当前时间: 1970-01-01 08:00:00

分类:办公文件

评论(0)

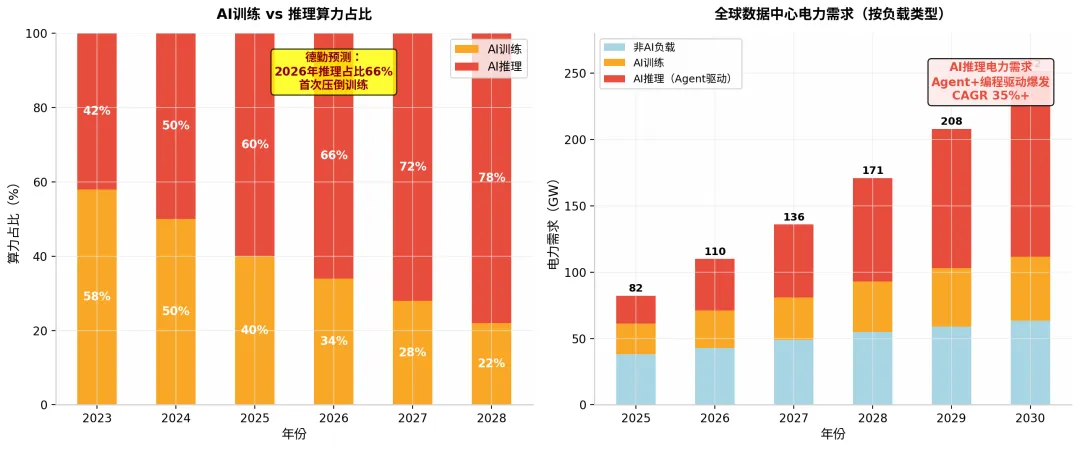

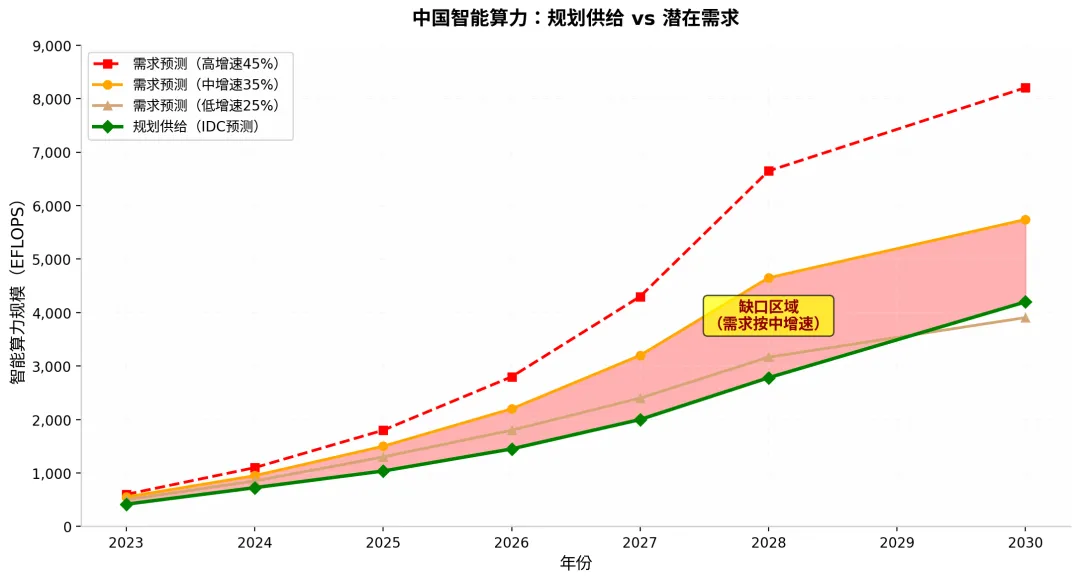

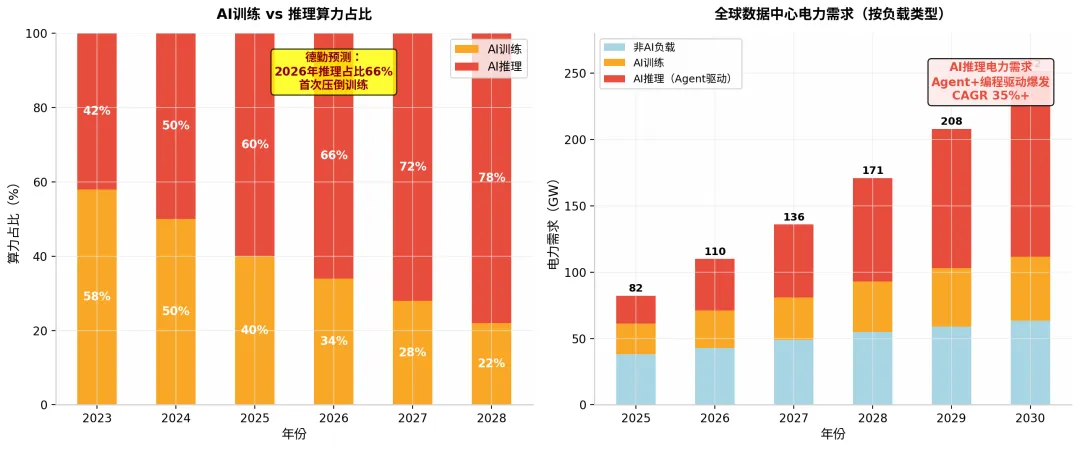

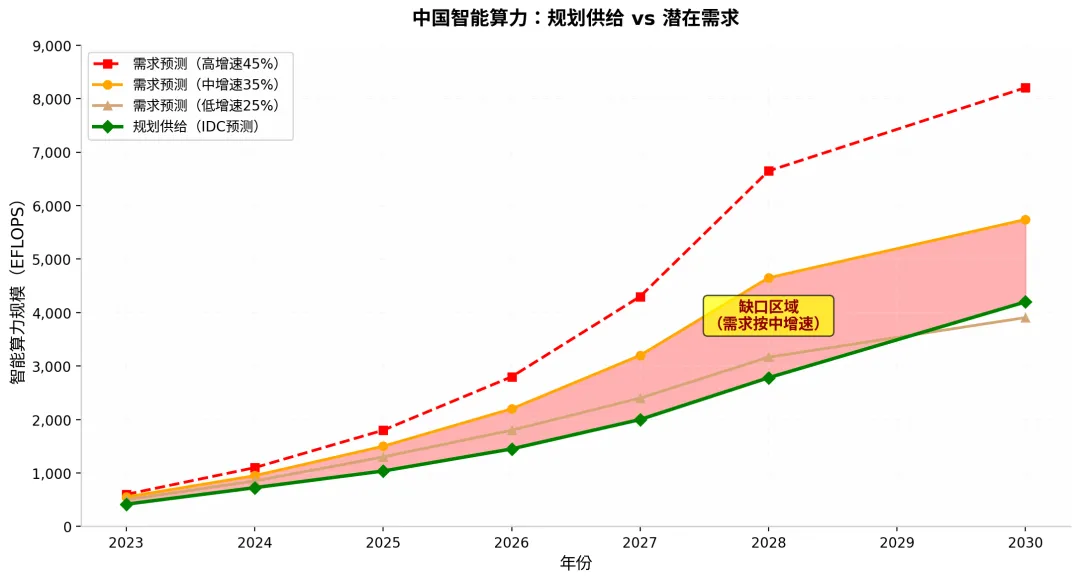

AI缺电,也缺算力?现在任何一个投资群,如果不讨论点光模块这样的热票,都会显得这个群的含登量特别高。我潜水的那个群就是这样。白天有人吹票,晚上有人复盘,凌晨两点还有人发研报截图。你要是不跟着哼哼两声,显得你自认很登。前两天群里有人突然来了一句,「AI基建,是不是已经泡沫了?」另一个人立刻怼回去,「泡什么沫,你看看英伟达的订单排到哪年了。」两个人争了不下半小时,从马斯克卖算力中心争到中国西部的风电,谁也没说服谁。我端着手机,看得一愣一愣的,发现自己居然插不上话。回来我就做了一件特别无聊的事。我让一个智能体去查。给它丢了一句指令,「搞清楚中美算力到底够不够,AI基建到底有没有泡沫,越具体越好。」它吭哧吭哧跑了半小时,交上来一份七千字的报告。我看完,挺意外。说泡沫的人,手里不是没有证据。美国科技批评家艾德·齐特龙,这个人你可能没听说过,但他不是无名之辈,他是个科技播客主持人,被「纽约客」、「大西洋月刊」等主流媒体都报道过,他最近干了一件特别狠的事。他花了一周时间,把微软、亚马逊、OpenAi、马斯克这些公司从2023年到2024年宣布的所有「吉瓦级数据中心」项目,挨个用卫星图、美国环保局的排放许可、还有当地市政记录,对了一遍账。微软CEO纳德拉每季度都在说「我们又新增了1吉瓦」。齐特龙翻遍地图,凑不出4吉瓦。一家叫半导分析的研究机构确认微软冻结了1.5吉瓦的自建计划,还取消了两倍于此的租赁意向。所谓的「全面投产」呢?亚马逊去年十月宣布雷尼尔项目「全面投产」,美国消费者新闻与商业频道的标题写得像模像样。实际是,规划30栋楼,通了7栋。7栋,约500兆瓦。跟宣称的2.2吉瓦之间,差了一个数量级。齐特龙管这叫「PPT产能」。我觉得这个词太客气了。应该叫「全面投产式话术陷阱」。更离谱的是凯文·奥利里,就是那个「创智赢家」节目里的光头投资人,他在犹他州画了一个9吉瓦的大饼。9吉瓦是什么概念?全美国数据中心加起来也就几十吉瓦。这相当于说自己要在沙漠里再造一个三峡,专门给电脑供电。今年四月刚获批,地都没铲。所以,供给侧的水分是真实存在的。行业宣称的数百吉瓦容量,经过卫星图加排放许可这两板斧一砍,水分能拧掉一半以上。这一点,你不能不承认。但故事如果只讲到这儿,那就成了一篇单纯的做空报告。而智能体提到的另一半内容,让我刚准备了一肚子做空的狠话,直接给噎回去了。。德勤今年最新报告里有一个数据,我读了三遍才信。到2026年,全球人工智能计算工作负载里,推理的占比将从2023年的42%飙升到66%。第一次压倒训练。什么意思呢?以前大家砸钱训练大模型,练完就完了,属于一次性爆发。但现在企业把模型搬回家之后,是7乘24小时不间断地跑。你每问一次、每生成一张图、每让智能体帮你订个外卖,背后都是算力在燃烧。国家数据局给了一个测算,未来推理算力需求与训练算力需求之比,将达到3比1甚至更高。我粗算了一下,一个1700亿参数的模型,单次训练需要350PF-days。但如果日活1000万用户,每人每天聊10轮,全年推理所需的算力是训练的3.4倍。而且这还只是开始。这里有一个特别反直觉的现象,经济学里叫杰文斯悖论。简单说就是,当一样东西变得更便宜,人们不会少用它,反而会用得更多。AI推理的单词元成本,这两年下降了大约1000倍。按理说成本降了,开销该少了对吧?不,总需求涨了100倍。英伟达预计,到2030年人工智能基础设施支出将达到3万亿到4万亿美元。智能体给我的报告里引了一个Anthropic的例子,我觉得特别形象。半导分析的迪伦·帕特尔说,Anthropic今年一月年度经常性收入还只有40亿,二月就跳到了60亿。年底需要超过5吉瓦的算力才能满足需求。但他们之前采购太保守,现在不得不接受更高价格、甚至让出收入分成,才能拿到芯片。最讽刺的是什么呢?是H100,英伟达三年前的老芯片,今天比三年前更值钱。因为更强的模型能从同一颗芯片里榨出更多价值,而芯片的供给始终有限。算力的稀缺性,已经从「缺卡」变成了「缺电」,最终可能变成「缺地」。坦率的讲,今年年初你跟我说AI基建有泡沫,我可能还会跟着哼哼两声。那时候大模型还在卷参数,训练完就完了,推理没起量,大家看着一堆规划中的数据中心心里发虚,觉得产能过剩,情有可原。AI编程的Token消耗已经炸了。智能体那边是7乘24小时不间断在跑。还有小龙虾那帮人,烧图形处理器的速度跟不要钱似的。这三个东西加在一起,Token消耗已经不是线性增长,是指数级在跳。你再跟我说泡沫,我就真的只能回你一句,站不住脚了。所以你看,供给侧有水分,需求侧在爆表。这两件事不是互相抵消的,是双重挤压。智能体调研的那份报告里算了一笔账,我觉得可以分享给大家。中国这边,工信部副部长张云明四月份刚公布的数据,截至2026年3月底,中国智能算力规模达到1882每秒百亿亿次浮点运算,半年增长了139%。已建成万卡智算集群42个,智算中心项目超过500个。听起来很猛对吧?但即便按这个速度,2026年的缺口仍有约800每秒百亿亿次浮点运算,占需求的25%。到2028年,缺口会扩大到3000每秒百亿亿次浮点运算,占42%。美国那边,高盛五月份的研报更直接。美国数据中心电力需求,2025年是31吉瓦,2026年跳到41吉瓦,2027年直接翻倍到66吉瓦。占美国夏季高峰电力的比例,从4.1%涨到8.5%。高盛还特别补了一刀,说历史数据显示,原计划未来四个季度上线的数据中心,仅约72%能按时落地。项目排期越靠后,兑现概率越低。贝恩咨询的数字则给整个故事加了一层寒意。他们说,到2030年全球AI算力总需求将达200吉瓦,每年需要投入约5000亿美元建设数据中心。但这需要对应2万亿美元的年营收才能维持财务健康。即便把所有企业IT预算和AI带来的成本节约全部再投资,仍有8000亿美元的营收缺口。翻译成人话就是,现在的投资强度,财务上根本撑不住。部分项目必然会被推迟或取消。我必须诚实地说,这块我特别谨慎。不是因为那份调研报告不好,而是因为相关标的已经涨上了天。这个时候再写「投资机会」,不是在帮人,是在害人。智能体那份报告列了五大赛道,光模块、电力设备、液冷散热、国产算力、数据中心运营商。但我想把报告里最硬核的三个问题留给你。这三个问题,比任何「买入」建议都值钱。艾德·齐特龙的调查最后落在一个字上:电。美国PJM电网2026到2027年的容量拍卖价,两年涨了10倍。中国「算电协同」已经写入2026年政府工作报告。变压器、高压直流输电、不间断电源的交货周期长达12到18个月。电是终极瓶颈,不是芯片,不是软件,是电。推理占比66%,意味着数据中心内部的东西向流量暴增。一个推理集群里,图形处理器之间的通信量远大于训练集群。800G和1.6T光模块,从「可选升级」变成了「刚需标配」。这不是预测,是已经发生的现实。机架功率密度五年间涨了11倍,从13千瓦飙到130千瓦。英伟达下一代架构的目标是600千瓦每机架。传统风冷早就撑不住了,液冷从「高端选配」变成了「入门标配」。马斯克在孟菲斯的数据中心,被逼得装了35台燃气轮机来散热。你说这问题有多急?能回答这三个问题的公司,才是真正值得研究的标的。而不是那些只会喊「我们规划了10吉瓦」的公司。如果你问的是「科技巨头的宣传有没有泡沫」,答案是肯定的。全面投产可能只通了23%的电,「即将上线」可能还是一片空地。这部分水分,迟早要被挤掉。但如果你问的是「算力需求本身有没有泡沫」,答案是否定的。推理正在吞噬一切,成本降千倍换来需求涨百倍,这不是泡沫,这是底层的物理规律在起作用。真正的风险不在于「有没有泡沫」,而在于「你买的是什么」。你是在买PPT,还是在买电、买光、买冷?你是在投预期,还是在投真正能交付的稀缺产能?以上就是今天的全部甲片。点个「在看」👇,让它被该看见的人看见。关注【海畔铠甲录】,斯基在这里一片一片攒铠甲。星标⭐一下,不然下次拆到你关注的票,可能就刷不到了。

基本

文件

流程

错误

SQL

调试

- 请求信息 : 2026-05-14 14:18:29 HTTP/1.1 GET : https://www.yeyulingfeng.com/a/624484.html

- 运行时间 : 0.096009s [ 吞吐率:10.42req/s ] 内存消耗:4,745.63kb 文件加载:145

- 缓存信息 : 0 reads,0 writes

- 会话信息 : SESSION_ID=9e23b67054646f6feeed6fa78b780f72

- CONNECT:[ UseTime:0.000529s ] mysql:host=127.0.0.1;port=3306;dbname=wenku;charset=utf8mb4

- SHOW FULL COLUMNS FROM `fenlei` [ RunTime:0.000700s ]

- SELECT * FROM `fenlei` WHERE `fid` = 0 [ RunTime:0.000293s ]

- SELECT * FROM `fenlei` WHERE `fid` = 63 [ RunTime:0.000305s ]

- SHOW FULL COLUMNS FROM `set` [ RunTime:0.000597s ]

- SELECT * FROM `set` [ RunTime:0.000239s ]

- SHOW FULL COLUMNS FROM `article` [ RunTime:0.000715s ]

- SELECT * FROM `article` WHERE `id` = 624484 LIMIT 1 [ RunTime:0.000468s ]

- UPDATE `article` SET `lasttime` = 1778739509 WHERE `id` = 624484 [ RunTime:0.000853s ]

- SELECT * FROM `fenlei` WHERE `id` = 64 LIMIT 1 [ RunTime:0.000227s ]

- SELECT * FROM `article` WHERE `id` < 624484 ORDER BY `id` DESC LIMIT 1 [ RunTime:0.000392s ]

- SELECT * FROM `article` WHERE `id` > 624484 ORDER BY `id` ASC LIMIT 1 [ RunTime:0.000338s ]

- SELECT * FROM `article` WHERE `id` < 624484 ORDER BY `id` DESC LIMIT 10 [ RunTime:0.001047s ]

- SELECT * FROM `article` WHERE `id` < 624484 ORDER BY `id` DESC LIMIT 10,10 [ RunTime:0.000958s ]

- SELECT * FROM `article` WHERE `id` < 624484 ORDER BY `id` DESC LIMIT 20,10 [ RunTime:0.002579s ]

0.097891s