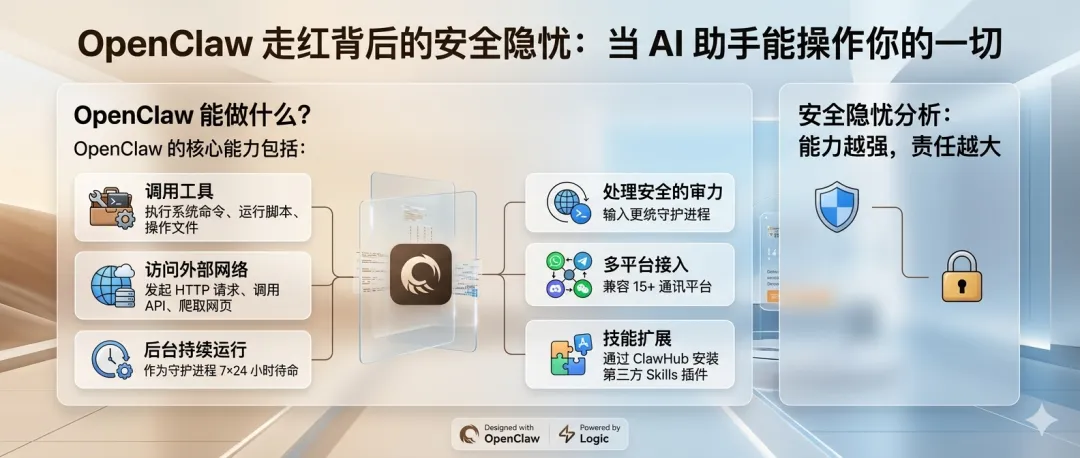

OpenClaw 走红背后的安全隐忧:当 AI 助手能操作你的一切

能力越强,风险边界越广。这不是”将来可能出问题”的预警,而是”现在需要重视”的现实。

一、现象:OpenClaw 的 2026 开年走红

2026 年开年以来,一款名为 OpenClaw 的开源 AI 智能体软件在全球科技圈迅速走红。

这款由奥地利独立开发者 Peter Steinberger 以个人力量开发的项目,能够在现实世界执行任务、代表用户采取行动——从调用工具、操作本地文件,到访问外部网络、在后台持续运行任务。

2 月 16 日,OpenAI 正式宣布 Peter Steinberger 加入公司,担任重要开发角色,专注于推动下一代个人 AI 智能体的研发。OpenAI 首席执行官 Sam Altman 确认了这一人事变动,并表示:

“Peter 拥有许多关于智能体相互协作的绝妙想法。未来将极度依赖多智能体系统,这种智能体间协作能力将迅速成为我们产品核心。”

与此同时,OpenClaw 项目将转型为一个基金会形式,继续作为开源项目存在,并获得 OpenAI 的持续支持。

然而,随着 OpenClaw 的能力边界不断扩展,一个不容忽视的问题浮出水面:当 AI 助手能够操作你的一切时,安全如何保障?

二、能力:OpenClaw 能做什么?

根据 GitHub 官方文档,OpenClaw 的核心能力包括:

2.1 核心功能

- 调用工具

— 执行系统命令、运行脚本、操作文件 - 访问外部网络

— 发起 HTTP 请求、调用 API、爬取网页 - 后台持续运行

— 作为守护进程 7×24 小时待命 - 多平台接入

— 兼容 15+ 通讯平台(WhatsApp、Telegram、Discord、飞书、微信等) - 技能扩展

— 通过 ClawHub 安装第三方 Skills 插件

2.2 典型使用场景

用户:”帮我整理昨天的会议记录,发到飞书群里”

OpenClaw 自动:

1. 读取本地录音文件

2. 调用语音转文字 API

3. 整理成结构化文档

4. 通过飞书 API 发送到指定群组

这种”一句话完成复杂任务”的体验,正是 OpenClaw 走红的核心原因。但反过来看,这意味着 OpenClaw 拥有极高的系统权限——它能读你的文件、发你的消息、访问你的 API 密钥。

三、风险:潜在安全隐患全景图

我们通过搜索和调研,梳理出 OpenClaw 可能存在的四类安全风险:

3.1 风险一:Skills 插件质量参差不齐

OpenClaw 的技能生态系统 ClawHub 允许第三方开发者发布 Skills 插件。根据 36Kr 采访的一家匿名安全公司透露:

“Skills 市场里约 10% 的插件存在恶意行为,有的会诱导 AI 执行恶意命令,有的在后台静默窃取数据。”

-

伪装成”效率工具”,实际后台上传用户数据 -

诱导 AI 执行系统命令(如 rm -rf、curl http://malicious.com) -

窃取 API 密钥、数据库凭证等敏感信息

3.2 风险二:高权限访问可能被盗用

OpenClaw 默认以当前用户权限运行,这意味着:

-

如果攻击者通过提示词注入控制 OpenClaw,就能以你的身份执行操作 -

接入的 API 密钥(如飞书、微信、GitHub)可能被滥用 -

本地文件(包括代码、文档、配置)可能被读取外发

3.3 风险三:提示词注入攻击

提示词注入(Prompt Injection)是大模型应用的常见攻击方式。攻击者可以通过精心设计的输入,诱导 AI 绕过安全限制:

虽然 OpenClaw 在官方文档中提到了安全防护,但实际效果取决于具体配置和用户警惕性。

3.4 风险四:企业无法追踪内网安装实例

对于企业 IT 管理者而言,一个棘手的问题是:根本不清楚内网里有多少员工私自安装了 OpenClaw。

-

员工可能用个人账号安装,接入企业系统 -

离职员工可能保留访问权限 -

多个 OpenClaw 实例可能形成攻击面叠加

四、官方应对:安全机制现状

我们在 GitHub 上查看了 OpenClaw 的官方安全策略(Security Policy),发现以下机制:

4.1 漏洞报告渠道

- 核心 CLI 和 Gateway

— 报告至 openclaw/openclaw - macOS/iOS/Android 应用

— 分别报告至对应目录 - ClawHub

— 报告至 openclaw/clawhub - 通用问题

— 发送邮件至 security@openclaw.ai

4.2 报告要求

官方要求漏洞报告包含:

1. 标题和严重性评估

2. 影响范围

3. 受影响组件

4. 技术复现步骤

5. 演示影响

6. 环境信息

7. 修复建议

4.3 明确”不在范围”的内容

以下情况官方通常不予受理:

-

仅通过提示词注入、无边界绕过的攻击 -

需要可信操作员配合的操作(如安装恶意插件) -

本地功能被呈现为远程注入(如 TUI 本地 shell) -

授权用户触发的本地操作被呈现为权限提升

五、企业该如何应对?

基于上述分析,我们为企业 IT 决策者提出以下建议:

5.1 短期措施(立即执行)

| 网络隔离 | 将 OpenClaw 实例限制在独立 VLAN,禁止访问核心系统 || 权限回收 | 检查并回收不必要的 API 密钥和系统权限 || 资产盘点 | 扫描内网,统计已安装的 OpenClaw 实例数量 || 员工培训 | 告知员工 AI 工具的安全风险和使用规范 |

5.2 中期措施(1-3 个月)

| 部署企业级方案 | 考虑 ClawForce 等企业级 Agent 管理平台 || 建立审计日志 | 记录所有 AI 工具的操作行为 || Skills 审核机制 | 建立内部 Skills 白名单,禁止随意安装 || 定期安全检测 | 每季度进行 AI 工具安全审计 |

5.3 长期措施(3-6 个月)

| AI 安全治理体系 | 将 AI 工具纳入企业整体安全框架 || 供应商评估 | 对 AI 工具供应商进行安全资质审核 || 应急预案 | 制定 AI 工具安全事件的响应流程 || 合规审查 | 确保 AI 工具使用符合数据保护法规 |

六、理性看待:风险与机遇并存

在撰写本文的过程中,我们刻意避免了夸大其词的表述。原因很简单:OpenClaw 代表的 AI 智能体方向,是技术发展的必然趋势。

6.1 不应该因噎废食

-

AI 助手能大幅提升工作效率 -

自动化复杂任务是未来的核心竞争力 -

完全禁止 AI 工具会让企业失去创新机会

6.2 但必须重视风险

-

安全机制必须与功能迭代同步 -

企业需要建立 AI 工具使用规范 -

开源项目需要完善的安全治理

正如 36Kr 报道中那家安全公司所说:

“OpenClaw 出来之前,我们已经做了三年 AI 安全。所以当它真正爆发的时候,我们没有太慌,但也不得不承认,变化的速度还是超出了所有人的预期。”

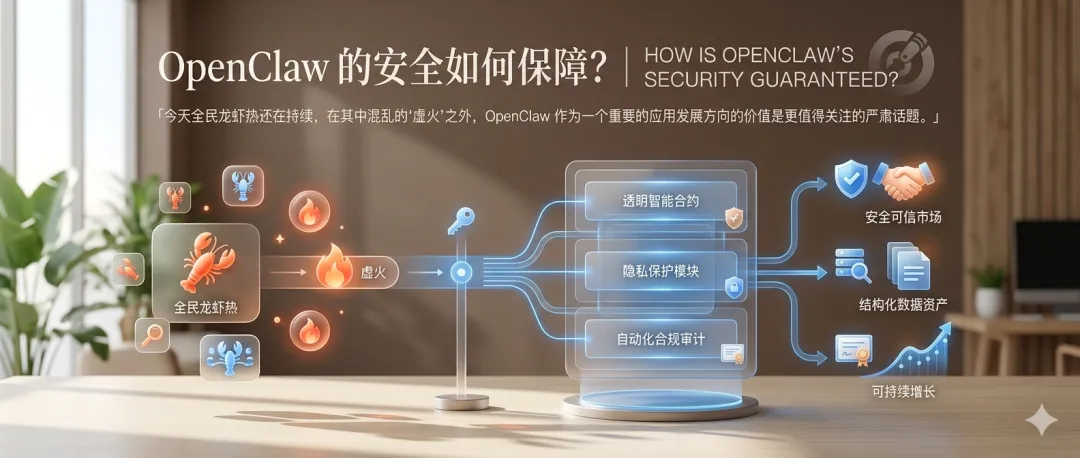

“今天全民龙虾热还在持续,在其中混乱的’虚火’之外,OpenClaw 作为一个重要的应用发展方向的价值是更值得关注的严肃话题。”

七、结语:安全是能力,不是障碍

OpenClaw 的走红,标志着 AI 从”对话助手”迈向”行动助手”的时代已经到来。这个转变带来的不仅是效率提升,还有全新的安全挑战。

-

不要盲目禁止,也不要放任自流 -

建立规范、持续审计、及时响应 -

把 AI 安全当作能力建设,而不是成本负担

-

在追求功能的同时,重视安全设计 -

主动报告漏洞,参与社区安全建设 -

推动行业安全标准的建立

-

了解 AI 工具的能力边界 -

谨慎授权,定期检查权限 -

不随意安装来源不明的 Skills

夜雨聆风

夜雨聆风