每天解析一款AI工具:视觉重定义:Luma Dream Machine终结“天价渲染”?

01.行业地位:2026视频工业的“物理引擎”

-

性能标杆:在2026年,Luma的Ray3.14架构已经实现了1080p原生生成,且成本降低了3倍,速度提升了4倍。 -

行业渗透:它是2026年戛纳狮子国际创意节(Cannes Lions)最活跃的幕后推手。仅在2026年初的8个月内,就有超过400支广告作品通过Luma完成核心特效与场景构建。 -

核心竞争力:不同于只会“堆砌像素”的模型,Luma的视频是基于3D理解的。它生成的画面符合真实的物理规律(如正确的光影折射和视差变化),这让它成为了电影工业唯一认可的“AI副导演”。

02.2026核心特性:它为什么是“分镜师的噩梦”?

-

物理级相机控制(Cinematic Camera Control):你不再需要复杂的Prompt。只需输入“推拉镜头(Dolly)”、“环绕(Orbit)”或“摇移(Pan)”,AI就能像真正的摄影师一样移动。因为模型内部有3D场景理解,所有的透视变形都精准无误。 -

Ray3推理引擎(Reasoning-driven Generation):2026年的Ray3具备“思考能力”。当你输入“一个女孩在雨中奔跑”,它会理解重力、雨滴的飞溅方向以及角色在湿滑地面上的步态逻辑,而不仅仅是画面重组。 -

Draft Mode(毫秒级草图模式):这是2026年最受欢迎的功能。它能以5倍的速度和5倍的低成本产出预览短片。你可以快速迭代10种运镜方案,选中最满意的,再一键进行4KHDR深度渲染。 -

Modify Video(局部重构):不满意主角的衣服?想把白天换成黄昏?只需选中画面区域并输入指令。由于具备“场景感知”能力,背景物体在角色移动时依然能保持几何一致性。

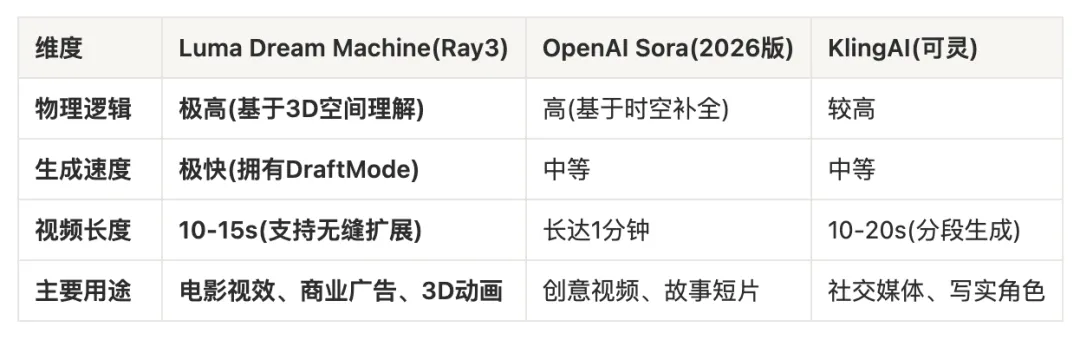

03.2026视频AI三巨头权力榜

夜雨聆风

夜雨聆风