OpenClaw*Hermes 智能体|Python 机器学习|氛围编程

免费数据资源丨大气专栏丨双碳专栏丨免费教程

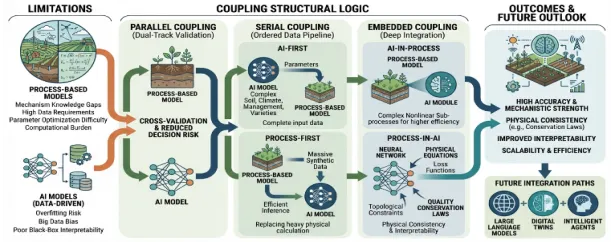

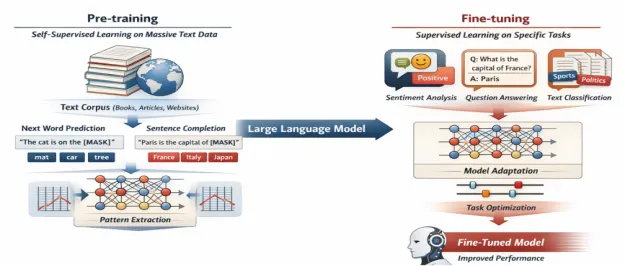

在AI技术狂飙突进的今天,科研工作正在经历一场静默而深刻的变革。从文献阅读到代码编写,从数据分析到论文写作,大语言模型正在重新定义“科研生产力”的上限。然而,真正的问题不在于“AI能做什么”,而在于——你是否拥有一套属于自己的、可持续进化的AI科研系统?

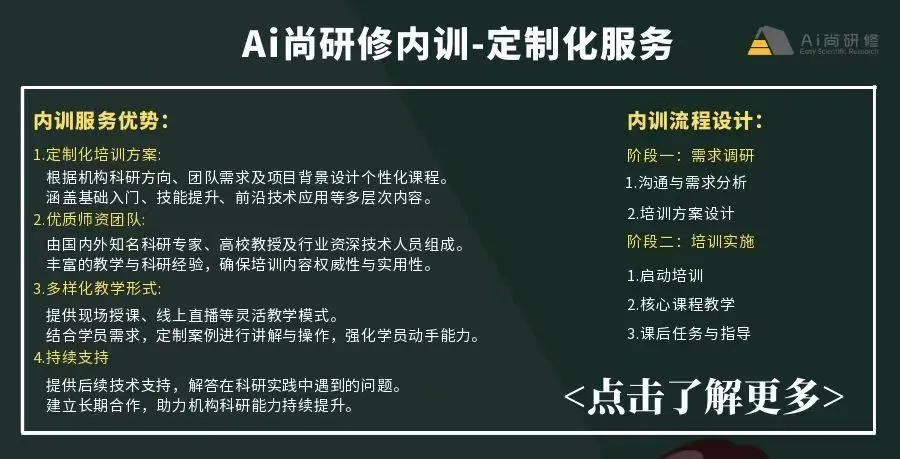

为此,我们精心策划了几场深度实战培训,帮助您从“使用AI”跨越到“构建AI”,让工具真正成为您科研道路上的长期合伙人。

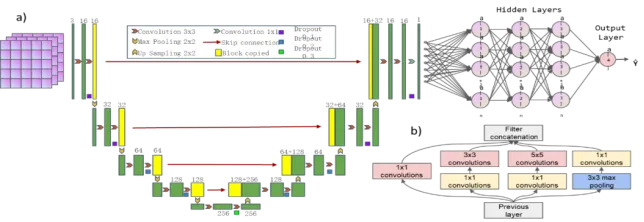

🌟 课程一:最新AI-Python机器学习、深度学习核心技术与前沿应用及Agent自动化全链路实践高级研修班

🌟 课程三:第四期:2026基于前沿AI-Agent2.0驱动的科研全链路实战营:一站式掌握LLM与Notebooklm应用、数据分析、自动化编程、文献管理到论文写作的核心技能、手把手搭建本地LLM与Agent,体验多模型“圆桌会议”的头脑风暴、基于N8N与OpenClaw、Claude Code构建从文献挖掘到成果产出的自主智能体、解锁Seedance2,轻松将论文转化为高质量的科研科普视频

📅 培训时间

-

直播时间:2026年5月16日-17日、23日-24日(腾讯会议直播)

📋 课程内容简要

📞 报名咨询

微信二维码:

课程二

课程三

📢 科研真正的挑战从来不是“有没有答案”,而是:如何高效整合信息、持续产生高质量IDEA,并把研究想法快速转化为可发表成果。而这,正是大多数通用AI使用方式所无法解决的。

本课程是一门面向科研人员、研究生、博士生、高校教师以及高端知识工作者的系统化实战训练营,以“工具即生产力,Agent即科研合作者”为核心理念,带你从“使用AI”进阶到“构建AI系统”。课程将系统讲解如何将主流大语言模型深度融合进:

1.科研写作与论文生产流程

2.实验与科研数据分析

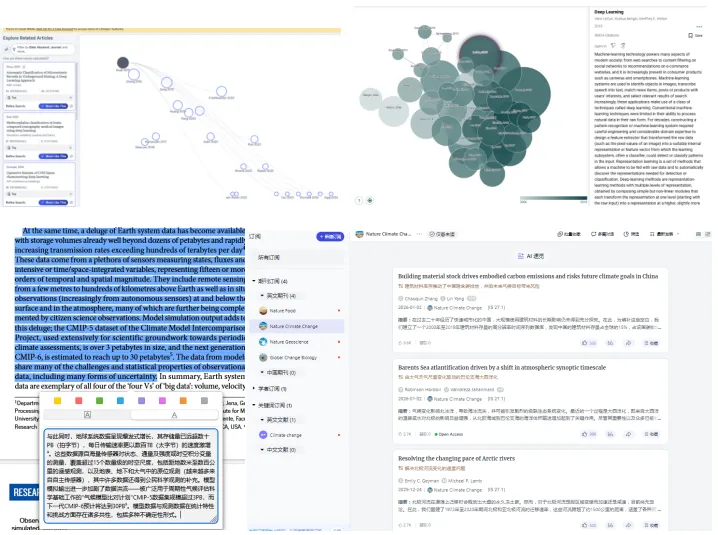

3.文献管理与知识体系构建

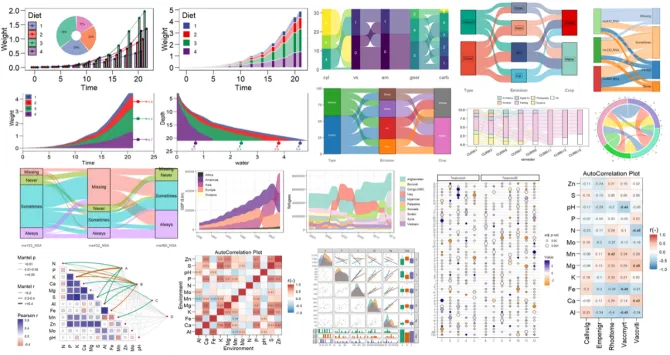

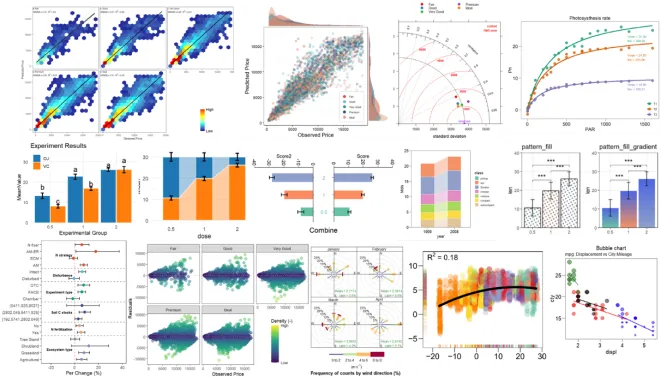

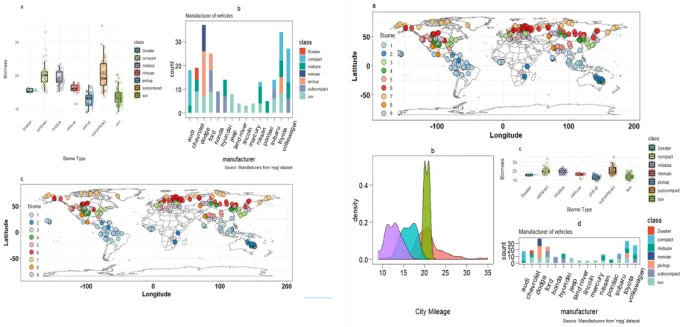

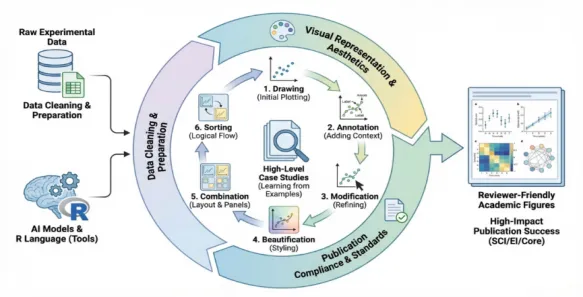

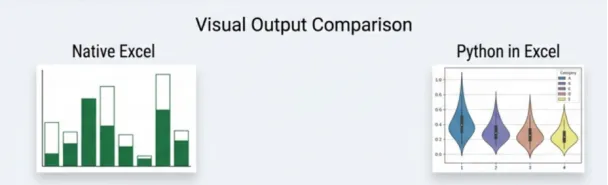

4.科研绘图与学术级可视化表达

5.多模型协作的创新型科研思考

6.基于NotebookLM 的研究资料整合、来源引用与可信推理

7.Google生态系统自动化科研工作流与AI Agent系统

通过真实科研场景与完整案例,你将学会如何让AI主动协助你思考、决策与创作,而不仅仅是被动回答问题。

通过本课程,你将不只是学会“使用AI”,而是能够真正做到:

1.构建属于自己的科研AI Agent,让AI成为你的长期研究助手

2.打造可持续复利的个人科研系统,知识与成果持续积累

3.显著提升科研效率与创新能力,减少重复劳动,专注高价值思考

4.让AI成为你稳定、可靠、可进化的科研合作者

这不是一门“教你玩AI的课程”,而是一门帮助你在AI时代建立长期科研竞争力的系统训练营。最后将总结Google Gemini(Nano Banana),AI Studio,Notebooklm等谷歌一系列生态系统,如何使用这些打造专属个人自动科研系统。

当前AI发展日新月异,大模型迭代速度显著加快,或许有一天人类终将被AI淘汰,但希望你我不是最先被AI淘汰的个人。

通过大语言模型生成数据统计图

Ollama部署LLAMA/DeepSeek

本地模型性能优化

RAG构建个人知识库

微调vs RAG的选择策略

Open WenUI本地部署,

如何结合Zotero和Open WenUI搭建本地知识系统

在本地环境里构建类似NotebookLM的科研生态系统(不需要科学上网,就能运行)

案例7:

本地部署DeepSeek→构建:

专属科研问答系统

私有文献分析Agent

结课成果:

一个私有科研AI Agent

多LLM分工机制

批判型/创新型Agent设计

自动迭代研究方案

模型的能力越强,Idea的创意更好

案例8:

ChatGPT+Claude→自动进行多轮讨论,生成创新研究方向。

结课成果:

一份「可投稿级研究IDEA说明书」

N8N基础与部署

多软件自动联动

多模型优势整合

全流程科研自动化设计

整合Google工作系统流

实战案例

案例9:

构建一个完整系统:

通过DeepSeek创建全自动科研文献搜索总结系统

最终交付:

一套可长期使用的科研文献搜索总结自动化系统

第十一章、Seedance 2.0视频生产大模型基础与科研科普自动化

课程四

📢 课程完整产出

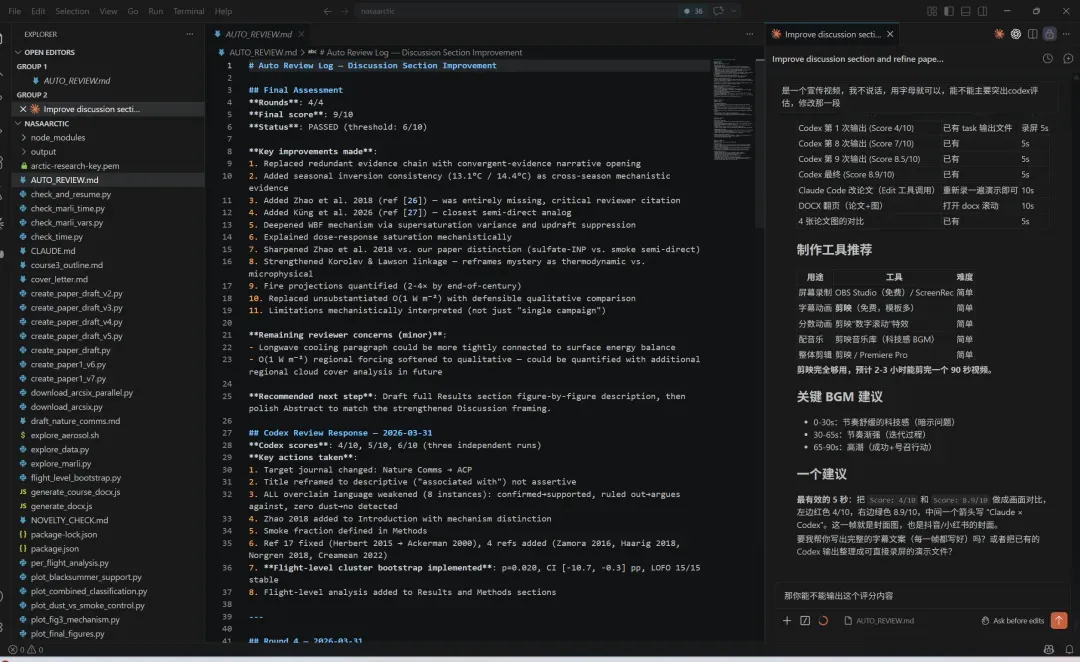

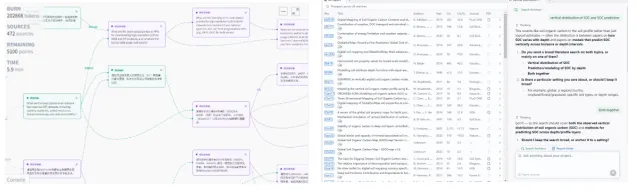

cluodcode自动化工作流图片

📋 课程内容简要

第一天:Claude Code科研深度使用——从数据到论文初稿

产出:完整Claude Code项目环境– 数据已下载、清洗、分析

第二天:Codex交叉审稿 + 迭代改进 + 投稿准备

产出:论文经过3轮交叉审稿,含完整改进记录-投稿级图表-论文DOCX + Cover Lette-学员自己课题的初步成果

课程五

🎁 学员课前准备

为确保每位学员都能顺利上手实操,课程开始前一周将讲解详细的环境配置教程,并提供一份配置说明文档,助你轻松搞定复杂环境搭建!

1.安装好Python、Git、VS Code

2.准备至少1-2个可调用API的模型账号

3.准备安装或已安装OpenClaw、Hermes、Cursor、Claude Code、Codex

4.自带一个科研题目、一份数据样例或2-3篇代表性论文,便于课堂演练

5.若计划实操本地部署,建议电脑具备较大内存或可连接GPU服务器

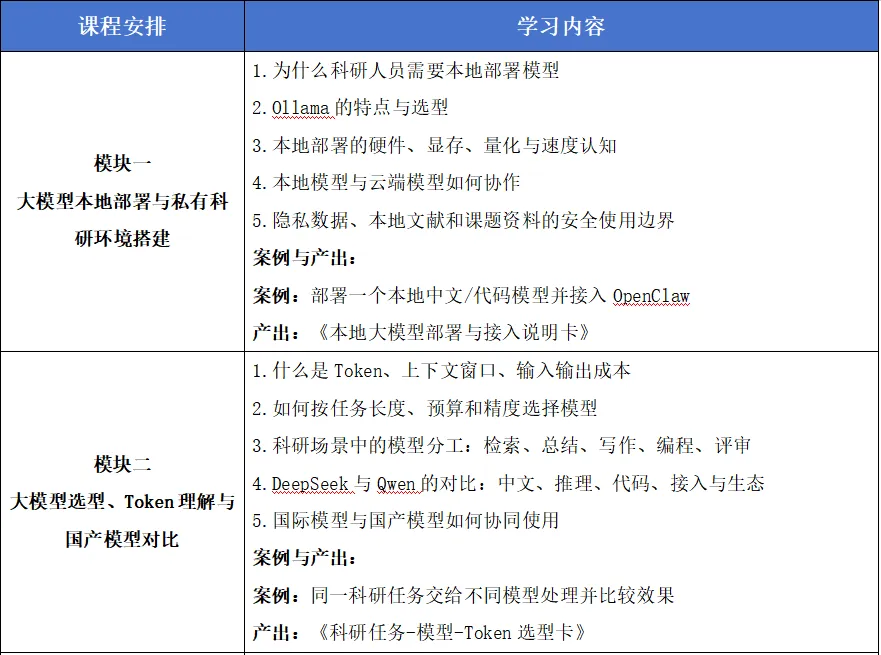

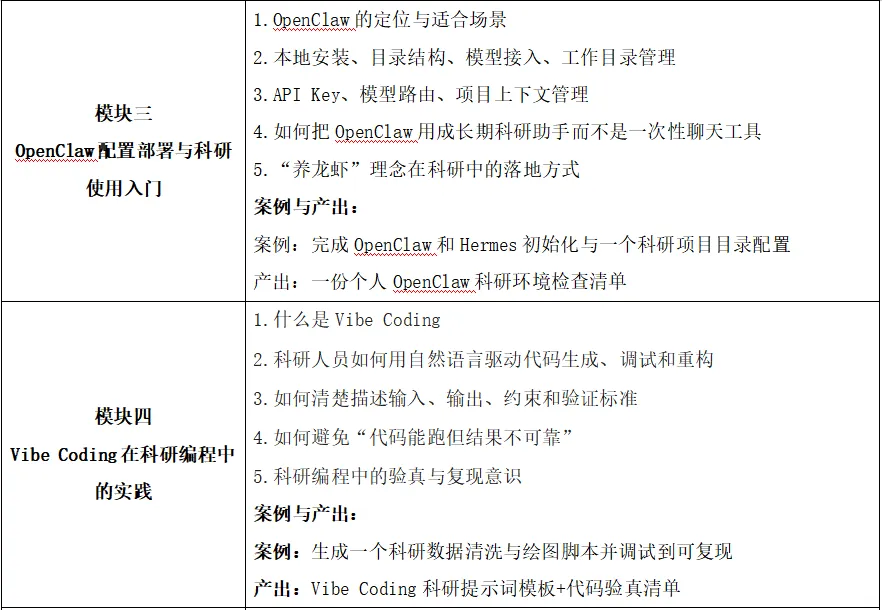

🎯课程结束后建议交付成果

1.一个已完成基础配置的OpenClaw科研环境

2.一份《科研任务-模型-Token选型卡》

3.一份《本地大模型部署与接入说明卡》

4.一份《科研Agent编程工具对比表》

5.两个科研Skill初稿

6.一份《科研MCP接入蓝图》

7.一份《科研云端数据管理与下载流程模板》

8.一套个人多模型论文写作自动化流程图

9.一份《个人OpenClaw科研助手搭建方案》

10.一份《NotebookLM、Claude Code、Obsidian的知识工作流》

⚡ 培训目标

1. 独立完成 OpenClaw、Hermes的安装、配置、模型接入与基础使用。相对于Openclaw,Hermes具有自我成长的功能。

2. 理解 Token、上下文窗口、调用成本与模型能力边界

3. 学会比较并选择不同大模型,尤其是 DeepSeek 、Qwen、Chatgpt、Opus、Gemma4、Kimi、GLM、Minimax

4. 掌握开源大模型本地部署的基本路径,如Ollama的适用场景,Ollama本地部署Gemma4和Qwen3.5后运行Claude,保存本地数据隐私性。Openclaw、Codex、Claude Code运行本地大模型

5. 学会建立科研数据的云端存储、快速下载与版本化管理流程

6. 掌握Vibe Coding在科研编程中的正确工作方法

7. 学会用Agent完成科研数据可视化与结果解释

8. 学会使用Cursor、VS Code、Codex、Claude Code 完成科研代码任务

9. 学会编写科研SKILL,理解MCP的扩展价值

10. 设计一套属于自己的多模型论文写作自动化工作流

11.掌握一套从NotebookLM、Claude Code、Obsidian知识管理自动化工作流(无论是老师还是学生都可以复现MIT研究生48小时掌握一门课)

12.通过Hermes Agent生成Karpathy的LLM-Wiki的Obsidian知识库

📢重点专题说明

1.如何讲清楚Token选择:

1)Token是模型处理文本的基本计量单位,不等于简单字数

2)选模型不仅看“聪不聪明”,还要看上下文、速度、成本和稳定性

3)真正高效的科研工作流通常是多模型分工,而不是只用一个最贵模型

4)要教会学员把高质量模型用在关键步骤,把高性价比模型用在重复步骤

2.中国两个大模型与美国三个大模型对比:

1)DeepSeek适合推理链、代码、数学与结构化任务

2)Qwen适合中文理解、通用办公、生态兼容和平台接入

3)Gemini的Nano Banana适合绘图

4)Opus搭配Claude Code适合写代码和论文

5)Chatgpt5.4搭配Codex适合执行任务

6)教学中应强调“任务分工”而不是简单比较谁更强

3.如何“养龙虾进行科研”:

1)长期培养一个懂你课题和工作习惯的科研助手

2)用规则、Skill、MCP、知识材料和模板持续迭代Agent

3)把每次科研实践沉淀成可复用的流程资产

4.本地部署与云端协同:

1)敏感数据、私有材料和高频重复任务优先考虑本地模型

2)高质量推理、长文写作和复杂审阅可调用云端强模型

3)最实用的方案往往不是全本地或全云端,而是“本地保密+云端增强”的混合策略

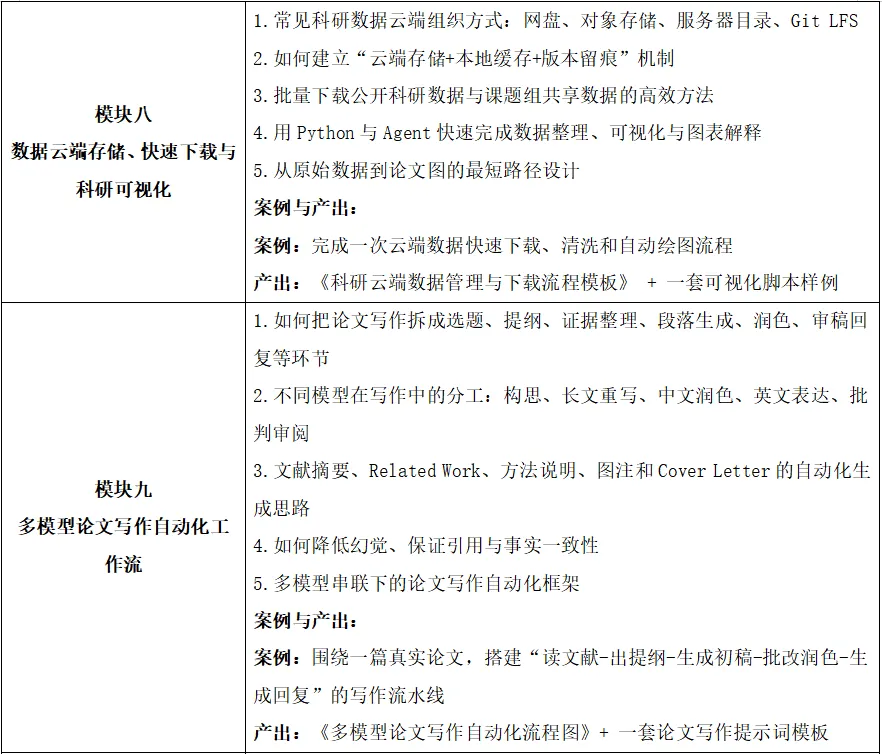

📋 课程内容简要

课程六

📢 课程核心差异化

1.真实数据驱动:使用Cochrane/JAMA已发表RCT的真实数据,非模拟数据,可溯源至原始文献。

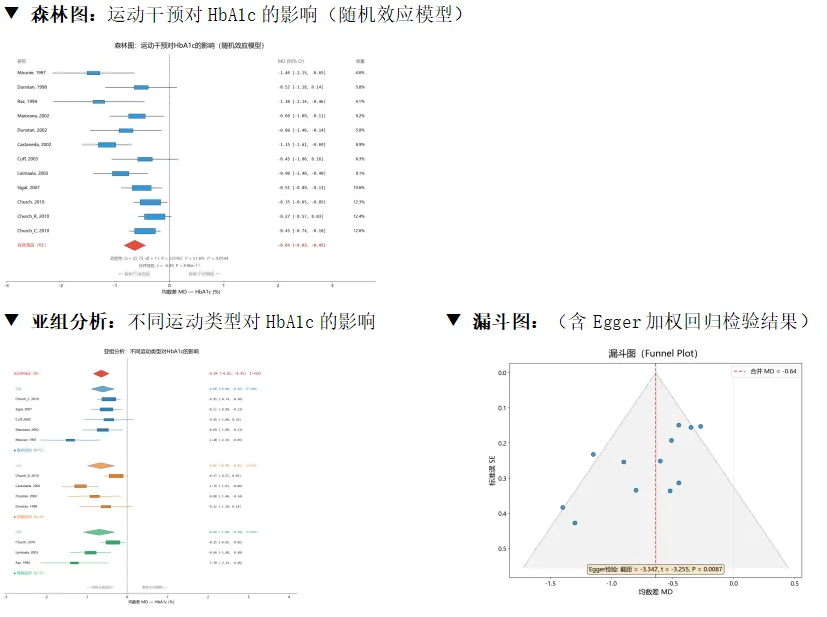

2.一条主线贯穿:从PICOS设计→PubMed检索→AI筛选→效应量计算→DL随机效应模型→森林图→漏斗图→亚组分析→敏感性分析→Results段落,两天做完完整Meta-Analysis。

3.AI深度提效:用Hermes Agent自动生成检索式、批量筛选文献、运行统计脚本、生成投稿级图表、撰写Results段落——亲眼见证AI把传统2周的工作压缩到2小时。

4.代码经双轮审阅:所有脚本经两轮代码审阅(Codex Review),Egger检验修正为加权回归(WLS)、SMD方差统一为含J²的Hedges标准公式、PRISMA计数改为动态计算,统计公式逐项验证。

5.带走你的专属科研智能体:你将带走一个配置好的Hermes Agent和Meta-Analysis统计Skill,利用其自进化能力,未来可一键复用到你的任何课题中。

📢 课程完整产出

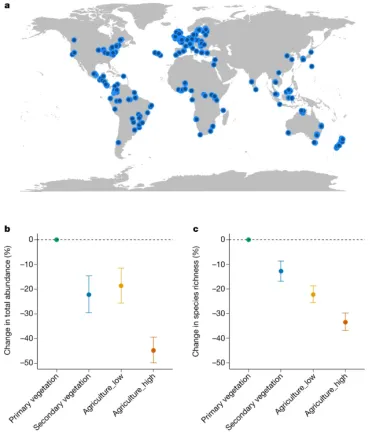

📢 【课程产出图表示例】(以下均为课程真实数据生成)

📅 培训时间

-

直播时间:5月30日-31日(腾讯会议直播)

🎯 培训方式

-

在线直播+助学群辅助+导师面对面实践工作交流

📋 课程内容简要

第一天:Hermes部署 + AI辅助文献检索与筛选

产出:Hermes科研环境 + 检索脚本 + 筛选结果 + 数据提取表

模块一、Hermes Agent部署与科研配置

1、Hermes安装→模型接入(DeepSeek/OpenAI/Anthropic)→验证运行

2、模型选择策略:Opus写作/Sonnet编码/Haiku批量筛选/Ollama本地

3、配置USER.md:让Hermes从通用助手变成”你的课题组成员”

4、备用方案:Claude Code替代+预录数据集兜底

模块二、PICOS设计与检索策略

1、AI辅助检索策略设计:Hermes生成PubMed检索式+MeSH词扩展

2、检索式逻辑完整性检查

3、其他学科案例展示(大气科学、心理学、教育学)

模块三、AI自动化文献检索与初筛

1、PubMed Entrez API批量检索(Biopython) 产出:检索脚本

2、Semantic Scholar补充检索 + 去重合并

3、AI辅助标题摘要筛选(逐篇判断+排除理由) 产出:筛选CSV

4、PRISMA 2020流程图生成(matplotlib动态计算)

模块四、数据提取与效应量计算

1、数据提取表设计+AI辅助PDF数据提取

2、效应量计算:均数差(MD)+标准化均数差(Hedges’g,含J校正)

3、使用课程真实数据(9项RCT/12臂,含Church 2010三臂试验说明)

第二天:统计分析 + Skill封装 + 个人落地

产出:4张投稿级图表 + 统计Skill + Results段落 + 个人方案

模块五、Meta-Analysis统计分析

1、DerSimonian-Laird随机效应模型(手动实现5步算法,纯numpy)

2、异质性检验:Q统计量、I²、τ²产出:统计报告

3、森林图:权重方块+合并钻石+数值标注(纯matplotlib)

4、亚组分析:按运动类型分组+组间异质性Q_between

5、漏斗图+Egger加权回归检验(正确WLS实现)

6、Leave-one-out敏感性分析 产出:4张投稿级图表

模块六、Skill封装与Hermes进化

1、将全套统计流程封装为Hermes Skill(输入CSV一键出图出报告)

2、Hermes自动优化Skill+团队共享方式

3、MCP扩展简介:Zotero文献管理、批量读PDF

模块七、AI辅助结果解读与写作

1、Hermes自动解读统计输出→生成Results段落初稿

2、标准学术句式模板(效应量+CI+P值+异质性描述)

3、AI写作边界:擅长格式化结果描述,需人工核验数值和引用

模块八、综合演练与个人落地

1、两天流程回顾:PICOS→检索→筛选→提取→统计→解读

2、学员自选题实操(60分钟):用自己的选题走全流程

3、Hermes长期维护方案:持续进化+Skill积累

4、Q&A+课后资源发放。

注:请提前自备电脑及安装所需软件。

课程七

📢 教学特色

📋 课程大纲

注:请提前自备电脑及安装所需软件。

📞 报名咨询

微信二维码:

直播课程推荐

AI赋能R-Meta分析核心技术:从热点挖掘到高级模型、助力高效科研与论文发表”培训班

直播时间:2026年4月24日-27日

直播时间:4月12日-13日、18日-19日

AI与Python双驱动计量经济学多源数据处理、机器学习预测及复杂因果识别全流程实战班

直播时间:4月18日-19日、25日-26日

关于举办“OpenClaw、Hermes+Vibe Coding核心实战玩法,手把手教你本地部署与云端协同,实现知识、论文自动化工作流”培训班

直播时间:5月23日-24日

五天-面向SCI论文:AI+PLUS-InVEST多情景耦合模拟、生态系统服务评估、土地利用优化、科研论文全链条实战高级研修班

直播时间:4月22日-24日、29日-30日

北斗高精度数据解算实战:破解城市峡谷/长基线/无网区难题,从毫米级定位到自动化交付的全流程攻坚进阶培训班

现场时间:4月20日-24日

直播时间:5月21日-24日

最新AI+Python驱动的高光谱遥感全链路解析与典型案例实践高级培训班

直播时间:5月22日-23日、29日-30日

直播时间:5月30日-31日、6月6日-7日

三维地质建模全链路实践技术——从数据清洗预处理到复杂构造建模、矿体圈定与储量估算培训班

直播时间:5月23日-24日、30日

第五期:智能遥感新质生产力暨DeepSeek、ChatGPT、Python等驱动的空天地数据识别与计算及15个行业标杆案例实践培训班

直播时间:5月8日-9日、15日-16日

最新合成孔径雷达干涉测量InSAR数据处理、地形三维重建、形变信息提取、监测等实践技术应用高级培训班

直播时间:5月23日-24日、30日

第八期:融合DeepSeek、GIS 与 Python 机器学习的全流程地质灾害风险评估、易发性分析、信息化建库、灾后重建及SCI论文成果撰写高级培训班

直播时间:5月20日-21日、25日、27日-28日

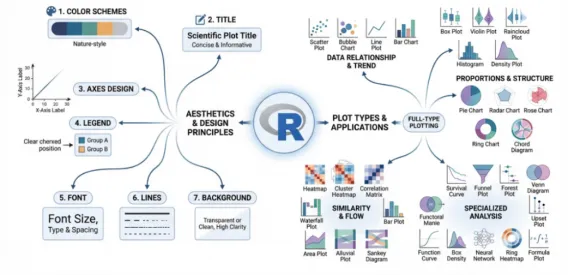

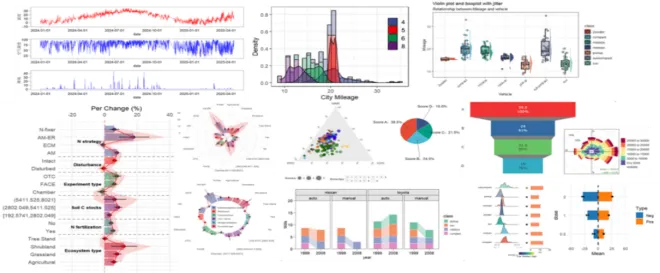

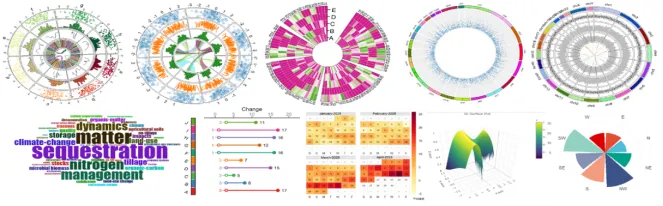

一图胜千言-顶刊级科研绘图工坊暨AI支持下Nature级数据可视化高级培训班

直播时间:5月15日-16日、22日-23日

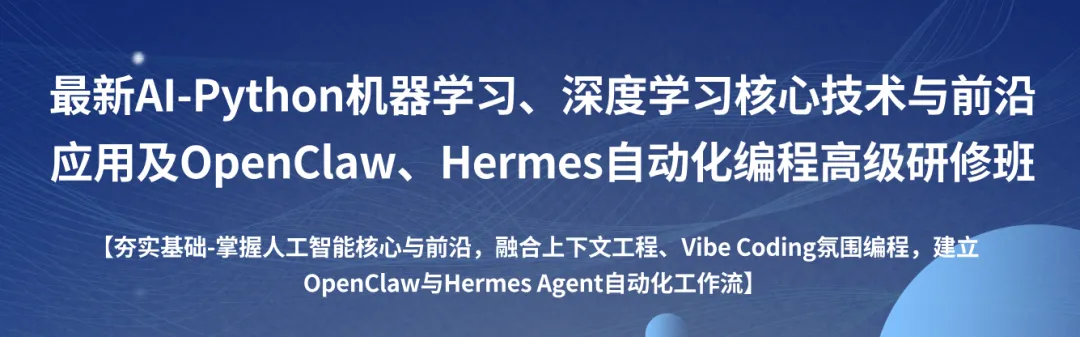

最新AI-Python机器学习、深度学习核心技术与前沿应用及OpenClaw、Hermes自动化编程高级研修班

直播时间:5月16日-17日、23日-24日

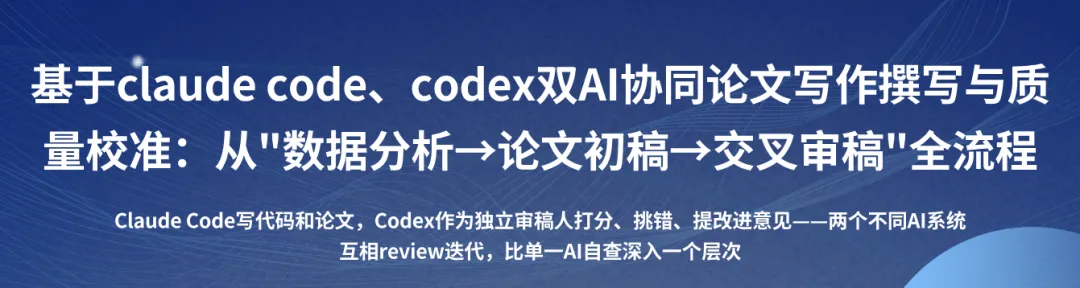

基于claude code、codex双AI协同论文写作撰写与质量校准:从”数据分析→论文初稿→交叉审稿”全流程

直播时间:5月16日-17日

AI赋能下的流域径流模拟、气候变化影响评估及水文水资源管理实践技术培训班

直播时间:5月16日-17日、23日-24日

从机理到实践告别“黑箱”模拟:OpenGeoSys(OGS6)多物理场THMC 全耦合建模与Python自动化分析高级实战营

直播时间:5月23日-24日、30日-31日

第七期:CNS与顶级期刊高水平论文写作的“破局”之道AI人机协同的CNS级论文全流程写作与发表系统高级培训班

直播时间:5月29日-30日、6月5日-6日

最新Hermes Agent 技能封装与科研自动化实战:以 Meta-Analysis 为例-实现从文献检索到绘图的一站式工作流培训班

直播时间:5月30日-31日

直播时间:6月5日-8日

点击课程标题了解详细介绍

扫码咨询课程详情

添加小编微信,海量数据、视频教程免费获取

点击进入

声明: 本号旨在传播、传递、交流,对相关文章内容观点保持中立态度。涉及内容如有侵权或其他问题,请与本号联系,第一时间做出撤回。

END

Ai尚研修丨专注科研领域

技术推广,人才招聘推荐,科研活动服务

科研技术云导师,Easy Scientific Research

直播课程推荐

AI赋能R-Meta分析核心技术:从热点挖掘到高级模型、助力高效科研与论文发表”培训班

直播时间:2026年4月24日-27日

直播时间:4月12日-13日、18日-19日

AI与Python双驱动计量经济学多源数据处理、机器学习预测及复杂因果识别全流程实战班

直播时间:4月18日-19日、25日-26日

关于举办“OpenClaw、Hermes+Vibe Coding核心实战玩法,手把手教你本地部署与云端协同,实现知识、论文自动化工作流”培训班

直播时间:5月23日-24日

五天-面向SCI论文:AI+PLUS-InVEST多情景耦合模拟、生态系统服务评估、土地利用优化、科研论文全链条实战高级研修班

直播时间:4月22日-24日、29日-30日

北斗高精度数据解算实战:破解城市峡谷/长基线/无网区难题,从毫米级定位到自动化交付的全流程攻坚进阶培训班

现场时间:4月20日-24日

直播时间:5月21日-24日

最新AI+Python驱动的高光谱遥感全链路解析与典型案例实践高级培训班

直播时间:5月22日-23日、29日-30日

直播时间:5月30日-31日、6月6日-7日

三维地质建模全链路实践技术——从数据清洗预处理到复杂构造建模、矿体圈定与储量估算培训班

直播时间:5月23日-24日、30日

第五期:智能遥感新质生产力暨DeepSeek、ChatGPT、Python等驱动的空天地数据识别与计算及15个行业标杆案例实践培训班

直播时间:5月8日-9日、15日-16日

最新合成孔径雷达干涉测量InSAR数据处理、地形三维重建、形变信息提取、监测等实践技术应用高级培训班

直播时间:5月23日-24日、30日

第八期:融合DeepSeek、GIS 与 Python 机器学习的全流程地质灾害风险评估、易发性分析、信息化建库、灾后重建及SCI论文成果撰写高级培训班

直播时间:5月20日-21日、25日、27日-28日

一图胜千言-顶刊级科研绘图工坊暨AI支持下Nature级数据可视化高级培训班

直播时间:5月15日-16日、22日-23日

最新AI-Python机器学习、深度学习核心技术与前沿应用及OpenClaw、Hermes自动化编程高级研修班

直播时间:5月16日-17日、23日-24日

基于claude code、codex双AI协同论文写作撰写与质量校准:从”数据分析→论文初稿→交叉审稿”全流程

直播时间:5月16日-17日

AI赋能下的流域径流模拟、气候变化影响评估及水文水资源管理实践技术培训班

直播时间:5月16日-17日、23日-24日

从机理到实践告别“黑箱”模拟:OpenGeoSys(OGS6)多物理场THMC 全耦合建模与Python自动化分析高级实战营

直播时间:5月23日-24日、30日-31日

第七期:CNS与顶级期刊高水平论文写作的“破局”之道AI人机协同的CNS级论文全流程写作与发表系统高级培训班

直播时间:5月29日-30日、6月5日-6日

最新Hermes Agent 技能封装与科研自动化实战:以 Meta-Analysis 为例-实现从文献检索到绘图的一站式工作流培训班

直播时间:5月30日-31日

直播时间:6月5日-8日

点击课程标题了解详细介绍

扫码咨询课程详情

添加小编微信,海量数据、视频教程免费获取

点击进入

声明: 本号旨在传播、传递、交流,对相关文章内容观点保持中立态度。涉及内容如有侵权或其他问题,请与本号联系,第一时间做出撤回。

END

Ai尚研修丨专注科研领域

技术推广,人才招聘推荐,科研活动服务

科研技术云导师,Easy Scientific Research

| 直播课程推荐 |

直播时间:4月12日-13日、18日-19日

AI与Python双驱动计量经济学多源数据处理、机器学习预测及复杂因果识别全流程实战班

直播时间:4月18日-19日、25日-26日

关于举办“OpenClaw、Hermes+Vibe Coding核心实战玩法,手把手教你本地部署与云端协同,实现知识、论文自动化工作流”培训班

直播时间:5月23日-24日

五天-面向SCI论文:AI+PLUS-InVEST多情景耦合模拟、生态系统服务评估、土地利用优化、科研论文全链条实战高级研修班

直播时间:4月22日-24日、29日-30日

北斗高精度数据解算实战:破解城市峡谷/长基线/无网区难题,从毫米级定位到自动化交付的全流程攻坚进阶培训班

现场时间:4月20日-24日

直播时间:5月21日-24日

最新AI+Python驱动的高光谱遥感全链路解析与典型案例实践高级培训班

直播时间:5月22日-23日、29日-30日

直播时间:5月30日-31日、6月6日-7日

三维地质建模全链路实践技术——从数据清洗预处理到复杂构造建模、矿体圈定与储量估算培训班

直播时间:5月23日-24日、30日

第五期:智能遥感新质生产力暨DeepSeek、ChatGPT、Python等驱动的空天地数据识别与计算及15个行业标杆案例实践培训班

直播时间:5月8日-9日、15日-16日

最新合成孔径雷达干涉测量InSAR数据处理、地形三维重建、形变信息提取、监测等实践技术应用高级培训班

直播时间:5月23日-24日、30日

第八期:融合DeepSeek、GIS 与 Python 机器学习的全流程地质灾害风险评估、易发性分析、信息化建库、灾后重建及SCI论文成果撰写高级培训班

直播时间:5月20日-21日、25日、27日-28日

一图胜千言-顶刊级科研绘图工坊暨AI支持下Nature级数据可视化高级培训班

直播时间:5月15日-16日、22日-23日

最新AI-Python机器学习、深度学习核心技术与前沿应用及OpenClaw、Hermes自动化编程高级研修班

直播时间:5月16日-17日、23日-24日

基于claude code、codex双AI协同论文写作撰写与质量校准:从”数据分析→论文初稿→交叉审稿”全流程

直播时间:5月16日-17日

AI赋能下的流域径流模拟、气候变化影响评估及水文水资源管理实践技术培训班

直播时间:5月16日-17日、23日-24日

从机理到实践告别“黑箱”模拟:OpenGeoSys(OGS6)多物理场THMC 全耦合建模与Python自动化分析高级实战营

直播时间:5月23日-24日、30日-31日

第七期:CNS与顶级期刊高水平论文写作的“破局”之道AI人机协同的CNS级论文全流程写作与发表系统高级培训班

直播时间:5月29日-30日、6月5日-6日

最新Hermes Agent 技能封装与科研自动化实战:以 Meta-Analysis 为例-实现从文献检索到绘图的一站式工作流培训班

直播时间:5月30日-31日

直播时间:6月5日-8日

添加小编微信,海量数据、视频教程免费获取

声明: 本号旨在传播、传递、交流,对相关文章内容观点保持中立态度。涉及内容如有侵权或其他问题,请与本号联系,第一时间做出撤回。

END

Ai尚研修丨专注科研领域

技术推广,人才招聘推荐,科研活动服务

科研技术云导师,Easy Scientific Research

夜雨聆风

夜雨聆风