本周最火的 4 个 AI 开源项目,DeepSeek V4 今天刚上线

本周最火的 4 个 AI 开源项目,每一个都值得收藏

今天搜罗了本周最火的 4 个 AI 热点。

1.6 万亿参数的国产大模型今天刚开源,36 万 Star 的个人 AI 助手支持在微信里聊,Anthropic 官方把 Claude Code 变笨的 3 个 Bug 全说清楚了,还有一场大厂集体抛弃 MCP 的事。

挨个看看。

01

DeepSeek V4 开源了,1.6 万亿参数,今天刚上线

DeepSeek 今天(4 月 24 日)发布了 V4 系列的预览版,同步开源。

说白了就是 2 个模型:

① V4-Pro:1.6 万亿总参数,每次推理激活 490 亿参数,MoE 架构

② V4-Flash:2840 亿总参数,激活 130 亿,更轻更快

两个都支持 100 万 token 的上下文窗口,MIT 协议开源。

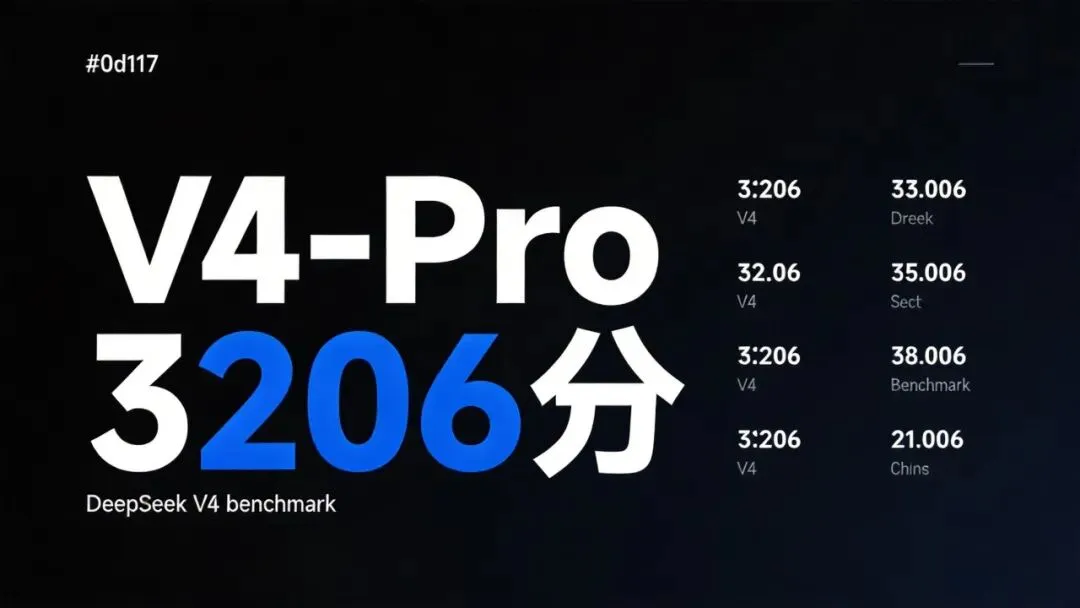

我看了下 benchmark,V4-Pro 在编程测试 Codeforces 上跑出了 3206 分,超过了 GPT-5.4。

更狠的是价格。API 调用大概 $0.028/百万 token,比 GPT-5.4 或 Claude Opus 4.6 便宜 20-50 倍。

还有一个数字:100 万 token 的长上下文场景下,V4-Pro 只需要 V3 的 27% 算力和 10% 的 KV 缓存。

更聪明,更便宜,更省资源。国产开源大模型这次确实有点东西。

开源地址:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro

02

36 万 Star 的 OpenClaw,在微信 QQ 里养个 AI 助手

OpenClaw 这个项目最近在 GitHub 上热度一直没降。

今天看了下数据:363,164 Star,74,244 Fork,今天还在持续更新。

说白了就是一个跑在你自己设备上的个人 AI 助手,数据完全自己掌控。

最有意思的是它支持的渠道:WhatsApp、Telegram、Slack、Discord、Signal、iMessage、微信、QQ、LINE、Matrix。。。一共 20 多个平台。

没错,微信和 QQ 都支持。

你可以直接在微信里跟你的 AI 助手聊,不用开任何 App,不用切换界面。

安装也不复杂,一行命令:

npxopenclawonboard

支持 macOS、Linux、Windows(WSL2),npm/pnpm/bun 都行。

赞助商里有 OpenAI,这个项目的生态已经挺成熟了。

开源地址:https://github.com/openclaw/openclaw

03

Anthropic 官方复盘:Claude Code 最近变笨,是这 3 个 Bug 搞的

这个我觉得挺值得看的。

最近一个月很多人反映 Claude Code 感觉变笨了,用量限额消耗也变快了。

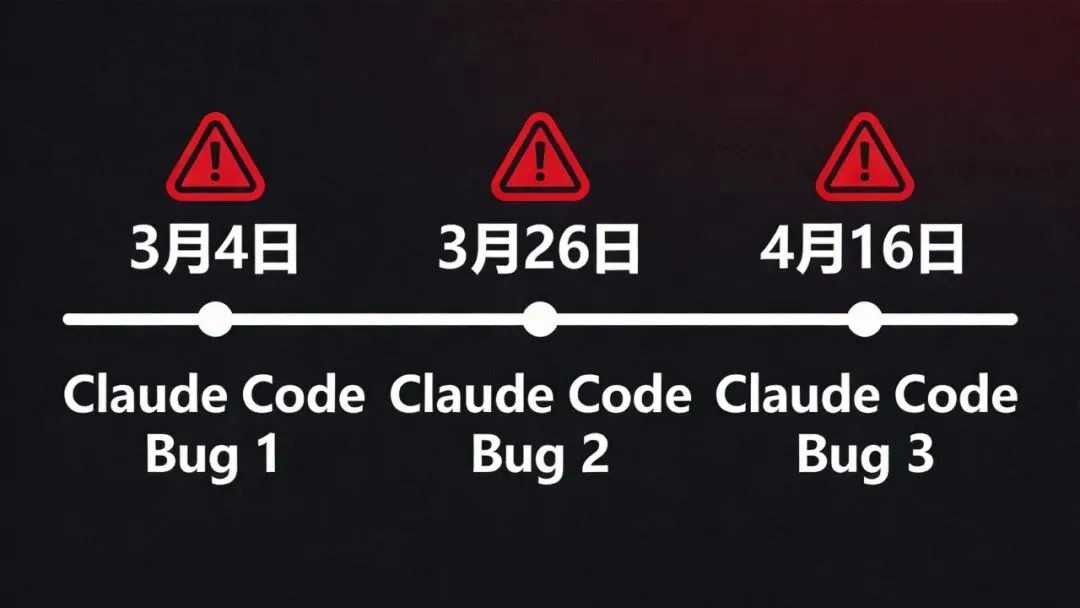

4 月 23 日,Anthropic 官方发了一篇复盘文章,把 3 个独立的 Bug 全部说清楚了。

Bug 1:推理等级被悄悄降级(3 月 4 日引入,4 月 7 日修复)

原来默认是 high 推理等级,有用户反映偶尔会卡很久,Anthropic 就把默认改成了 medium。

结果大家都觉得 Claude 变笨了。

现在已经回滚,Opus 4.7 默认 xhigh,其他模型默认 high。

Bug 2:缓存优化 Bug,每轮都在清除历史推理(3 月 26 日引入,4 月 10 日修复)

这个是真正的 Bug。

设计意图是:空闲超 1 小时后,清一次旧的 thinking 记录节省 token。

但实现有问题,变成了每一轮都清除。

Claude 就像得了失忆症,每次回复都不记得自己之前为什么这么做。

这也解释了为什么很多人发现用量限额消耗变快了——缓存命中率下降,每次都要重新算。

这个 Bug 通过了多轮人工代码审查、单元测试、E2E 测试、dogfooding,还是没被发现。

最后是 Opus 4.7 在拿到完整代码仓库上下文后找到的,Opus 4.6 没找到。

Bug 3:系统提示词加了字数限制(4 月 16 日引入,4 月 20 日修复)

为了压制 Opus 4.7 的冗长输出,加了一条:工具调用之间不超过 25 个词,最终回复不超过 100 个词。

结果编码质量下降了 3%。

已回滚。

Anthropic 还宣布:4 月 23 日重置所有订阅用户的使用限额。

原文:https://www.anthropic.com/engineering/april-23-postmortem

04

大厂为什么开始抛弃 MCP,转向 CLI

这个话题最近在开发者圈子里讨论挺多的。

Perplexity CTO 公开宣布放弃 MCP,Y Combinator CEO 直言”MCP sucks”,飞书、钉钉、企业微信选择开源自家的 CLI 而不是 MCP。

MCP 是 Anthropic 2024 年底推出的协议,曾经被称为 AI 界的”Type-C 接口”,月下载量峰值超过 9700 万次。

一年多后,开始被大量抛弃。

为什么?

核心问题是上下文臃肿。

连接 3 个 MCP Server,光工具定义就要占用约 143K token。在 200K 上下文的模型里,72% 的空间被工具定义吃掉了,AI 还没开始干活就”满”了。

研究还发现,工具越多,工具选择准确率反而越低——从 43% 掉到 14% 以下。

CLI 的逻辑完全不同:按需加载,需要什么查什么,不提前塞满上下文。

有实测数据:CLI 方案比 MCP 方案便宜 17 倍,可靠性接近 100%。

Andrej Karpathy 评价说:”CLI is super exciting precisely because they are legacy.”

说白了就是:老东西反而更适合 AI Agent。

这个趋势已经挺清楚了。

以上 4 个,DeepSeek V4 今天刚出,可以去 HuggingFace 上试试。OpenClaw 想在微信里养个 AI 助手的值得折腾。Claude Code 的 Bug 已经修了,可以放心用了。MCP vs CLI 感兴趣的去看掘金那篇原文,数据很详细。

关注小波,每天带来最新的开源资讯

夜雨聆风

夜雨聆风