DeepSeek V4发布,OpenClaw 这个适配速度有点意思

4月24日,DeepSeek 丢出了 V4。

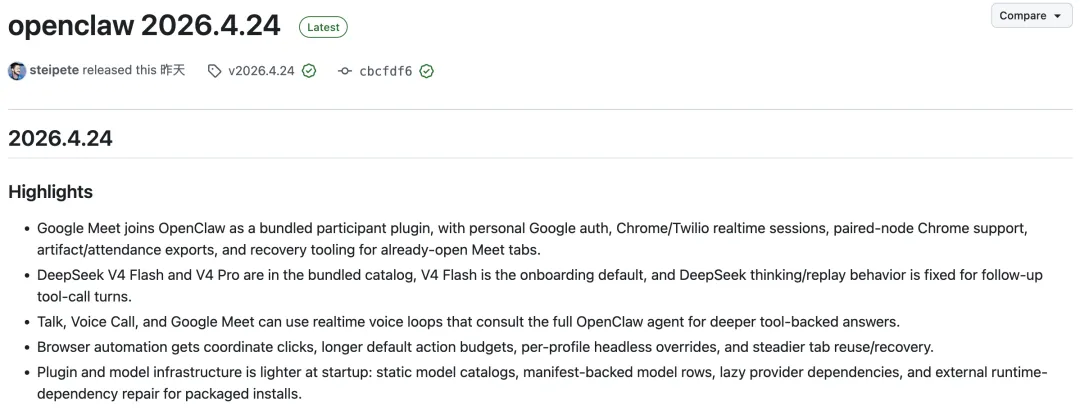

4月25日,OpenClaw 直接把 v2026.4.24 推出来了——同天适配,V4-Flash 直接上了新用户引导的默认位。

这个速度确实有点意外。以前主流模型发布,生态工具跟进通常要等好几周。

这次更新了什么

V4 支持这块,V4 Flash 和 V4 Pro 都进内置目录了,Flash 当默认模型,顺便修了一堆多轮工具调用的 bug。

同期的更新里,Google Meet 插件终于来了,TTS 语音支持扩了一圈,Azure、小米、ElevenLabs v3 都接了,插件冷启动也有优化。

DeepSeek V4 什么水平

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

有意思的是官方文档里提到 V4 已与 Claude Code、OpenClaw、OpenCode 等主流 AI Agent 无缝集成。Agent 能力是 V4 的主打方向之一。

V4-Flash 只有 13B 活跃参数,但工具调用和多轮对话专门调过,不是在参数规模上硬刚。

加上 HuggingFace 权重开源,更像是在建开发者生态。

之前有消息说 V4 会支持华为芯片。如果真能跑在昇腾上,国产大模型加国产芯片这套组合就有实际产品了。

两天适配,而且 V4-Flash 当默认模型——不是加个入口凑合,是认真在推。

模型能力差距在缩小、用户换工具成本很低、自动化适配成熟了,这几个因素叠加在一起。以后判断一个 AI 工具值不值得用,新模型适配速度可能跟功能一样重要。

平时用 OpenClaw 做一些自动化脚本和内容整理。V4-Flash 当默认之后,1M 上下文意味着可以丢一整本书进去分析,不用切片处理了。

独立开发者成本下来了,试错空间大了。做 AI 服务的多了一个性价比选择。企业用户长文档处理这些场景真的可以用了。

DeepSeek V4 加 OpenClaw 这次配合,对国产 AI 生态来说是个好信号。不是等别人定义标准,是自己先把 Agent 场景跑通,拉着生态一起适配。

能适配到稳定好用还有距离,以过往OpenClaw的更新来看,每次升级可能都有很大一部分用户给搞崩了,总得重新安装配置,这次怕是也不例外。建议想要升级的朋友先持续观察,先不要着急,等OpenClaw再修修Bug也不迟。

关注我,一起用AI做点儿正事儿!

夜雨聆风

夜雨聆风