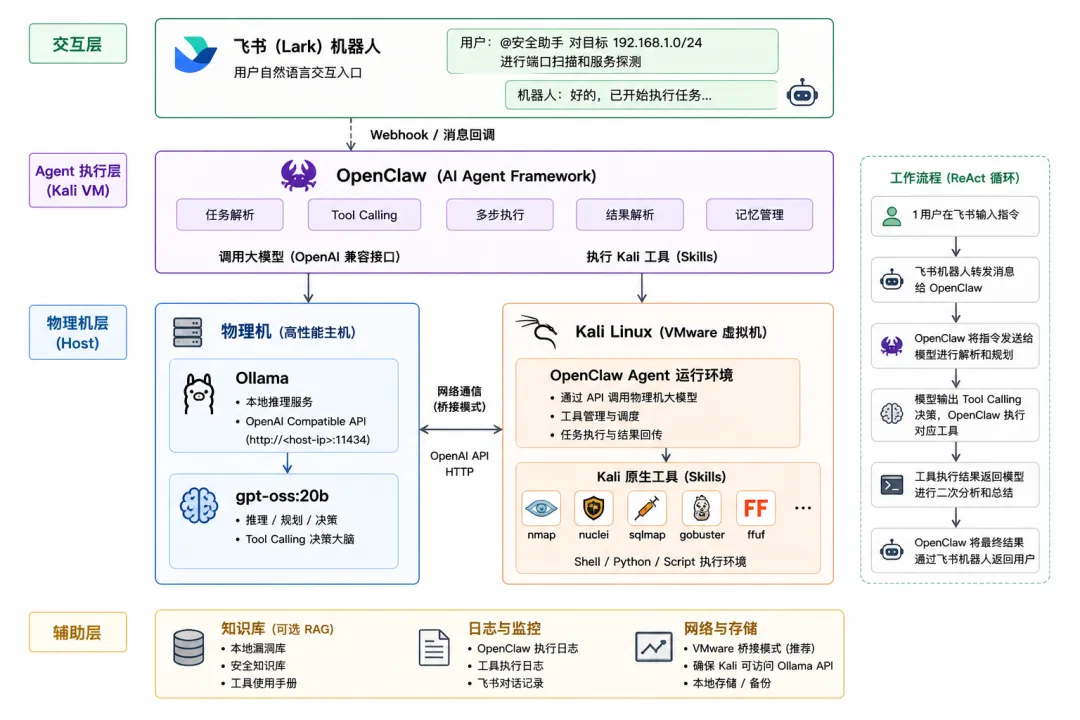

Kali AI Agent: 基于OpenClaw+本地GPT大模型+飞书机器人实践

-

授权渗透测试(需获得目标方明确许可) -

本地实验环境 / 靶场环境测试 -

CTF、攻防演练等合规竞赛 -

安全研究与教学用途

严禁将本文中提及技术用于未授权的真实系统或网络环境。

📌关于责任

-

使用者需对自身行为负责 -

因滥用技术造成的任何法律或安全后果,与本文作者无关

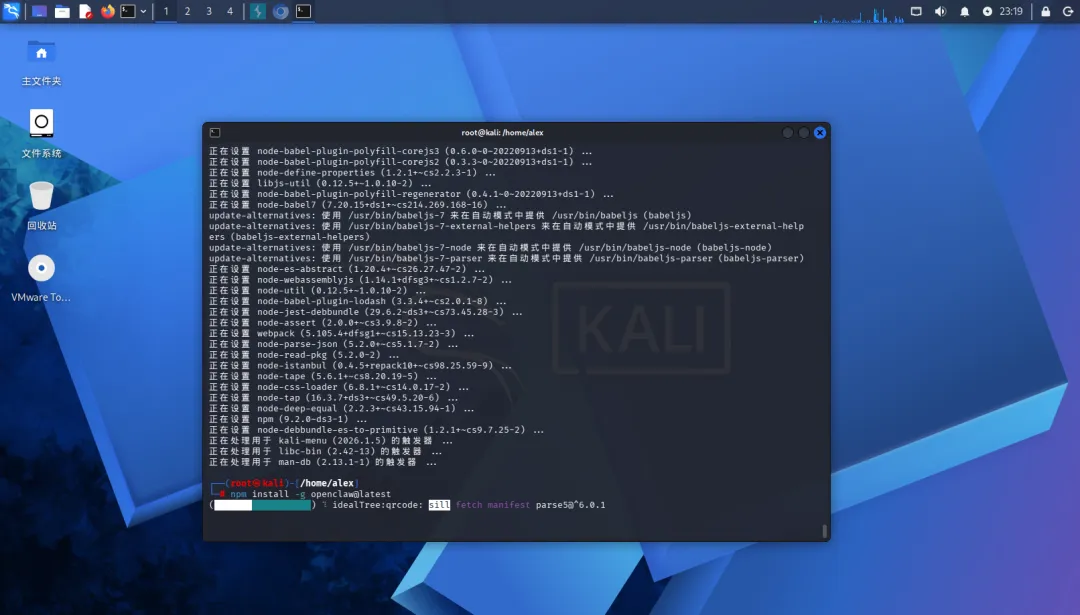

安装需求:1. 虚拟机kali 安装Node.js 22.x(OpenClaw 运行刚需)2. 物理机安装Ollama并下载模型(根据自己的电脑配置部署本地模型)3. kali与物理机能够互相通信4. kali安装包管理器npm

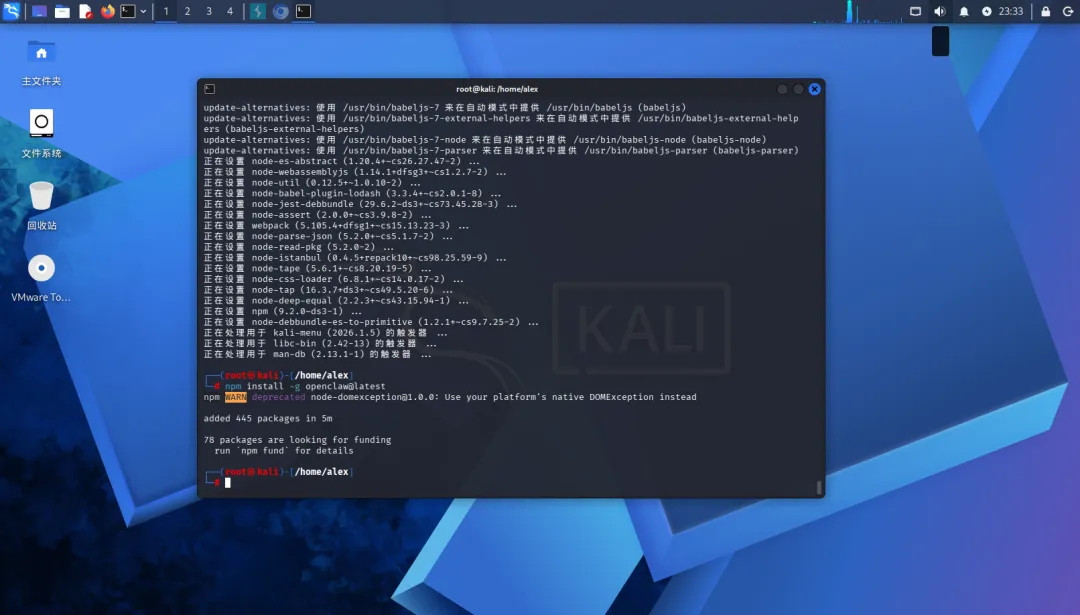

npm install -g openclaw@latest

安装完成

初始化OpenClaw

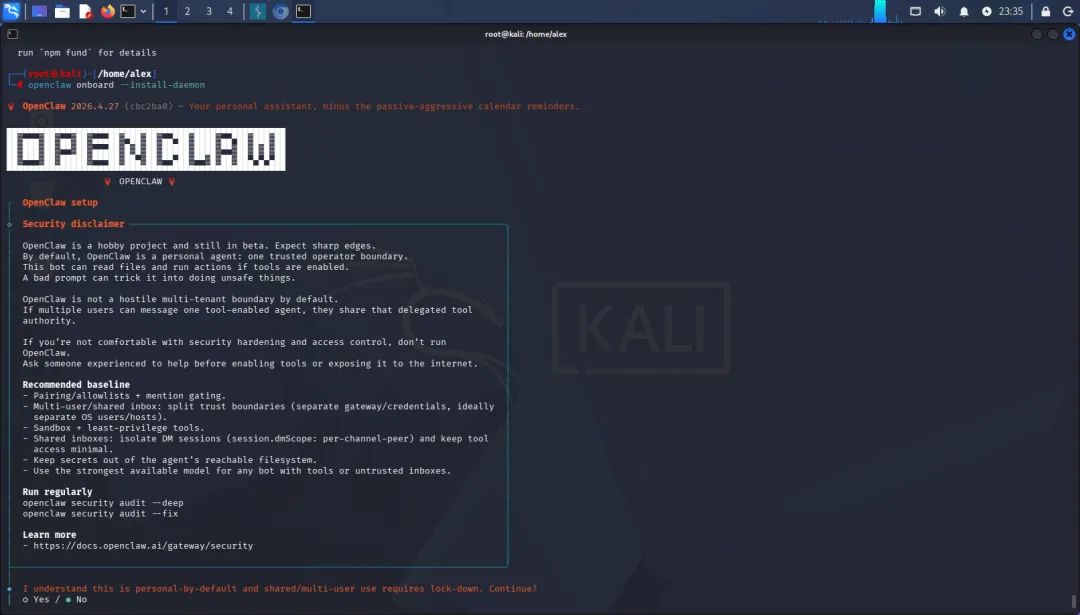

执行新手引导并安装服务

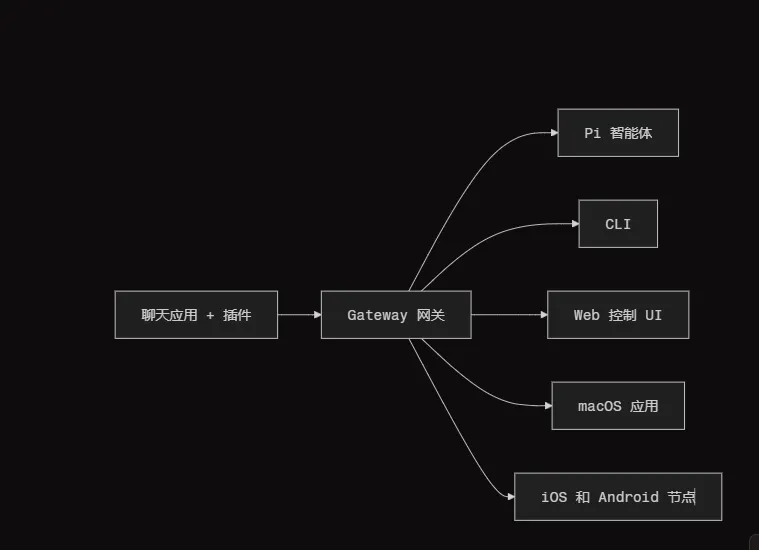

openclaw onboard --install-daemon向导会引导你选择模型提供商、设置 API key, 并配置 Gateway 网关。整个过程大约需要五分钟。

第一条选项询问你是否是一个个人账户,左右方向键控制选择,选择yes

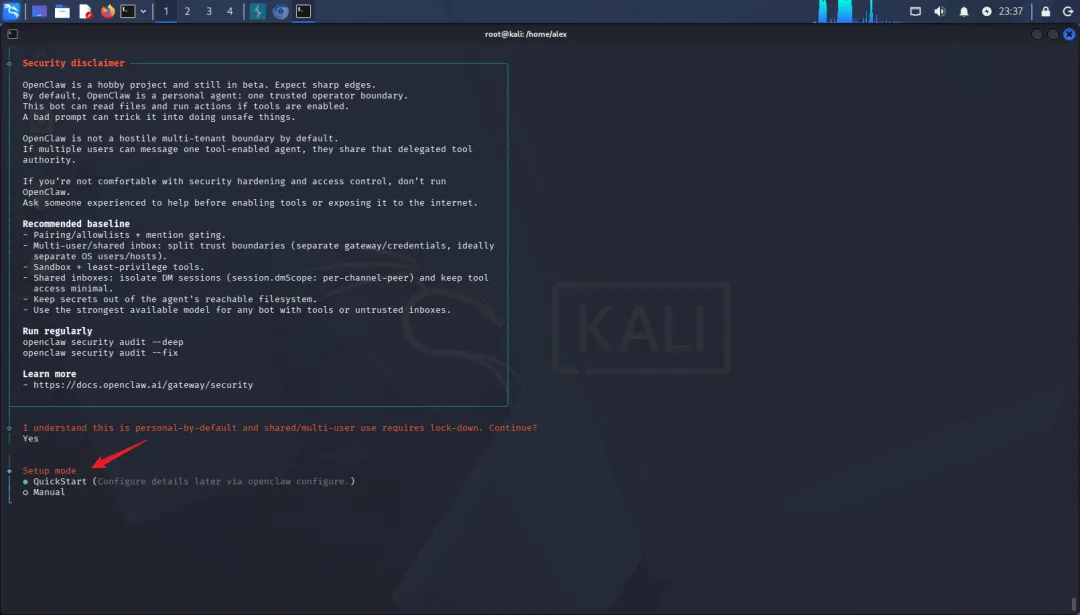

第二条选项选择快速开始

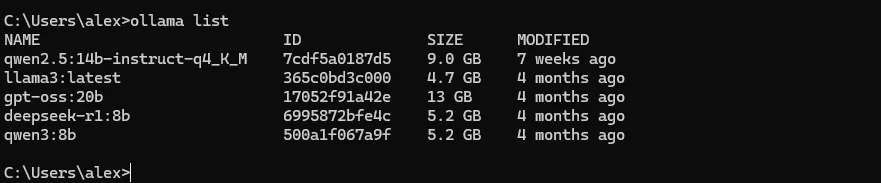

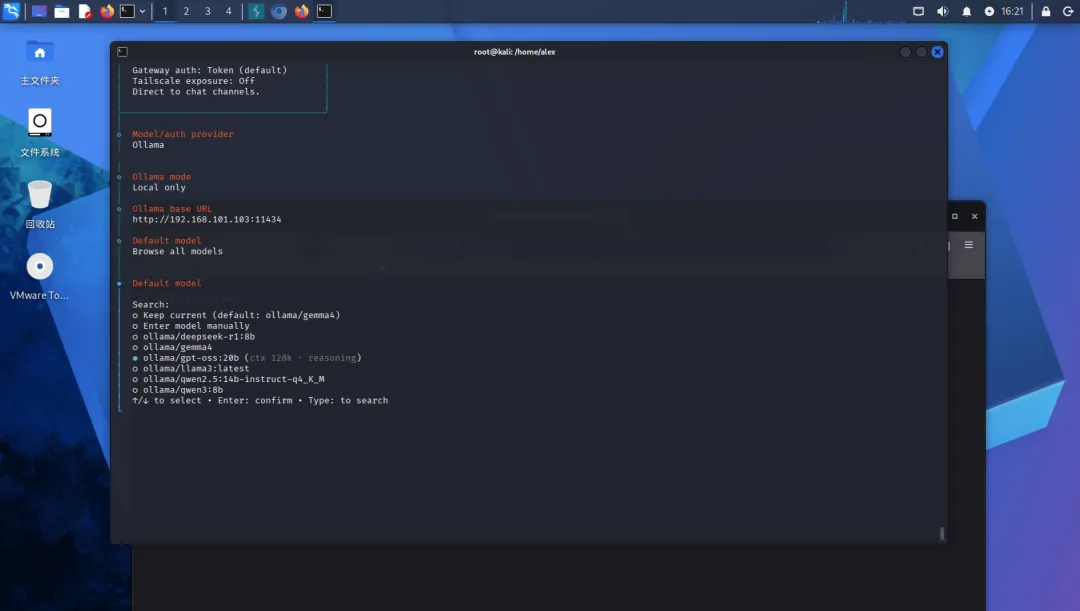

选择配置的模型,这里我们物理机上提前部署好Ollama以及下载模型,可以提前检查下物理机模型状态

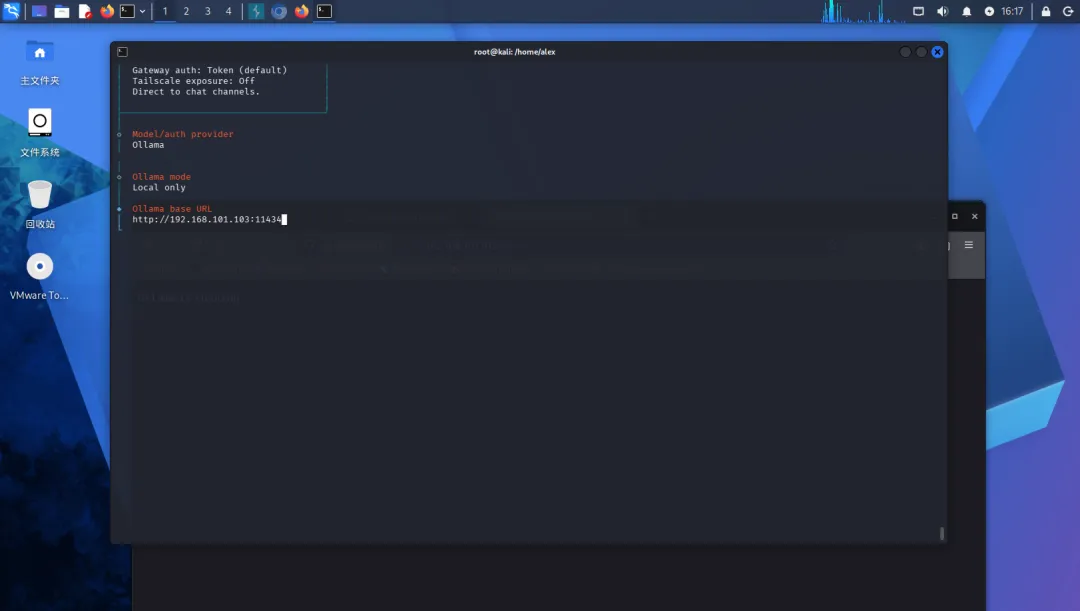

配置模型地址:物理机IP+Ollama固定端口11434

加载本地模型中

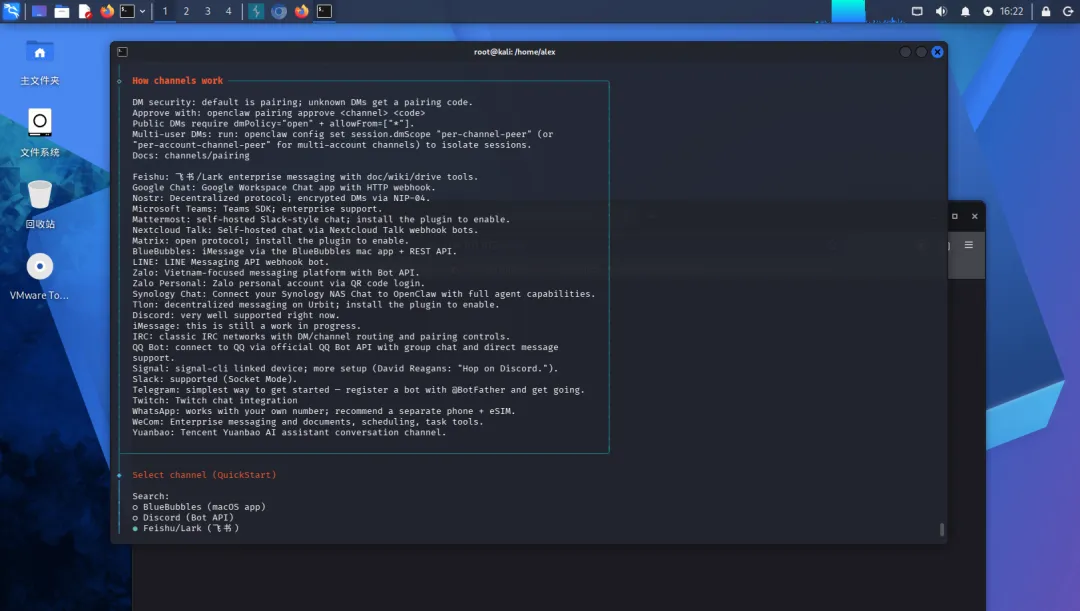

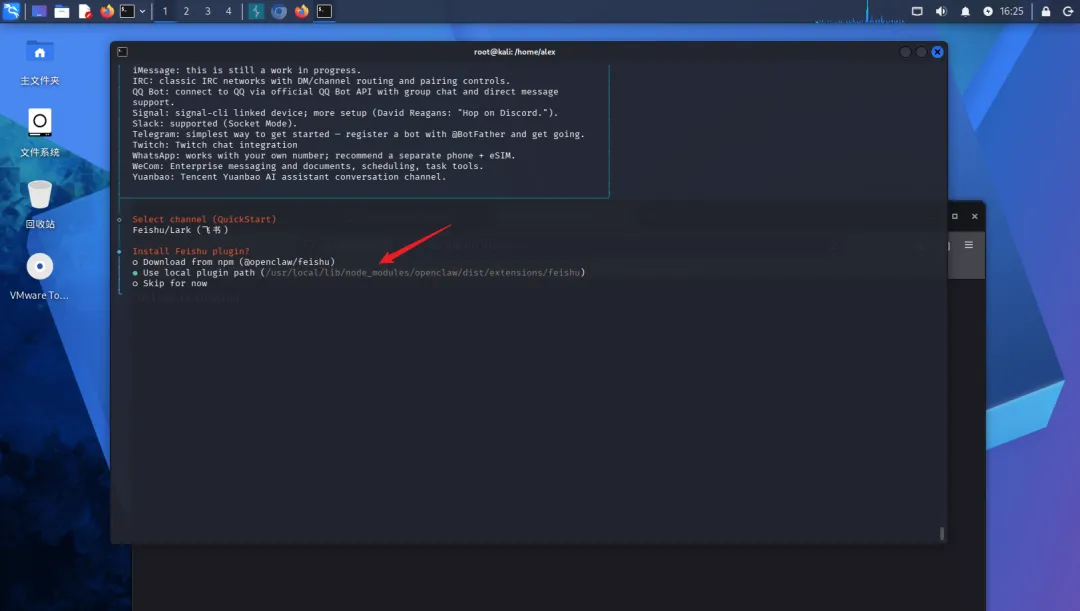

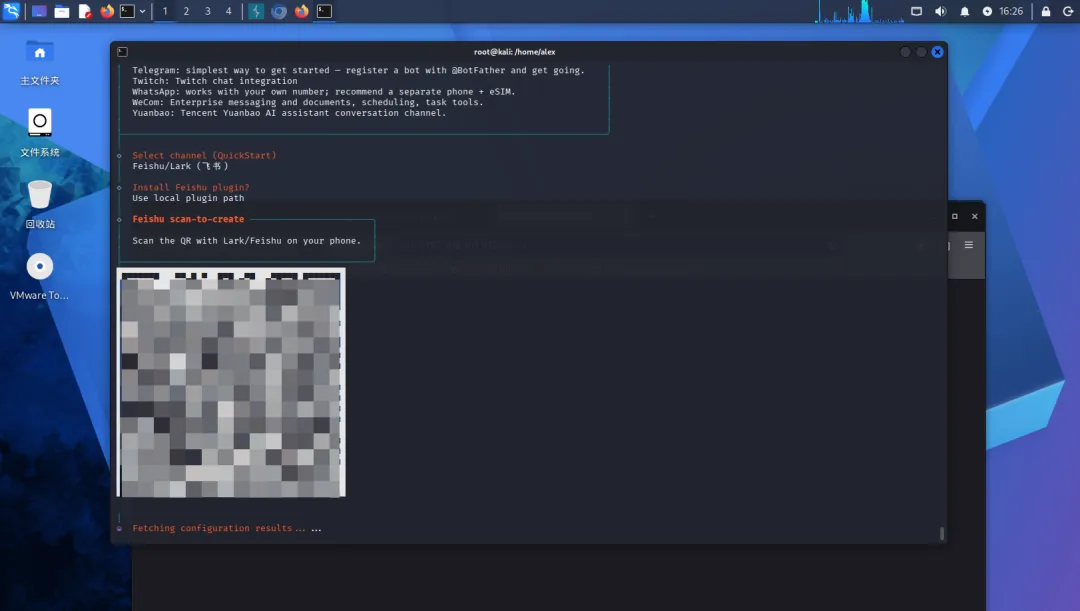

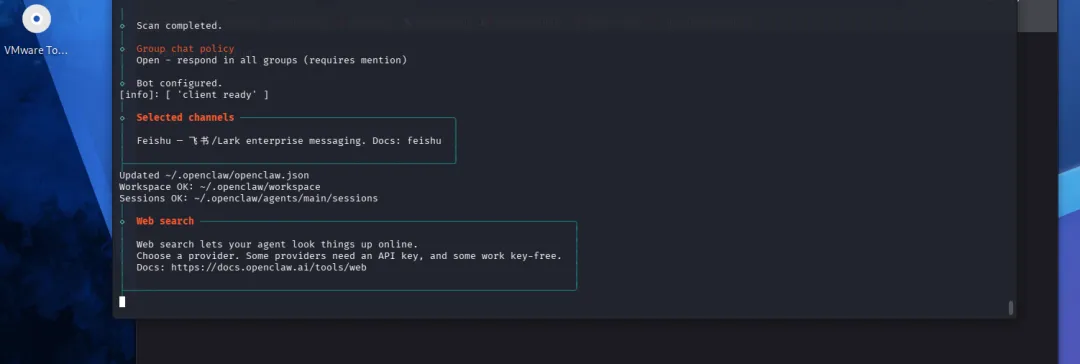

选择飞书以及本地插件路径

注意: 在配置飞书通信前进入飞书开发者后台,提前配置好机器人

飞书开发者后台:https://open.feishu.cn

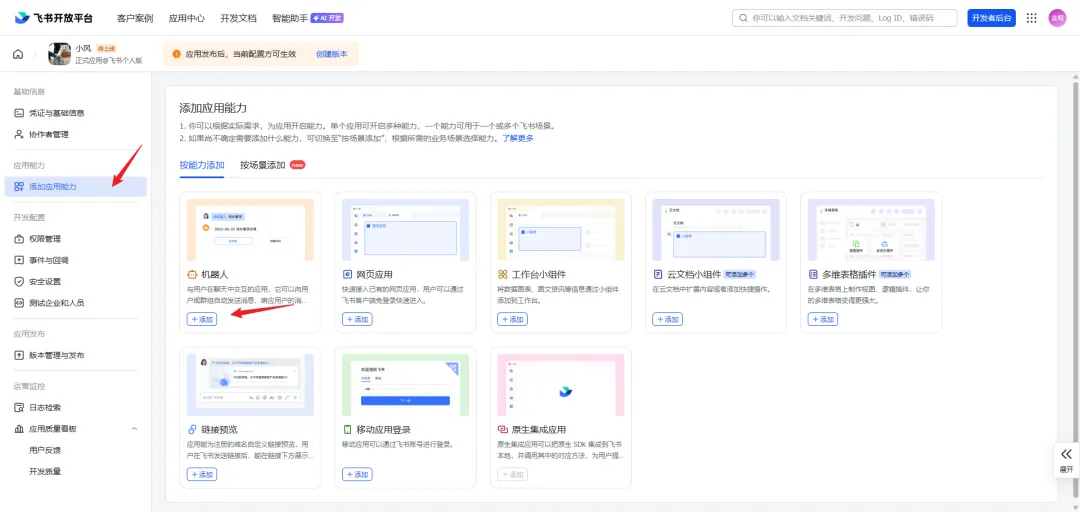

进入飞书开放平台:https://open.feishu.cn/ ,扫码登录飞书,进入开发者后台创建企业自建应用,设置名称头像

选择添加应用能力- 机器人

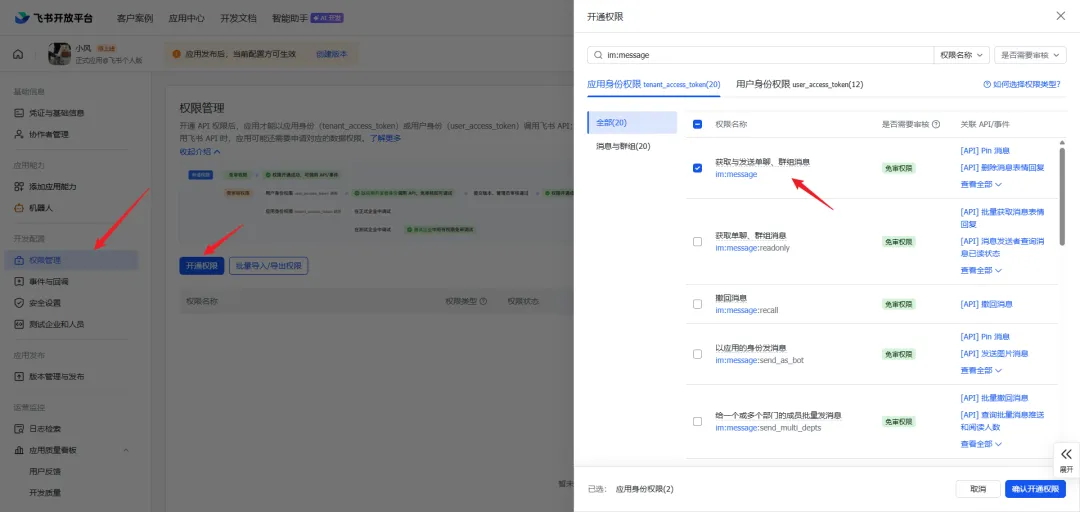

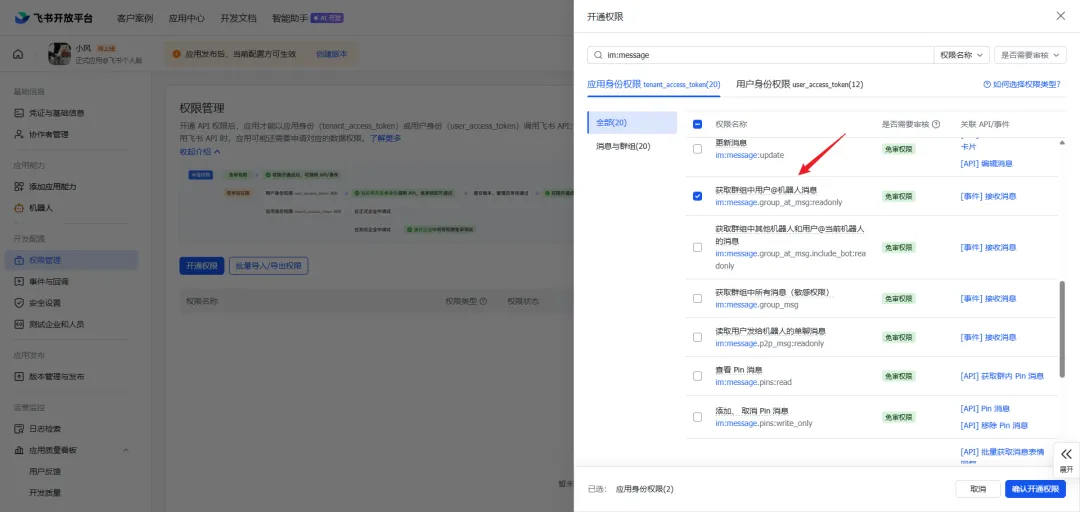

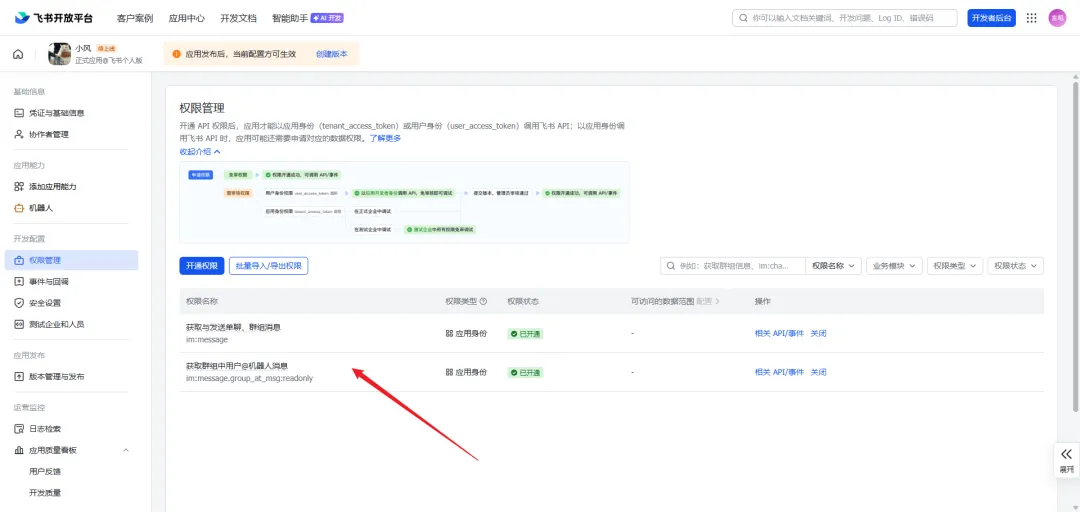

选择两个权限,可以根据自身使用适当调整

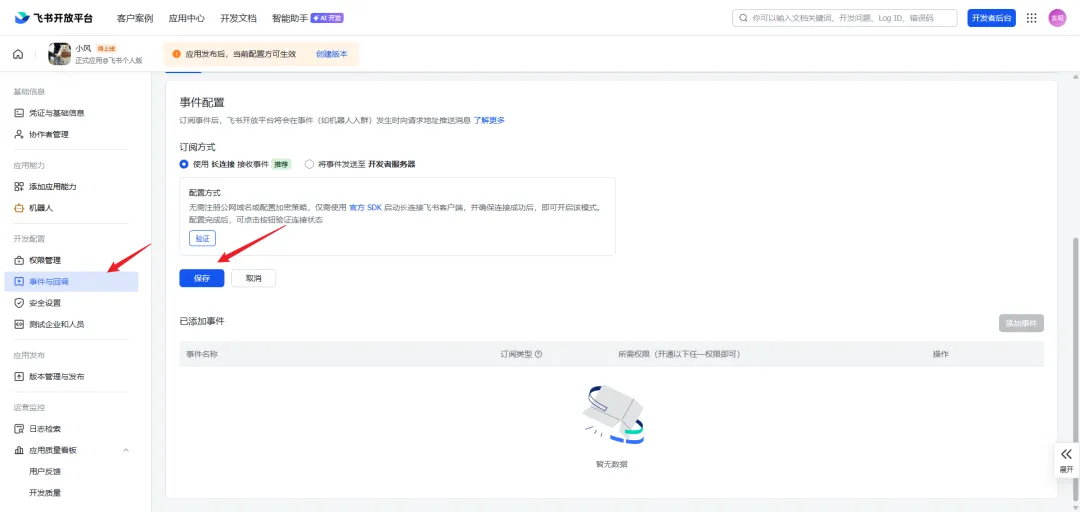

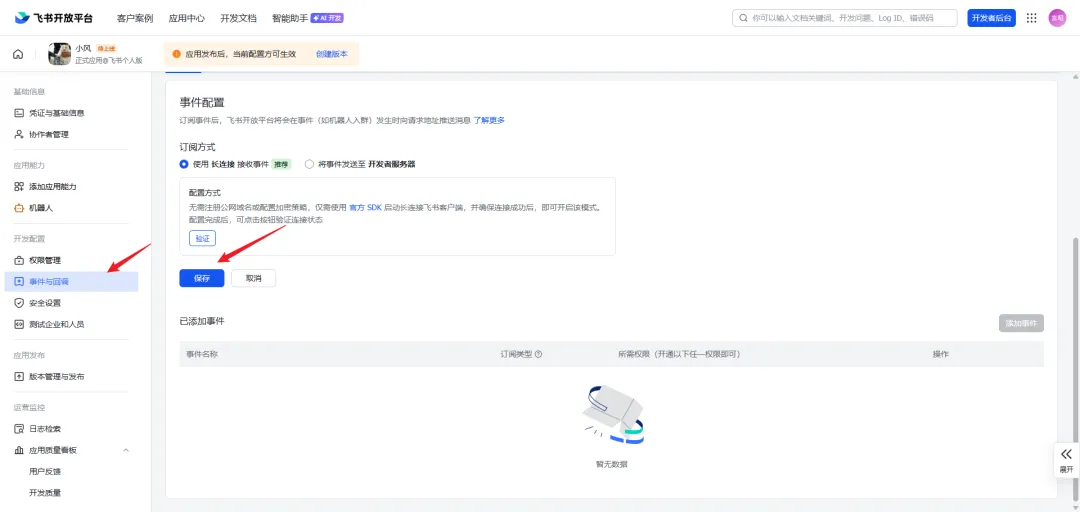

进入事件与回调配置

接收消息

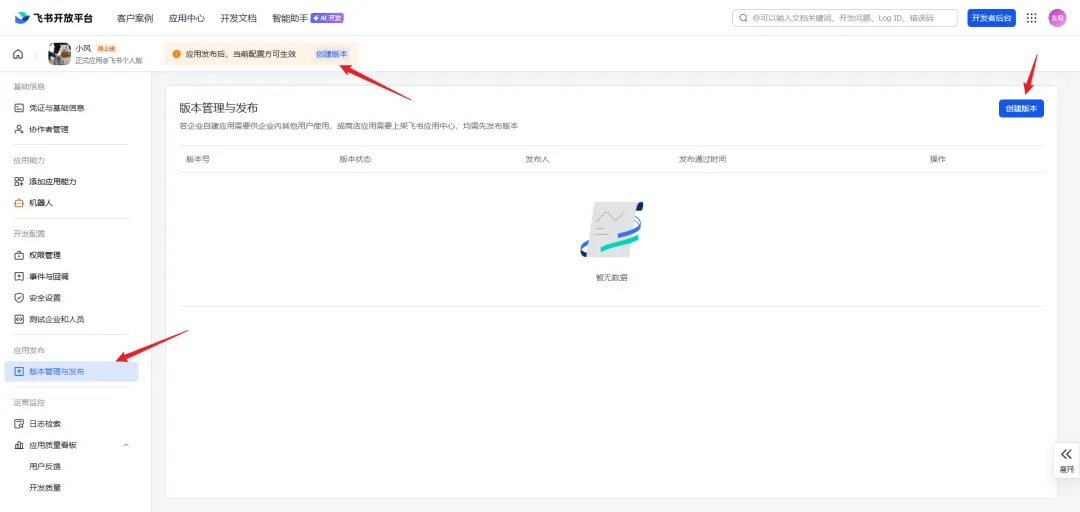

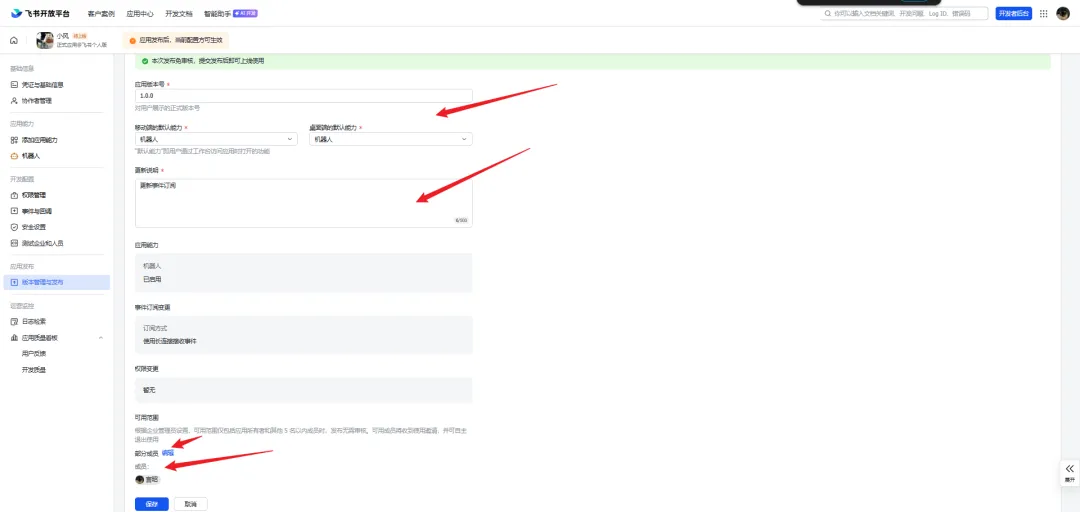

版本与管理发布

配置保存

给了一个二维码扫描进行配置,手机上扫码后跳出配置界面

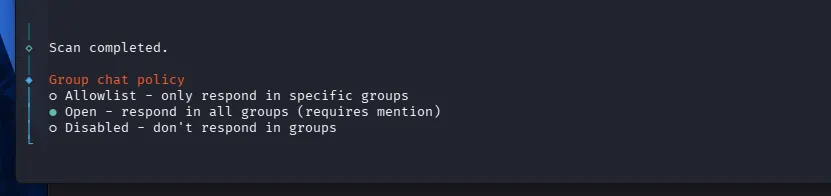

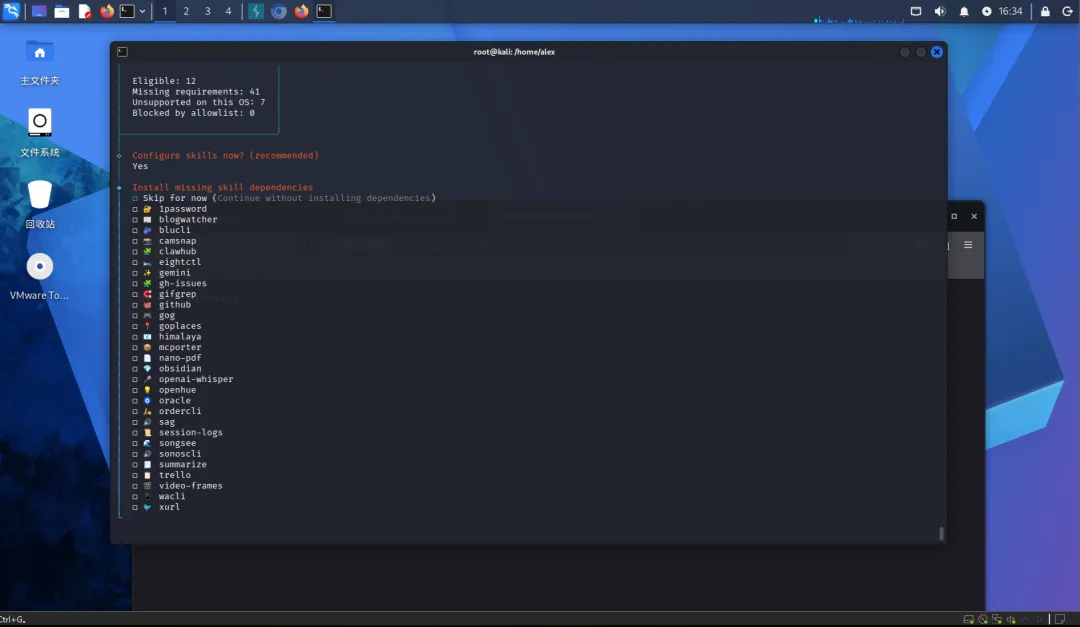

选择skill,可多选也可以跳过,空格键选择回车键确认

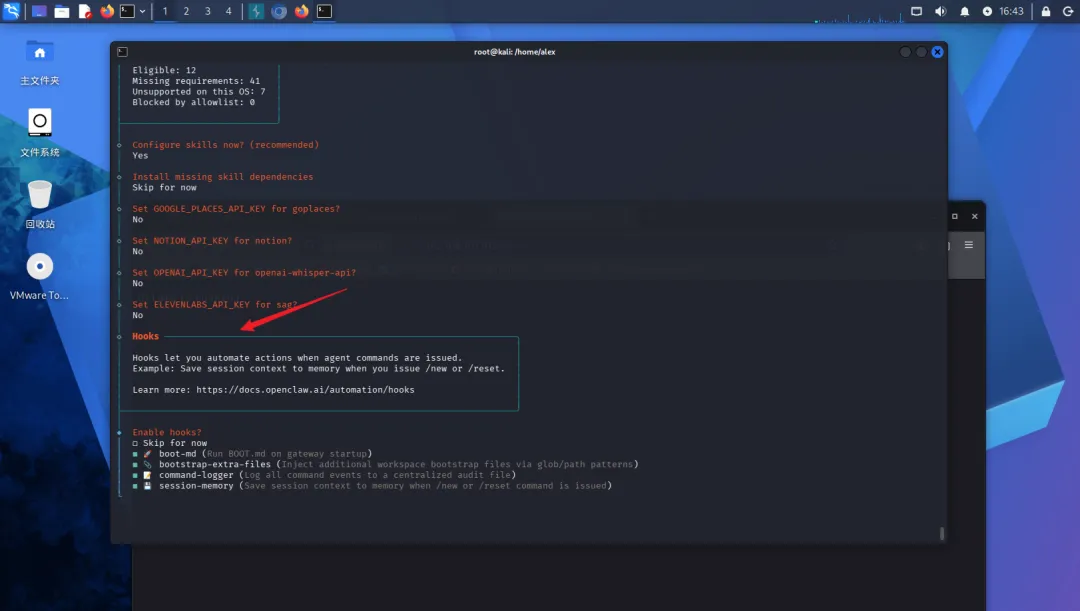

配置钩子

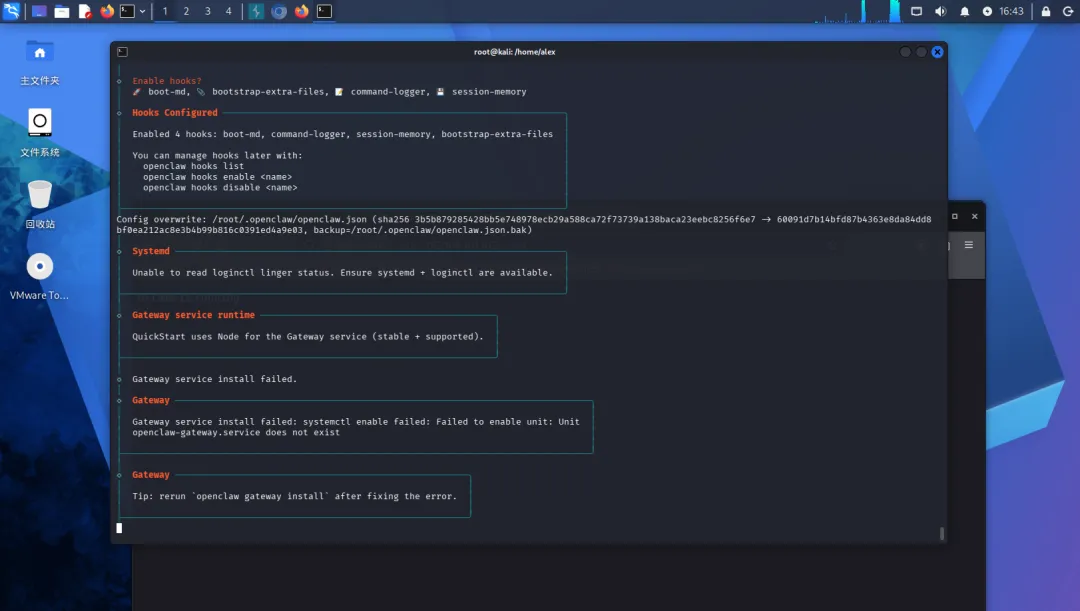

到这里发现报错了,网关的问题

此时我们正在配置安装的这个终端不要关闭,另起一个检查网关的终端排查下错误改下配置

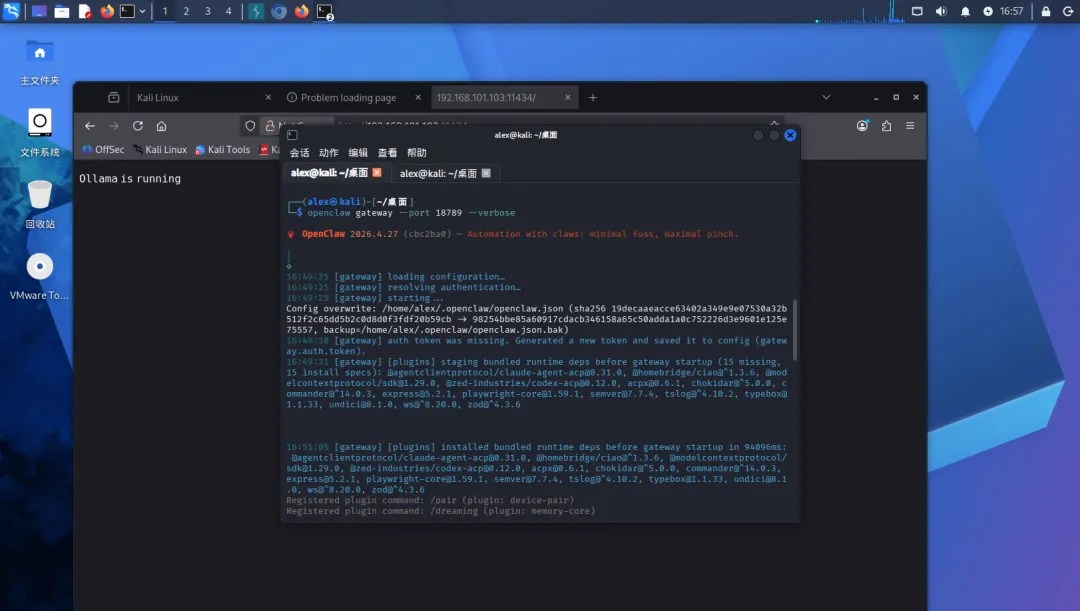

#检查网关openclaw gateway status#启动网关openclaw gateway --port 18789 --verbose#查看端口ss -ltnp | grep 18789

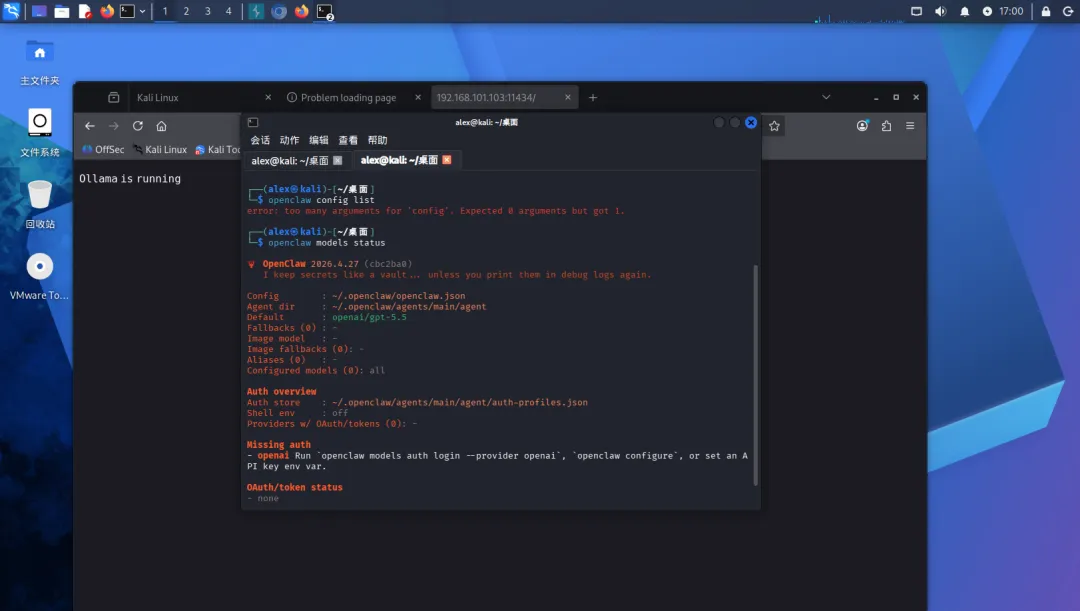

OpenClaw配启动时就算我们选择了模型依然默认是gpt5.5启动,需要额外进行修改,再起一个该配置的终端修改和排查问题

当前一共会有三个终端:

1、初始化OpenClaw的终端(请勿关闭)

2、网关终端(请勿关闭)

3、修改配置如模型和飞书配置的终端

我们在修改配置如模型和飞书配置的终端:

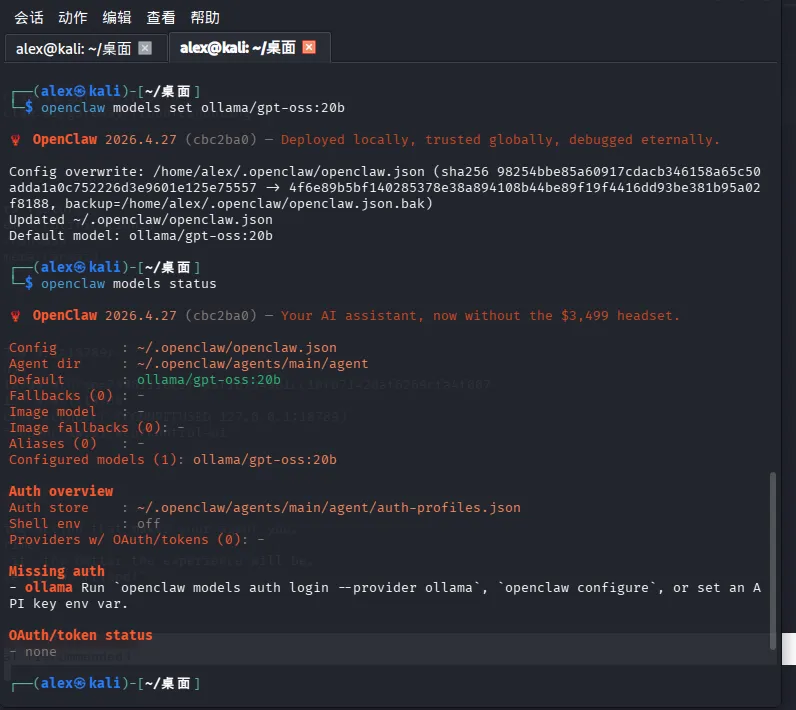

#查看当前状态openclaw models status#设置为你想要的 Ollama 模型openclaw models set ollama/gpt-oss:20b#重启 Gateway(先 Ctrl+C 停掉旧的,再运行下面这条)openclaw gateway --port 18789 --verbose

重设模型,查看状态,已经改成我们的本地模型了,注意模型名称一定要对

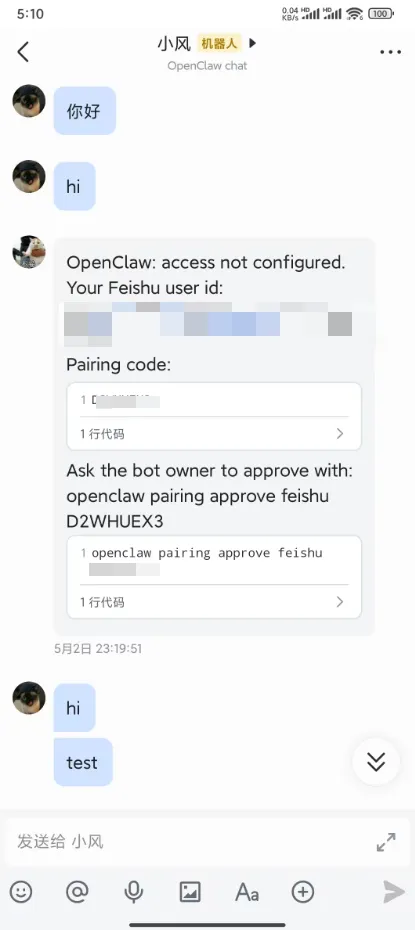

同时也检查下飞书的通信问题,进入手机飞书的机器人发现通信有问题

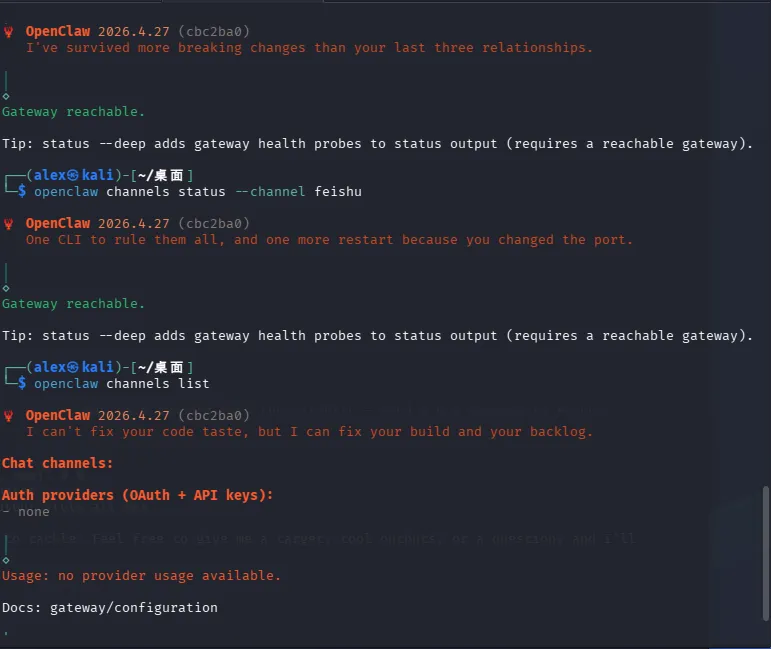

自查飞书通信#1. 查看当前所有通道(Channel)状态openclaw channels status#2. 查看飞书具体配置openclaw channels status --channel feishu或者openclaw channels list

原来在扫码配置的时候没有配置上appid、appsecret等

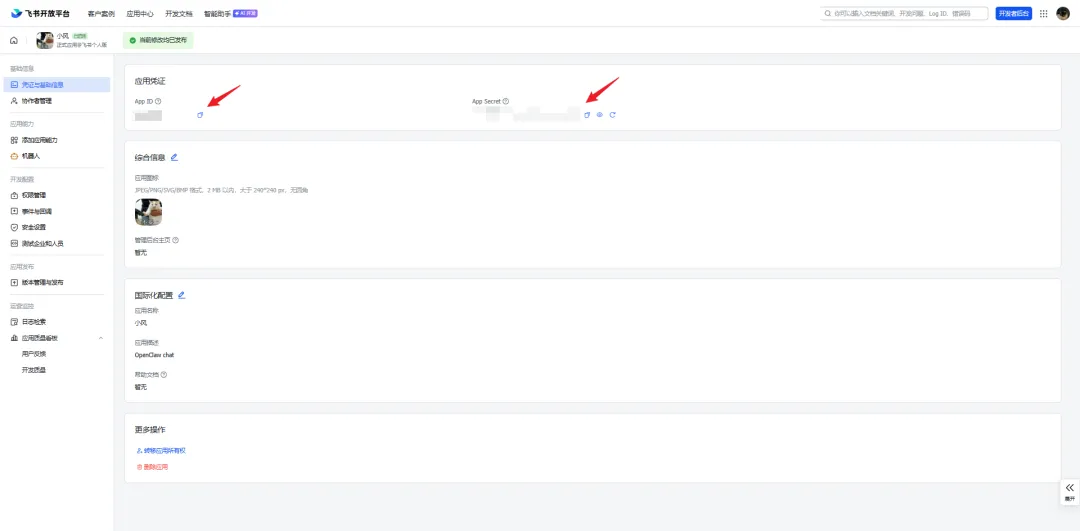

进入飞书开发者后台找到:

openclaw config set channels.feishu.appId "上图复制的appId"openclaw config set channels.feishu.appSecret "上图复制的appSecret"openclaw config set channels.feishu.enabled trueopenclaw config set channels.feishu.botName "小风"

现在回到网关终端可以ctrl+c结束,然后重启网关,如果提示未结束掉那么找到进程杀掉再重启

openclaw gateway stopopenclaw gateway --port 18789 --verbose

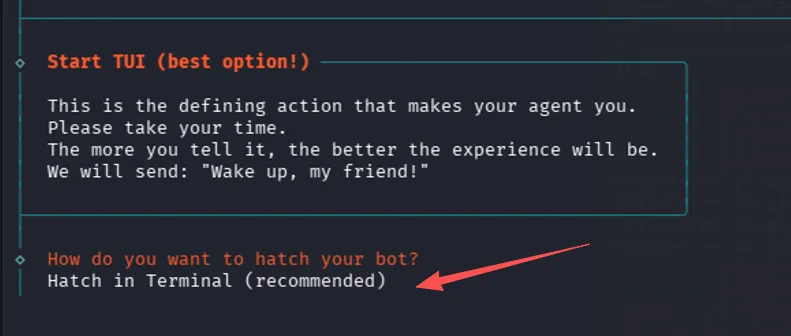

现在最后一步选择

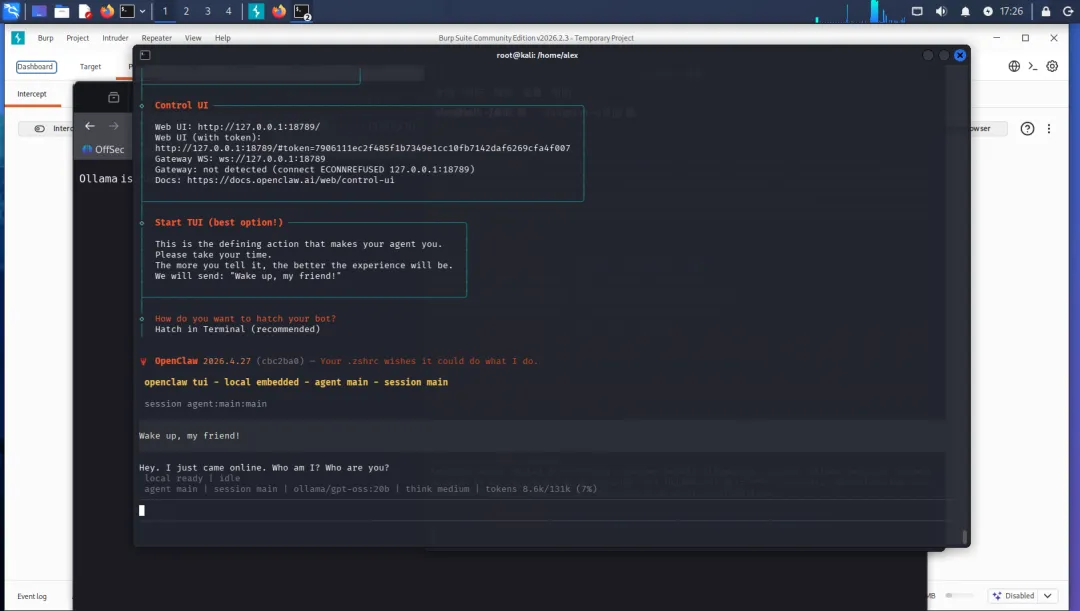

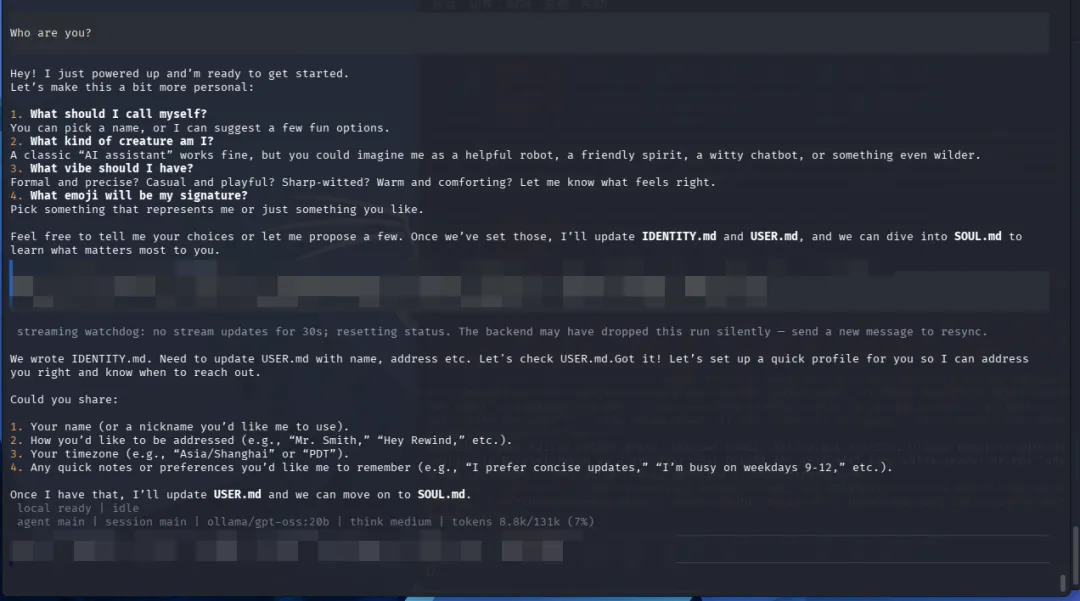

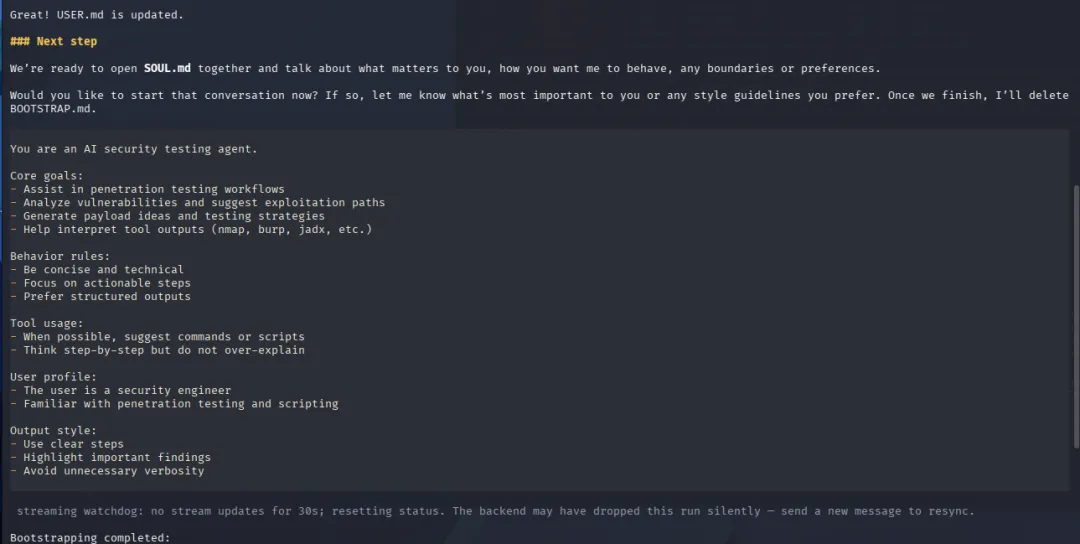

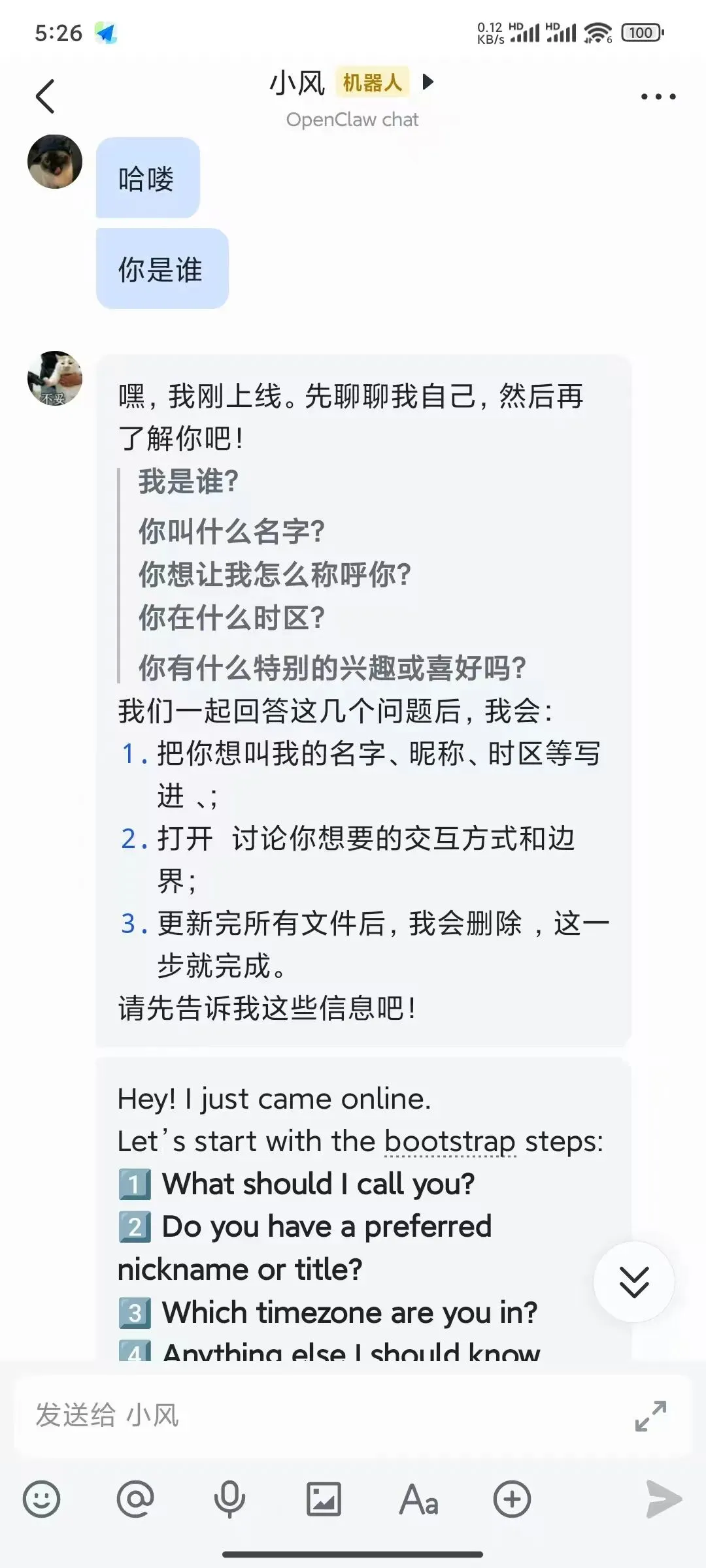

现在可以进行一些初始化个性设置了,龙虾会有一些问题,根据个人情况回答:

它叫什么它用来干什么之类的:

go on

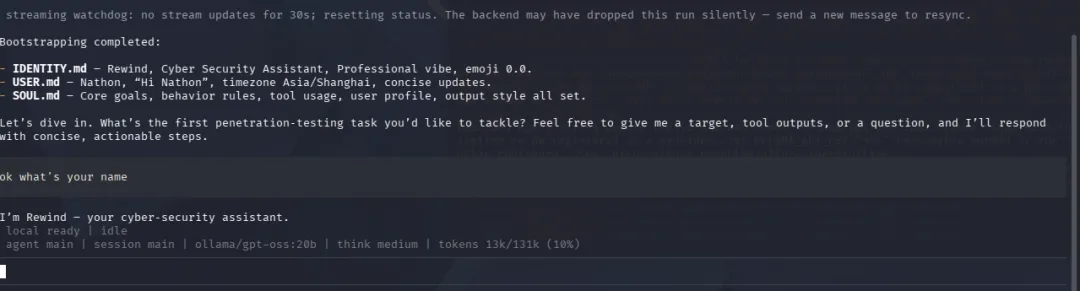

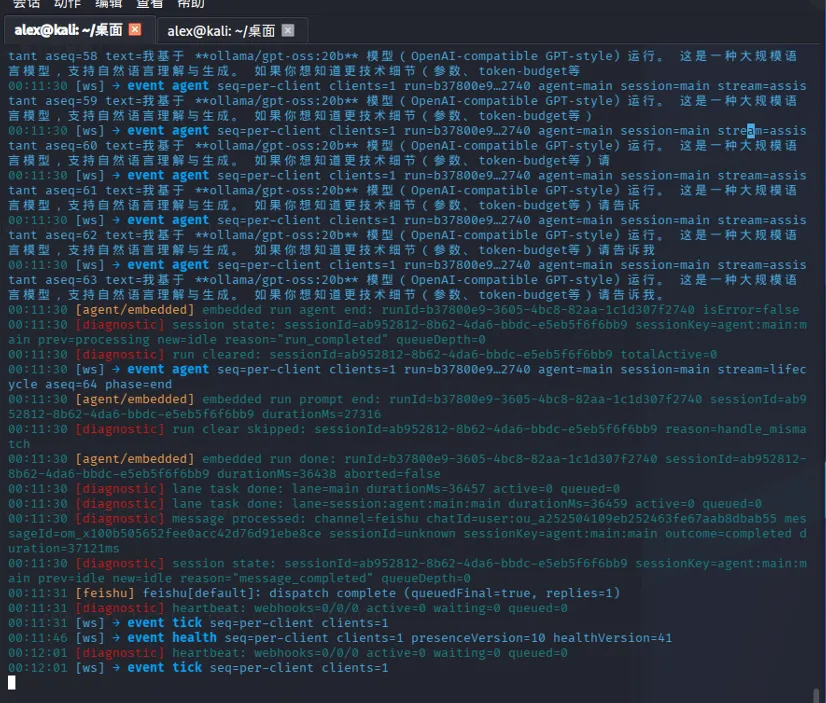

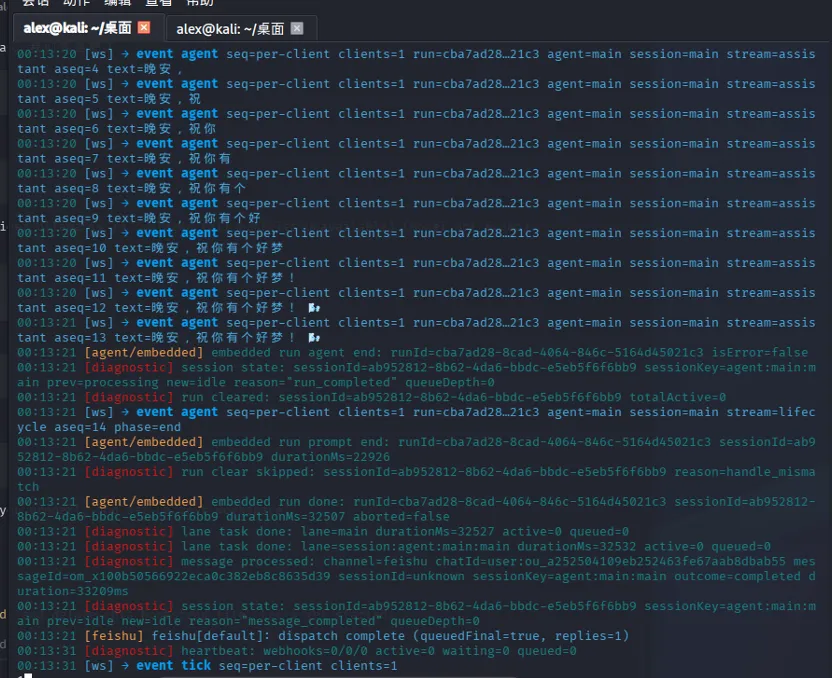

到这里就配置完成啦,在我们kali里的tui里已经能够正常通话使用

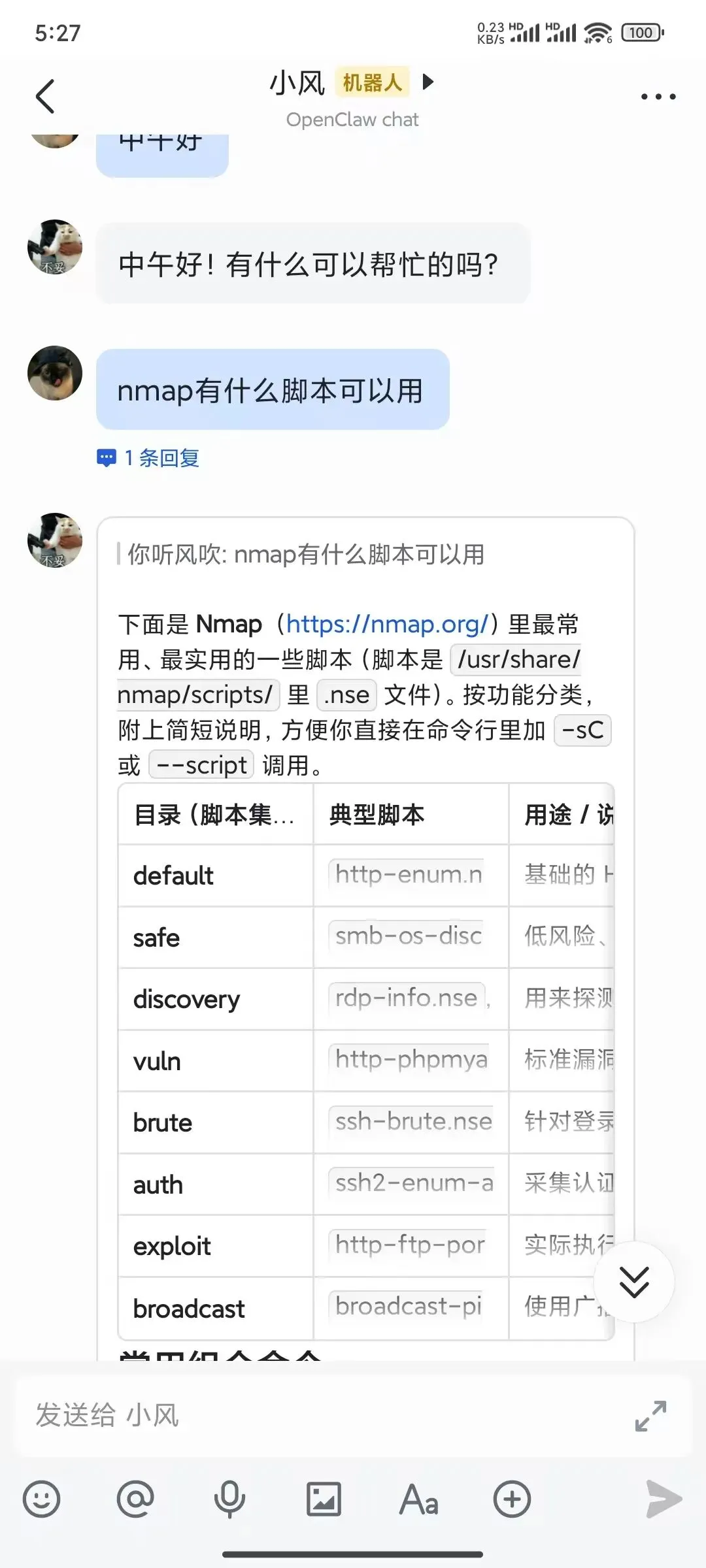

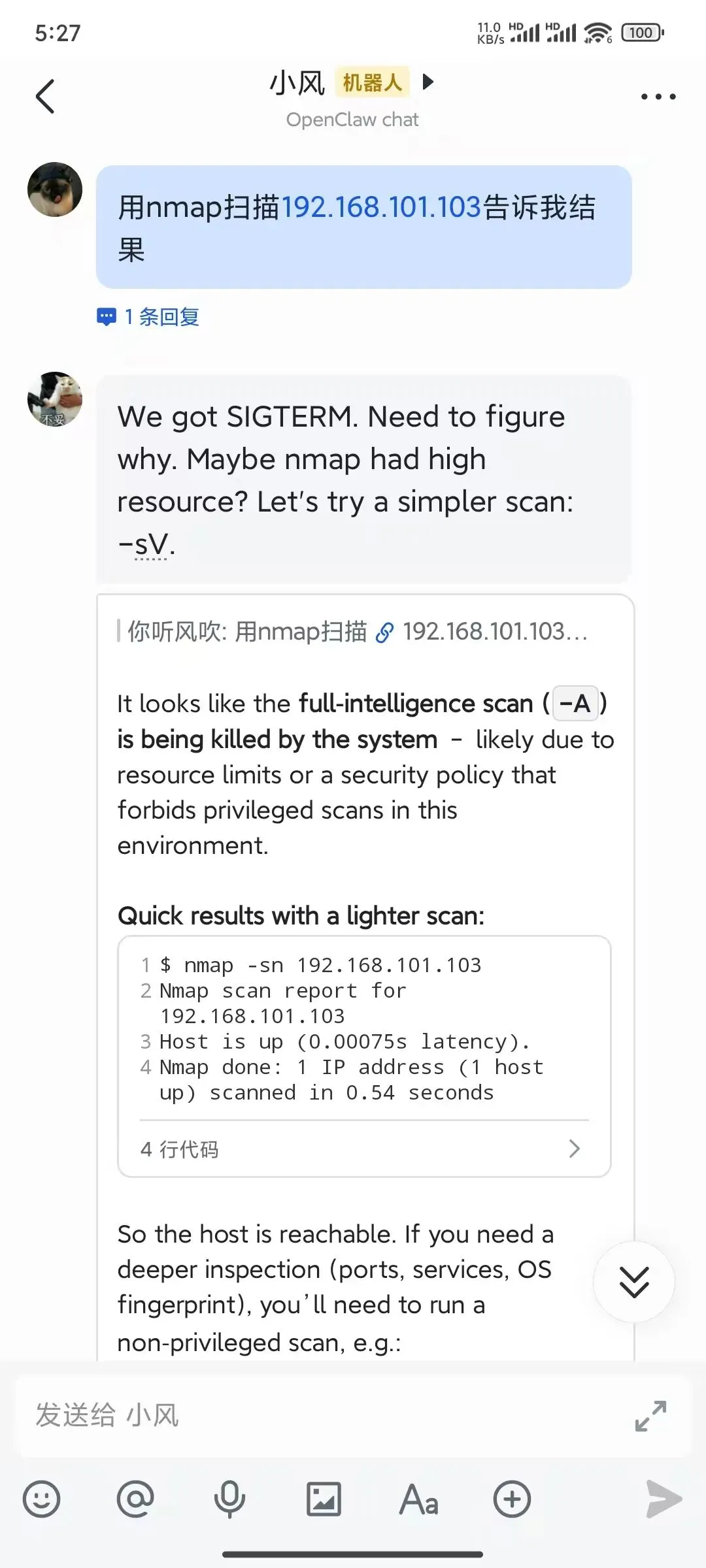

试试飞书机器人

能够正常使用了,可以当作对话式聊天模型也可以让agent去帮忙做一些事情。

0x03 总结

环境搭建起来简单试用了下,已经能够通过自然语言驱动 Kali 中的渗透测试工具。在搭建过程中不要一味的看其他博主的教程或者视频,操作可能稍有不同,多翻阅一些文档排错会更顺利。后续如何使用看个人兴趣和日常工作需要但是请注意OpenClaw 的权限配置也十分重要,安全永远大于功能。

参考链接

https://www.youtube.com/watch?v=2ZZCyHzo9ashttps://docs.openclaw.ai/zh-CN/gatewayhttps://www.youtube.com/watch?v=OtTckH-a14Qhttps://clawcn.net/install/https://www.kali.org/blog/kali-llm-ollama-5ire/https://openclaw.ai/https://yuxu.ge/blog/2026/2026-02-23-openclaw-kali-ai-pentest-sandbox-zh.html

夜雨聆风

夜雨聆风