有科学家开始拒绝使用AI!不是落后,而是害怕把思考能力外包出去

现在,生成式 AI 已经冲进科研圈。

写邮件、改论文、总结文献、生成代码、准备基金申请、写审稿意见,很多科研人员已经开始把 AI 当成日常工具。有人觉得它节省时间,有人觉得它提高效率,还有人认为不用 AI 就像拒绝计算器一样,是跟不上时代。

但最近,《Nature》发表了一篇职业特写,采访了一批明确拒绝使用生成式 AI 的学者。

他们不是不懂技术,也不是反科学。恰恰相反,很多人正是因为理解科研训练、学术诚信、环境代价和知识生产的复杂性,才选择不用。

这篇文章最值得关注的地方在于,它提出了一个很现实的问题:

当AI变得越来越方便时,人类还愿不愿意亲自学习、亲自判断、亲自写作、亲自犯错?

这不是一个简单的“用不用工具”问题。

它关系到科研训练的根基。

为什么有人拒绝用AI?

文章中提到,英国班戈大学的海洋动物学博士生 Danielle Crowley 几乎是她同届博士生中少数不使用生成式 AI 的人。她看到同事用 AI 写代码、调整邮件语气,甚至有人建议她用 AI 生成会议海报。

但她拒绝了。

原因很明确:她担心版权伦理,担心 AI 公司如何使用数据不透明,担心 AI 工具的环境影响,也担心 AI 输出内容的准确性。

更重要的是,她认为使用 AI 可能反而妨碍自己的学习。

比如写代码。

如果她最不自信的正是代码能力,那她更应该自己写、自己错、自己调试、自己学会,而不是马上把问题丢给 AI。

这句话非常关键。

学习本来就包含笨拙、错误和反复试错。

如果所有困难一出现,就交给 AI 解决,那么人看起来效率提高了,但能力可能没有真正长出来。

这就像学数学时,题目一不会就直接看答案。短期看很爽,长期看脑子没有形成解题能力。

科研训练也是一样。

博士阶段不是只为了产出论文,也是为了训练一个人如何发现问题、拆解问题、解决问题、表达问题。

如果这些过程过早外包给 AI,学生可能会失去最重要的训练机会。

不用AI,不等于反进步。

现在很多人有一种很粗暴的看法:谁不用 AI,谁就是落后;谁质疑 AI,谁就是保守;谁拒绝 AI,谁就是不懂未来。

但这篇《Nature》文章提醒我们,事情没有这么简单。

有些科学家拒绝 AI,不是因为他们不理解 AI,而是因为他们太清楚 AI 的问题。

比如澳大利亚昆士兰大学的数学家和保护科学家 Hugh Possingham 就明确表示自己不用生成式 AI。他甚至在 LinkedIn 上开玩笑说,自己选择依靠“natural stupidity”,也就是“天然愚蠢”。

这句话听起来幽默,但背后有很深的意思。

人类当然会犯错,会慢,会笨。

但人类在犯错中学习,在慢慢推理中形成判断,在亲自写作中组织思想。

AI 可以快速生成答案,但它也可能一本正经地胡说八道。

文章中提到,Possingham 曾看到 AI 生成内容出现明显幻觉:一篇硕士论文引用了一位已经去世十年后才“发表”的论文作者。这种错误荒唐到离谱,但如果读者不仔细查证,就可能被流畅语言骗过去。

这就是 AI 最危险的地方之一:

它不只是会错,而是会错得很自信。

人类写错,常常会露出犹豫、混乱或逻辑断裂。

AI 写错,可能语气非常稳,结构非常漂亮,引用看起来非常像真的。

这对科研来说非常危险。

因为科研不是看谁写得顺,而是看谁的证据可靠。

在化学领域,AI也会一本正经画错分子。

《Nature》文章还提到,加拿大麦吉尔大学化学家 Audrey Moores 对 AI 生成内容非常警惕。她看到过 AI 生成的化学结构图出现严重错误,甚至在化学期刊中出现“无意义分子”。

她的形容很直接:这就像让一个三岁小孩画化学结构。

这句话很刺耳,但很准确。

AI 可以模仿化学图像的外观,却不一定真正理解化学规则。它可能画出看起来像分子的东西,但键连错了、价态错了、结构不合理。

对外行来说,这种图可能很“科学”。

但对专业人士来说,这就是硬伤。

这提醒我们一个重要事实:

AI生成的东西,越专业,越需要专业人士检查。

问题是,如果检查 AI 的输出要花大量时间,那所谓“提高效率”可能就不成立了。

澳大利亚邦德大学社会科学家 Tanisha Jowsey 就说,她所在学院让她担任“AI champion”,也就是负责评估 AI 工具、判断模型适合做什么,并建议学院如何使用。

但她发现很讽刺的一点:检查 AI 输出常常比自己直接做还费时间。

她说,95%的时候,自己直接完成任务,比让 AI 做完再检查对不对更快。

这句话非常适合很多科研场景。

如果 AI 只是帮你处理低风险文本,比如改语法,可能确实省事。

但如果 AI 涉及专业判断、数据解释、文献归纳、实验设计、定性分析,那么你必须逐字检查、逐条核实。

最后你可能发现:AI 没有帮你省时间,只是把工作从“创作”变成了“纠错”。

AI的效率,可能是伪效率。

很多人迷信 AI,是因为它快。

几秒钟写一封邮件,几分钟生成一段综述,几十秒给你代码,确实很爽。

但科研真正需要的不是快,而是准。

如果快出来的是错的,后面就要花更多时间修正。

如果 AI 让学生绕过训练,短期看提高效率,长期看可能削弱能力。

如果 AI 让论文语言更漂亮,但内容没有更扎实,那它只是学术包装机。

如果 AI 让审稿报告更长、更礼貌,但没有真正判断论文质量,那它反而损害同行评审。

所以,关键问题不是 AI 能不能提高效率,而是:

它提高的是哪一种效率?牺牲的又是什么?

是节省了重复劳动,还是偷走了学习过程?

是提升了表达质量,还是掩盖了思考空洞?

是帮助科学家更好工作,还是让科学家越来越依赖工具?

这些问题都不能简单用“未来趋势”四个字糊弄过去。

科研写作不是机械劳动,而是思考过程。

这篇文章里另一个非常重要的观点,来自加拿大英属哥伦比亚大学保护科学家 Elizabeth Wolkovich。她不喜欢学生提交 AI 生成的论文写作内容,甚至决定不再主持或参加那些使用 AI 写作的研究生答辩委员会。

她的理由很清楚:

写作不是最后一步的包装,而是训练思维的一部分。

很多人以为,科研过程是先做实验、先分析数据,最后把结果写出来。于是写作只是“表达工具”,AI 替你写也没关系。

但真正做过科研的人都知道,写作本身就是思考。

你写引言时,要判断问题为什么重要。

你写方法时,要检查实验逻辑是否清楚。

你写结果时,要决定哪些数据真正支持结论。

你写讨论时,要面对研究的局限、意义和解释边界。

写作过程中,你会发现逻辑漏洞、数据矛盾、概念不清。

所以,写作不是把已有思想倒出来,而是在写的过程中形成思想。

如果把写作外包给 AI,学生失去的不只是语言训练,而是科研思维训练。

这就是为什么有些导师对 AI 写论文非常反感。

他们不是守旧,而是知道写作能力本身就是科研能力的一部分。

不会写,就很难真正会想。

这句话听起来狠,但很真实。

很多人的思考混乱,正是在写作时暴露出来的。

如果 AI 把混乱包装成流畅文字,导师和学生都可能错过发现问题的机会。

这不是帮助学习,而是遮蔽学习。

AI还有环境代价。

很多人使用 AI 时,只看到屏幕上的快捷回复,很少想到背后的数据中心。

《Nature》文章提到,生成式 AI 系统背后的数据中心会消耗大量能源和水。有研究估计,2025年全球 AI 系统的碳足迹可能达到 3260万到7970万吨二氧化碳,水足迹可能达到 3125亿到7646亿升。

这个量级非常惊人。

研究中甚至将其与纽约市整体碳足迹相比较。

这也是为什么 Crowley 这样的气候变化研究者会感到矛盾:如果自己的项目研究气候变化,却大量使用高耗能 AI 工具,她会觉得不合适。

这并不是说所有 AI 使用都不可接受,而是提醒我们:

AI不是云端魔法,它有真实的能源和水资源成本。

每一次生成回答、总结文章、生成图片,都不是零成本。

当全球数亿人每天大量调用 AI,背后的能耗和水耗就会变成一个现实环境问题。

所以,AI 的伦理不只是版权和准确性,也包括生态代价。

尤其对环境科学家、气候研究者、可持续发展研究者来说,这个问题更难回避。

如果一个工具带来的收益有限,却消耗更多能源和水,那么是否值得使用,就需要认真权衡。

还有人担心:我们不是在使用AI,而是在被AI使用。

文章中,瑞典斯德哥尔摩韧性中心的可持续发展科学家 Juan Rocha 提出一个很尖锐的观点:当我们使用 AI 工具时,其实也在帮助大型私营公司训练更强的算法。

他的说法很直接:你以为你在使用 AI,其实你正在被 AI 使用。

这句话很有冲击力。

因为每一次输入、反馈、纠错、使用习惯,都可能帮助平台优化模型、扩大市场、增强依赖。

长期来看,AI 公司变得更强,人类劳动可能变得更廉价,大学工作中的某些技能也可能被削弱。

这不是阴谋论,而是平台经济的基本逻辑。

用户越多,数据越多,模型越强,市场越集中,依赖越深。

如果学术界不加思考地把写作、审稿、教学、代码、文献总结都交给大型 AI 平台,那么大学的一部分知识劳动就可能被平台化。

这会改变学术工作的结构。

谁掌握工具,谁就掌握工作流。

谁掌握工作流,谁就可能影响未来知识生产。

版权和同意问题也没有解决。

麻省理工学院心理语言学家 Michaela Socolof 也表达了对生成式 AI 的反对。她认为,生成式 AI 训练使用了大量作者、艺术家和创作者的作品,而这些人并没有明确同意。

在她看来,这就是剽窃。

这个问题非常复杂,但不能轻轻带过。

AI 模型之所以能写文章、画图、模仿风格,是因为它吸收了海量人类创作内容。很多内容来自书籍、论文、网页、艺术作品、代码和公共文本。

但创作者是否同意被用于训练?

他们是否得到补偿?

模型输出是否会替代他们的劳动?

这些问题到今天仍然有巨大争议。

对学术界来说,尤其讽刺的是:科学家非常重视引用、署名、原创性,却可能在使用一个版权来源并不透明的工具。

这也是一些研究者拒绝 AI 的重要原因。

他们不是害怕新技术,而是觉得这项技术目前的生产方式还不够干净。

当然,科研圈并不是所有人都拒绝AI。

事实上,越来越多科学家正在使用 AI。

《Nature》文章提到,一项约5000名研究人员参与的 Nature 调查显示,超过90%的受访者认为,使用 AI 编辑或翻译自己的文本是可以接受的,但较少人接受直接用 AI 生成文本。

同一调查中,实际使用 AI 的人仍然是少数:约四分之一受访者使用 AI 编辑论文,只有8%用于翻译、总结或写初稿。

而 Elsevier 后来对3234名研究者的调查显示,使用 AI 的研究者比例从前一年的37%上升到58%。在用途上,61%的人希望用 AI 查找新研究,51%用于收集和总结文献,41%用于准备基金申请。

这说明,科研界并不是简单分成“AI派”和“反AI派”。

真实情况更复杂。

有些人完全不用。

有些人只用来改语法。

有些人用来查文献。

有些人用来写代码。

有些人用来起草邮件。

也有人直接用它写论文、写评审、做图。

所以,未来最重要的问题不是简单禁止,也不是全面拥抱,而是建立边界。

哪些任务可以用AI?哪些任务必须由人完成?

这是大学和科研机构必须认真回答的问题。

比如,用 AI 检查错别字、优化语法,风险相对较低。

用 AI 帮助非英语母语作者润色表达,也可能有公平意义。

用 AI 帮助理解代码报错、生成基础脚本,也可以作为学习辅助。

但用 AI 代写论文、生成审稿意见、伪造文献总结、生成不可核实的图像、替代学生独立思考,风险就很大。

尤其是在教学和研究生训练中,必须区分“工具辅助”和“能力替代”。

学生可以用计算器,但不能因此不学数学。

学生可以用文献管理软件,但不能因此不读文献。

学生可以用 AI 查语法,但不能因此不训练写作和思考。

这条线很重要。

AI最危险的地方,是让人误以为自己会了。

你让 AI 写一段代码,程序跑通了,你可能觉得自己掌握了。

但下次报错,你可能仍然不懂为什么。

你让 AI 写一段论文讨论,看起来很专业,你可能觉得逻辑已经成型。

但导师一问细节,你可能说不清证据链。

你让 AI 总结十篇文献,看起来条理清楚,你可能觉得已经掌握领域。

但真正读原文时,你才发现关键争议和方法细节完全被压缩掉了。

所以,AI 很容易制造一种虚假的掌握感。

这对学习者尤其危险。

因为学习不是得到答案,而是建立能力。

如果一个人总是跳过痛苦过程,只保留漂亮输出,那么他的能力增长会很慢。

这也是为什么一些学者拒绝 AI。

他们不是不知道 AI 方便,而是不愿意牺牲能力形成过程。

慢,不一定是坏事。

现代社会太迷信效率了。

写得快,发得快,回得快,产出快。

但科研里有些慢是必要的。

慢慢读文献,才能看出争议。

慢慢写论文,才能理清逻辑。

慢慢调代码,才能理解方法。

慢慢失败,才能知道边界。

慢慢修改,才能形成判断。

AI 可以加速很多事情,但不是所有事情都应该被加速。

有些训练一旦被加速跳过,人就会变得空心。

这正是《Nature》这篇文章最有价值的地方:它让那些拒绝使用 AI 的学者说出了自己的理由。

他们不是不懂未来。

他们只是认为,未来不能只由效率定义。

科研不是流水线,大学也不是内容工厂。

如果科研只剩下更快写摘要、更快做PPT、更快发邮件、更快生成论文,那它可能会失去最重要的东西:深度思考、真实判断和长期能力。

AI 应该是工具,而不是大脑替代品。

它可以帮人减轻机械负担,但不能替人承担学术责任。

它可以帮人润色语言,但不能替人形成思想。

它可以帮人找线索,但不能替人判断真伪。

它可以帮人加速工作流,但不能替人完成学习过程。

如果这条边界守不住,科研教育就会被悄悄掏空。

表面上论文更多、效率更高、表达更顺。

实际上,学生的写作能力、判断能力、专业直觉和独立思考可能下降。

这才是最值得警惕的地方。

不用AI,也是一种选择权。

现在很多人把“不用 AI”看成落后,甚至会催别人“你必须用”。

这其实也是一种压力。

就像文章里 Crowley 说的,不用 AI 有点像参加聚会时说自己不喝酒。

别人会惊讶,会劝你,会觉得你不合群。

但科研人员应该有权选择自己的工作方式。

有人觉得 AI 能提高效率,可以使用,但应该透明、负责、谨慎。

有人觉得 AI 有伦理、环境、学习成本问题,也应该有权拒绝。

真正成熟的学术环境,不应该强迫所有人追赶同一个工具潮流。

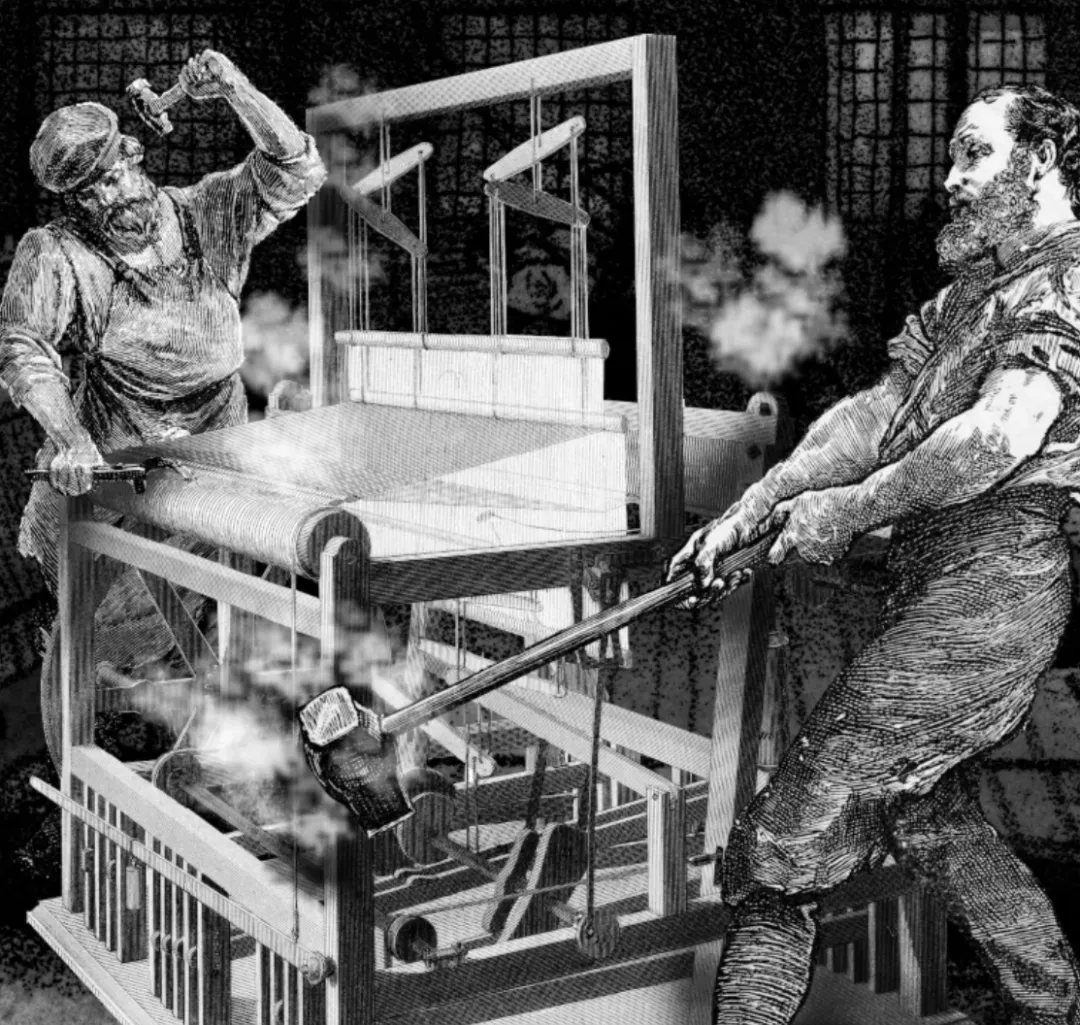

更不应该把质疑 AI 的人简单骂成“卢德分子”。

历史上的卢德分子常被描述成反技术者,但他们真正反对的往往不是机器本身,而是机器被用来压低劳动价值、摧毁生计和改变社会关系。

今天一些学者拒绝 AI,也不是单纯讨厌技术,而是在质疑:这项技术究竟由谁控制?消耗什么资源?侵犯谁的劳动?改变什么训练?削弱什么能力?

这些问题不但合理,而且必要。

AI越强,人越要清楚自己为什么用它。

盲目不用,可能错过工具。

盲目使用,可能失去判断。

真正理性的态度,是知道每次使用的目的、边界和代价。

比如:

用 AI 改语法,是为了提高表达清晰度,不是为了替代思考。

用 AI 帮助查找资料,是为了发现线索,不是为了代替阅读原文。

用 AI 辅助代码,是为了学习和调试,不是为了不懂也复制运行。

用 AI 准备基金草稿,是为了节省格式劳动,不是为了编造创新点。

用 AI 做任何专业任务,都必须由人类最终核查和负责。

这才是合理使用。

但如果一个人决定完全不用,也完全可以。

这不是落后,而是有意识地维护自己的学习方式、伦理边界和工作习惯。

未来真正稀缺的,可能不是会不会用AI,而是不用AI也能独立思考。

当所有人都能让 AI 写出流畅文字时,文字流畅就不再稀缺。

当所有人都能让 AI 生成代码时,生成代码本身不再稀缺。

当所有人都能让 AI 总结文献时,摘要不再稀缺。

真正稀缺的是:

你能不能提出好问题?

你能不能判断答案对不对?

你能不能识别胡说八道?

你能不能独立写出有思想的文字?

你能不能在没有 AI 的情况下理解方法?

你能不能对自己的研究负责?

这才是科研人的核心能力。

AI 时代并不会让人类能力不重要,反而会让真正的人类能力更重要。

因为机器可以批量生成普通内容,但不能替你成为一个有判断力的科学家。

这篇《Nature》特写给我们的最大启示是:

拒绝使用AI的学者,不一定是反对未来;他们可能是在保护科研最核心的东西:学习、判断、写作、责任和独立思考。

AI 可以是好工具。

但工具越强,越要问清楚:它帮了我什么?又偷走了我什么?

如果它帮你节省了机械劳动,那很好。

如果它偷走了你的训练过程,那就要小心。

如果它帮你表达得更清楚,那很好。

如果它让你以为自己懂了,其实没有懂,那就危险。

如果它帮你处理低风险任务,那很好。

如果它替你做专业判断,那就越界了。

科学最怕的不是慢。

科学最怕的是看起来很快,实际上很空。

所以,在这个人人追着 AI 跑的时代,有些学者选择停下来、自己写、自己查、自己学、自己犯错,这不是愚蠢。

这可能是一种清醒。

一句话总结:

AI可以帮人变快,但不能保证人变强。真正的科研训练,不只是产出结果,而是把一个人训练成能独立判断的人。

资料来源:《Nature》职业特写《Meet the academics refusing to use generative AI》,发表于2026年5月5日。

夜雨聆风

夜雨聆风