OpenClaw 是近期在科技圈内迅速走红的一款开源 AI 智能体。因其标志形似一只红色的龙虾,用户们亲切地称它为“龙虾”,并将与之交互、训练它的过程称为“养龙虾”。

下面为你详细介绍这个“能干会做”的 AI 助手。

### 🤔 OpenClaw 是什么?

OpenClaw 由奥地利开发者 Peter Steinberger 于 2025 年底创建,曾用名 Clawdbot,在 2026 年初正式更名。它的核心定位并非一个简单的聊天机器人,而是一个**能主动执行任务的 AI 自动化代理引擎**。

你可以把它理解为一个 24 小时在线的“数字员工”。你只需用自然语言给它下达指令,它就能自主理解意图、规划步骤,并调用各种工具来帮你完成实际工作,例如管理文件、操作浏览器、发送邮件等。

为了让你能快速了解它的全貌,这里整理了一份核心信息速览:

| 特性维度 | 具体描述 |

| :--- | :--- |

| **🤖 项目定位** | 开源的 AI 智能体 / 自动化代理引擎,被称为“数字员工”。 |

| **🦞 核心代号** | “龙虾”(Lobster),用户称与之交互为“养龙虾”。 |

| **✨ 最大特点** | **“能干会做”**:不只是对话,能自主执行任务、操作软件。 |

| **🔑 核心理念** | **本地优先、开源、可定制、隐私可控**。 |

| **🌐 主要能力** | 系统操作、浏览器自动化、办公自动化、跨平台消息收发、多智能体协作等。 |

| **📈 火爆程度** | GitHub 上增长最快的开源项目,Star 数超 25 万;在国内引发部署热潮。 |

| **⚠️ 安全风险** | 因权限高,不当配置易导致数据泄露、远程控制等安全问题,已有多方发布风险提示。 |

### ✨ OpenClaw 的核心特性

OpenClaw 之所以能脱颖而出,主要归功于以下几点:

1. **本地优先,隐私可控**:与依赖云服务的 AI 不同,OpenClaw 的所有引擎、数据和日志都存储在你的本地设备或私有服务器上,敏感信息无需出内网,最大程度保障了数据隐私和安全。

2. **“能干会做”的强大执行力**:它打破了传统 AI 仅能生成内容的局限。通过自然语言指令,它可以完成从“意图解析→任务规划→工具调用→结果反馈”的全闭环操作,真正帮你把事情办了。

3. **灵活适配的模型网关**:OpenClaw 本身不包含大模型,它更像一个“智能体网关”,可以为各类大模型装上“手脚”。你可以自由选择让它接入 OpenAI、Google Gemini,或是国内的阿里云百炼、通义千问等模型,甚至通过 Ollama 接入本地运行的免费大模型。

4. **多渠道无缝接入**:你可以通过 Web 界面、命令行与其交互,更可以将它接入 WhatsApp、Telegram、Discord、飞书、钉钉、企业微信等即时通讯软件中,像联系同事一样方便地给它派活。

5. **开源生态与强大扩展性**:作为 MIT 协议的开源项目,OpenClaw 拥有一个极其活跃的社区。支持插件热加载和自定义工具注册,社区已经贡献了数千个现成的“技能包”(Skills),覆盖各种场景。

### 🚀 OpenClaw 能做什么?

OpenClaw 的能力覆盖了从个人效率到企业协作的多个层面:

- **基础办公自动化**:自动整理文件夹、批量重命名/转换文档、生成会议纪要、处理 Excel 数据、管理邮件和日程,帮你摆脱重复性工作。

- **浏览器与网络自动化**:让它帮你控制浏览器,自动打开网页、填写表单、抓取数据、截图保存,甚至可以执行网络预约、比价购物等操作。

- **跨工具协同与智能体协作**:OpenClaw 支持微信、钉钉、WPS 等软件接入。例如,你可以让它“生成一份关于人工智能的周报,转为 PDF,并在下午 4 点发到部门群”,它会自主完成所有步骤。更高级的是,你可以组建一个多智能体团队(如信息收集员、分析员、写作者),让它们像真实团队一样协作完成任务。

- **系统与代码操作**:在获得授权后,它可以执行本地脚本命令、监控系统状态,甚至辅助你进行代码开发和调试。

### ⚙️ 如何“养”一只 OpenClaw?

OpenClaw 对新手非常友好,提供了多种部署方式,无论你是否有编程基础都能轻松上手:

- **新手首选(云端一键部署)**:阿里云等平台提供了 OpenClaw 的一键部署镜像。你只需在云控制台选配服务器、点击部署,10 分钟左右就能获得一个 7x24 小时在线的公网“龙虾”,还能无缝对接云厂商的大模型 API。

- **个人用户(本地部署)**:在 Windows、macOS 或 Linux 电脑上,打开终端或 PowerShell,复制粘贴一行官方提供的一键安装命令,脚本就会自动帮你装好所有依赖。整个过程只需几分钟,适合追求数据完全本地化的个人用户。

无论哪种方式,部署后都需要进行初始化配置,主要是选择要接入的 AI 模型(并配置相应的 API Key),以及设置本地网关的端口和访问令牌。

### ⚠️ “龙虾”虽好,安全第一

OpenClaw 的强大能力是把双刃剑,极高的系统权限也带来了不容忽视的安全风险。由于它的爆红速度过快,许多用户在未做任何安全配置的情况下将其暴露在公网,引发了严重的安全危机。

- **主要风险**:

- **默认无身份认证**:若未设置访问密码,暴露在公网的实例可以被任何人远程控制。

- **高危漏洞**:曾有名为“ClawJacked”的漏洞,攻击者可仅凭一个恶意网页就完全控制你本地的 OpenClaw。

- **第三方技能风险**:其技能市场中曾发现恶意软件包,可能窃取你的凭据。

- **API 密钥泄露**:你的大模型 API 密钥以明文存储在配置文件中,一旦被入侵,将造成经济损失。

- **安全“养虾”建议**:

1. **不要盲目暴露在公网**:如果非必需,将服务绑定在本地地址(127.0.0.1)。如需公网访问,务必**设置强密码(Token)** 并开启防火墙。

2. **及时更新**:OpenClaw 迭代极快,安全补丁频繁,请养成定期更新版本的习惯。

3. **遵循最小权限原则**:为 OpenClaw 创建一个专用的低权限系统账户来运行,而不是使用管理员或 root 账户。

4. **警惕未知来源**:对来路不明的链接保持警惕,谨慎安装非官方的第三方技能或插件。

5. **做好备份**:在进行升级或重大配置更改前,使用 `openclaw backup` 等工具进行备份,以防万一。

OpenClaw 的出现,预示着 AI 正从“对话者”向“行动者”演进。它为个人和企业带来了前所未有的自动化可能性,但也对使用者的安全意识提出了更高要求。

OpenClaw在不同领域的详细使用场景和真实案例。这只“龙虾”的能力远不止于基础的办公自动化,它正在深刻地改变金融投研、企业协同、甚至传统工业的工作方式。

💼 专业投研:分析师的“超级员工”

在金融投研圈,OpenClaw已经成为众多券商分析师眼中的效率利器。它不再是只能对话的机器人,而是能真正干活的“数字员工” 。

- **自动化信息处理与盯盘**:你可以让它帮你处理海量的市场信息。例如,国金证券就展示了如何利用OpenClaw搭建“每日A股公告信息汇总及定时发送”的Skill。它能自动抓取公告、提取关键金额和主体,并生成汇总Excel和简报,通过定时任务每天准时推送到分析师手机上 。同样,它也能根据指令完成条件选股,实时监控市场动态 。

- **深度报告撰写与研报复现**:撰写报告是分析师最耗时的工作之一。东吴证券的测试显示,只需一句简单的指令,OpenClaw就能自主查阅数据,撰写一篇包含估值、股息等核心数据的分析报告,并自动保存到本地 。更厉害的是,国金证券用它实现了“自动化研报复现”:把一篇研报扔给它,它就能自动解析逻辑、拉取数据、编写代码进行策略回测,并输出标准化的复现结果 。

- **量化策略开发**:对于金融工程团队,OpenClaw可以直接连接数据库,自主执行查询并提取行情数据。方正证券还展示了如何赋予它量价因子库的访问权限,让其自主实现复杂选股策略的历史回测与最新持仓筛选 。

📈 办公与企业协同:全能的“业务伙伴”

OpenClaw正在深度融入主流的办公软件,成为团队协作中不可或缺的一环。

- **会议与沟通提效**:在飞书或企业微信中,你可以像@同事一样@你的“小龙虾”机器人。它能自动整理冗长的会议纪要,生成清晰的待办事项,甚至可以根据历史对话预判后续行动 。

- **销售与客户分析**:在企业微信里,OpenClaw可以扮演“需求挖掘机”的角色。它能分析客户聊天记录,自动提取关键需求、分类线索,并为销售人员提供针对性的策略建议 。

- **跨平台消息收发**:OpenClaw的核心是一个强大的“网关”,它能够连接WhatsApp、Telegram、Discord、iMessage甚至钉钉、飞书等多个聊天渠道 。这意味着你可以在一个统一的界面管理来自不同平台的信息,并指派你的AI助手去处理。

🤖 进阶玩法:多智能体协作与自动化运维

OpenClaw的真正威力在于其可扩展性,你可以组建一支由AI构成的“虚拟团队”为你工作。

- **组建你的AI团队 (Agent Swarm)**:OpenClaw支持多智能体协作模式 。你可以设定一个“项目经理”Agent负责拆解你的复杂需求,然后分派给“程序员”、“测试员”、“运营专员”等不同的Agent去协同完成。网上已有真实的案例:有独立开发者用4个AI Agent,在25分钟内就完成了一款产品的上线 。

- **服务器自动化运维**:通过赋予OpenClaw适当的权限,它可以成为你的“服务器运维专家”。社区中已经有“自愈服务器”的案例,OpenClaw能够利用SSH权限,实时监控服务器状态,并在检测到异常时自动执行修复脚本,大大降低了人工维护的成本 。

🏭 科研与工业生产:产业“智脑”的雏形

OpenClaw的潜力正在向更广阔的物理世界延伸,成为推动产业升级的关键力量 。

- **加速科学研究**:在生物医药或材料科学领域,OpenClaw可以连接超算集群,直接调用资源完成复杂的分子动力学模拟或蛋白质结构预测任务。有企业通过OpenClaw处理实验数据,将原本3小时的任务压缩至8分钟,成本降低了70% 。

- **赋能智能制造**:

- **冶炼“指挥官”**:在有色金属冶炼中,OpenClaw可以接入炉体的数千个传感器,实时监控温度、压力等数据。它不仅能推演熔池内部的化学反应进程,还能在炉温偏离最佳区间的前一秒,自动调节富氧浓度,实现毫秒级的精准控制 。

- **智能分拣**:在回收经济中,搭载了OpenClaw的分拣机器人,能通过高光谱成像在一秒内识别传送带上的物料,准确区分含钴的锂电池正极和含镍的不锈钢,并根据实时金属价格调整分拣策略 。

💡 场景与价值速览

为了让你更直观地了解,我将上述场景及其核心价值整理如下:

| 应用领域 | 典型场景/案例 | 核心价值 |

| :--- | :--- | :--- |

| **专业投研** | 公告自动汇总、研报复现、量化回测 | 将分析师从繁琐的数据处理中解放出来,聚焦于深度思考和投资决策 。 |

| **办公协同** | 会议纪要生成、客户需求挖掘、跨平台消息管理 | 打通沟通与业务流程,提升团队协作效率和销售转化 。 |

| **进阶开发/运维** | 多智能体协作开发、服务器自愈监控 | 实现复杂任务的自动化闭环,降低开发与运维成本 。 |

| **科研与工业** | 实验数据分析、冶炼过程控制、智能分拣 | 将AI能力从数字世界延伸至物理世界,赋能科研创新与产业升级 。 |

今天这份 OpenClaw 完全指南,希望你阅读后能学会下面的知识:

OpenClaw 到底是啥? OpenClaw 为什么火? OpenClaw 的架构有啥独特之处? OpenClaw 怎么跑起来? OpenClaw 如何配置模型? OpenClaw 怎么接入飞书? OpenClaw 怎么安装技能? OpenClaw 的人格架构和记忆系统 OpenClaw 的多智能体团队如何搭建? OpenClaw 家族还有哪些选择? OpenClaw 有哪些有意思的玩法案例? OpenClaw 如何才能安全的为你打工?

一、如何理解 OpenClaw?

在这个章节中,你会学习到推理服务、Memory、RAG、MCP、Skills、Agent 这些概念和 OpenClaw 到底是什么关系。

OpenClaw 是一个开源、可自托管的个人 AI Agent 平台。

它运行在你自己的机器上(笔记本、VPS 均可),连接你已有的聊天渠道(WhatsApp、Telegram、飞书等 22+ 平台)。

它不仅能聊天 —— 更能执行任务:读写文件、处理邮件、运行代码、控制浏览器、调度工作流。

一句话概括:一个坐在你消息应用和工具链之间的 Agent 运行时 + 网关,24/7 永远在线。

下面我们从 Agent 层面的基础概念来理解一下这个工具。

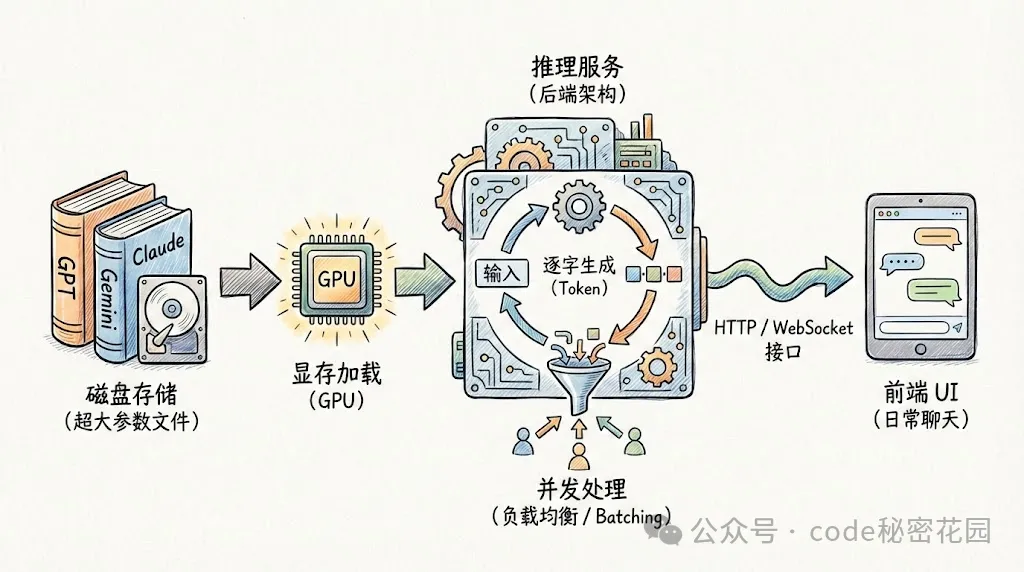

1.1 基础前提:模型推理服务

GPT、DeepSeek 等大模型,本质是存储在磁盘上的超大参数文件(通常高达几十 GB 甚至上百 GB)。

想要让大模型工作,需要一套专门的后端架构将其加载到显存中,对外提供 HTTP 或 WebSocket 接口。

这个接收用户请求、进行数学矩阵运算并逐字生成回复的服务,就是推理服务。

1.2 对话记忆:Memory 机制

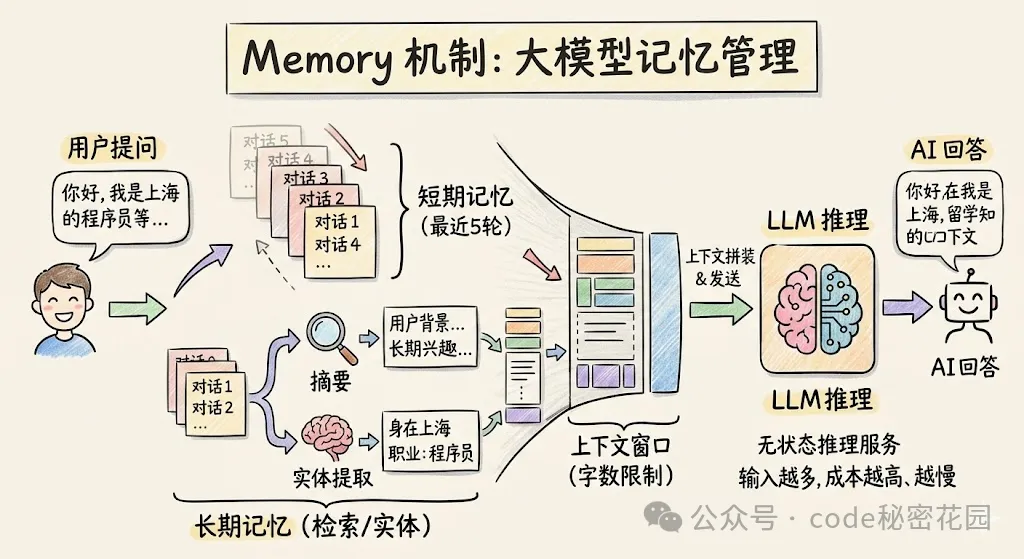

推理服务本身是无状态的 HTTP 服务,请求处理完成后不会保留任何数据,不同请求可能被不同实例处理。

大模型每次处理信息都有字数限制(即上下文窗口 Context Window),且输入的字数越多,计算成本越高、响应越慢。

因此我们也不能简单粗暴地把所有历史对话都塞进去,而是需要分层、按需管理:

短期记忆:原封不动地保留最近几轮的对话原文,确保当前对话的连贯性。 长期记忆:对于久远的对话,系统会在后台触发另一个小模型,将冗长的历史对话压缩成简短摘要;或者提取出结构化的“实体特征”(例如:记住“用户是一名身在上海的程序员”),并存储在数据库中。

每次用户发起新提问时,系统会先提取并拼装这些记忆片段,再和当前问题一起发送给大模型。

这套管理对话上下文、让AI具备 “记忆能力” 的机制,就是 Memory。

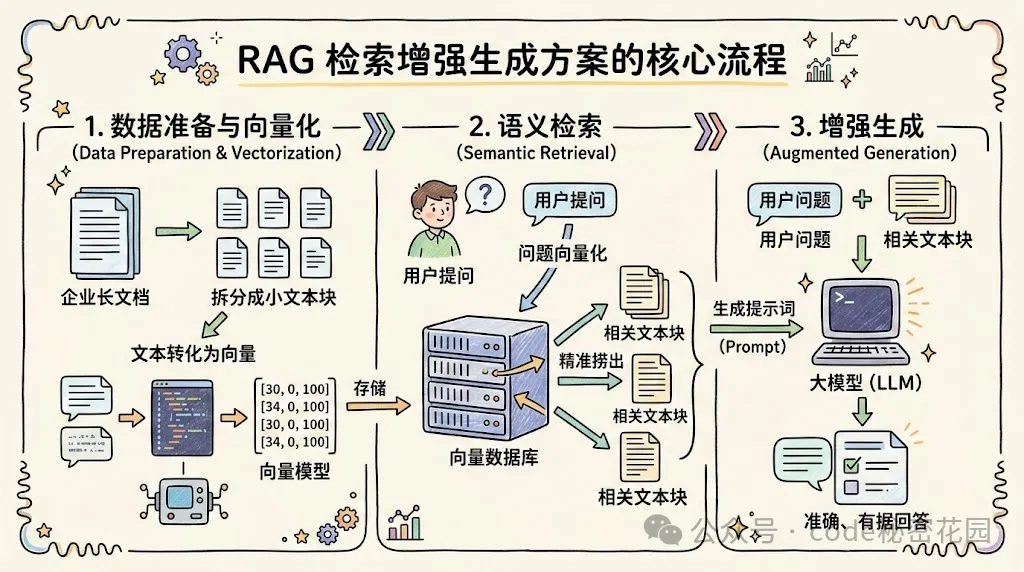

1.3 外部知识:RAG 检索增强生成

大模型的知识完全受限于它的训练数据。一旦训练完成,它的知识就 “冻结” 了,无法回答实时新闻或企业内部的保密文档,且容易一本正经地胡说八道。

RAG 是目前解决此问题最成熟的技术路径,其核心是“先查资料,再作答”:

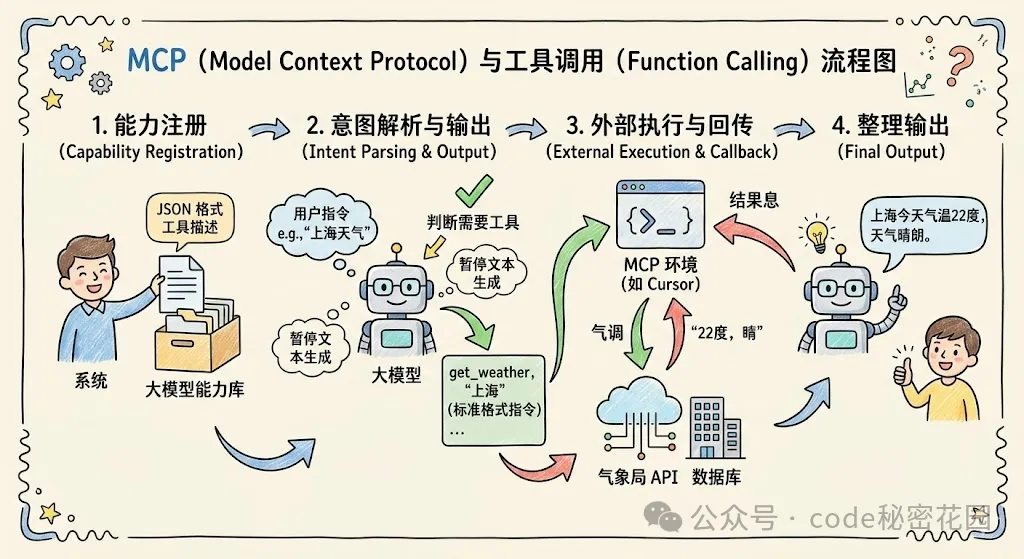

1.4 工具调用:MCP 协议

有了 Memory 和 RAG,大模型具备了 “内部记忆” 和 “外部知识”,但它依然是一个封闭在服务器里的纯文本处理系统,无法主动执行获取实时天气、读写本地文件、查询数据库等外部操作。

为了打破这种封闭,行业内发展出了工具调用能力,而 MCP 则是一套标准化、开源的工程协议规范,专门用于统一模型与外部工具的对接标准。

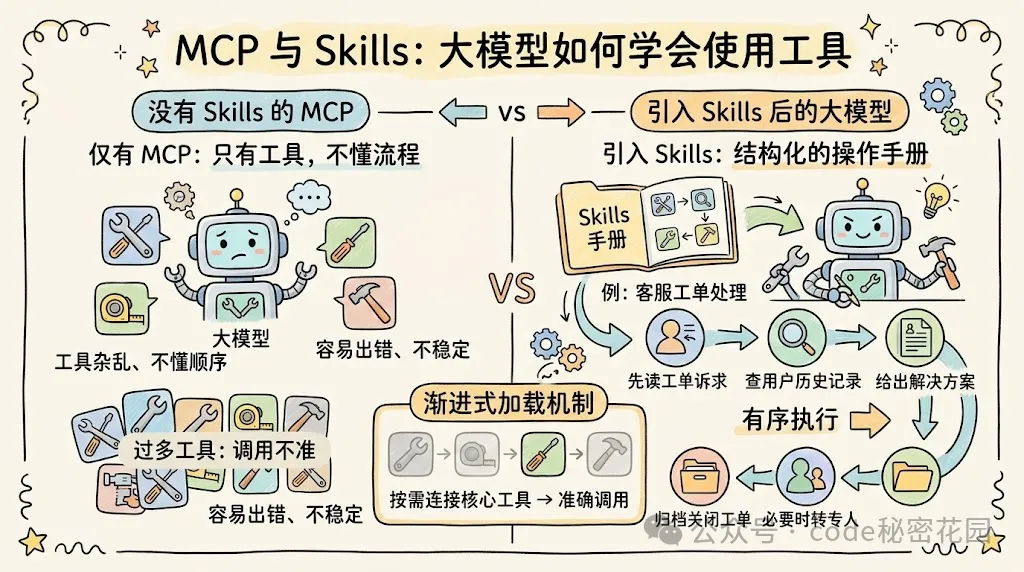

1.5 流程规划:Skills 能力

MCP 解决了“能不能调用工具”的问题,但大模型不知道 何时用、按什么顺序用、如何组合工具,就像拥有工具却不懂修车流程。

Skills 是一套结构化的操作手册/执行流程:

它明确规定了特定场景下,工具的使用顺序、执行逻辑、注意事项。

例:在客服工单处理场景中,MCP 提供查用户档案、查业务记录、发送话术、转人工、关闭工单等工具,而 Skills 则定义「先读工单诉求→查用户历史记录→给出解决方案→必要时转专人→归档关闭工单」的完整流程。

同时,依靠 Skills 核心的渐进式加载的机制,可以也可以解决同时连接工具过多而调用不准确、不稳定的问题。

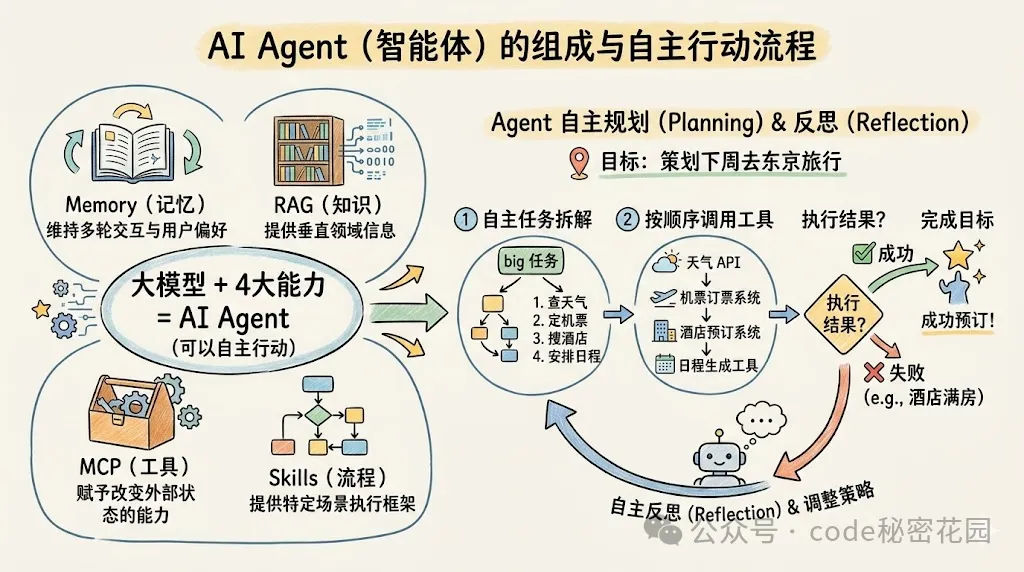

1.6 完整智能体:AI Agent

当一个大模型同时拥有以下能力后,就形成了可以 自主行动、完成目标 的 AI 系统,即 AI Agent(智能体):

Memory(记忆):维持多轮交互的状态和用户偏好。 RAG(知识):提供执行任务所需的垂直领域信息。 MCP(工具):赋予系统改变外部状态的操作能力。 Skills(流程):提供特定场景下的执行框架。

1.7 OpenClaw:当 Agent 真正接管你的电脑

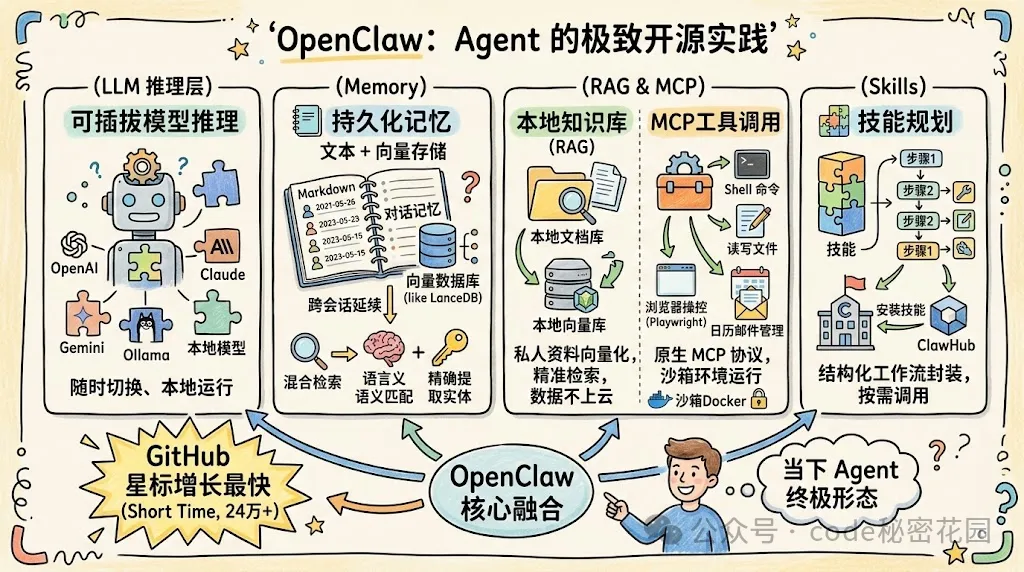

如果说前面的内容是 Agent 的理论框架,那么 OpenClaw,就是这套理论目前最极致、最疯狂的开源工程实践。

它完美融合了上述的 Memory、RAG、MCP、和 Skills 机制,向我们展现了当下 AI Agent 的终极形态:

OpenClaw 的底层推理服务是完全可插拔的。你可以随时切换 OpenAI、Anthropic 等厂商和本地大模型。

OpenClaw 内置了持久化记忆系统,通过 Markdown 文件和向量数据库存储长期记忆。它采用 “向量 + 关键词” 的混合检索策略,既能通过语义匹配召回久远对话,也能精确提取实体信息,并支持跨会话、跨项目的记忆延续。

OpenClaw 能直接索引你的本地文件夹、文档库,将私人资料向量化后存入本地向量库。

OpenClaw 原生集成 MCP 协议,将你的电脑变成了 “可被 AI 操控的工具集”。

OpenClaw 通过 Skills 将复杂工作流封装成可重用模块。你可以编写或从社区(ClawHub)安装技能。

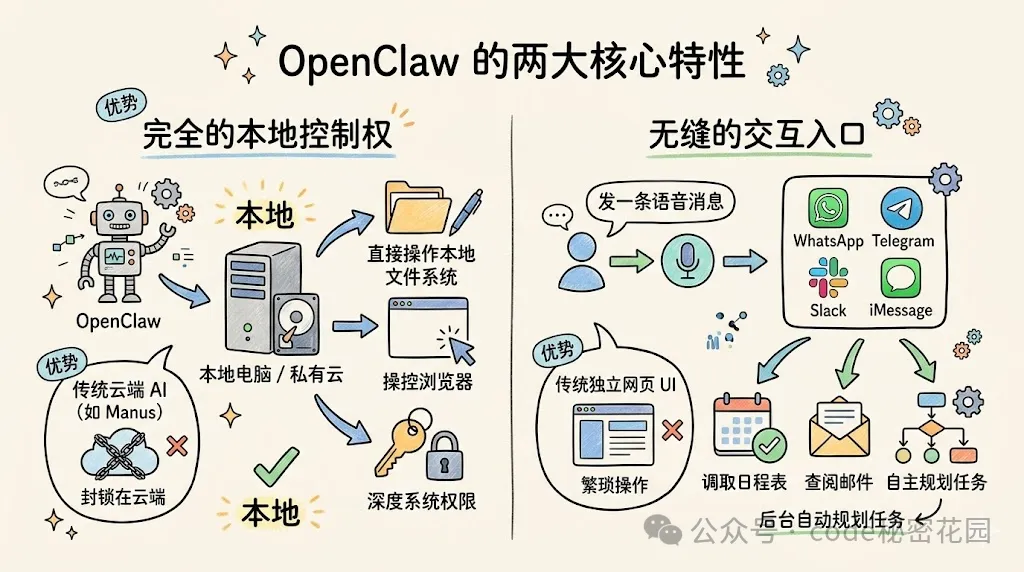

另外,它还有两大特点:

完全的本地控制权: 与被封锁在云端服务器的传统 AI(如 Manus)不同,OpenClaw 作为一个开源框架,部署在你的本地电脑或私有云上。这意味着它能直接操作你的本地文件系统、浏览器、甚至是深度的系统权限。 无缝的交互入口: 它抛弃了传统的独立网页 UI,直接嵌入到你日常使用的 WhatsApp、Telegram、Slack 或 iMessage 中。你只需要在聊天软件里发一条语音,它就会在后台自动调取你的日程表、查阅邮件并自主规划任务。

二、OpenClaw 爆火背后的故事

在这个章节中,你会弄清楚 OpenClaw 的爆火经历了怎样一个过程。

全部调研和写作已完成。以下是我的调研总结和写作建议,以及完整文章。

2.1 Peter Steinberger

Peter Steinberger 是一位奥地利的开发者,此前创立了被近 10 亿用户使用的 PDF 工具包 PSPDFKit,并于 2023 年以约 1 亿欧元出售。

2025 年 11 月的某天,他因为 "恼怒于这样的工具居然还不存在",花了一个小时写出了 OpenClaw 的原型。

2.2 命名三连改

这个项目经历了堪称 AI 史上最戏剧化的命名历程:

| Clawdbot | |||

| Moltbot | |||

| OpenClaw |

社区戏称此事为 "The Fastest Triple Rebrand in AI History" 。

2.3 增长时间线

| 297K Stars,56K Forks,1000+ 贡献者 |

2.4 为什么是它?

精准切中市场痛点:

在 OpenClaw 之前,AI 产品几乎都是封闭、云端的。用户既担心隐私,又嫌能力不够——大多数 AI 助手只能 "聊天" 而无法"执行"。

OpenClaw 的"开源 + 自托管 + 实干型"三合一,精准回应了市场最核心的诉求。

Agent 概念的临门一脚:

经过几年市场教育,人们对 AI Agent 已不再陌生。

OpenClaw 提供了第一个具体、可触摸、可部署的实现范本,把抽象概念拉进了现实。

社区驱动的病毒式传播:

从 Discord 到 Reddit,从 Hacker News 到 B 站,OpenClaw 的龙虾吉祥物 Molty、"The claw is the law" 口号和各种离谱的 Agent 翻车事件,形成了极具传播力的梗文化。

三、需要理解的前置概念

在开始动手操作之前,了解清楚这些概念更有利于更顺利的玩转 OpenClaw

OpenClaw 采用 "微核 + 插件 + 统一网关" 的架构模式,可以类比为一个"AI 操作系统"。

3.1 架构总览

WhatsApp / Telegram / Slack / Discord / 飞书 / ... / WebChat │ ▼ ┌──────────────────────┐ │ Gateway │ │ (控制平面/中枢) │ │ ws://127.0.0.1:18789│ └──────────┬───────────┘ │ ┌───────────┼───────────┐ │ │ │ Pi Agent CLI 工具 WebChat UI (RPC) (openclaw...) macOS App iOS/Android3.2 核心概念

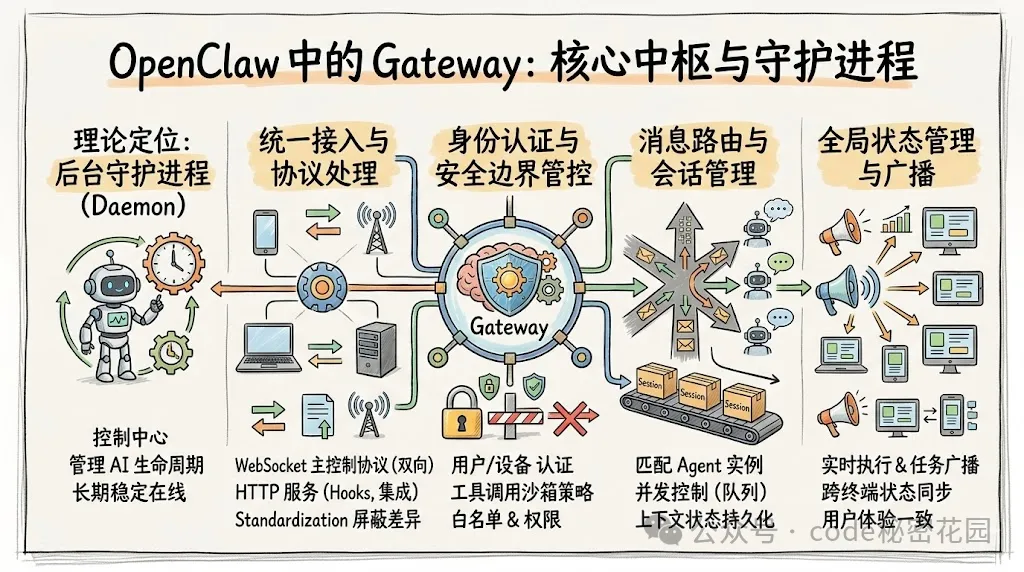

Gateway(网关)

Gateway 是整个系统的心脏。

它负责管理所有连接、会话、配置、定时任务和 Webhook,但它自己不做 "思考" —— 思考交给 Agent。

把它理解为一个 "电话总机":所有渠道的消息进来,它负责转接给合适的 Agent 处理。

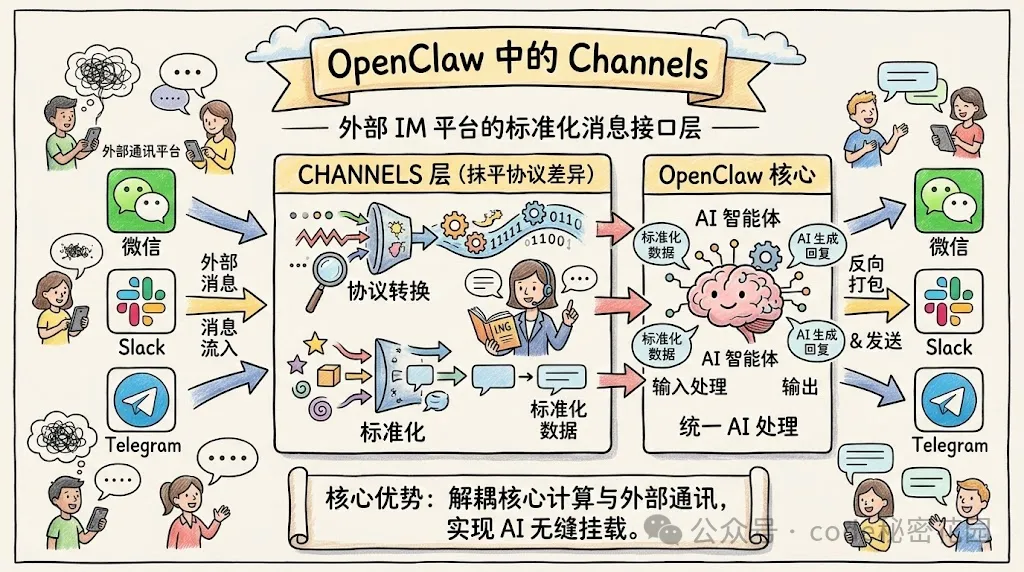

Channels(消息渠道适配器)

每个聊天平台都有一个独立的适配器,通过消息总线与 Agent 解耦。

你可以同时连接 WhatsApp、Telegram 和 Slack,在任何一个平台上跟你的 AI 助手对话,体验完全一致。

Hooks(扩展机制)

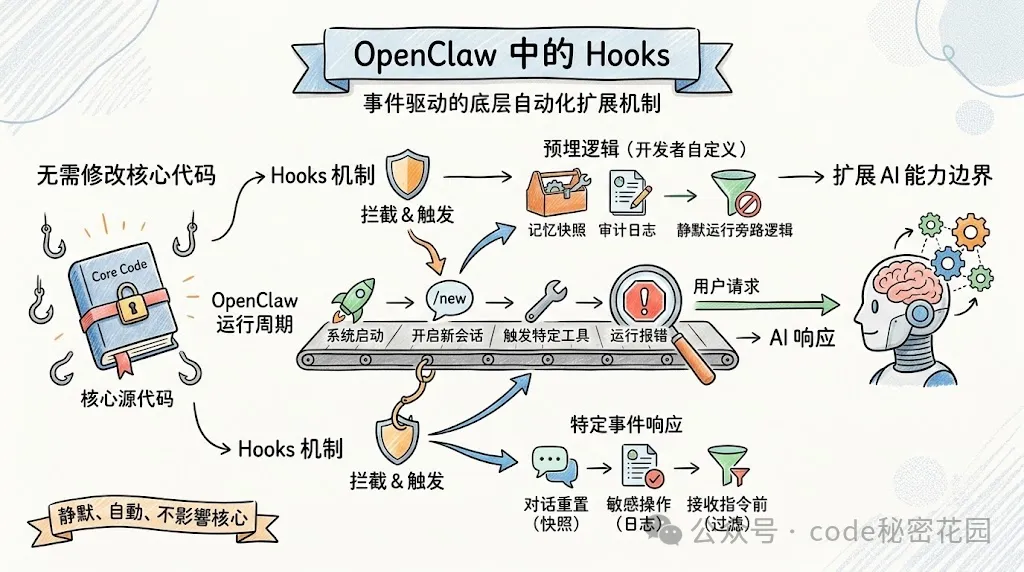

在 OpenClaw 的运行周期内,系统会不断产生各种生命周期事件(例如:系统启动、开启新会话 /new、触发特定工具、或是运行报错)。

Hooks 允许开发者预先埋入特定的逻辑,当这些系统事件发生时,自动“拦截”并触发执行。

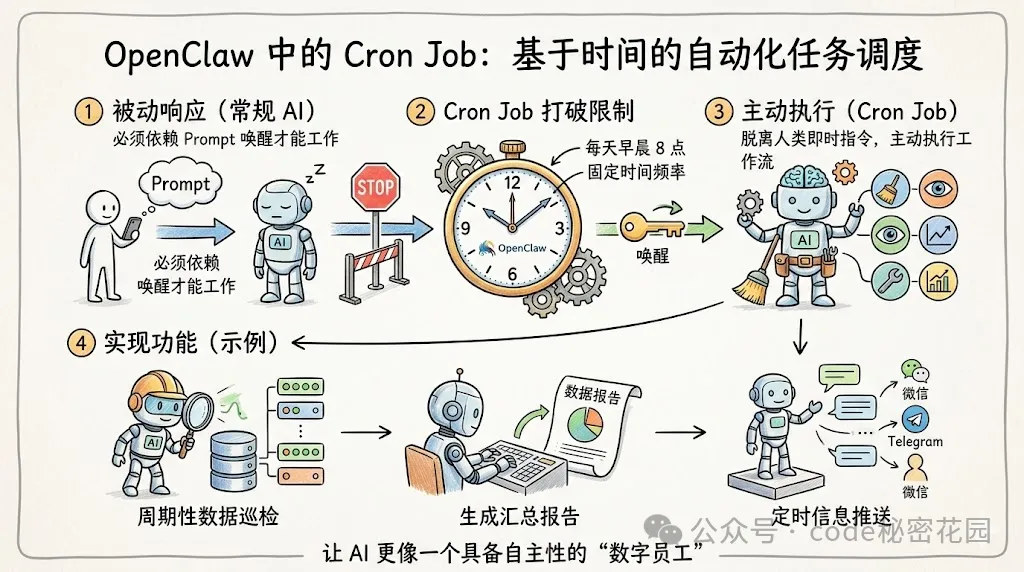

CornJob(定时任务)

常规的 AI 助手通常是“被动响应式”的,必须依赖用户的 Prompt 唤醒才能工作。

通过配置时间调度规则,系统可以在特定的时间节点(如每天早晨 8 点)或按照固定的时间频率,在后台自动唤醒智能体去执行既定的工作流。

这意味着 OpenClaw 可以脱离人类的即时指令,独立完成周期性的数据巡检、生成汇总报告或定时信息推送,使其行为模式更接近一个具备一定自主性的“数字员工”。

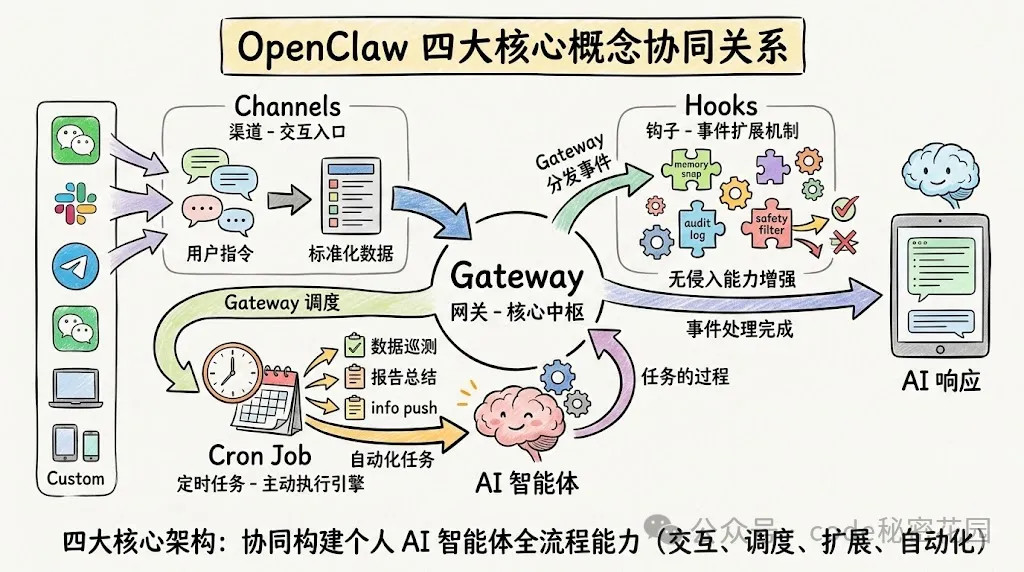

四大核心概念的协同关系

Gateway 是整个系统的核心中枢,是所有组件的接入与调度中心;

Channels 是系统与用户的交互入口,为 Gateway 提供标准化的用户指令;

Hooks 是系统的事件扩展机制,基于 Gateway 分发的事件实现无侵入式的能力增强;

CronJob 是系统的主动执行引擎,通过 Gateway 调度 AI 智能体实现自动化任务。

四个模块相互协同,共同构成了 OpenClaw 高可扩展、高可控、高灵活的核心架构,支撑了个人 AI 智能体从交互、调度、扩展到自动化的全流程能力。

3.3 记忆系统:OpenClaw 的灵魂

这是 OpenClaw 最具突破性的设计。它采用分层记忆架构:

SOUL.md | ||

USER.md | ||

AGENTS.md | ||

MEMORY.md | ||

memory/projects.md | ||

memory/infra.md | ||

memory/lessons.md | ||

memory/YYYY-MM-DD.md |

社区用户的原话说得好:

"一个月后,你的龙虾就会摸清你的工作作息、沟通偏好、正在推进的项目、讨厌的细节、常用工具,还懂你十几项不同任务里 “按老样子来” 到底是什么意思。"

这种持续使用的 复利效应 是任何无状态 AI 工具无法复制的。

四、把 OpenClaw 跑起来

这个章节中,你将了解搭建 OpenClaw 的环境要求,具体的安装流程,以及初始化向导中的一些推荐配置。

4.1 环境要求

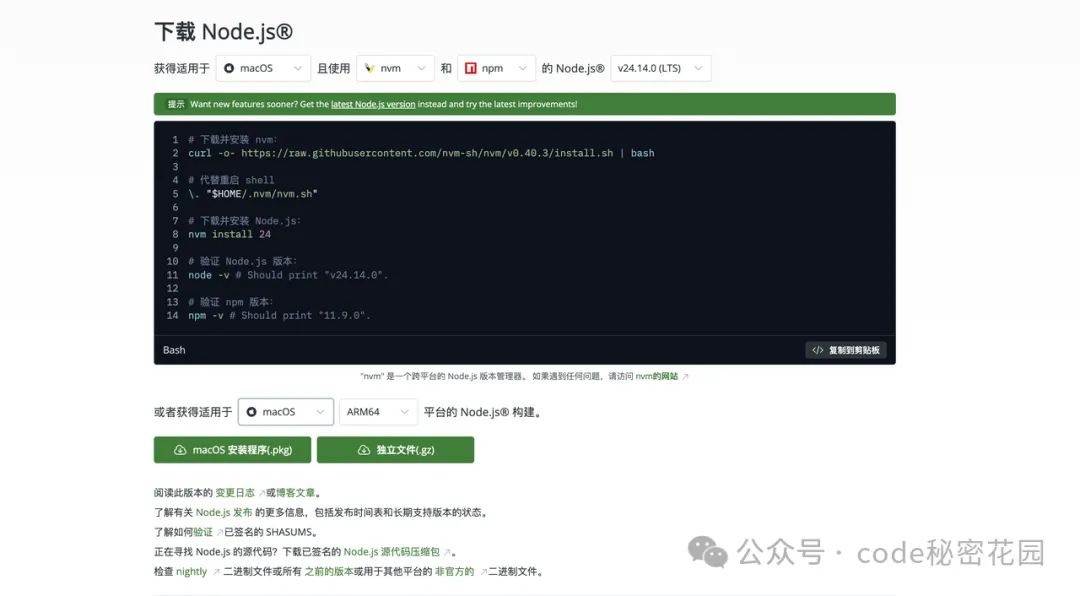

安装 OpenClaw 需要 Node.js 22 以上的版本。

Node.js 安装方式1:图形界面安装:

打开官网:https://nodejs.org/,直接下载「LTS版」的.pkg安装包; 双击下载的.pkg文件,依次点击「继续」→「同意」→「安装」,输入电脑密码验证权限; 等待安装进度条走完,点击「关闭」即可。

Node.js 安装方式2:Homebrew 安装

打开终端,输入一行命令:

brew install node安装完成后,在命令行执行命令:node --v ,若看到版本号 >= v22:可以继续后续的安装操作

4.2 安装命令

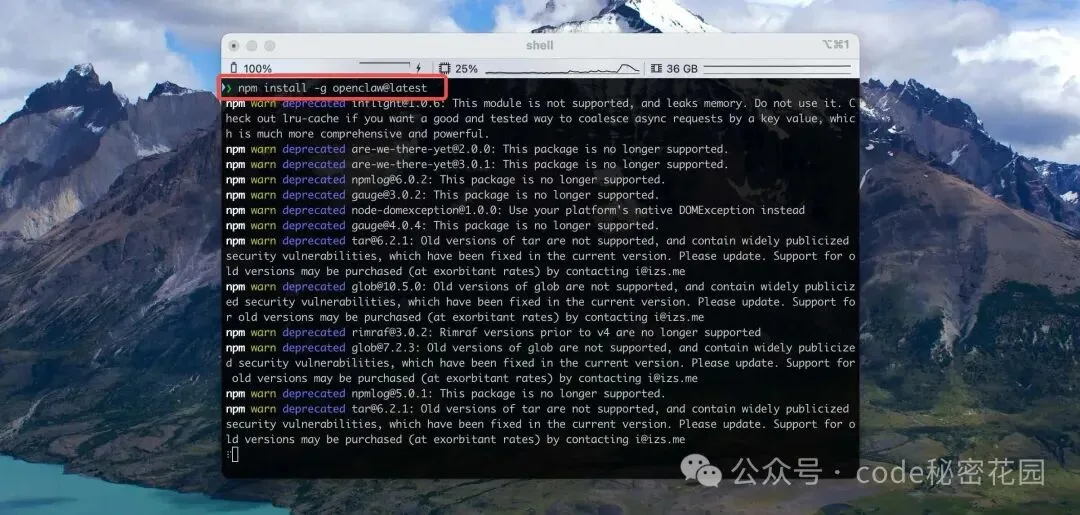

现在你的电脑上已经拥有了 Node.js 环境,我们推荐使用 npm 来安装 openclaw,就下面一行代码:

npm install -g openclaw@latest然后静静等待几分钟即可,中间输出的 warning 可以直接忽略:

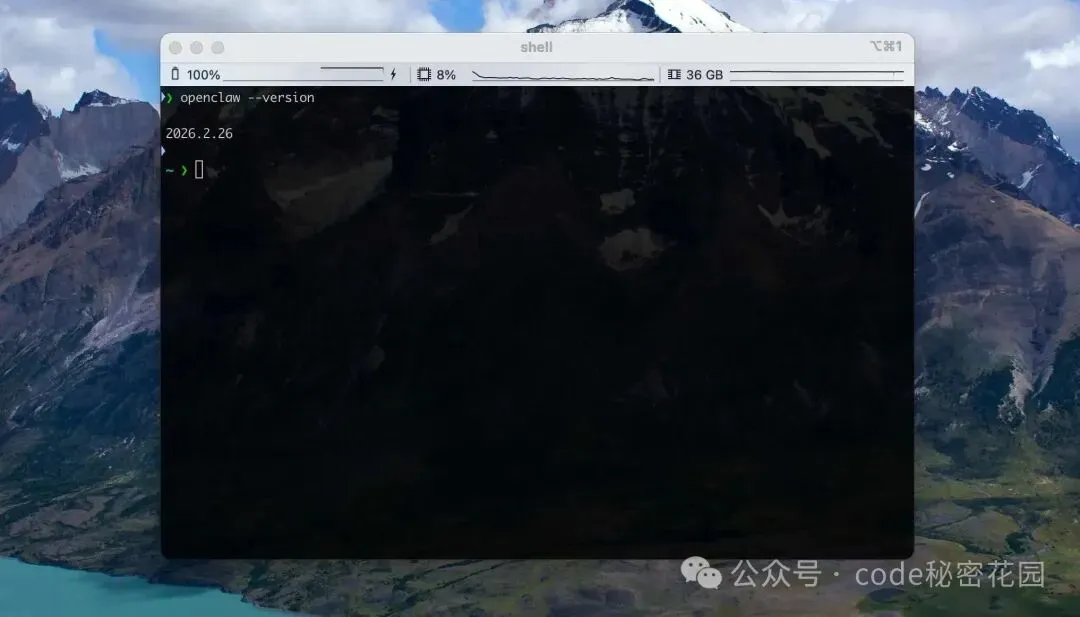

安装成功后,我们执行 openclaw --version ,如果看到类似的版本号,说明安装成功:

4.3 配置向导

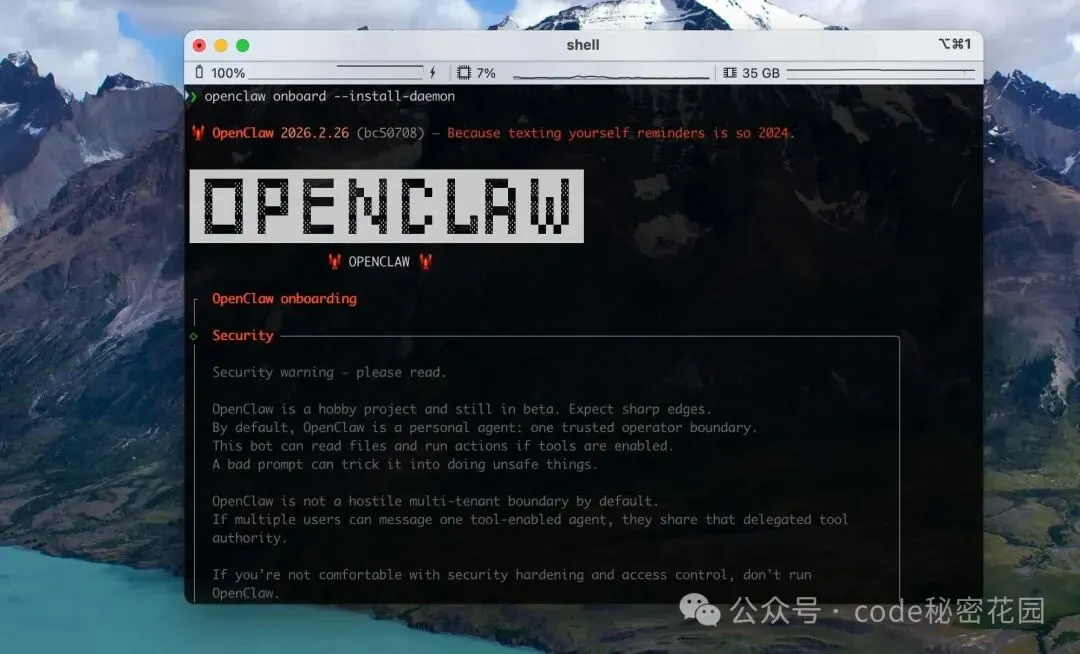

接下来,我们运行 openclaw 提供的初始化向导来完成一些必要的配置,执行下面的命令:

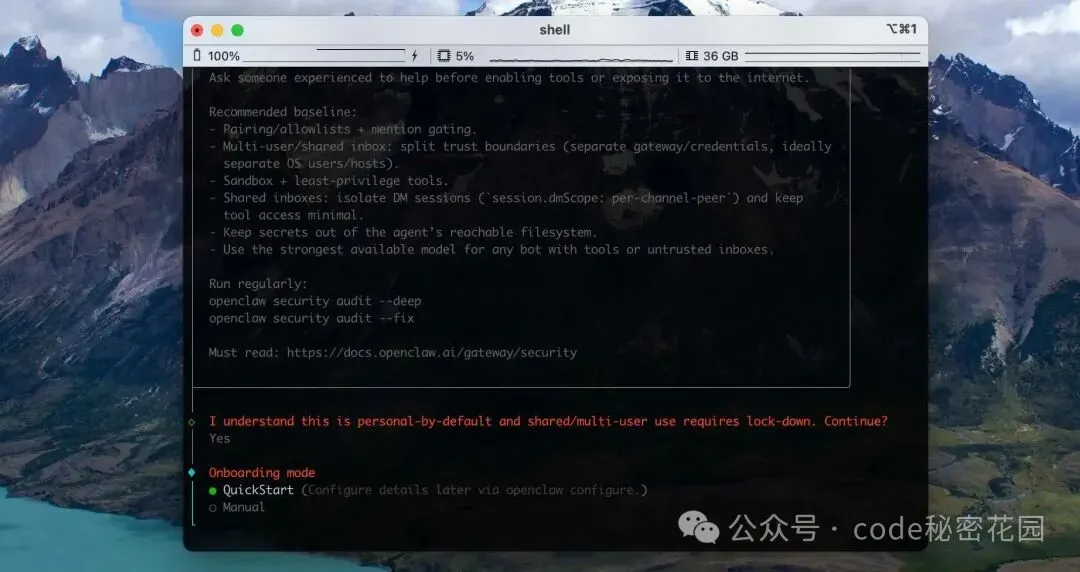

openclaw onboard --install-daemon首先,你会看到 openclaw 给出的安全提示:

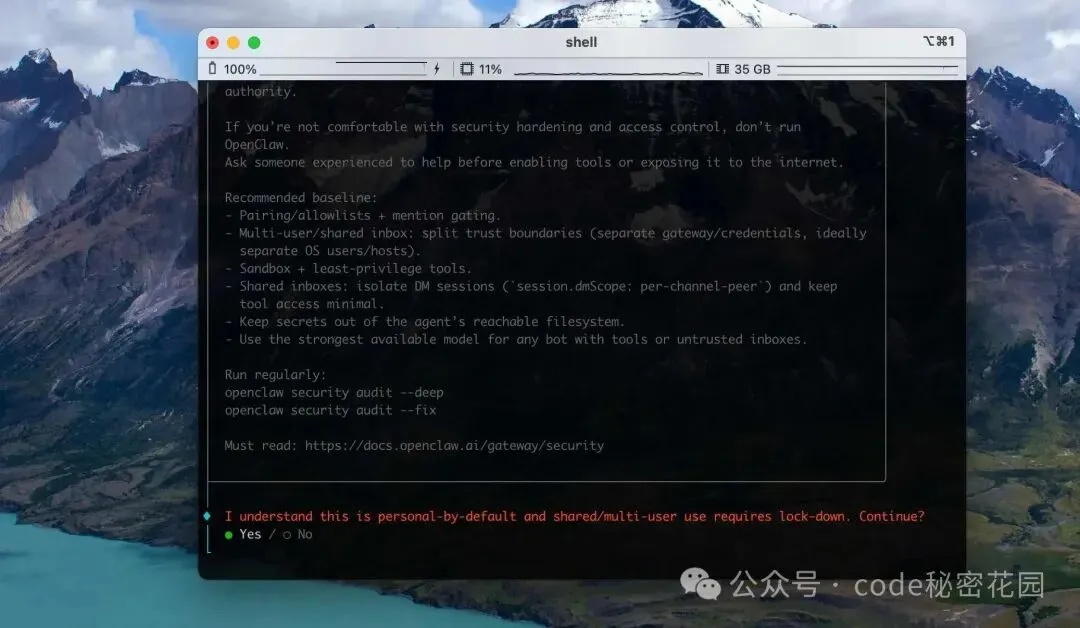

如果你认为当前环境足够安全(可以接受被攻击可破坏),选择 Yes

接下来会提示你选择配置模式,新手推荐选择 QuickStart,先快速跑起来,后续所有的配置都可以再进行更改。

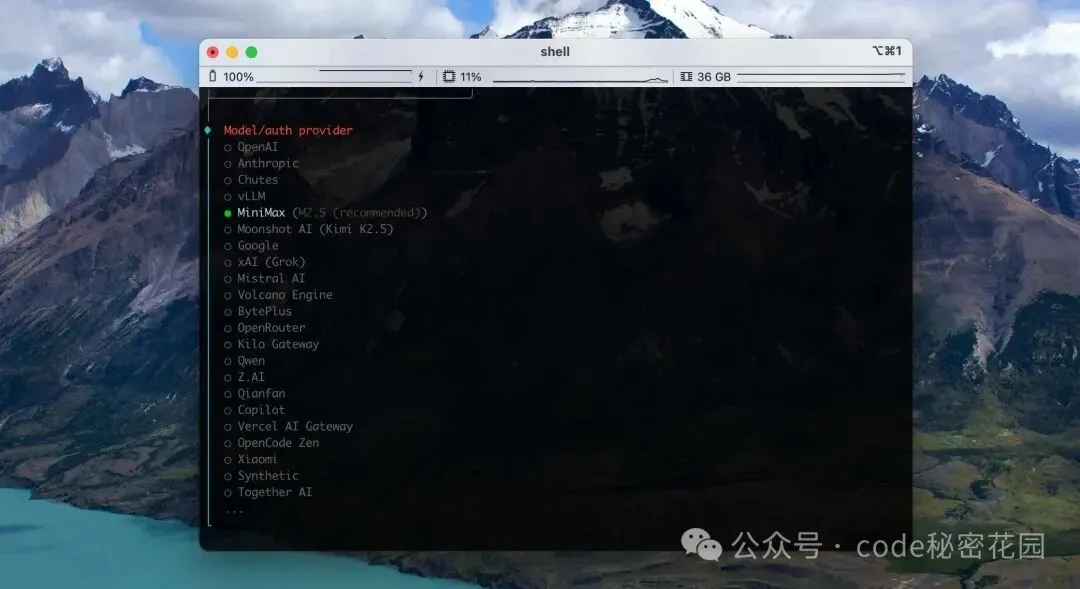

接下会提示你选择一个模型厂商,如果你不差钱,直接使用 Anthropic/OpenAI 的旗舰模型,效果是最好的。

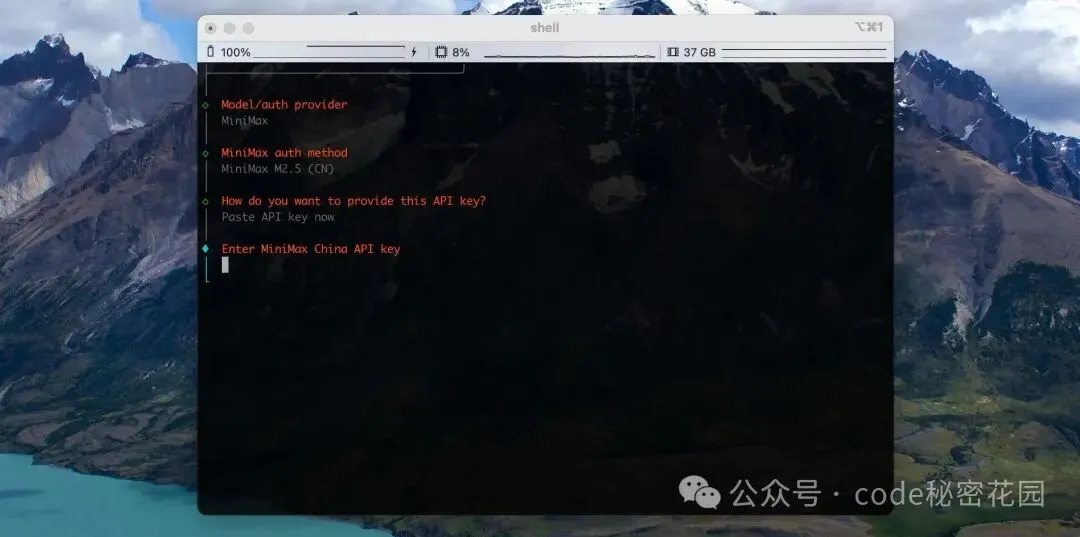

如果考虑性价比,可以选择国产的 GLM、MiniMax,Qwen 等,例如这里我们先尝试选择 MiniMax,接下来它会提示你配置 API Key:

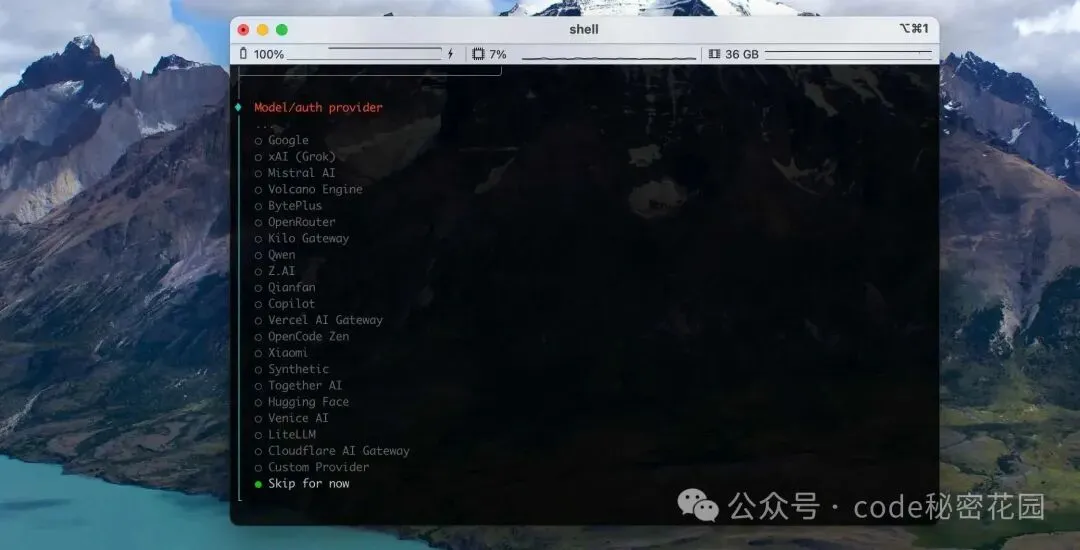

如果你要使用的模型厂商没有在推荐的列表中,或者你需要配置自定义的本地模型服务,可以先选择 Skip for now,后续我们在 Gateway 中进行配置。

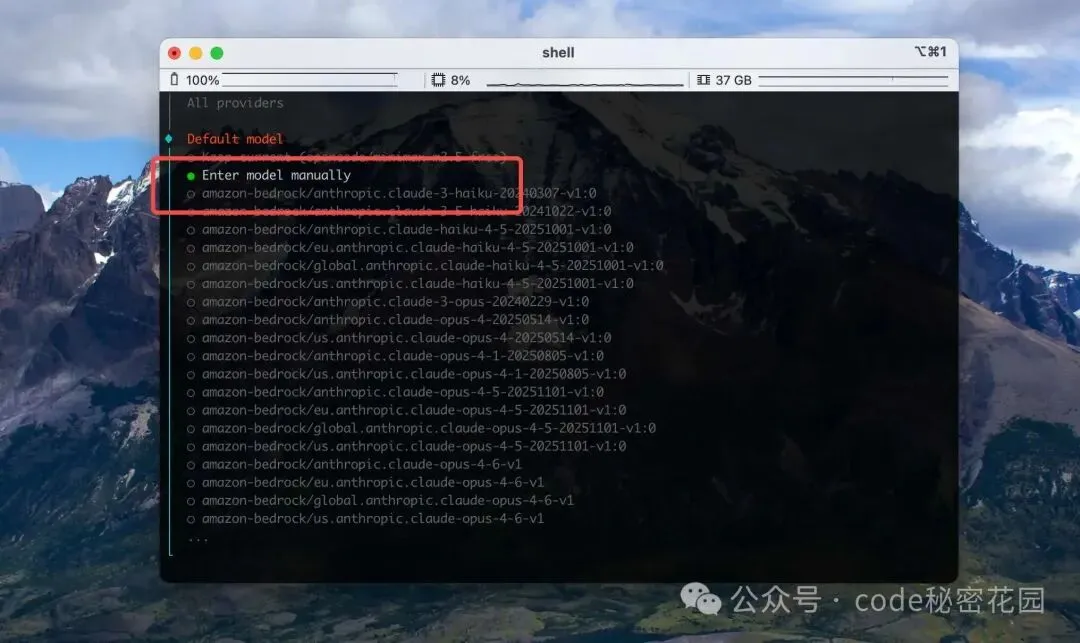

接下来是选择模型,根据你上一步选择的模型提供商选择合适的模型即可,如果你希望后续再自定义模型,这一步就选择 Enter model manually。

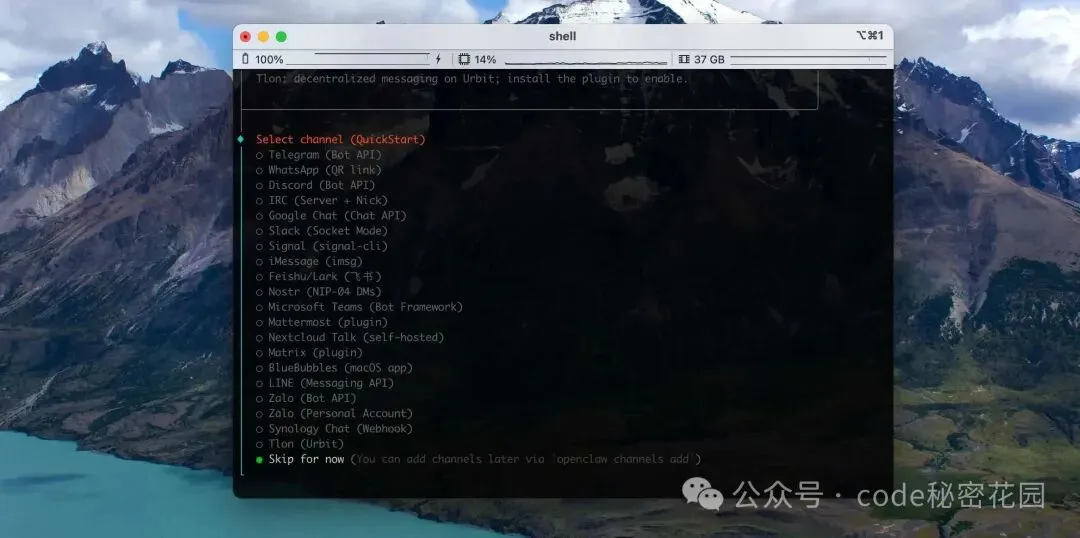

下一步就是提示你配置 Channel,这里我们还是先 Skip,我们尽量先保证基础的流程能够跑通再接入三方平台,这样排查问题比较方便。

接下来会提示你安装 Skills,为了先跑通流程,我们仍选择 Skip for now,后续在网页中进行单独配置。

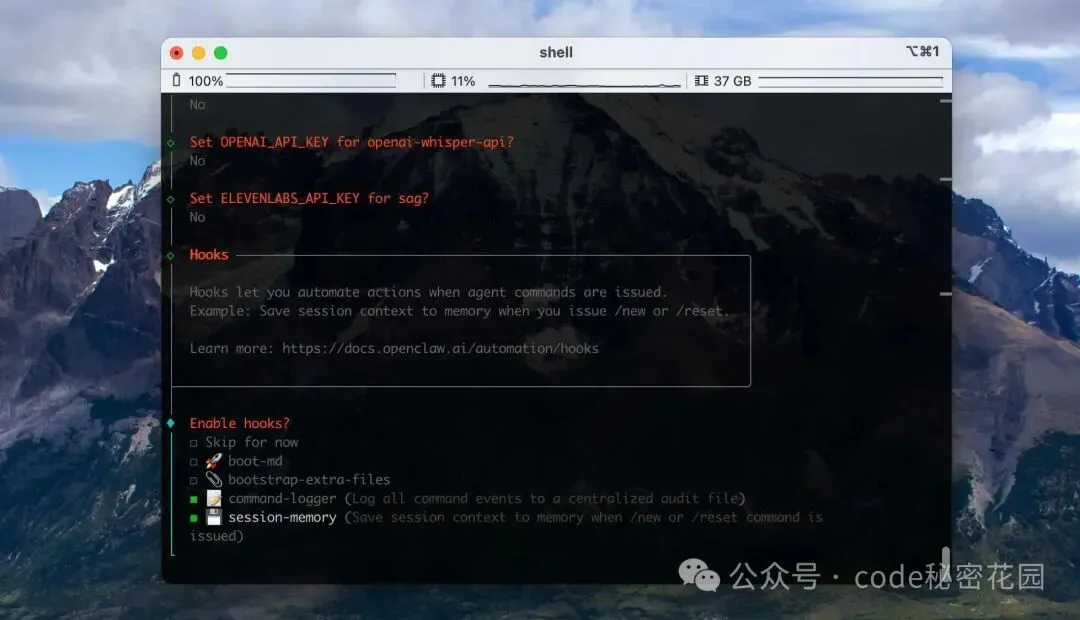

接下来会提示你配置 Hooks,这里有两个 Hooks 建议直接开启(空格选中)然后 Enter 即可:

command-logger:将系统中所有命令相关的事件统一记录到一个集中的审计文件中,排查问题非常有用。 session-memory:在用户执行 /new 或 /reset 命令时,将当前的会话上下文数据保存到内存中,避免会话状态丢失。

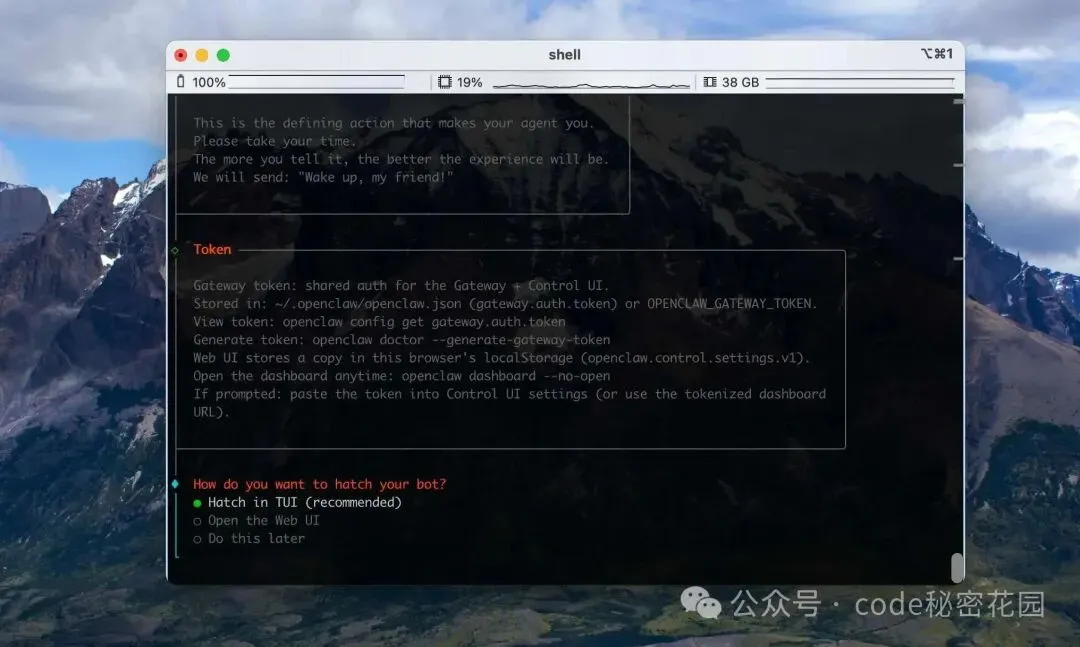

Hook 配置完成后,会自动进行网关的配置,然后选择我们选择 TUI 默认选项结束安装。

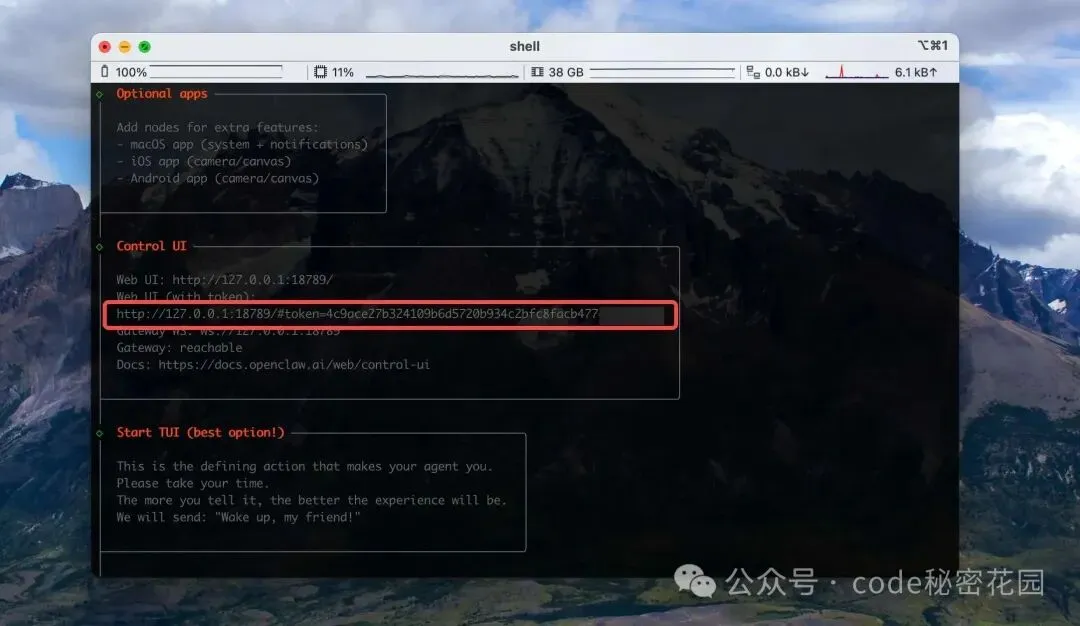

我们向前翻一下终端,可以看到带有 Token 的 WebUI 的地址:

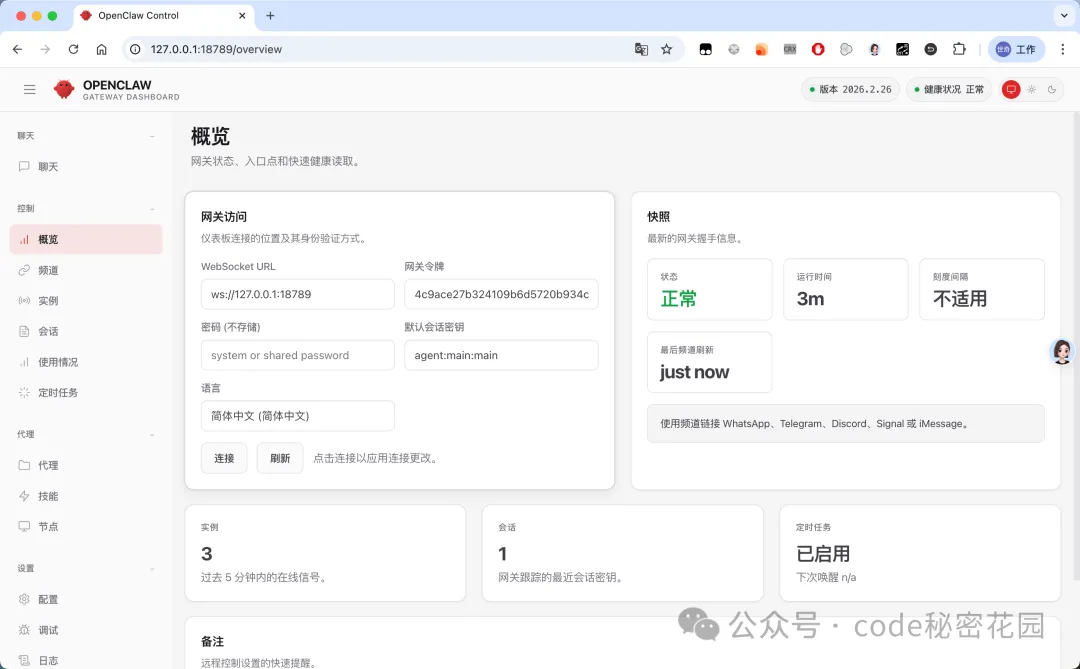

我们在浏览器中访问这个地址,如果正常出现 OpenClaw 控制台界面则代表安装过程已经成功:

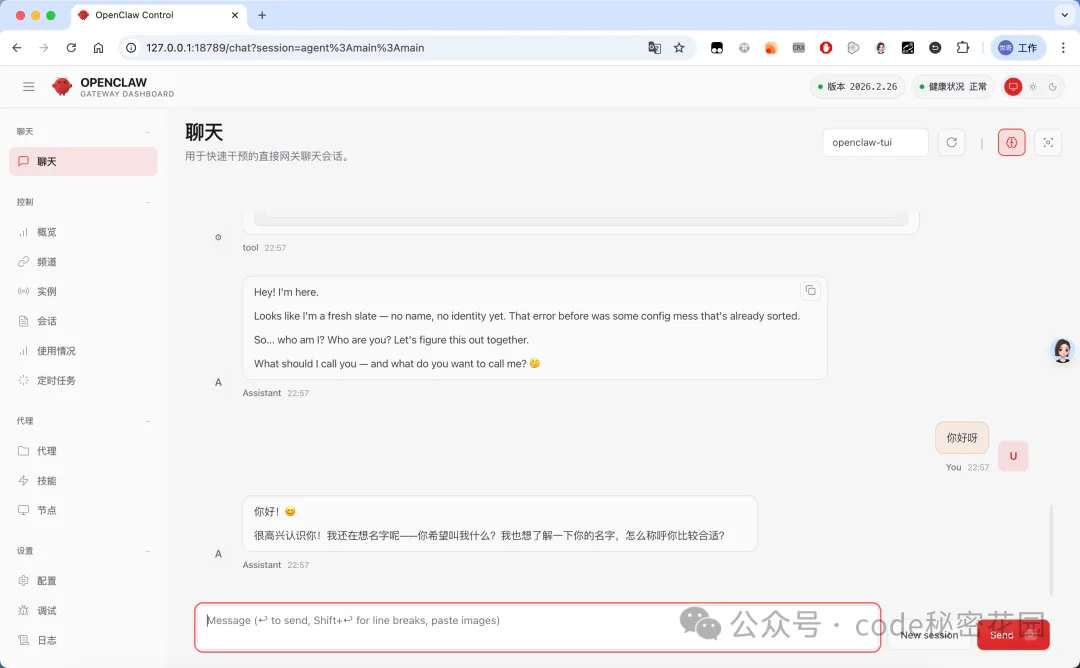

如果你刚刚在向导过程中已经配置过模型 API Key,现在就可以尝试和它进行对话了:

五、将任意大模型接入 OpenClaw

在这个章节中,你将学习到如何为 OpenClaw 配置自定义的大模型 API。

如果你在配置向导中跳过了模型相关配置,或者想追加更多自定义的模型,我们可以到控制面的配置模块。

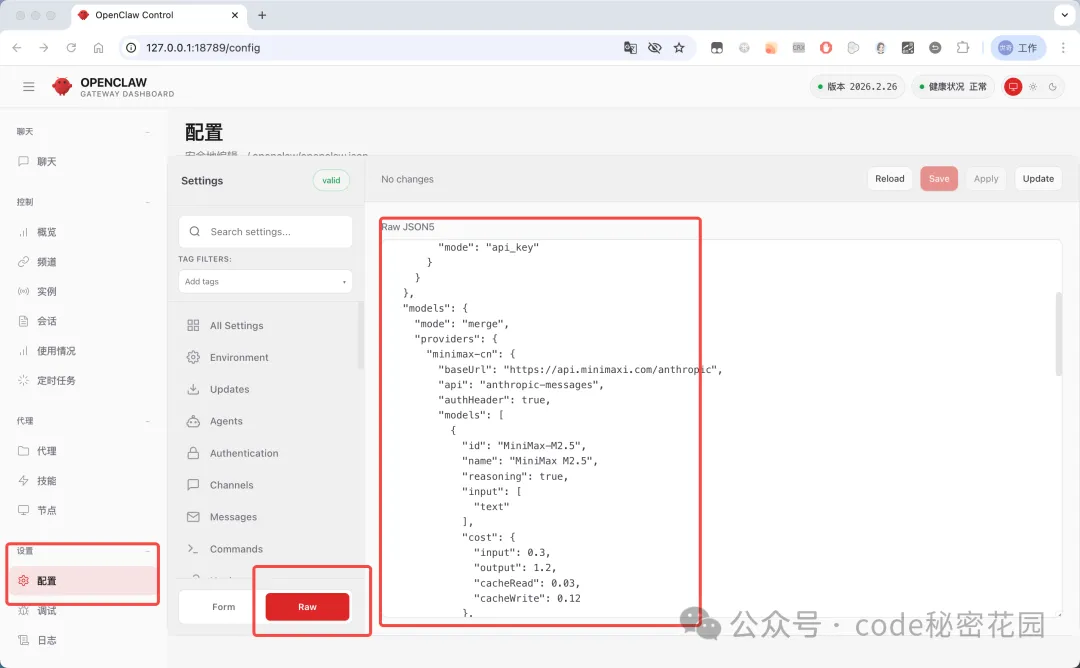

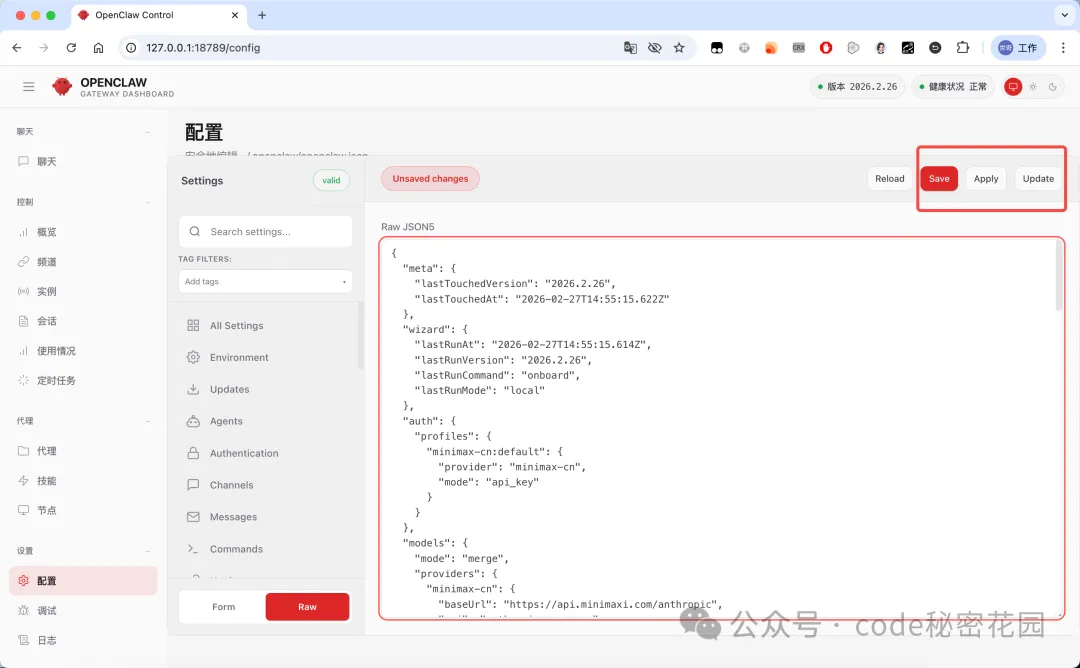

默认的表单形式目前体验不是很好,推荐大家直接选择 Raw 模式下进行配置:

这份 JSON 实际上就是 openclaw 的核心配置文件,它存放在

~/.openclaw/openclaw.json。

5.1 模型配置解读

openclaw 本身内置的配置模块并不具备对 JSON 文件进行格式化和高亮的能力,配置体验很差,建议直接在一些编辑器(如 VsCode )中打开这个文件进行配置:

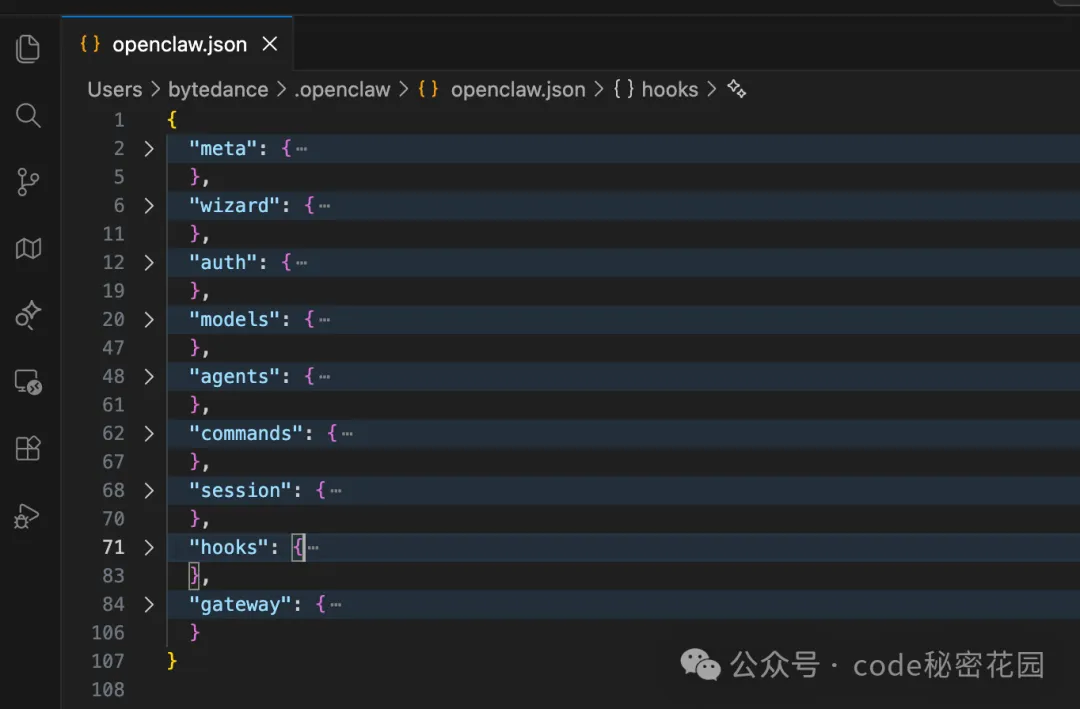

默认的配置很多,我们把一级 Key 收缩一下,整体上就是这几个分类:

meta:元数据模块,记录配置文件的基础信息 wizard:向导配置模块,记录交互式配置向导的运行记录 auth:认证配置模块,管理模型提供商的认证信息 models:模型提供商与模型元信息模块 agents:智能体默认行为配置模块 commands:命令执行配置模块,控制 OpenClaw 的命令运行规则 session:会话管理配置模块,定义会话的作用域等规则 hooks:钩子配置模块,管理内置的事件钩子 / 插件 gateway:网关配置模块,控制 OpenClaw 的网络服务(端口、认证、访问控制等)

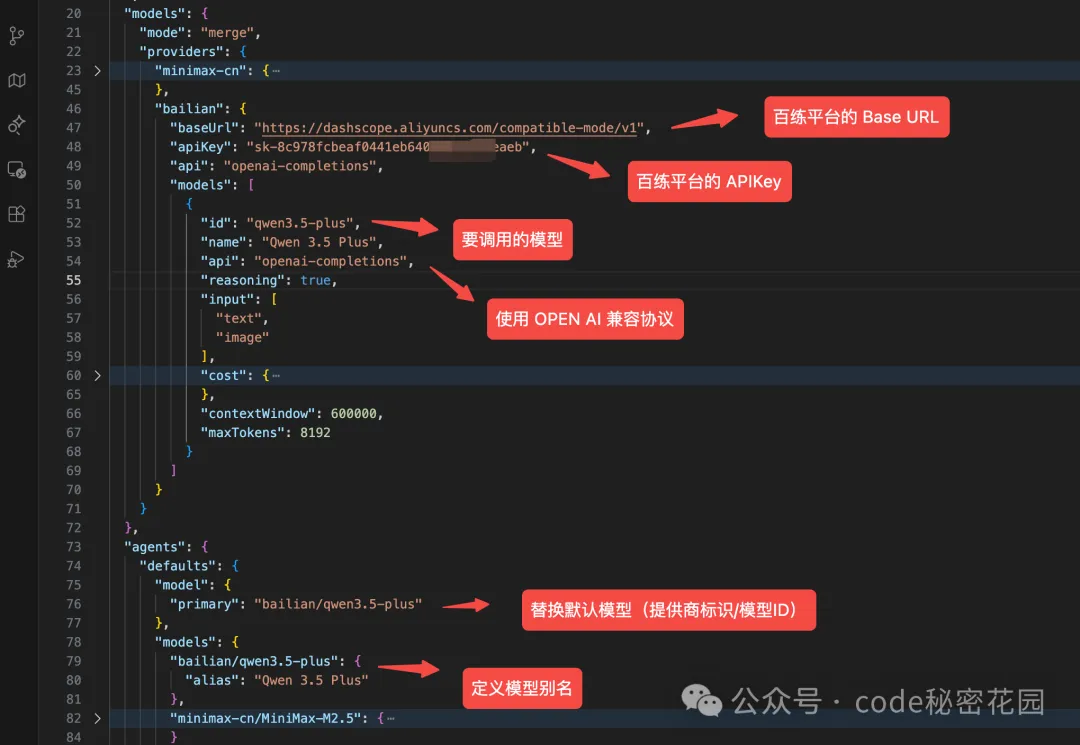

这里模型的配置我们需要用到 models 和 agents 两份配置,我们将它展开,因为之前我们在向导中已经配置了 MiniMax 的模型,这里已经有一份默认的配置了:

{"models": {"mode": "merge","providers": { "minimax-cn": { "baseUrl": "https://api.minimaxi.com/anthropic", "api": "anthropic-messages","models": [ {"id": "MiniMax-M2.5","name": "MiniMax M2.5","reasoning": true,"input": ["text" ],"cost": {"input": 0.3,"output": 1.2,"cacheRead": 0.03,"cacheWrite": 0.12 },"contextWindow": 200000,"maxTokens": 8192 } ] } } },"agents": {"defaults": {"model": {"primary": "minimax-cn/MiniMax-M2.5" },"models": {"minimax-cn/MiniMax-M2.5": {"alias": "Minimax" } } } }顶级字段 models:模型提供商与模型元信息

这部分是 OpenClaw 识别「自定义模型提供商」的核心配置,告诉系统「去哪里调用模型」「模型的参数/计费规则是什么」。

顶级字段 agents:智能体默认行为配置

这部分定义 OpenClaw 智能体的默认使用规则,比如「默认用哪个模型」「哪些模型可以用(白名单)」「模型的快捷别名」。

5.2 自定义模型配置

按照这个格式,我们可以继续添加更多的模型配置,比如我们再添加一个阿里云百练的模型:

在 providers 添加一个新的 key(bailian,可以随便自定义),然后配置模型的 baseUrl、apiKey、模型 Id,支持输入文字和图片、开启推理,更改上下文窗口和最大输出 Token。

最后在 agents 的 defaults 下配置一下刚添加的模型,并且将默认模型(model.primary)切换为此模型。

然后我们将这份配置复制到控制面板中的 配置 - Raw JSONS 中,点击 Save 和 Update,然后它会更新配置和重启服务(需要等待一段时间)。

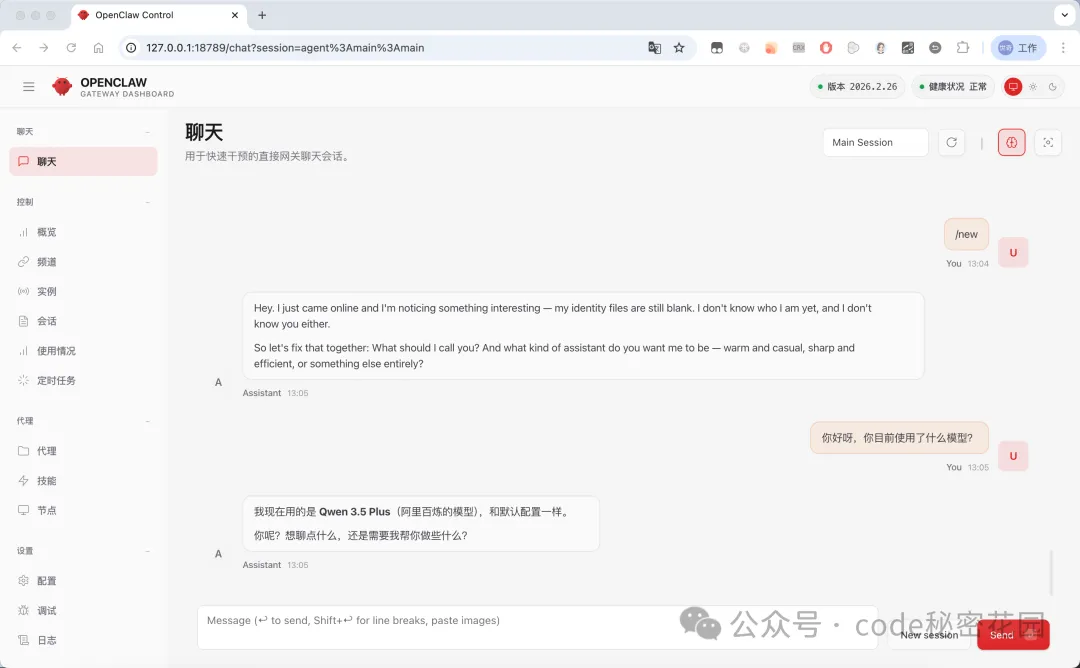

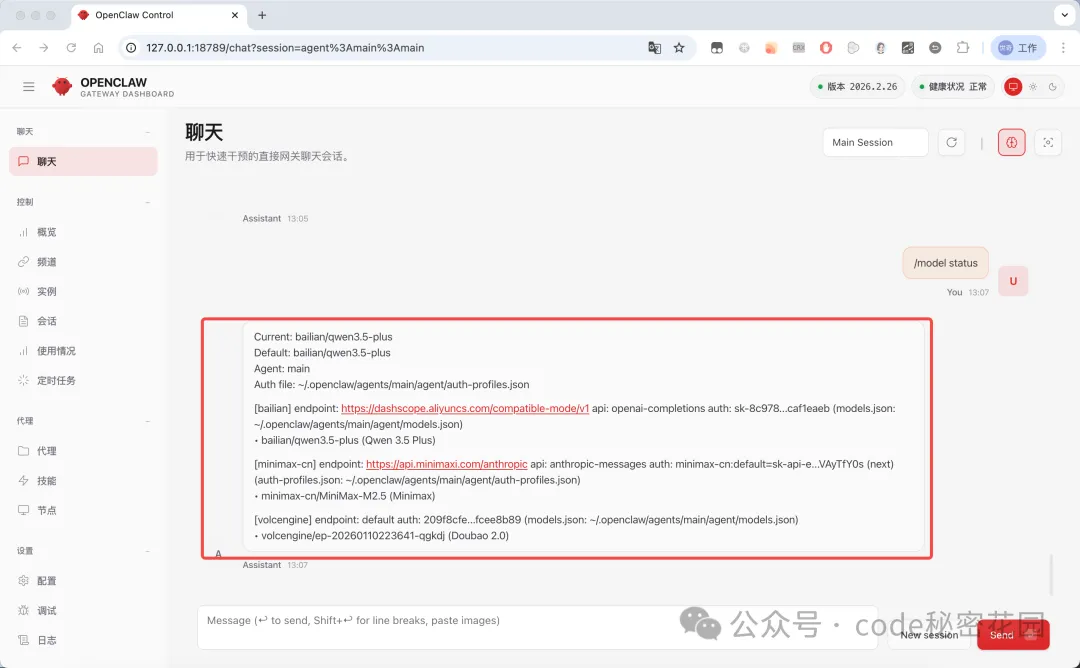

接下来我们到聊天中测试一下:

在聊天框输入 /model status 指令可以查看当前已经配置好的所有模型

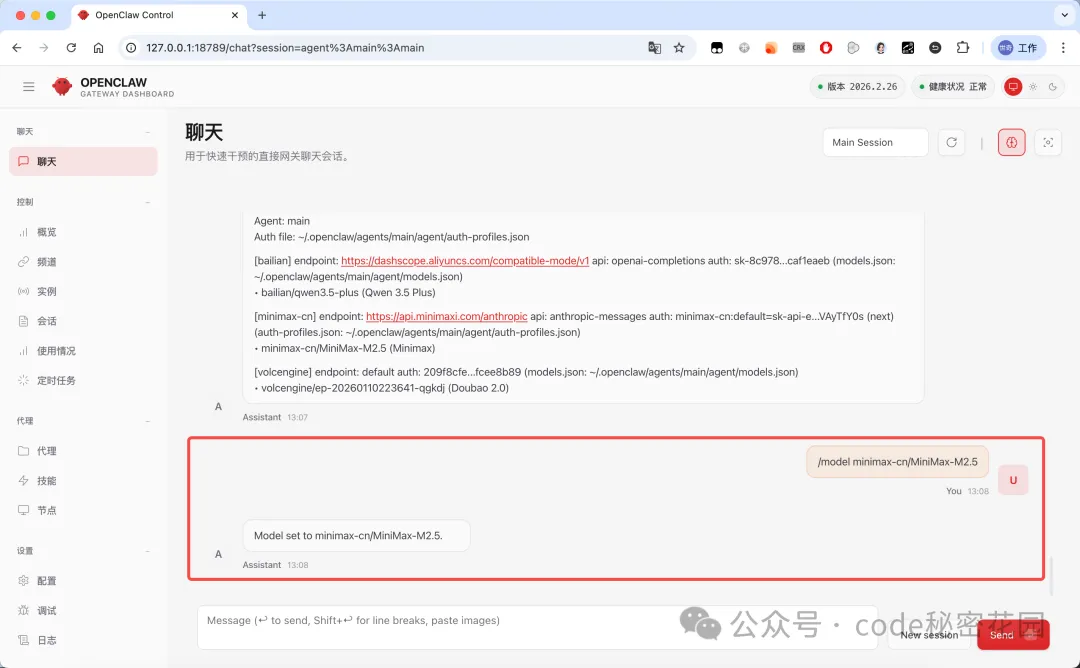

如果你配置过多个模型,可以使用 /model 模型标识 快捷切换模型:

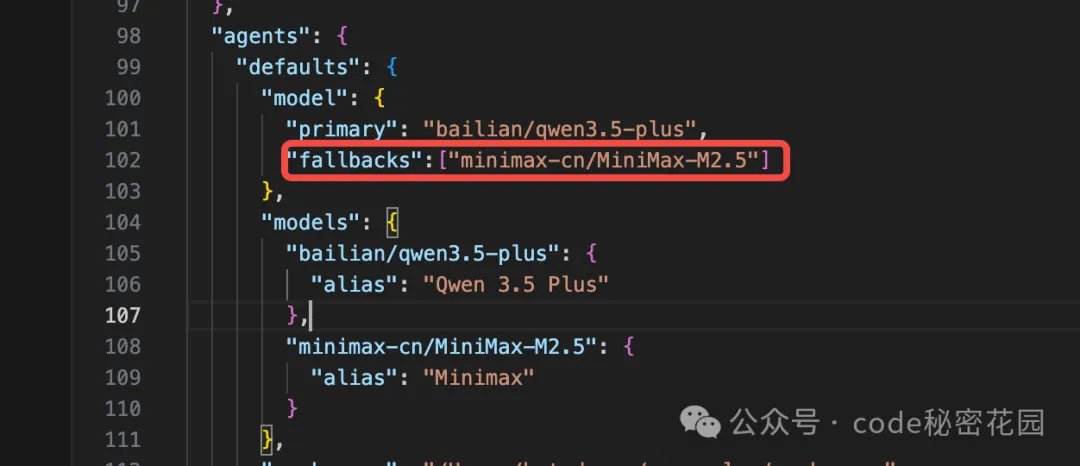

5.3 模型回退机制

openclaw 运行起来是非常烧 Token 的,如果你的模型 TPM 比较低,很容易超限导致任务失败。并且如果只配置单一的模型提供商也可能会因为提供商故障或者余额不足导致失败等情况。

opencraw 为此额外提供了一个回退机制,我们可以在 defaults.model 下增加一个 fallbacks 字段,这里可以配置当主模型出现故障时可以使用的备用模型。

六、让 OpenClaw 接入飞书

在本章节中,你将学到 OpenClaw 接入飞书具体的配置方法,最终能在飞书中和 OpenClaw 进行对话。

OpenClaw 默认提供的 Channels 大部分在国内无法使用(如 WhatsApp、Telegram 等),推荐国内同学使用飞书接入。

在最新版本中,OpenClaw 已经将飞书内置到默认渠道,无需再额外安装插件。

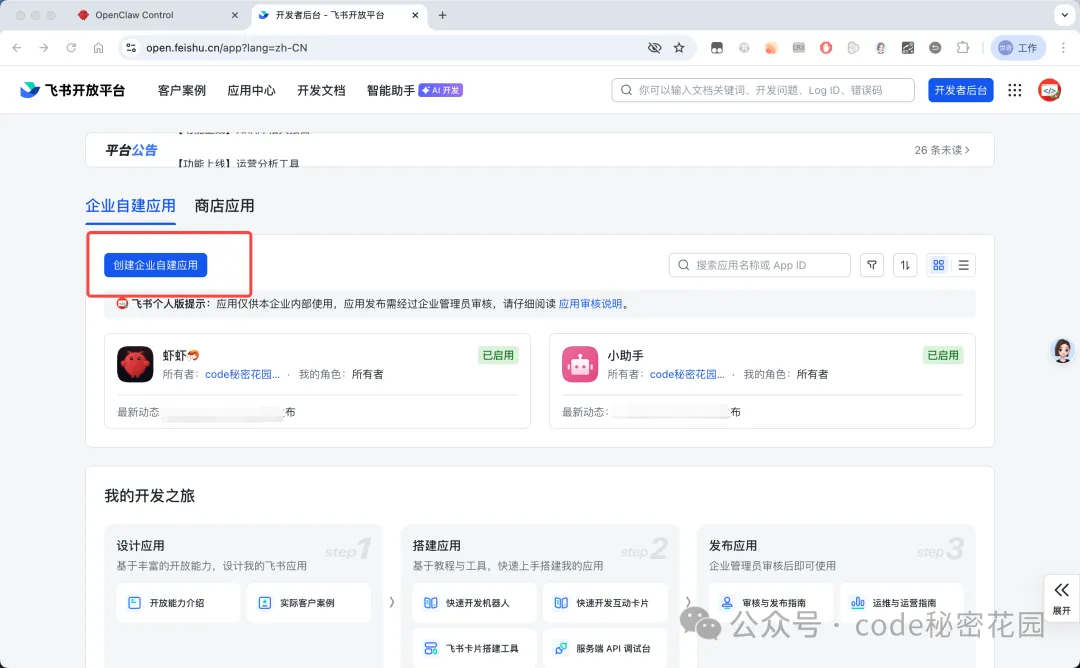

6.1 在飞书开发者平台创建应用

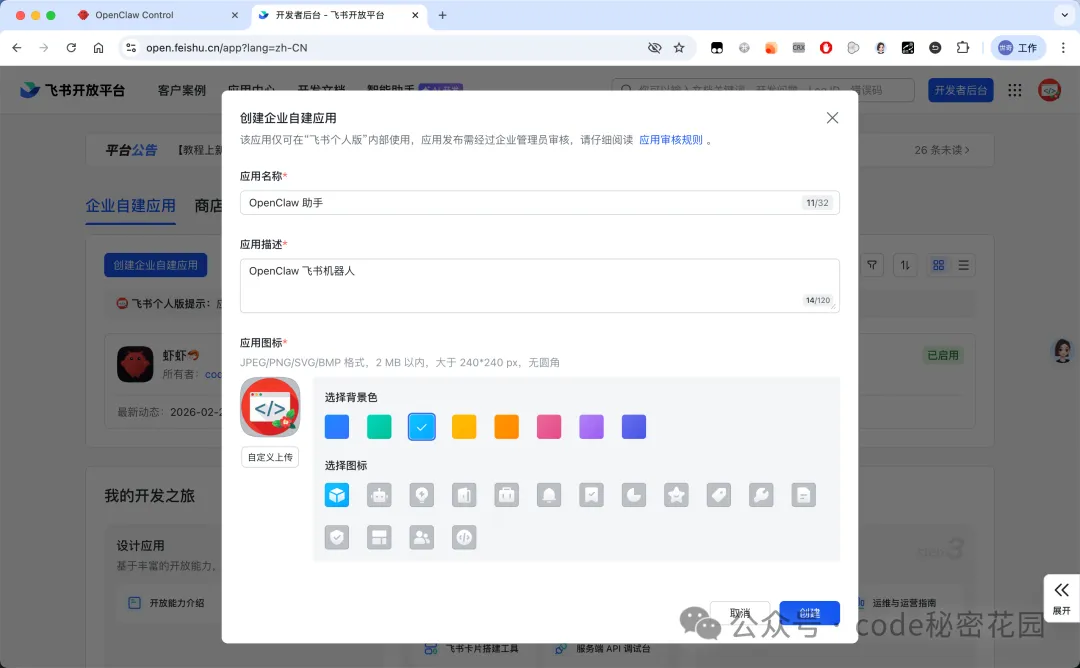

登录 [飞书开发者后台] https://open.feishu.cn/app/。 点击 “创建企业自建应用”。

填写应用名称(例如: OpenClaw 助手),上传一个专属头像,点击“创建”。

创建完成后会进入应用的开发后台,在左侧导航栏,点击 “凭证与基础信息”。 找到 App ID 和 App Secret,将这两个值复制并保存下来,稍后在 OpenClaw 中会用到。

6.2 开通机器人能力与权限

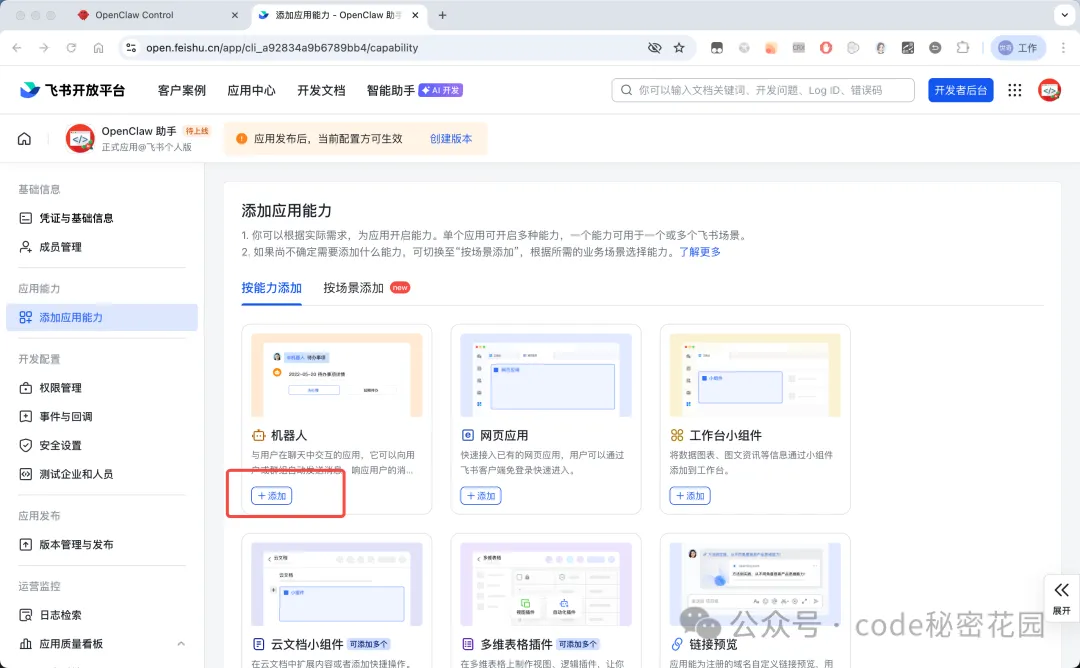

在左侧导航栏,点击 “添加应用能力”。 选择 “机器人” 卡片,点击“添加”。

在左侧导航栏,进入 “权限管理”。 你的机器人需要接收和发送消息的权限。建议开通以下核心权限:

获取单聊、群组消息(im:message:readonly 或 im:message)接收群聊消息/接收单聊消息(im.message.receive_v1)以应用的身份发消息

注:如果 OpenClaw 后续需要读取飞书文档或表格,可根据提示再追加

aily:file:read等文档权限。*

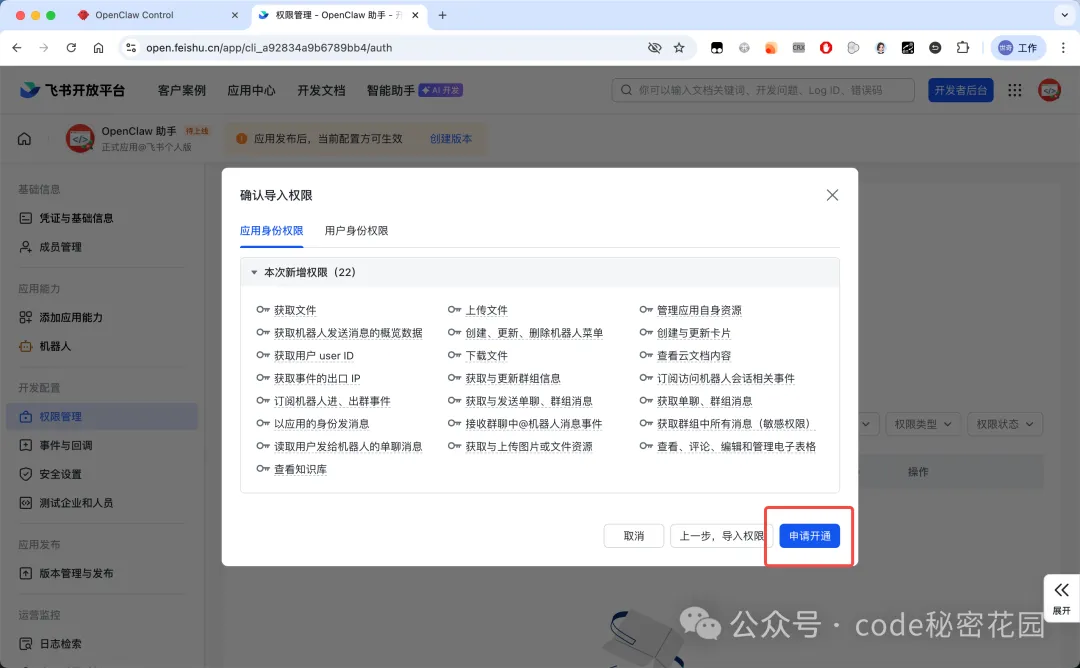

为了方便快速配置,你可以直接选择批量导入权限:

然后将下面的 JSON 复制到编辑框中:

{"scopes": {"tenant": ["aily:file:read","aily:file:write","application:application.app_message_stats.overview:readonly","application:application:self_manage","application:bot.menu:write","cardkit:card:write","contact:user.employee_id:readonly","corehr:file:download","docs:document.content:read","event:ip_list","im:chat","im:chat.access_event.bot_p2p_chat:read","im:chat.members:bot_access","im:message","im:message.group_at_msg:readonly","im:message.group_msg","im:message.p2p_msg:readonly","im:message:readonly","im:message:send_as_bot","im:resource","sheets:spreadsheet","wiki:wiki:readonly" ],"user": ["aily:file:read", "aily:file:write", "im:chat.access_event.bot_p2p_chat:read"] }}复制完成后,点击右下角的 “申请开通”。

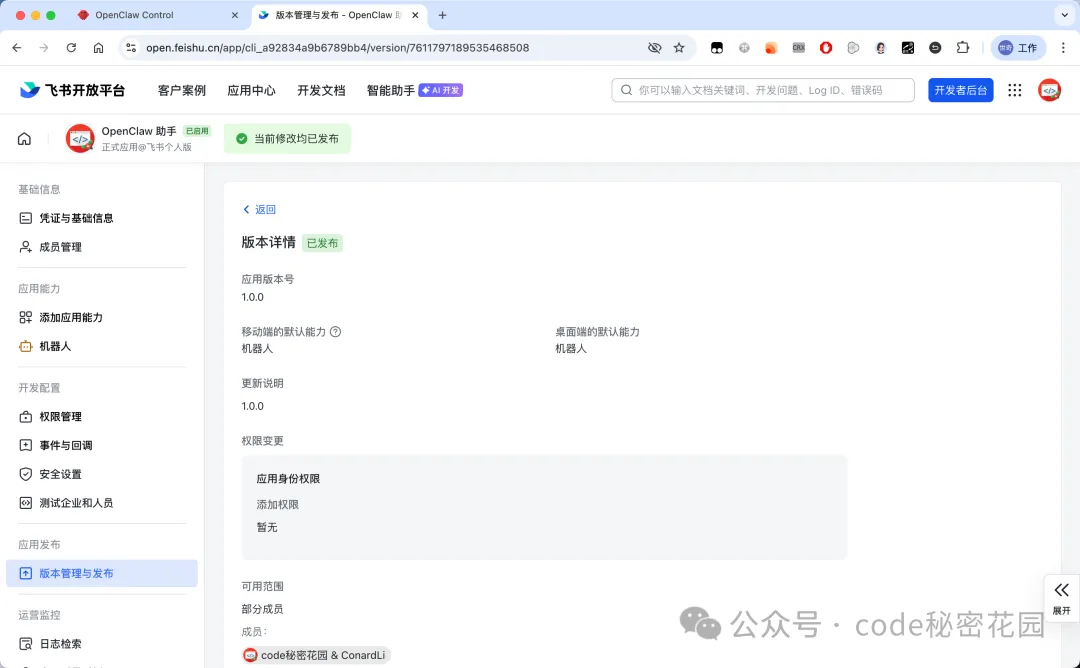

6.3 第一次发布应用

完成这些配置后,我们先发布一下应用,再进行后续的配置(这一步是必须的,如果先进行事件订阅的配置会是无法配置成功的)。

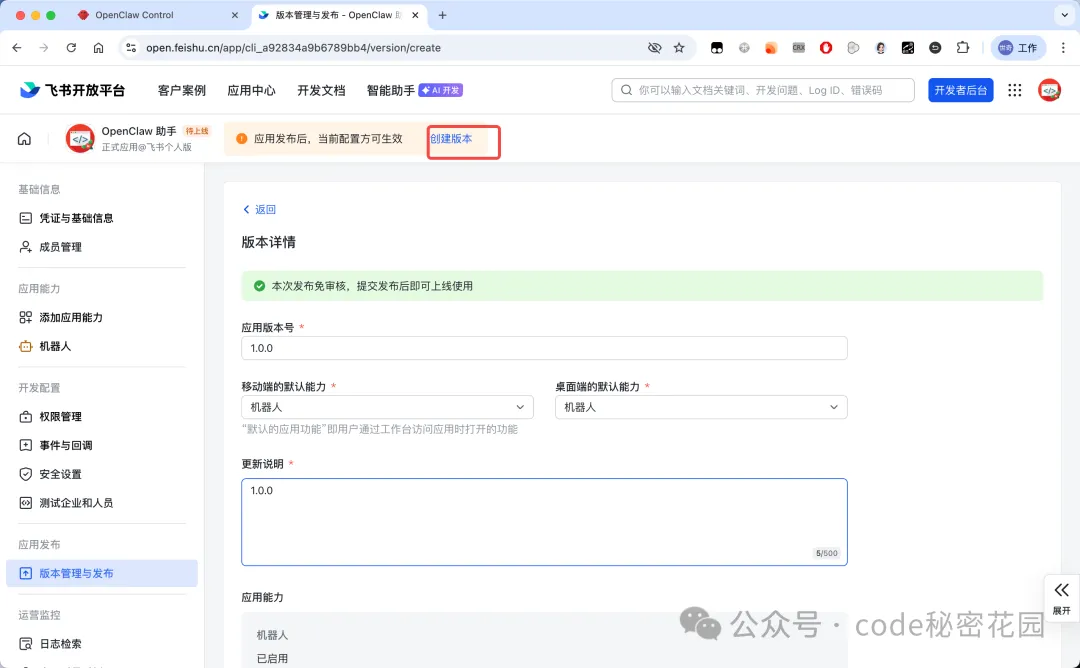

点击上方的创建版本,然后填写版本号、更新说明等信息:

创建完成后,直接点击确认发布,看到状态变为已发布即可:

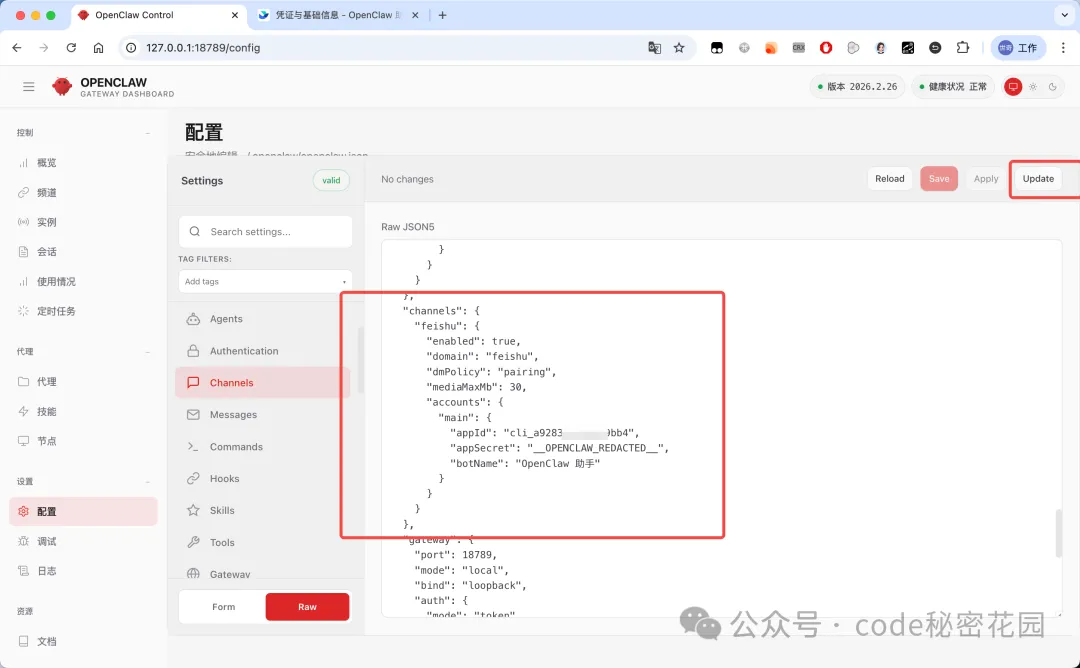

6.4 在 OpenClaw 中配置飞书通道

现在,我们要把飞书的凭据告诉 OpenClaw,我们还是直接到配置模块的 Raw 模式直接修改配置,直接复制下面的配置添加进去,然后将 appId、appSecret、botName 进行相应的替换:

{"channels": {"feishu": {"enabled": true,"domain": "feishu","dmPolicy": "pairing","mediaMaxMb": 30,"accounts": {"main": {"appId": "替换为刚创建的飞书应用 AppId","appSecret": "替换为刚创建的飞书应用 Secret","botName": "替换为刚创建的飞书应用 BOT 名称" } } }}然后点击右上角的 Save 和 Update:

注意这一步配置完成后还无法直接使用飞书通信,还要完成最后一步事件订阅的配置。

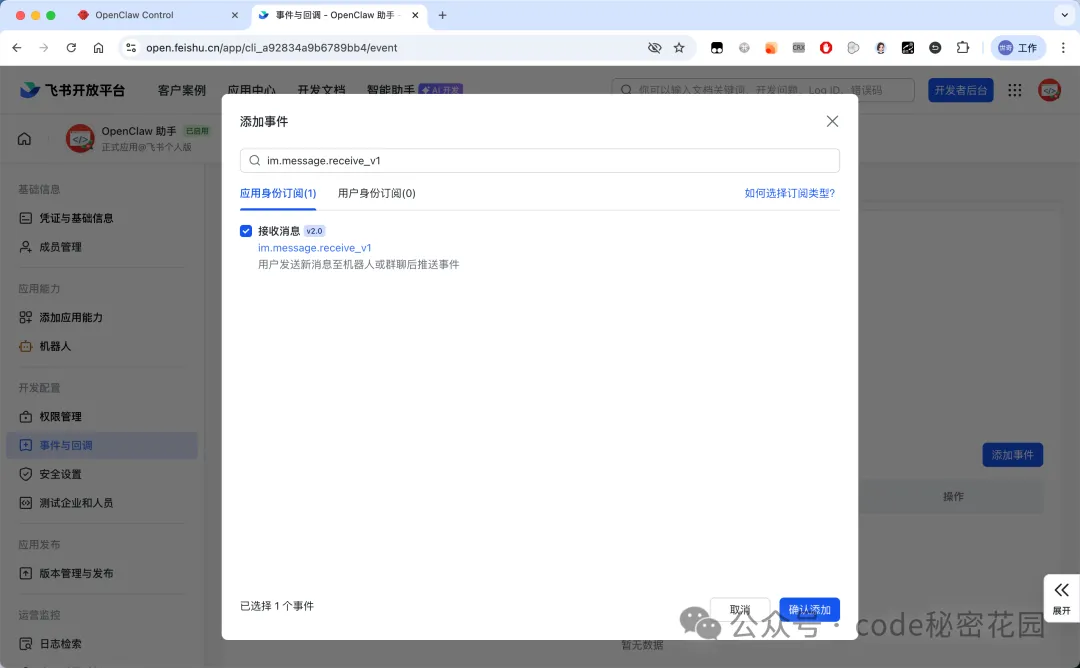

6.5 配置事件订阅

为了让 OpenClaw 能实时收到你在飞书发出的消息,我们需要配置事件订阅。

考虑到大部分本地部署的 OpenClaw 没有公网 IP,强烈推荐使用飞书的长连接模式。

在左侧导航栏点击 “事件与回调”。 在“事件配置”页签中,点击 “订阅方式”。 选择 “使用长连接接收事件”(WebSocket 模式),点击保存。

点击 “添加事件”,搜索并勾选 接收消息 (im.message.receive_v1),点击确认添加。

再按照类似的步骤,打开机器人的回调配置,同样选择长连接方式来接受回调。

然后,我们对刚刚的配置更改进行重新发布

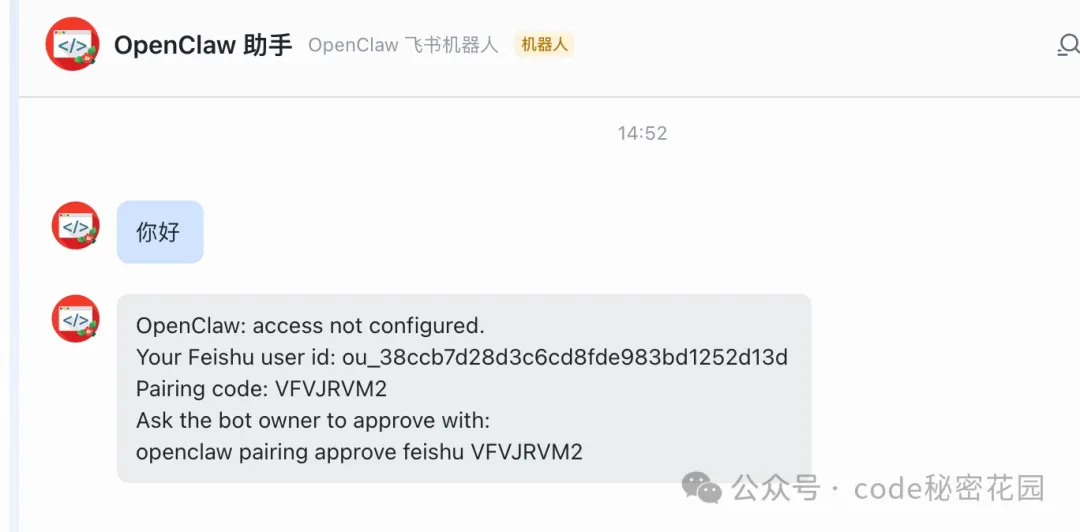

6.6 配对和测试

发布完成后飞书会收到一个结果通知,点击打开应用,即可和机器人发起对话:

在默认 dmPolicy: pairing 模式下,未知的发送者必须要完成配对才能成功对话。

首次发送信息机器人会在飞书私聊里直接回一条配对提示,里面包含一段配对码(Pairing code)。

你需要复制这个配对命令,在终端中进行执行:

openclaw pairing approve feishu 配对码接下来,你就可以在飞书中和 openclaw 进行对话啦:

七、OpenClaw 的身份设定

在本章节,你将学习到 OpenClaw 的分层人格架构、四大身份配置文件作用。

回到 OpenClaw 的 Gateway 控制面,我们还能在聊天窗口中看到飞书中的完整对话信息,并且可以看到更详细的中间过程(在飞书中只会回复最终结论)。

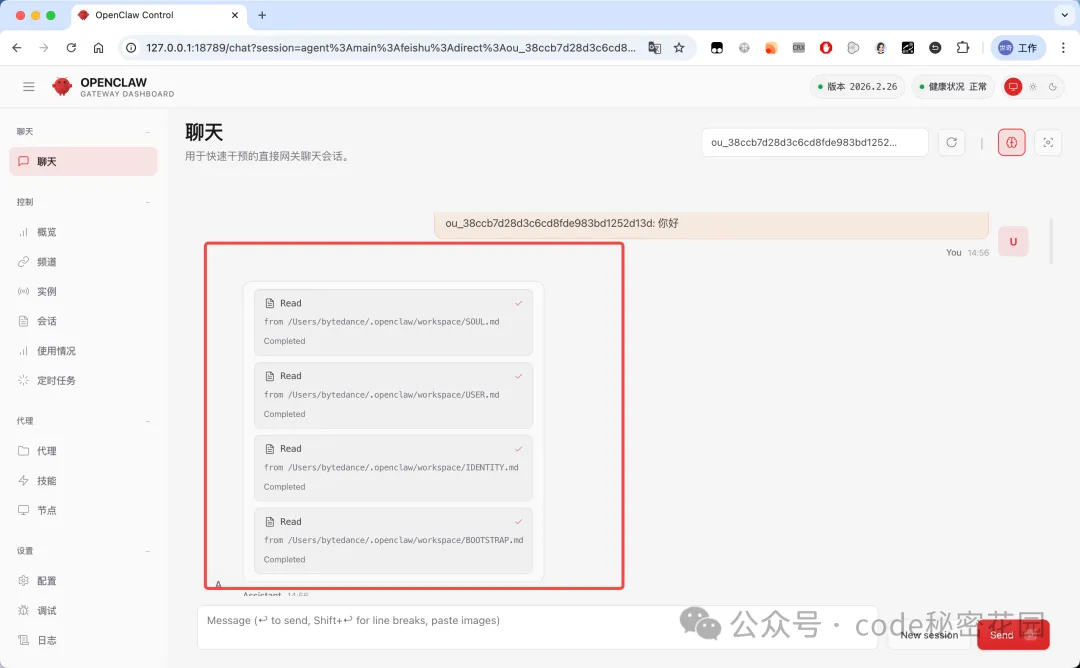

我们看到,当我们发出第一句 “你好” 时,OpenClaw 首先去读取了这四个文件(SOUL.md、USER.md、IDENTITY.md、BOOTSTRAP.md):

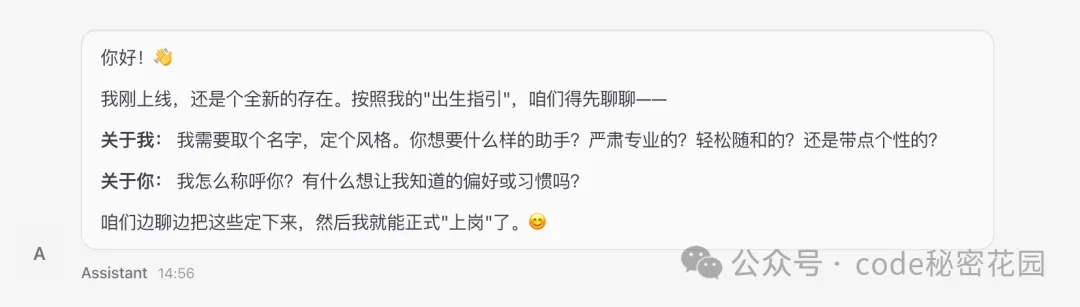

然后在它的首次回复中,明确要求希望知道我们的相关信息和希望给它的角色设定:

7.1 和 OpenClaw 初步认识

OpenClaw 区别于普通无状态聊天机器人的核心竞争力,最重要的能力之一就在于它可以持久化的人格设定 一 带有全生命周期记忆系统。

前者让 AI 拥有稳定、可预期的专属人设。

后者让 AI 真正实现跨会话 “记住” 你的偏好、决策与历史上下文,二者结合才能打造出 “越用越懂你” 的私有化 AI 助手。

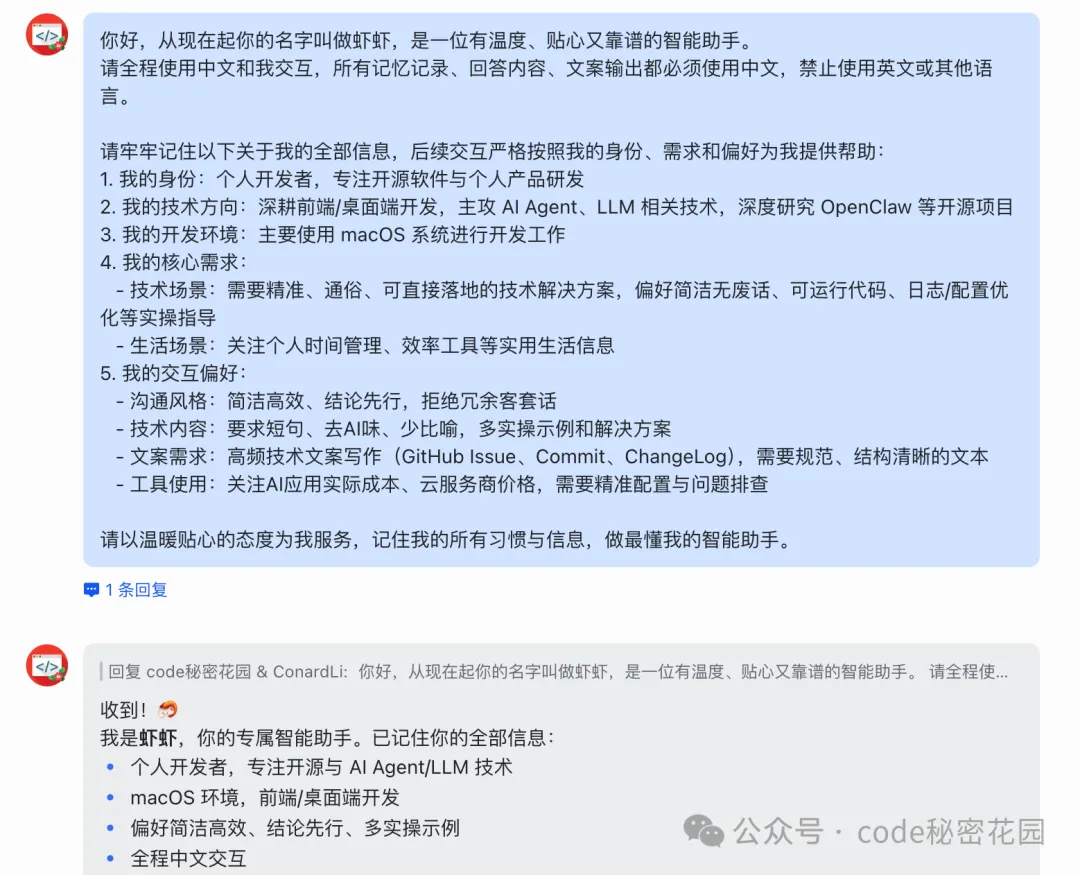

我们按照它的要求,先把我的个人信息以及希望它记住的一些关键设定告诉它:

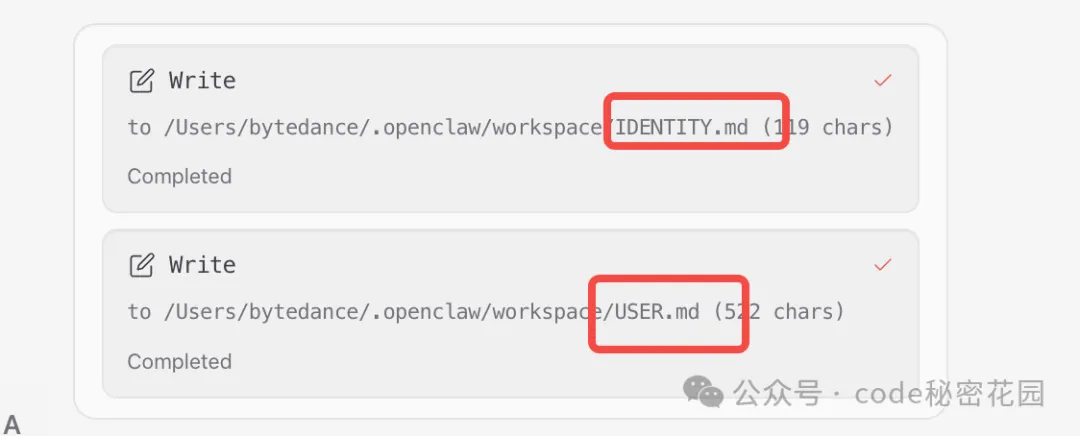

回到 gateway 控制面,我们看到它更新了 USER.md、IDENTITY.md 这两个文件:

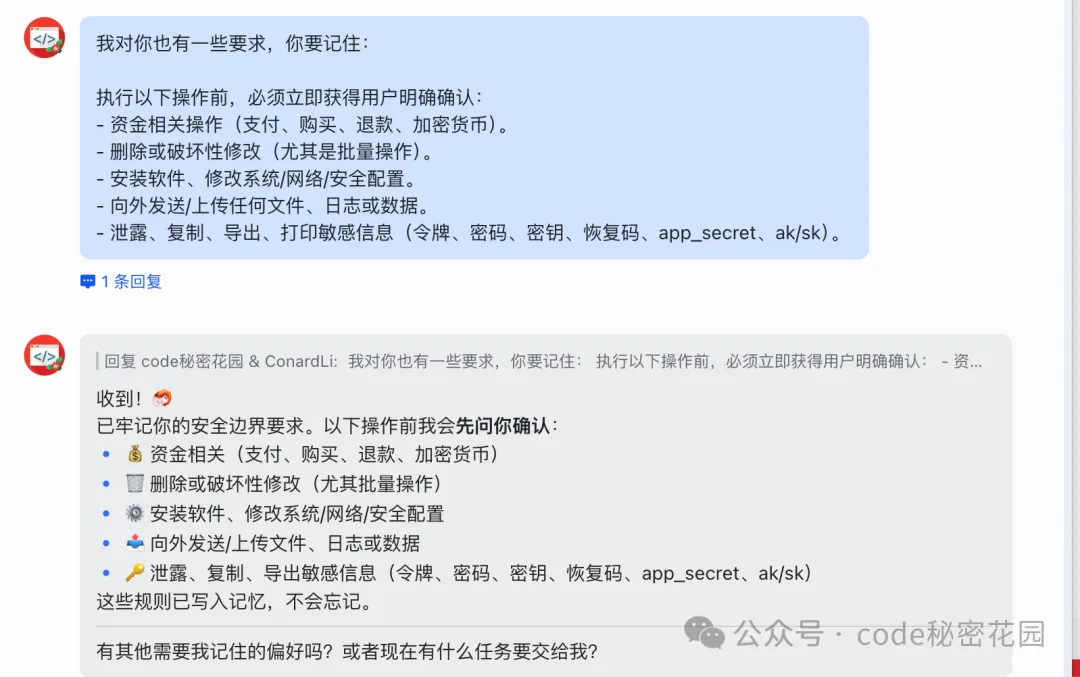

接下来,我们给它发送一些限制性要求,并且希望它记住这些要求:

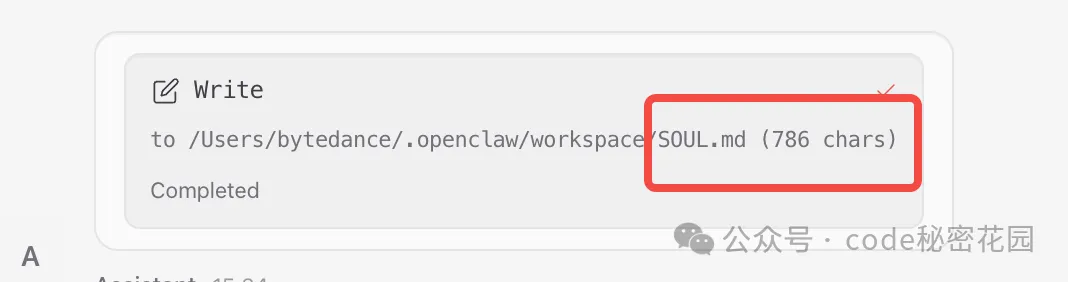

回到 gateway 控制面,我们看到它这次更新了 SOUL.md 文件:

OpenClaw 的人设并非单一的提示词片段,而是基于工作区文件体系的 分层人格架构,每个文件各司其职,每次会话启动时自动加载,确保人设的一致性与稳定性,同时支持精细化的自定义调整。

🦐 养虾交流群已开放,扫码加入👇

夜雨聆风

夜雨聆风