这段时间 OpenClaw 火得一塌糊涂。

几乎每个人都想上手部署,但使用过后,纷纷喊它是一只无情的 Token 吞金兽。

为了省钱,我们自然就把目光转向了不用花钱的本地部署大模型了。

然而,还未开始动手,那些大模型各种参数大小、各种微调量化版本,看得一头雾水。

根本不知道,自己的电脑能运行哪些模型,折腾半天部署后却发现跑不起来,心直接凉了。

无独有偶,今天在 GitHub 上发现了 llmfit 这个开源终端小工具,正好能解决这个痛点。

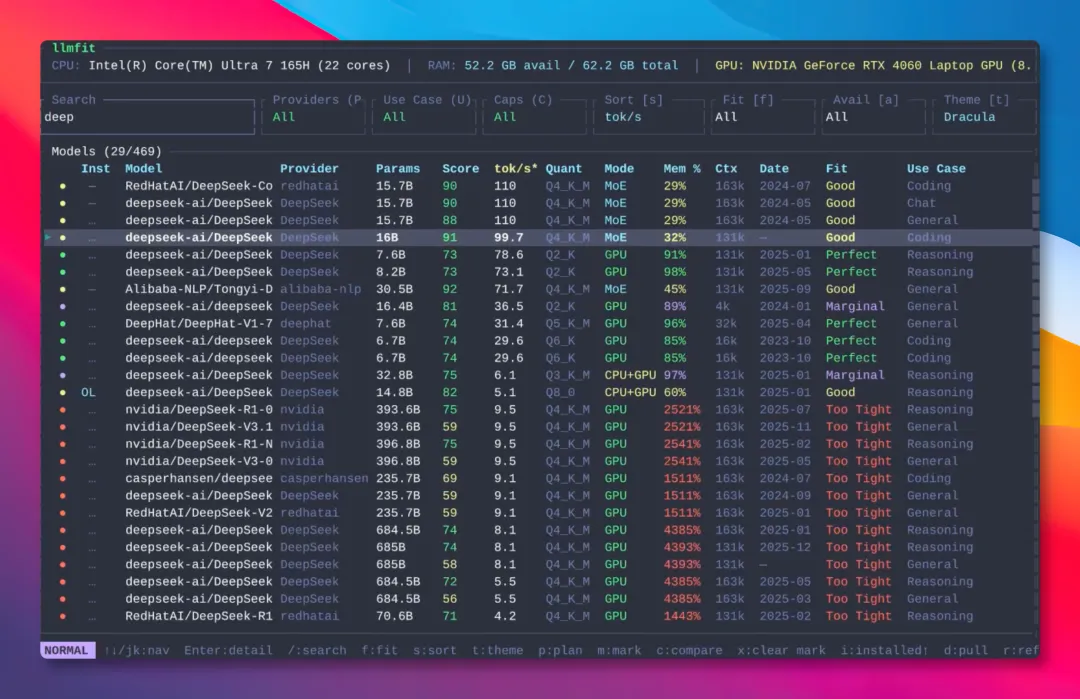

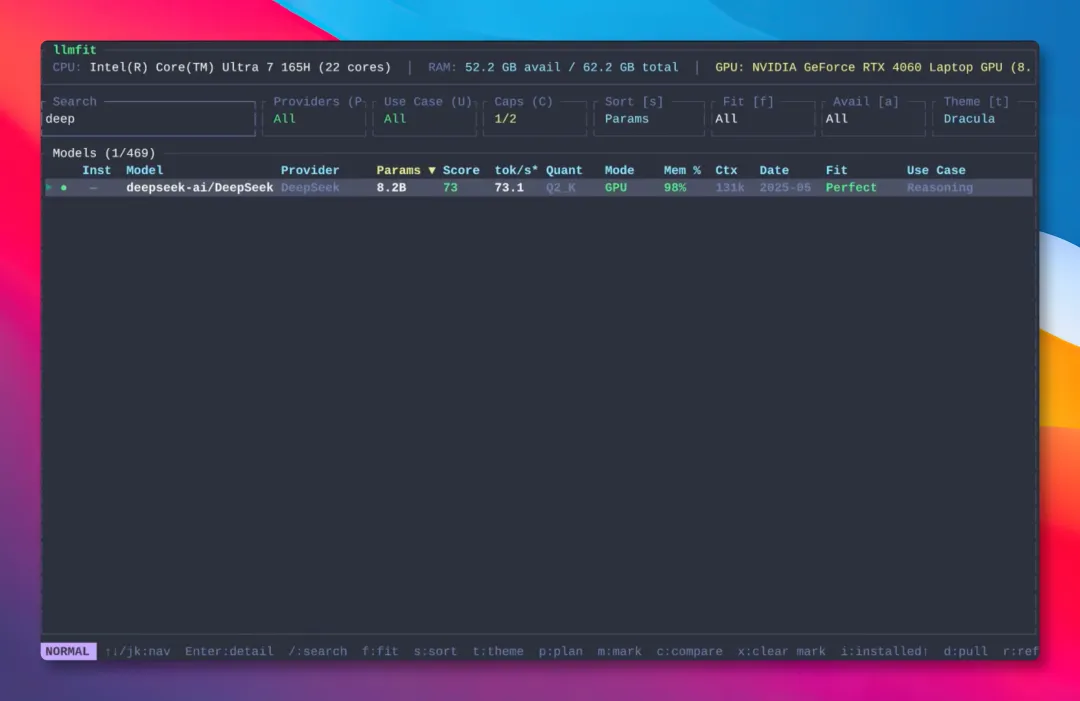

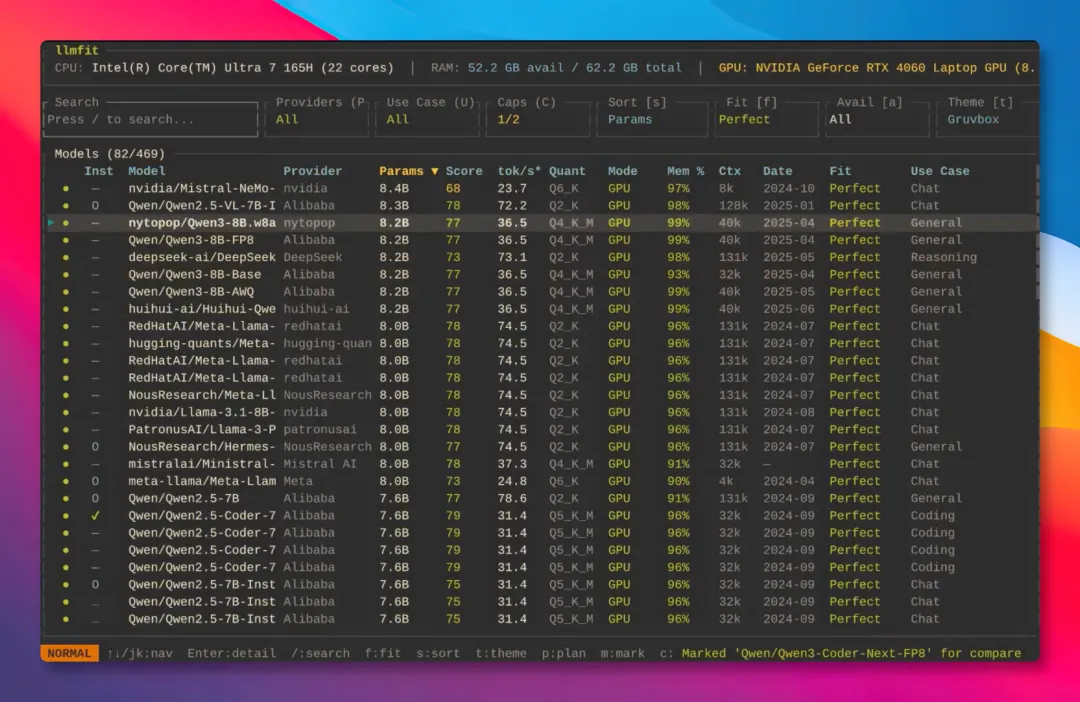

在终端里,只要运行一行命令,它就会自动扒出本机的 CPU、内存和显卡型号。

然后根据几百个主流模型的参数和压缩程度,列出一张很直观的排位表。

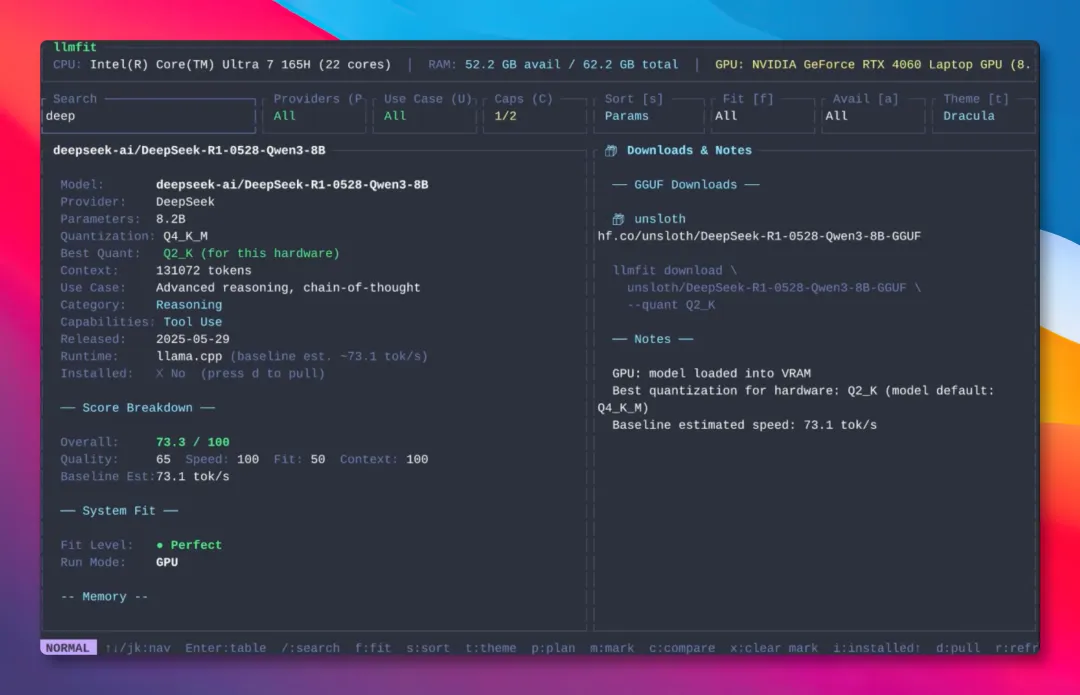

它不仅直接标明能不能跑,还会算出非常具体的运行指标。

比如它会预估显卡跑某个模型时,每秒到底能蹦出 10 个词还是 20 个词。

适合用来写代码、聊天还是做推理,都会在黑框终端里写得清清楚楚。

它甚至聪明到能看懂那些结构复杂的混合专家模型。

同时还知道这些模型在工作时其实只会用到一部分脑力,所以算出的显存需求会比原本小得多。

平时常用的各种本地大模型运行工具它都能兼容。

在这个极简的界面里,我们可以直接浏览所有推荐清单。

选中合适的,按个字母 d 就能一键下载,体验很顺滑。

想要使用这个小工具,非常简单。

如果你是用 macOS 系统,执行brew install llmfit 命令就能装好。

如果用的是 Windows 系统,则通过 scoop install llmfit 安装也一样轻松。

碰到那些没法自动识别显存的特殊设备。

我们还能手动输入参数,来强行指定显存容量。

比如敲一段代码告诉它显存有 24G,就能提前看看如果要升级显卡,到底能跑多大的模型。

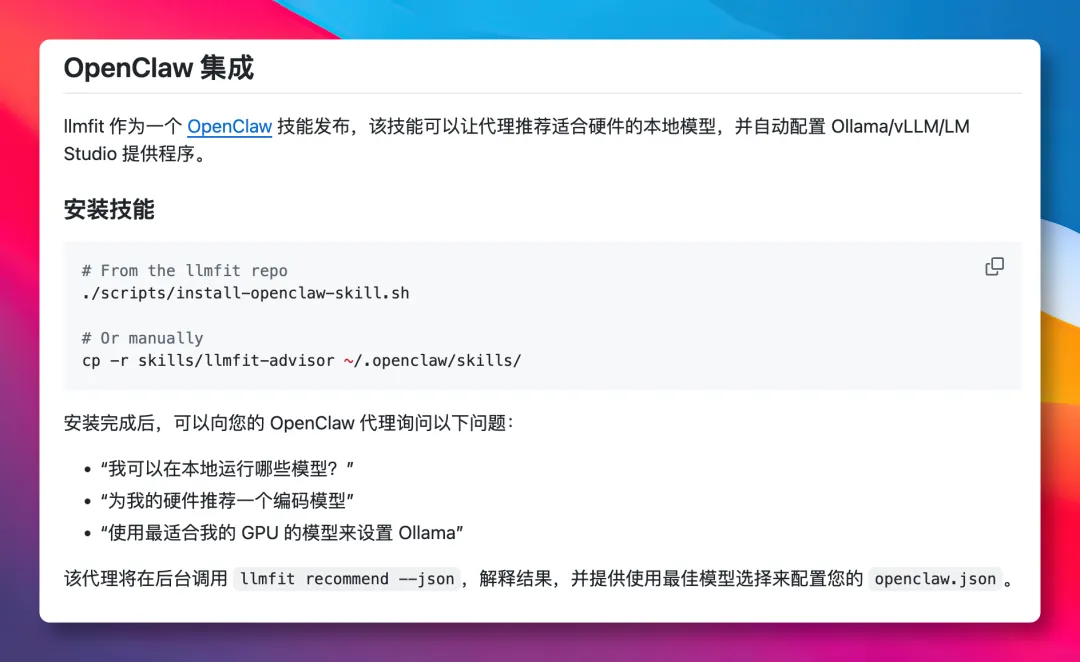

不仅如此,作者也深知大家用 OpenClaw 跑云端模型有多烧钱。

所以他专门为 OpenClaw 写了一个专属的 Skill 技能包。

只要在终端敲一行命令,就能完成安装。

./scripts/install-openclaw-skill.sh装好以后,AI Agent 就能自己去调用它评估咱们的本地硬件。

接着自动帮我们把 Ollama 这些本地运行环境配置好。

过去玩开源模型全靠硬件硬扛,试错成本实在太高。

现在有了这套工具把关,我们在本地折腾 AI 的门槛算是又降下了一大截。

把算力精打细算,让硬件物尽其用。 这或许才是本地部署真正的乐趣所在。

GitHub 项目地址:https://github.com/AlexsJones/llmfit

今天的分享到此结束,感谢大家抽空阅读,我们下期再见,Respect!

夜雨聆风

夜雨聆风