长期以来,AI一直被困在对话框里,能提建议,无法真执行。OpenClaw终结了这场纸上谈兵,让人工智能完成了从“建议者”到“执行者”的史诗级跨越,一个全新的“执行型AI”时代,正式拉开帷幕。

1

告别聊天机器人!AI终于长出“双手”

据悉,OpenClaw的前身是Clawdbot,由开发者Peter Steinberger于2025年11月推出,因商标相关调整,先后更名为Moltbot、OpenClaw,最终确定以OpenClaw为官方名称,保留Clawdbot作为常用别名,社区常称其为“小龙虾AI”。

OpenClaw的核心突破,就是给AI装上了能操控数字世界的“双手”。作为一款开源、支持私有化部署的AI智能体框架,它不是独立大模型,而是大模型的“执行载体”,能完美对接现有主流模型,实现:

● 自主拆解任务:听懂自然语言指令,把复杂需求拆分成可落地的步骤;

● 跨应用实操:操控文件、运行脚本、操作浏览器、整理数据,像真人一样干活;

● 闭环执行反馈:7×24小时后台运行,无需持续人工干预,完成任务后自动反馈。

图:OpenClaw的四层架构,来源:APIYI

简单来说:以前AI告诉你“怎么做”,现在OpenClaw直接帮你“做完”。无论是职场人头疼的文件整理、报表生成,还是开发者的代码运维、数据抓取,它都能一键搞定,堪称全天候在线的“数字员工”。

也正是这种颠覆性的体验,让OpenClaw火速出圈,GitHub星数暴涨、全球开发者疯抢部署,彻底改写了AI的应用逻辑。

2

Token消耗暴增6倍!AI商业化按下加速键

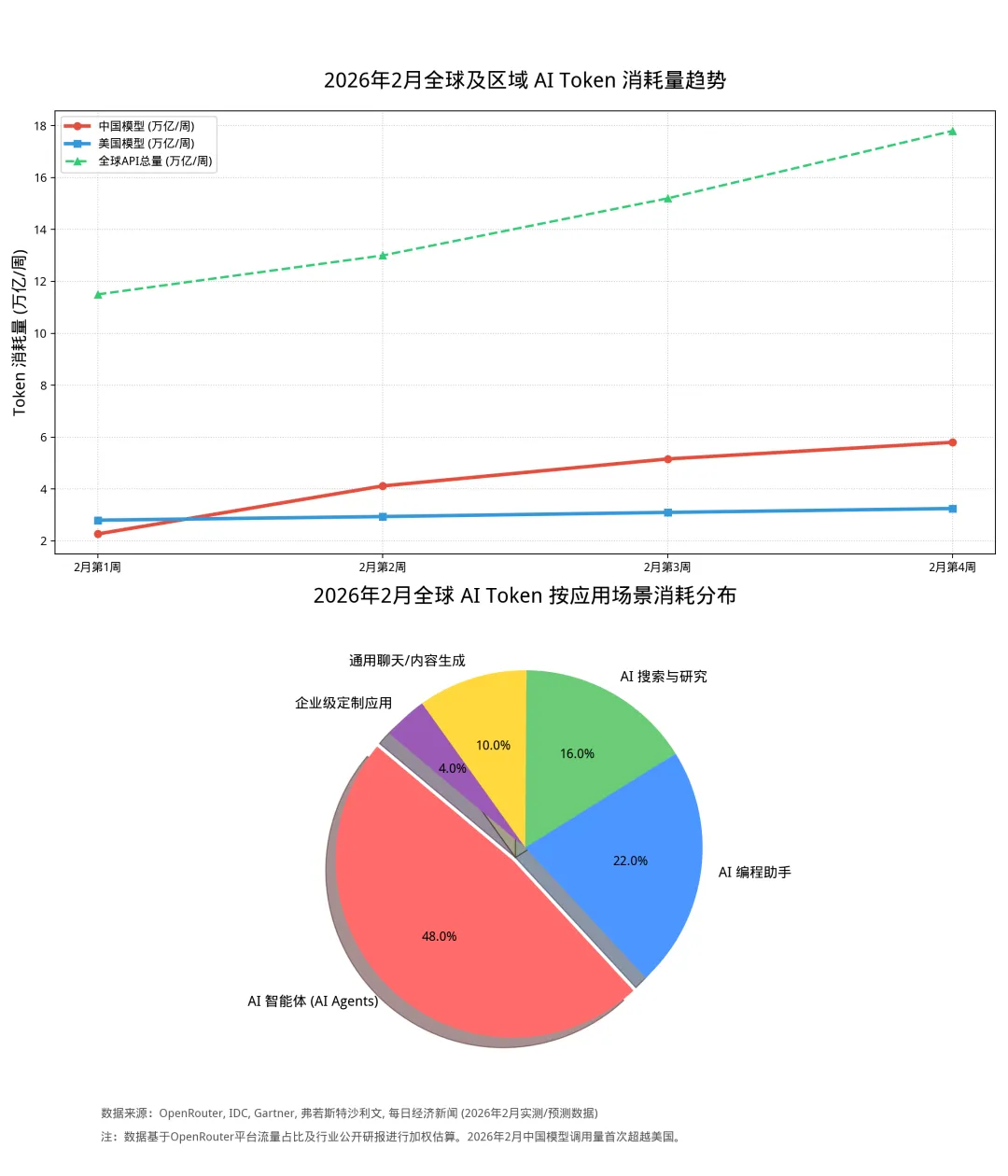

OpenClaw爆火的背后,是一场算力需求的“核聚变”。由于它需要自主规划、跨应用执行、反复纠错推演,其Token消耗量相比传统聊天模式呈指数级攀升。

业内人士透露,传统聊天式AI的人均日Token消耗仅百万级封顶;而切换到OpenClaw的任务执行模式后,人均日消耗直接飙升至上亿级,使用量翻了整整百倍。据MinMax最新财报显示,2月M2系列文本模型日均Token消耗量,是2025年12月的6倍以上,增长曲线和OpenClaw的爆火历程高度吻合——数以万计的开发者正在用OpenClaw调用各类大模型,完成从“聊天”到“执行”的任务升级。

这也意味着,AI行业彻底告别“轻量聊天”时代,进入“高耗执行”新阶段。Token不再是小众消耗品,而是成为AI生产力的核心燃料,商业化变现的路径也变得前所未有的清晰。

在此背景下,高性价比的Token就站到了C位。

3

国产模型成最大赢家,低成本才是王道

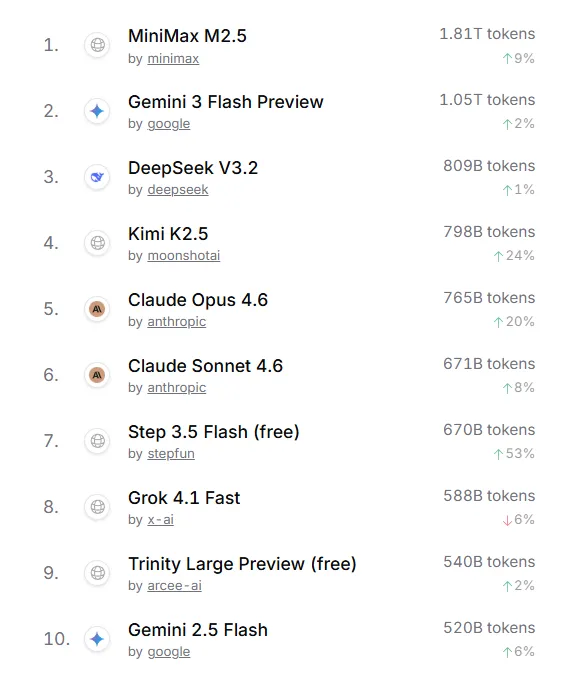

OpenRouter的最新数据显示,MiniMax的M2.5、DeepSeek的V3.2、月之暗面的Kimi K2.5、阶跃星辰的Step 3.5 Flash (free)与智谱的GLM 5,分别进入模型Token调用榜的Top 10,占据了半壁江山。

值得说明的是,OpenRouter的核心用户是个人开发者、初创团队,仅占全球AI支出的2%;真正的Token消耗大头(90%以上),是财富500强、大型SaaS厂商,它们大多直接对接OpenAI、Anthropic等巨头官方API,不经过第三方平台。

但即便如此,OpenClaw的爆发,依旧让国产大模型占据了先机。执行型AI对Token成本极度敏感,而国产模型凭借极致的性价比、稳定的调用能力,完美适配OpenClaw的海量消耗需求。

据腾讯科技统计,Claude 4.6 Sonnet的输出价格为15美元/百万Token,而MiniMax M2.5的典型输出价格约为1.2美元/百万Token,前者是后者的约12.5倍。GPT-5.2的输出价格为14美元/百万Token,也接近MiniMax的11.7倍。即便是已经涨价的智谱GLM-5,输出价格约为3.2美元/百万Token,仍然只有Claude的大约五分之一左右。在Agent场景里,这种差距会被指数级放大。假设一个生产级Agent每天处理10亿输出Token,挂Claude意味着每天约1.5万美元的支出;同样规模如果使用MiniMax,大约1200美元。30天下来,前者接近45万美元,后者约3.6万美元,中间差出40多万美元。

当算力成本不断下探、国产模型的性价比优势持续放大,中国AI出海的想象空间,也真正被彻底打开。

4

产业链传导,从模型厂商到数据中心

Token需求高速增长的影响,正在沿着产业链层层传导。

● 在模型层,国产厂商的领先优势有望进一步扩大。OpenClaw的开发者生态具有强烈的“路径依赖”特征——一旦某个模型在社区中被验证适合执行型任务,开发者会围绕它构建工具链、分享最佳实践,形成正向循环的生态壁垒。

● 在算力层,推理算力的需求正在爆发式增长。与训练算力的一次性投入不同,推理算力是持续的、高频的消耗。这直接利好算力租赁、云计算服务商。阿里云、腾讯云、火山引擎、华为云、优刻得、青云科技等推出的OpenClaw一键部署镜像,本质上是在抢占“执行型AI”时代的算力入口。

● 在数据中心层面,角色的转变尤为深刻。过去,数据中心更多地被视为数据存储和分发的中心;而现在,它必须进化为能够支撑推理算力海啸的“算力工厂”。每一个在用户本地端运行的“龙虾”,背后都可能需要云端数据中心提供源源不断的推理算力。

● 在政策层面,地方政府已经敏锐捕捉到机遇。3月初,深圳市龙岗区人工智能(机器人)署就发布了《深圳市龙岗区支持OpenClaw&OPC发展的若干措施(征求意见稿)》,俗称"龙虾十条",成为全国首个专门针对OpenClaw的专项扶持政策 。3月9日,无锡高新区发布“养龙虾12条”——全国首个针对OpenClaw产业的专项扶持政策,提供最高300万元的算力补贴、最高100万元的数据采购补贴。在此之前,成都高新区已宣布设立OpenClaw产业专项基金,北京海淀区则组织了多场“养虾”实操培训。地方政府竞相布局,瞄准的是“执行型AI”催生的全新产业生态——新的模型服务商、算力运营商、应用开发商,甚至“数字员工派遣”、“AI任务众包”等全新业态。

5

写在最后

OpenClaw的爆火,从来不是一次偶然的流量狂欢,而是AI产业发展的必然拐点。

从“对话”到“执行”,AI终于摆脱了辅助工具的定位,成为真正能解放生产力、重构工作流程的核心引擎。Token消耗的暴涨、国产模型的崛起,也预示着行业即将迎来新一轮洗牌。那些能把控Token成本、深耕落地场景的玩家,终将成为这个时代的赢家。

这场AI执行革命,才刚刚开始。

声明:文章综合整理自网络,本公众平台对转载、分享的内容、陈述、观点判断保持中立,不对所包含内容的准确性、可靠性或完善性提供任何明示或暗示的保证,仅供读者参考。

你体验过OpenClaw了吗?觉得AI执行时代会改变你的工作吗?欢迎在评论区留言讨论~

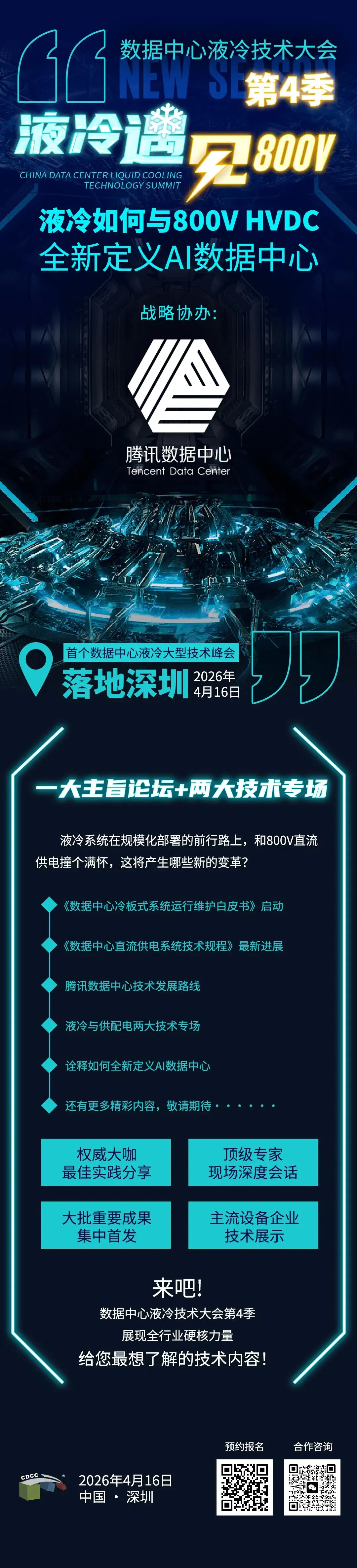

2026年4月16日,由CDCC主办、腾讯数据中心战略协办的数据中心液冷技术大会将在深圳召开,这是首个数据中心液冷大型技术峰会落地深圳。大会以“液冷遇见800V”为主题,旨在汇聚数据中心领域的顶尖专家、技术骨干与学术研究者,共同探讨行业创新方向,谋划合作机遇,推动液冷技术生态健康发展。

识别海报二维码快速报名~

关注我们获取更多精彩内容

往期回顾

夜雨聆风

夜雨聆风