选 AI 模型就像点菜——菜单太长反而不知道选哪个。OpenClaw 目前适配了 13 款主流 AI 模型,国产和国外各有所长。这篇文章把每个模型的适配度、价格、适用场景都列清楚,帮你快速做出选择。

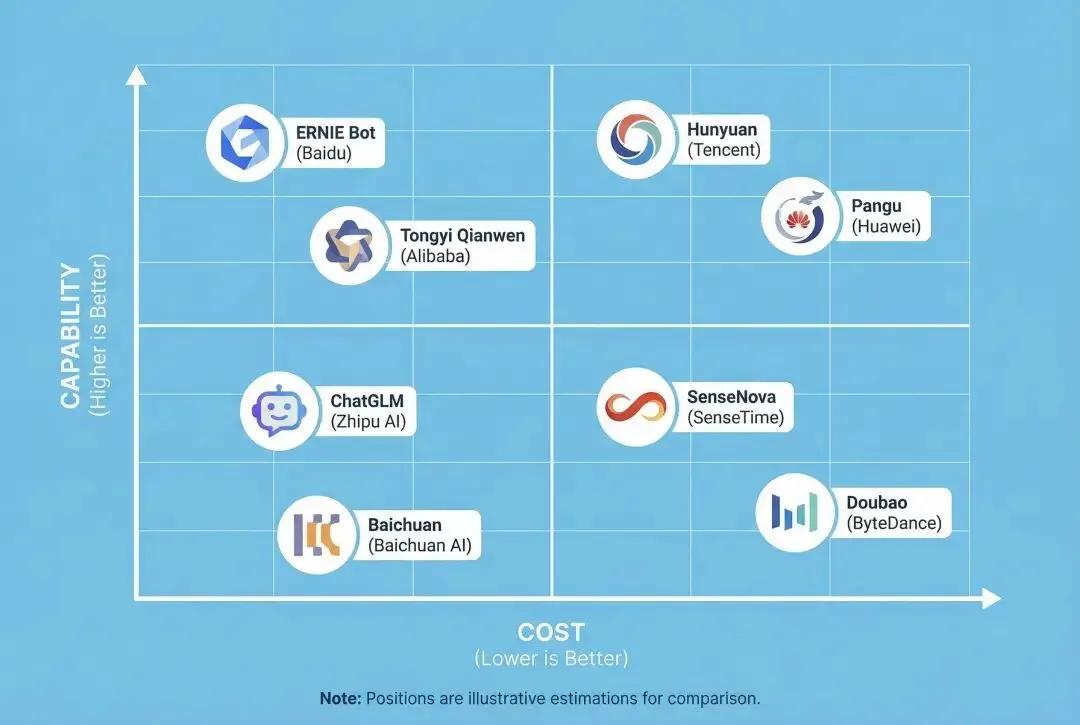

(一)国产 AI 模型(按适配度/性价比排序)

1. MiniMax M2.1 / M2.5

- 适配度:

★★★★★(PinchBench 成功率 93.6%,OpenClaw 官方推荐) - 亮点:

长流程任务稳定、20 万 tokens 上下文。百万 Token 上下文价格仅为国际同类的 1/15 至 1/10,海外调用量排名靠前 - 适合:

自动化办公、流程执行、高并发场景,企业级大规模部署 - 价格:

按量计费。快速版(100 TPS)输入 $0.3/百万 Token、输出 $2.4/百万 Token;标准版(50 TPS)输入 $0.3/百万 Token、输出 $1.2/百万 Token。折算约 0.001–0.005 元/千 tokens

2. 月之暗面 Kimi K2.5(Moonshot)

- 适配度:

★★★★★(官方内置支持,成功率超 93%) - 亮点:

256K 超长上下文、文档分析能力强、支持思考模式,周活跃调用量已进入头部梯队,OpenClaw 官方提供免费额度,指令理解精准 - 适合:

长文档处理、知识管理、合同/论文阅读、批量文档分析 - 价格:

输入 ¥0.002/千 tokens,输出 ¥0.008/千 tokens。OpenClaw 官方有免费额度,新用户可免费试用

3. 智谱 AI GLM-4 Flash / GLM-5

- 适配度:

★★★★☆ - 亮点:

代码/推理能力强、中文友好、价格极低(约海外模型的 1/70),个人用户可永久免费使用(非商用),无额度限制,代码生成成功率高 - 适合:

编程、复杂任务规划、高频使用、自动化脚本生成 - 价格:

约 0.0005–0.003 元/千 tokens。个人非商用永久免费,仅限制 QPS 为 3 次/秒,连续调用超 50 次有短暂冷却

4. 百度文心一言 3.5 Turbo

- 适配度:

★★★★☆(官方直接支持,最新版无需额外配置) - 亮点:

个人非商用永久免费、国内访问稳定,无时间限制和 Token 额度上限,指令理解准确率高,配置简单 - 适合:

日常办公、问答、文档处理、基础自动化任务 - 价格:

个人非商用永久免费(QPS 限制 5 次/秒);商用按量计费,约 0.001–0.005 元/千 tokens

5. 阿里通义千问 Qwen 3.5 Plus / Turbo

- 适配度:

★★★★☆ - 亮点:

国内网络访问稳定、免费额度多、支持视觉多模态,适配钉钉/飞书生态,企业集成便捷 - 适合:

企业办公、钉钉/飞书集成、通用智能体、多模态任务 - 价格:

OAuth 免费 2000 次/天;API 按量计费,约 0.002–0.02 元/千 tokens

6. 字节豆包 2.0

- 适配度:

★★★★ - 亮点:

中文理解能力强、飞书生态适配好,响应速度快 - 适合:

中文创作、企业知识库、飞书集成、中文指令执行 - 价格:

按量计费,约 0.001–0.006 元/千 tokens

7. DeepSeek

- 适配度:

★★★★ - 亮点:

推理能力强、性价比高、开源友好,周调用量进入全球前十,适合私有化部署 - 适合:

技术开发、私有化部署、成本敏感场景、代码辅助 - 价格:

约 0.0008–0.004 元/千 tokens

8. 讯飞星火 Lite(科大讯飞)

- 适配度:

★★★★☆ - 亮点:

个人非商用永久免费,支持语音指令识别,普通话识别准确率 97.2%,方言识别准确率 85.3%,配置简单 - 适合:

语音控制电脑、亲子互动、语音转文字整理 - 价格:

个人非商用永久免费(QPS 限制 4 次/秒);商用需单独咨询

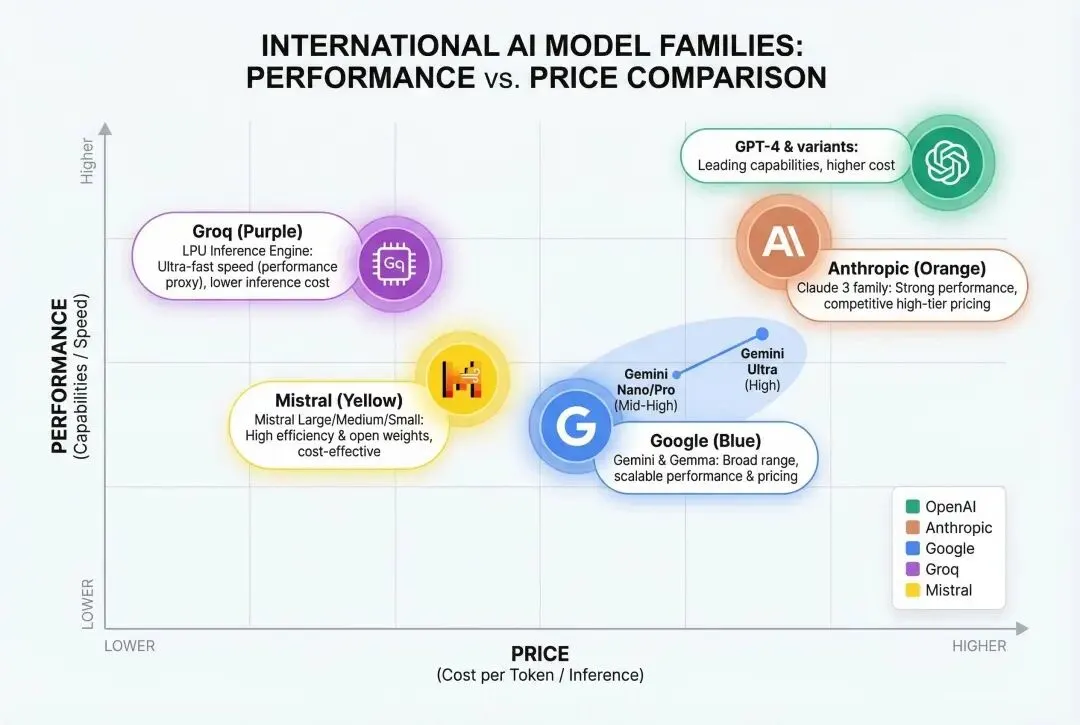

(二)国外 AI 模型(按适配度/性能排序)

1. OpenAI GPT 系列(官方原生支持)

- 适配度:

★★★★★(OpenClaw 默认首选,自动降级机制完善) - 模型:

gpt-5.4、gpt-4o、gpt-3.5-turbo、o1-preview。其中 GPT-5.4 为 2026 年 3 月 5 日发布的旗舰模型,支持 105 万 token 超大上下文窗口,原生计算机操作能力突出,OSWorld 基准测试成功率 75% - 亮点:

工具调用和函数调用稳定性领先,生态丰富,部分版本支持批量处理可降低成本 - 适合:

全场景通用、复杂推理、代码生成、多模态、企业级高吞吐量应用 - 价格:

GPT-5.4(≤272K):输入 $2.5/百万 tokens,输出 $15/百万 tokens GPT-5.4(>272K):输入 $5/百万 tokens,输出 $22.5/百万 tokens GPT-5.4 Pro:输入 $30–60/百万 tokens,输出 $180–270/百万 tokens(按上下文长度分级) GPT-4o:输入 $5/百万 tokens,输出 $15/百万 tokens GPT-3.5-turbo:输入 $0.5/百万 tokens,输出 $1.5/百万 tokens 批量处理可享标准价格 50% 优惠

2. Anthropic Claude 系列

- 适配度:

★★★★★(官方内置支持,PinchBench 成功率 92%+) - 模型:

claude-opus-4-6、claude-sonnet-4-5、claude-haiku。其中 Claude Opus 4.6 为 2026 年 2 月发布的旗舰模型,支持 100 万 Token 上下文窗口(Beta 版),引入 Agent Teams 多智能体协作功能,Terminal-Bench 2.0 得分 65.4% - 亮点:

超长上下文(最高 1M)、代码能力强、提示词缓存、安全性高,分层定价 - 适合:

长文档处理、复杂编程、合规敏感场景、多智能体协作任务 - 价格:

Opus 4.6(≤200K):输入 $5/百万 tokens,输出 $25/百万 tokens Opus 4.6(>200K):输入 $10/百万 tokens,输出 $37.5/百万 tokens Sonnet 4.5:输入 $3/百万 tokens,输出 $15/百万 tokens Haiku:输入 $0.8/百万 tokens,输出 $4/百万 tokens

3. Google Gemini 系列

- 适配度:

★★★★☆(2026.3 版本新增原生支持) - 模型:

gemini-3.1-flash、gemini-3.1-pro、gemini-2.0、gemini-3.1-flash-lite(2026 年 3 月 3 日新增)。Flash-Lite 定位成本最低、延迟最短,价格仅为 Flash 版本的一半 - 亮点:

多模态能力强(文本/图像/音频/视频)、速度快,谷歌生态集成便捷 - 适合:

多模态任务、实时交互、谷歌生态集成、高频轻量场景 - 价格:

Gemini 3.1 Flash-Lite:输入 $0.25/百万 tokens,输出 $1.5/百万 tokens Gemini 3.1 Flash:输入 $0.15/百万 tokens,输出 $0.6/百万 tokens Gemini 3.1 Pro:输入 $1.25/百万 tokens,输出 $5/百万 tokens Gemini 2.0:输入 $1/百万 tokens,输出 $4/百万 tokens

4. Groq 极速推理模型

- 适配度:

★★★★ - 模型:

llama3-70b、mixtral-8x7b、gemma-7b,依托 Groq LPU 芯片,推理速度极快 - 亮点:

推理速度毫秒级、性价比高、延迟低 - 适合:

实时对话、高并发、低延迟场景 - 价格:

约 $0.05–$0.5/百万 tokens

5. Mistral 系列

- 适配度:

★★★★ - 模型:

mistral-large-2、mixtral-8x22b - 亮点:

开源友好、推理能力强、成本低 - 适合:

技术开发、私有化部署、成本敏感场景、代码辅助 - 价格:

约 $0.5–$3/百万 tokens

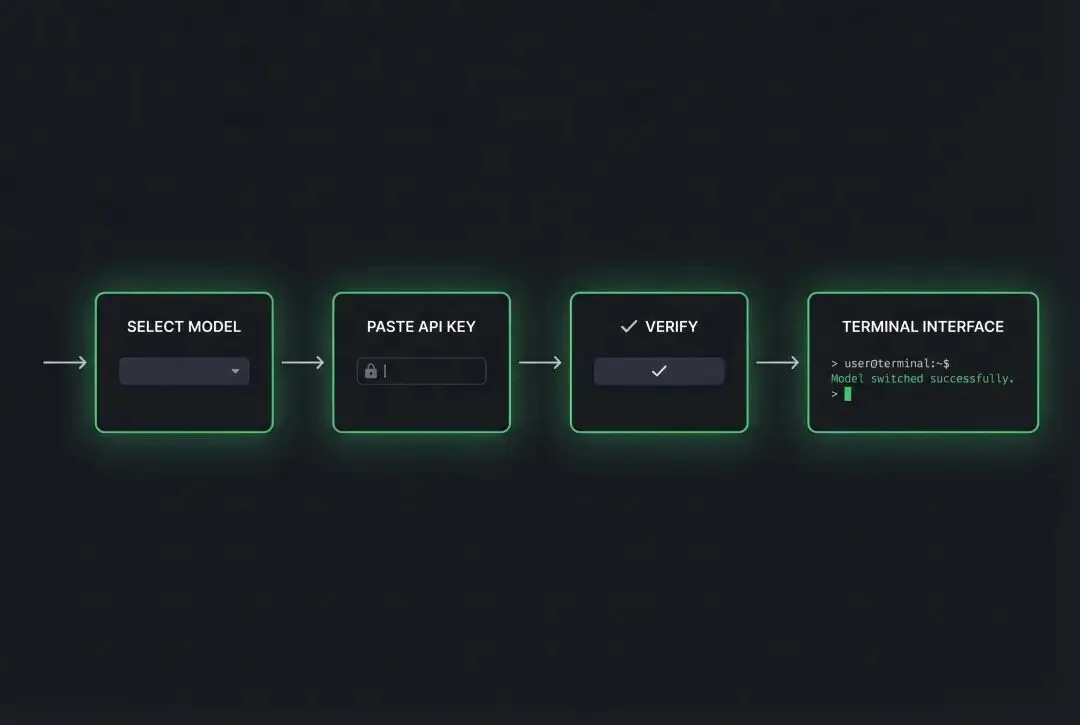

二、通用购买/接入步骤

所有适配模型均遵循以下通用流程,配置完成后即可在 OpenClaw 中使用。

第 1 步:注册平台账号

进入对应模型的官方开放平台,完成注册(个人/企业均可,企业需实名认证)。

💡 各平台入口国产模型:MiniMax 开放平台[1]、Moonshot 开放平台[2]、智谱AI 开放平台[3]、百度智能云[4]、阿里云百炼[5]、火山方舟[6]、讯飞星火开放平台

国外模型:OpenAI Platform[7]、Anthropic Console[8]、Google AI Studio[9]、Groq Cloud[10]、Mistral AI Platform[11]

第 2 步:获取 API Key

进入对应平台控制台 → 创建应用/项目 → 生成并复制 API Key。

⚠️ 安全提醒API Key 仅显示一次,请妥善保管。泄露会导致账号被盗用、产生额外费用。

第 3 步:OpenClaw 配置

Windows(以管理员身份运行 PowerShell):

iwr -usebhttps://open-claw.org.cn/install-cn.ps1 | iexMac / Linux(打开终端):

curl -fsSL https://open-claw.org.cn/install-cn.sh | bash安装完成后,运行配置向导:

openclaw onboard在向导中选择对应模型供应商及版本,粘贴 API Key,开启自动降级(推荐),完成配置。

第 4 步:充值/计费

- 付费模型:

在对应平台控制台充值(国产平台支持微信、支付宝,国外平台支持信用卡),按 tokens 消耗自动扣费 - 免费额度:

多数平台提供新用户免费额度(国外模型通常有效期 1-3 个月,国产模型部分支持个人永久免费),可先试用再充值

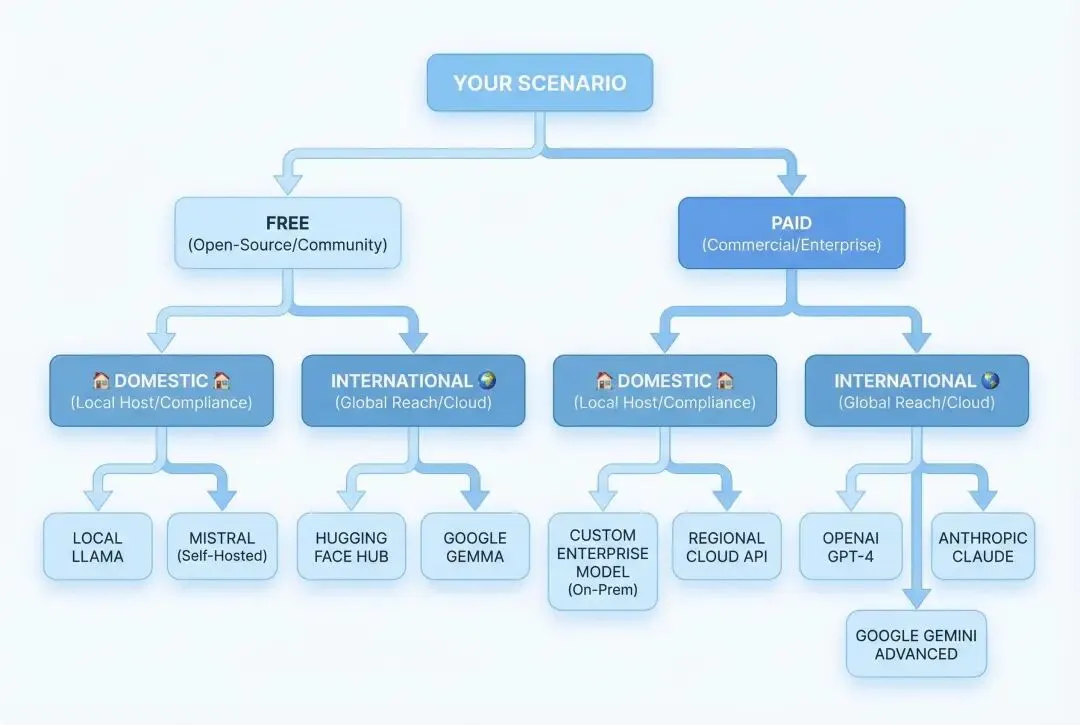

三、选型与成本建议

(一)个人用户/免费优先

- 纯办公/文字任务:

文心一言 3.5 Turbo(个人永久免费)、智谱 GLM-4 Flash(永久免费,代码能力强)、讯飞星火 Lite(永久免费,支持语音) - 长文档试用:

Kimi K2.5(官方免费额度,256K 长上下文) - 多模态试用:

Gemini 3.1 Flash(免费额度,速度快)

(二)企业用户/专业场景

- 全场景首选:

GPT-4o(性能与价格平衡)、MiniMax M2.5(成本仅为国际模型的 1/10 左右) - 长文本/代码:

Claude Sonnet 4.5(1M 上下文 + 提示词缓存)、Kimi K2.5(256K 上下文) - 多模态任务:

Gemini 3.1 Pro(全模态支持,谷歌生态集成) - 极速推理/高并发:

Groq(毫秒级响应) - 编程/开发:

智谱 GLM-4 Flash、DeepSeek、Mistral(开源友好,成本低) - 生态集成:

通义千问(钉钉)、豆包(飞书)、Gemini(谷歌生态)

(三)成本敏感场景

- 国产首选:

智谱 GLM-4 Flash(免费)、DeepSeek(约 0.0008 元/千 tokens)、MiniMax M2.5 - 国外首选:

GPT-3.5-turbo、Gemini 3.1 Flash-Lite、Groq

四、OpenClaw 适配 AI 模型配置速查表

ℹ️ 使用说明以下配置 ID 可直接用于 OpenClaw 配置向导。API Key 需自行在对应平台获取。

国产模型速查表

minimax/m2.1minimax/m2.5 | ||||

moonshot/kimi-k2.5moonshot/kimi-k2-thinking | ||||

zhipu/glm-4-flashzhipu/glm-5 | ||||

baidu/ernie-3.5-turbo | ||||

ali/qwen-3.5-plusali/qwen-3.5-turbo | ||||

bytedance/doubao-2.0 | ||||

deepseek/deepseek-chat | ||||

iflytek/xinghuo-lite |

国外模型速查表

openai/gpt-5.4 | ||||

openai/gpt-4oopenai/gpt-3.5-turbo | ||||

anthropic/claude-opus-4-6anthropic/claude-sonnet-4-5 | ||||

google/gemini-3.1-flash-litegoogle/gemini-3.1-flash、google/gemini-3.1-pro | ||||

groq/llama3-70bmistral/mistral-large-2 |

五、OpenClaw 模型切换步骤

切换模型无需重新安装 OpenClaw,通过终端命令即可完成。

第 1 步:打开终端

Windows 打开 PowerShell(管理员身份),Mac 打开终端。

第 2 步:进入配置向导

openclaw onboard启动配置向导(与初次配置步骤一致,无需重新注册 API Key)。

第 3 步:选择目标模型

在向导中找到"模型选择"选项,用上下键切换到目标模型(需提前获取对应 API Key,已保存的可直接复用)。

第 4 步:确认配置并生效

粘贴对应 API Key(已配置过的可选择"复用已保存 API Key"),确认开启自动降级(推荐),输入 y 确认,等待 1-2 秒即生效。

第 5 步:验证切换结果

openclaw model list若显示"当前生效模型:目标模型名称",说明切换成功。也可运行以下命令验证响应:

openclaw ask "你好"💡 批量切换如需频繁切换,可提前在配置向导中保存多个模型的 API Key,后续直接选择即可。

六、终端配置代理端口(以 7890 为例)

国内访问国外 AI 模型(如 OpenAI、Anthropic、Google Gemini)时,需配置终端代理。以下以常用端口 7890 为例。

(一)前提准备

确保已安装并启动代理工具(如 Clash、V2Ray 等),端口设置为 7890 确认代理工具已开启"全局代理"或"终端代理"模式

(二)Windows 系统(PowerShell)

临时代理(仅当前终端生效,关闭后失效):

$env:HTTP_PROXY="http://127.0.0.1:7890"$env:HTTPS_PROXY="http://127.0.0.1:7890"永久代理(所有终端生效,重启后仍有效):

验证:运行 curl https://www.google.com,能返回页面内容说明配置成功。

(三)Mac 系统(终端)

临时代理(仅当前终端生效):

export HTTP_PROXY=http://127.0.0.1:7890export HTTPS_PROXY=http://127.0.0.1:7890永久代理(所有终端生效):

nano ~/.bash_profile在文件中添加:

export HTTP_PROXY=http://127.0.0.1:7890export HTTPS_PROXY=http://127.0.0.1:7890按 Ctrl+O 保存,Ctrl+X 退出。然后执行:

source ~/.bash_profile验证:运行 curl -I www.google.com,返回 200 说明配置成功。

(四)注意事项

代理端口需与代理工具的端口保持一致,若端口为其他数值(如 7891、10809),替换命令中的 7890即可配置代理后,仅国外模型需要代理,国产模型无需代理可正常使用 若配置后仍无法访问,检查代理工具是否正常运行、端口是否正确,或尝试重启代理工具和终端

参考资料

[1] https://www.minimaxi.com/ [2] https://platform.moonshot.cn/ [3] https://open.bigmodel.cn/ [4] https://cloud.baidu.com/ [5] https://www.aliyun.com/product/bailian [6] https://www.volcengine.com/ark [7] https://platform.openai.com/ [8] https://console.anthropic.com/ [9] https://aistudio.google.com/ [10] https://console.groq.com/ [11] https://console.mistral.ai/

夜雨聆风

夜雨聆风