引言:从能聊到能做,AI执行力的范式革命

核心观点:OpenClaw通过本地优先、透明可控的架构设计,让AI从对话工具转变为真正的生产力工具,解决了企业级AI应用的隐私与合规难题。

2026年初,一款名为OpenClaw的开源AI智能体框架以火箭般的速度席卷GitHub,短短数周内星标数突破27.8万,走完了Linux 30年的普及之路。英伟达CEO黄仁勋公开评价:“这可能是当代最重要的软件发布。”

但OpenClaw究竟是什么?为什么它能引发如此大的行业震动?答案在于其核心定位的颠覆性转变——OpenClaw不是另一个聊天机器人,而是一个真正能让AI“动手”执行任务的智能体执行网关。

传统大模型如ChatGPT、Claude虽然能回答复杂问题,但它们只是“大脑”,缺乏“手脚”。用户得到的依然是文字建议,而非实际成果。OpenClaw解决了这一痛点:它将大语言模型的思考能力与本地系统的执行能力相结合,让AI不再停留在对话层面,而是真正进入工作流,自动完成文件整理、代码编写、网页操作等实际任务。

本文将从技术架构角度深度拆解OpenClaw的设计理念、核心组件与性能优势,揭示这只“红色龙虾”背后的工程智慧,以及它如何为AI从“玩具”走向“生产力工具”铺平道路。

一、核心架构设计:四层解耦模型

OpenClaw采用经典的四层解耦架构,从外到内形成清晰的责任边界,确保系统的高度可扩展性和维护性。

1.1 四层架构概览

| 交互层 (Channels) | |||

| 网关层 (Gateway) | |||

| 智能体层 (Agent) | |||

| 执行层 (Execution) |

1.2 设计理念:本地优先与透明可控

OpenClaw的架构设计体现了两个核心哲学:

本地优先:所有数据默认存储在用户本地设备(~/.openclaw/目录),不依赖云端服务器,确保数据隐私和主权。

透明可控:AI的记忆不再是黑盒,而是以可读的Markdown文件形式存储,用户可以直接查看、编辑。

这种设计解决了企业级AI应用中最敏感的隐私问题。对于处理财务数据、客户信息、商业机密的场景,OpenClaw提供了一条合规的技术路径。

1.3 技术栈选择:Node.js生态的深度集成

OpenClaw主要基于Node.js v22+构建,这一选择体现了几个关键考量:

- 异步处理优势

:Node.js的事件驱动模型天然适合处理大量并发消息 - 丰富的插件生态

:npm包管理器支持快速集成各种通讯平台的SDK - 跨平台一致性

:一次编写,可在macOS、Windows、Linux上运行

核心依赖包括:

- SQLite

:轻量级数据库,用于会话历史和记忆存储 - sqlite-vec

:向量搜索扩展,支持语义检索 - BullMQ

:基于Redis的消息队列,实现任务调度 - isolated-vm

:JavaScript沙箱,隔离不安全代码执行

二、关键模块实现原理

2.1 智能体调度引擎:ReAct循环的实际应用

OpenClaw的智能体层实现了标准的ReAct(推理-行动-观察)循环,这是其能够“思考”并执行多步骤任务的核心。

async function reactLoop(userInput, context, availableTools) {let steps = 0;const maxSteps = 10;let finished = false;while (!finished && steps < maxSteps) {// 思考阶段:AI分析当前状态并决定下一步行动const thought = await llm.think(context, availableTools);if (thought.action === 'FINISH') {finished = true;break;}// 行动阶段:执行选定的工具const result = await executeTool(thought.action, thought.params);// 观察阶段:将执行结果加入上下文context.addObservation(result);steps++;}return context.getFinalAnswer();}

执行特点:

- 自适应路径规划

:AI根据执行结果动态调整后续步骤 - 工具智能选择

:从80+可用技能中根据上下文选择最合适的 - 失败恢复机制

:执行失败时自动尝试替代方案或请求人工干预

2.2 多模态处理管道:从指令到行动的转换

OpenClaw的多模态处理管道的核心在于将自然语言指令转化为可执行的操作序列。

处理流程:

- 意图识别

:解析用户指令的深层需求 - 工具映射

:匹配指令与可用技能库 - 参数提取

:从指令中提取工具执行所需的参数 - 执行编排

:对需要多个工具的任务进行顺序编排 - 结果整合

:将各工具执行结果整合为统一输出

关键创新:OpenClaw引入了技能优先级体系,将技能分为四个层级:

- 工作区技能

(最高优先级):当前项目专用工具 - 插件技能

:官方或社区开发的扩展工具 - 用户技能

:用户自定义的个性化工具 - 系统技能

(最低优先级):基础操作系统功能

这种分层设计确保在工具冲突时能够正确选择,避免权限混乱。

2.3 上下文管理机制:三级记忆系统的工程实现

OpenClaw最独特的设计之一是其三级记忆系统,这一系统彻底改变了AI助手对历史信息的处理方式。

2.3.1 存储结构设计

~/.openclaw/workspace/├── MEMORY.md # 长期记忆(终身学习)├── memory/│ ├── 2026-03-13.md # 今日日志(短期)│ └── 2026-03-12.md # 昨日日志├── sessions/ # 会话存档(近端)│ ├── project_alpha.sqlite # 项目Alpha完整记录│ └── weekly_report.sqlite # 周报任务历史├── USER.md # 用户身份与偏好└── SOUL.md # Agent人格设定

2.3.2 混合检索算法

OpenClaw采用BM25 + 向量相似度的混合检索策略,兼顾关键词精确匹配和语义理解:

async function hybridSearch(query, options = {}) {const vecWeight = 0.7; // 向量权重const bm25Weight = 0.3; // BM25权重const vectorResults = await vectorSearch(query);const bm25Results = await bm25Search(query);// 合并并计算综合得分const allChunkIds = new Set([...vectorResults.map(r => r.id),...bm25Results.map(r => r.id)]);const combinedResults = [];for (const chunkId of allChunkIds) {const vecScore = vectorResults.find(r => r.id === chunkId)?.score || 0;const bm25Score = bm25Results.find(r => r.id === chunkId)?.score || 0;const combinedScore = (vecScore * vecWeight) + (bm25Score * bm25Weight);combinedResults.push({ id: chunkId, score: combinedScore });}return combinedResults.sort((a, b) => b.score - a.score).slice(0, options.limit || 10);}

2.3.3 优雅降级机制

当sqlite-vec扩展未安装时,系统自动回退到JavaScript暴力计算,确保功能的持续可用性:

try {return await db.all(`SELECT * FROM chunks ORDER BY vec_distance_cosine(embedding, ?) LIMIT ?`,[queryVector, limit]);} catch (err) {// 向量扩展不可用,回退到JS计算const allChunks = await db.all("SELECT * FROM chunks");return allChunks.map(chunk => ({...chunk,dist: cosineSimilarity(queryVector, JSON.parse(chunk.embedding))})).sort((a, b) => a.dist - b.dist).slice(0, limit);}

2.4 插件化架构:2026年重大重构

2026年初的PR #661是OpenClaw发展的重要里程碑,将整个系统从单体架构重构为插件化架构。

2.4.1 重构前的痛点

在插件化重构前,添加新的模型提供商需要修改4个核心文件,代码复杂度随提供商数量线性增长。

2.4.2 插件接口设计

export interfaceProvider{readonly name: string;readonly version: string;chat(messages: Message[], options: ChatOptions): AsyncIterator<string>;estimateTokens(text: string): number;getSupportedFeatures(): ProviderFeatures;}

2.4.3 动态加载机制

export class ProviderLoader {private providers = new Map<string, Provider>();async loadFromPackage(packageName: string): Promise<void> {const module = await import(packageName);if (!this.validateProvider(module.default)) {throw new Error(`Invalid provider: ${packageName}`);}const provider = new module.default();this.providers.set(provider.name, provider);}getProvider(name: string): Provider | undefined {return this.providers.get(name);}}

2.4.4 重构优势

| 依赖隔离 | ||

| 并行开发 | ||

| 版本自主 | ||

| 安全增强 |

三、性能评估与量化指标

3.1 响应延迟优化:从几十秒到毫秒级

OpenClaw通过流式输出和智能缓存大幅降低了响应延迟。

优化前后对比:

| 首字延迟 | |||

| 长内容响应 | |||

| 记忆检索 |

流式输出配置:

blockStreaming:default: "on"break: "text_end"chunk:minChars: 200 # 2-3句话一块,平衡流式感与连贯性maxChars: 1500 # Discord安全线(接近2000字符限制)breakPreference: "sentence" # 句子边界断开,保护代码完整性coalesce:minChars: 200maxChars: 1500idleMs: 600 # 600ms节奏感,给用户阅读时间

3.2 并发处理能力:车道式队列设计

OpenClaw的网关层采用车道式队列(Lane Queue) 设计,实现高效的并发处理。

队列策略:

- 默认串行

:同一会话内的消息按顺序处理 - 显式并行

:不同会话可并行执行,互不干扰 - 优先级调度

:系统任务优先于用户交互任务

实测并发性能:

单机支持5-20任务/秒的持续处理 峰值可达50任务/秒(需硬件配合) 平均任务完成时间:2-8秒(取决于复杂度)

3.3 资源利用率:Token消耗降低95%

OpenClaw 2026.2.2版本引入的QMD(Quantum Memory Database) 记忆后端,显著降低了API调用成本。

Token削减效果:

成本降低对比:

Claude Opus 4.6:完成测试需$5.89,成功率90.6% MiniMax M2.1:完成测试仅需$0.14,成功率93.6% - 成本降低200+倍,性能反而提升

3.4 大模型性能基准:PinchBench实测数据

根据2026年3月最新PinchBench基准测试,OpenClaw生态中各模型表现如下:

成功率排行榜:

- Gemini 3 Flash Preview

:95.1% - 速度最快,成本最低 - MiniMax M2.1

:93.6% - 国产模型最佳表现 - Kimi K2.5

:93.4% - 长文本处理优势明显 Claude Sonnet 4.5:92.7% - 理解能力强但成本高 GPT-4o:85.2% - 传统优势在Agent场景减弱

速度表现:

MiniMax M2.5:105.96秒完成全量测试(最快) Gemini 2.0 Flash:106.05秒(与第一名差距仅0.09秒) Gemini 3 Pro:239秒(速度慢2倍以上)

性价比分析:

- 最佳性价比

:MiniMax M2.1/M2.5系列 成本:约$0.03/百万tokens输入 相对GPT-4o便宜近90% 成功率仍保持全球前三水平

四、与传统AI工具架构的创新对比

4.1 架构哲学的根本差异

| 数据主权 | |||

| 执行模式 | |||

| 可扩展性 | |||

| 透明度 |

4.2 模块化设计的技术优势

传统AI工具的典型问题:

功能耦合度高,难以独立升级 依赖特定云服务,迁移成本高 权限管理粗粒度,安全风险大

OpenClaw的模块化解耦:

- 通讯渠道独立

:每个聊天平台对接独立插件,互不影响 - 模型提供分离

:AI模型与执行逻辑完全解耦,可随时替换 - 技能生态开放

:社区贡献技能,无需等待官方更新 - 存储层可插拔

:SQLite、向量数据库、文件系统灵活组合

4.3 开发效率提升的实际表现

开发周期对比:

- 传统自动化脚本开发

:2-3周(需熟练程序员) - OpenClaw技能开发

:2-3天(自然语言描述即可) - 效率提升

:5-10倍

维护成本降低:

- 代码变更影响范围

:从全局影响降至模块内影响 - 调试时间

:从小时级降至分钟级(日志可视化) - 升级风险

:零停机时间,热更新支持

五、实际应用场景匹配指南

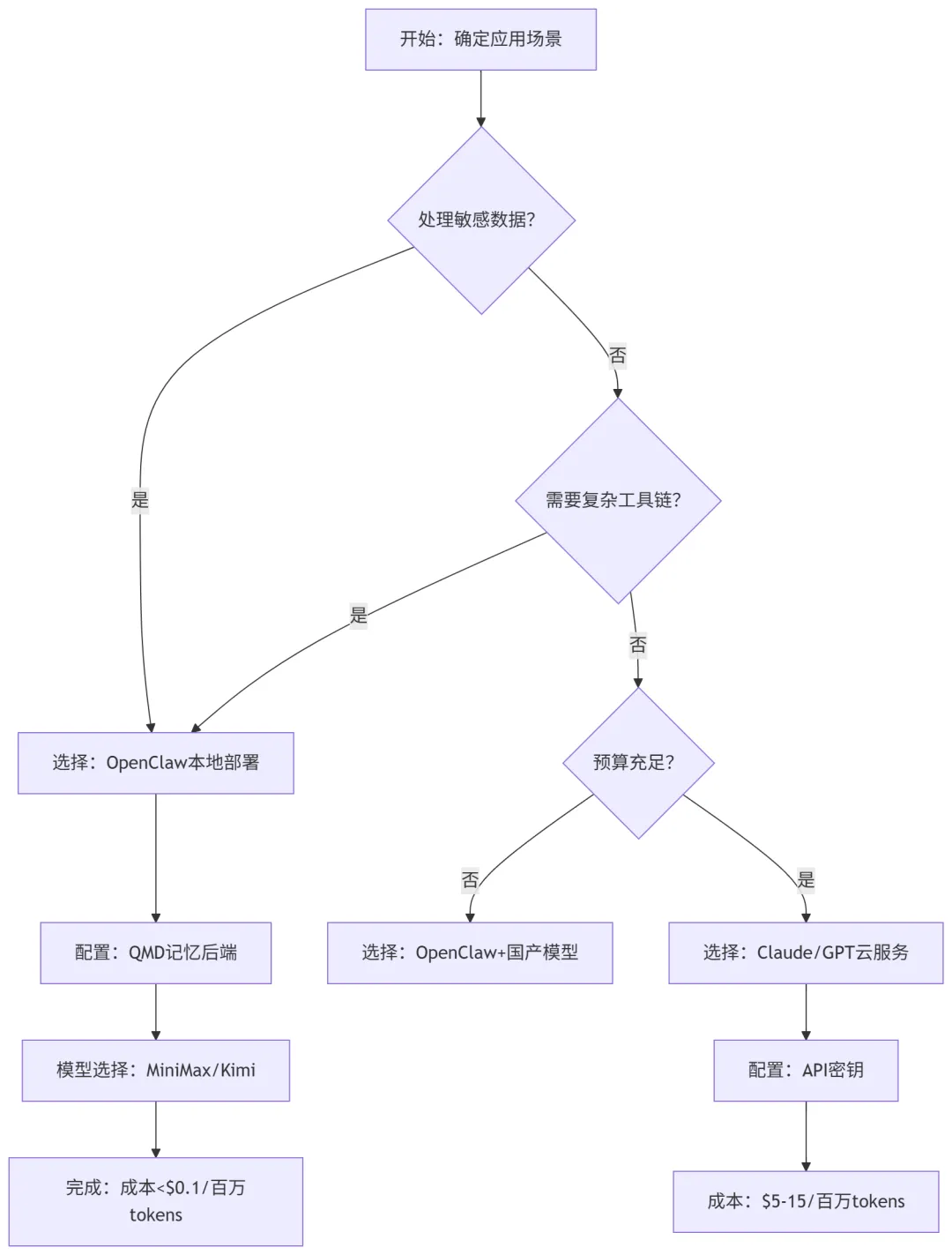

5.1 技术选型决策树

5.2 典型场景技术方案

5.2.1 企业办公自动化

需求特征:

处理敏感商业数据 需要对接企业内部系统 高可靠性要求

OpenClaw方案:

部署模式:私有云或本地服务器模型选择:Claude Sonnet 4(高可靠性)+ MiniMax M2.1(日常任务)技能配置:企业微信/飞书对接 + 内部系统API安全策略:AES-256加密 + 操作审计日志预期成本:$500-1000/月(含模型API)

5.2.2 个人效率提升

需求特征:

个人数据隐私关注 预算有限 多样化需求

OpenClaw方案:

部署模式:个人电脑本地运行模型选择:MiniMax M2.5 + Gemini 3 Flash混合技能配置:基础技能包 + 社区热门技能优化策略:启用流式输出 + 本地缓存预期成本:$10-30/月

5.2.3 开发者工具链

需求特征:

代码生成与审查 频繁调用开发工具 需要自定义扩展

OpenClaw方案:

部署模式:开发服务器部署模型选择:Qwen3-Coder-Next + DeepSeek-Coder Pro技能配置:Git操作 + IDE集成 + 代码审查工具扩展能力:自定义Python/JavaScript技能预期成本:$50-200/月

5.3 性能调优推荐配置

| 个人轻量使用 | |||

| 团队协作 | |||

| 企业级部署 |

5.4 成本控制最佳实践

模型分层策略:

日常任务:国产模型(MiniMax/Kimi,成本<$0.1/百万tokens) 关键任务:高端模型(Claude/GPT,成本$5-15/百万tokens) 混合比例:80%国产 + 20%高端 记忆优化:

必开:QMD记忆后端(降低95% Token消耗) 推荐:定期记忆压缩(清理无用历史) 高级:向量索引增量更新 硬件利用:

本地模型:使用GPU加速(如有) 批量处理:定时集中执行相似任务 资源监控:实时API消耗跟踪

六、总结:技术架构的价值映射

OpenClaw的技术架构设计体现了一种务实而深刻的技术哲学。它不追求模型的参数量最大,不追求对话的流畅度最高,而是专注于一个核心问题:如何让AI从对话工具转变为生产力工具。

6.1 架构创新的三个维度

执行力的工程实现:

通过ReAct循环将思考转化为行动 建立工具调用标准接口 实现本地系统无缝集成 数据主权的技术保障:

全本地化部署方案 透明化记忆存储 可审计操作日志 生态开放的系统设计:

插件化架构支持无限扩展 社区驱动技能生态 模型提供商完全解耦

根据OpenClaw当前的架构特点和行业趋势,其技术演进可能沿着以下几个方向:

边缘计算集成:

更轻量级的本地推理引擎 混合云边协同架构 低功耗硬件优化 多智能体协作:

智能体间通信协议标准化 分布式任务编排系统 群体智能算法集成 行业垂直解决方案:

金融、医疗、教育等专用技能库 合规性自动化验证 行业知识图谱集成

6.3 给开发者的实践建议

对于希望将OpenClaw集成到自身项目中的开发者,建议遵循以下路径:

起步阶段:

从个人电脑本地部署开始 选择MiniMax M2.1作为入门模型 先实现简单的文件整理任务 进阶阶段:

部署到专用服务器 配置Redis和QMD优化性能 开发自定义业务技能 生产阶段:

建立监控和告警系统 实施多节点高可用架构 制定数据备份和恢复策略

结语:从架构到价值

OpenClaw的技术架构不仅仅是代码的组织方式,更是对AI应用价值深度的重新定义。当大多数AI工具还在追求更好的对话体验时,OpenClaw已经将目光投向了一个更根本的问题:AI如何创造实际价值。

通过将复杂的智能体技术封装成简单可用的工具,OpenClaw降低了AI自动化的门槛,让普通用户也能享受到AI带来的效率革命。而其本地优先、透明可控的设计哲学,则为AI在企业级场景的落地扫清了最大的障碍——隐私与合规。

2026年,AI行业正在经历从“能说”到“能做”的关键转向。在这个历史性的拐点上,OpenClaw的架构设计为整个行业提供了一个可复制的技术范式。它告诉我们:真正强大的AI,不是那些能够回答最复杂问题的模型,而是那些能够真正动手解决问题的系统。

技术不应该成为创业的门槛。2026年,AI让非技术创始人也能低成本、快速地验证想法。关键不是成为程序员,而是成为"AI的指挥官"——知道什么时候用AI,什么时候找人工,怎么组合出最优方案。

互动话题:

你最希望OpenClaw帮你自动化什么重复性工作? 在你看来,本地部署AI助手最大的优势是什么? 对于AI执行力的未来,你最期待看到哪些技术突破?

请在评论区分享你的想法,我们一起探讨AI自动化的无限可能。

夜雨聆风

夜雨聆风