龙虾爆火

马年最火的动物不是马,而是龙虾。

过去几年,大家也在谈 AI,谈大模型,谈生成式工具。它们会写文案,会做表格,会改代码,会总结材料,看上去已经很强了。但多数时候,这种强还停留在“助手”的范畴里。你知道它能帮你省事,能替你起个头,能把原本繁琐的工作压缩到几分钟,可你心里还保留着一道边界:最后拍板的是人,真正把事情推进下去的还是人。

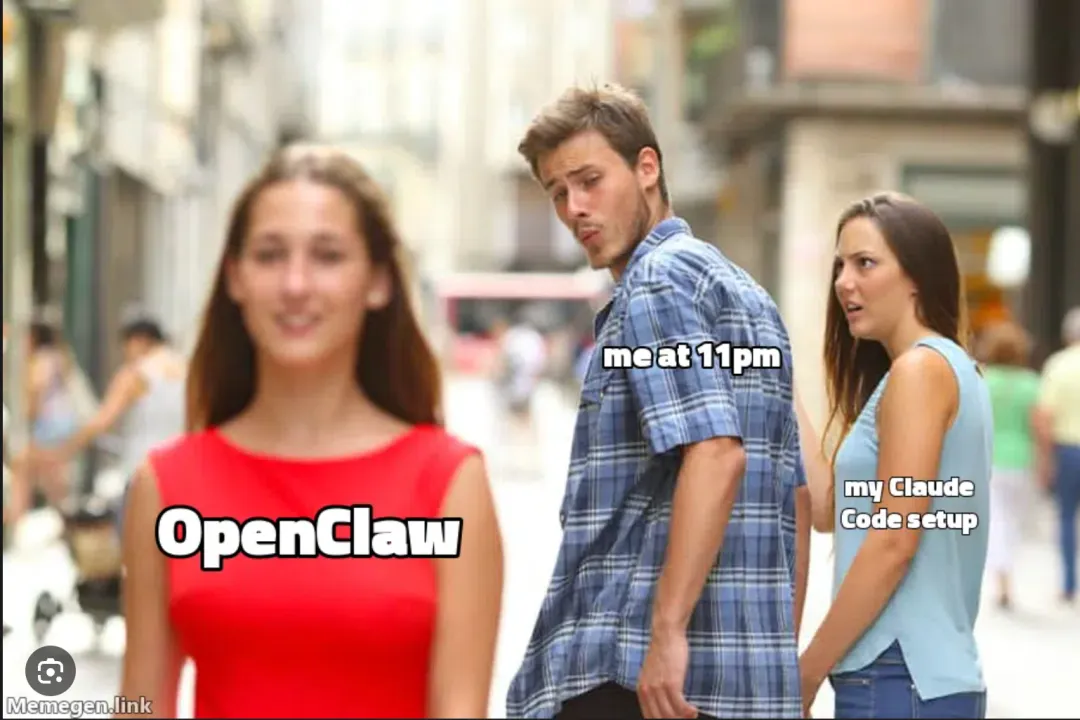

OpenClaw 让这道边界松动了。

它引发关注,当然有技术层面的原因,但真正击中人的地方,恐怕还不在技术指标本身。它带来的冲击很直接:AI 开始从“提供答案”走向“接手流程”,从“辅助工作”走向“进入岗位”。它不再只是坐在聊天框里等你发问,而是在越来越多的场景里,显露出一种可以被当成“执行者”的样子。

这件事带来的心理震动,比任何一次模型参数升级都要大。模型更会说话,大家会惊叹;模型开始做事,大家会紧张。前者像工具升级,后者像劳动关系在悄悄变化。

所以 OpenClaw 的热度,本质上并不只是围绕一个产品。它点燃的是一种更普遍的感受:很多原本默认需要人来完成的工作,正在变得可以被拆解、被代理、被自动推进。人们担心的从来不只是一篇文章写得比自己好,或者一段代码补得比自己快。真正让人坐不住的,是某一类岗位存在的理由,开始变得没有以前那么稳固了。

最先受到冲击的,往往也不是那些依赖长期积累、复杂判断和强责任承担的位置。先被波及的,通常是流程清楚、目标明确、结果容易衡量的工作。初级助理、基础运营、文档整理、客服支持、标准化分析、信息检索、常规汇报、部分初级开发任务,这些工作过去需要人坐在工位上,一步一步完成,如今却越来越像一组可被编排的动作。

很多岗位不会立刻消失,但岗位里的内容会先变。一个人原本靠搜集信息、整理材料、生成汇报、跨系统搬运数据来体现价值,接下来这些事情会越来越多地被工具接手。留下来的那部分,分量反而会更重:知道什么该做,知道先做哪一件,知道哪些信息值得相信,知道一份结果里真正有用的是什么。事情的核心慢慢从“有没有产出”转向“这份产出到底值不值得要”。

这一点,放在自己的工作里看,会更清楚。

很多人现在都有类似的感受:原来要花大量时间铺垫的工作,今天很快就能得到一个像样的版本。资料可以迅速汇总,框架可以快速搭起,文稿可以一轮成型,代码能直接生成一个可运行的雏形。效率当然提高了,可提高效率只是表层变化。更深一层的变化在于,那些曾经构成门槛的能力,正在变成默认配置。你会写,不再稀缺;你会查,也不再稀缺;你能把一个八十分的初稿弄出来,这件事本身正在迅速贬值。

真正拉开差距的地方,慢慢挪到了更前面,也更深一些。问题怎么定义,材料怎么取舍,目标怎么校正,风险怎么判断,哪些地方值得反复推敲,哪些地方应该尽快放下,很多时候决定成败的都不在执行端。执行越来越像流水线,判断越来越像分水岭。

这也是为什么,越往后看,越觉得“AI 取代人”这句话说得太粗了。更准确一点的表述,应该是:它先拿走了人身上那部分最容易被标准化的能力。记忆、检索、归纳、套模板、生成初稿、完成常规性表达,这些事情曾经值得被反复训练,也确实帮助很多人进入工作世界。可一旦工具把它们做得足够好,它们的市场价值就会迅速下滑。

可人的价值并不会因此自动升高。很多人真正焦虑的地方也在这里:旧的门槛塌得很快,新的门槛却不那么容易长出来。过去靠勤奋和熟练就能建立起来的优势,接下来未必还能维持。你会发现,自己需要的不再只是更快地做事,而是更清楚地知道事情本身值不值得做。

taste

说到这里,就绕不开一个词:taste。

这个词这些年被说得太轻了,轻到像一种审美偏好,像对风格、品位、趣味的装饰性表达。放在 AI 时代,它的分量其实很重。所谓 taste,放在工作和研究里,接近一种对重要性的感知能力。它关系到你看问题的角度,关系到你如何判断轻重缓急,关系到你会不会被表面的热闹牵着走,也关系到你在一堆看似都能做的事情里,究竟愿意把时间押在哪一件上。

同样的工具给不同的人,结果差得很远。有人拿着它加速重复劳动,有人拿着它开出新的工作方法;有人只是在原有流程上节省几个小时,有人已经开始重写整个流程。差别当然和经验有关,和训练有关,也和行业位置有关,但归根到底,还是看一个人有没有能力辨认出真正重要的那条线。工具越来越趋于平等,认知上的高低差会显得越来越刺眼。

这类差别,在学术研究里也格外明显。为什么有的人能在一个方向还不热的时候提前下注,为什么有的人总能看见某个问题背后更长的趋势,为什么有的人手里的工具并不特别,却能做出让同行服气的东西。这里头固然有资源、有机遇、有长期积累,可最后总有一个无法完全还原成方法论的部分。你可以叫它 taste,也可以叫判断力、方向感、问题意识。名字不重要,重要的是它开始比从前更值钱了。

我还记得我在公司第一次做交易系统的时候花了几个月才正式跑起来,现在在GPT 5.4 xhigh的帮助下,我只用了三天就做到了同样的,甚至代码风格一致性更强的股票柜台。但回过头来看,我并不认为曾经的几个月是浪费了的,因为他帮助我积累了taste,这些事情是模型之外的。

教育通向何处?

一旦这一点变得清楚,教育问题就会被重新摆到台面上。

如果 AI 已经能够接管越来越多标准化的知识劳动,那么教育到底还在培养什么?如果学生未来面对的是一个“会写、会算、会搜、会整合”越来越容易获得的世界,学校继续把大把精力放在训练他们产出格式工整、结构完整、看上去很像那么回事的作业和报告上,意义就会越来越可疑。那些东西并非毫无价值,但它们已经不适合继续被视作能力的核心凭证。

更麻烦的是,教育里最容易被替代的,恰好也是最容易被量化、最容易被考核的部分。写一篇作业,交一份报告,做一套标准题,老师容易批改,学校容易管理,学生也容易适应。可一旦 AI 能把这些事情做得很像样,教育就不能再假装原来的评价体系还足够有效。形式上的完成,和真实的掌握,今后会越来越不像一回事。

这时候,基础教育和高等教育的问题会同时暴露出来,只是暴露的方式不一样。

基础教育真正该守住的,还是那些最朴素、也最费时间的东西。读写能力、逻辑能力、计算能力、基本体能、协作能力、面对真实问题时的稳定心智,这些东西看上去不炫,也很难包装出一种“前沿感”,但它们决定了一个人今后能不能站得住。很多人在谈 AI 赋能教育时,容易把“学习提速”理解成“成长提速”。知识接收当然可以加快,讲解当然可以更个性化,练习当然可以更高效,但一个人长成什么样,并不会因为外部工具变强就被大幅压缩。人成熟得很慢,这件事并没有因为技术进步而改变。

还有一个常被忽略的问题:很多低层次、重复性的训练,恰恰是初学者建立理解能力的必经之路。孩子一开始学写作、学数学、学表达,过程里有很多笨功夫,很多重复,很多枯燥时刻。今天看,这些环节很容易被工具替代,甚至有人会觉得,既然计算器都在手边了,何必再去死磕算术;既然 AI 能生成作文,何必还让学生自己磕磕绊绊地写。可一旦这些过程被整片拿掉,留下来的往往不是更聪明的人,而是更依赖工具的人。工具可以帮你跳过一部分劳动,也可能让你失去建立结构感、建立直觉、建立自我判断的机会。

学校之所以重要,也从来不只是知识传递。它首先是一个社会化场所。人在里面学会与他人相处,学会等待,学会表达,学会合作,也学会面对冲突和挫败。AI 可以给出答案,却替代不了同伴关系、真实互动和共同成长带来的塑造。基础教育越往后走,越会显出这一层价值。

到了高等教育,问题会变得更尖锐一些。大学原本承担着更专业的训练任务,也承担着向社会输送人才的责任。可在 AI 介入之后,传统的考核和培养方式都开始显得摇晃。论文、作业、课程报告、总结陈述,这些材料过去多少还能在一定程度上反映学生的理解和能力,如今却越来越难判断里面到底有多少是学生自己的东西。不是说这些形式应当彻底取消,而是说,它们已经不够了。

高等教育接下来势必要重新重视那些更能识别真实水平的方式。闭卷考试会重新获得地位,因为它粗糙,却有效;口试会重新变得重要,因为一问一答之间,很难长期伪装;过程性评价也会更有分量,因为一个人是如何思考、如何修改、如何回应质疑的,往往比最后交上来的那个成品更能说明问题。一个有经验的老师,听学生解释几个关键决策,问几个追问,通常就能看出来这个学生有没有真正理解问题。

可大学面临的难题,并不只在考核端。更大的挑战来自实践端。过去很多人是在大量基础性、入门型的工作中慢慢成长起来的。实习、助研、协助项目、参与团队里的边角任务,这些看上去不那么光鲜,却构成了一个年轻人进入专业世界的坡道。现在,AI 正在加速吞掉这段坡道。企业会更倾向于直接要成熟劳动力,或者让工具承担掉一部分原本交给新人练手的任务。结果就是,年轻人上手的机会变少了,成长链条中间那段原本最关键的缓冲地带,也可能越来越薄。

这意味着,学校必须承担起更多原本由社会和企业分担的培养责任。大学不能只提供课程,然后默认能力会在外部世界自然长出来。在面试的过程中,我见识了很多应届生的迷茫。他们从清北这样的名校,拿到非常好的GPA,但是不知道自己能做什么。接下来的培养,很可能要把更多真实项目、长期设计、问题导向的训练重新拉回校园。毕业设计也许不该只是最后仓促完成的一篇论文,而应当变成一段更长时间、更贴近真实问题的工作过程。学生在这个过程里面对的,应该不只是“写出来”,而是“做出来”“想明白”“解释清楚”“承担后果”。

AI 在这里并非完全扮演威胁的角色。恰恰相反,它也可能成为教育改革的一部分条件。借助 AI,学校有机会构造更复杂、更接近真实世界的实践环境,让学生在较低风险的条件下接触高复杂度问题。过去很多训练做不到,不一定因为没有想法,而是因为成本太高、资源太稀缺、现实风险太大。现在,这一层条件正在被改写。问题不再是能不能用 AI,而是有没有能力设计出一套真正有教育价值的使用方式。

当知识调用越来越廉价,标准化产出越来越容易,人的成长还应该靠什么来支撑。这个问题不会因为多加几门 AI 课程就自动解决,也不会因为把作业都改成让学生用 AI 完成就显得更现代。跟风开放几个人工智能的专业,并不是一个负责任的行为。

未来的教育,大概很难再把目标设定为培养“做得比 AI 更快的人”。这个方向本身就不现实。教育更应该做的,是培养那些在工具极其强大的情况下,仍然不会轻易被工具带着走的人。这样的人未必每一步都比机器快,但他知道自己为什么出发,知道什么值得坚持,知道什么时候该怀疑一份看上去完美的答案,也知道什么时候该在混乱里继续往前走。

OpenClaw 的爆火,让很多人感到的是岗位压力;顺着这条线往下看,最后会发现,它真正逼近的,其实是教育的核心问题。一个时代越依赖强工具,越需要那些能守住基本能力、能做出判断、也能承担责任的人。教育最终要培养的,恐怕还是这样的人。

夜雨聆风

夜雨聆风