为什么选择虚拟机安装?

虚拟机安装OpenClaw有很多优点,感觉是 现阶段最适合小白的本地部署方案,可以实现数据隔离、隐私安全、快照还原、可以随意折腾,帮助新手小白反复练习和使用龙虾。并且相较于云端,便于传输文件,可以一次性拖给龙虾上百个文件让其依次处理,甚至可以多开虚拟机,同时养多只龙虾,协同工作等。

本教程中还包含接入2个免费大模型的方法,基本可以满足新手体验使用,以及对接飞书的方法,让龙虾融入你的日常工作。

这里录制了详细的视频演示步骤

现阶段,龙虾安装环节是使用龙虾过程中最简单的一环了,这个步骤省了,大概率使用过程中会还回来的,因为有了安装龙虾经验,命令行的操作我们就熟悉了,后续遇到异常,问问AI,基本能够自行处理。如果大家真的想玩转龙虾,原生的安装方式,希望大家一定要体验一遍。

安装虚拟机

启用cpu虚拟化

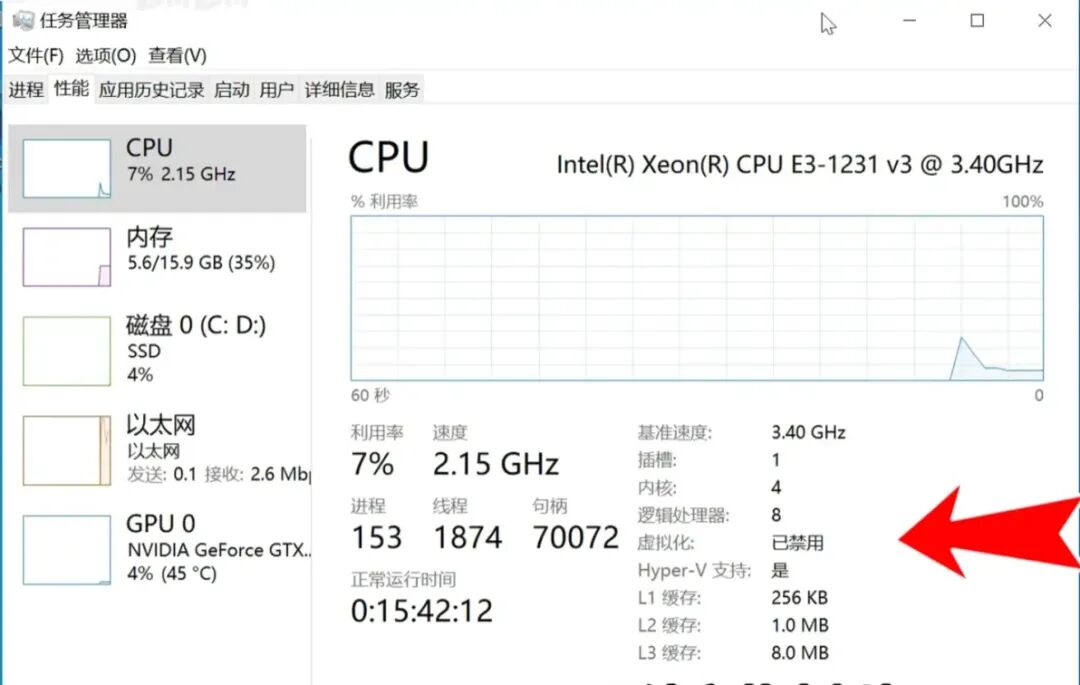

鼠标右键底部任务栏,找到任务管理器并打开,在任务管理器中,点击“性能”,再点击CPU,如果我们看到这里有一个"虚拟化”的选项,那么我们就可以通过虚拟机的方式安装OpenClaw。

如果没有该选项,则说明你的机器大概率无法安装虚拟机,只能选择直接本地安装或云端养虾。

如果你的虚拟化显示为“已关闭”则需要进入BIOS中进行开启,

进入BIOS最简单的方式就是看开机提示,最下面一行会提示我们连续按什么键能进入BIOS。

大多数机器都是在开机时通过不停的按Del键或F2进入的。

设置虚拟化,不同品牌的主板,不同的CPU,略有不同。因此我们可以在成功进入BIOS后,将BIOS的画面拍成照片,发给任意的AI助手,然后问她“如何开启CPU虚拟化”,这样我们就可以轻松配置了。

安装VitrulBox

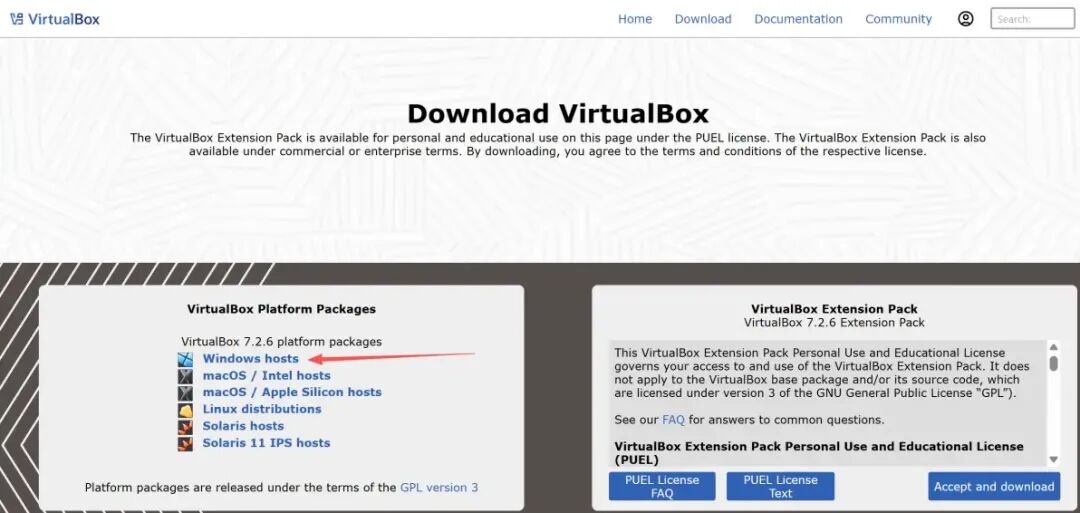

安装虚拟机,我们需要准备两个软件,一个是虚拟机VitrulBox,还有一个是Ubuntu桌面版的系统镜像。这两个都可以在其官网下载,如果找不到,请对你的AI助手说,给我提供VitrulBox和Ubuntu的下载地址。

在VirtulBox的官网,我们先点击Download,然后再点击windows Host即可开始下载。

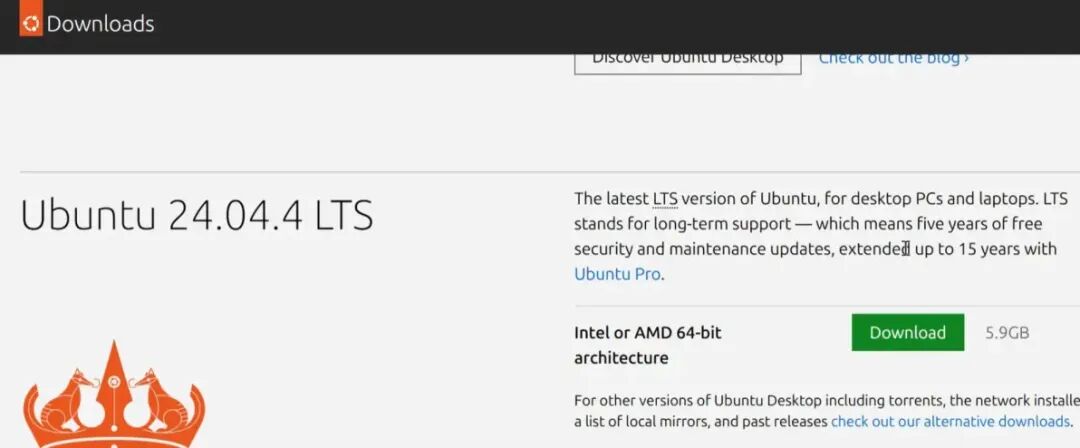

同理,在Ubuntu官网,我们点击顶部的DownLoad Ubuntu,然后选择24.04桌面版进行下载

在安装虚拟机时,如果提示缺少Microsoft Visual C++, 我们可以直接要求AI助手为我们提供其微软的下载地址,然后找到X64这个选项,点击下载,然后安装即可。

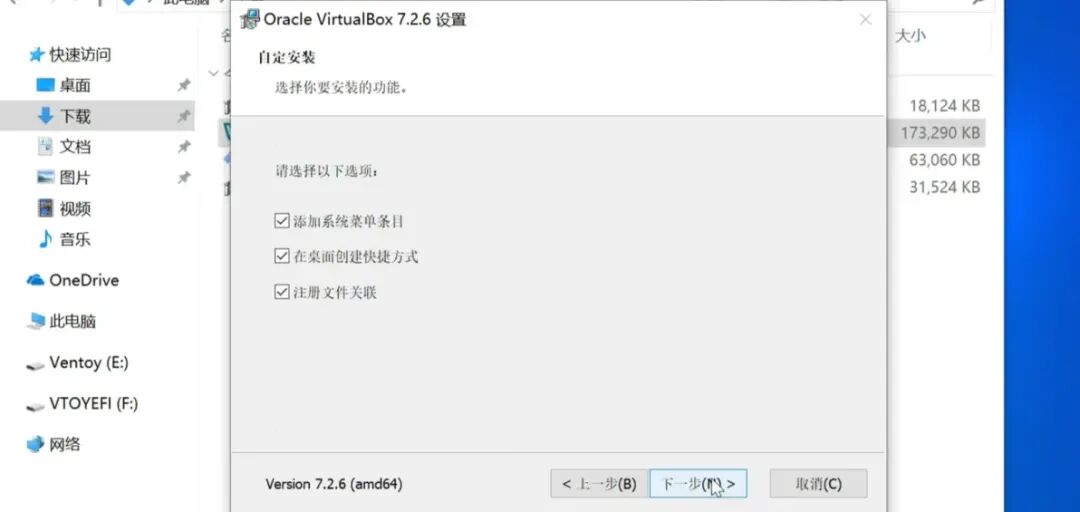

双击VirtualBox安装程序开始安装虚拟机,我们一直点击下一步即可。

安装Linux系统

接下来,我们开始在虚拟机中安装Linux系统,我们这里用的是Ubuntu桌面版,我们点击“创建一个新的虚拟机”,输入虚拟机名称,虚拟机文件夹可以自行设置,我这里保持默认。

接着选择ISO映像文件,也就是我们此前下载的Ubuntu24.04的后缀为iso的文件。

我希望手动安装Ubuntu系统,所以这里取消勾选 “继续进行无人值守安装”。

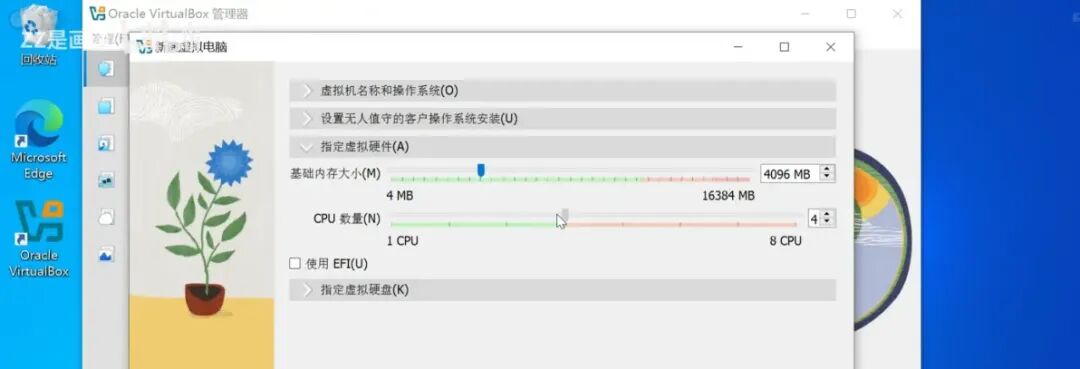

指定内存大小建议为4GB,CPU数量4个,注意,这里内存最低为2GB,CPU最低为2个,不要超过自身物理内存和CPU数量。

指定虚拟硬盘大小,不需要很大,我这里大约给了30GB。

其他保持默认,点击完成。

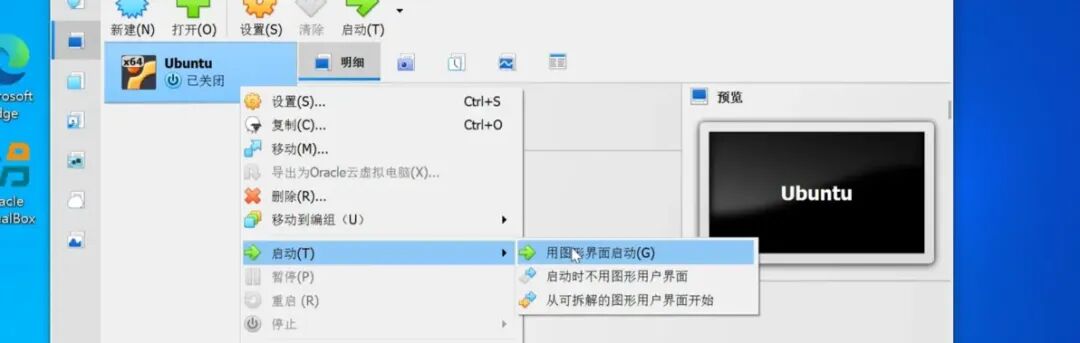

接着右键我们创建的虚拟机,选择启动,用图像界面启动。

此时会启动Ubutu镜像,如果我们点击虚拟机内的画面,会锁定鼠标键盘,取消锁定的快捷键是右Ctr+C,注意是右侧的Ctrl。

我们选择第一个Try or install Ubuntu

然后进入安装选项页面,语言选择“中文简体”、键盘布局选择汉语,选网络选择使用有线连接、安装程序更新这里我们跳过,因为如有需要,后续我们可以在系统中自行更新。

选择安装Ubuntu,选择默认集合,推荐软件这里,我们什么也不用勾选,直接下一步。

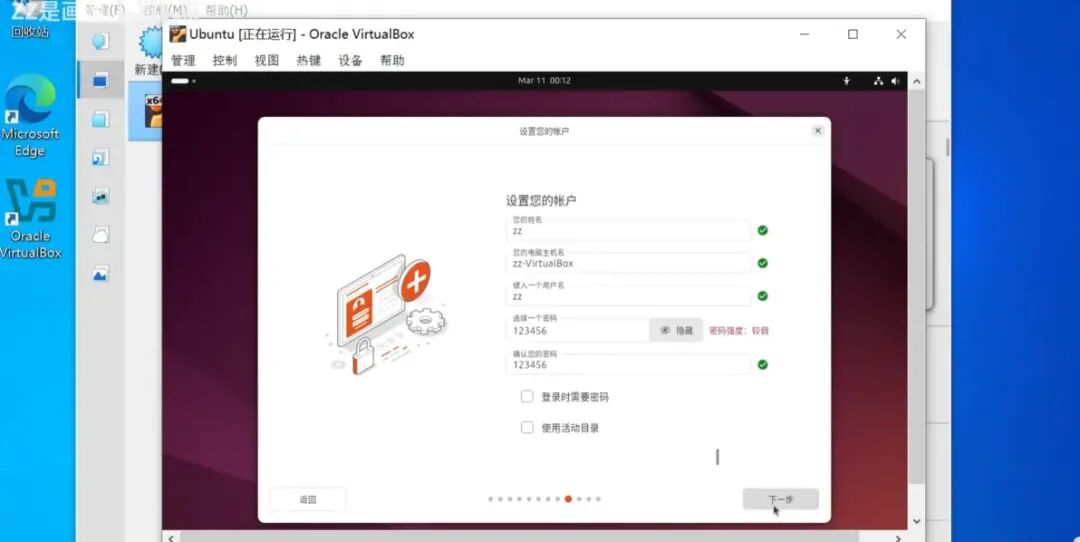

安装方式选择擦除硬盘,设置用户名和密码,这里的密码一定要记好,后续会用到。

取消登陆时需要密码。然后点下一步、下一步,然后开始安装,这里安装需要耐心等待一段时间。

安装完成后,我们点击立即重启。

安装增强功能

接着我们再来安装增强功能,这样我们就可以实现在宿主机和虚拟机中无缝复制粘贴。

我们点击设备将共享粘贴板设置为“双向”,将拖放设置为“双向”。

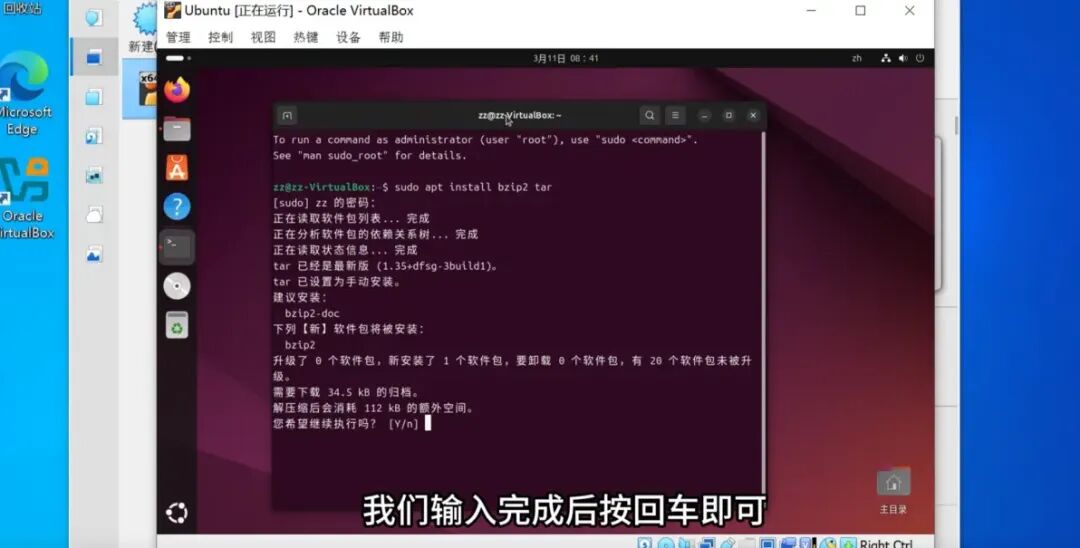

接着我们点击左下角的显示应用,然后点击终端,输入这行命令

sudo apt install bzip2 tar然后输入我们的密码,等待一会后,再输入y回车。

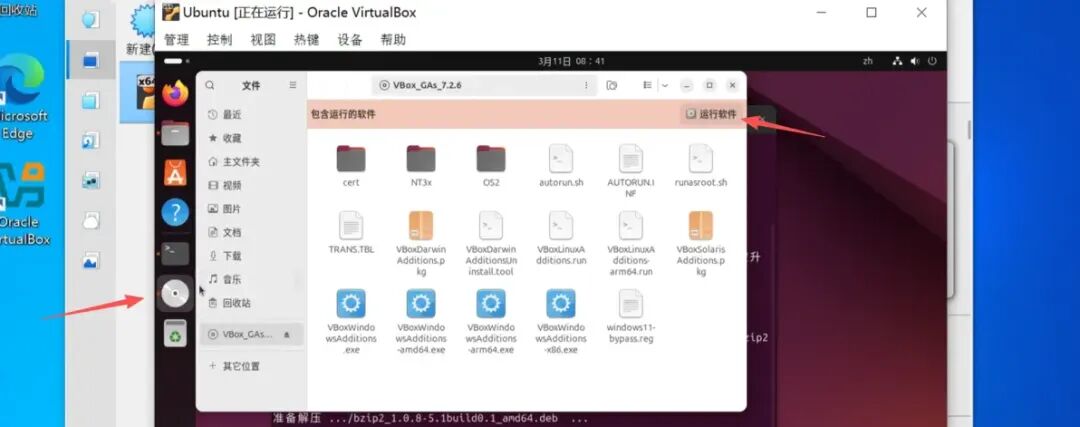

然后点击 设备,选择 安装增强功能。

然后点击侧边栏的圆形光盘图标,点击右上角的运行软件按钮。

再次输入密码,等待处理完成后,我们点击右上角,进入设置,将分辨率调整到一个合适的数值。

重启一下。

现在我们就可以在宿主机和虚拟机之间无缝复制粘贴了。

安装龙虾OpenClaw

更新系统并安装基础工具

首先第一步,我们要更新系统并安装基础工具。

这里有两行代码,我们依次执行。

sudo apt update && sudo apt upgrade -y注意,在Ubuntu系统中,粘贴的快捷键是Shift+Insert

运行时需要我们输入密码,然后回车。

等待一会后,我们再输入第二行命令

sudo apt install -y curl git build-essential安装SSH(可选)

接着是可选的ssh服务,因为我们是用虚拟机直接运行在了本地,再用ssh来访问,有些多余,毕竟我们可以直接操作虚拟机,已经十分方便了,而ssh需要命令行操作,这里我们就先不安装了,后续大家如果部署到服务器,可以再安装。

安装并启动 SSH 服务 (可选)

sudo apt install -y openssh-serversudo systemctl status sshsudo systemctl start ssh获取局域网 IP 地址

ip addr show | grep -E "inet " | awk "{print $2}" | cut -d"/" -f1 | grep -v "^127"免密使用sudo(可选)

还有一个可选的命令是sudo visudo,这个可以允许免密使用sudo命令。在你还没玩明白龙虾前不建议你装,安装命令就在这里,可以等你真需要了再装。

sudo visudo在最后一行增加(替换 用户名):

用户名 ALL=(ALL) NOPASSWD: ALL按 Ctrl+X,再按 Y,最后按回车保存退出。

安装Node.js

这里我们重新打开一下终端,然后开始安装Node.js

我们将下载命令复制粘贴到终端,然后回车

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash - && sudo apt install -y nodejs输入密码,等待安装完成。

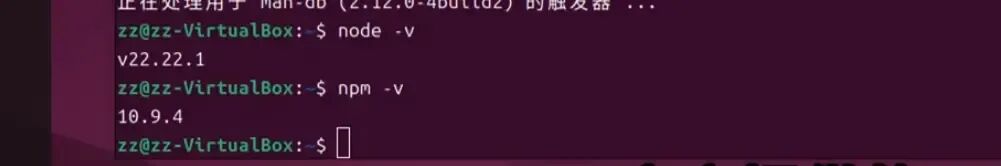

接着我们输入node -v来验证安装。

node -v如画面所示,输出了版本号,即为安装成功,同样的输入npm -v 输出版本号,即为成功。

npm -v安装OpenClaw

接着,复制这条官方提供的OpenClaw安装脚本

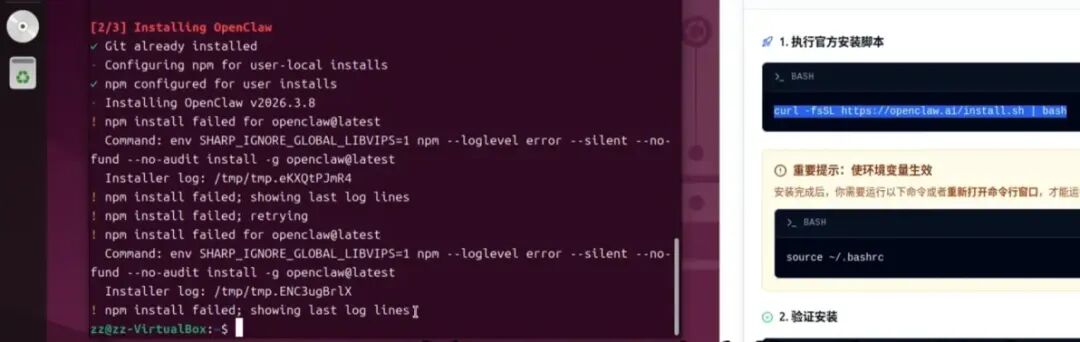

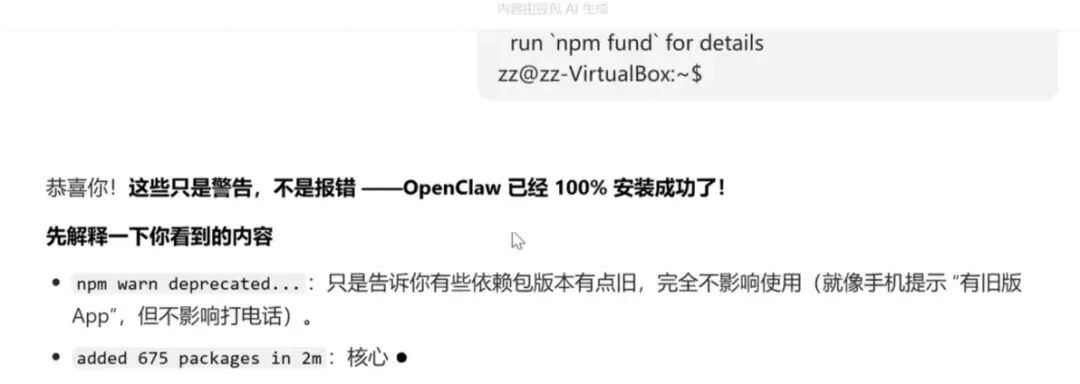

curl -fsSL https://openclaw.ai/install.sh | bash可以看到这里报了多条带有叹号的错误。

现阶段OpenClaw在安装和使用过程中遇到报错非常正常,我们只需把报错信息复制或拍照发送给AI聊天助手,让他们给出解决方案。

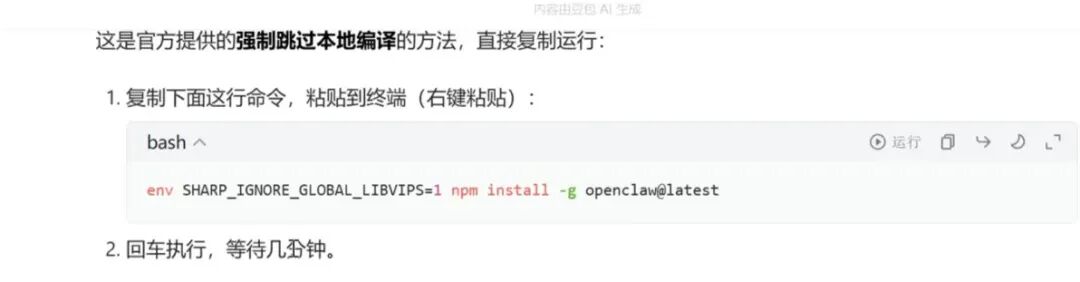

我们复制AI给出的解决方案,来运行下。

运行完成后,把运行结果再发给AI,让AI来判断我们是否安装成功。

它这里说我们修复成功了,这样的话,可以打开龙虾的面板来测试下是否真的安装成功。

不过在此之前,我们需要输入一次source ~/.bashrc或者重新打开一下终端才行。

source ~/.bashrc然后我们就可以使用OpenClaw onboard来启动一下龙虾的面板看是否成功了。

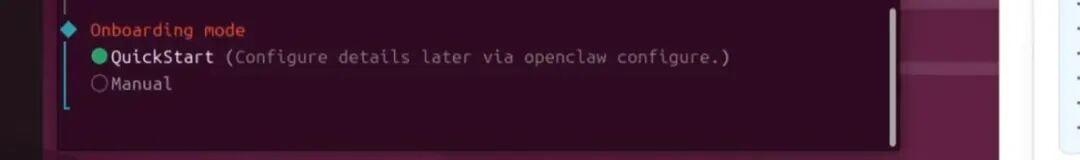

openclaw onboard此时会让我们先对龙虾进行配置,我现在选择yes,然后再选择QuickStart

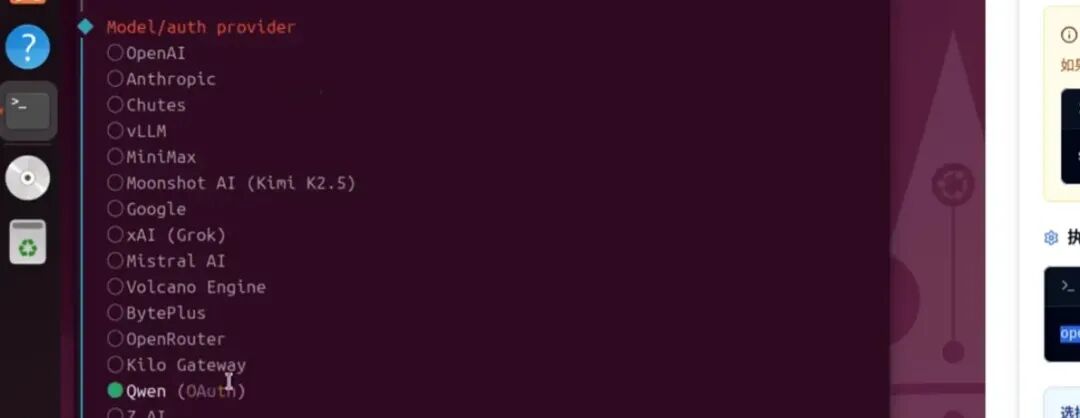

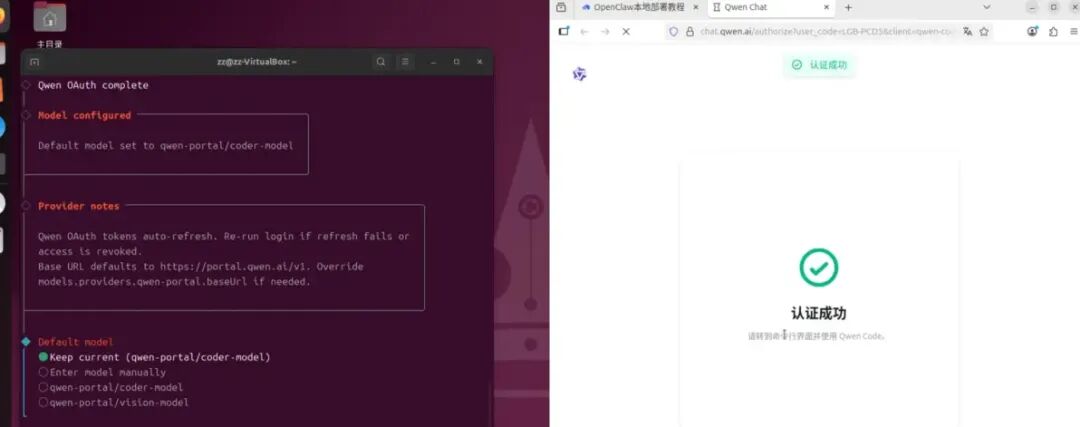

然后是模型选择,这里我们选择Qwen,因为Qwen可以白嫖一定的免费额度

此时它会弹出一个授权页面,这里我们注册登录一下。

如果网页没有自动打开的话,也可以把命令行中的https到code为止的这段地址,复制到浏览器中打开。

接着我们选择Keep current 保持当前。

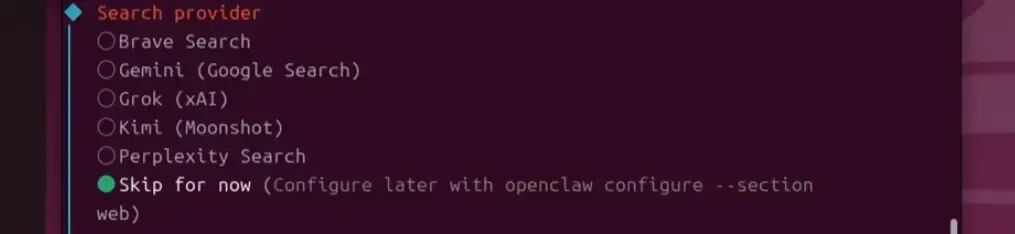

然后是选择用什么聊天软件跟龙虾沟通,这里我们选择Skip for now先跳过,一会再来配置。

搜索引擎这里也跳过Skip for now,

配置技能这里也先跳过,选择No,

因为这些都是我们后续使用中,可以等用到了再通过跟龙虾对话来安装的。没必要现在装。

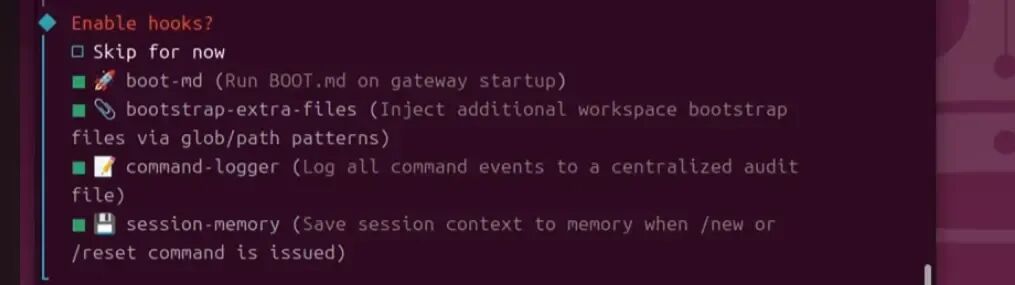

然后hooks这里不要跳过,这是当遇到问题时如何处理的方式,我们通过按空格的形式把它都选上。

配置API

配置免费API

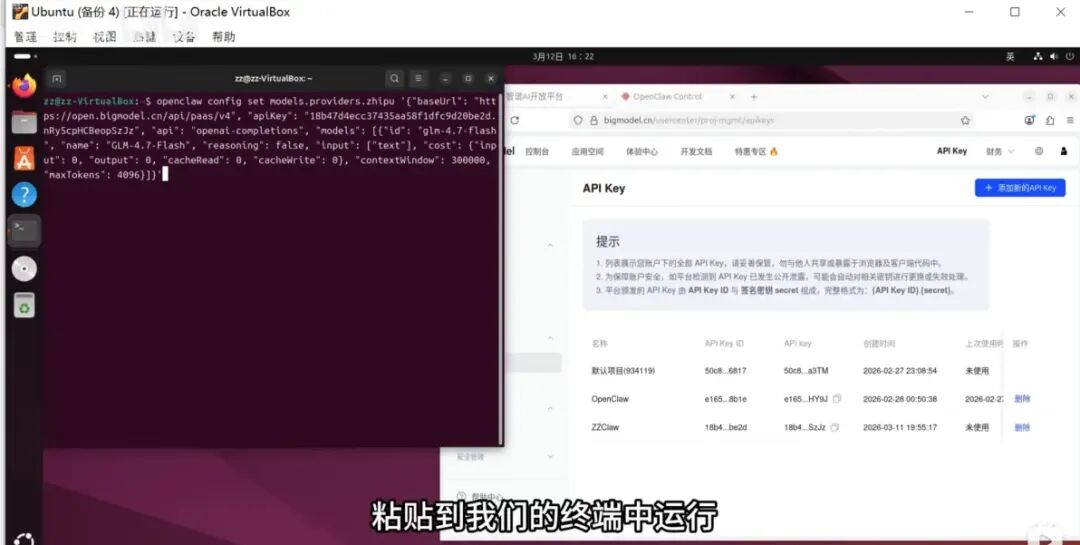

因为Qwen有额度限制,只有一个肯定不够用,所以我们安装第二个可以白嫖的模型,智谱的GLM-4.7-FLASH,这里我给大家准备了一个一键安装命令。其中“你的KEY”需要去智谱开放平台获取一下。在智谱开放平台,点击右上角控制台,再点击API Key,点击添加新的API Key,然后复制API key

我这里整理了配置命令,只需要替换下你的KEY,依次在Ubuntu的终端中执行以下步骤,即可配置API Key

1. 添加智谱 Provider(包含免费模型)

执行以下命令:

记得用刚才获取的API key 替换下方命令中的“你的KEY”

openclaw config set models.providers.zhipu '{"baseUrl": "https://open.bigmodel.cn/api/paas/v4", "apiKey": "你的KEY", "api": "openai-completions", "models": [{"id": "glm-4.7-flash", "name": "GLM-4.7-Flash", "reasoning": false, "input": ["text"], "cost": {"input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0}, "contextWindow": 300000, "maxTokens": 4096}]}'2. 加到 Fallback 列表

openclaw config set agents.defaults.model.fallbacks '["qwen-portal/coder-model", "zhipu/glm-4.7-flash", "zhipu/glm-4-flash", "zhipu/glm-4"]'3. 重启生效

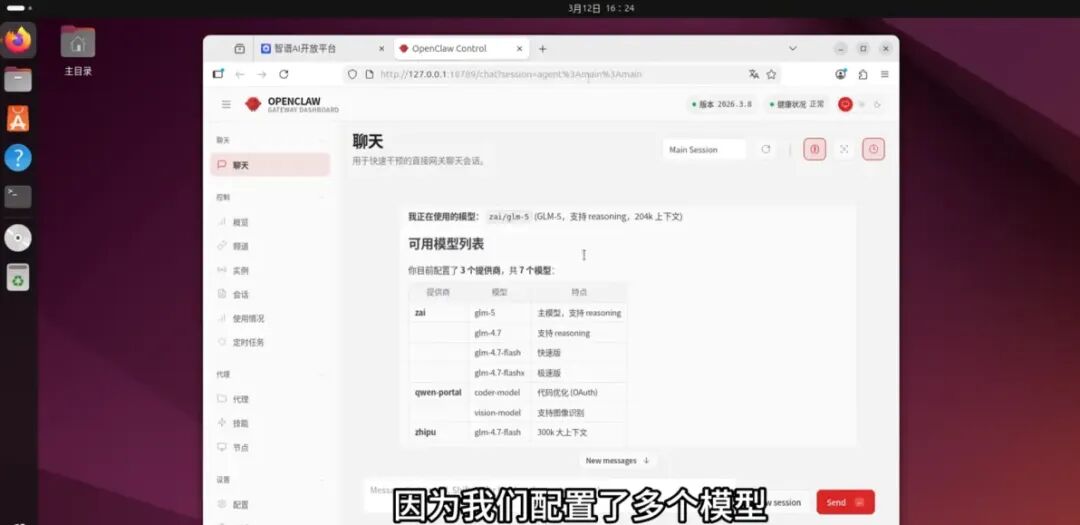

openclaw gateway restart然后我们可以询问龙虾当前所用的模型,因为我们配置了多个模型 ,因此当某个模型失效后,可以自动切换。

配置付费API

配置付费API的可选就更多了,这里仅做演示,而非推荐。

这里以MiniMax为例,同样是使用命令行的方式配置,配置的命令可以在配置好免费API后,直接让龙虾自行给出其他API的配置命令,或者直接发给龙虾API Key,让其自行配置也是可以的。

1. 添加 Minimax Provider

openclaw config set models.providers.minimax-cn '{"baseUrl": "https://api.minimaxi.com/anthropic", "apiKey": "你的KEY", "api": "anthropic-messages", "models": [{"id": "MiniMax-M2.5", "name": "MiniMax M2.5", "reasoning": true, "input": ["text"], "cost": {"input": 0.3, "output": 1.2, "cacheRead": 0, "cacheWrite": 0}, "contextWindow": 204800, "maxTokens": 131072}]}'2. 设为主模型 (可选)

openclaw config set agents.defaults.model.primary "minimax-cn/MiniMax-M2.5"3. 重启生效

openclaw gateway restart对接聊天软件

接下来我们给龙虾对接聊天软件,我们打开飞书开放平台, 点击创建企业自建应用,起个名字,我这里叫ZZclaw,填个介绍,选个图标,点击确定。

在“权限管理”中点击“批量导入”,粘贴以下 JSON:

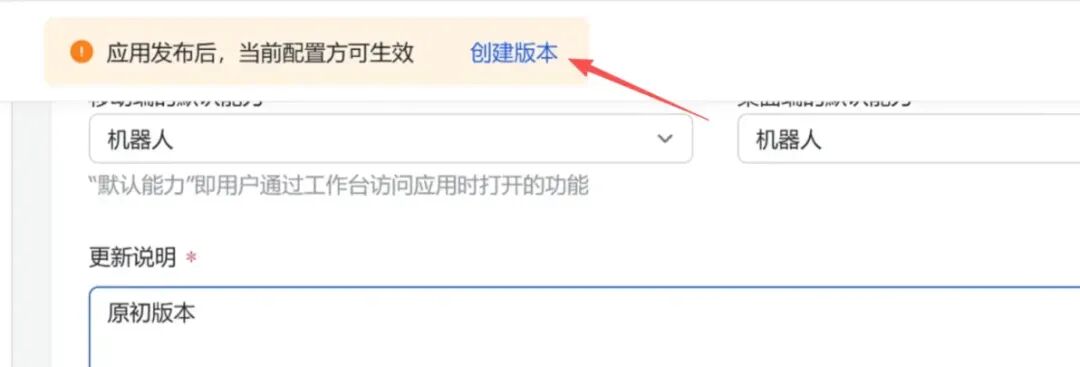

{ "scopes": { "tenant": [ "contact:contact.base:readonly", "contact:user.base:readonly", "im:chat.access_event.bot_p2p_chat:read", "im:chat.members:bot_access", "im:message", "im:message.group_at_msg:readonly", "im:message.p2p_msg:readonly", "im:message:send_as_bot", "im:resource" ], "user": [ "contact:contact.base:readonly", "im:message" ] }}发布应用:创建一个版本并点击发布。

我们复制这行代码到文本文档中,然后回到飞书中,复制一下APP ID,将APP ID替换到刚才的命令中,再将命令粘贴到终端中运行。

openclaw config set channels.feishu.accounts.main.appId "你的AppID"同理,将APP Secret替换到下方 命令中,再将命令粘贴到终端中运行。

openclaw config set channels.feishu.accounts.main.appSecret "你的AppSecret"接着重启geteway

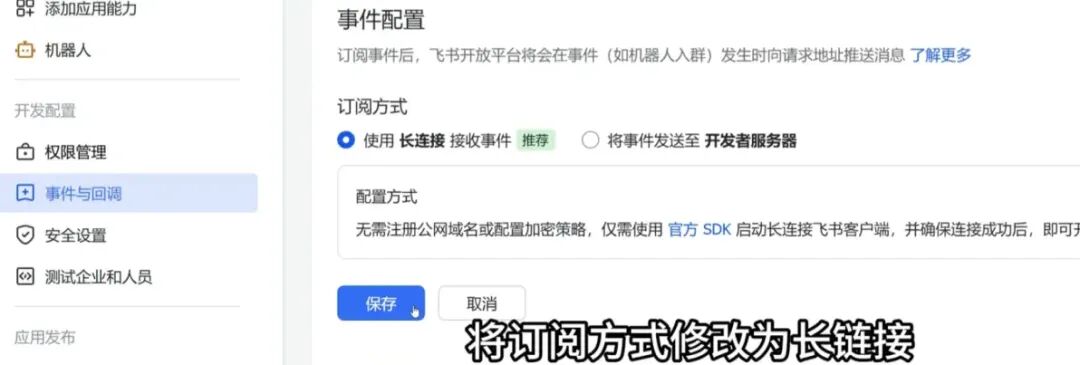

openclaw gateway restart回到飞书开放平台,在事件与回调中,将订阅方式修改为长链接,点击保存

点击“添加事件”,搜索接收消息,将接收消息添加进来。

再次创建,并发布版本。

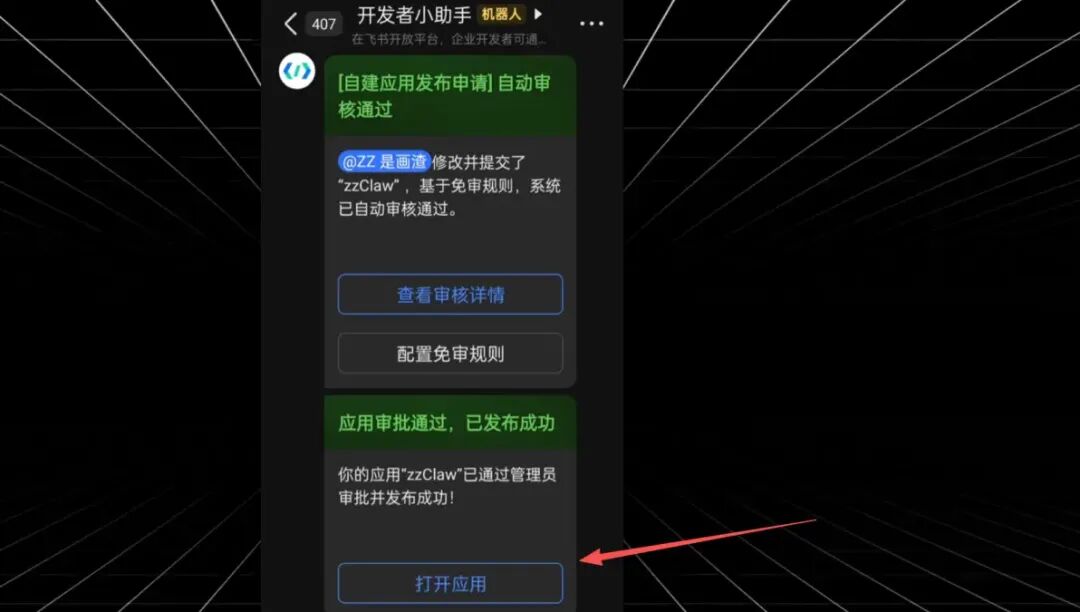

发布版本后,飞书上会收到开发者小助手的消息,我们点击其中的打开应用

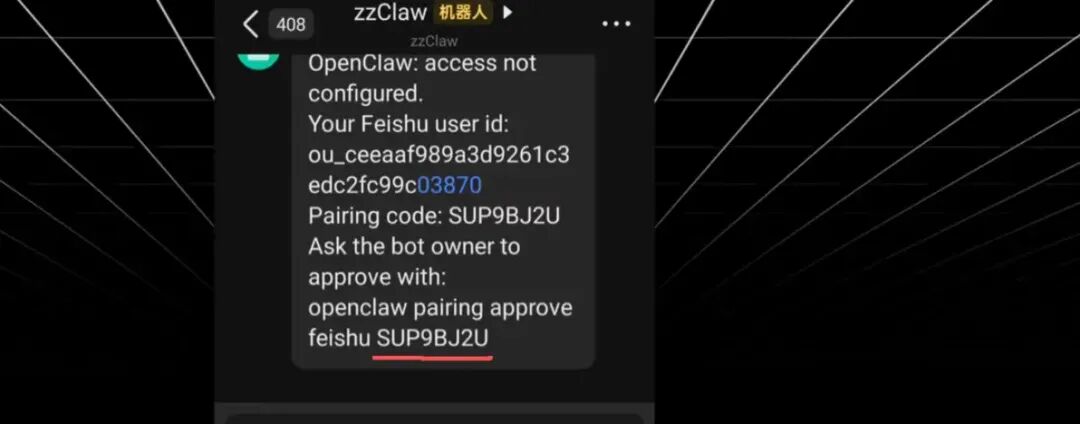

随便给我们创建的OpenClaw机器人发条消息,获取一下配对码

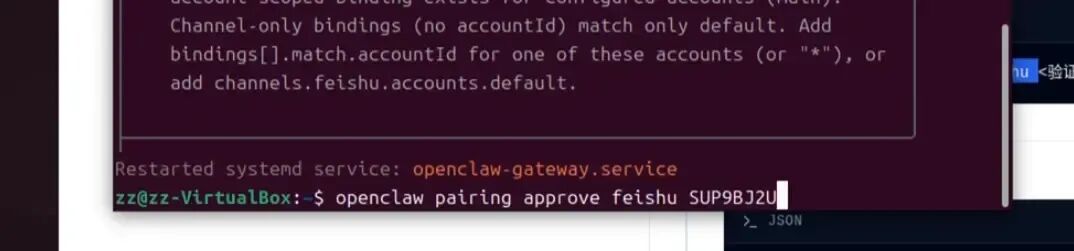

将配对码放入下方命令中,然后再粘贴到终端中执行

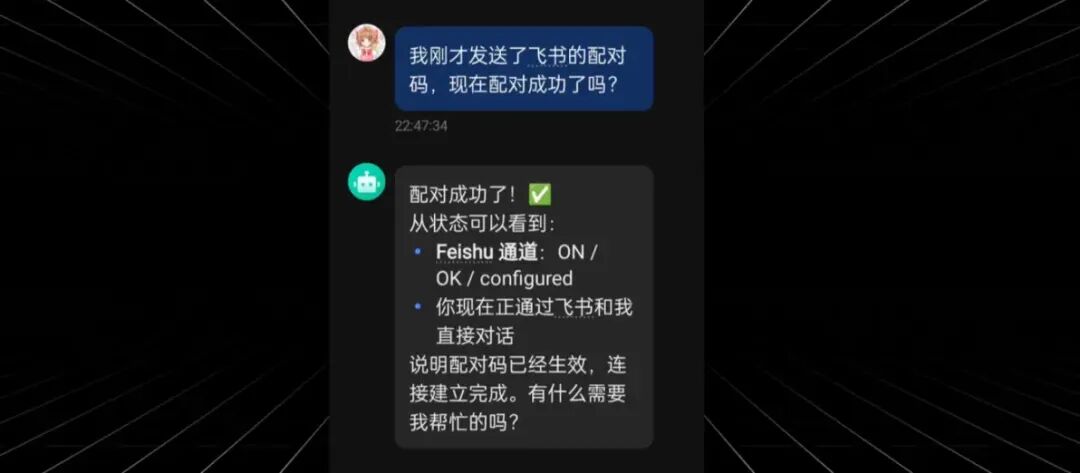

openclaw pairing approve feishu <验证码>此时聊天软件和龙虾配置成功,可以愉快的帮你打工了

大家在安装和使用龙虾的过程中遇到任何问题,随时留言,我会努力解答的,感谢大家!

夜雨聆风

夜雨聆风