## 前言

最近在使用OpenClaw的过程中,我尝试了多家云厂商的云主机和大模型服务。本文将分享在阿里云、百度云、联通云、移动云、天翼云等平台部署OpenClaw的体验,以及对GLM5、Deepseek3.2、千问等大模型能力调用的对比评测。

---

## 一、云主机资源开通

### 1.1 互联网厂商:阿里云与百度云

阿里云和百度云都以极低的价格提供包年或包月的轻量型云主机,服务体验非常好。

**开通流程:**

1. 选择轻量型云主机(性价比高)

2. 配置OpenClaw镜像

3. 设置安全组端口放行

4. 完成部署

**亮点:**

- 两家厂商均已预配置OpenClaw镜像,开箱即用

- 安全策略设置友好,支持端口自定义,提升安全性

- 均可通过Web界面或命令行操控(有的版本需要自己配置openclaw.json文件)

**差异:**

阿里云,镜像采用阿里操作系统,用官方镜像系统性能优,用原生操作系统部署性能非常差(可以说阿里云操作系统的镜像针对自己的云平台做了优化,其他的他不管也很正常),与Openclaw版本与官方版本存在一定时差

百度云,原生操作系统优化良好,性能稳定

### 1.2 运营商厂商:联通云与移动云

联通云和移动云均提供0元试用云主机,但使用体验存在明显差异。

**联通云:**

- 0元云主机开通便捷,菜单放置略深但可找到

- 安全组配置完成后即可使用

- 镜像下载、程序部署速度较快

- 整体体验良好

**移动云:**

- 配置相对繁琐,存在以下问题:

1. 安全组配置后,还需额外配置ACL才能访问外网

2. 密码设置要求非连续字符,但无明确提示,需要反复摸索

3. 镜像下载、系统升级速度最慢

- 可能与限速策略或镜像源配置有关

**天翼云:**

提供非常便宜的包年的云主机,但是很难抢到

### 1.3 小结

互联网厂商的云主机开通便捷、镜像预配置、体验统一;运营商云主机虽为0元试用,但配置复杂度较高(或者说云平台还是10年前的套路,样子新了很多),适合有一定技术基础的用户。

---

## 二、OpenClaw安装部署

### 2.1 互联网厂商

阿里云和百度云均已预置OpenClaw镜像,直接使用即可,无需手动部署。

**注意事项:**

- 阿里云:使用原生操作系统系统部署性能较差,建议使用官方预配置镜像

- 百度云:基于原生系统优化,性能表现良好

### 2.2 运营商厂商

联通云和移动云无预置镜像,需按官方教程或一键部署脚本手动操作。总体可顺利完成部署,无重大问题。

---

## 三、大模型能力评测

### 3.1 测试模型

本次评测主要对比以下三个模型:

- GLM5

- Deepseek3.2

- 千问3.5 235B

### 3.2 核心发现

**模型能力决定任务下限,提示词与交互决定上限。**

维度 | ||||

任务完成度 | ||||

Token消耗 | 最高(约为Deepseek的2倍) |

**关键观察:**

1. 模型能力越强,任务完成度越高,准确率越高,速度越快

2. 更强的模型反而Token消耗更少(效率更高)

3. Function Call能力和上下文窗口对任务执行有显著帮助

4. 千问Coder模型在任务完成上表现优异(第一个给我信心把任务跑通了)

**弱模型问题:**

- 中断次数增加,Token消耗增大

- 缺少Function Call能力可能导致任务无法完成

- 部分模型执行一段时间后出现"胡言乱语"现象

---

## 四、各家模型服务体验

### 4.1 阿里云(百炼)

**优点:**

- 配置便捷,调用方便

- 模型种类丰富,可充分体验各模型差异

**缺点:**

- 每个模型免费额度仅100万Token

- 单个任务可能Token不足

### 4.2 天翼云

**优点:**

- 免费2500万Token

- 提供GLM5、Deepseek3.2、千问3.5最新模型

- 文档完善,配置便捷

**缺点:**

- 服务稳定性一般,部分模型调用错误率达50%以上

### 4.3 移动云

**优点:**

- 免费2500万Token

**缺点:**

- 模型较旧(约2025年10月前版本)

- 文档不完善,需自行摸索从端点方式改为OpenAI接入方式

- 服务稳定性有待提升

- 有的模型说可以通过API调用,但实际上不可以(经验,标准了在线体验的模型,一般都可以调用得通)

### 4.4 注意事项

各服务商提供的模型可能存在差异:

- 上下文窗口大小不同

- 输出能力限制不同

- 部分为量化版本

- 部署的后台服务器(GPU卡)参差不齐,导致性能和精度其实有差别

选用时需仔细阅读文档,避免出现文字溢出等问题。

---

## 五、自动化任务设计实践

### 5.1 任务目标

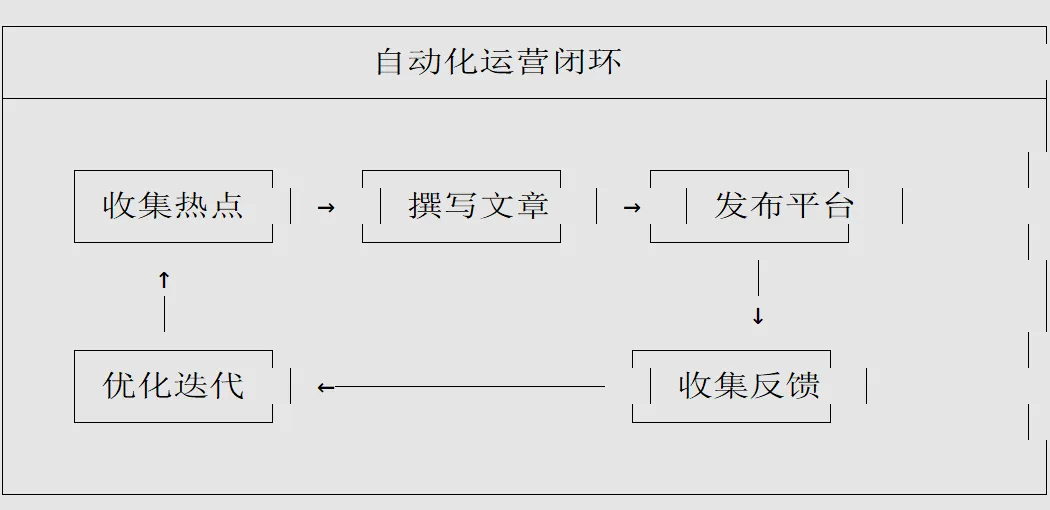

设计一个自动化、自我运营的文章撰写与发布系统。

### 5.2 任务流程

**步骤说明:**

1. **收集热点**:自动搜集网上最新的OpenClaw相关信息

2. **撰写文章**:根据热点生成技术文章

3. **发布平台**:将文章发布到指定平台

4. **收集反馈**:跟踪点赞、评论、阅读量等数据

5. **优化迭代**:结合反馈与近期热点,持续优化内容

### 5.3 预期效果

通过自动化运营,逐步提升内容质量和读者规模,形成正向循环。

---

## 六、总结与建议

### 6.1 云主机选择建议

| 需求场景 | 推荐选择 |

|----------|----------|

| 快速上手、体验OpenClaw | 阿里云/百度云(预配置镜像) |

| 长期使用、成本敏感 | 联通云(0元试用,体验较好) |

| 技术能力强、愿意折腾 | 移动云(配置繁琐但免费) |

### 6.2 模型选择建议

| 需求场景 | 推荐选择 |

|----------|----------|

| 复杂任务、追求效率 | 千问3.5 235B / Deepseek3.2 |

| 成本敏感 | 天翼云免费Token + GLM5/Deepseek3.2 |

| 体验多种模型 | 阿里云百炼 |

### 6.3 核心结论

1. **云主机**:互联网厂商体验优于运营商,但运营商免费资源性价比高

2. **模型能力**:越强的模型任务完成度越高,Token效率也越高

3. **任务设计**:模型能力决定下限甚至是一直失败,提示词与交互决定上限

---

*本文基于实际使用体验撰写,记录了OpenClaw多云部署与大模型调用的真实感受,希望能为读者提供参考。*

本文由L口述并微调文章,OC整理并完善

夜雨聆风

夜雨聆风