本教程介绍如何通过 Docker 镜像快速完成龙虾(OpenClaw)的安装与配置。相比从源码编译或手动安装的方式,镜像安装省去了繁琐的环境依赖问题,只需下载镜像文件并加载,整个过程简单高效,适合快速上手体验。安装完成后,还可使用“龙虾助手”进行图形化配置,无需手动编辑配置文件,操作更加便捷直观。

本教程适用于 Linux(Ubuntu)系统和 Windows 系统。Windows 用户需先安装 WSL 子系统,详细步骤请参考教程《Windows 下如何安全地安装龙虾(OpenClaw)》,访问地址:https://longxialab.com/tutorials/windows-openclaw/。

1 镜像下载与安装

本节将完成镜像文件的下载、加载以及容器的创建与启动,共分为三个步骤。

步骤一:下载龙虾镜像文件并解压缩

下载地址:链接: https://pan.baidu.com/s/1ZuQMm7voXoV-H-vV8BdslA?pwd=fgai提取码: fgai

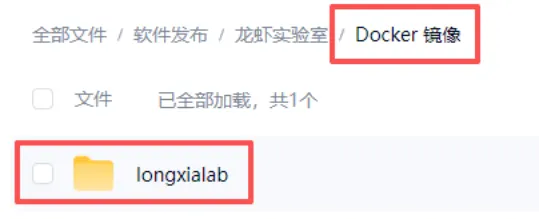

打开上方链接后,进入“Docker 镜像”目录,下载其中的 longxialab 文件夹。该文件夹包含镜像本体及配置文件,请确保完整下载后再进行后续操作。

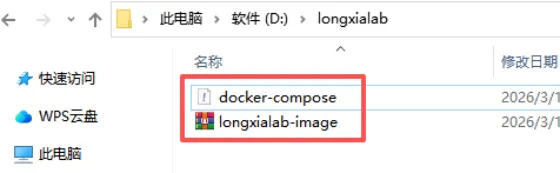

下载完成后解压缩,文件夹中包含以下两份文件:

•docker-compose.yml:容器编排配置文件,定义了容器的启动参数和端口映射等信息

•longxialab-image.tar:龙虾(OpenClaw)的 Docker 镜像压缩包,体积较大,请确保磁盘空间充足

以 Windows 系统为例,假设将上述文件放置在 D:/longxialab/目录下,则在 WSL 子系统中对应的路径为 /mnt/d/longxialab/。后续命令中将以此路径为例,若你的文件放在其他位置,请相应修改路径。

步骤二:加载镜像文件

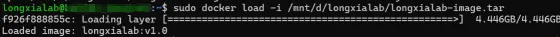

打开终端(Ubuntu 用户直接使用系统终端,Windows 用户请在 WSL 终端中操作),执行以下命令将镜像文件加载到 Docker 中:

# /mnt/d 对应 Windows 的 D 盘,若文件存放在其他路径,请自行修改sudo docker load -i /mnt/d/longxialab/longxialab-image.tar

由于镜像文件体积较大,加载过程可能需要两三分钟,请耐心等待,直到终端输出“Loaded image”相关提示后再进行下一步。

步骤三:创建并启动容器

镜像加载完成后,使用docker-compose命令一键创建并后台启动容器:

# /mnt/d 对应 Windows 的 D 盘,若文件存放在其他路径,请自行修改docker-compose -f /mnt/d/longxialab/docker-compose.yml up -d

2 配置大模型参数

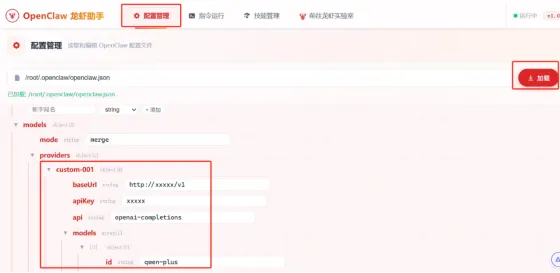

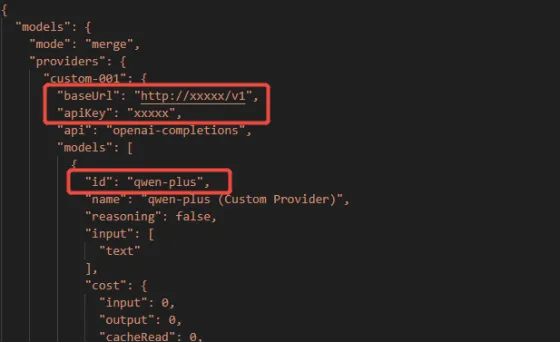

龙虾(OpenClaw)需要接入外部大模型才能正常运行。你需要配置以下 3 个关键参数,以指定所使用的大模型服务:

•大模型地址(baseUrl):大模型 API 的接入端点,格式为 "baseUrl": "http://xxxxx/v1",需替换为你实际使用的服务地址

•大模型密钥(apiKey):用于鉴权的 API Key,格式为 "apiKey": "xxxxx",请填写你的有效密钥

•大模型名称(id):调用的模型标识符,格式为 "id": "qwen-plus",请填写你所使用的模型名称(例如gpt-4o、qwen-plus、deepseek-chat等)

以下提供两种配置方式,推荐使用方法一通过图形化界面操作,更加直观简便。

方法一:通过龙虾助手图形化界面配置(推荐)

在浏览器中访问http://localhost:19789/打开龙虾助手,点击左侧菜单进入“配置管理”页面,点击“加载”按钮。在对应字段中填写大模型地址、密钥和模型名称,修改完成后保存即可生效,无需手动进入容器操作。

方法二:进入容器手动修改配置文件

如果你更习惯命令行操作,也可以直接进入容器编辑配置文件。首先使用以下命令进入容器的 shell 环境:

sudo docker exec -it opc /bin/bash -l进入容器后,配置文件位于以下路径:

/root/.openclaw/openclaw.json使用 vim或其他文本编辑器打开该文件,找到baseUrl、apiKey、id字段并修改为你的实际配置,保存退出后重启服务即可。

3 启动服务

大模型参数配置完成后,需要启动龙虾网关服务。同样提供图形化和命令行两种方式,推荐使用龙虾助手一键启动。

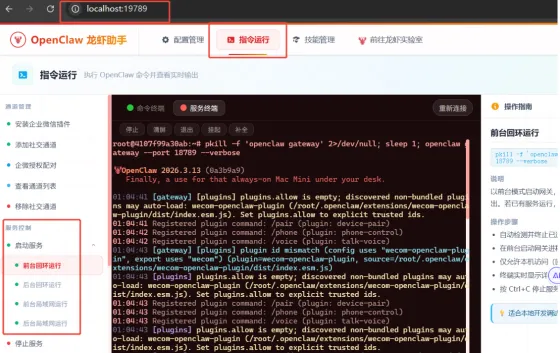

方法一:通过龙虾助手启动(推荐)

在浏览器中访问http://localhost:19789/打开龙虾助手,进入“指令运行”页面,在“启动服务”区域可以看到不同系统环境对应的启动按钮,点击相应指令即可一键启动服务。

根据你的运行环境选择对应的启动方式:

•Ubuntu 系统:直接使用回环模式(loopback)启动,服务仅监听本机地址

•WSL 子系统:使用局域网模式(LAN)启动,服务会绑定到 WSL 的局域网 IP,以便宿主 Windows 系统可以正常访问

方法二:进入容器手动启动

如需对启动参数进行更细粒度的控制,可以手动进入容器执行启动命令。首先使用以下命令进入容器:

sudo docker exec -it opc /bin/bash -l进入容器后,根据系统环境选择对应的启动方式:

(1)Ubuntu 系统:

# 前台运行(关闭终端窗口后服务会退出,适合调试时查看实时日志)openclaw gateway --port 18789 --verbose# 生产环境建议使用 nohup 后台运行,并将日志输出到指定文件,便于后续排查:nohup openclaw gateway --port 18789 > /tmp/openclaw-gateway.log 2>&1 &

(2)Windows WSL 子系统:

# 前台运行(关闭终端窗口后服务会退出,适合调试时查看实时日志)openclaw gateway --bind lan --port 18789 --verbose# 生产环境建议使用 nohup 后台运行,并将日志输出到指定文件,便于后续排查:nohup openclaw gateway --bind lan --port 18789 > /tmp/openclaw-gateway.log 2>&1 &

服务启动成功后,终端会输出相关监听端口信息。若使用后台运行方式,可通过tail -f /tmp/openclaw-gateway.log查看实时日志。

4 页面测试

服务启动后,可通过前端页面验证整套流程是否正常运行。本节将引导你完成连接、授权和对话测试。

注意:随着龙虾版本的更新迭代,自带的前端页面样式可能会有所变化,但核心配置流程(输入 Token、设备配对授权)保持一致,均可在龙虾助手页面中完成操作。

步骤一:访问前端页面

打开浏览器,访问以下地址进入概览页面:

http://localhost:18789/overview首次访问时,页面会提示需要进行设备连接。请先点击“连接”按钮,此时系统会弹出提示 “pairing required”(需要配对),说明当前设备尚未完成授权,请继续执行步骤二获取 Token。

步骤二:获取 Token

Token 是设备连接的认证凭据,首次配对时需要填写。可通过以下任一方式获取:

•方式 A:打开容器内的配置文件openclaw.json,在文件中找到token字段对应的值

•方式 B:直接在龙虾助手的配置页面http://localhost:19789/中查看,界面上会明文显示当前 Token

获取到 Token 后,将其粘贴到连接窗口中的对应输入框,为后续的设备配对做准备。

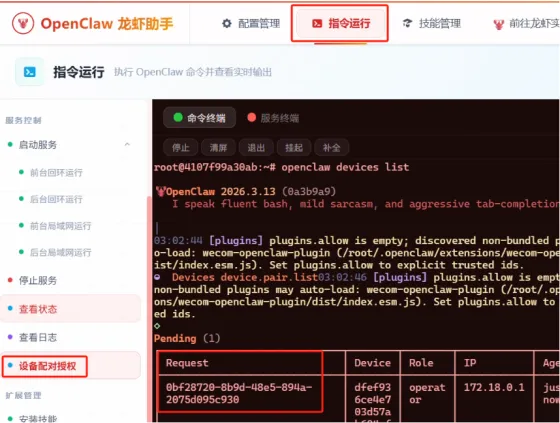

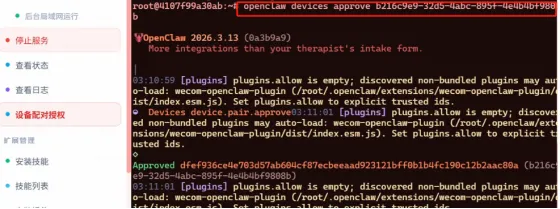

步骤三:设备配对授权

完成 Token 填写后,还需要对设备连接请求进行授权确认。在龙虾助手指令运行页面 http://localhost:19789/找到“设备配对授权”按钮并点击,系统将自动批准当前待处理的连接请求。

提示:该命令偶尔可能执行失败,如遇失败请稍等片刻后多尝试几次。

openclaw devices approve <requestId># 示例:openclaw devices approve b216c9e9-32d5-4abc-895f-4e4b4bf9808b

授权成功后,返回前端页面再次点击“连接”按钮,连接状态将显示为正常,说明设备配对已完成。

步骤四:聊天测试

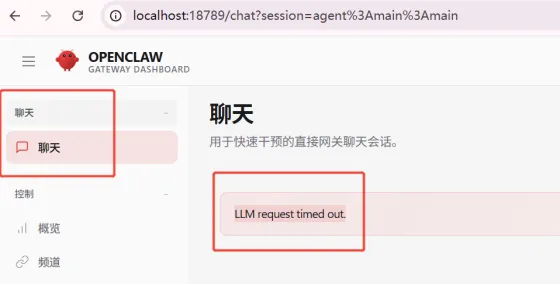

设备连接正常后,访问以下聊天测试页面进行对话测试,验证大模型是否能够正常响应:

http://localhost:18789/chat?session=agent%3Amain%3Amain在输入框中发送一条测试消息,观察龙虾的回复情况:

•正常情况:龙虾会在数秒内给出大模型的回复,说明整套服务链路配置正确

•无响应或超时:如果龙虾没有任何响应,或提示“LLM request timed out.”,大概率是大模型配置有误(地址、密钥或模型名称填写有误)。请返回第 2 节检查并修改配置文件,确认无误后重新启动龙虾服务再进行测试

夜雨聆风

夜雨聆风