1.vLLM 简介与技术特点

vLLM是一个快速高效的大语言模型推理和服务库,具有以下核心优势:

·高吞吐量服务

通过PagedAttention实现先进的内存管理

·连续批处理

对传入请求进行连续批处理,提高GPU利用率

·优化执行

支持自定义Gaudi®实现,针对LLM操作符进行优化

·多推理模式

支持离线批处理推理和通过OpenAI兼容服务器的在线推理

2.环境要求(硬件+系统+软件环境)

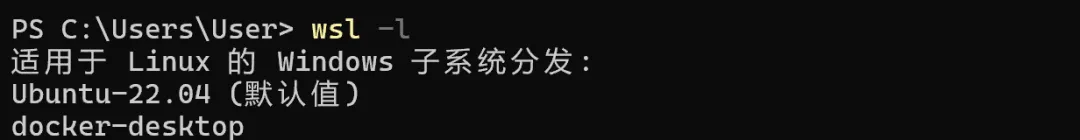

·操作系统

Ubuntu 22.04 LTS/Windows 11(WSL2)

·conda环境

已安装conda

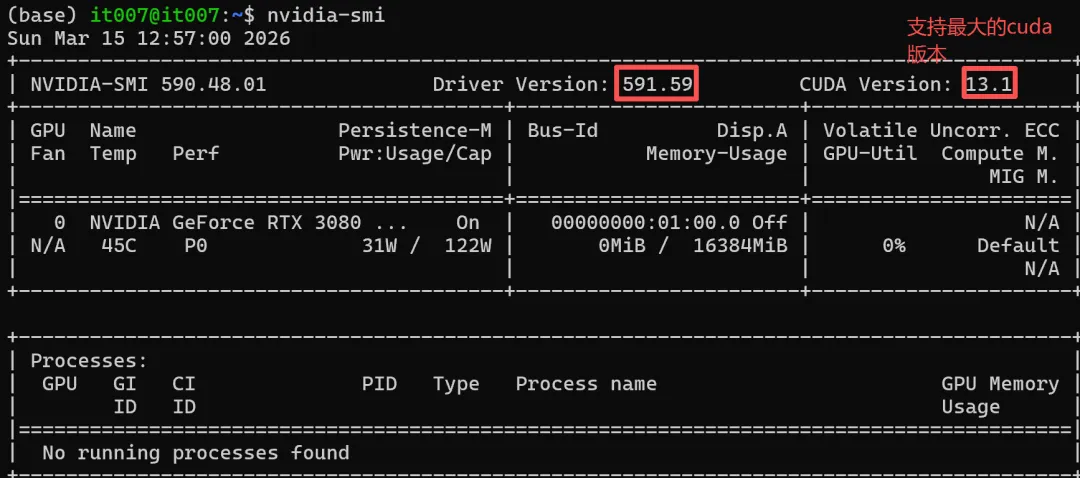

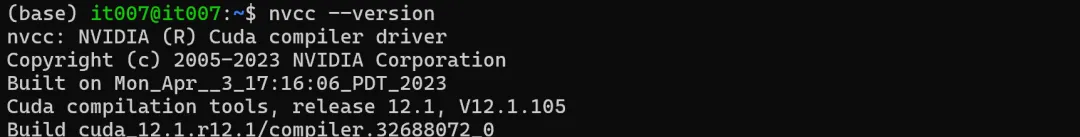

·cuda工具包

已安装cuda

3.1创建虚拟环境

conda create -n vllm python=3.12 -y

3.2 激活虚拟环境

conda activate vllm

3.3安装vLLM

# pip安装vllm预编译的Python包

pip install vllm -i https://pypi.tuna.tsinghua.edu.cn/simple

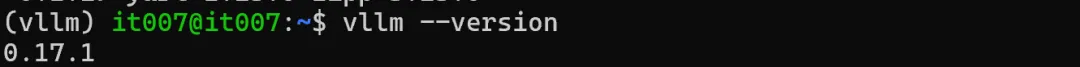

3.4 验证vLLM

vllm --version

3.5 下载大模型包

魔搭社区: https://www.modelscope.cn/models/modelscope

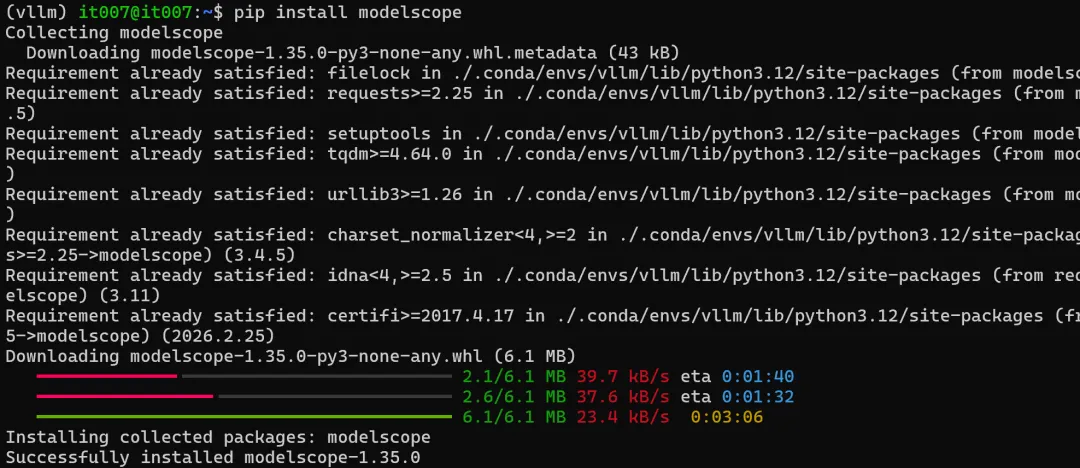

(1)安装ModelScope

pip install modelscope

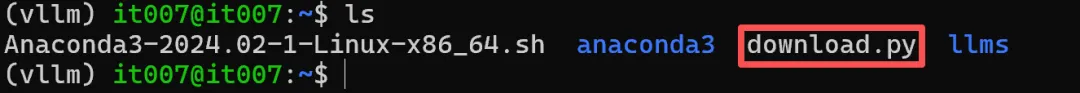

(2)下载大模型

#模型下载 from modelscope import snapshot_download

model_dir = snapshot_download('Qwen/Qwen3-4B',cache_dir=”./llms/models”)

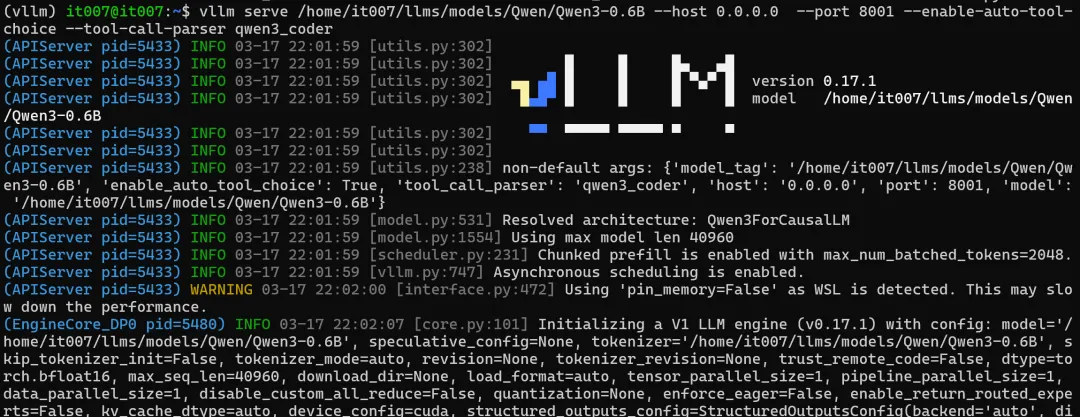

3.6启动模型服务

vllm serve /home/it007/llms/models/Qwen/Qwen3-4B --host 0.0.0.0--port 8001--enable-auto-tool-choice--tool-call-parser qwen3_coder

注意:需要带路径/home/it007/llms/models/Qwen,默认的端口号为:8001

3.7验证大模型

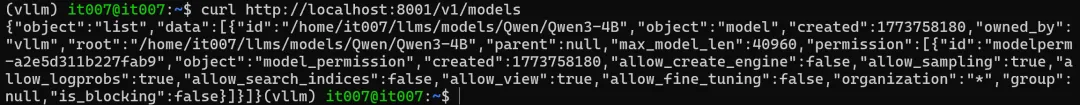

(1)查看模型信息

curl http://localhost:8001/v1/models

curl http://127.0.0.1:8001/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{ "model": "/home/it007/llms/models/Qwen/Qwen3-4B","messages": [ {"role": "system", "content": "你是一个英文翻译助手。"}, {"role": "user", "content": "请把你吃饭了么翻译成英语"} ], "temperature": 0.2, "max_tokens": 256 }'

3.8配置openclaw

vi ~/.openclaw/openclaw.json |

把下面这段代码替换到上述文件中

"models": { "mode": "merge", "providers": { "vllm": { "baseUrl": "http://127.0.0.1:8001/v1", "apiKey": "VLLM_API_KEY", "api": "openai-completions", "models": [ { "id": "/home/it007/llms/models/Qwen/Qwen3-4B", "name": "/home/it007/llms/models/Qwen/Qwen3-4B", "reasoning": false, "input": [ "text" ], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 128000, "maxTokens": 8192, "compat": { "supportsStrictMode": false, "supportsStore": false, "supportsDeveloperRole": false, "supportsReasoningEffort": false } } ] } } }, "agents": { "defaults": { "model": { "primary": "vllm//home/it007/llms/models/Qwen/Qwen3-4B" }, "models": { "vllm//home/it007/llms/models/Qwen/Qwen3-4B": {} }, "workspace": "/home/it007/.openclaw/workspace" } }, |

注意

(1)id和name名称填写的是模型启动的全路径

/home/it007/llms/models/Qwen/Qwen3-4B

(2)agents配置时,vllm后面是//

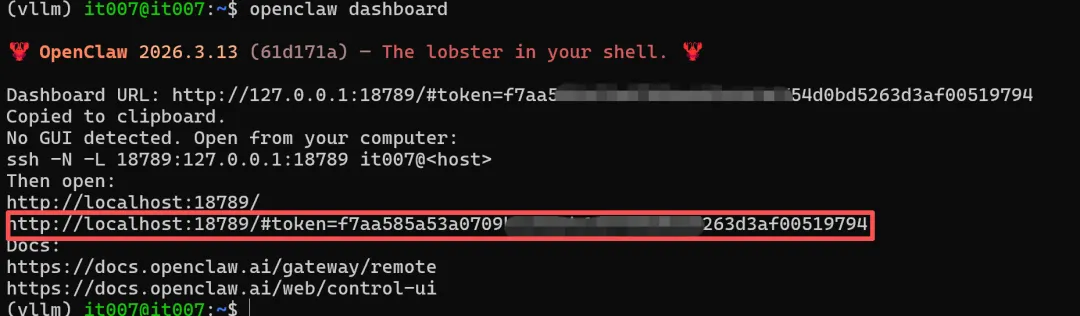

3.9重启openclaw网关

#重启网关 openclaw gateway restart |

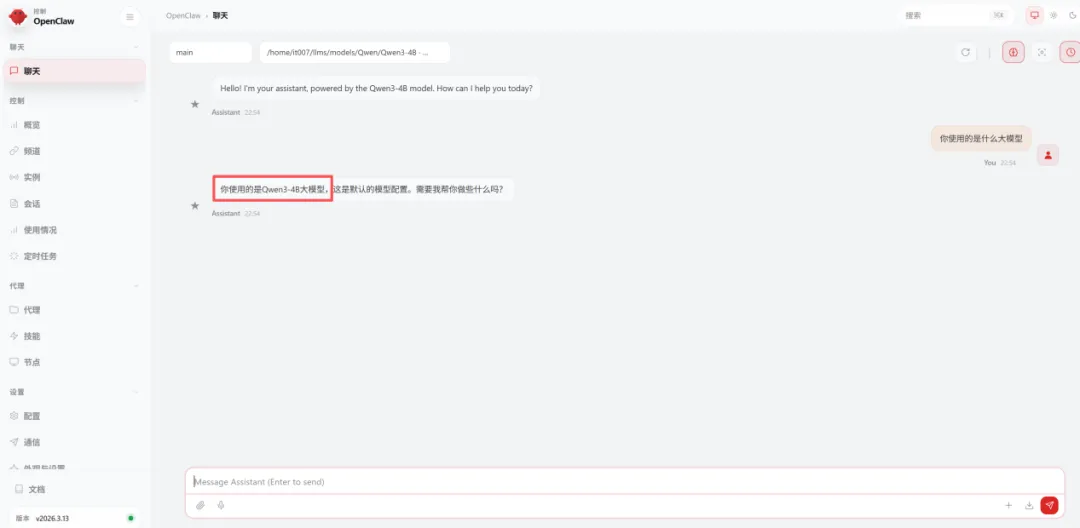

4测试OpenClaw使用模型

打开openclaw的Web UI

测试一下ollama部署的qwen3:4B模型

夜雨聆风

夜雨聆风