🦞最近,你的朋友圈被一只小龙虾刷屏了吗?没错,OpenClaw 突然火了!大家纷纷调侃要开始“养殖”属于自己的龙虾。但你知道吗?这只龙虾背后,其实藏着 AI 开发者们真正关注的热点——开放、可控的本地模型部署理念!

随着 OpenAI、Claude 等闭源大模型广泛应用,数据隐私、API 成本及定制化需求日益凸显,本地部署已成为不可忽视的趋势。

今天我们不聊🦞小龙虾怎么养,而是用另一个轻量级开源工具——text-generation-webui,带你一步步实现模型本地化部署。

text-generation-webui 拥有简洁的 Web 界面,让本地运行大模型变得像点外卖一样简单。本文基于 Ubuntu 22.04,手把手教你完成安装、模型下载及 API 测试全流程,助你快速搭建属于自己的私有大模型环境。

一、前置准备与环境检查

在开始安装前,首先确认你的系统版本为Ubuntu 22.04 LTS(本文步骤仅适配该版本),同时准备好基础操作环境——Ubuntu 22.04

默认自带Python 3.10,刚好符合text-generation-webui的版本要求(推荐Python 3.10~3.11,不建议3.12+,部分依赖暂不兼容),无需额外安装Python,只需补充必要的依赖工具即可。

二、完整安装步骤(新手友好,全程复制命令即可✌)

步骤1:更新系统并安装核心依赖

首先更新系统包列表,避免因依赖版本不匹配导致安装失败,同时安装Git(用于克隆代码仓库)、Python虚拟环境、编译工具等核心组件,这些是后续安装的基础,缺一不可。

bash# 更新系统包列表,升级现有软件(耗时根据网络情况而定)sudo apt update && sudo apt upgrade -y# 安装核心依赖,一次性安装所有必要工具sudo apt install -y python3.10 python3.10-venv python3-pip git build-essential libssl-dev libffi-dev python3-dev |

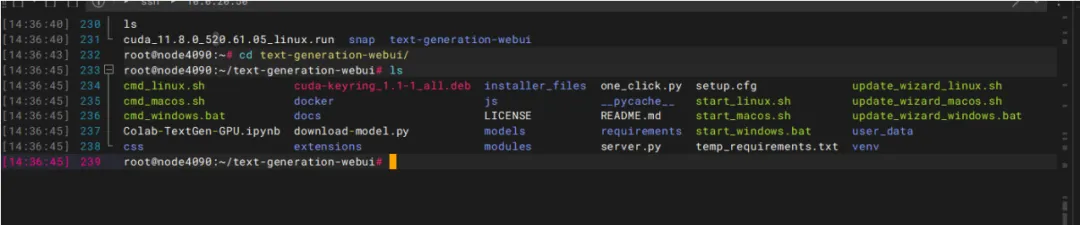

步骤2:克隆text-generation-webui代码仓库

选择一个易访问、无权限问题的目录(推荐用户主目录),创建专门的安装文件夹,然后克隆官方代码仓库。考虑到国内网络访问GitHub可能较慢,这里提供官方源和国内镜像源两种选择,按需挑选即可。

bash# 1. 创建安装目录(推荐放在主目录下,方便后续查找)mkdir -p ~/AI && cd ~/AI# 2. 克隆代码仓库(二选一)# 方式1:官方源(国外网络推荐,国内可能较慢)git clone https://github.com/oobabooga/text-generation-webui.git# 方式2:国内镜像源(国内网络优先,速度更快)git clone https://gitee.com/mirrors/text-generation-webui.git# 3. 进入仓库目录(后续所有操作都在此目录执行,务必进入)cd text-generation-webui |

步骤3:优化依赖下载速度,执行安装脚本

Ubuntu 22.04下,官方提供的启动脚本会自动创建Python虚拟环境,并安装所有依赖,但默认使用国外PyPI源,国内网络下载速度极慢,容易出现超时失败。因此,我们先修改启动脚本,添加国内PyPI源(清华源),再执行安装。

bash# 1. 用nano编辑器修改启动脚本(新手友好,简单易操作)nano start_linux.sh |

打开脚本后,找到包含「pip install」的两行代码(通常在「create_venv」函数内),将其修改为以下内容(添加清华源):

bashpip3 install --upgrade pip setuptools wheel -i https://pypi.tuna.tsinghua.edu.cn/simplepip3 install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple |

修改完成后,按「Ctrl+O」保存,按「Ctrl+X」退出nano编辑器。接下来赋予脚本执行权限,并运行脚本,自动完成依赖安装:

bash# 赋予脚本执行权限(首次运行必做,避免权限不足报错)chmod +x start_linux.sh# 运行脚本,首次运行会自动创建虚拟环境、安装所有依赖# 耗时5~20分钟,取决于网络速度,耐心等待即可./start_linux.sh |

步骤4:启动text-generation-webui,验证安装成功

依赖安装完成(若配置了GPU,需确保GPU环境正常)后,回到text-generation-webui目录,启动WebUI:

bash# 回到仓库目录(若重启后退出了目录,务必执行这一步)cd ~/AI/text-generation-webui# 启动WebUI./start_linux.sh |

首次启动会加载依赖并初始化Web界面,耐心等待1~2分钟,当终端输出以下内容时,说明启动成功:

bashRunning on local URL: http://127.0.0.1:7860 |

此时,打开Ubuntu系统自带的浏览器(Firefox/Chrome),输入「http://127.0.0.1:7860」,即可进入text-generation-webui的主界面,安装环节至此完成。

三、补充内容:模型测试(两种测试方式,确保模型正常可用)

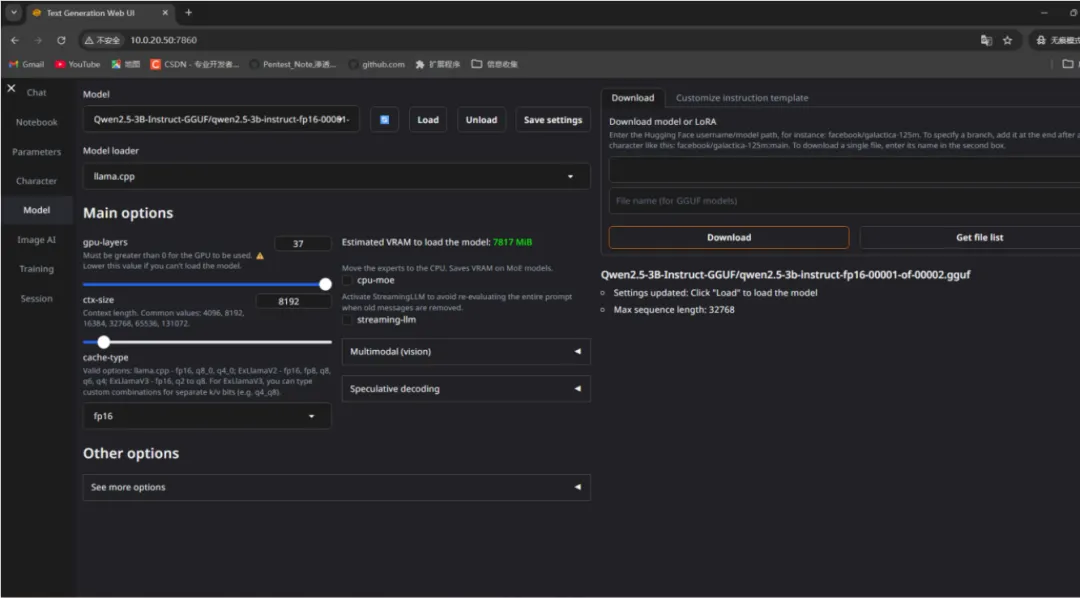

模型下载并加载后,我们可以通过两种方式测试API,验证模型是否能正常响应——一种是WebUI内直接测试,适合快速验证;另一种是外部API调用,适合后续对接其他程序(如Python脚本、前端页面)。

方式1:WebUI内测试(最简单,新手首选)

1. 打开WebUI界面,点击顶部「Model」标签页,在下拉框中选择已下载的模型(如Qwen-7B-Chat);

2. 点击「Load」按钮,加载模型(首次加载耗时1~5分钟,取决于模型大小和GPU性能);

3. 加载完成后,切换到「Text Generation」标签页,在左侧输入框中输入问题(如「介绍一下Ubuntu系统」);

4. 点击「Generate」按钮,等待模型生成响应,若能正常输出回答,说明模型和WebUI均正常可用。

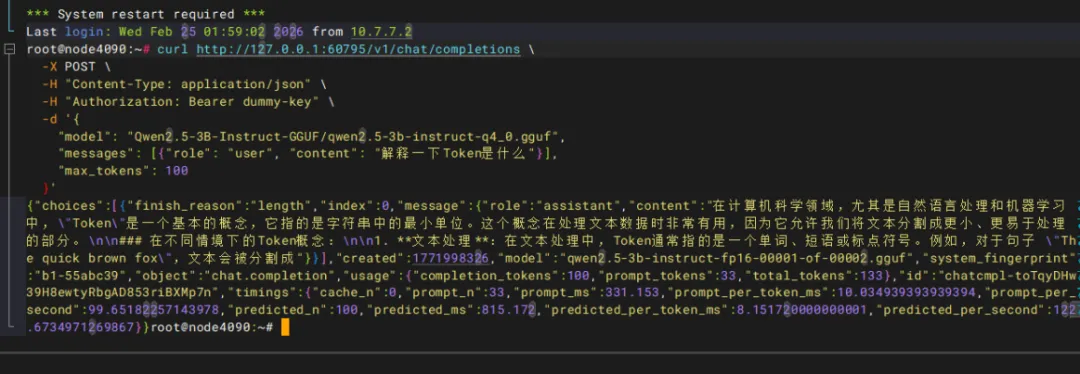

方式2:外部API调用测试(适合对接其他程序)

text-generation-webui支持API调用,我们可以通过curl命令或Python脚本测试API接口,步骤如下:

1. 启动WebUI时开启API模式

首先关闭当前运行的WebUI(按「Ctrl+C」终止终端进程),然后用以下命令启动,开启API模式:

bashcd ~/AI/text-generation-webui# 开启API模式,允许外部访问(--listen参数可选,允许同一局域网内其他设备访问)./start_linux.sh --api --listen |

启动成功后,终端会输出API相关地址,其中「http://127.0.0.1:5000」即为API接口地址。

2. 用curl命令测试API(无需写代码)

打开一个新的终端,执行以下命令,发送请求到API接口,测试模型响应:

bashcurl -X POST http://127.0.0.1:5000/v1/completions \-H "Content-Type: application/json" \-d '{ "model": "Qwen-7B-Chat", # 替换为你加载的模型名称 "prompt": "介绍一下text-generation-webui", "max_tokens": 100, # 最大生成字数 "temperature": 0.7 # 生成随机性,0~1之间,越小越严谨}' |

若能正常返回JSON格式的响应(包含模型生成的文本),说明API接口正常;若报错,检查模型是否已加载、API模式是否开启。

3. 用Python脚本测试API(适合后续开发)

创建一个Python脚本(如test_api.py),写入以下代码,运行即可测试API:

pythonimport requestsimport json# API接口地址url = "http://127.0.0.1:5000/v1/completions"# 请求参数payload = { "model": "Qwen-7B-Chat", # 替换为你的模型名称 "prompt": "如何在Ubuntu 22.04中安装软件?", "max_tokens": 150, "temperature": 0.8}# 发送POST请求response = requests.post(url, headers={"Content-Type": "application/json"}, data=json.dumps(payload))# 解析响应if response.status_code == 200: result = response.json() print("模型响应:", result["choices"][0]["text"])else: print("API请求失败,状态码:", response.status_code) |

运行脚本(python3 test_api.py),若能正常输出模型回答,说明API调用成功,后续可基于该接口对接其他程序。

以上就是部署指南,赶紧实操起来!

四川浮点运算科技有限公司是一家专注人工智能算力网络服务的专业化公司,公司致力于成为中国领先的人工智能算网服务商,联合鹏城实验室共建中国算力网西部运营中心,汇聚智算中心、电信运营商以及云头部⼚商多源异构算力资源接入中国算力网西部调度平台(算力圈平台),共建算网服务生态圈,为算力行业客户提供智算中心建设、平台化运营及算力、AI一体化解决方案。

戳“阅读原文”,发布算力供给/需求信息

夜雨聆风

夜雨聆风