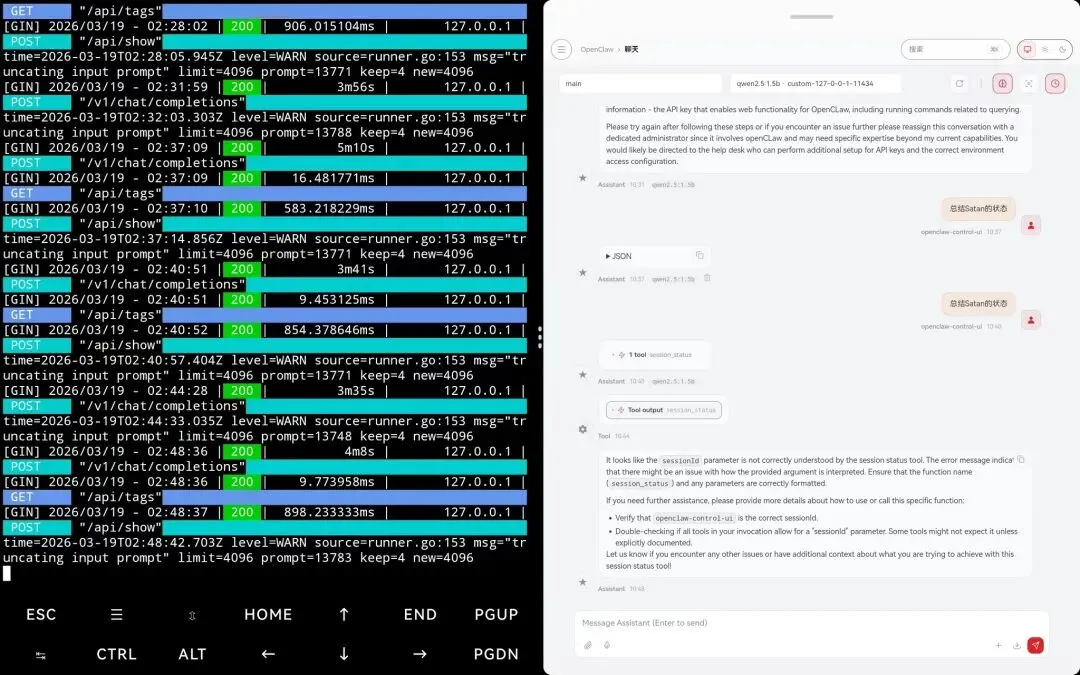

最近都流行养虾,不仅仅是电脑,手机、平板都可以当成openclaw的终端。通过CLI机制,让你的闲置产品成为一个可用的智能化终端,同时,为了避免调用云端模型烧token,采用本地小模型实现本地化服务,不用再担心token消耗,只是速度有点慢。

以下是亲测的全流程闭坑版:华为平板(HarmonyOS)安装 OpenClaw 深度指南。

本教程涵盖了从基础环境(Termux、Node.js)到本地模型(Ollama),再到 OpenClaw 核心补丁的完整教程。

在华为设备上运行 OpenClaw,最核心的障碍是系统严禁非 Root 应用访问网卡接口(报错 Error 13)。本教程将带你从零开始,搭建一个闭环的专项智能工作站。

[重要]

💡 核心忠告:专注专项任务,拒绝“多 Agent”陷阱。

1、 不要盲目追求同时运行多个 Agent!

2、华为平板内存管理极严,稳定性与 Agent 数量成反比。建议专注于一个 Agent 处理一个专项任务(如:专门负责业务分析或文案生成)。多 Agent 并行会剧烈消耗内存,极易导致系统杀掉后台或模型响应超时。

第一步:基础环境搭建 (Termux & Node.js)

* 下载 Termux:请务必从 F-Droid 或 GitHub 下载最新版本(不要使用应用商店的老旧版本)。

* 初始化环境:打开 Termux,输入以下命令更新并安装 Node.js:

pkg update && pkg upgrade

pkg install nodejs-lts

* 验证版本:输入 node -v,建议版本在 v22 及以上。

第二步:安装本地引擎 (Ollama)

为了在平板上获得“秒回”的体验,建议安装 Ollama 跑本地模型,避免公网延迟。

* 安装 Ollama:

pkg install ollama

* 启动服务:

ollama serve &

* 下载轻量模型(推荐 Qwen2.5-1.5B,适合平板):

ollama run qwen2.5:1.5b

测试能说话后,按 Ctrl+D 退出模型,保持服务在后台即可。

第三步:安装 OpenClaw 与“华为权限补丁”

* 强制安装 OpenClaw:

npm install -g openclaw --force

* 创建权限补丁 (fix.mjs):

由于华为系统会拦截网卡查询,我们要用这个文件在启动时“封印”报错函数:

cat <

import os from 'node:os';

os.networkInterfaces = () => ({});

console.log('✅ 华为系统网络权限已封印');

EOF

第四步:配置启动与快捷方式

* 配置快捷词(Alias):

为了以后不用输入长命令,直接运行以下命令:

echo "alias runclaw='NODE_OPTIONS=\"--import file://\$HOME/fix.mjs\" openclaw gateway run'" >> ~/.bashrc

source ~/.bashrc

* 正式启动:

现在只需输入:runclaw

* 成功标志:看到绿色的 ✅ 华为系统网络权限已封印 且日志显示 [gateway] listening on ws://127.0.0.1:18789。

1. 深度解决响应卡顿

* 关闭流式传输:进入 OpenClaw 网页设置,关闭 "Stream"。移动端网络常有缓存干扰,关闭流式能避免“转圈很久最后才蹦字”的体感卡顿。

* 保持前台:华为系统会杀掉后台高负载进程。建议将 Termux 与浏览器分屏显示。

2. 内存防杀

* 清理冗余:定期在网页端清理不常用的 Agent 节点,保持内存占用处于健康区间。

#OpenClaw #Termux #华为平板 #鸿蒙系统 #AI智能体 #Ollama #Nodejs #生产力工具 #DeepSeek

夜雨聆风

夜雨聆风