解决

⚠️ API rate limit reached. Please try again later.报错,彻底告别限流困扰

写在前面

最近不少使用OpenClaw(原ClawdBot/Moltbot)的朋友遇到了一个烦人的问题:明明配置好了Qwen模型,却总是收到API rate limit reached的报错提示,导致服务频繁中断。

这个问题的根源在于:Qwen Portal免费版存在严格的限流策略。虽然免费版每天提供2000次请求额度,但短时间内的多轮交互同样会触发流量限制。一旦触发,通常需要等待1-60分钟才能恢复,严重影响了使用体验。

本文将手把手教你如何将OpenClaw从Qwen免费版迁移到阿里云百炼Coding Plan,彻底解决限流问题,同时获得更多模型选择和更稳定的服务。

一、准备工作

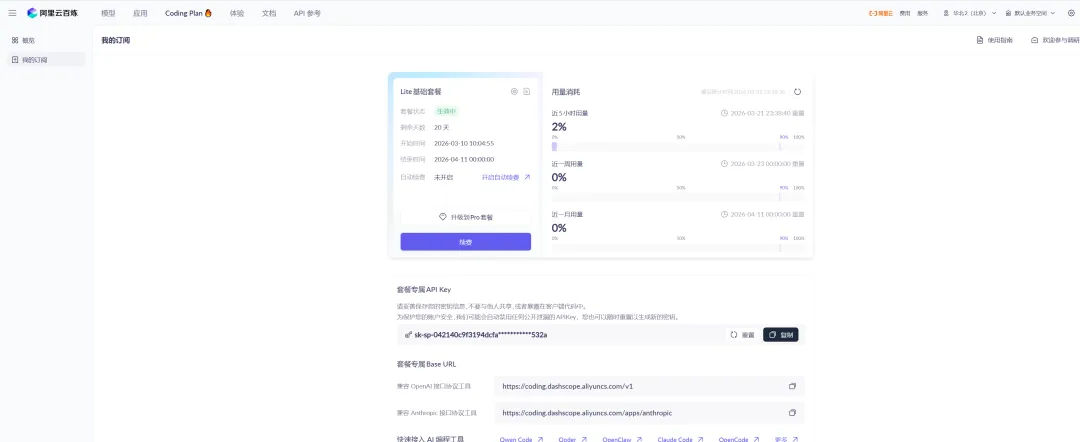

1.1 获取阿里云百炼API Key

首先,你需要一个阿里云百炼的API Key。如果你还没有,按以下步骤获取:

先点顶端菜单栏应用边的

1.2 确认OpenClaw已安装

确保你的OpenClaw已经正确安装并运行。可以通过以下命令检查:

bash

openclaw --version如果显示版本号,说明安装正常。

二、备份当前配置

在进行任何修改之前,强烈建议先备份当前的配置文件。这样如果出现问题,可以快速恢复。

cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.backup

备份文件会保存在同一目录下,名为 openclaw.json.backup。

1.2 确认OpenClaw已安装

确保你的OpenClaw已经正确安装并运行。可以通过以下命令检查:

bash

openclaw --version如果显示版本号,说明安装正常。

二、一键迁移命令

只需三步:修改API Key → 复制命令 → 粘贴执行

步骤1:复制以下命令,修改API Key

将下面命令中的 sk-你的阿里云百炼API密钥 替换为你在上一步获取的真实API Key。

bash

# 设置你的API Key(请修改这里!)API_KEY="sk-你的阿里云百炼API密钥"# 备份原配置并写入新配置cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.backup 2>/dev/nullmkdir-p ~/.openclawcat> ~/.openclaw/openclaw.json <<EOF{ "models": { "providers": { "bailian": { "baseUrl": "https://coding.dashscope.aliyuncs.com/v1", "apiKey": "${API_KEY}", "api": "openai-completions", "models": [ {"id": "qwen3.5-plus", "contextWindow": 1000000, "maxTokens": 65536}, {"id": "qwen3-max-2026-01-23", "contextWindow": 262144, "maxTokens": 65536}, {"id": "qwen3-coder-next", "contextWindow": 262144, "maxTokens": 65536}, {"id": "qwen3-coder-plus", "contextWindow": 1000000, "maxTokens": 65536}, {"id": "MiniMax-M2.5", "contextWindow": 196608, "maxTokens": 32768}, {"id": "glm-5", "contextWindow": 202752, "maxTokens": 16384}, {"id": "glm-4.7", "contextWindow": 202752, "maxTokens": 16384}, {"id": "kimi-k2.5", "contextWindow": 262144, "maxTokens": 32768} ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" } } }}EOF# 重启Gatewayopenclaw gateway restart# 验证配置echo""echo"✅ 迁移完成!正在验证配置..."sleep2openclaw models status

步骤2:修改API Key

将命令第一行的 sk-你的阿里云百炼API密钥 替换为你的真实API Key。

修改前:

bash

API_KEY="sk-你的阿里云百炼API密钥"修改后(示例):

bash

API_KEY="sk-abc123def456ghi789jkl"步骤3:粘贴到终端执行

复制修改后的完整命令,在终端中粘贴并回车执行。

三、执行过程详解

命令执行后,你会看到类似这样的输出:

text

✅ 迁移完成!正在验证配置...Default model: bailian/qwen3.5-plusProviders: bailian: ✓ configured (8 models)

验证成功的标志:

✅ 显示

bailian: ✓ configured✅ 显示

(8 models)✅ 没有显示

Missing auth或Error

如果出现错误:

| 错误提示 | 原因 | 解决方法 |

|---|---|---|

Missing auth | API Key未正确配置 | 检查API_KEY是否正确设置 |

Connection error | 网络问题 | 检查是否能访问阿里云百炼 |

No such file | OpenClaw未安装 | 先运行 npm install -g openclaw 安装 |

四、手动验证(可选)

如果你想进一步确认配置成功,可以运行以下命令:

bash

# 查看所有可用模型openclaw models list# 测试对话openclaw chat "你好,请介绍一下自己"

如果能正常响应,说明迁移完全成功!

五、配置说明

5.1 迁移前后对比

| 配置项 | 迁移前(Qwen免费版) | 迁移后(阿里云百炼) |

|---|---|---|

| 模型提供商 | qwen-portal | bailian |

| Base URL | portal.qwen.ai | coding.dashscope.aliyuncs.com |

| 认证方式 | OAuth(无API Key) | API Key(sk-xxx) |

| 默认模型 | coder-model | qwen3.5-plus |

| 可用模型数 | 2个 | 8个 |

| 是否限流 | ✅ 是(免费版限制) | ❌ 否(按量计费) |

5.2 可用模型列表

| 模型ID | 上下文长度 | 最大输出 | 特色 |

|---|---|---|---|

| qwen3.5-plus | 100万 | 65,536 | 多模态支持 |

| qwen3-max-2026-01-23 | 26万 | 65,536 | 最新旗舰 |

| qwen3-coder-next | 26万 | 65,536 | 代码优化 |

| qwen3-coder-plus | 100万 | 65,536 | 超长上下文编程 |

| MiniMax-M2.5 | 19.6万 | 32,768 | MiniMax系列 |

| glm-5 | 20.2万 | 16,384 | 智谱最新 |

| glm-4.7 | 20.2万 | 16,384 | 智谱稳定版 |

| kimi-k2.5 | 26万 | 32,768 | 多模态支持 |

5.3 费用说明

阿里云百炼采用按量付费模式,价格透明:

| 模型档次 | 输入价格 | 输出价格 |

|---|---|---|

| Turbo | ¥0.3/百万token | ¥0.6/百万token |

| Plus | ¥0.8/百万token | ¥2/百万token |

| Max | ¥4/百万token | ¥12/百万token |

对于个人日常使用,每月费用通常在几元到十几元之间,远低于自建服务的成本。

六、如何切换其他模型?

如果你想使用其他模型(如代码专用模型),可以通过命令行快速切换:

bash

# 切换到 Qwen Coder Plus(超大上下文编程模型)openclaw models set-default bailian/qwen3-coder-plus# 切换到 Kimi K2.5(多模态模型)openclaw models set-default bailian/kimi-k2.5# 切换到 GLM-5(智谱最新模型)openclaw models set-default bailian/glm-5

七、常见问题

Q1:为什么不用Qwen Portal了?

Qwen Portal免费版虽然好用,但存在严格的限流机制。当短时间内请求过多时,会触发API rate limit reached错误,影响正常使用。迁移到阿里云百炼后,按量付费模式没有限流问题,服务更稳定。

Q2:如何恢复原来的配置?

如果新配置出现问题,可以快速恢复备份:

bash

cp ~/.openclaw/openclaw.json.backup ~/.openclaw/openclaw.jsonopenclaw gateway restart

Q3:配置后仍然报错怎么办?

检查API Key是否正确(格式:

sk-开头)确认阿里云百炼账户余额充足

检查网络是否能正常访问

coding.dashscope.aliyuncs.com查看详细日志:

cat ~/.openclaw/logs/gateway.err.log

Q4:这个配置会保留我原有的Telegram、飞书等渠道配置吗?

会的! 上面的一键命令只替换了 models 和 agents 部分,不会影响你的渠道配置(Telegram、飞书等)。如果你之前配置了这些渠道,它们会继续正常工作。

如果你是从零开始的全新安装,上面的配置只包含模型部分,你可以稍后根据需要添加渠道配置。

八、总结

通过本文的一键命令,你已经成功将OpenClaw从Qwen免费版迁移到了阿里云百炼Coding Plan。迁移后的优势:

✅ 彻底解决限流问题:按量付费模式,无请求频率限制✅ 一行命令完成:无需手动编辑配置文件✅ 更多模型选择:从2个模型扩展到8个模型,覆盖Qwen、MiniMax、GLM、Kimi✅ 更大上下文:最大支持100万tokens上下文,适合处理长文档✅ 多模态支持:部分模型支持图像输入✅ 稳定可靠:企业级服务,99.9%可用性保证

现在,你可以安心使用OpenClaw,不再受限流困扰!

延伸阅读:

阿里云百炼官方文档

OpenClaw GitHub仓库

夜雨聆风

夜雨聆风