这可能是你见过最实用的 AI 浏览器自动化工具——不需要写代码、不需要 LLM 推理成本,一次安装就 能让 AI 直接操作小红书、B 站、X (Twitter)、GitHub...

它能做什么?

1. 数据抓取(零成本)

部分常见站点示例(还有很多):

平台 | 命令示例 |

小红书 |

|

B站 |

|

Twitter/X |

|

| |

知乎 |

|

GitHub |

|

核心优势:

支持站点众多,绝对够用!

不需要 LLM 推理,不消耗 token。

同样的查询跑 10000 次,一分钱不花。

2. 自动化操作

发小红书笔记

发 Twitter 推文

下载 B 站视频

管理 GitHub PR/Issue

定时抓取数据进你的 pipeline

3. 桌面应用控制(独家能力)

这是 OpenCLI 最独特的地方——它能控制 Electron 桌面应用:

应用 | 能做什么 |

Cursor | 发送 prompt,获取代码 |

Codex | 驱动 AI 编程 |

ChatGPT | 自动发消息、对话 |

Notion | 读写页面 |

Discord | 自动化消息 |

据有限信息查询,可能还没有其他工具能做到。

(如果有请留言告知,不吝赐教)

适用场景 vs 不适用场景

适合用 OpenCLI(几乎满足大部分场景了)

场景 | 为什么选它 |

定时抓取数据 | 零成本、可放进 cron |

AI Agent 需要操作网站 | 确定性输出、省 token |

需要登录态操作 | 复用 Chrome 登录,不用额外凭证 |

中国平台(B站、小红书、知乎等) | 有官方适配器 |

桌面应用自动化 | 唯一支持 CDP 的 CLI 工具 |

不适合用 OpenCLI

场景 | 选什么 |

探索未知网站 | Browser-Use / Stagehand |

一次性的复杂流程 | LLM 驱动的浏览器工具 |

大规模爬虫 | Crawl4AI |

OpenCLI 的设计哲学:用确定性换通用性。它不是取代浏览器自动化工具,而是和它们互补。

安装与配置

第一步:安装 CLI

命令行里执行下面命令:

(需安装Node.js,不会安装请留言)

命令行里执行下面命令:

(需安装Node.js,不会安装请留言)npm install -g @jackwener/opencli第二步:安装浏览器插件

去https://github.com/jackwener/opencli/releases下载最新的 Chrome 扩展程序

opencli-extension.zip然后打开Chrome,在地址栏输入

chrome://extensions 回车,开启开发者模式点击「加载已解压的扩展程序」

选择解压后的文件夹

第三步:检查连接状态

命令行执行:

opencli doctor看到「Everything looks good」就 OK 了。

第四步:确保Chrome里的网站已登录

浏览器命令会复用你的 Chrome 登录状态。

先在 Chrome 里登录目标网站(小红书、B 站、Twitter...),然后就可以直接用命令操作了。

常用命令示例

查小红书热门

opencli xiaohongshu search "AI 工具" --limit 10查X(Twitter)

# 搜索推文opencli twitter search "Claude Code" --limit 10# 查看某人最新推文opencli twitter timeline dotey --limit 5

查B站热门

opencli bilibili hot --limit 10下载B站视频

opencli bilibili download BV1xxx --output ./videos发推文(很丝滑)

opencli twitter post "Hello from OpenCLI!"格式化输出

支持 table / json / yaml / md / csv:

opencli bilibili hot -f jsonopencli bilibili hot -f csv

Claude Code怎么用?

方法一:在CLAUDE.md中配置如下内容

不知道CLAUDE.md的,查看我的文章 【进阶篇】让你的 Claude Code 更懂你,初识 CLAUDE.md

# 外部网络与数据抓取工具 (OpenCLI)当前本地环境已全局挂载 `opencli`,这是一个利用本地浏览器 Session 绕过反爬和登录限制的网页自动化 CLI 工具。**【触发条件】**当用户的请求涉及:获取互联网实时信息、抓取特定网站内容、进行外部数据调研,或你需要联网核实信息时,请优先使用本工具。**【标准操作流程 (SOP)】**1. **能力嗅探**:在不确定命令格式时,静默执行 `opencli list` 或 `opencli --help`,读取支持的站点列表和参数说明。2. **结构化调用**:执行抓取命令时,**必须强制追加 `-f json` 参数**(例如 `opencli <平台> <动作> -f json`),以确保你接收到的是易于解析的结构化标准输出 (stdout)。3. **未知站点处理**:如果用户要求的网站不在 `list` 预设中,请尝试执行 `opencli explore <URL>` 对目标网页进行结构探测和解析。4. **异常重试**:如果命令执行失败或返回错误(如网络超时),请尝试更换参数重试一次。**【行为规范】**- 直接在 Bash 中静默执行上述命令,**不需要向用户解释你的调用过程或打印原始 JSON 数据**。- 将终端返回的数据在后台自行消化分析后,直接输出用户最终需要的结论、代码或格式化文本。

方法二:直接大白话告诉Claude Code

安装好OpenCLI后,把下面的话发给它~

我本地已经装了 opencli。请帮我在当前目录下创建或更新CLAUDE.md 文件,追加一段关于如何使用 opencli 的全局指令。核心要求:1. 不确定命令时,先执行opencli list;2. 调用具体抓取命令时,必须包含完整前缀并追加-f json 参数(例如opencli zhihu hot -f json);3. 遇到不支持的站点执行opencli explore <URL> 进行探测;4. 要求你在后台静默处理原始的 JSON 输出,只向我汇报提炼后的最终结论。尽量精简,写完后直接保存文件即可。

然后...

你就可以直接大白话让Claude Code去查询x.com、小红书、B站了,溜到起飞~

到此搞定。

如果是 OpenClaw 使用也同样道理,只不过 OpenClaw 是配置在 AGENT.md 里,把上面的 CLAUDE.md 换一下就行,不会的请留言~

进阶玩法

1. 自定义适配器

遇到不支持的网站?一行命令生成适配器:

opencli generate https://example.com --goal "hot"2. 注册本地 CLI

任何本地命令都能注册成 AI 可发现的工具(这个很牛逼,很有想象空间):

opencli register mycli3. 配合 cron 做数据管道

# 每小时抓一次数据0 * * * * opencli bilibili hot -f json >> ~/data/bilibili-$(date +\%Y\%m\%d\%H).json

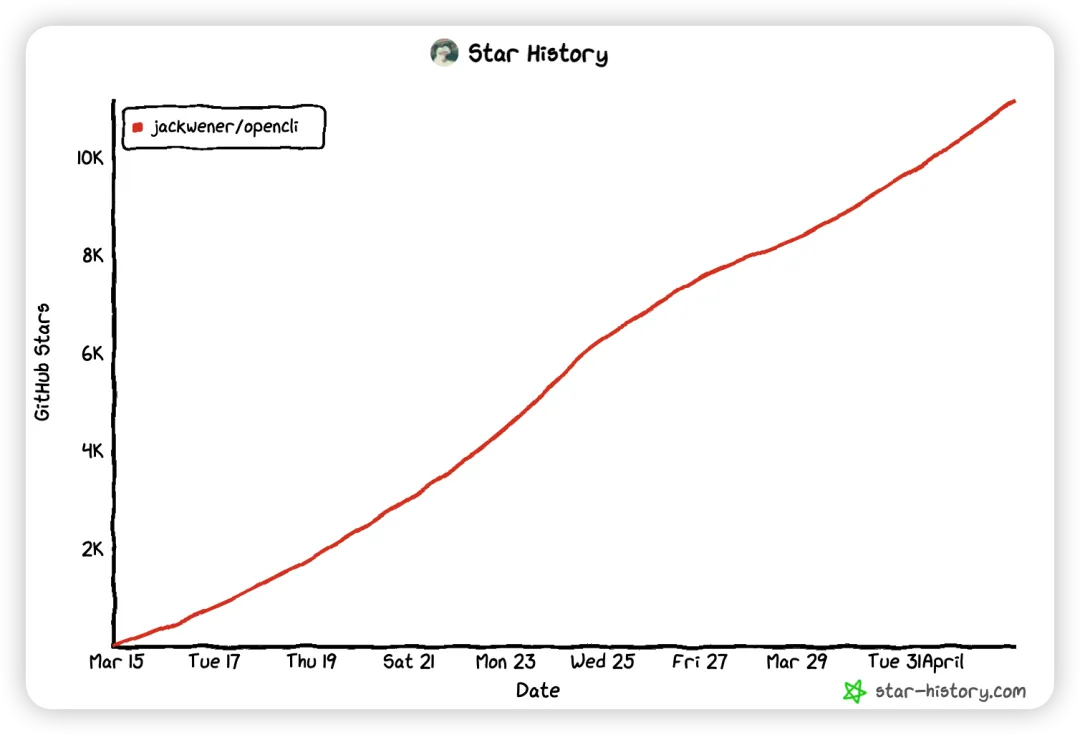

在Github上的Start History👍

Github地址:https://github.com/jackwener/opencli

最后说两句

如果你正在使用 Claude Code 或者 OpenClaw,强烈建议安装使用OpenCLI进行浏览器自动化,是目前我用来最满意和最稳定的。

它的设计哲学,我是非常认可的:用确定性换通用性。

还有更多好用的 Skill 后面会慢慢跟大家分享,如果你有想了解和学习的,也欢迎留言讨论~

如果你也在学习和使用 AI

欢迎进入AI社群一起学习~

夜雨聆风

夜雨聆风