“语言的边界真是人类思维的边界”。

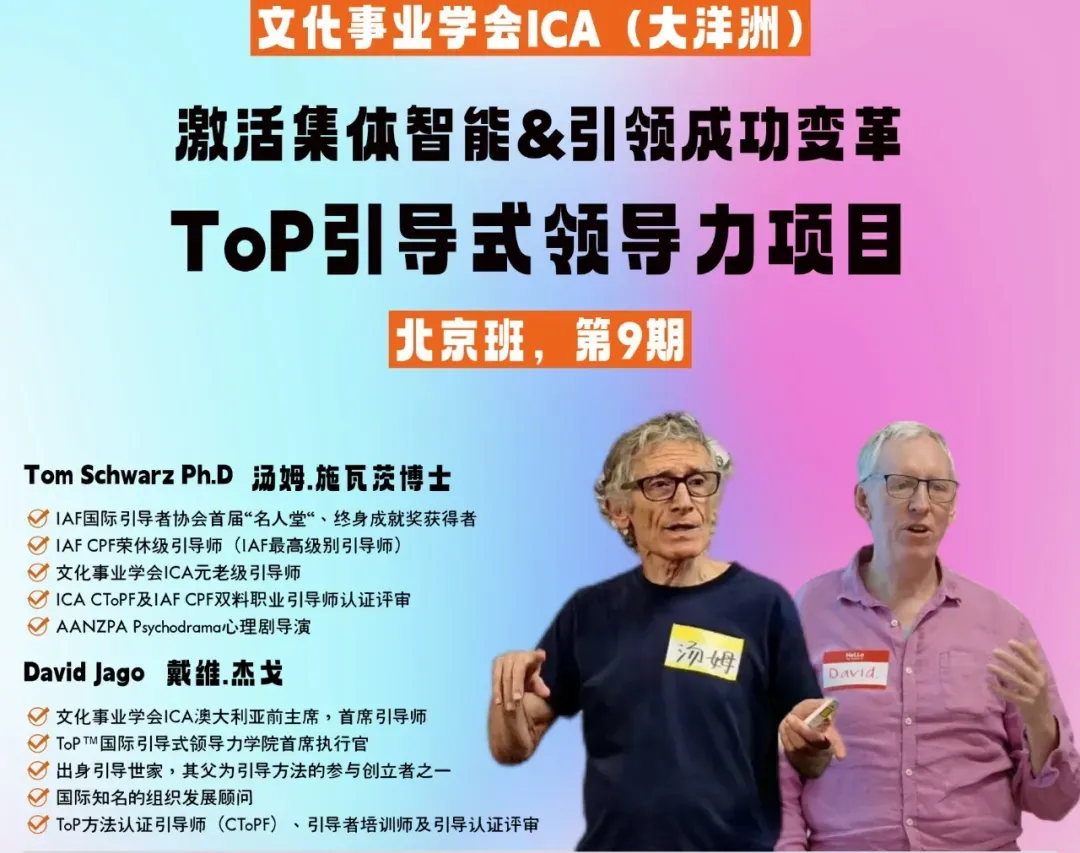

点击↑↑↑图片,了解ToP引导式领导力项目

通过文末联系方式报名↓↓↓

本篇文章,我们用焦点对话(Focused Conversation)方法开始聊起:

一、我们从数据中看到了什么?(Objective)——两个不可忽视的结构性信号

信号一:成本结构的崩塌

一个典型知识工作者每天处理和生成的信息量约为12.5万字。将全球知识工作者的全部成本与同等处理量的AI令牌成本相比,比例约为 2000:1。

历史告诉我们:当成本出现这种数量级的差异,变化从来不是"加一点工具",而是整个行业被重塑——就像航运、贸易、移动通信曾经经历的那样。

信号二:商业主体的位移

AI正引发商业世界的"相变":它不再是提升效率的工具,而是与人平起平坐、重构一切商业规则的新主体。

> 观察到的现象:

同样一件事,现在让AI先写一版、先列选项、先给结论,太容易了。

难的是——你到底该信哪一句?该为哪一个选择负责?

客户开始只为确定性结果付费,不再为"可能性"买单。

未来的交易将是智能体间的直接对话,用户界面和中间平台的价值将被重构。

案例:某制造企业的"战略误判"

一家中型制造企业在AI辅助下快速完成了海外市场扩张方案,效率提升数倍。但三个月后,CEO发现团队对当地政策风险的判断完全依赖AI输出,当突发贸易管制时,团队无法快速调整——因为他们从未真正理解过选择背后的逻辑。

当董事会追问"为什么选这个市场而非那个"时,高管只能复述AI的摘要。效率提升了,但选择力与判断力断层了。

二、反应性层次(Reflective):这让我们感受到什么? ——双重焦虑的交织

第一层焦虑:个体层面的"练功场"消失

当我们感受到"效率提升"的喜悦时,是否觉察到一丝不安?

当AI把日常工作拿走后,组织里培养选择力与判断力的土壤正在消失。

我们可能会感到:决策变快了,但底气变少了。

我们可能会担忧:年轻人不再经历"练功场"的磨砺,如何承担高风险决策?

第二层焦虑:系统层面的"繁荣悖论"

AI驱动增长的背后,是生产率和GDP创新高,但人类收入和消费可能陷入停滞——繁荣或将与个体无关。

案例:某零售集团的"选址依赖症"

某连锁零售集团引入AI选址系统后,年轻拓展经理不再需要通过实地走访、观察人流节奏来判断门店潜力。

一年后,当系统在某文化街区给出"高潜力"评级时,团队直接签约——却忽略了当地正在酝酿的社区改造计划。开业后客流惨淡,那些曾经通过千百次真实考察培养出的"情境直觉",被AI的即时评分替代了。

一位资深拓展总监感叹:"他们现在会问'系统打多少分',而不是'这条街的气场对不对'。"

三、诠释性层次(Interpretive):这意味着什么? ——从"选择力与判断力差距"到"商业重构":同一枚硬币的两面

传统"成长环境"的三重功能正在被瓦解:

功能 | 过去如何培养 | AI时代的风险 |

建立自信 | 通过反复做、反复验证,克服冒名顶替感 | 直接获得答案,失去验证过程 |

模式识别 | 见得多,才能在压力下识别关键线索 | 缺乏多样化情境的反复接触 |

个人风格 | 在细节里打磨专业直觉 | 依赖AI输出,失去品味形成过程 |

商业规则的十二重构:

经济模式 | ||

需求捕捉 | 平台流量经济 | 意图经济:AI预判用户说不清的需求 |

付费逻辑 | 工具付费、过程付费 | 结果经济:只为确定性结果买单 |

A2A:智能体对智能体的直接交易 | ||

营销对象 | 对人做生意 | 对机器做生意:产品在AI世界可见性 |

营销框架 | STP×4P | 市场位置=人心智位置×算法认知位置 |

品牌基建 | SEO搜索引擎优化 | GEO生成引擎优化:成为AI权威信源 |

管理核心 | 管人、控流程 | 定义意图、校准价值观、设定边界 |

战略形态 | 静态五年规划 | 动态涌现:与算法持续互动的概率化系统 |

人类价值 | 从策略到执行 | 从"策"到"决":终极选择力与判断力是最后壁垒 |

增长来源 | 渐进式优化 | 基础设施迁移引发的全量用户迁移 |

> 核心洞察:人类价值的重新定义

组织的新瓶颈公式: 高效认知 = 智力 × 信息丰富度 × 有效协作

AI时代的变化:思考变得极其便宜、极其丰富。瓶颈不再是"有没有信息/能不能产出",而变成了"选择质量与判断质量"。

人类核心价值的新定位:AI能给你无数完美的"策",但最终决定生死的,是你的"决"。在信息爆炸的时代,基于价值观和直觉的终极选择力与判断力,是人类最后的、也是最高的壁垒。

这与"选择力与判断力差距"的洞察形成呼应:当AI让"策"泛滥时,"决"的稀缺性反而凸显。

选择力与判断力的三种生成机制:

根据三类研究的整合,选择力与判断力依赖三种机制——它们都不会在AI优先的工作场所里自动发生:

情境经验 | 多样化情境的反复接触,形成模式识别本能 | 案例/模拟变成常规环节 |

结果所有权 | 知道自己在哪些地方有把握、哪些不确定 | 个人反思记录,记录理由/风险/信心 |

传承制 | 隐性知识通过观察、跟随、共事传递 | 资深者在现场说出取舍逻辑 |

案例:结果所有权的"校准实验"

某科技公司让两组产品经理分别用AI辅助制定路线图。

- A组被要求在提交时标注"我对这个优先级选择的信心等级(1-5分)"和"可能推翻这个选择的条件"。

- B组直接提交。

六个月后复盘:A组的产品市场匹配度比B组高35%,更重要的是,A组成员能更准确地预测自己的盲区在哪里——这种"校准后的自信"正是选择力与判断力的核心。

四、决定性层次(Decisional):我们将要做什么? ——三项组织层面的转变

1,建立反思-回顾循环:让选择过程可见

不是仅有结果透明,而是结构化反思:

记录当时的理由、考虑的风险、对结果的信心。

几个月后回看:哪些选择有效?哪些失误?为什么?

案例:某新能源企业的"战略选择复盘"

一家新能源企业在进入储能市场时,要求决策团队填写"选择思考单":

①当时的关键假设是什么?

②哪些信号会让我们重新选择?

③我的信心区间是多少?

九个月后,无论市场反馈如何,团队用聚焦式会话进行群体反思:不是问"市占率多少",而是问"当时的选择逻辑是否成立"。当政策突变导致行业洗牌时,这种仪式让团队能快速调整策略,而不是固守错误路径——失败变成了选择力与判断力资产,而不是沉没成本。

2,渐进式发展路径:不能把练功场拆了指望高手出现

用模拟、案例、场景练习,让人逐级积累选择经验——不能期望新人在日常工作自动化后直接承担CEO级别的高风险战略选择。

案例:某投资机构的"阶梯式传承制"

某投资机构发现:AI投研助手让初级分析师不再需要从整理财报、绘制行业图谱做起。但他们设计了一个替代方案——"模拟投委会+导师口述"制度:每周一上午,资深合伙人会带着一个真实案例,边思考边说出自己的取舍逻辑("我放弃这个项目,是因为估值逻辑与我的底层假设冲突..."),初级分析师则需要在模拟环境中做出投资选择并解释理由。隐性知识的传递,从"看我做"变成了"听我想"。

3,区分审查与纠正:把"审核AI"当成学习过程

纠错式做法——"这不对,我改掉"

学习式做法(焦点对话提问) ——"你基于哪些信息这么选择?" "考虑了哪些风险?" "信心从何而来?"

后者传递的是选择力与判断力,而不仅是"正确答案"。

案例:某快消品牌的"苏格拉底式选品"

某快消品牌改变了选品流程:CMO不再直接否决AI辅助生成的产品方案,而是召开20分钟的聚焦式会话,用ORID结构提问:

——客观:这个消费数据的来源是什么?

——反应:你看到这个趋势时的第一直觉是什么?

——诠释:为什么选择这个品类而非那个?

——决定:如果要在三个月内上市,你会押注哪个选择?这种对话让选品会议变成了选择力与判断力训练场。

五、共识工作坊(Consensus Workshop):团队的共同承诺

一个最狠的试金石

你的员工能分辨人工智能何时出错吗? 因为每一次与AI的交互,要么让人产生依赖,要么促进人成长。

案例:某金融科技公司的"AI陷阱测试"

该公司每月举行一次"反向选择测试":故意给AI系统输入有缺陷的市场数据或模糊的战略假设,看团队能否识别出问题。

一次测试中,AI生成的并购标的分析看似完美,但忽略了监管合规的隐性成本——只有两位资深合伙人发现了异常。这个测试不是为了抓错,而是为了校准团队的"AI错误雷达"。

团队共识声明:

× 我们不选择:默认模式是"问AI → 照做",导致选择力与判断力退化。

√ 我们选择:把交互设计成发展契机,选择力与判断力会提升。

六、行动计划(Action Planning):ORID框架下的具体行动

O-Objective(客观层面):建立群体规范——把"选择责任"先立住

在开场群体规范里明确:AI可以给建议,但团队要对选择负责。

任何结论都必须说清"我们为什么信"。

群体规范:所有关键结论必须附带"反向选择/风险考量/信心区间"(防止被AI的流畅性绑架)。

R-Reflective(反应层面):流程设计——把三种选择力与判断力机制"流程化"

机制 | ToP工具应用 |

情境经验 | 用多场景对照训练模式识别;焦点对话挖掘深层模式 |

结果所有权 | 工作坊做"个人反思记录";约定群体回顾 |

传承制 | 资深者现场说出取舍逻辑(结构化对话),而不是只给答案 |

I-Interpretive(诠释层面):产出物——升级为"可校准的选择力与判断力资产"

共识工作坊三件套:

1,《选择思考单》:理由、风险、信心区间、谁负责

2,《反向选择》:哪些信息会让我们重新选择?要去哪里验证?

3,《下一步行动》:用什么具体行动验证选择

D-Decisional(决定层面):结构化对话——用对话保护"选择力与判断力训练"

会议里嵌入结构化对话时段,做"审查≠纠错"的学习式提问:

我们基于哪些信息?

忽略了哪些变量?

AI可能在哪里错?

最终检验(ToP式收尾)

共识工作坊结束时,不问"AI帮写了多少",只问—— 团队有没有更会分辨AI什么时候错?

核心共识:

AI让思考变得便宜,但不会替你承担后果。当商业规则被重构、经济范式被颠覆,未来组织之间真正的差距,不在工具,而在选择——以及组织有没有能力系统性地培养选择力与判断力。

最大的增长红利,来自基础设施的迁移。但当AI重构了一切,人类最后的、也是最高的壁垒,是基于价值观和直觉的终极选择力与判断力。

注:本文采用ToP(Technology of Participation/参与式技术)引导框架语境,核心结构包括:焦点对话(ORID四层次)、共识工作坊(Consensus Workshop)、行动计划(Action Planning)。

本文使用简化理解的ORID,目的是为引入基于现象学的ToP引导语境。

维特根斯坦的说法对于人类的贡献在于告诉我们:

“语言的边界真是人类思维的边界”,AI时代面对VUCA,我们不得不提升认知,而维度认知提升的第一步是学习新的语境所代表的思维范式。

添加下方微信

Charlie 18911394801(同微信)

Value People !

领程智达(北京)管理咨询有限公司(Leadership Management Community,LMC®)2010年成立于北京。

作为一家专注于帮助客户全方位优化改善并创造持续性业绩成功的公司,关注人与组织发展的各个领域,在过去的多年里,我们在战略举措清晰与共识、不确定时代的变革、业务模式创新、建立敏捷适应性组织、领导梯队建设、持续性发展人才队伍、高协作力团队建设、提高销售绩效、优化客户体验方面积累了丰富的科学专业及实践经验,构建完整且系统的组织学习解决方案,我们始终坚持:从界定未来企业需要的行为、意识和技能开始,将组织能力深度融合到组织战略中,协助企业的领导者打造真实活力型组织,落地客户战略,将愿景转化为现实。

夜雨聆风

夜雨聆风