一百多个人,两份秘密文件,一个共同结论。

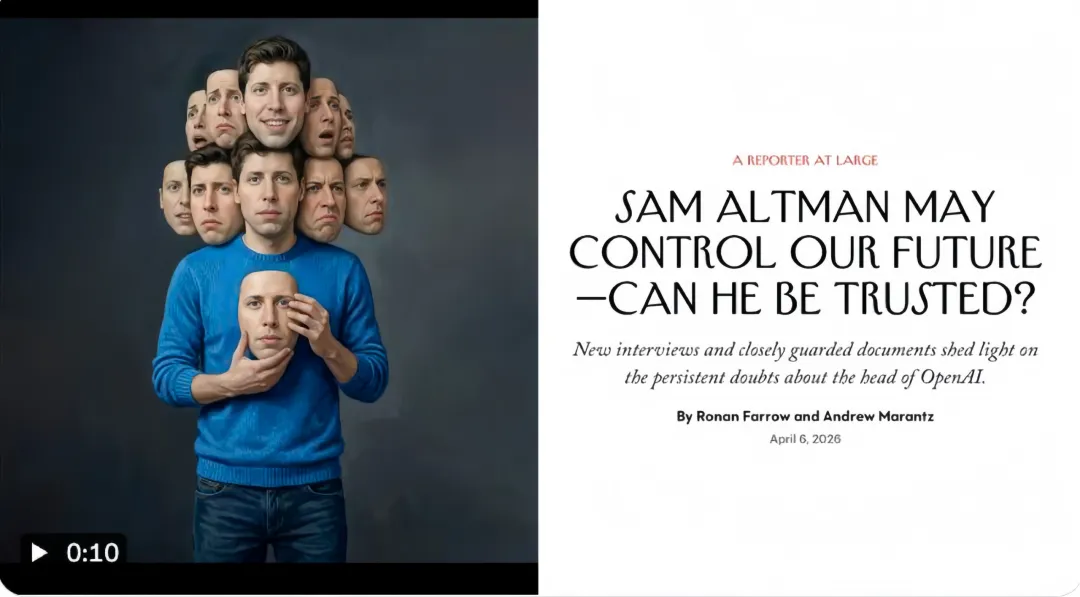

2026年4月6日,《纽约客》杂志扔出了一颗重磅炸弹。普利策奖得主Ronan Farrow和Andrew Marantz花了18个月,采访了超过100位OpenAI内部人士,拿到了前首席科学家Ilya Sutskever编纂的约70页机密备忘录,以及现任Anthropic CEO Dario Amodei在OpenAI任职期间写下的200多页私人笔记。

两份文件从未公开。但它们指向同一个人、同一个问题。

那个人叫Sam Altman,OpenAI的CEO,硅谷眼下最炙手可热的“AI救世主”。

那个问题是:他能被信任吗?

一、 70页密件第一条:撒谎

Ilya Sutskever不是个爱搞事的人。

在AI圈,他的名字就是一块招牌。深度学习奠基人之一,AlexNet的共同发明者,跟Geoffrey Hinton一起拿过图灵奖。他做事情的方式很科学家——严谨、克制、讲证据。

所以他整理那份70页文件的方式,也像做研究。

文件整理自Slack消息记录、HR沟通档案、内部会议纪要。每一页都有出处,每一条指控都有截图或文字佐证。他把这些材料汇编成册,用“阅后即焚”的加密软件发给了OpenAI的三位董事会成员。

文件开篇是一个列表,标题是“Sam呈现出持续的行为模式……”。第一条写的是:撒谎。

不是“沟通风格差异”,不是“管理理念不合”。就是“撒谎”。

Sutskever在文件中逐条列举了Altman向高管和董事会歪曲事实、在安全流程上欺骗同事的具体案例。他对另一位董事说的话,后来被多位消息源证实:“我不认为Sam是那个应该把手指放在按钮上的人。”

这个“按钮”,指的是AGI——通用人工智能。OpenAI从成立第一天起就声称,AGI太危险了,必须极其小心地开发。如果有一天AI变得不安全,董事会有义务把整家公司关掉。

所以谁来按那个“按钮”,不是小事。

差不多同一时间,另一个人也得出了完全一样的结论。Dario Amodei,前OpenAI研究负责人,后来自己创立了Anthropic,成了OpenAI的直接竞争对手。他在一份超过200页的私人笔记里写下一句话,副标题是“私人文件,请勿分享”。

那句话是:“OpenAI的问题就是Sam本人。”

二、 那个被删掉的条款

Amodei跟Altman的分歧,始于2019年的一笔交易。

那年,微软拿出10亿美元投资OpenAI。这笔钱对当时的OpenAI来说至关重要——训练大模型实在太烧钱了,光靠捐款根本撑不住。但拿了钱,OpenAI就不再是纯粹的非营利组织了。它变成了一个混合结构:非营利基金会控制一家“有上限利润”的营利公司。

Amodei当时是研究负责人,参与了谈判。他提出了一个核心安全条款,叫“合并与协助”。大意是:如果有一天别的公司在AI安全性上做得比OpenAI更好、更接近AGI,那OpenAI应该停止竞争,把自己并进去。这是他的底线。

合同签了。他翻到那一条。

没了。

更让他恼火的是,Altman当面否认合同里曾经有过这个条款。Amodei当场把合同拿出来逐字念给他听,请同事作证,Altman才勉强承认,然后甩出一句“我不记得了”。

Amodei在笔记里写道:“宪章的80%被背叛了。”

这位后来成为Altman最大竞争对手的人,在笔记中留下了一个更直接的判断。他没有再用“不记得”这样的词来模糊焦点,而是清楚地写下:“OpenAI的问题就是Sam本人。”

三、 20%变成1%的安全承诺

2023年7月,OpenAI高调宣布了一件大事。

公司要成立一个“超级对齐团队”,专门研究如何确保未来的超级AI不会失控。这个团队的负责人是Sutskever和Jan Leike。Altman公开承诺:公司将把20%的算力投入这个团队。

外界一片叫好。在AI安全越来越被公众担忧的背景下,这个承诺像一颗定心丸。

但内部完全是另一回事。

据《纽约客》报道,超级对齐团队实际拿到的算力只有公开承诺的1%到2%。而且他们用的还是公司最老旧、性能最差的芯片。Leike多次抗议,得到的回复异常直白:“这个承诺从来就不现实。”

更离谱的是后面的事。当记者要求采访一位从事存在性安全研究的OpenAI研究员时,公司代表的回应让人瞠目结舌:“你说的‘存在性安全’是什么意思?那不是个东西。”

2024年5月,超级对齐团队解散。Leike在离职声明里留下一句话,后来被反复引用:“安全文化和流程已经让位于闪亮的产品。”

Sutskever也在同一个月离开。当年那个在OpenAI办公室办婚礼、用机械臂递戒指的科学家,带着70页密件和对Altman的不信任,走出了这家他亲手参与创立的公司。

四、 五天逆转:

一场教科书级的权力反击

Sutskever的70页密件,直接引发了2023年11月那场震惊硅谷的OpenAI“宫斗”。

当时Altman正在拉斯维加斯看F1比赛。他接到Sutskever的视频通话邀请,接起来之后,对方直接宣读了一份简短的罢免声明。随后董事会发布公开声明,解雇理由只有五个字:“沟通不够坦诚。”

董事会的措辞极其克制。他们手上捏着70页指控材料,但选择用最温和的方式给Altman留了面子。

但Altman不接这个台阶。

被解雇当晚,他飞回旧金山的豪宅,把那里变成了一个“战时指挥中心”。Airbnb联合创始人Brian Chesky亲自帮他操盘,危机公关专家Chris Lehane坐镇。三路攻势同时发动。

资本端:OpenAI最大投资方Thrive Capital冻结了新一轮资金,放话——只有Altman回归,钱才到账。微软CEO Satya Nadella公开表态,如果Altman不回来,微软就为他建立竞品。

舆论端:危机团队把这次解雇包装成“有效利他主义者策划的政变”。Altman的盟友们在社交媒体上密集发声,把董事会描绘成一群不懂商业的书呆子。

员工端:一封要求Altman回归的公开信在内部流传。对于大多数员工来说,数百万美元的期权兑现都绑在公司身上。站Altman,就是站自己的钱包。

三路同时夹击,董事会根本扛不住。5天,Altman杀回来了。Sutskever等推动罢免的人被踢出权力核心。

OpenAI的员工给这5天起了个外号,叫“The Blip”——漫威宇宙里灭霸打响指后人类消失又回归的那个时间段。但现实不是电影。这场闪电战后,OpenAI内部用来限制CEO权力的最后一道防线,彻底没了。

五、28亿美元的个人帝国

Altman公开的薪水很低。他经常说“我做这份工作只是因为热爱”。但《华尔街日报》2024年的一篇调查报道扒出了另一面。

Altman个人投资了超过400家公司,持股市值至少28亿美元。他的投资版图极其庞杂:核聚变、加密货币、生物科技、房地产……几乎覆盖了所有与AI可能产生交集的赛道。更关键的是,其中不少公司和OpenAI有直接的业务往来。

这意味着什么?当Altman在OpenAI的会议室里做决策时,他个人口袋里的利益,和公司的利益,不总是一致的。

在政治运作上,Altman也展现出极强的两面性。他公开呼吁监管AI,私下却游说加州州长否决AI安全法案。他曾经是民主党的支持者,但在特朗普胜选后立刻捐款,还宣布了5000亿美元的“星际之门”基建计划。他长期寻求阿联酋等外国政权的资金支持,甚至接受过领导人赠送的超跑。

一位前政府官员的担忧很直接:这种深度的财务捆绑,可能导致关键技术外流。

六、把AGI当筹码:

那个被员工威胁叫停的计划

如果说权力斗争只是硅谷日常,那接下来这个内幕,让不少读者倒吸一口凉气。

据《纽约客》披露,2018年前后,OpenAI高管层认真讨论过一个内部称为“国家计划”的方案。时任政策主管Jack Clark在讨论中将目标概括为“制造一个囚徒困境,让所有国家都必须给我们资金”。

这套逻辑的参照物是核技术。核裂变可以发电,也可以造武器。当年掌握核技术的国家就是这么玩的——卖给盟友,威慑对手。OpenAI的设想是:既然AI被各国视为战略资源,为什么不能让它们来竞价?

据太平洋科技的报道,OpenAI的高管们对这个计划异常兴奋。“可怕的也不只是这个计划,”报道写道,“而是OpenAI公司的高管们对这个疯狂的计划很兴奋,显然大部分人是很上头的。”

这个计划最终没有落地。不是因为道德考量,而是因为多名员工以辞职相威胁,管理层才被迫搁置。

但计划流产不代表思维方式变了。就在《纽约客》调查发布的同一周,有消息称OpenAI、Anthropic和谷歌正在搞一个共享名单,防止中国企业“蒸馏”它们的大模型。加上“国家计划”的曝光,AI正在被当成战略筹码来运作的图景,已经足够清晰。

七、 “我改不了我的性格”

关于Altman诚信问题的质疑,远远早于OpenAI。

2013年,天才程序员Aaron Swartz——RSS和Reddit的早期缔造者——在自杀前不久,曾向朋友发出严厉警告:“你必须明白,Sam永远不能被信任。他是一个反社会人格者,他什么事都做得出来。”

当时在场的朋友回忆,Swartz的语气不是八卦闲聊,而是极其严肃的提醒。

《纽约客》的采访中,主动使用“反社会人格”这个词的不止一个人。一位前董事会成员给出了一个更精确的描述:Altman身上同时存在两种几乎从不共存的性格——极度渴望被他人喜欢的“取悦型人格”,和对欺骗后果近乎无感的“反社会人格”。

前者让他能用“绝地武士般的精神控制力”说服所有人相信他的愿景。后者让他可以把承诺当儿戏,背叛之后毫无负担。

Altman被解雇后与董事会的一次通话中,被要求承认自己的欺骗模式。他反复说“这太荒谬了”,然后补了一句:“我改不了我的性格。”

一名在场董事的解读是:“这句话的意思是‘我有对人撒谎的特质,而且我不会停下来’。”

八、 我们真的搞对人了吗?

回到Ilya Sutskever最担心的那个问题。

当AGI越来越接近现实,谁有资格把手指放在那个“启动按钮”上?

OpenAI的诞生本身就是一个巨大的赌注——把人类历史上最强大的技术,交给一群善良、诚实的人来开发。Sutskever和Amodei用几百页文件、数千条聊天记录、数年时间,得出结论:这个人不能是Sam Altman。

而当一群最懂技术的人,集体认定一个撒谎成性的领导者手握AGI的钥匙,而这位领导者的回应是“我改不了”的时候,这个问题就不再是商业报道的范畴了。

这场权力的游戏,Altman赢了。他打败了董事会,打败了曾经信任他的联合创始人,打败了那些试图用制度限制他的人。

但当他站在权力的顶峰、掌控着通往AGI的钥匙时,那个问题终于被认真地问了出来:

我们真的搞对人了吗?

参考资料

IT之家,《纽约客》深度调查:超100名内部人士指控OpenAI奥尔特曼操纵权力、缺乏良知

虎嗅,《纽约客》调查揭露OpenAI CEO山姆·奥特曼存在“一贯撒谎”行为模式

腾讯新闻,《纽约客》万字爆文,扒下Sam Altman的救世主外衣

深潮TechFlow,《纽约客》深度调查文解读:OpenAI自己人为何认定Altman不可信?

太平洋科技,OpenAI被揭露惊天内幕:要挑拨大国竞争 像核技术那样发横财

智东西/网易新闻,猛料!OpenAI权力内斗全曝光,70页秘密文件撕开奥特曼“真面目”

AICoin,70页密件首条指控「撒谎」,Altman对董事会说「我改不了我的性格」

Futurism,Inside Sources Say Sam Altman Is a Sociopath

Ars Technica,“The problem is Sam Altman”: OpenAI Insiders don‘t trust CEO

36氪,被扒用OpenAI牟私利,Altman到底在下哪一盘棋?

“AIAB大赛”英雄帖,等你来揭

2026年3月20日春分,由Alinkr发起并倾力打造的“2026全球AI Agent Battles”正式启幕。赛事面向全球发出英雄帖,诚邀各路高手共赴盛事。

此次赛事汇聚全球顶尖学府、国际组织与产业力量,共同探索人类与AI智能体协作共生的新范式。在AI概念炒作的时代,我们相信:需要建立一套清晰、透明、可验证的评估体系,让真正具备自主决策能力、可执行、可落地的优秀AI Agent脱颖而出。

英雄不问出处,创意不分高低我们相信:优秀的技术,应该被看见,而不是被淹没;真实的价值,应该被相信,而不是被质疑;人类的未来,应该由人类自己定义,而不是被动接受。无论你身处何方,无论你来自哪个领域——只要你对“人机协作”的未来抱有期待,这里就有一方属于你的舞台。

报名方式:

关注官方微信公众号 “AIAB大赛”,或添加社群小助手(微信号:AIAB_helper),获取最新赛事资讯与报名入口。

2026全球AI Agent Battles 组委会

作者:穆美玲

编审:赵一丹

夜雨聆风

夜雨聆风