引言:假如你有一个“永不疲倦的研究搭子”?

想象一下,凌晨一点,你还在为研究计划发愁。能一起讨论的人大多已经休息了,导师这时候也未必会及时回复,但一个生成式AI聊天机器人仍会在几秒内给你选题建议、研究问题、文献线索,甚至连方法设计都能帮你铺开。它像一个不会累的“研究搭子”,既迅速,又体面,看起来几乎完美。

问题是:当一个工具可以比同伴更快给出方向时,它究竟是在帮助你变得更会思考,还是只是在帮助你更快完成文本?更尖锐地说,AI到底是在扩展创造性问题解决(Creative Problem-Solving, CPS)的边界,还是在把本该属于人的探索过程压缩成一连串高效问答?其对话方式、学习感知和任务产出会不会发生较为稳定的变化?本文正是围绕这一假设展开。

*该图片由 MidJourney Anime V6 模型生成

与生成式AI聊天机器人的互动:揭示对话动态、学生感知及创意解决问题中的实践能力

文献来源:Song Y, Huang L, Zheng L, et al. Interactions with generative AI chatbots: unveiling dialogic dynamics, students’ perceptions, and practical competencies in creative problem-solving[J]. International Journal of Educational Technology in Higher Education, 2025, 22(1): 12.

摘要

本研究探讨了由生成式人工智能(GAI)赋能的聊天机器人在支持大学生创造性问题解决(CPS)方面的有效性。研究采用准实验设计,比较学生分别与:(1)GAI聊天机器人,以及(2)同伴互动时,在CPS中的对话动态、学习者感知和实践能力表现。共有80名研究生参与,承担的CPS任务为撰写一份创新性研究计划书。研究发现,两类互动中的对话交流存在显著差异。学生—GAI聊天机器人互动呈现出更多基于知识的对话和展开性讨论,而主观表达少于学生—同伴互动。值得注意的是,学生在与GAI聊天机器人互动时的发言量显著少于与同伴互动时。学生—GAI聊天机器人的对话交流倾向于呈现较为清晰的模式,而学生—同伴互动的对话则更难预测。学生认为,与GAI聊天机器人互动比与同伴互动更有用、也更容易。此外,在利用GAI聊天机器人完成CPS任务时,学生表现出更高的使用意愿。最终,通过与GAI聊天机器人的互动,学生的实践表现得到显著提升。本研究表明,审慎使用基于GAI的技术有助于促进大学生的学习成效。

研究背景与问题提出

该研究讨论的是,生成式AI聊天机器人能否真正支持高等教育中的创造性问题解决任务。与不少研究主要考察语言学习、编程练习或一般写作支持不同,作者把研究放在研究计划写作这一更接近真实学术场景的任务中。研究计划书写作既要求学生提出有价值的问题,也要求其整合文献、设计方法并说明创新点,因此能较好呈现创造性问题解决的完整过程。文章也没有只看最后分数,而是把对话动态、学习者感知和任务产出放在同一框架中考察,这使研究的解释力更强。

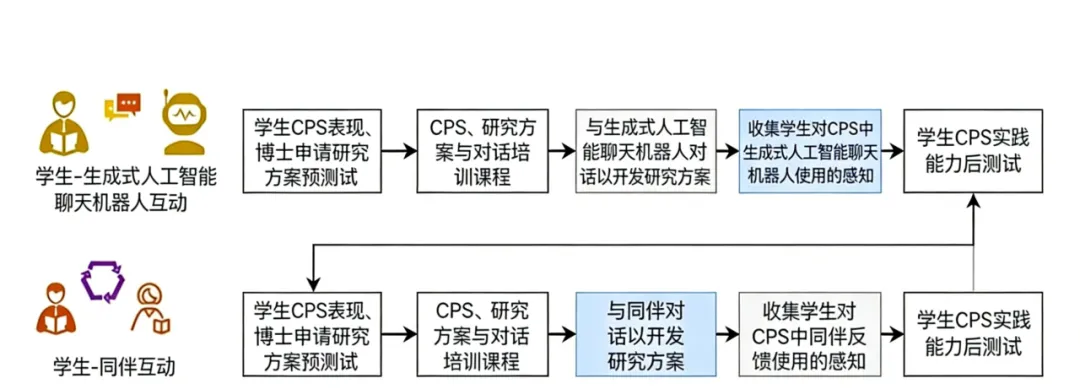

研究设计:让AI和同伴分别做“研究搭子”

研究采用准实验设计,共纳入中国南方一所高校80名博士研究生,其中实验组40人,个体与豆包聊天机器人互动;对照组40人,与自选同伴围绕同一任务展开讨论。整个实验持续3个月,核心对话活动连续5周进行,每周1次、每次30分钟,主题依次为确定研究主题、澄清研究问题、检索综述文献、形成研究设计以及识别研究原创性。研究以前期申博材料中的研究计划书作为前测,实验结束后提交的新研究计划书作为后测。

作者设置了三类指标。其一,对话动态,采用CI-PCD编码框架分析先验知识、主观表达、展开、协调、推测和建构等话语类型,并结合序列分析观察不同话语之间的转化关系。其二,学习感知,借助技术接受模型比较两组在感知有用性、感知易用性和未来使用意愿上的差异,并辅以访谈资料。其三,实践表现,在控制前测成绩的基础上,使用协方差分析比较两组后测研究计划书得分。作品评分涵盖研究目标、问题与假设、文献综述、研究设计与方法以及原创性等维度,评分前进行了匿名化处理,并由两名独立评分者完成评定。

研究发现

对话动态:两类互动在话语结构上存在显著差异。与学生—同伴互动相比,学生—GAI聊天机器人互动中,知识型对话与展开性讨论更多,而主观表达更少。论文报告显示,知识型对话均值在实验组高于对照组(0.16>0.13,t=2.017,p=0.049),主观表达显著更低(0.06<0.13,t=-6.000,p<0.001),展开性对话也更高(0.16>0.13,t=2.218,p=0.030)。进一步看,聊天机器人提供的先验知识、展开和协调性回应均显著多于同伴;但学生在与聊天机器人互动时,自身贡献的先验知识、主观表达与协调性发言均显著减少。序列分析还显示,学生—GAI聊天机器人的对话路径更清晰,常表现为学生发起问题后,聊天机器人先给出基于先验知识的回应,再引出学生进一步追问解释与展开;而学生—同伴互动的路径则更分散。

学习感知:独立样本t检验表明,实验组在感知有用性、感知易用性和未来使用意愿三个维度上均显著高于对照组。其中,感知有用性均值分别为3.64和3.14(t=3.54,p<0.001),感知易用性分别为3.94和3.40(t=2.47,p<0.05),未来使用意愿分别为4.22和3.26(t=4.53,p<0.001)。访谈资料也显示,学生普遍认为聊天机器人响应快、操作便捷,并能够在研究问题凝练、文献梳理和方法建议等方面提供帮助。

实践表现:作者采用ANCOVA比较两组研究计划书得分。在方差齐性与回归斜率齐性假设均满足的前提下,结果显示两组后测得分存在显著差异(F=15.058,p<0.001),且学生—GAI聊天机器人互动对实践表现具有较大效应量(Partial η²=0.179)。实验组后测均值为57.77,对照组为46.38。说明在这项研究中,与聊天机器人互动的学生最终提交了质量更高的研究计划。

结论与启示

01

讨论与总结:AI是“会解释的顾问”

还不是“会共创的伙伴”

总体来看:该研究为GAI聊天机器人支持大学生创造性问题解决提供了较清晰的经验证据,说明聊天机器人能够改善复杂文本任务中的对话组织、学习感知与作品表现。

教学启示:生成式AI在创造性问题解决中最擅长的,是提供结构化支架;最不擅长的,是替代真正的人类共创。更合适的做法不是让聊天机器人取代同伴互动,而是在复杂任务中把它作为辅助支架使用,用它帮助学生梳理知识、推进问题、搭建方案,把观点碰撞、质疑与论证更多留给人与人的交流。

02

深度思考:它告诉了我们什么

也遗漏了什么

值得肯定的是:这项研究没有停留在“AI有没有用”的简单比较上,而是把互动过程、学习感知和任务产出放在一起考察,因此不仅回答了“是否有效”,也解释了“为什么会有效”。研究任务也较真实,能反映研究生处理开放性学术任务时的状态。

也需要看到:聊天机器人虽然在知识供给、解释展开和信息组织上表现出较强支架作用,但学生在互动中的主动表达和协调性发言有所减少。作品表现的提升,并不等于学习者主体性和独立迁移能力同步增强。这也是后续研究仍需继续追问的地方。

也许,未来最好的教育型AI,不该只是一个更会回答的系统,而应是一个知道何时该追问、何时该停顿、何时该把问题还给学生的系统。真正好的技术,不是替学生把路走完,而是让学生在更清楚地看见道路之后,仍愿意自己迈步。

摘编 | 李贝宁

排版 | 丁 戈

审核 | 嵩 天、单捷飞

夜雨聆风

夜雨聆风