翻一翻历史K线,会发现光模块的新**,从2025年4月最低点65元,到昨天的522元,涨了10多倍(没算错,2025年5月10股转4股,实际涨了10倍多 )

)

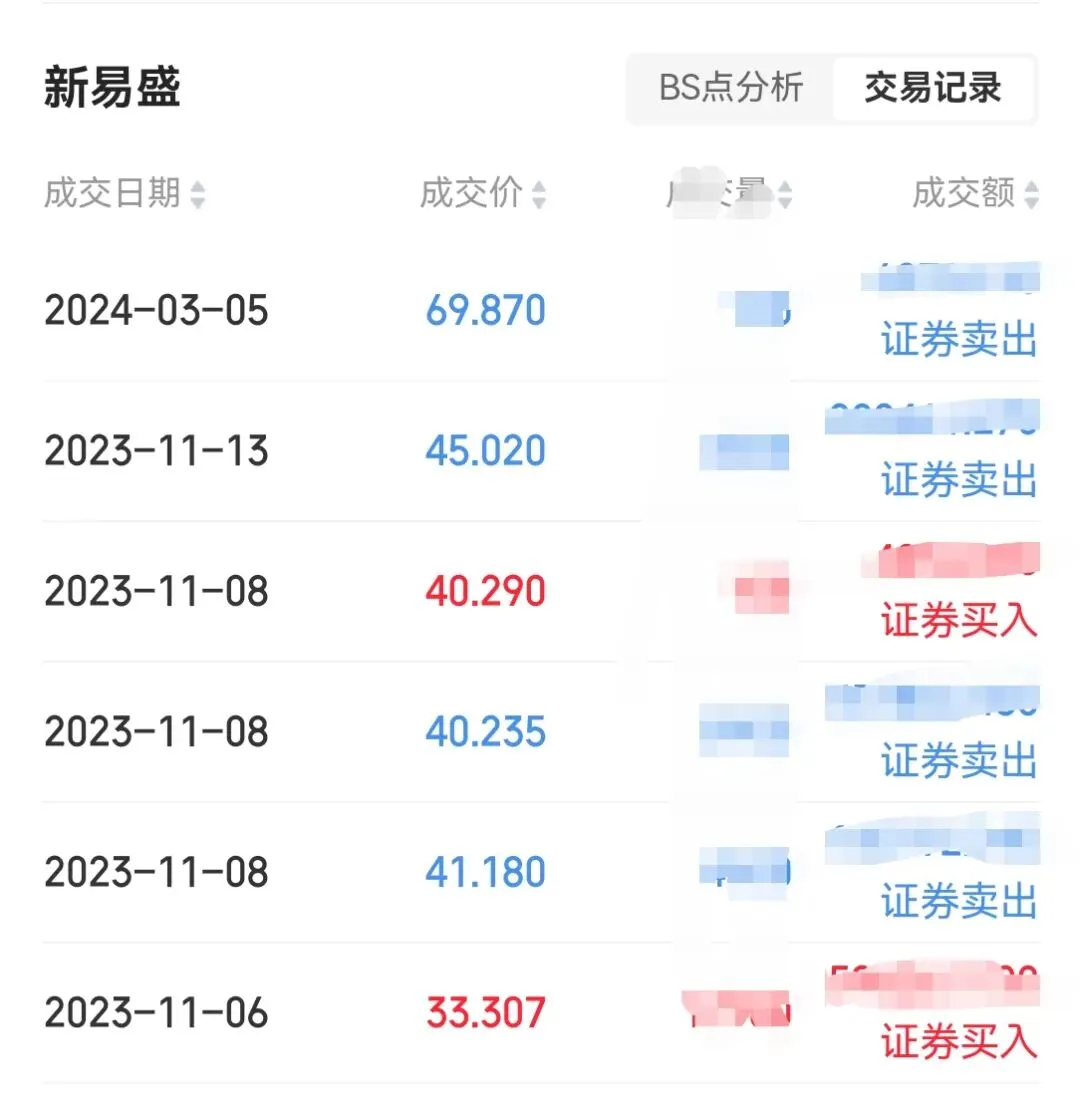

我自己是2023年底开始买的,当时价格33,拿了一段时间后清仓了,最后一笔是69.87卖的,总体大概赚了三四十个点,卖出后看着它继续一路狂飙,又涨了10倍多,这种滋味,酸爽。

近来我反复琢磨,到底是什么原因,让我在这种10年一遇的大牛股启动前下车的?

我当时是做过功课的,把光模块的技术看了好几遍,最后得出的结论是AI服务器对CPO的需求肯定比传统服务器大,但顶天了也就两三倍的增量,行业空间并不大,股价的涨幅已经反映这个利好了,该落袋为安了。

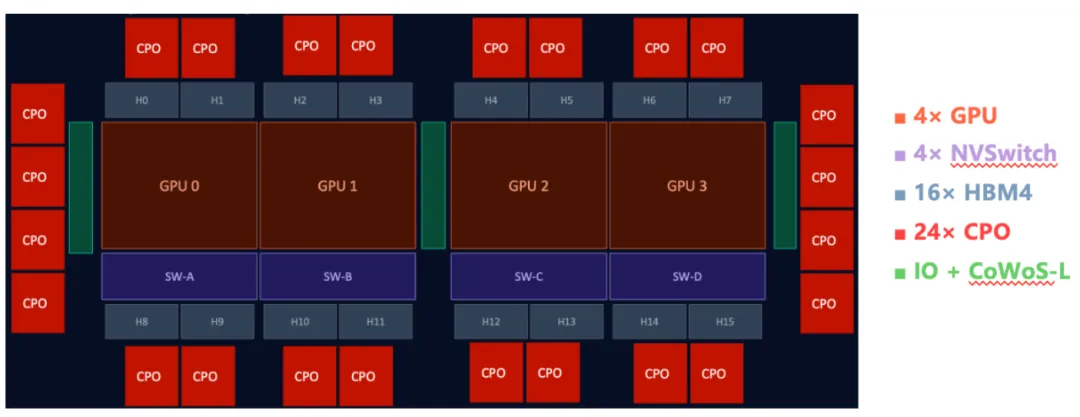

直到最近,我看到一张AI服务器的内部架构图,再结合行业数据一复盘,才发现自己真是的半瓶子水,错得有多离谱。

4块GPU就要配24个CPO,光模块用量是传统服务器的6-8倍,根本不是一个概念,并且光模块在不停地更新迭代,从400G、800G,到1.6T,真的是赚麻了,新**的利润从2023年的6.8亿,增到了去年的96.5亿。

所以错过10倍天经地义,因为自己纯粹是用脑子里的老经验,去毛估AI时代的新需求,用“宁要模糊的正确,不要精确的错误”麻痹自己,完全错估了行业空间。

现在我也在想,市场已经把AI相关的CPO、存储、光纤、PCB板炒了一个遍,还能不能发掘新机会?今天跟朋友聊了聊,费了一批脑细胞后,想到了一个还不错的点,写出来供参考。

AI最开始的主要应用是“问答推理”,算力瓶颈主要在GPU,随着各种龙虾的崛起,AI 正在从简单的“问答推理”转向“智能体 Agentic 工作流”,智能体在自动写代码、调用数据库、进行物理模拟时,需要极其密集的 CPU 资源,而不是GPU资源。

因为GPU擅长并行计算,但办公及日常的龙虾需求,是串行任务居多,还是要依赖传统的CPU。

以前一台 8 卡 GPU 服务器,配 2 颗 CPU 就够,现在不一样了,单颗 GPU 就要配 86-120 个 CPU 核心,因为GPU太快了,CPU相比GPU,太慢了。

所以,AI的这个板块,也许可以研究。

夜雨聆风

夜雨聆风