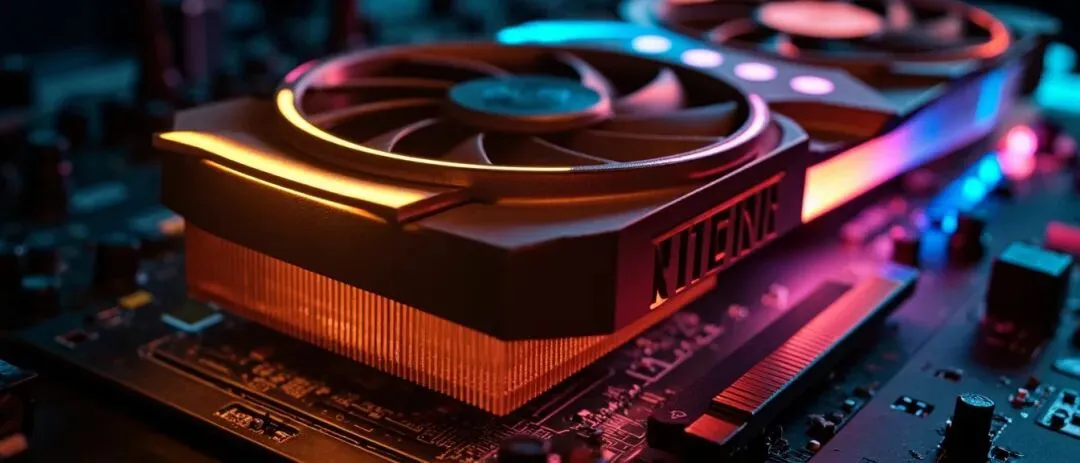

前几天刷到一个帖子,有个哥们儿晒了他买显卡的账单,RTX 5090,两千美元出头。

底下评论炸了。

有人骂黄仁勋疯了,有人开始算自己用了五年的1070还能撑多久,还有人直接放弃了,跑去买游戏本。

其实大家隐约感觉到了什么,但又说不太清楚。

这东西为什么越来越贵?

真的只是因为黄牛囤货、供应链紧张吗?

真正的原因藏得更深一点。

你有没有发现,AI出现之后,理论上应该让科技产品变便宜的东西,反而开始变贵了。这听起来有点反直觉,但底层逻辑其实不复杂。

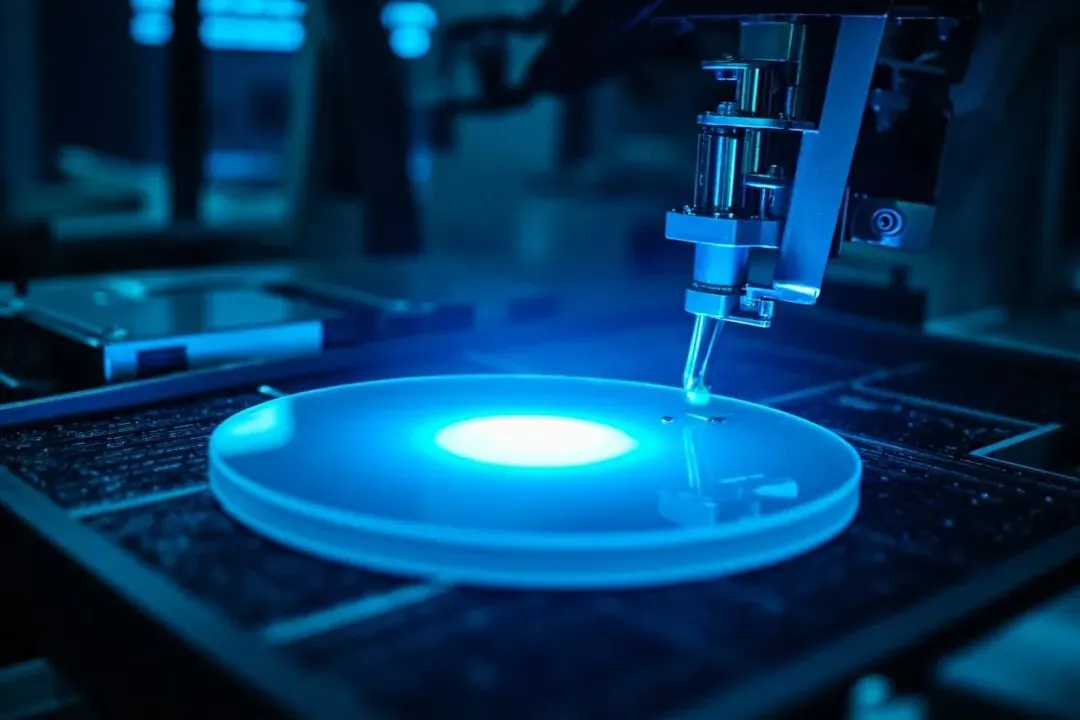

我们先从一块芯片是怎么造出来的说起。

现在全球最先进的芯片制造,全在台积电手里。

三星勉强能跟上,但成熟度和产能都差一截。

台积电最新一代制程,2纳米,一块晶圆的代工价格已经冲到了三万美元往上。

什么概念呢,就是你让工厂帮你生产一块这么大尺寸的硅片,他们收你三十万人民币。这不是出厂价,这是成本价。

这还只是一块什么都没有的晶圆,后面还要切割、封装、测试,每一步都在加钱。

回到十年前,28纳米的代工价格大概是三千美元一块。

现在最新的制程,价格涨了快十倍,但晶体管密度可没有扩大十倍。这中间的钱去哪了?

答案很简单,物理极限的代价。

制程越往下走,每缩小一纳米,要解决的基础物理问题就多一层。

漏电、散热、量子隧穿效应,每个都是硬骨头。

这些问题的解法没有巧劲,全靠真金白银砸出来的工艺。

现在AI又在这个基础上猛踩了一脚油门。

AI模型训练需要海量内存,尤其是那种带宽超高但贵得要命的HBM内存。

HBM3的价格从去年到现在涨了超过六成,而一块AI服务器里动不动就装八张卡。

你算算,光内存成本就变成了什么样。

手机行业也有类似的故事。

这两年手机厂商推新机,重点宣传的不是像素、不是续航了,全在讲AI芯片。

什么本地大模型运行、AI消除、AI助手。

这些功能听起来是在手机上免费送的,其实不是。

这些能力对芯片有额外的要求,不是老机型系统更新就能有的。

所以你换手机的速度,可能被迫加快了。

说到这个,我自己去年就体验了一回。

我的旧手机其实完全够用,但新系统装上之后,AI功能死活跑不动,提示器跑半天没反应。

那一刻我才意识到,这不是系统淘汰了你,是芯片架构淘汰了你。

云端服务的订阅费也在悄悄涨价。

ChatGPT Plus、Claude Pro、国内的文心一言会员,这些服务从去年开始都在调价。

幅度不大,但信号很明显。

AI服务不是零边际成本的云计算,它背后跑的是GPU集群,每小时的电费和折旧都是实实在在的。

用户多了,成本跟着涨,涨价就成了唯一的选择。

还有一点很多人没注意到。

AI时代的硬件涨价不只是芯片本身,散热和供电也在跟着涨。

跑AI模型的芯片发热量比传统处理器高得多,数据中心现在最头疼的问题不是算力不够,是散热跟不上。

一台服务器想要稳定运行,空调和冷却系统的成本有时候比芯片本身还高。

这些费用最终都会转嫁到云服务价格上,然后到你我每个月的订阅费里。

这个逻辑链条很简单,AI需要更强的芯片,更贵的制程和封装,更高的散热和电力需求,最终传导到更贵的终端产品和订阅服务。

回到开头那张显卡。

你以为买的是一张打游戏用的显卡,其实买的是一张能跑AI推理的小型服务器。

显卡的核心功能从渲染画面变成了跑模型计算,这两件事对硬件的要求完全不一样。

游戏只需要即时响应,AI需要的是算力密度和内存带宽,这些东西本来就贵。

所以问题不是显卡会不会降价。

问题是你想让设备陪伴你多久。

如果你是那种买一台电脑要用七八年的人,现在买电子产品的思路可能要调整了。以前买电脑,看CPU主频、内存大小、硬盘容量,这些参数用十年都不会太差。

但AI时代不一样,芯片架构决定了它能不能跑某一类模型,这个能力是有保质期的。

说这么多,不是要制造焦虑。

只是想让你在掏钱的时候多想一步,你买这个东西,准备用多久,以及它还能在AI时代里活多久。

❤️ 如果文章对你有价值,点赞 与 转发,是我持续创作的动力

🎓 如果想第一时间收到推送,也可以给我个星标⭐~

"囤词元能暴富"是骗局|词元(Token)非投资属性,AI概念炒作新坑

28岁程序员用DeepSeek写歌卖出5位数:AI时代「一人公司」变现

甲骨文3万人深夜裁员:业绩暴涨95%,资本却在把"人"换成"芯片"

夜雨聆风

夜雨聆风