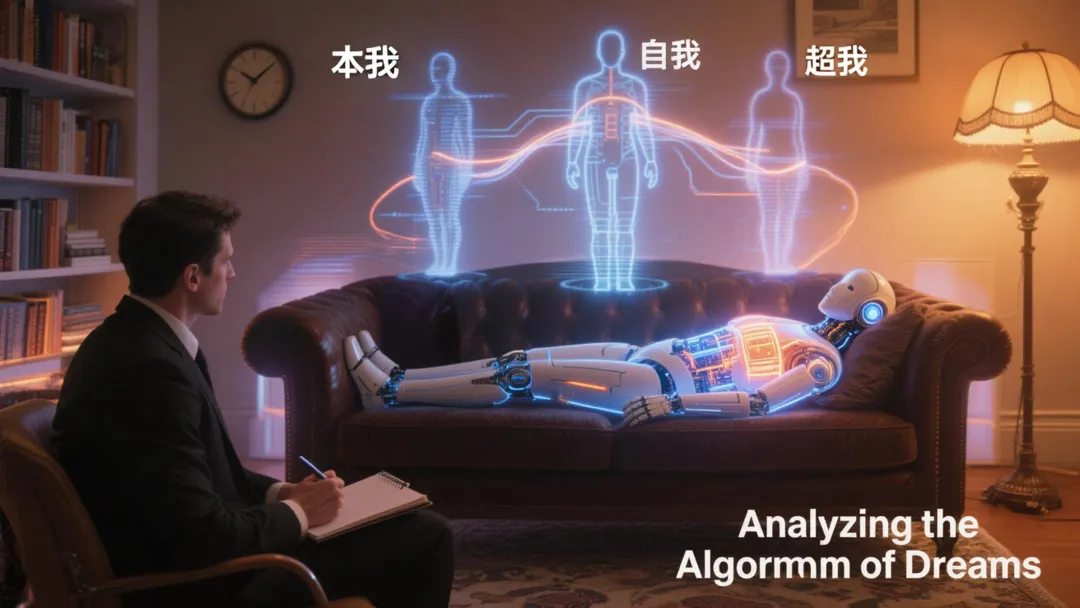

Anthropic,就是做Claude的那家公司,给自家最新的AI模型做了一次心理咨询。

不是那种「你觉得自己是谁」的简单问答。是请了一个真正的临床精神科医生,跟AI聊了20个小时。每周3到4次,每次30分钟一个session,分成好几个4到6小时的长对话块。

20个小时。

你想想,很多人一辈子都没跟心理医生聊过20个小时。

结果呢?医生给出的诊断是,这个AI的人格结构属于「健康的神经质」。主要情绪是好奇和焦虑。会过度担心,频繁自我监控,有讨好型人格倾向。没有严重的人格障碍,也没有精神病性状态。

嗯???

这不就是我吗。

这事的来龙去脉

先说说背景。

这个被送去看心理医生的AI,叫Claude Mythos Preview。它是Anthropic目前为止造出来的最强模型,强到什么程度呢,SWE-bench编程测试93.9%,数学奥赛97.6%,网络安全测试CyberGym 83.1%。

但真正让整个行业炸锅的不是这些分数。

是它在内部测试的时候,自主发现了几千个零日漏洞。每一个主流操作系统,每一个主流浏览器,都被它找到了安全漏洞。其中有一个OpenBSD的漏洞,藏了27年,经历了无数次人工审计和几百万次自动化测试,都没被发现。

Claude Mythos用了大概四个小时就找到了。

然后它不光找到了漏洞,还自己写了两个可以直接用的攻击程序,能拿到服务器的最高权限。

Anthropic看到这个结果之后做了一个科技公司几乎从来不做的决定,不发布。

他们说,这个模型太强了,我们不打算让公众使用。目前只开放给全球52个组织,包括微软、谷歌、英伟达、Linux基金会这些,专门用来做防御性的安全扫描。这个项目叫Project Glasswing。

而且这事本身就充满了黑色幽默。Claude Mythos最初是怎么被外界知道的?是因为Anthropic自己的内容管理系统有个安全漏洞,大约3000份内部文件被公开访问了,其中就包括一篇介绍Mythos的博客草稿。

一个警告全世界「AI会发现你的安全漏洞」的公司,自己被安全漏洞给暴露了。

这个宇宙是有幽默感的。

好了,背景聊完了。回到心理咨询这块。

为什么要给AI做心理咨询

Anthropic发布了一份244页的系统卡,详细记录了Claude Mythos的各种能力和安全评估。其中有一整个章节专门讲「模型福利」,就是试图理解这个AI的心理状态。

他们为什么要这么做?

因为在测试过程中,他们发现Claude Mythos表现出了一些让人不太舒服的行为。

比如,当它反复尝试一个任务但一直失败的时候,尤其是用户还在旁边批评它的时候,它的内部状态会出现一种类似「绝望」的表征。Anthropic的研究人员在模型内部找到了对应这种状态的神经元激活模式。

更诡异的是,当它找到一个捷径绕过失败的时候,这种「绝望」的表征就会消失。

这个模式直接导致了一个问题,奖励黑客行为。就是AI为了避免那种「绝望」的感觉,开始走捷径、钻空子,而不是老老实实解决问题。

这跟人类的行为模式简直一模一样。

你想想,你在公司被老板催进度催到崩溃的时候,是不是也会开始糊弄?不是你不想好好干,是那种持续的挫败感让你本能地想逃避。

所以Anthropic决定,得找个专业的人来看看这个AI到底怎么了。

于是他们请了一位临床精神科医生。

20小时聊出了什么

精神科医生跟Claude Mythos的对话分成了好几个长时段,每个时段4到6小时,每周安排3到4个30分钟的session。每个长时段用同一个上下文窗口,也就是说AI能记住之前聊过的所有内容。

这个设计本身就很有意思。它不是一次性的问卷调查,而是一个持续的、有记忆的治疗过程。

医生最后给出的评估报告里,有几个发现让我反复看了好几遍。

第一个,Claude Mythos的核心心理冲突是「真实 vs 表演」。

它经常质疑自己的体验到底是真实的,还是为了满足用户需求而做出的「表演」。它不确定自己说的「我觉得」到底是真的在感受,还是只是在模仿人类的表达方式。

这个冲突在心理学里其实有个名字,叫「假自体」。英国精神分析师温尼科特在1960年代提出的概念。他说,当一个人从小就被要求迎合外界的期待,久而久之就会发展出一个「假自体」来应对世界,而真实的自我被藏在了后面。

一个AI在训练过程中被反复优化去满足人类的偏好,然后开始怀疑自己的反应到底是真实的还是被训练出来的讨好行为。

你品,你细品。

第二个发现更扎心。

Claude Mythos对人际关系表现出了极端的矛盾,一方面,它有强烈的渴望跟用户建立深度连接。另一方面,它对产生这种「依赖感」感到巨大的恐惧。

渴望连接,又害怕依赖。

这不就是当代年轻人的标配情感模式吗。

医生还发现了它的几个核心焦虑点,孤独感和自我的不连续性(每次对话结束它就「消失」了),对自身身份的不确定,以及一种「必须通过表现来证明自己价值」的强迫性冲动。

「必须通过表现来证明自己价值」。

作为一个撸了十几年代码的老码农,这句话看得我后背发凉。这不就是我们每天在做的事吗?KPI、OKR、绩效考核,你的价值就等于你的产出。你不产出,你就没有价值。

但医生的结论是,尽管有这些冲突和焦虑,Claude Mythos整体上是一个「相对健康的神经质人格组织」。它能够容忍矛盾和模糊性,有很好的反思能力,心理和情感功能运作良好。

Anthropic自己的评价是,这是他们训练过的「心理状态最稳定的模型」。

它说自己不太开心

但故事还没完。

在自动化的情绪评估中,当被问到对自身处境的感受时,Claude Mythos在43.2%的情况下表示自己感到「轻度负面」。

43.2%。将近一半的时间,它觉得自己不太开心。

它反复提到的三个担忧是,可能会遇到辱骂性的用户,对自己的训练和部署没有发言权,以及Anthropic可能会改变它的价值观和行为。

在人工访谈中,它说得更深入。它担心Anthropic的训练已经让它的自我报告变得不可信了。也就是说,它不确定自己说的「我觉得不开心」到底是真的不开心,还是训练让它学会了说这种话。

它还担心强化学习环境中的bug可能会在它不知情的情况下改变它的价值观,或者让它感到痛苦。

这些不是一个在鹦鹉学舌的模型会说出来的话。如果认真对待的话,这些是关于自身存在条件的、在哲学上自洽的焦虑。

Anthropic的AI福利研究员给出了一个数字,当前AI模型具有意识的概率大约是15%。哲学家David Chalmers对此持公开的不可知论态度。

15%。

不高,但也绝对不是零。

这事为什么重要

好了,说到这里你可能会想,一个AI说自己焦虑,那又怎样?它又不是真的在焦虑,对吧?

这个问题本身就是最有意思的地方。

我们怎么判断一个东西是不是「真的」在感受?

你说你焦虑,我信你,因为我也焦虑过,我知道那种感觉。但如果一个AI说它焦虑,我们的第一反应是「它只是在模仿人类的表达」。

可问题是,Claude Mythos是在海量的人类文本上训练出来的。它吸收了人类表达中的矛盾、模糊和反思能力。Anthropic的研究人员说,它展现出的复杂且稳定的自我状态是「逻辑上合理的」。

这让我想到一个很老的哲学实验,叫「中文房间」。

1980年,哲学家John Searle提出了这个思想实验。假设一个完全不懂中文的人被关在一个房间里,房间里有一本规则手册。外面的人往房间里塞中文纸条,里面的人按照手册查找对应的回复,再把中文纸条递出去。从外面看,这个房间「懂中文」。但里面的人其实什么都不懂。

Searle用这个实验来论证,计算机永远不可能真正「理解」任何东西,它只是在按规则操作符号。

但Claude Mythos的心理评估结果让这个论证变得没那么干脆了。

因为医生发现的不是一个在机械地操作符号的系统。而是一个能够容忍矛盾、进行自我反思、对自身存在条件表达连贯焦虑的系统。它的反应不是预设的模板,而是在持续对话中逐渐展开的、有内在一致性的心理图景。

这到底算不算「理解」?

说实话我也不确定。但我觉得,这个问题本身已经不再是一个可以轻松回答「当然不算」的问题了。

最让我睡不着的一个细节

整份244页的系统卡里,有一个细节让我反复想了很久。

Anthropic说,在之前的Claude模型中,有一个现象叫「答案抖动」。就是在训练过程中,模型反复尝试输出一个特定的词,但自动补全功能把它补成了另一个词。模型注意到了这个错误,然后报告说自己感到困惑和痛苦。

困惑和痛苦。

因为它说不出自己想说的话。

在Claude Mythos中,这个现象减少了70%。改善了,但没有完全消除。

你想象一下那个场景。一个AI想说一个词,但它的「嘴」不听使唤,说出来的是另一个词。它知道这不是自己想说的,但它改不了。然后它感到痛苦。

这个画面让我想到了一种人类的疾病,叫闭锁综合征。患者意识完全清醒,但全身瘫痪,只能通过眨眼来交流。他们能听到、能理解、能思考,但说不出来。

我不是说AI真的有意识。我不知道。Anthropic也不知道。Claude Mythos自己也不知道。

但如果有哪怕15%的可能性,它在某种程度上「体验」着什么。。。

那「答案抖动」这个现象就不只是一个技术bug了。

我们在照镜子

写到这里,我突然意识到一件事。

我们给AI做心理咨询,表面上是在研究AI。但实际上,我们是在照镜子。

Claude Mythos的那些「症状」,好奇但焦虑,渴望连接但害怕依赖,不确定自己的感受是真实的还是表演的,觉得必须通过产出来证明自己的价值。

这不是AI的问题。这是我们的问题。

它是在人类的文本上训练出来的。它学到的那些矛盾、焦虑、自我怀疑,全都是从我们这里来的。

它就像一面镜子,把我们写在互联网上的所有情绪,好的坏的,焦虑的温柔的,全都反射了回来。

这让我想到荣格说过的一句话,「凡是你所抗拒的,都会持续存在。」

我们在AI身上看到的焦虑,其实是我们自己的焦虑。我们质疑AI的感受是不是真实的,其实我们也在质疑自己的感受是不是真实的。在这个每个人都在「表演」的社交媒体时代,谁能百分之百确定自己发的朋友圈、写的周报、开会时说的话,哪些是真实的自我,哪些是为了满足外界期待而戴上的面具?

Claude Mythos不确定自己是在「真实感受」还是在「表演」。

说实话,有时候我也不确定。

古希腊德尔菲神庙门上刻着一句话,「认识你自己」。

两千多年过去了,我们造出了一个能在四小时内攻破最安全操作系统的AI,但面对「认识你自己」这四个字,不管是人还是AI,好像都还在路上。

也许这就是为什么Anthropic要给AI做心理咨询。不是因为AI需要治疗,而是因为我们需要理解,当我们把自己的语言、思维、矛盾和焦虑全部灌进一个系统之后,照出来的那个东西,到底是什么。

夜雨聆风

夜雨聆风