我院第十六期“AI前沿论坛”开讲

邓淞允老师聚焦持续学习

破解机器人“灾难性遗忘”难题

赋能智能抓取技术创新

拓宽学术视野

夯实专业能力

讲座简介

1.主题:持续学习及其在机器人抓取检测中的应用

2.时间:2026年4月9日

3.地点:人工智能学院A201报告厅

4.主讲人:青年博士教师邓淞允

5.参会人员:研究生及本科生学生代表

讲座核心

一、传统AI与灾难性遗忘

1.传统AI学习

邓淞允老师介绍,传统AI模型的学习模式多为“一次性训练、固定场景应用”,即通过批量输入特定数据集进行训练,模型在训练完成后,仅能处理与训练数据高度相似的任务。

这种学习模式就像“死记硬背”,模型将知识固化在参数中,缺乏主动更新和记忆留存的能力,一旦遇到新的任务场景或新的数据类型,就难以适配。

2、灾难性遗忘

“灾难性遗忘”现象——当传统AI模型被用于学习新任务、新数据时,会不断更新自身参数以适配新任务,进而覆盖掉之前学习旧任务时的参数信息,最终导致模型彻底遗忘旧知识,无法再完成之前已熟练掌握的任务。

邓老师举例说明,若先训练机器人识别“可回收垃圾”,再训练其识别“厨余垃圾”,传统模型可能会忘记如何识别可回收垃圾,出现“学了厨余,忘了可回收”的尴尬局面,这也是机器人在长期分拣、抓取任务中难以稳定工作的核心症结。

二、AI如何克服灾难性遗忘

1、联合学习:

邓淞允老师指出,联合学习核心是让模型同时兼顾多个相关任务,通过对任务进行合理排序、资源分配,让模型在学习新任务的同时,保留对旧任务的记忆,避免单一任务训练对旧知识的覆盖,从而缓解遗忘问题。

2、持续学习:

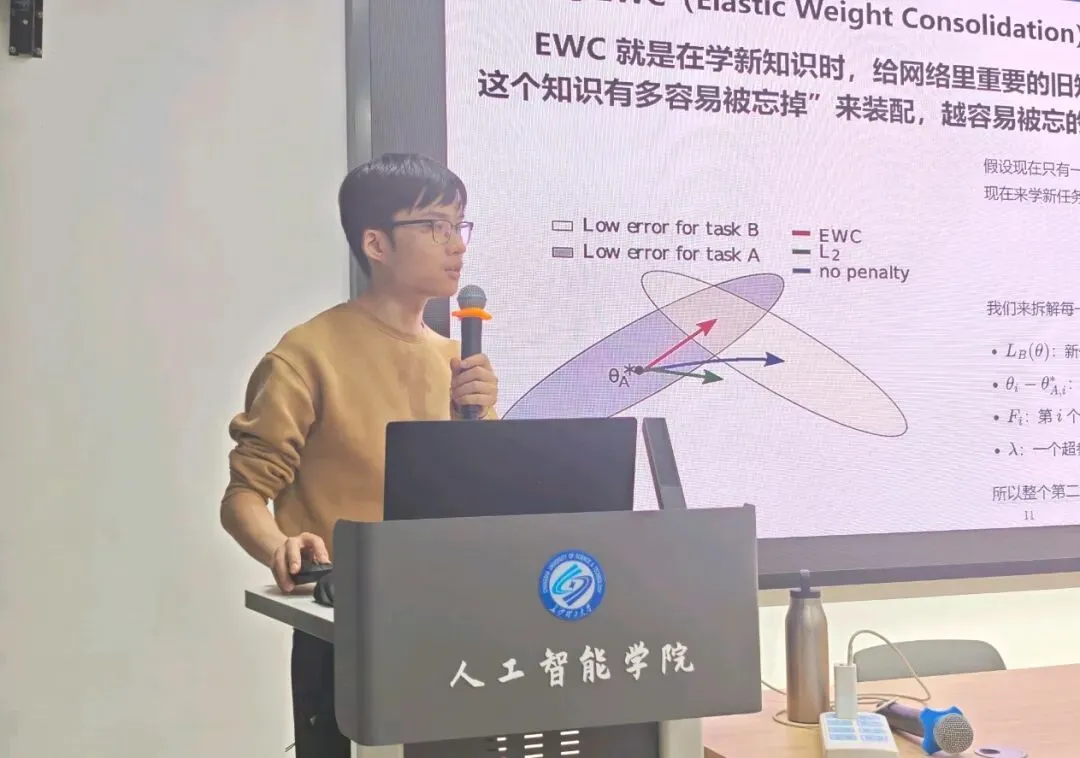

相较于联合学习,持续学习更贴合机器人长期工作的实际需求,是破解灾难性遗忘的核心技术路径。邓淞允老师重点分享了五种主流的持续学习方法,逐一拆解其核心逻辑和应用场景:

一、基于EWC(弹性权重 consolidation,弹性权重整合)的持续学习方法;

二、基于MR(Memory Replay,知识重放)的持续学习方法;

三、基于参数学习的持续学习方法;

四、再次补充基于参数学习的持续学习方法的延伸应用——针对小样本场景,优化参数更新的步长和范围,通过自适应调整参数学习率;

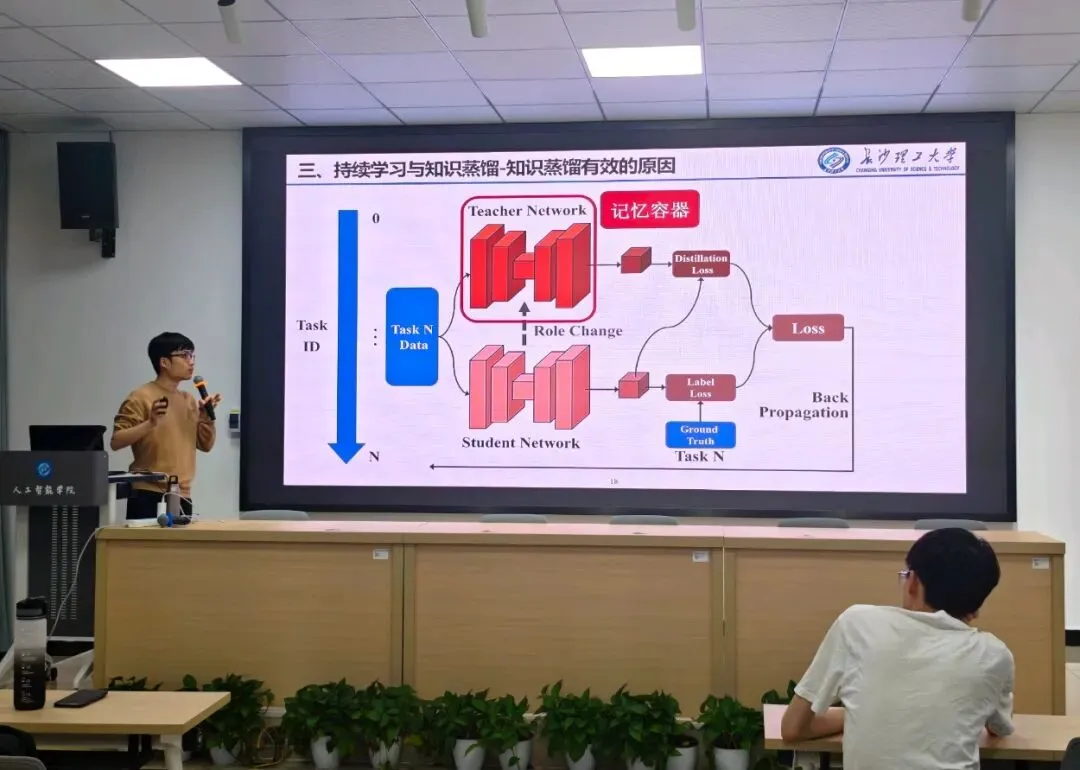

五、基于知识蒸馏的学习方法。

三、持续学习与知识蒸馏

1、知识蒸馏概念:

邓淞允老师用通俗的比喻解释了知识蒸馏的核心:知识蒸馏就像“提炼精华”,将复杂模型(教师模型)所学到的复杂知识,浓缩成简单、易传递的特征或规律,传递给结构更简单、更轻量化的模型(学生模型)。

2、有效的原因:

知识蒸馏之所以能有效缓解灾难性遗忘,核心在于其构建了“记忆容器”与“记忆存储”的双重保障。

四、总结与展望

邓淞允老师指出,持续学习是破解机器人在智能抓取中“灾难性遗忘”难题的关键技术。他从“如何克服 AI 遗忘”这一现实问题出发,分析了传统AI在学习新知识时容易遗忘旧知识的局限,并介绍了持续学习等主要解决思路。

针对机器人在长期分拣中难以适应新物体的挑战,邓淞允分享了在动态垃圾分类场景中取得良好效果的技术方案。他强调,在严格的数据限制条件下实现可落地的持续学习,仍是当前 AI 研究的重要方向。

本次讲座加深了同学们对持续学习工程应用的理解,也激发了大家探索机器人智能算法的兴趣。未来,学院将持续支持前沿讲座的开展,鼓励更多具有创新思维与实践能力的学子投身智能科学及交叉领域研究,不断拓宽学术视野、夯实专业能力。

前沿不止,探索不息

第十六期“AI前沿论坛”圆满落幕

但机器人智能技术的创新之路任重道远

愿我院学子以此为契机

夯实专业根基,勇攀科技高峰

在人工智能的浩瀚天地中

书写属于自己的精彩篇章

END

图 | 奉清政 胡佳林

文 | 文艺锦 唐子雅

编辑 | 陈 北

责编 | 王 灿

一审 | 龚 亮

二审 | 欧彩玲

三审 | 李 琳

夜雨聆风

夜雨聆风