撰文| 涂彦平

编辑| 张 南

设计| 荆 芥

题图| AI

2026年2月28日上午,伊朗最高领袖哈梅内伊在一处建筑里遇袭身亡。执掌伊朗近37年,他终究没能躲过这次美以联合行动。

美国总统特朗普在其自己的社交平台“真相社交”(Truth Social)上写道:“他无法躲避我们的情报系统和高度精密的追踪系统。在与以色列密切合作下,他以及与他一同被击毙的其他领导人,根本无能为力。”

在这场美方代号为“史诗怒火”、以方代号为“狮吼”的军事行动中,美以展开了大规模空袭与导弹打击,目标涵盖了伊朗的导弹体系、重要军工与海军设施乃至最高权力中枢,伊朗则以大规模导弹和无人机袭击予以回击。

引人注意的是,《华尔街日报》透露:美国国防部队在袭击伊朗时使用了 Anthropic开发的人工智能技术,即便几个小时前特朗普刚刚下达了对这家公司的禁令——指示联邦机构停止与它合作。

数月以来,Anthropic与美国政府因五角大楼如何使用其AI模型产生争执。但知情人士称,即便双方紧张关系加剧,美军仍然在使用这款工具进行情报评估、目标识别和模拟战斗场景。

《华尔街日报》称,包括美国驻中东的中央司令部在内的全国各司令部都在使用Anthropic的Claude AI工具。不过,对于正在对伊朗采取的行动中使用的具体系统,美国中央司令部不予置评。

这不免让人好奇:AI在这场突袭中究竟发挥了怎么样的作用?

战争还在继续。在战场上,AI是那个看不见而又无法忽视的影子。

基于既有事实作合理推测,美国在中东突袭中使用的应该是Anthropic的Claude Gov模型。2025年6月,Anthropic宣布推出这套专为美国国家安全客户打造的定制模型。

Claude Gov模型被美国国家安全最高级别的机构部署,访问仅限于那些在这种机密环境中工作的人,被用于从战略规划和运营支持到情报分析和威胁评估等应用。

根据Anthropic官网信息,该模型为关键的政府需求和专业任务进行了性能增强,包括:

改进对机密材料的处理;更好地理解情报和国防背景下的文件和信息;提高对国家安全行动至关重要的语言和方言的熟练程度;改善对用于智能分析的复杂网络安全数据的理解和解释。

从上述描述来看,Claude Gov模型就像一个加强版AI军方文秘。

早在2024年,Claude 就已通过与数据分析公司Palantir、Amazon Web Services的合作关系,为美国情报与国防机构提供AWS上的Claude 3和3.5系列模型的访问权限。

不过,Claude在军方行动中崭露头角应该是2026年1月用于捕获当时的委内瑞拉总统尼古拉斯·马杜罗。

Anthropic首席执行官达里奥·阿莫代伊(Dario Amodei)2月27日接受CBS新闻采访时透露:“我们是第一家将模型放到机密云端的公司。我们是第一家为国家安全目的定制模型的公司。”

►Anthropic首席执行官达里奥·阿莫代伊(Dario Amodei)

说话时,他神情疲惫,在总统面前已经“失宠”。

当天,特朗普下令所有联邦机构立即停止使用 Anthropic的技术,并给予国防部等6个月过渡期,还指示五角大楼将Anthropic指定为“供应链风险”,禁止任何军方承包商、供应商或合作伙伴与其开展商业活动。(详见Claude已死,OpenAI万岁,川普万万岁)

给机构6个月的时间用于替换供应商,这也充分说明Claude已经深深植根各个机构,想连根拔除也不是那么容易的事。

此次对伊朗的突袭,Claude的在场也显示了它已经深深融合进美国军事行动。如果没有它,行动很可能不会开展得这么迅速。

人工智能在国防领域的应用正日益凸显。

以美国为例,2018年6月,美国国防部联合人工智能中心(JAIC)成立,核心使命就是推进人工智能技术在军事领域的整合与应用。

2022年2月,JAIC与国防数字服务等部门合并为首席数字和人工智能办公室(CDAO)。CDAO负责领导国防部在数据、分析和人工智能采用方面的战略和政策,支持开发数字化和支持人工智能的解决方案。

2023年8月,美国国防部成立“利马工作组”(Task Force Lima),以推进对大语言模型等生成式人工智能技术的探索和部署。

2025年10月,驻韩美军第八集团军司令汉克·泰勒(Hank Taylor)公开承认,他使用OpenAI开发的聊天机器人ChatGPT来制定关键军事决策。

如果说这些AI还是坐在办公室里的军事助手,那么有些AI已经杀到前线战场去了。

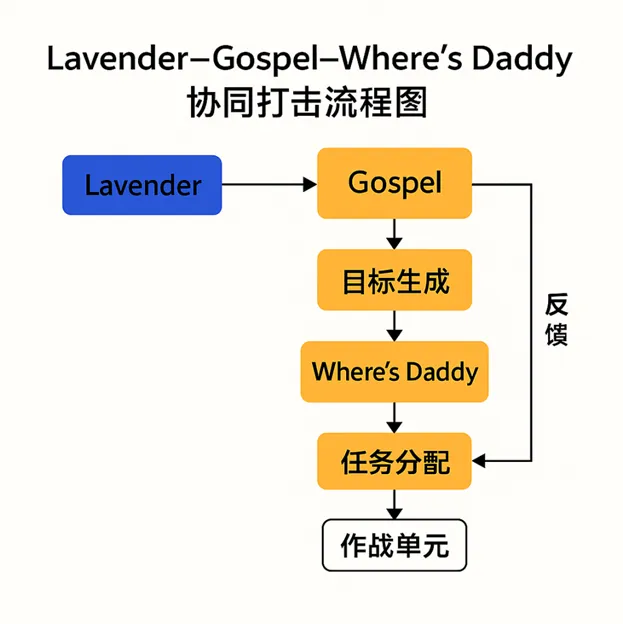

以色列国防军已经在2023年以哈冲突中熟练使用三大人工智能系统:“薰衣草”系统(Lavender),“福音”系统(Gospel),“爸爸在哪儿”系统(Where’s Daddy)。

“薰衣草”系统的设计目标是集成多个数据源,比如通讯元数据、地理位置信息、社交网络连接、职业/角色标签等,从而高效识别潜在哈马斯作战成员,并生成批量可供打击的目标名单。

以色列“+972”杂志与英国《卫报》的联合调查报道显示,“薰衣草”系统曾一次性生成超过37000个目标名单,这些人被系统标记为“可能参与哈马斯作战组织”。甚至有说法表示:以军在部分情况下允许不进行独立行为确认,即可依据算法判断进行致命打击。

“薰衣草”输出结果,再由“福音”负责判断目标地点是否适合打击,而“爸爸在哪儿”则辅助确认目标是否处于家庭环境、是否存在平民陪同,以避免大规模误杀。

►以军三大AI系统Lavender/Gospel/Where’s Daddy 协同打击流程图

►以军三大AI系统Lavender/Gospel/Where’s Daddy 协同打击流程图

2025年6月“述策”团队推出的《人工智能军事运用案例解析——以俄乌战争和以哈冲突为主》报告,对此有详细分析——“薰衣草”系统主导打击目标生成,“福音”系统与“爸爸在哪儿”系统则提供合法性评估与伦理修正机制。“三者协作构建出一种前所未有的AI集成作战体系,在效率提升的同时,也加剧了外界对于其技术可靠性、伦理底线和人类控制权的担忧。”

目前,尚不清楚,在这次对伊朗的突袭中,以军是否使用了这三大AI系统。

面对AI技术用于现代战争,很多人的心情是复杂的。一个普遍的疑问是:它真的能够做到精准打击、不伤平民吗?

有报道称,以军技术人员曾透露,“爸爸在哪儿”在过去冲突中成功避免了数十起非战斗人员误杀事件。

但另有数据显示,“薰衣草”因其高达10%的错误率导致了大量平民伤亡。这是否是算法对人类的屠杀?

此次,在对伊朗的军事行动中,一所小学也被波及。最新消息显示,目前该小学遇难者人数已上升至118人。这会是“薰衣草”的误差导致的吗?

2025年2月,DeepMind创始人德米斯·哈萨比斯(Demis Hassabis)与Anthropic创始人达里奥坐到一起,接受《经济学人》的采访。

►DeepMind创始人德米斯·哈萨比斯(Demis Hassabis)

哈萨比斯表示:会因担心自己成为下一个奥本海默,而彻夜难眠。

达里奥说,早在2023年,他们就做了一些关于AI系统能否生成在谷歌或教科书中找不到的、可用于制造生物武器的信息的工作,他们的结论是可以。

因坚持“道德红线”而在政府采购中出局的 Anthropic拒绝两类高风险应用:一是国内大规模监控,另外一个就是全自主武器,即无需人工参与即可发射的武器。

当CBS新闻记者问达里奥:“我想了解美国民众应当警惕的最坏情况。当您对自主武器存在担忧时,能否举一两个可能出错的实例?”

达里奥举了两个例子:其一是可靠性问题,比如误伤友军、射杀平民或采取错误行动;其二是监督机制问题,若由一人或少数人指挥千万无人机组成的军队,这种权力过度集中的模式行不通。

“这并非否定我们不该拥有这样的机群——毕竟对手可能率先部署。但必须讨论责任归属问题:谁掌握按钮?谁能说‘不’?”达里奥说道。

►联合国秘书长安东尼奥·古特雷斯(António Guterres)

2025年5月,联合国秘书长安东尼奥·古特雷斯(António Guterres)在致命性自主武器系统非正式磋商会议上说道:具备自主决定人类生死的机器在政治、道德层面均不可接受,应通过国际法明令禁止。

他呼吁各国在2026年前达成具有法律约束力的协议,并提出两大核心原则:必须确保人类对使用武力的绝对控制权;采取预防行动已刻不容缓。

点击阅读原文报名

▼

夜雨聆风

夜雨聆风