做 AI 漫剧、AI 真人剧、AIGC 剧情内容时,很多人都会卡在同一个问题上:

场景不一致。

上一张图里的房间是这样的,下一张图里的房间又变了;上一镜的走廊结构还算统一,下一镜就开始窗户变形、墙面变形、空间逻辑错乱;同一个场景做多张参考图时,最终出来的结果像是“差不多”,但就是很难做到真正统一。

这个问题,在做剧情向内容时特别致命。

因为你一旦要做连续镜头、角色调度、图生视频、分镜延展,场景不稳定就会直接影响成片质量。很多时候,不是模型不够强,而是你前期的场景生产方式就不够稳定。

最近我在实操里,开始更多使用一种思路来解决这个问题:

首先生成 VR360 全景图,再从全景图里截取不同角度的场景参考图。

这套方法的核心价值,不是“让一张图更漂亮”,而是:

让同一个场景拥有更稳定的空间逻辑和更多可复用视角。

一、为什么 AIGC 场景一致性这么难?

因为我们平时常见的做法,往往是:

• 一张图一张图单独生成 • 不同机位分别抽卡 • 靠提示词尽量描述“同一个场景” • 靠后期筛选尽量挑接近的图

这种方式可以做单图,但一旦进入剧情制作,就会出现几个典型问题:

1. 空间结构不连续

同样是“法庭”“教室”“病房”“办公室”,不同张图之间,桌椅位置、门窗关系、空间朝向很容易变。

2. 多视角不统一

你想要正面、侧面、斜侧、回头视角,结果每一张图都像是“平行宇宙版本”。

3. 后续镜头延展困难

当你要继续做分镜、图生视频、镜头衔接时,场景的不一致会被无限放大。

所以,真正的问题并不只是“图漂不漂亮”,而是:

有没有一个更适合剧情制作的场景底图工作流。

二、为什么 VR360 全景图更适合做场景底图?

这套工作流的核心思路非常清晰:

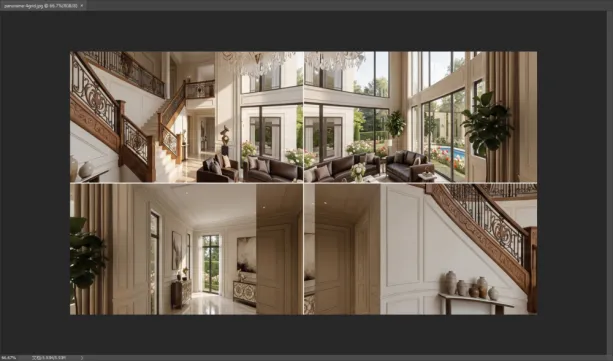

先上传一张场景图,尽量使用横图,因为竖图稳定性较差;系统会基于该场景图生成一张 360°VR 全景图,默认比例为 2:1。生成完成后,还可以通过全景图查看工具,自定义截取不同区域的场景图片,继续作为 AI 视频或分镜的场景参考图。

这意味着什么?

意味着你不再是“为每个镜头重新生一个场景”,而是先建立一个相对统一的完整场景空间,再从这个空间里提取你需要的不同视角。

这就像是:

以前你是在一张张“猜”场景;现在你是在一个完整场景里“取”视角。

这个差别非常大。

三、这套方法最适合哪些场景?

我认为特别适合以下几类内容:

1. 固定主场景剧情

比如法庭、教室、病房、办公室、客厅、宫殿、大厅、监狱、会议室等。

这类场景在剧情里往往要反复出现,多次切镜头。如果每次都单独生成,很容易崩。

2. 多机位剧情分镜

同一个空间,需要正拍、侧拍、过肩、仰拍、俯拍、远景、中景、近景等多个视角。

如果先有一个全景空间,再从里面截取角度,会更稳。

3. 图生视频前的场景参考

截取下来的宫格图可以作为 AI 视频的场景参考图。这对后续镜头生成和场景延展非常有帮助。

四、VR360 全景图工作流,实操上怎么理解?

你可以把这套方法理解为四步:

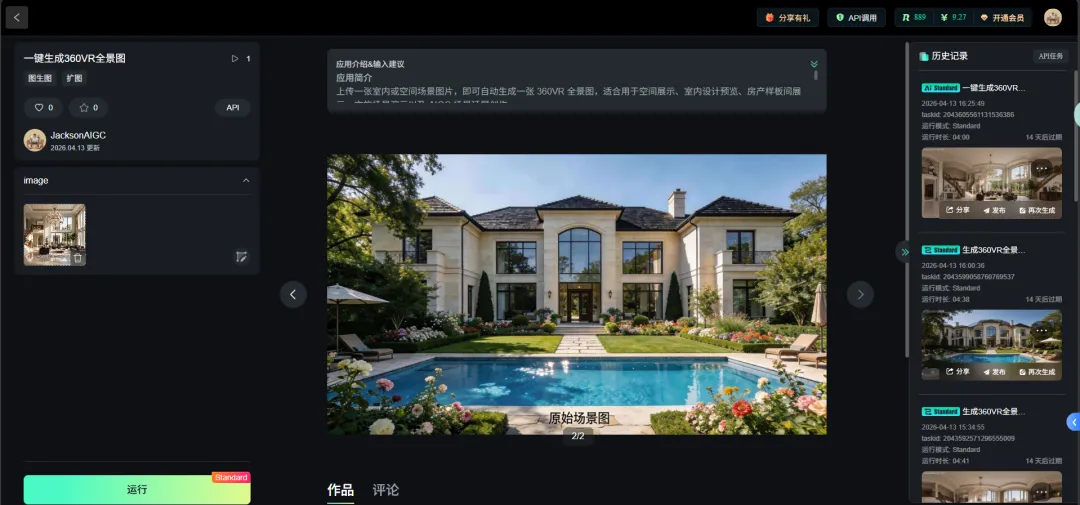

第一步:先准备一张相对理想的场景原图

这里尽量使用横图。横图更稳定,竖图不稳定。

这张原图的任务,不是直接用于成片,而是作为你后续生成全景空间的“种子图”。

第二步:生成 360°VR 全景图

一键生成360VR全景图体验地址:

https://www.runninghub.cn/ai-detail/2043605157656666114/?inviteCode=9dxp4zge

工具会基于你上传的场景图,生成一个 360° 的完整空间场景。

生成完成后,你可以借助VR360全景查看工具,自定义浏览与截取不同机位、不同方向的场景画面。

关注公众号JacksonAIGC,回复 "aigc" 获取VR360全景查看工具。

这一点非常关键。

因为从本质上说,你是在同一个空间逻辑下,连续拿到多个镜头参考图,这天然比“一张张独立抽卡”更接近真实影视制作的空间关系。

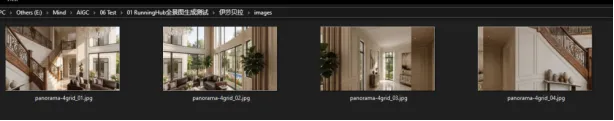

第四步:把提取出的图继续用于分镜、图生视频、场景统一

到这一步,你的全景图价值才真正释放出来:

它不只是“一张 360 图”,而是你整个剧情场景资产库的源头。

五、这套方法的优势,不只是“统一”

很多人理解这类工作流时,只会看到“场景一致性更好”。

但在我看来,它至少还有三个额外优势。

1. 提高镜头设计效率

你不需要为每个镜头重新构思场景,只需要在同一空间里找角度。

2. 更适合做工业化素材管理

当你的核心场景来自同一张全景空间,后续无论是命名、归档,还是场景复用,都会更清楚。

3. 更利于后期修复和局部优化

生成并非百分百稳定,可能会出现场景无法闭环、场景扭曲等问题;如果问题较小,可以用其他工具局部重绘修复;如果错误较大,就需要重新抽卡。

这就意味着:

你不是要追求“一次完美”,而是先建立一个大致稳定的空间,再针对局部问题做修复。

这反而更符合 AIGC 的真实工作流。

六、VR360 全景图不是万能,但它确实更适合剧情制作

这里也要说清楚:这套方法不是生成一次就绝对完美。

实际生成中依然会遇到一些问题,比如:

• 场景无法闭环 • 局部扭曲 • 某些区域结构异常 • 上下部分出现瑕疵

比如在 12 宫格拆分中,就可能出现了上方和下方部分图像有瑕疵的情况,后续还需要再修复。

但问题在于:

它给你的是“一个更稳的起点”,而不是最终完美答案。

对于剧情制作来说,这已经很有价值了。

因为最怕的不是小瑕疵,最怕的是每一张图都是完全不同的空间逻辑。

七、全景图生成后,怎么把宫格图快速拆开?

这也是很多人接下来会遇到的一个高频问题。

你从 VR360 全景图中截取出来的,往往不是单张图,而是多宫格场景图。这时候如果还用手动裁切,效率会非常低。

操作思路:

先建立参考线版面 → 再自动生成切片 → 最后批量导出切片。

也就是说,你不需要手动一块块裁。

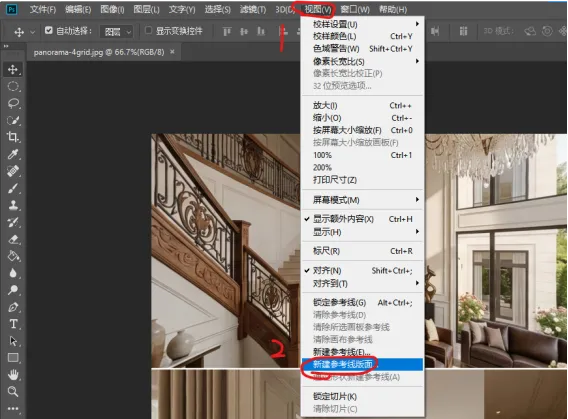

八、PS 快速分割宫格图的具体方法

下面我简要梳理一下这个流程。

1. 导入宫格图

先把你的四宫格、九宫格、十二宫格等场景图拖入 Photoshop。

2. 新建参考线版面

在顶部菜单栏点击:

视图 → 新建参考线版面

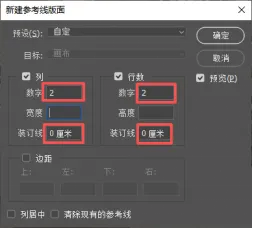

3. 设置行列数

如果是四宫格,就设置成:

• 列:2 • 行:2 • 装订线:0

如果是九宫格,就设成 3×3;如果是六宫格,就按 3×2 或 2×3;本质上就是按照实际布局填写即可。

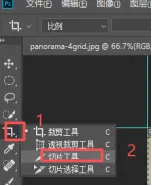

4. 选择切片工具

在工具栏中找到 切片工具。

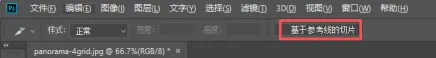

5. 基于参考线生成切片

点击:

基于参考线的切片。

这样 Photoshop 就会根据你设好的参考线,自动把整张图切成多个区域。

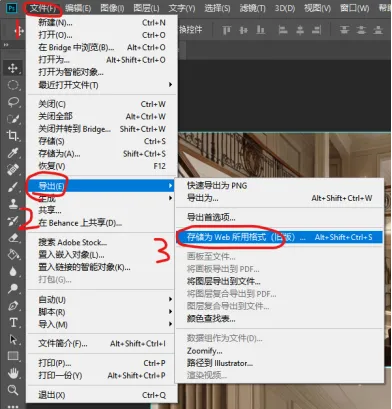

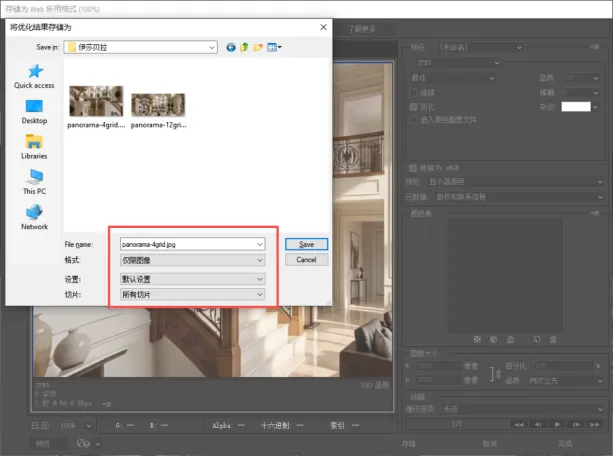

6. 导出切片

依次点击:

文件 → 导出 → 存储为 Web 所用格式

也可以直接使用快捷键:

Ctrl + Alt + Shift + W

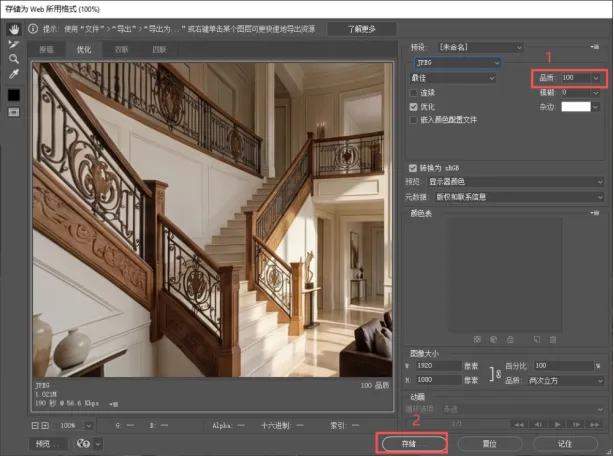

7. 导出设置

建议导出时把品质设为 100,然后按默认逻辑保存。

得到完整拆分后的单张图片素材。

九、把这两步连起来,你的场景工作流会顺很多

一条非常清晰的 AIGC 场景工作流:

原始场景图 → 生成 VR360 全景图 → 截取多视角宫格图 → PS 快速拆分成单张素材 → 继续用于分镜、图生视频、后期整理

你会发现,这已经不是单纯“生成一张图”了,而是在做一种更适合剧情内容的场景资产生产流程。

这对于 AI 漫剧、AI 真人剧创作者来说,价值非常大。

十、结语

很多人做 AIGC 内容时,总想靠更强的模型来硬解决一切问题。

但实际做久了你会发现,真正拉开差距的,很多时候不是模型本身,而是你有没有建立起一套更稳、更清晰、更可复用的工作流。

对于场景一致性来说,VR360 全景图提供的是一个更统一的空间底图思路;而 PS 快速切片 解决的是后续素材拆分与整理效率问题。

这两步结合起来,足以帮很多做剧情内容的人,少走不少弯路。

如果你也在做 AI 漫剧、AI 真人剧、AIGC 剧情内容,欢迎关注我的公众号 JacksonAIGC。

后面我还会继续分享更多实操型干货、流程型经验和提效方法。

如需更多交流,可以在公众号主页点击菜单栏的 「加入社群」,一起交流 AIGC 创作、工作流和落地经验。

往期文章推荐:

2026年,AI真人短剧已经不是拼模型了,而是拼整套工业化流程

2026年AI漫剧、AI真人剧主流画风全梳理:附Seedance2.0专用提示词模板清单

夜雨聆风

夜雨聆风