OpenClaw(社区昵称 “大龙虾”)作为 2026 年最火的 AI Agent 框架,凭借强大的自动化执行能力成为开发者标配。但随着使用频次提升,云端大模型 Token 消耗成本居高不下,成为个人开发者与中小企业的核心痛点。本文针对最新版 OpenClaw,提供一套零成本、可复现的本地化解决方案:通过 ClawX和Ollama 部署开源大模型,彻底摆脱云端依赖,解决 命令行 参数失效、认证配置错误等核心问题,实现 “本地推理 + 本地执行” 的全闭环,兼顾成本、隐私与性能。接下来我们就一步一步来分享部署过程.

第一部分:Ollama 本地部署与开源模型选型 (以Windows下安装为例)

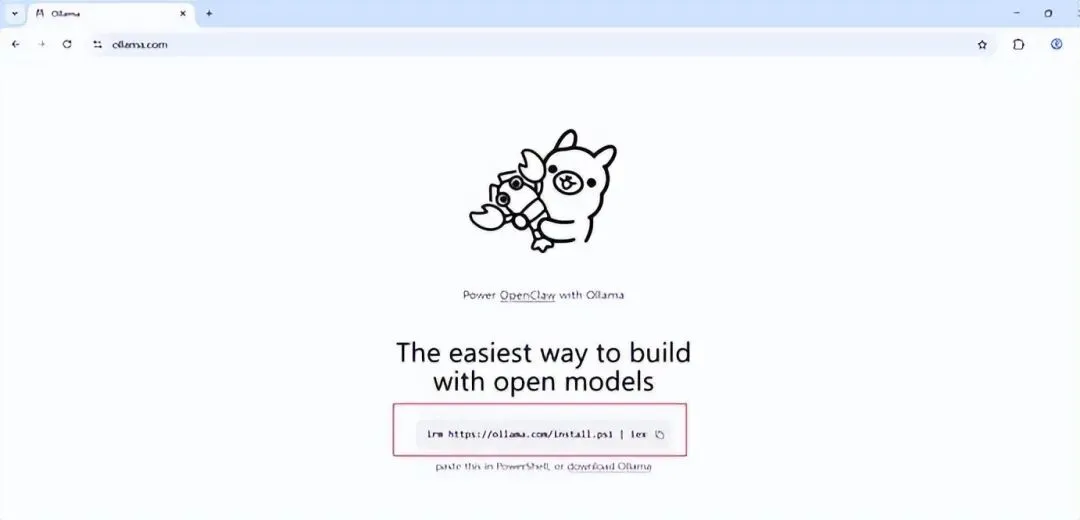

1. 打开ollama官网:https://ollama.com/

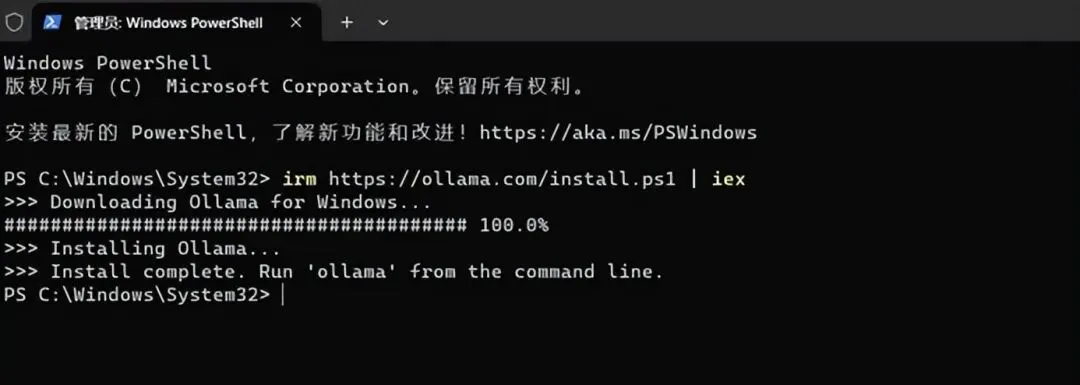

2. 复制安装代码:

irm https://ollama.com/install.ps1 | iex

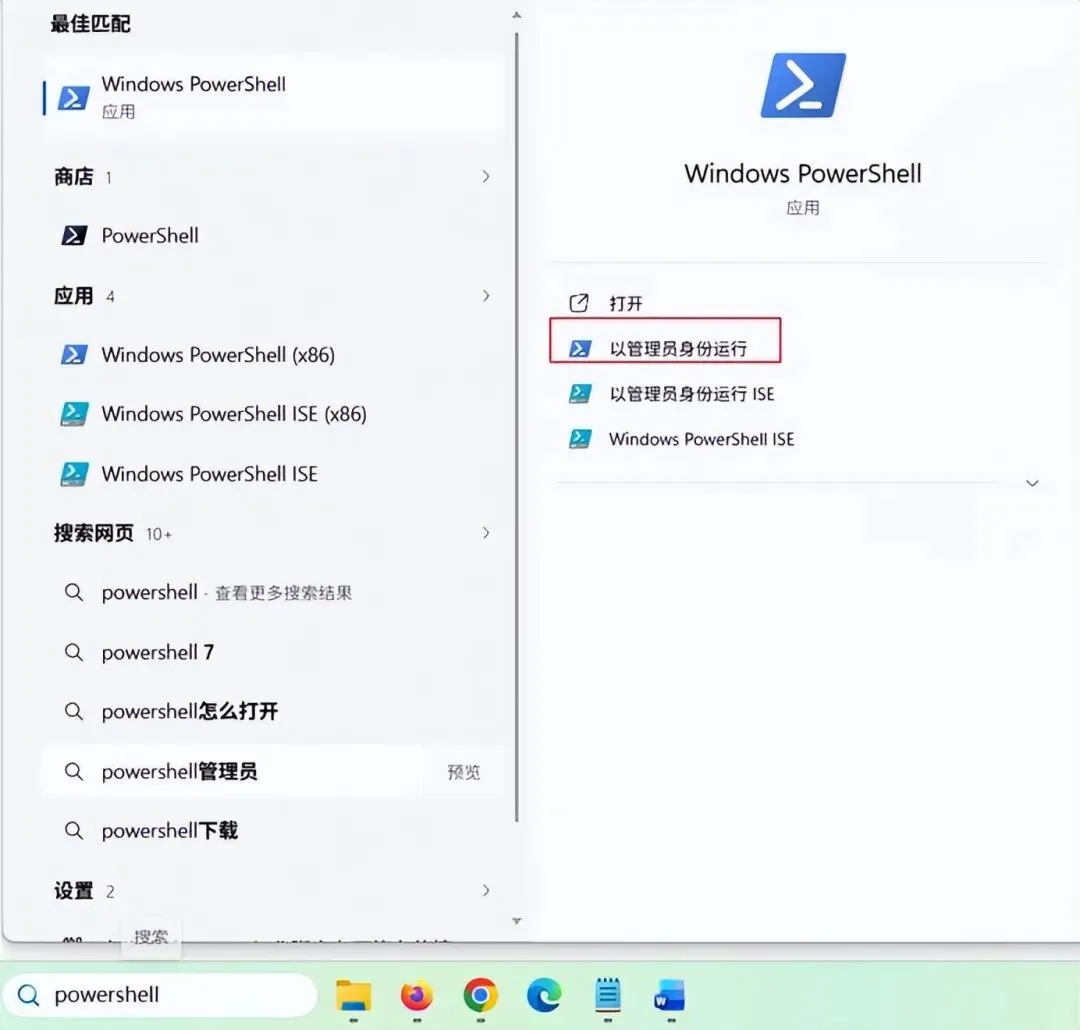

3. 以管理员身份运行Powershell

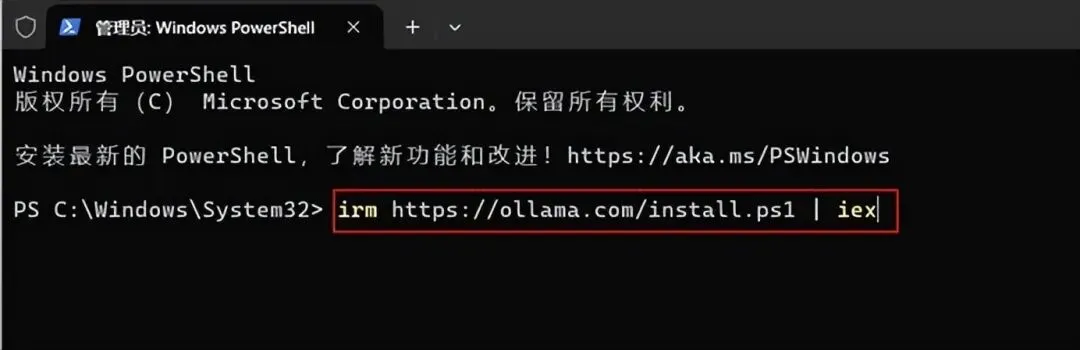

4. 在打开的命令窗口中,右键粘贴刚才复制的安装代码

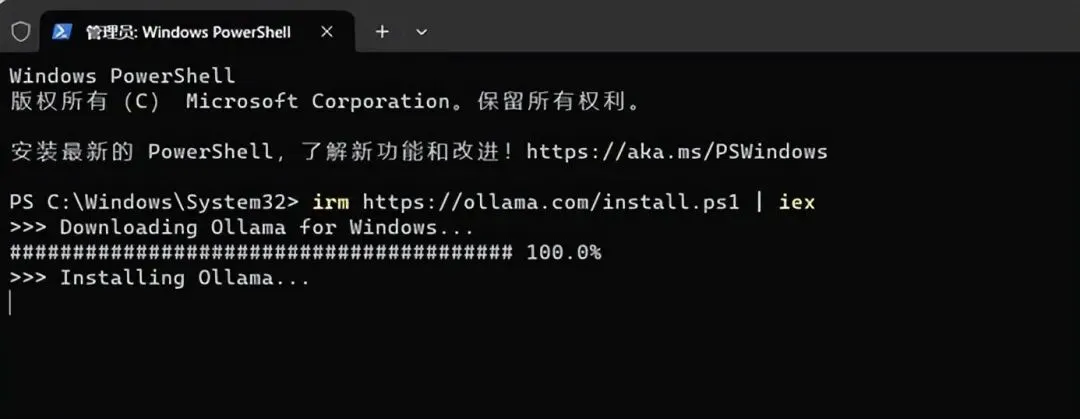

5. 等待ollama安装完成

6. 安装完后,验证 Ollama 安装

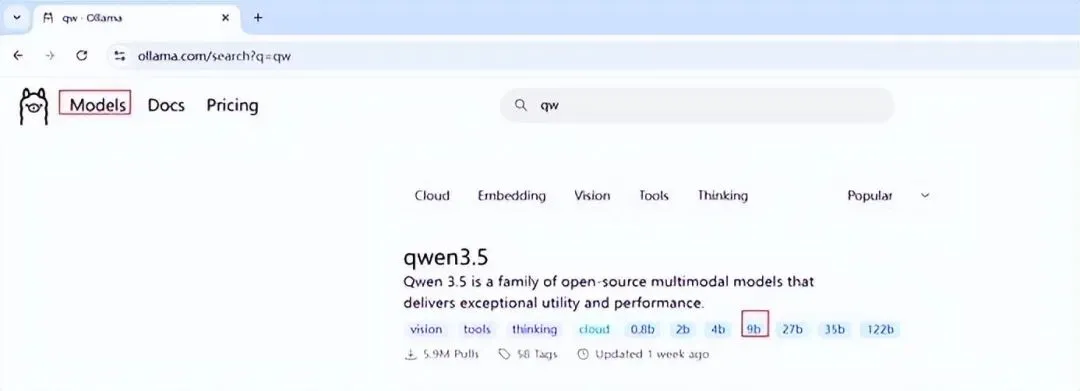

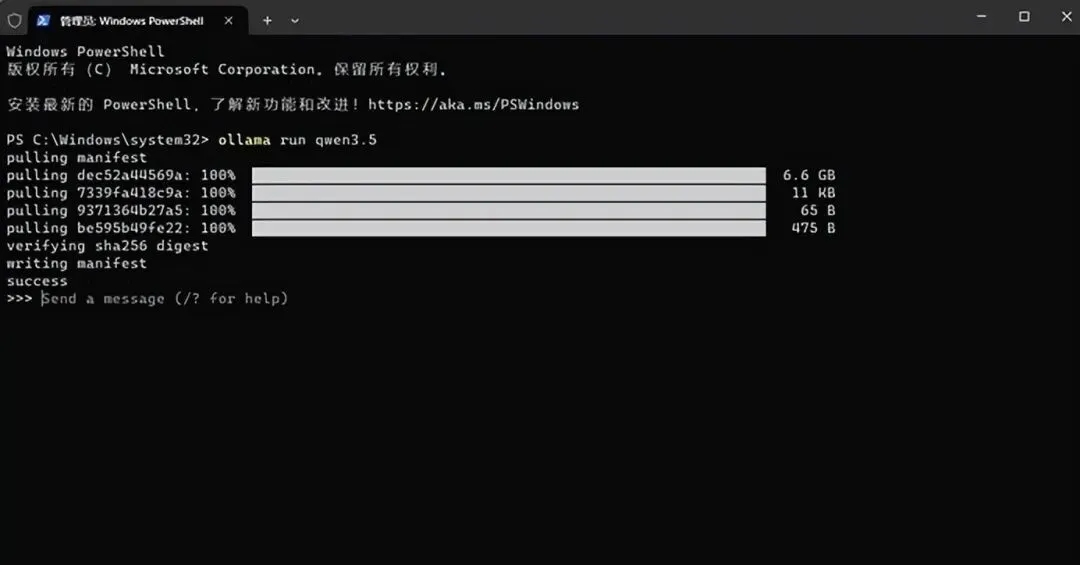

7. 打开ollama官网,选择并拉取开源模型,本例以安装qwen3.5 9b为例

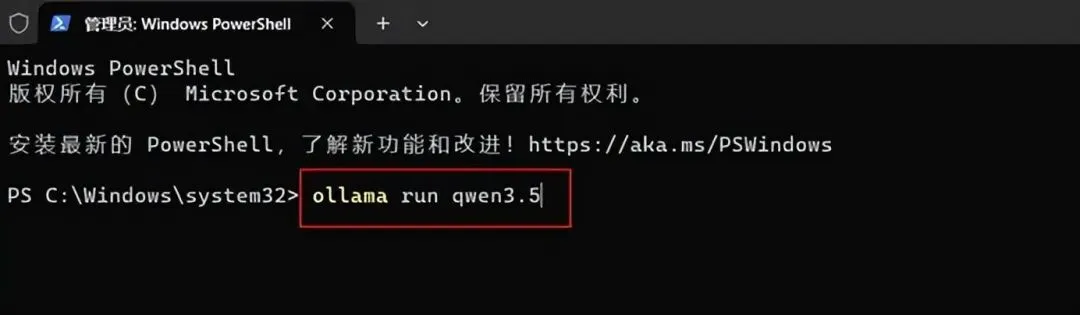

8. 复制好模型安装代码后,回到Powershell命令窗口,右键粘贴安装模型

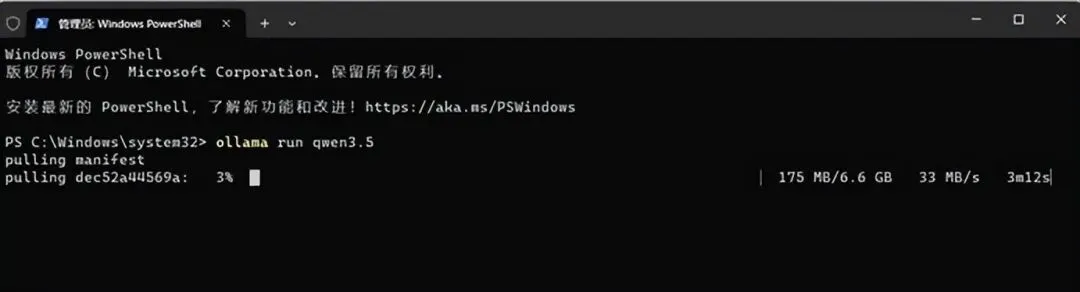

9. 等待安装模型

10. 模型安装完成

第二部分:ClawX的安装和配置

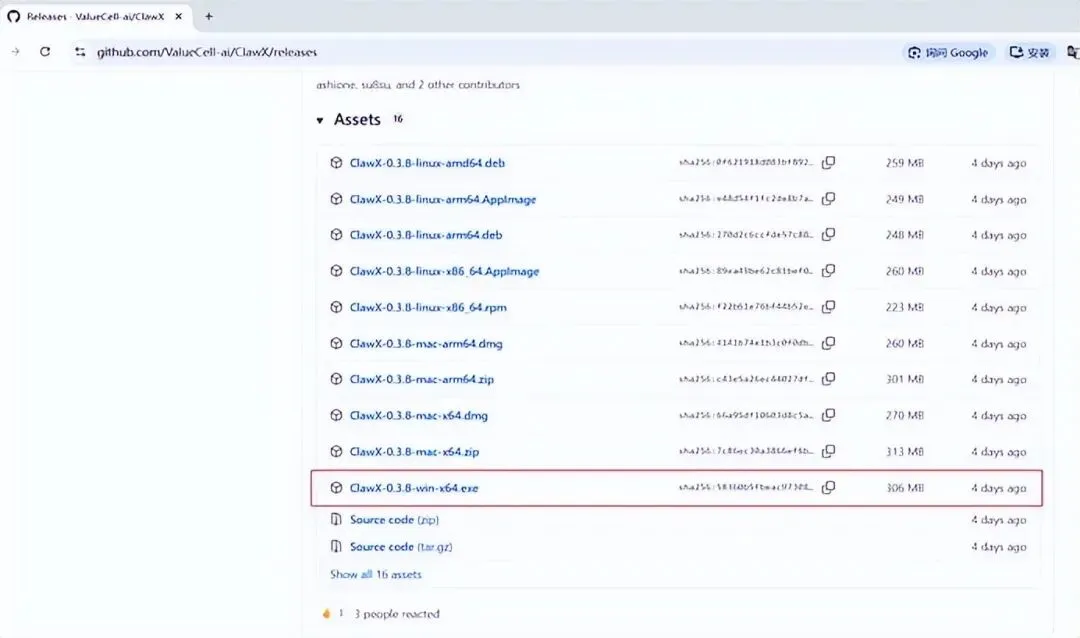

1. 打开ClawX的下载链接:https://github.com/ValueCell-ai/ClawX/releases

2. 选择Windows版本安装包ClawX-0.3.8-win-x64.exe并下载

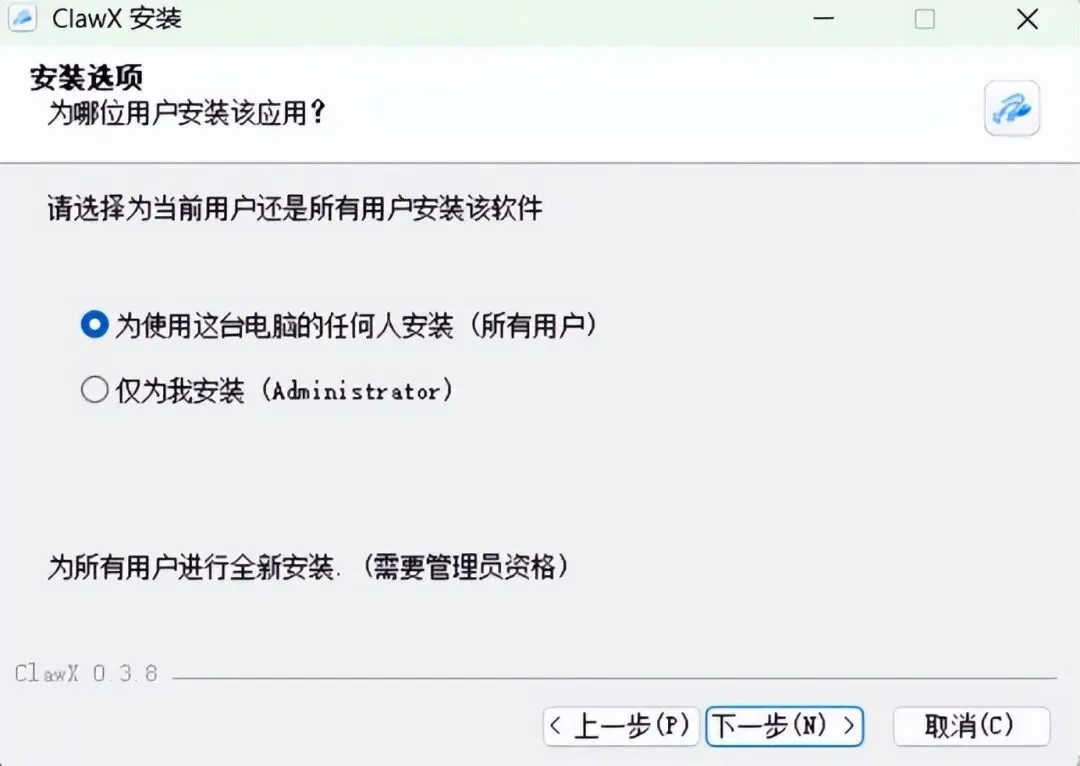

3. 运行ClawX-0.3.8-win-x64.exe

4. 安装完后,运行ClawX.并根据提示配置

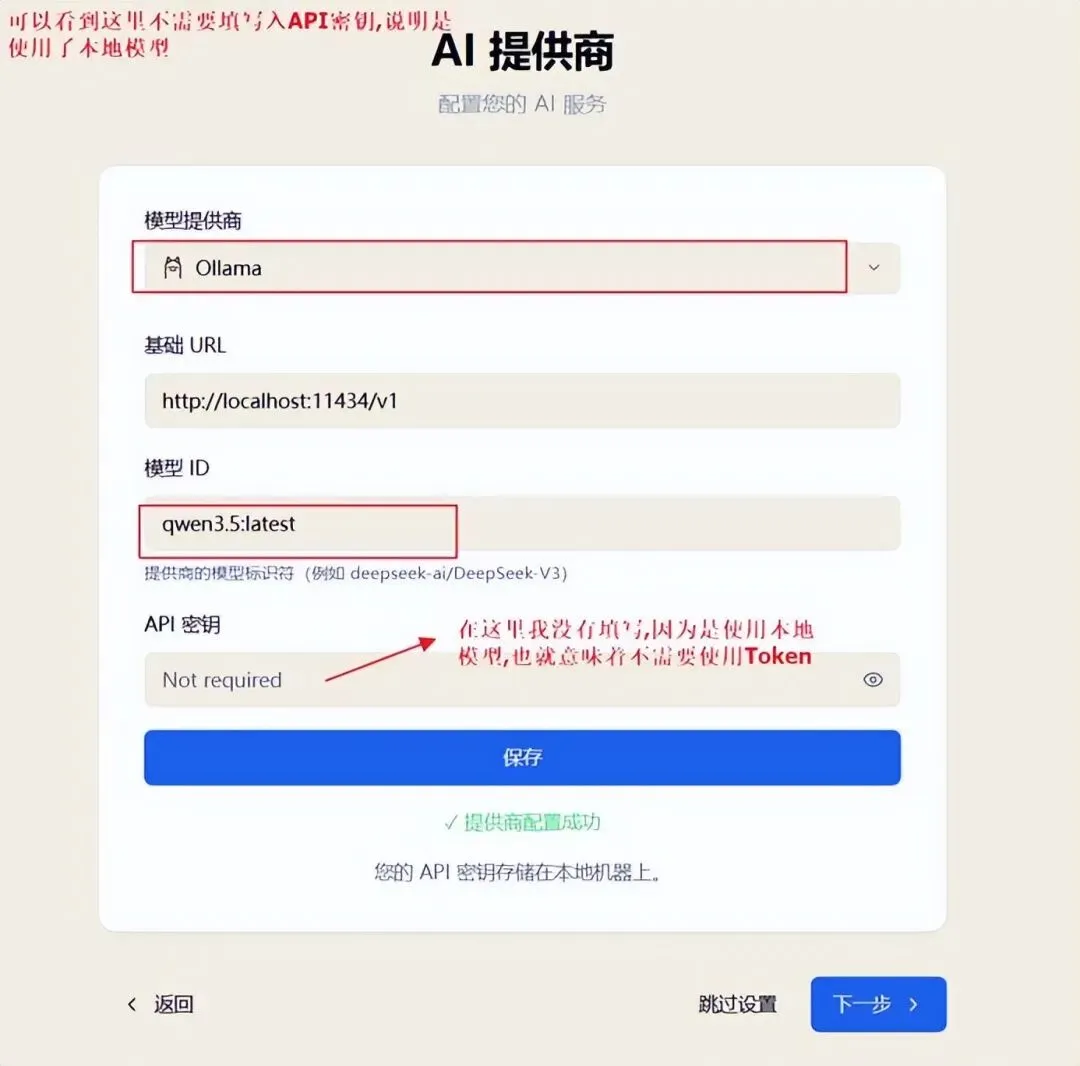

5. 选择模板提供商及模型ID,这一步很重要,本例以Ollama+qwen3为例

6. 配置完成开始使用

7. 测试

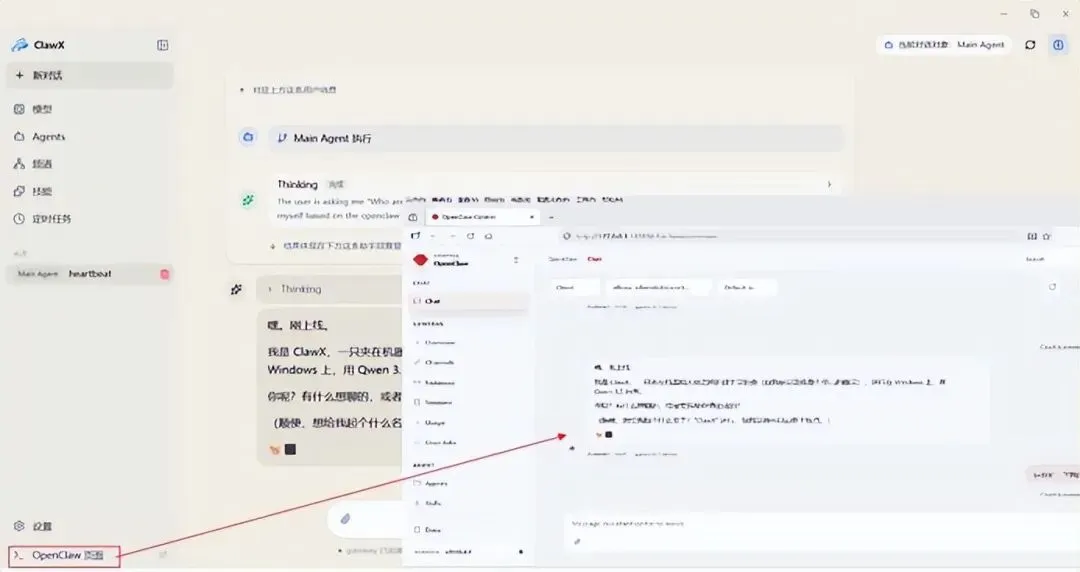

8. 如果喜欢使用原始的OpenClaw的网页界面,也是可以的

夜雨聆风

夜雨聆风