点击蓝字 关注我们

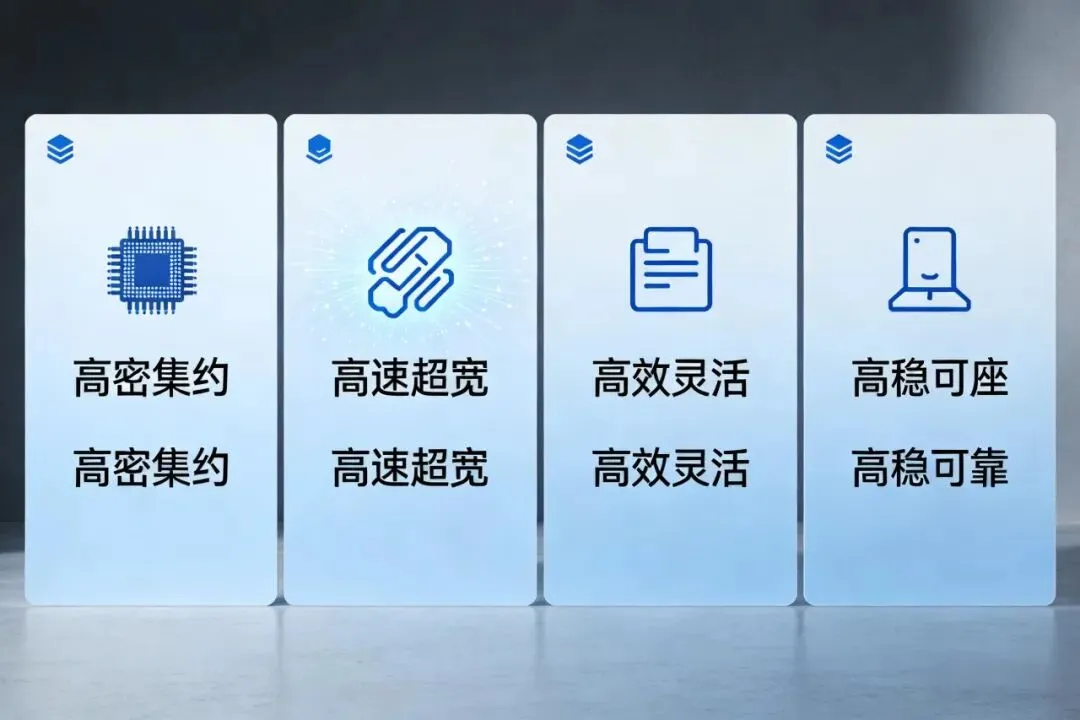

当前,全球人工智能迈入大模型深度发展阶段,万亿参数模型训练、高并发推理与千行百业智能化转型,共同催生爆发式算力需求。传统算力架构面临单机性能瓶颈、集群扩展受限、资源利用率偏低等难题,以高密集约、高速超宽、高效灵活、高稳可靠为核心特征的 AI 计算节点,正成为突破算力瓶颈、支撑智能算力高质量发展的核心单元。

AI 计算节点:定义、特征与发展背景

01

什么是 AI 计算节点

AI 计算节点是构建超大规模智能算力集群的核心技术架构,通过高速互联技术将多张算力芯片集成于一个逻辑单元,形成 “超级计算节点”。 它以 高带宽域(HBD)为基本单元,先通过 Scale-Up 实现节点内算力高效聚合,再通过 Scale-Out 构建万卡、十万卡级超大集群,有效解决大模型训练中算力协同不足、调度效率低等关键问题。

四大核心能力

高密集约:多芯片高密集成、共享内存、高密度散热供电,最大化算力密度。

高速超宽:芯片级直连、高带宽低时延传输,破解数据传输瓶颈。

高效灵活:异构资源池化、动态调度、弹性伸缩,提升资源利用率。

高稳可靠:故障冗余、流量管理、秒级恢复,保障长周期高负载任务稳定运行。

三大发展背景

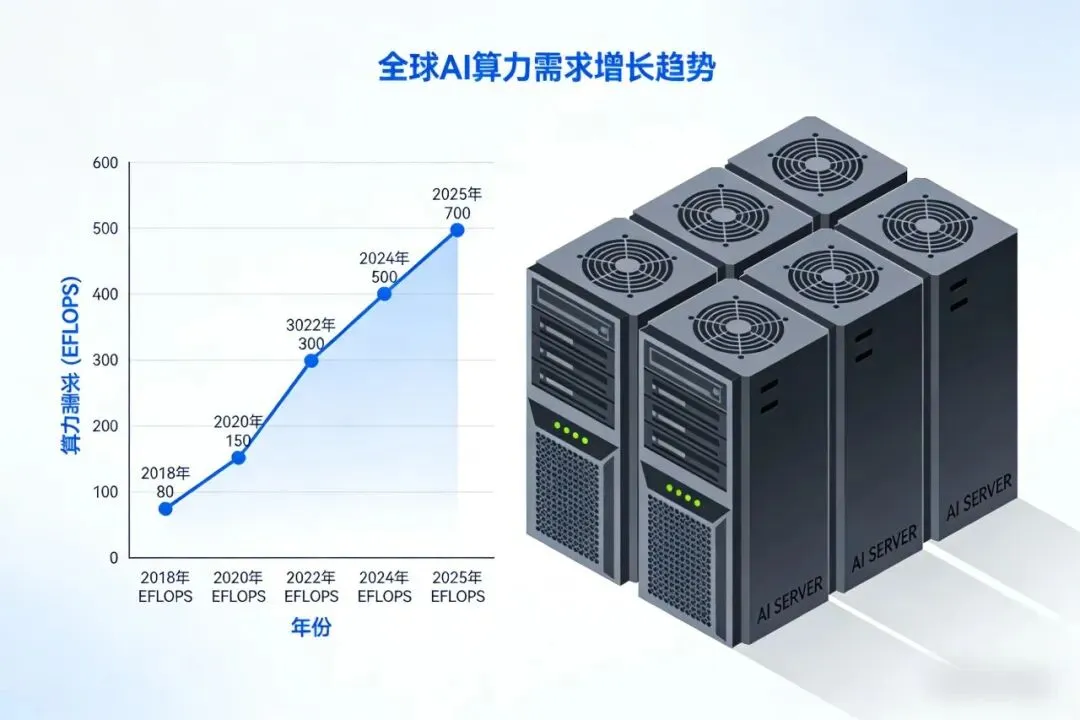

AI 大模型催生刚性算力缺口大模型参数从百亿级迈向万亿级,训练数据从千亿 token 跃升至数十万亿 token,互联网、金融、制造等行业智能化全面提速,算力需求呈指数级增长。IDC 预测,2025 年全球 AI 服务器市场规模达 1587 亿美元,2028 年将增至 2227 亿美元。

智算中心上升为国家战略,美国、英国、欧盟、加拿大、日本等纷纷出台国家级 AI 基础设施计划,投入千亿级资金布局算力底座。我国以 “东数西算”、算力基础设施高质量发展行动计划、“人工智能 +” 行动为指引,将 AI 计算节点作为智能算力建设核心方向。

新型架构突围传统算力瓶颈,传统架构受 “内存墙”、通信延迟、集群扩展上限制约,大规模集群算力利用率常低于 30%。AI 计算节点通过架构重构、高速互联、内存共享,实现算力效能质的飞跃。

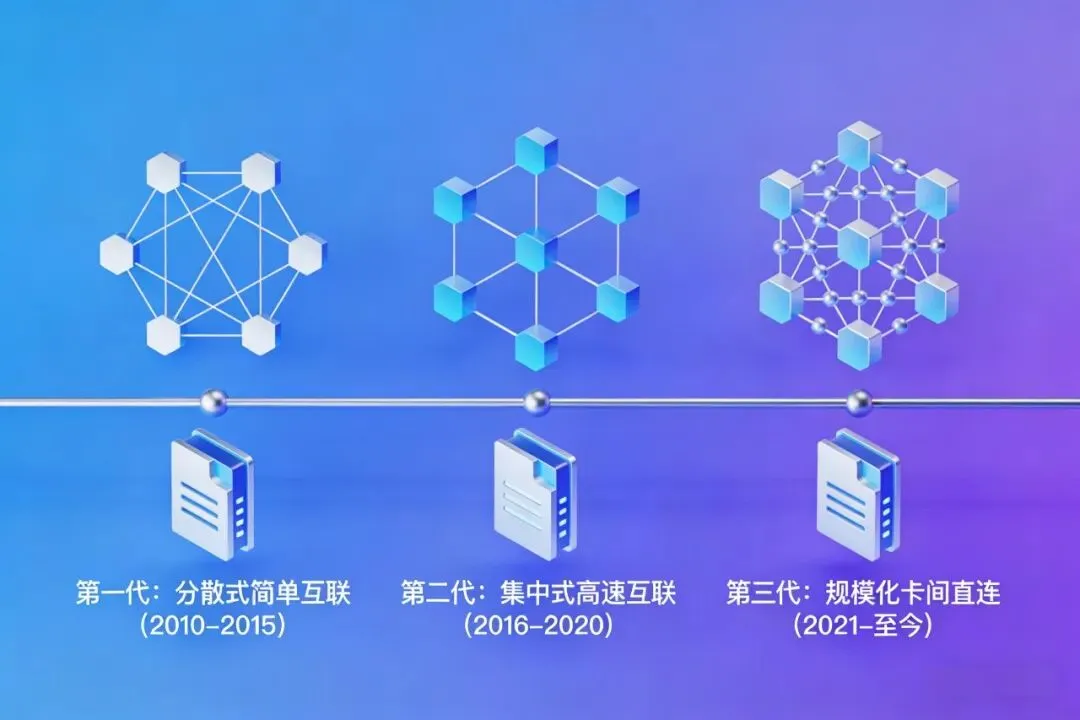

发展阶段:从简单互联到卡间直连的三次跃迁

02

AI 计算节点历经三代演进,互联效率、算力密度、协同能力持续升级:

分散式简单互联阶段以网页、电商等轻量业务为主,算力以服务器分布式堆叠为主,互联为百千兆以太网,算力协同弱。

机间协同组网阶段适配中小模型训练、视觉语音等 AI 任务,采用 InfiniBand、万兆以太网组网,算力密度提升至单机柜十几至几十千瓦,但卡间通信仍需服务器中转,效率受限。

规模化卡间直连阶段面向万亿参数大模型,以 NVLink 等超高速技术实现 GPU 直连,构建统一内存、算力一体的节点单元,配合 InfiniBand/RoCE 组建超大集群,实现算力池化与线性扩展。

核心技术:六大创新支撑算力高效运行

03

1. 节点架构重构:从 CPU 中心转向 GPU 互联中心放弃传统以服务器为单元的堆叠模式,转向以 GPU 互联为核心的紧耦合架构;采用 Mesh、全连接非阻塞拓扑,节点内卡间全互联,节点间高速组网,支撑万卡级训练。

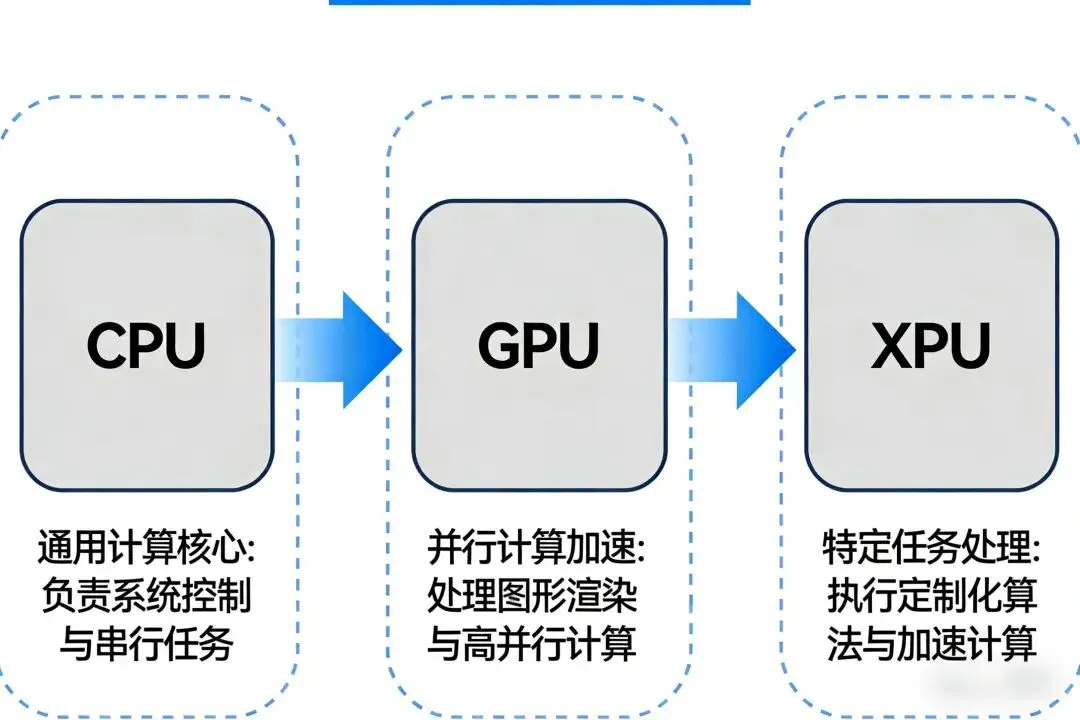

2. 异构计算:CPU+GPU+XPU 协同突破算力密度以 CPU 负责调度、GPU 承担主力计算、NPU/TPU/DPU 专用芯片做算子加速,结合 Chiplet 芯粒技术,提升良率、降低成本、缓解 “内存墙”,单机柜可实现 64 卡乃至更高密度部署。

3. 超低时延网络:节点内 — 节点间 — 集群间高速贯通节点内:专用协议实现卡间全互联,支持 512 卡直连;节点间:RoCE/InfiniBand 构建无损低时延网络;集群间:光传输、SRv6、广域 RDMA 实现跨域智算协同。

4. HBM 与 CXL:突破存储与内存带宽瓶颈HBM 高带宽内存:3D 堆叠、超宽接口,提供 TB 级每秒带宽,缩短数据路径;CXL 内存池化:打破设备内存隔离,实现跨节点内存共享,降低硬件冗余。

5. 智能算力调度:训推一体、多芯片兼容打造训练 — 推理一体化调度平台,实时感知负载、动态分配资源;兼容英伟达、昇腾、寒武纪等多架构芯片,大幅提升集群利用率。

6. 绿色低碳供能:液冷成为刚需单机柜功耗突破 100kW,冷板 / 浸没式液冷全面替代风冷,配合 AI 智能温控,显著降低 PUE,保障高密度节点稳定运行。

典型应用:三大场景释放算力价值

04

大模型训练:支撑万亿参数高效训练

AI 计算节点以高速直连、统一内存编址、故障秒级恢复,支撑万亿参数模型稳定训练。 2025 年以来,浪潮、华为、中科曙光等相继发布单机柜 64 卡 —640 卡级超节点产品,为国产大模型提供硬核算力支撑。

高并发推理:保障生成式 AI 实时响应

面向对话、文生图、代码生成等百万级并发场景,通过高速互联、异构协同、共享显存、流量削峰,实现低时延、高吞吐、低成本推理,单卡性能与并发能力大幅提升。

行业智算:定制化赋能金融、工业、能源

金融风控:毫秒级实时推理、模型快速迭代、数据安全合规,支撑交易风控、信贷审批、投研决策。

工业质检:像素级缺陷识别、小样本快速迭代、高可靠连续运行,赋能精密制造质检。

能源调度:新能源功率高精度预测、多时空尺度智能调度,支撑新型电力系统安全经济运行。

产业生态:国际引领与国内自主协同并进

05

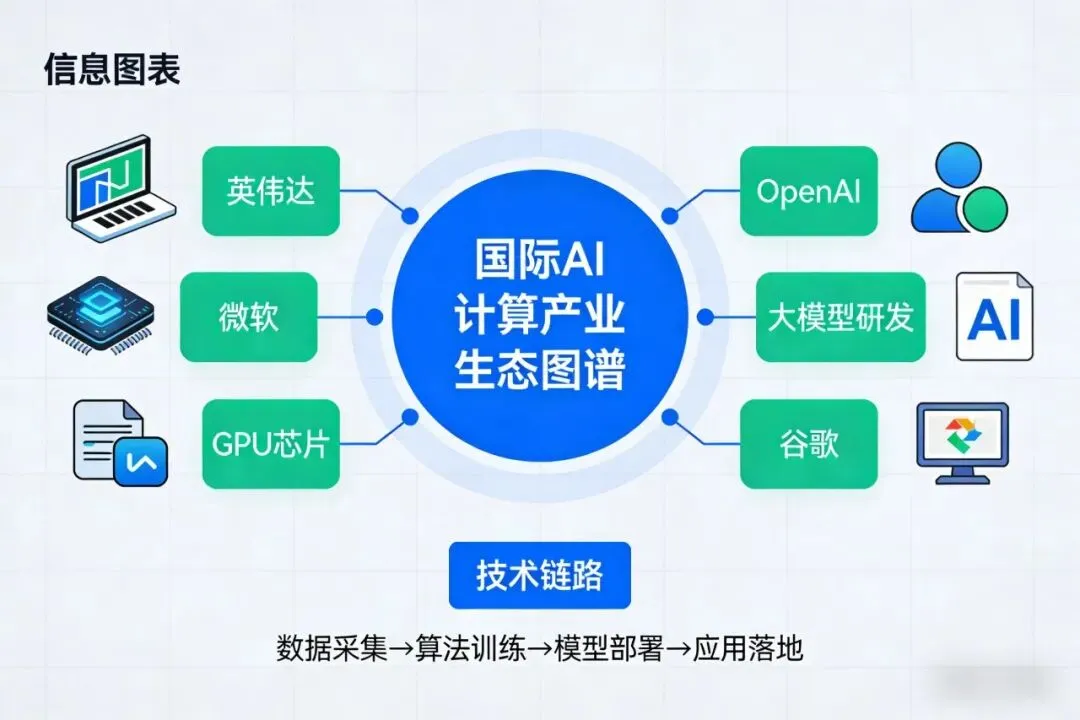

国际生态:技术垄断与开放协作并行

国际形成芯片、设备、标准、应用闭环生态:

芯片端:英伟达主导,AMD、博通等差异化竞争;

标准端:UALink、UEC 联盟主导互联规范;

应用端:微软、AWS、Meta 等大规模部署,牵引技术迭代。

国内生态:多主体协同构建自主可控体系

国内走 “系统级创新弥补单点短板、开放兼容融合生态” 路径:

生产端:寒武纪、海光、沐曦等突破芯片与架构;腾讯、阿里、中国信通院牵头 ETH-X、AI 网络实验室,推进标准建设;

应用端:百度、字节跳动、中国电信等规模化部署,鹏城云脑等国家级设施支撑科研与产业;

协同端:政产学研用联动,推动硬件、软件、场景全链条升级。

未来趋势:四大方向引领算力新时代

06

1. 政策:聚焦自主创新与全链条支撑强化芯片、互联、架构核心技术攻关,推动从 “单卡比拼” 转向 “系统级效率竞争”,完善标准、降低部署门槛,加速规模化落地。

2. 技术:高效互联 + 高密集成 + 绿色低碳全柜级深度集成、训推一体架构普及;高速互联协议替代传统方案,光互连逐步落地;AI 动态调度优化资源配比;全液冷成为标配,PUE 持续下降。

3. 产业:头部引领 + 生态开放 + 模式创新云厂商、运营商主导投建运营;硬件向 “算力即服务、模型即服务” 一体化方案转型;构建接口标准化、软硬件解耦的开放生态,降低兼容成本。

4. 应用:从试点走向全域渗透从互联网、大模型训练向金融、制造、生物医药、智慧城市全域渗透;推出行业定制化 AI 计算节点,形成 “算力 + 算法 + 数据 + 服务” 一体化赋能,成为实体经济智能化通用底座。

AI 计算节点已从技术概念走向产业主流,成为智能算力基础设施的核心支柱。面向未来,以技术创新突破瓶颈、以生态协同降低门槛、以场景落地释放价值,将持续推动 AI 与实体经济深度融合,为数字经济高质量发展筑牢智能底座。

科技创新

引领未来

联系电话:400-101-5634

往期回顾

01

02

03

免责声明

本文内容基于中国信息通信研究院《AI 计算节点发展研究报告(2026 年)》整理,仅用于行业知识分享与信息传播,不构成投资建议、技术选型指导或商业决策依据。报告相关数据、观点与结论归发布机构所有,本文不对信息准确性、完整性与时效性作出任何承诺与保证。读者据此操作产生的风险与后果自行承担。

版权声明

本公众号文章内容来源:中国信息通信研究院,报告版权归中国信息通信研究院独家所有。

未经书面授权,禁止任何机构与个人对本文及报告原文进行转载、摘编、复制、篡改、商用或用于其他侵权用途。

合规引用、转载需注明来源 “中国信息通信研究院” 及本文公众号出处,违者将依法追究相关法律责任。

夜雨聆风

夜雨聆风