斯坦福发布了 2026 年人工智能指数报告(2026 Artificial Intelligence Index,点击底部查看原文查看该报告),里面有一些数据令人吃惊。

73% vs 23%:AI 专家对 AI 就业前景的乐观程度,73%;普通公众,23%。

整整五十个百分点的差距,我一整个震惊了

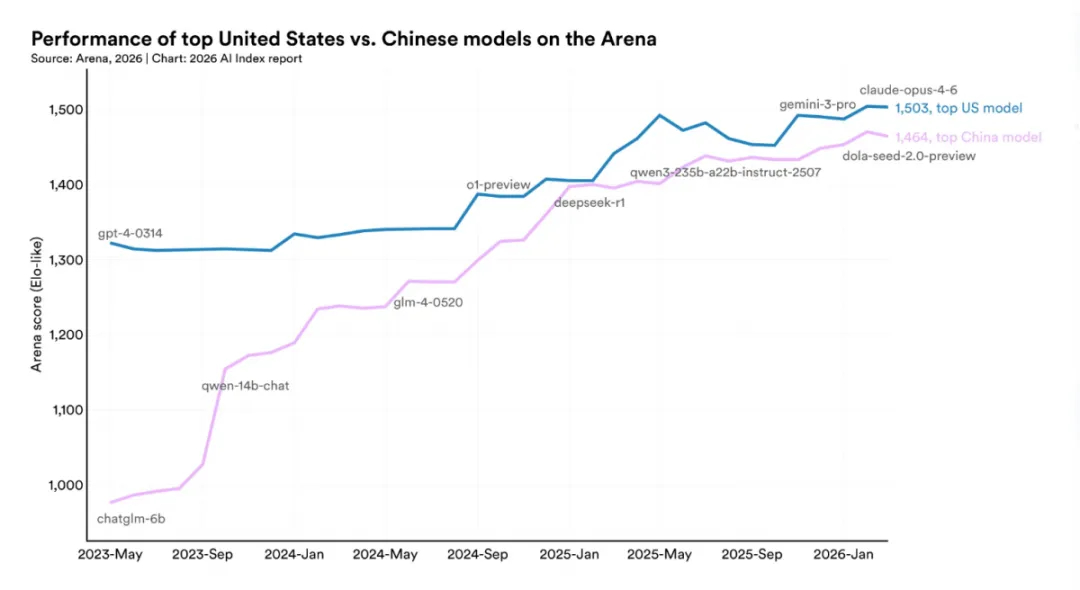

2.7%:美国顶级模型仅领先中国 2.7%。

报告里的原话是:*"the U.S.-China AI model performance gap has effectively closed"*(中美人工智能模型性能差距已基本消除)。

看完这份报告后,我沉思了很久。越看越觉得,这哪是认知鸿沟。

这根本就是两部分人各自活在平行世界里。

撕裂的数字,分裂的现实

先聊聊 AI 对工作的影响。几个核心数据,你感受一下这个撕裂感有多强。

AI 对工作的影响:专家 73% 认为正面,公众 **23%**。 AI 对经济的影响:专家 69% 认为正面,公众 **21%**。 AI 对医疗的影响:专家 84% 认为正面,公众 **44%**。

每一个都是腰斩级别的差距。

更狠的是,64% 的美国人预期 AI 会在未来 20 年导致工作减少,只有 5% 的人预期会增加。 而专家的预测呢? 只有 39% 的专家认为工作会减少,甚至有 19% 认为会增加。

看懂这个离谱的差异了吗?

公众觉得,AI 来了,我的工作就没了。 而专家觉得,AI 来了,工作效率会提升,新的岗位会出现,经济会增长。

这两个叙事,根本不在一个频道上。

一边用,一边怕

我有时候觉得,这种认知鸿沟比技术本身的进步更值得关注。

你知道最讽刺的是什么吗?同一份报告里说,全球有 58% 的员工已经在工作中使用 AI 了,而在印度、中国、尼日利亚这些国家,这个比例超过 80%。

也就是说,那些最担心 AI 抢饭碗的人,恰恰是 AI 用得最勤的人。

这就很有意思了。 一边用,一边怕。一边离不开,一边焦虑。

这种分裂感,我自己身边也见过太多次。

之前看到有人发帖提问:

用了那么多 AI,那么多 Agent,装了那么多 Skill,可以用 AI 搞定几乎所有的事情。

但为什么,坐在电脑前的时间反而更多了呢?

底下有条高赞评论,一针见血:

很早之前在字节专门研究过,效率越高越加班。本质是因为个人能力被放大,每个人离“我可以改变世界”更进一步,创造的价值反馈更明确,分泌的多巴胺更多,加班更狠。就和路飞开二档一样,是透支生命的行为。

2.7%,差距消失了

再说斯坦福报告里另一个数据,我觉得特别提气。

美国顶级模型仅仅领先中国 2.7%。

三年前不可是这样的。

在2023 年,GPT-4 刚出来的时候,国内的大模型跟它的差距,保守估计都在 30% 以上。

那时候民众觉得每年都在追,每年都看到进步,但每年都觉得这差距还得再追一年。

可令人万万没想到的是,这个“再追一年”的差距,用了仅仅三年,差距就没了。

数据来自 Arena Leaderboard

数据来自 Arena Leaderboard

2025 年初开始,中美模型多次互换领先位置。

2025 年 2 月,DeepSeek-R1 短暂追平美国顶级模型(差距曾急剧缩小到 0.4%)

2026 年 3 月,Anthropic 的顶级模型领先 2.7%。

这个差距,已经小于统计误差了。

说白了,就是一个水平。

我们回想一下,在过去的三年,美国对中国 AI 的封锁有多狠啊。

高端 GPU 禁运,A100、H100、H800,全不让卖。

2024 年 10 月,连 H20 这种特供版都要限制。

人才交流切断,中国学生想学 AI 相关方向,签证越来越难。

投资限制,美国资本不能投中国 AI 公司。

这一套组合拳下来,目的是什么? 是想让中国 AI 发展不起来。

但结果是,三年后,差距没了。

当性能不再是唯一战场

写到这,我突然想到一个问题。

当模型性能不再是竞争焦点的时候,竞争会转向哪里?

安全?生态?应用?人才?信任?

我觉得可能都有。

但最关键的,可能是 信任。

报告里有个数据,是关于公众对 AI 的信任。 美国人对政府监管 AI 的信任度,只有 31%,是全球 surveyed 国家里最低的。作为对比,新加坡是 81%,印尼是 76%,全球平均是 54%。

这个数字背后是什么? 我觉得是一种深层的不安全感。当你对一个东西感到失控的时候,你自然就不相信任何机构能管好它。

而有趣的是,报告里说,在所有 50 个州,担心 AI 监管不够的人,都多于担心监管过度的人。全国范围内,41% 的人觉得联邦 AI 监管会不够力,27% 的人觉得会过度。

这种矛盾心态,太真实了。既想要监管,又不相信监管者。既想要 AI 带来的便利,又害怕它带来的风险。

我们这代人的集体困境

我寻思了一下,我没寻思明白。

为什么专家和公众的认知会差这么多?

报告里给了一个线索:AI 领导者们一直在关注 AGI 的风险,关注超级智能会不会失控,但普通人关心的是下个月的工资单会不会变薄,电费账单会不会变厚。

说白了,专家在聊十年后的事,普通人在聊下个月的事。

这两个对话,本来就不可能在一个频道上。

但这还不是最关键的。 最关键的是,这种认知鸿沟会带来什么后果?

你想啊,当政策制定者听到的是专家的声音,他们制定的政策会倾向于鼓励 AI 发展,放宽监管,加速落地。但当公众感受到的是焦虑和不安,他们会用选票、用舆论、用抵制来表达不满。

这两种力量撞在一起,会发生什么? 我不知道。但我能感觉到,这种撕裂已经在发生了。

报告里提到,Gen Z 对 AI 的情绪正在变得越来越负面。 盖洛普最近的一个 poll 显示,年轻人对 AI 的希望越来越少,愤怒越来越多,尽管有一半的人每天都在用 AI。

这种又爱又恨的感觉,我太理解了。 就像明知道熬夜不好,但我还是要熬。明知道刷短视频浪费时间,但我还是要刷。对于 AI 也是这样,我知道它可能带来风险,但已经离不开它了。

这种分裂,是我们这代人的集体困境。我们都在这个撕裂里,谁都跑不掉。

那怎么办?

说实话,我也不知道。

但我觉得,第一步是得承认这种撕裂的存在,而不是假装它不存在。

AI 已经不仅仅是一个技术问题,它是一个社会问题。它关乎权力,关乎分配,关乎谁受益谁受损。

当我们在讨论 AI 的时候,我们其实在讨论,我们想要一个什么样的未来。

这些问题,没有标准答案。 但有一点是确定的:

如果专家和公众继续活在两个世界里,继续各说各话,那任何答案都不会有好结果。

夜雨聆风

夜雨聆风