如果你这两年一直在用 AI,大概率已经听过这些词:

LLM、Token、Context、Prompt、Tool、Agent、MCP、Agent Skill。

它们几乎每天都在你的信息流里出现。

但说实话,真正把这 8 个概念串起来理解的人,并不多。

很多人的状态其实是这样的:

• 知道 LLM 是大语言模型 • 知道 Prompt 是提示词 • 知道 Agent 是智能体 • 知道 MCP 最近很火

然后呢?

然后就没有然后了。

一旦往下追问一句,比如:

Token 到底是字,还是词?

Context 和 Prompt 到底是什么关系?

有 Tool 为什么还不算 Agent?

已经有 Tool 了,为什么还需要 MCP?

很多人就开始含糊了。

这也是我这段时间一个很强烈的感受:大多数人并不是不努力,而是对 AI 的理解停留在“名词认知”层,没有真正进入“机制认知”。

而机制认知,才决定你能不能把 AI 用明白。

今天这篇文章,我不聊某个具体工具,也不做百科式科普。我想做一件更有价值的事:

把这 8 个概念讲成一条“能力进化链”。

你会发现,它们不是 8 个互相独立的名词,而是 AI 一步一步从“会说话”进化到“能独立干活”的完整路径。

理解这条链,你以后再看到任何 AI 新概念,心里都会更稳。

因为你知道它到底在解决什么问题。

一、先说结论:这不是 8 个概念,这是 8 层能力

我先把最核心的判断放前面。

这 8 个概念不是平铺的,而是递进的:

LLM -> Token -> Context -> Prompt -> Tool -> Agent -> MCP -> Agent Skill

每一层的出现,都是因为上一层有一个明显的短板。

你可以把它理解成这样:

如果你把这张表真正吃透,你就会发现一个很有意思的事情:

AI 行业里很多新词,其实都不是横空出世,而是在这条链上的某个位置做增强。

所以真正重要的,不是背单词。

而是理解它们为什么会出现。

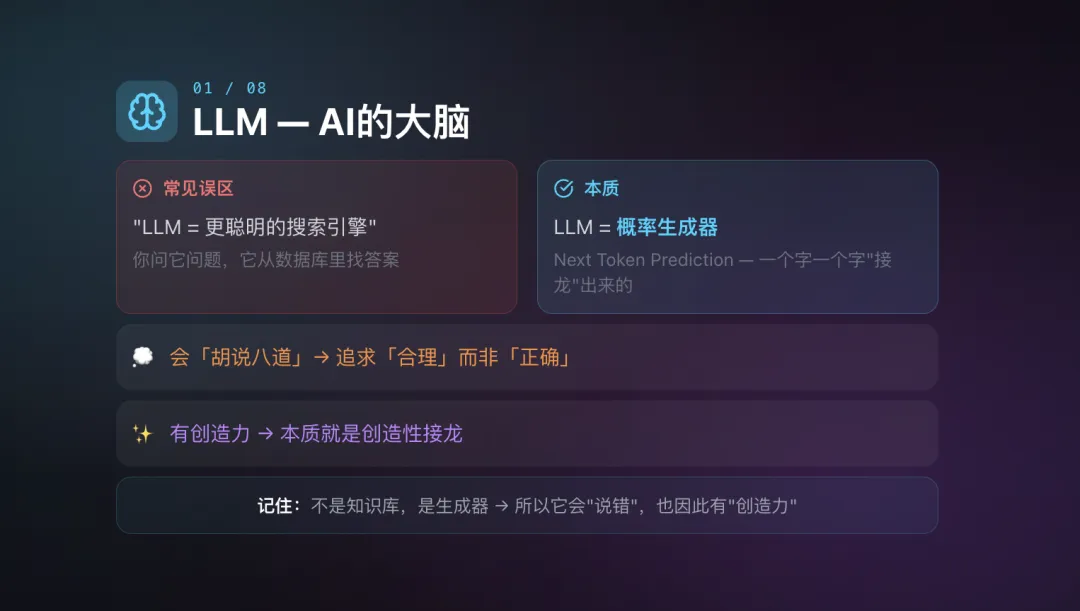

二、LLM:AI 的“大脑”,但不是搜索引擎

先说第一个概念:LLM,Large Language Model。

很多人对它的第一反应是:

“哦,就是一个更聪明的搜索引擎。”

这个理解很常见,也很容易误导人。

因为 LLM 不是在“查答案”,它是在“生成答案”。

它底层做的事情叫 next token prediction,也就是:

给它一段上下文,它去预测“下一个最可能出现的 token 是什么”。

然后再基于刚生成的 token,继续预测下一个。

一个接一个,像接龙一样,把整段回答“续”出来。

这件事带来两个非常关键的后果。

1. 它会胡说八道,不是因为它笨,而是因为它本来就在“生成”

你有没有遇到过这种情况:

• 问它一个很具体的知识点,它答得头头是道 • 但你一查,里面夹了几句明显是编的

很多人会觉得:“AI 怎么这么不靠谱?”

但如果你理解了 LLM 的本质,你就会明白,这不是偶然失误,而是机制决定的。

它追求的是“语言上最合理”,不是“事实上最真实”。

这就是为什么幻觉问题几乎是所有大模型的宿命。

2. 它也因此具备创造力

反过来说,正因为它不是查数据库,所以它才能写诗、写故事、生成代码、重组表达。

它不是把现成答案搬给你,而是在已有统计规律上,现场生成一个“看起来成立”的结果。

这就是 LLM 既强大又危险的地方。

强大在于它能创造。

危险在于它也能一本正经地创造错误。

所以如果你只记一句话,我希望你记住这个:

LLM 是概率生成器,不是知识库。

理解这一点,你对 AI 的很多困惑都会瞬间消失。

三、Token:不是技术细节,它是 AI 的成本单位

第二个概念是 Token。

大多数人第一次听到 Token,都会把它理解成“字”或者“词”。

这个理解不能算错,但也不够准确。

更精确的说法是:

Token 是模型处理文本时的最小单位。

它不完全等于一个字,也不完全等于一个词。

比如英文里的 ChatGPT,可能会被拆成多个 token。中文里的“人工智能”,也未必就是 4 个 token。

这听起来像个技术细节,但实际上它跟你日常使用 AI 的体验强相关。

1. 为什么同样一段内容,中文往往更贵?

如果你做过 API 调用,应该知道大部分模型都是按 token 收费的。

而中文在很多模型里的 token 消耗,通常比英文更高。

这意味着什么?

意味着同样的信息量,中文可能天然更贵。

如果你是个人随便玩玩,这事影响不大。

但如果你在做产品、做业务、做批量调用,这就不是小问题了,而是真金白银。

2. 为什么 AI 聊着聊着突然“变笨”了?

很多人会发现,跟 AI 聊到后面,它会开始:

• 忘前文 • 回答变短 • 逻辑断裂 • 甚至直接截断

很多时候,不是模型状态不好,而是 token 预算快打满了。

所以 Token 不只是定价问题,它还是能力边界问题。

3. 为什么模型越强,往往越贵?

很多人以为贵是因为“知道得更多”。

其实更本质的原因是:每一个 token 的生成,背后都需要更复杂的计算。

所以 Token 是什么?

在我看来,它至少是三件事:

• AI 的语言单位 • AI 的成本单位 • AI 的能力边界单位

如果你连 Token 都没建立正确认知,后面很多问题你都会看不透。

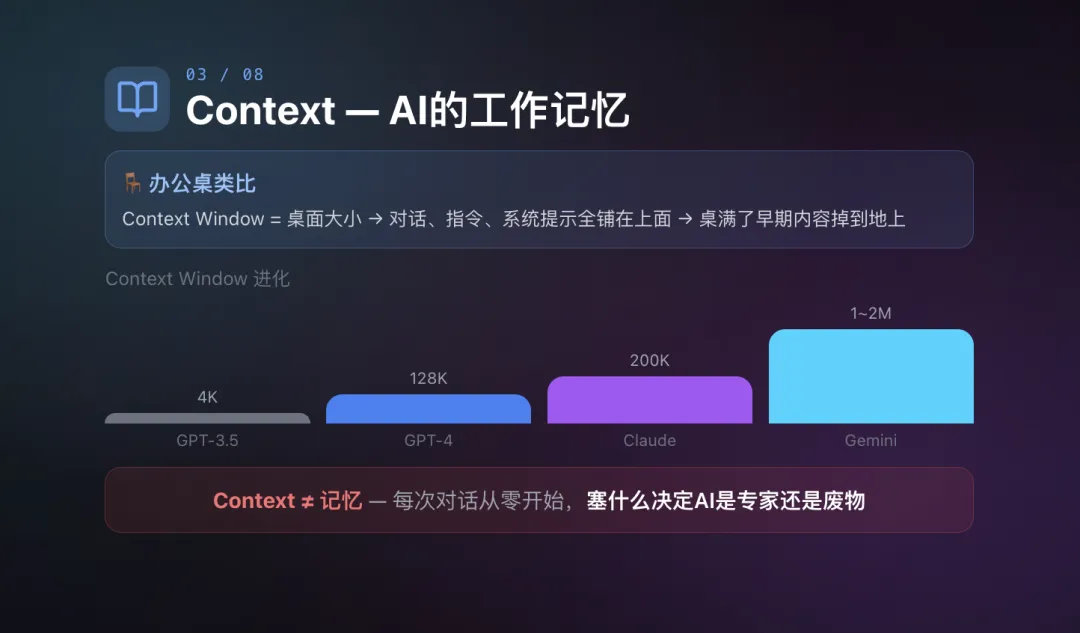

四、Context:AI 不是失忆,它只是桌子太小了

第三个概念,Context。

这个概念我觉得特别重要,因为它直接决定你是不是会“正确地失望”。

为什么这么说?

因为很多人对 AI 的期待,本质上是把它当成了一个“有连续记忆的人”。

但现实不是。

Context 更像什么?

更像一张办公桌。

你给 AI 的所有信息,系统提示词、历史对话、文档、代码片段、你刚刚的提问,全都摊在这张桌子上。

桌子有多大,它一次就能同时看到多少东西。

桌子外面的内容,不是它不愿意看,而是它根本看不见。

这就是为什么你跟 AI 聊久了,它会“忘记”前面的内容。

不是它失忆了,而是前面的纸张已经掉到桌子外面了。

一个特别容易混淆的误区:Context 不等于记忆

这点我想单独强调一下。

很多人把 Context 理解成“AI 的记忆能力”,这其实不对。

Context 是当下可见范围,不是真正的长期记忆。

它更像临时工作区,而不是大脑硬盘。

所以同一个模型,有时候像专家,有时候像傻子,根本原因常常不是模型本身变了,而是:

你给它的 Context 质量变了。

塞得清楚,它就表现得像专家。

塞得混乱,它就像临时抓来应付差事的人。

这一点在代码场景里尤其明显。

你把目标、约束、文件结构、上下游关系说清楚,AI 很稳定。

你只丢一句“帮我改下这个 bug”,然后指望它全懂,最后大概率就是一地鸡毛。

所以说到底,Context 决定的是:

AI 在这一轮任务里,到底处于什么认知地板和认知天花板之间。

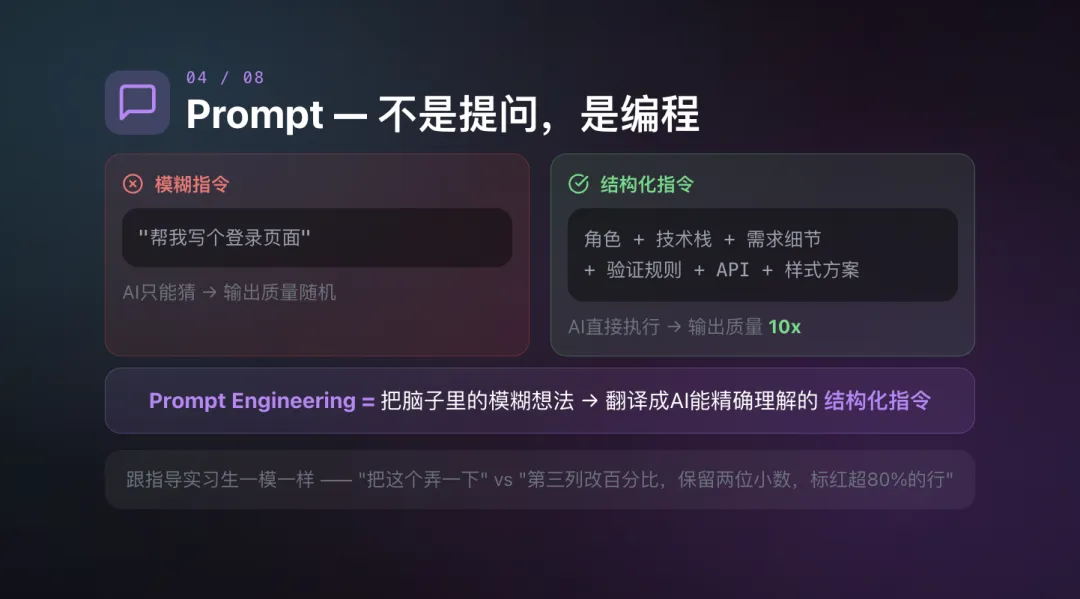

五、Prompt:不是提问,是用自然语言编程

聊到这里,就顺理成章进入下一个概念:Prompt。

很多人对 Prompt 的理解停留在“提示词”。

这当然没错,但如果你只是把它理解成“提问技巧”,你其实还是低估了它。

我现在越来越倾向于把 Prompt 理解成一件事:

你在用自然语言给 AI 编程。

为什么这么说?

因为 Prompt 的本质,不是把问题说出去,而是把任务结构化。

举个特别典型的例子。

差的 Prompt:

帮我写个登录页。

好的 Prompt:

你是一个高级前端工程师。请用 React + TypeScript 实现一个登录页面,包含邮箱和密码输入框、表单校验、错误提示、提交后调用

/api/login接口,并使用 Tailwind CSS 做响应式布局。

这两个 Prompt 看上去都在表达同一个需求,但本质完全不同。

第一个 Prompt 是在丢任务。

第二个 Prompt 是在定义任务。

这就是为什么很多人会觉得“AI 有时候很好用,有时候像智障”。

说白了,不少时候不是模型不行,而是你给它的工作指令太模糊。

Prompt Engineering 不是玄学,是把模糊想法翻译成清晰约束

我特别反感把 Prompt 神秘化。

它不是什么只有高手才懂的咒语体系。

本质上它就是一件很朴素的事:

把你脑子里的模糊想法,翻译成 AI 能稳定执行的约束集合。

角色、目标、范围、输入、输出、限制条件、验收标准。

这些东西越清楚,AI 的输出越稳定。

这跟你带人干活是一模一样的。

你跟一个实习生说“帮我弄一下”,大概率翻车。

你说“把这个表格第三列改成百分比,保留两位小数,超过 80% 的行标红”,结果就会好很多。

所以在我看来,Prompt 不是提问能力,而是任务表达能力。

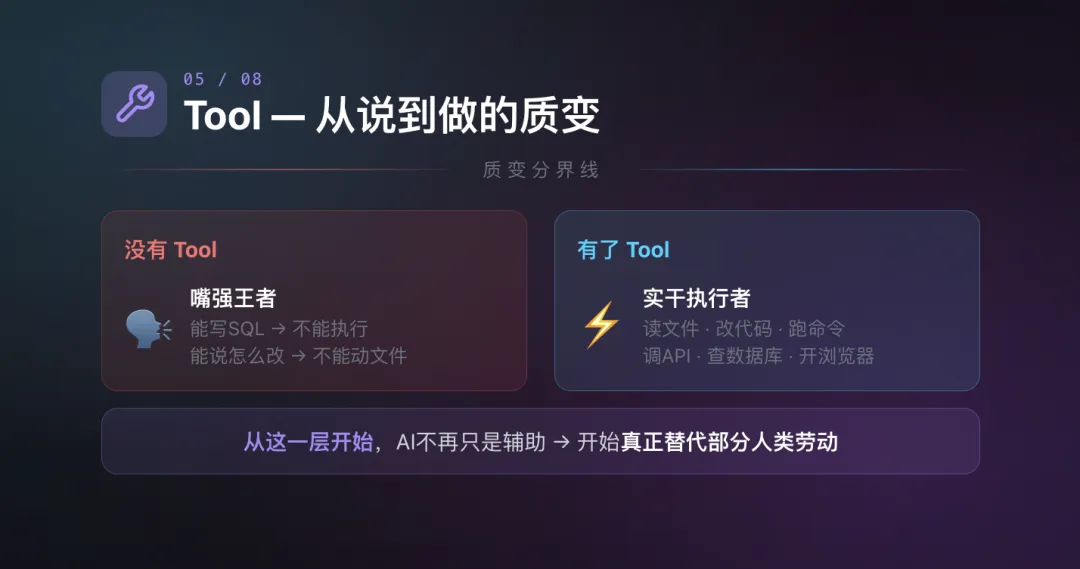

六、Tool:AI 真正开始“干活”的分水岭

前面四层,其实都还停留在“理解和生成”。

也就是说,AI 到这里为止,还是主要在处理文本。

它会思考、会理解、会生成、会解释。

但它有一个巨大短板:

它只能说,不能做。

这时候,Tool 出现了。

Tool 到底解决了什么?

解决的是 AI 从“嘴强王者”变成“能动手的人”。

比如在代码场景里:

• 读取文件 • 修改代码 • 调用终端 • 执行脚本 • 访问接口 • 查询数据库 • 操作浏览器

这些都不是大模型天然拥有的能力,而是外部工具赋予它的能力。

所以 Tool 的意义非常大。

没有 Tool 的 AI,更像一个参谋。

它能把建议说得很漂亮,但最后还得你自己执行。

有了 Tool 之后,AI 开始变成执行者。

它不再只是告诉你“应该怎么改”,而是直接去改。

这就是为什么很多人第一次在 Cursor 里看到 AI 自动读文件、改代码、跑命令的时候,会有一种很强的冲击感。

因为那一刻你会意识到:

这已经不是一个聊天机器人了。

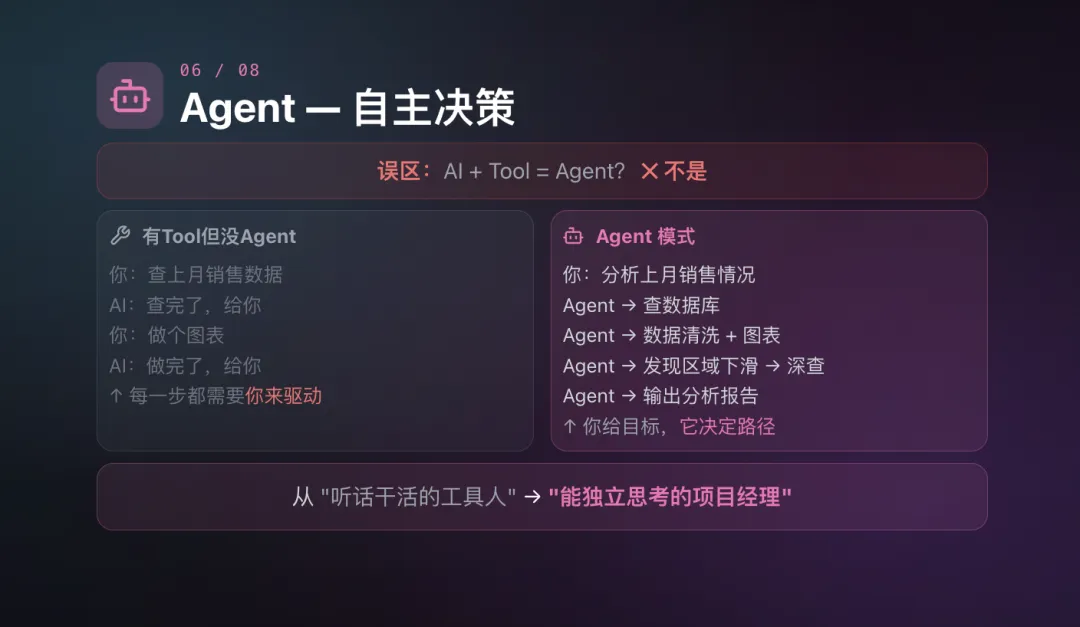

七、Agent:关键不在“有工具”,而在“会自己决定怎么用”

接下来是最近最容易被滥用的一个词:Agent。

现在很多产品动不动就说自己是 Agent。

但说句实话,很多所谓 Agent,本质上只是“带点自动化的 AI 助手”。

真正的区别在哪?

不在于它有没有 Tool。

而在于它有没有自主决策能力。

有 Tool,不等于有 Agent

这个误区非常普遍。

你让 AI 去查数据库,它查了。

你再让它生成图表,它生成了。

这依然只是“按步骤执行”。

真正的 Agent 是什么?

是你只给它一个目标,它自己去拆任务、选工具、执行、检查、调整。

比如你说:

帮我分析一下上个月销售下滑的原因,并给出建议。

一个普通带 Tool 的 AI,可能只会等你一步步下命令。

一个真正的 Agent,会自己做这些事:

• 先查销售数据 • 再找异常波动 • 再去比对区域、时间、品类 • 再生成图表 • 再提炼结论 • 如果发现数据不够,还会继续追问或主动补查

这才叫 Agent。

所以我常说一句话:

Tool 解决的是“能不能做”,Agent 解决的是“怎么自己把事情做完”。

这两者不是一个层级的问题。

从 Tool 到 Agent,是 AI 从“工具人”变成“项目经理”的质变。

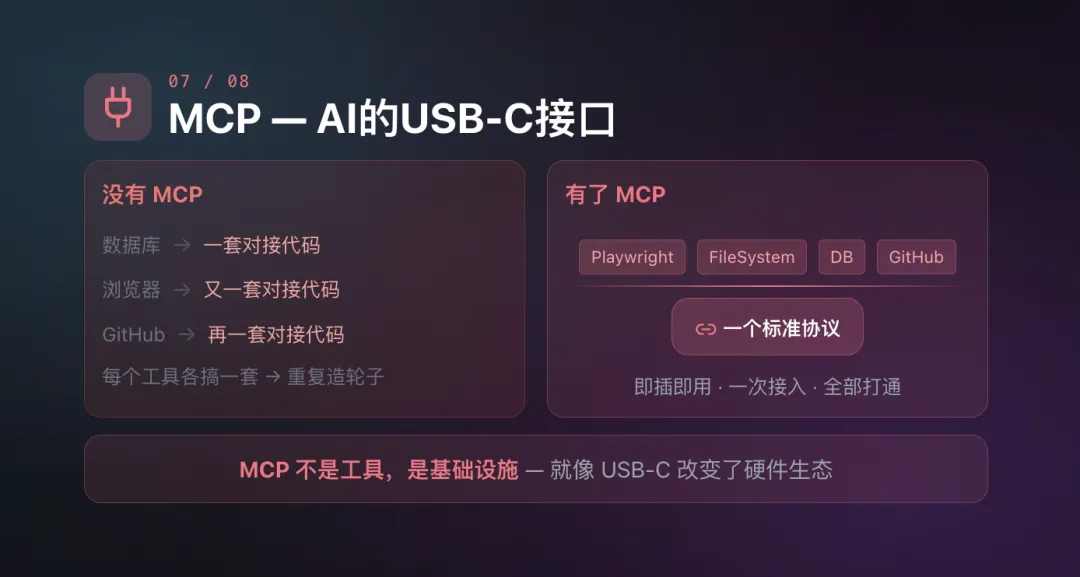

八、MCP:AI 世界终于开始长出“统一接口”

然后就是最近很火的 MCP,Model Context Protocol。

如果你最近一直在看 AI 圈内容,应该已经被这个词刷过很多遍了。

但很多人还是会有个疑问:

既然已经有 Tool 了,为什么还要 MCP?

因为 Tool 的世界如果没有标准,最后一定会碎片化。

这个问题其实一点都不新鲜。

我最喜欢的类比就是:

MCP 像 AI 世界的 USB-C。

以前每个设备接口都不一样,你出门得带一堆线。

AI 工具接入也是一样。

数据库一套接法,浏览器一套接法,文件系统一套接法,企业内部系统又是一套接法。

每加一个工具,就写一套适配。

这件事的结果就是:

• 工具开发者很累 • AI 客户端很累 • 用户也很难形成稳定体验

MCP 的意义就在于,它定义了一套统一协议,让 AI 知道:

• 怎么发现工具 • 怎么调用工具 • 工具怎么返回结果

有了这个标准之后,工具开发者只要按协议暴露能力,支持 MCP 的 AI 客户端就能直接接入。

这件事听起来不性感,但其实特别关键。

因为真正改变生态的,往往不是某个孤立功能,而是底层标准。

Type-C 改变的是硬件生态,

MCP 改变的是 AI 的能力生态。

这也是为什么我越来越觉得,MCP 不是一个“热点词”,而是一个真正值得长期关注的基础设施概念。

九、Agent Skill:AI 不是越通用越好,很多时候它需要被“训练成专家”

最后一个概念,Agent Skill。

很多人到 Agent 这一步就停了,觉得已经够强了。

但实际做过复杂任务的人很快就会发现一个问题:

Agent 什么都能做一点,但不一定什么都做得深。

这就像一个全科医生。

感冒、发烧、普通问题都能看。

但如果你真要做心脏手术,你不会找全科医生。

你会找专家。

Agent Skill 的价值就在这里。

它不是再给 AI 加一个新大脑,而是把某一类高频、复杂、可复用的工作流程,封装成稳定的专业能力。

比如:

• 代码审查并输出结构化报告 • 自动化测试并分析失败原因 • 把 PRD 转成技术方案 • 基于知识库回答某一类固定业务问题

这些工作如果每次都让 Agent 从零开始想,效果波动会很大。

但如果你把:

• 系统提示词 • 工作流程 • 工具组合 • 质量标准

都预先设计好,封装成 Skill,它在这个任务上的表现就会稳定很多。

简单说:

Agent 给了 AI 自主性,Skill 给了 AI 专业度。

一个是“会自己干活”。

一个是“在某件事上干得特别好”。

十、把这 8 个概念串起来,你才真正开始理解 AI

写到这里,你应该能感受到一件事:

这 8 个概念的价值,不是让你显得懂行。

而是让你建立一套判断框架。

你以后再遇到任何 AI 新概念,不要急着被带节奏,也不要急着兴奋。

先问自己两个问题:

1. 它在这条能力链上的哪个位置?

它是在增强理解?

增强记忆?

增强表达?

增强执行?

增强标准化?

还是增强专业深度?

2. 它解决的是一个真实瓶颈,还是只是换了个新名字?

这两个问题一问,很多概念会立刻显形。

你会知道哪些是真进步,哪些只是包装。

十一、如果你是开发者,接下来最值得做的不是背名词

最后给 3 条很具体的建议,尤其适合开发者。

1. 不要只记定义,要记“它解决了什么问题”

如果你只会背:

• LLM 是大语言模型 • Prompt 是提示词 • MCP 是协议

那这些知识对你没什么实际帮助。

真正有用的是你能说出:

• 为什么 LLM 会幻觉 • 为什么 Context 不是记忆 • 为什么有 Tool 还不够 • 为什么 MCP 会成为生态基础设施

2. 把 AI 从“问答工具”升级成“工作系统”

很多人现在还停留在“有问题问一下 AI”的层面。

但真正的价值,已经开始往下走了:

• 用 Prompt 提高清晰度 • 用 Tool 让它动手 • 用 Agent 让它自己编排 • 用 Skill 让它在高频场景里稳定输出

你越早进入这个层次,越能拉开差距。

3. 建立自己的认知地图,而不是追热词

AI 圈未来一定还会继续冒出很多新词。

如果你没有一套底层地图,很容易今天学这个,明天学那个,最后脑子里全是碎片。

但如果你已经有了这条“能力进化链”,新知识会自动挂到对应位置。

这时候你不是在追热点。

你是在扩展系统。

最后

如果让我用一句话总结这篇文章,我会这么说:

理解 AI,不是从记住名词开始,而是从看见它为什么一层一层长成现在这样开始。

LLM 给了它生成能力。

Token 是它处理语言的最小单位。

Context 决定它一次能看见多少。

Prompt 决定你怎么把任务讲清楚。

Tool 让它从“会说”变成“会做”。

Agent 让它从“听命令”变成“能自己规划”。

MCP 让它开始拥有统一的能力接口。

Skill 则让它从通才走向专精。

这不是 8 个分散的知识点。

这是 AI 从聊天机器人走向数字劳动力的一条完整路径。

你理解得越早,就越不容易在下一波变化里慌。

如果你觉得这篇文章讲清楚了,收藏下来。

以后再看到任何 AI 新概念,你就回到这条链上看一眼:

它到底在解决哪个问题。

夜雨聆风

夜雨聆风