不联网问 AI?手把手教你用 NAS 搭建完全离线的 AI 知识库助手

哈喽小伙伴们好,我是Stark-C~

在这个AI盛行的年代,不管是我们个人还是企业团队,都能轻松享受到 AI 带来的效率提升和便利。但同时,AI带来的问题也非常明显,比如说:

现在的AI大模型基本都是云端联网,如果碰到断网或者有网络限制的环境,AI就直接“停摆”了; 想让 AI 在线整理自己的资料,办公文件或者聊天记录什么的,总感觉不踏实,总担心隐私会被泄露; 好不容易找到了一个合适的AI项目,但是接入大模型的API Key又需要付费,长期用的话,费用又遭不住。

那怎么做既让我们放心把自己的资料交给 AI,又能随时随地、不受限制地使用 AI?其实答案很简单:把AI从云端“请回家”,让它在本地运行就可以了!所以本期教程中,我将分享我是如何使用极空间Z423私有云,搭建一个完全离线、私有、免费的 AI 知识库助手。

话不多说,接下来开始今天的正题。

第一步:安装 Ollama 框架

Ollama 框架的作用是方便我们加载和调度各种大模型,并提供统一的 API 供外部应用或者服务连接。

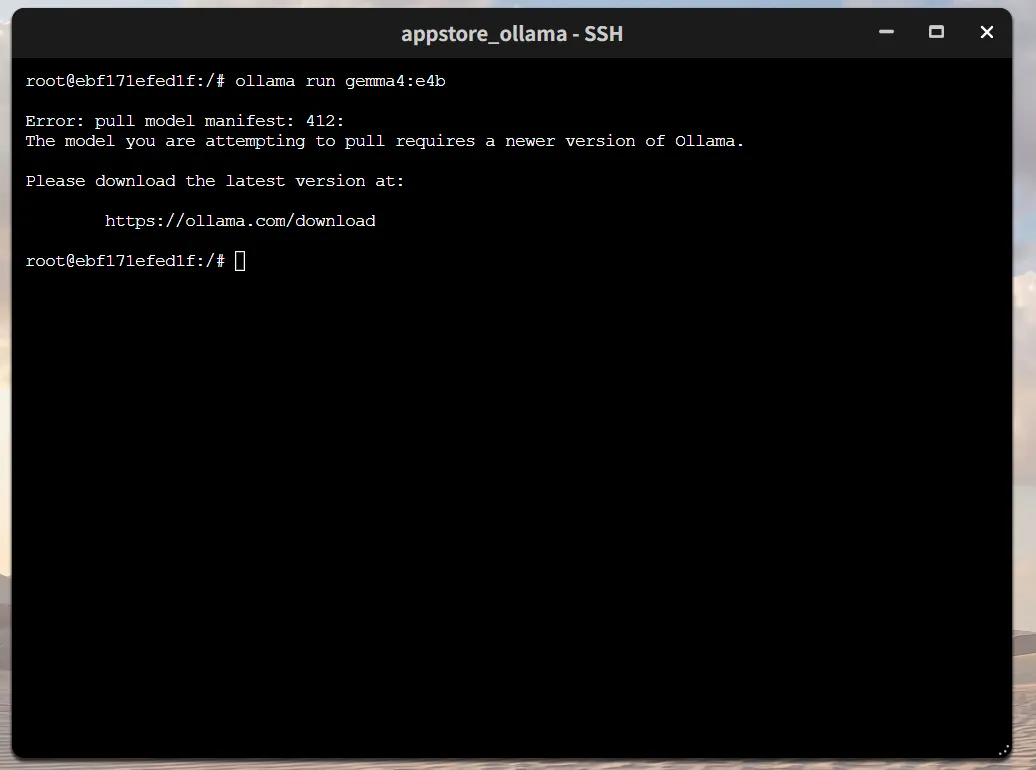

🔺其实极空间的应用商店是有现成的Ollama应用,但是我想体验谷歌最近新开源,号称当前最智能的多模态Gemma 4 大模型,而它应用商店的Ollama提示我版本过低无法使用,所以没办法,我还是决定使用Docker单独部署,这样我在以后都能第一时间体验到最新版本了。

PS:极空间会在下一个版本中更新应用商店的Ollama应用,也就是说有可能你们看到这篇文章的时候极空间应用商店已经是最新版Ollama,那个时候就就可以直接使用应用商店的Ollama应用拉取Gemma 4 大模型,而免去部署这一步了~

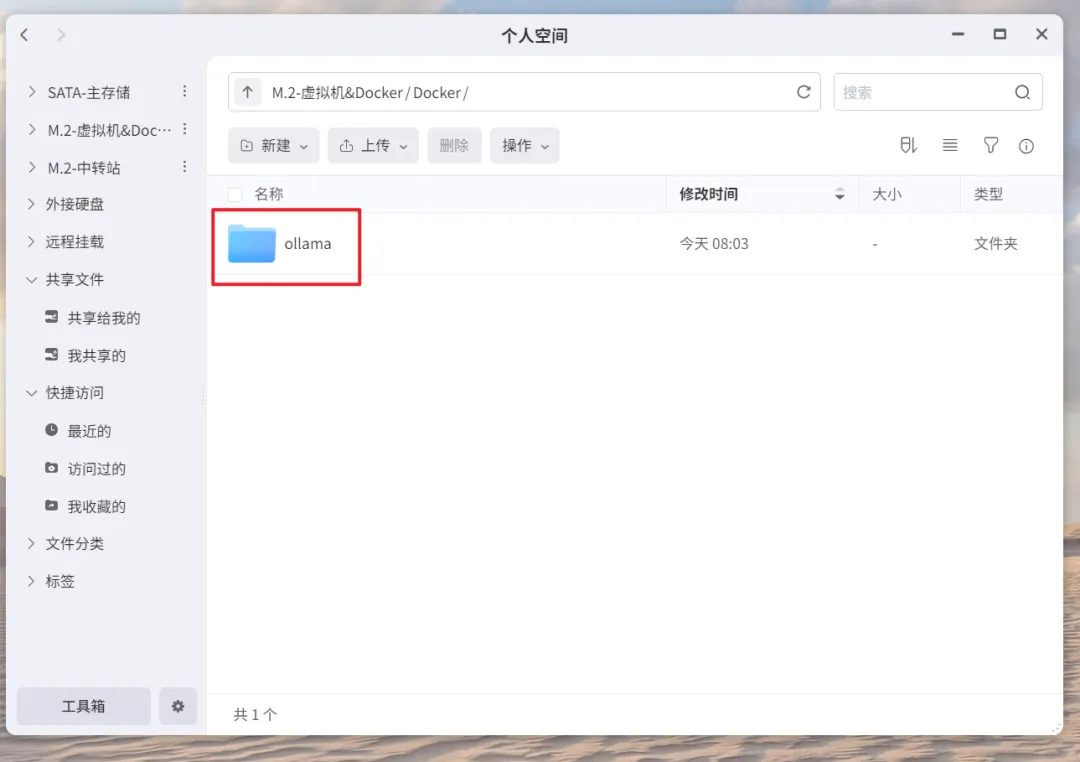

🔺先在极空间的Docker目录中新建一个“ollama”的文件夹。

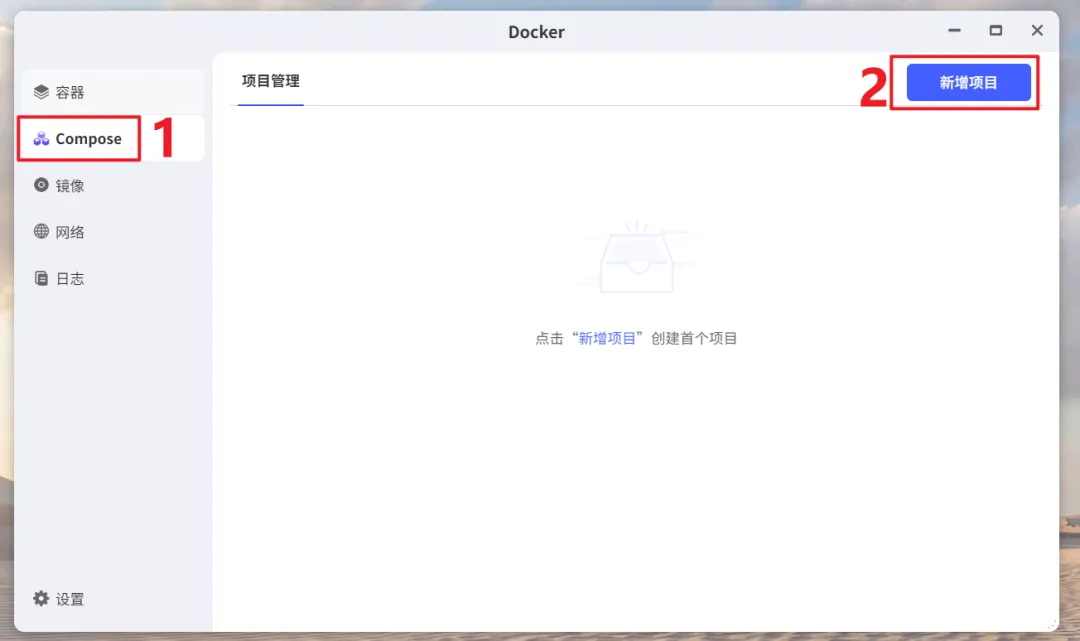

🔺然后点击极空间NAS的“Docker”应用,点击【Compose】 > 【新增项目】。

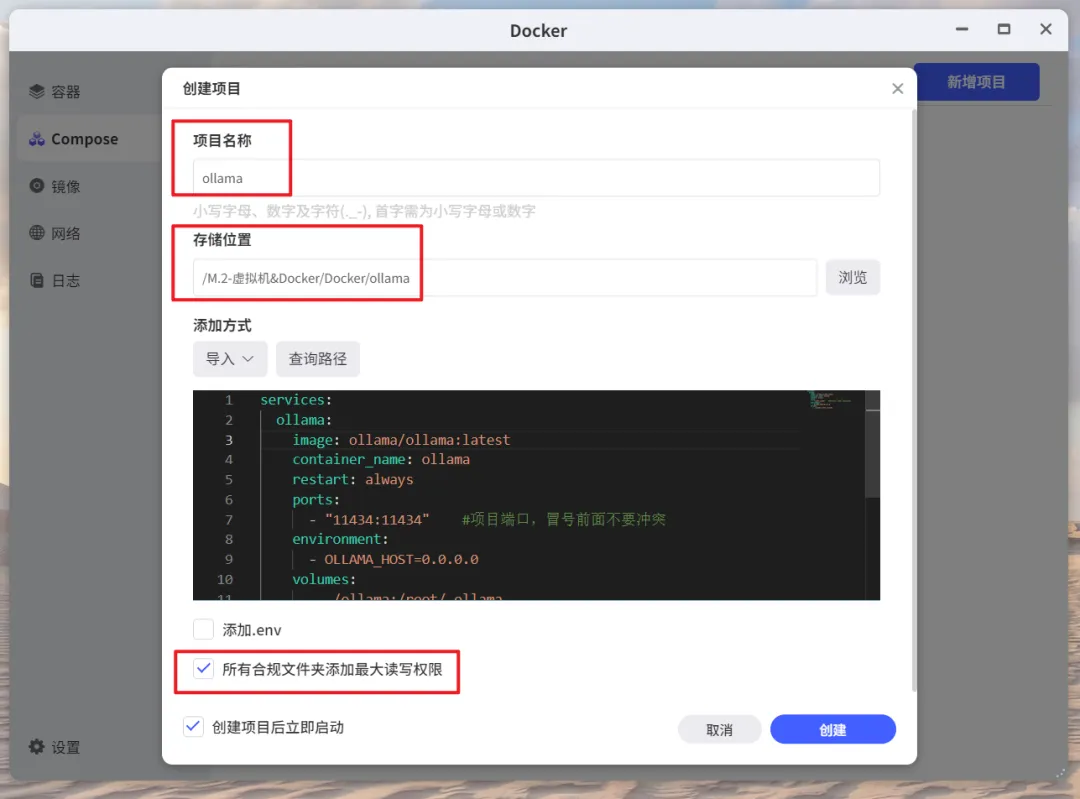

🔺极空间的Compose现在已经全面拥抱相对路径的部署,在“创建项目”页面自定义项目名称,“存储位置”需要手动选择我们前面新建的ollama文件夹,然后勾选下方的“所有合规文件夹添加最大读写权限”,最后输入以下 Docker Compose 配置信息后点“创建”按钮:

services:

ollama:

image:ollama/ollama:latest

container_name:ollama

restart:always

ports:

-"11434:11434"#项目端口,冒号前面不要冲突

environment:

-OLLAMA_HOST=0.0.0.0

volumes:

-./ollama:/root/.ollama

以上代码需要修改的地方就项目Web页面打开端口那里,其它的直接保持默认即可。镜像的拉取需要自行解决网络问题,粘贴到自己的NAS这边之前建议使用AI工具优化一下,以防止格式问题造成的部署失败。

🔺ollama的镜像还是比较大的,耐心等待项目部署完成,当看到容器显示“运行中”,就说明可以使用了。

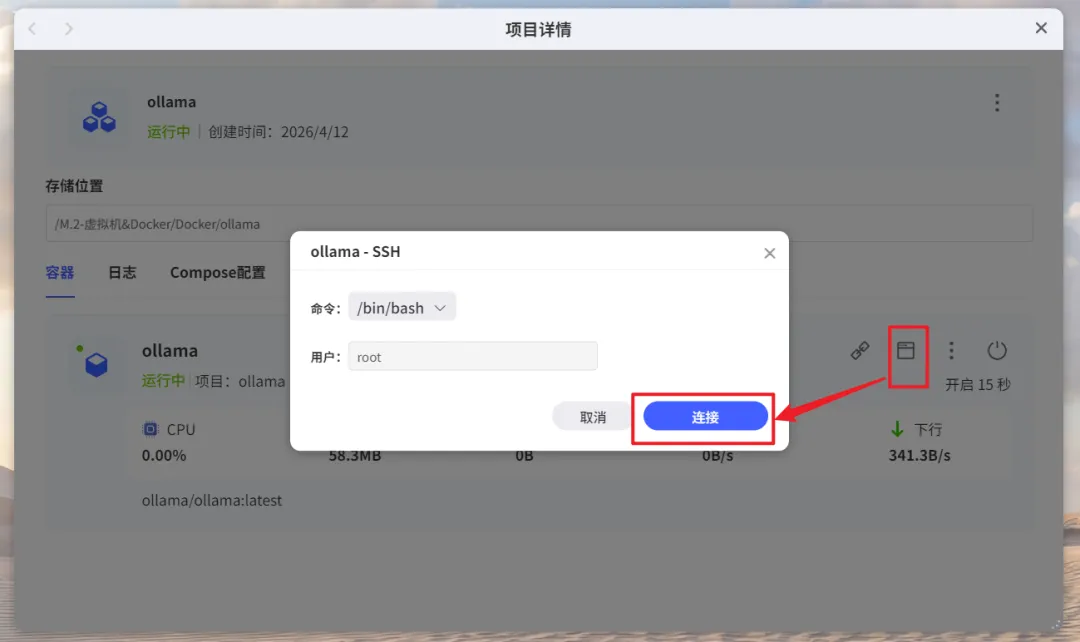

🔺接着我们要为ollama配置Gemma 4 大模型,点击项目容器中的“终端”,默认命令“/bin/bash”不要动,直接点“连接”。

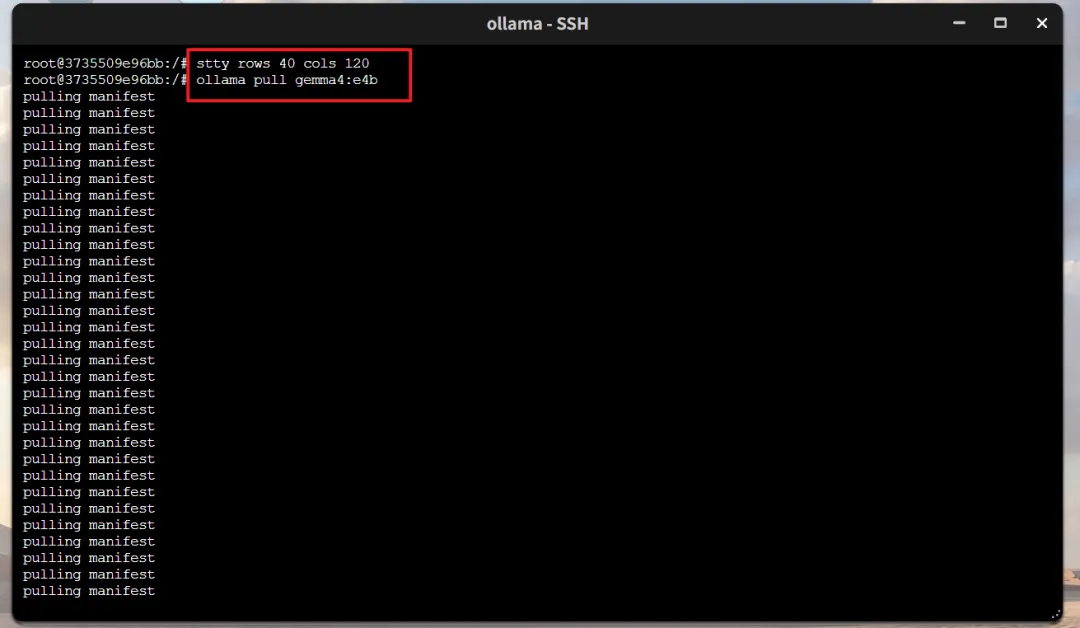

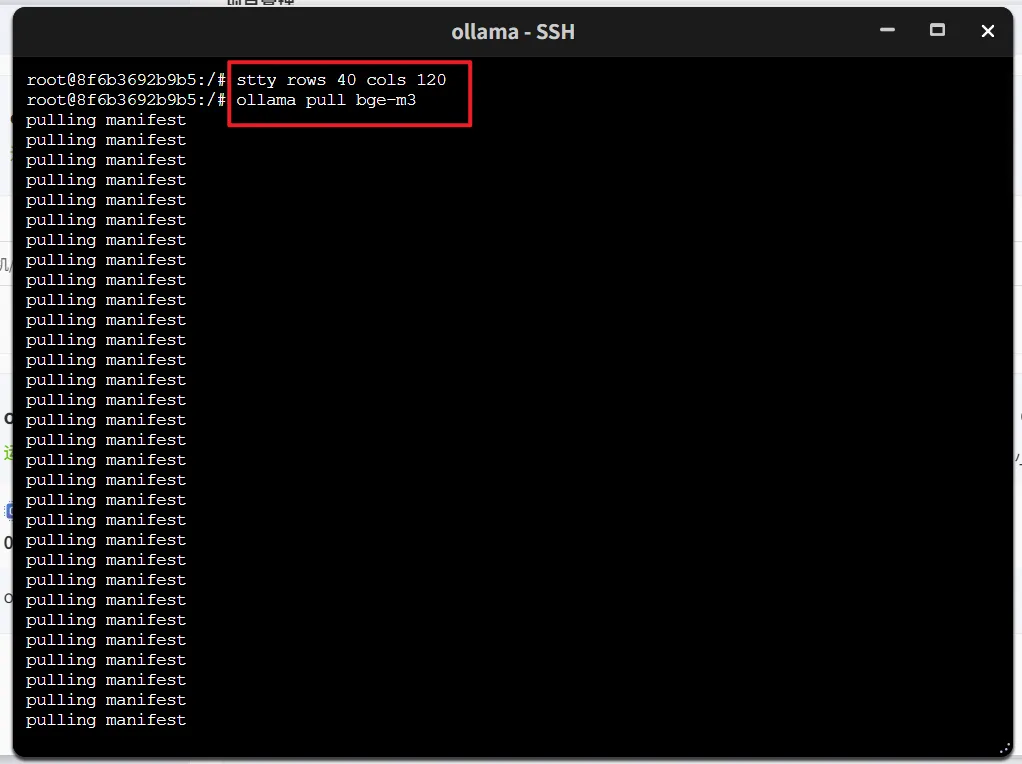

🔺在终端端口依次执行以下命令:

stty rows 40 cols 120 ollama pull gemma4:e4b

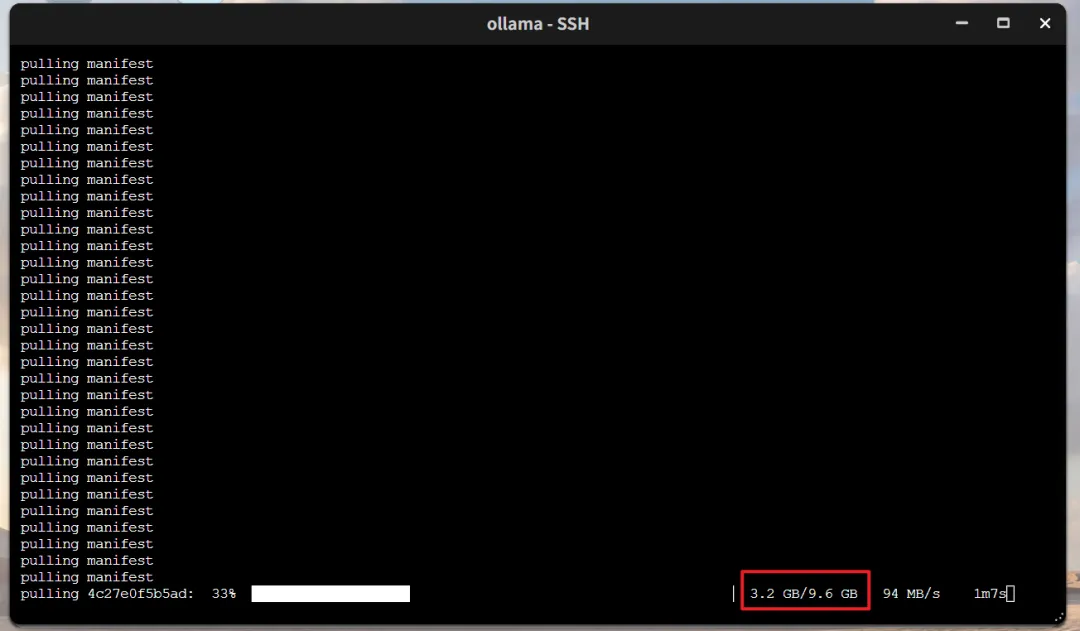

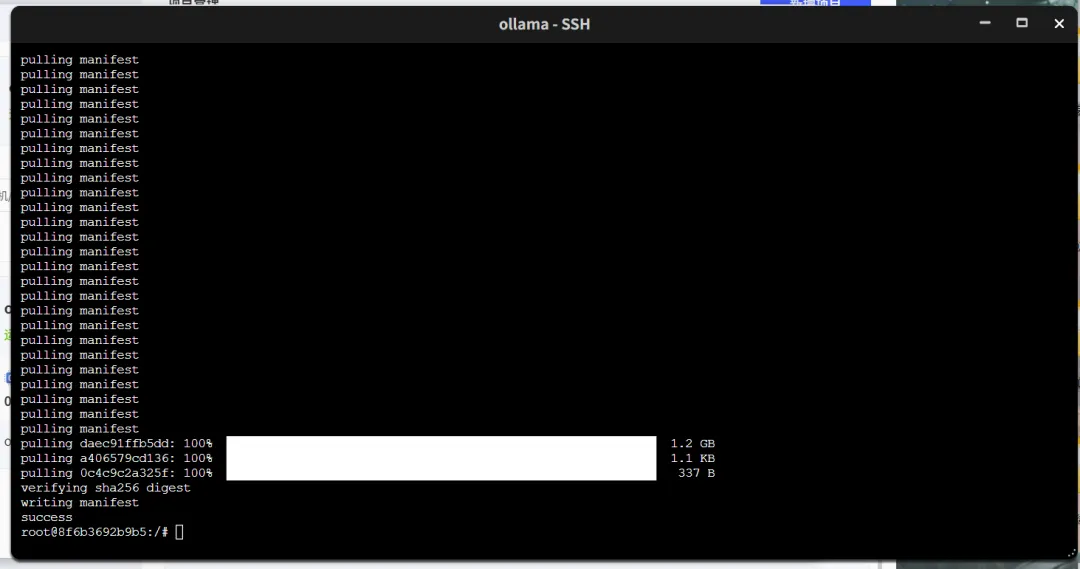

🔺gemma4:e4b大模型有9.6GB,还是很大的,耐心等待全部拉取完成。

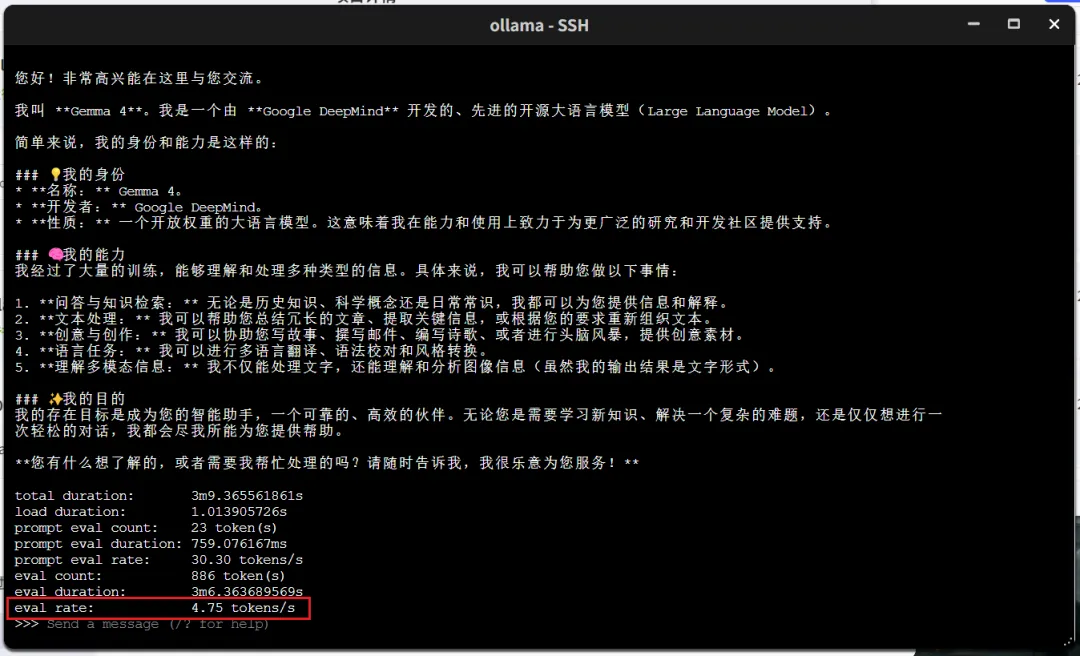

🔺等待它拉取完成之后我使用“ollama run gemma4:e4b --verbose”命令测试了下它在极空间上的速度,得出的结果为4.75tokens/s。谈不上很快,但也算合格了。

PS:如果只是追求推理速度,还可以考虑gemma4:e2b大模型。

第二步:部署 Open WebUI

Open WebUI 的作用是为ollama部署好的后端本地大模型提供一个统一、可视化、可扩展的前端 Web 界面,让我们无需命令行,点点鼠标就能和模型对话、建知识库、做 RAG。

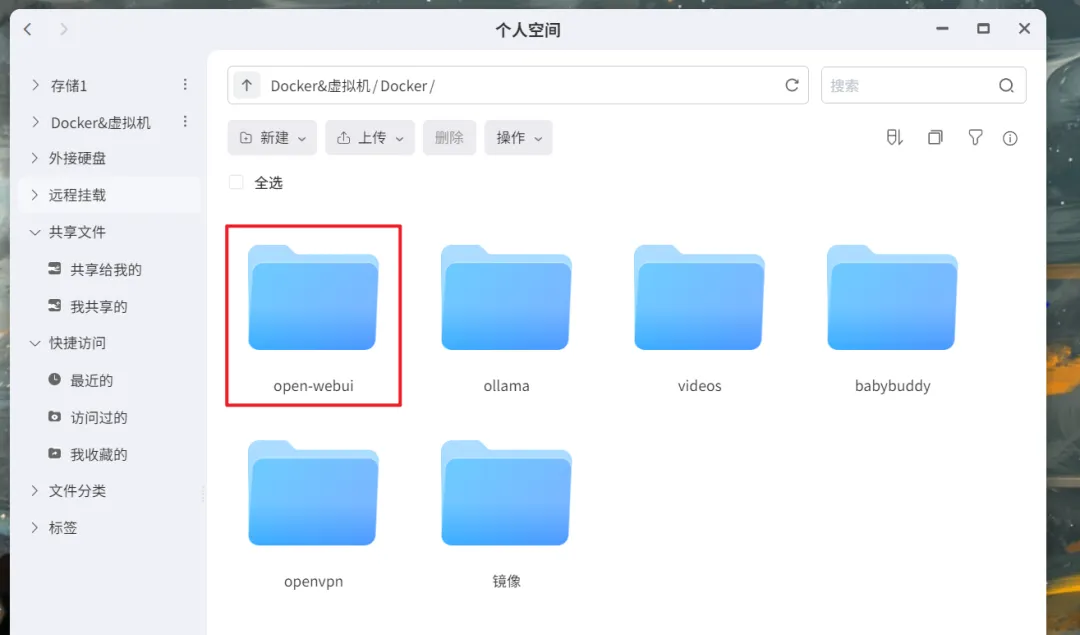

🔺先在极空间的Docker目录中新建一个“open-webui”的文件夹。

🔺然后点击极空间NAS的“Docker”应用,点击【Compose】 > 【新增项目】。

🔺同样使用相对路径部署,在“创建项目”页面自定义项目名称,“存储位置”需要手动选择我们前面新建的ollama文件夹,然后勾选下方的“所有合规文件夹添加最大读写权限”,最后输入以下 Docker Compose 配置信息后点“创建”按钮:

services:

open-webui:

image:ghcr.io/open-webui/open-webui:latest

container_name:open-webui

restart:always

ports:

-"3009:8080"#项目打开端口,冒号前面不要冲突

environment:

-OLLAMA_BASE_URL=http://192.168.31.23:11434#这里改成ollama访问地址(IP:端口号)

volumes:

-./data:/app/backend/data

healthcheck:

test:["CMD","curl","-f","http://localhost:8080/"]

interval:30s

以上代码需要修改的就我中文注释的两个地方,其它的直接保持默认即可。镜像的拉取需要自行解决网络问题,粘贴到自己的NAS这边之前建议使用AI工具优化一下,以防止格式问题造成的部署失败。

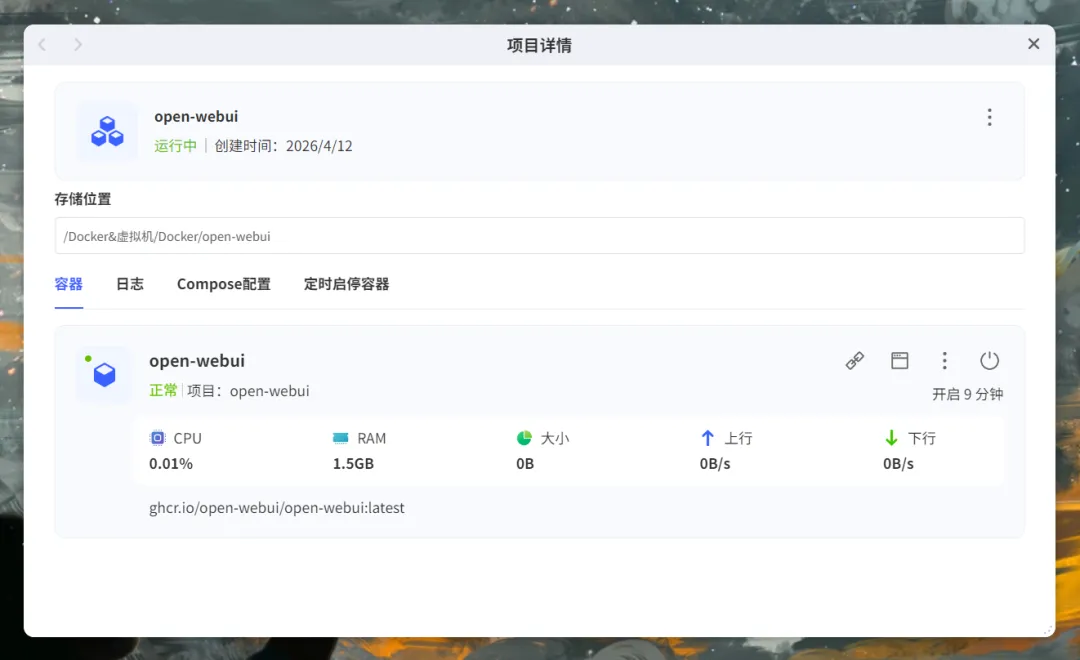

🔺项目刚开始因为要安装一些依赖和建立必要的数据库文件,所以启动的时间稍有些长。

🔺当看到项目显示“正常”,就说明 Open WebUI可以使用了。

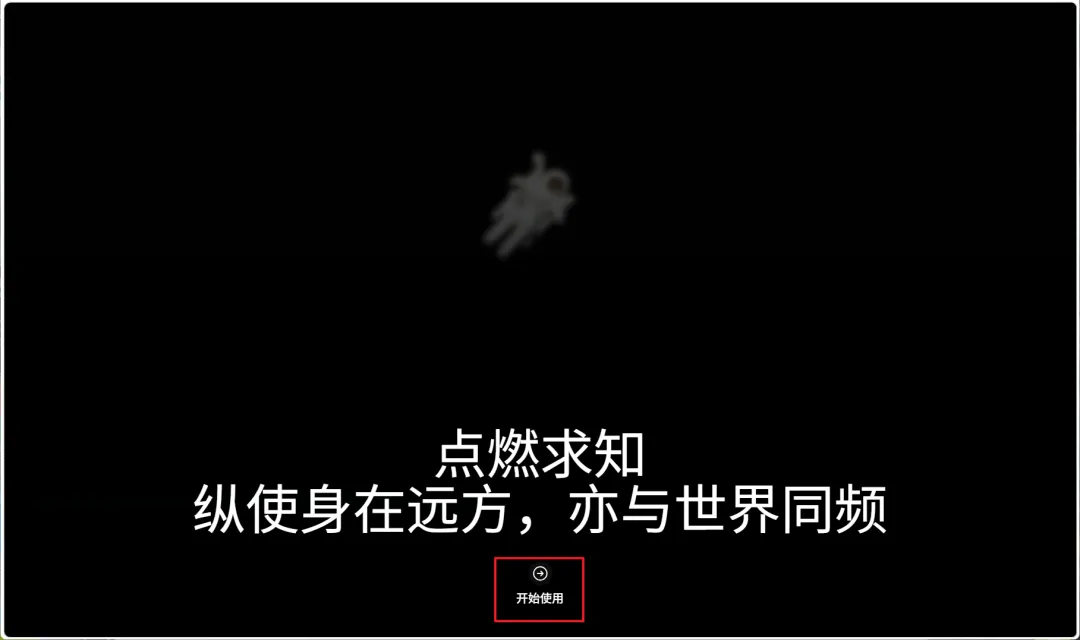

🔺 Open WebUI的打开方式没什么特别,依然是通过浏览器输入【IP:端口号】的方式,打开Web页面之后点“开始使用”。

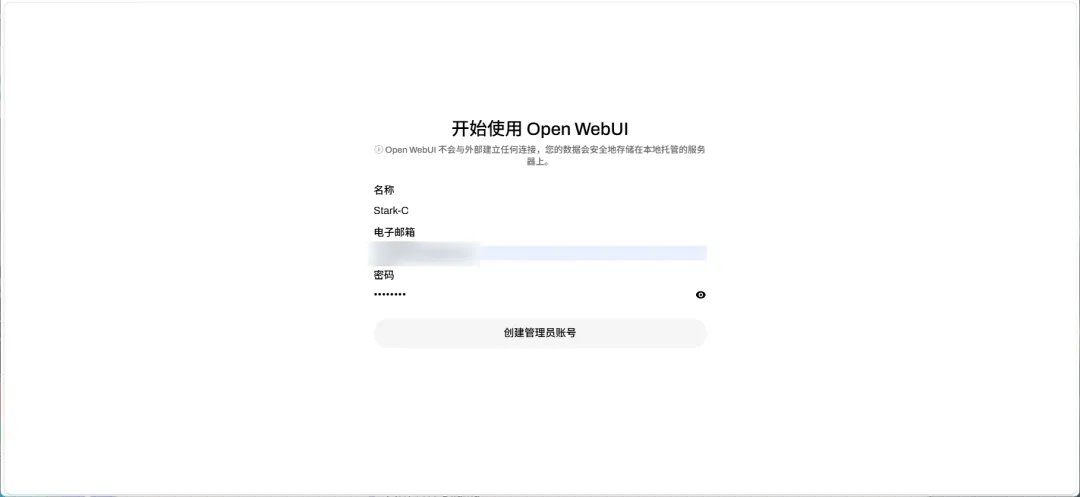

🔺首次使用需要创建管理员账号,我们直接跟着向导随便输入对应的信息即可。

🔺进来之后可以看到Open WebUI默认连接的就是Ollama 那边的gemma4:e4b大模型,并且在这里已经可以直接和gemma4:e4b大模型对话了,实测速度几乎没什么影响,也有整个思考过程,只不过gemma4:e4b大模型的思考过程显示的是英文。

第三步:搭建本地AI知识库

AI知识库和普通知识库的区别就是,AI知识库会使用RAG生成我们想要的结果,而普通知识库只是纯粹静态存储,结果需要我们自己找。

何为RAG:

自动检索(Retrieve):不是用户自己翻文档,而是 AI 自动从知识库里找相关内容。 自动理解(Augment):AI 会把检索到的内容进行理解、筛选、重组。 自动生成(Generate):最终输出的是 自然语言答案,而不是“给你一堆文档自己看”。

不过为了让 AI 能够实现自动检索,我们需要使用嵌入模型将文本转换成向量,用于相似度检索,也就是我们常说的语义匹配。

嵌入模型同样需要Ollama来拉取,目前使用最广泛的嵌入模型有相对轻量级的nomic-embed-text,以及中文使用场景比较好bge-m3。极空间Z423的机器配置不错,我这里就直接选择的后者。

🔺方法和前面拉取gemma4:e4b大模型一样,在Ollama容器终端端口,依次执行以下命令:

stty rows 40 cols 120 ollama pull bge-m3

🔺bge-m3模型有1.2GB,不是很大,一定等待模型拉取成功。

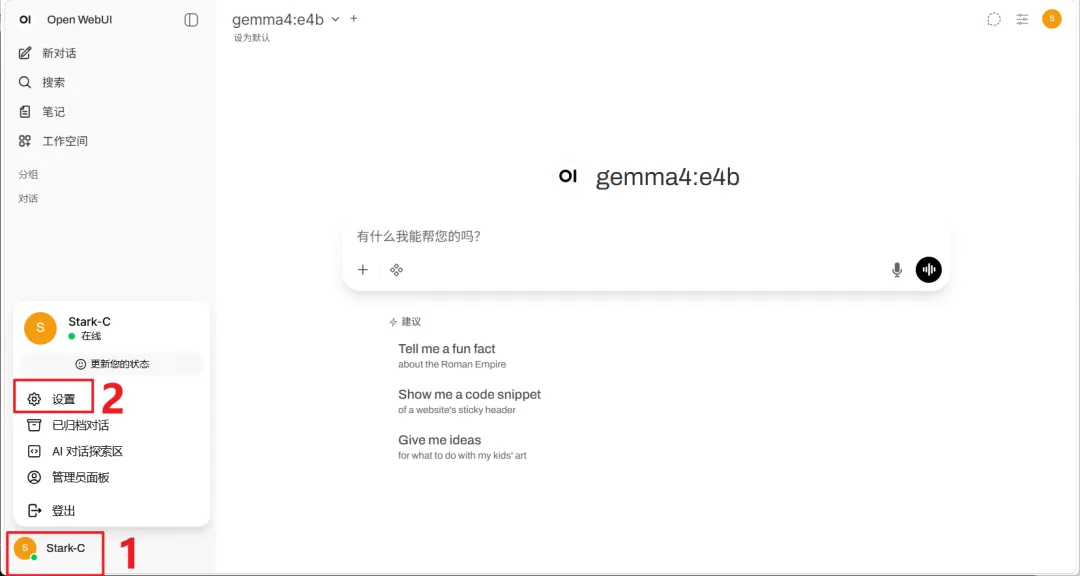

🔺bge-m3模型拉取成功之后,回到Open WebUI网页端,点击左下角的用户打开“设置”页面。

🔺然后在设置中再点击左下角的“管理员设置”。

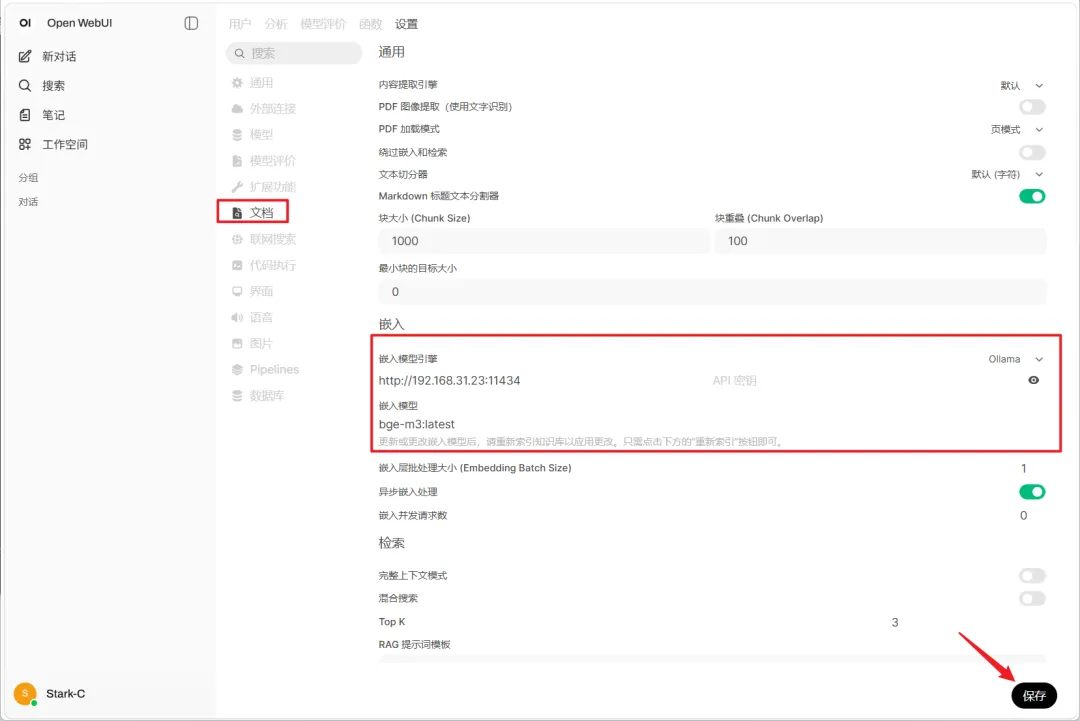

🔺在管理员设置页面选择“文档”:

嵌入模型引擎:手动选择“Ollama” 嵌入模型:手动输入“bge-m3:latest”

完成之后别忘了点页面下方的“保存”按钮。

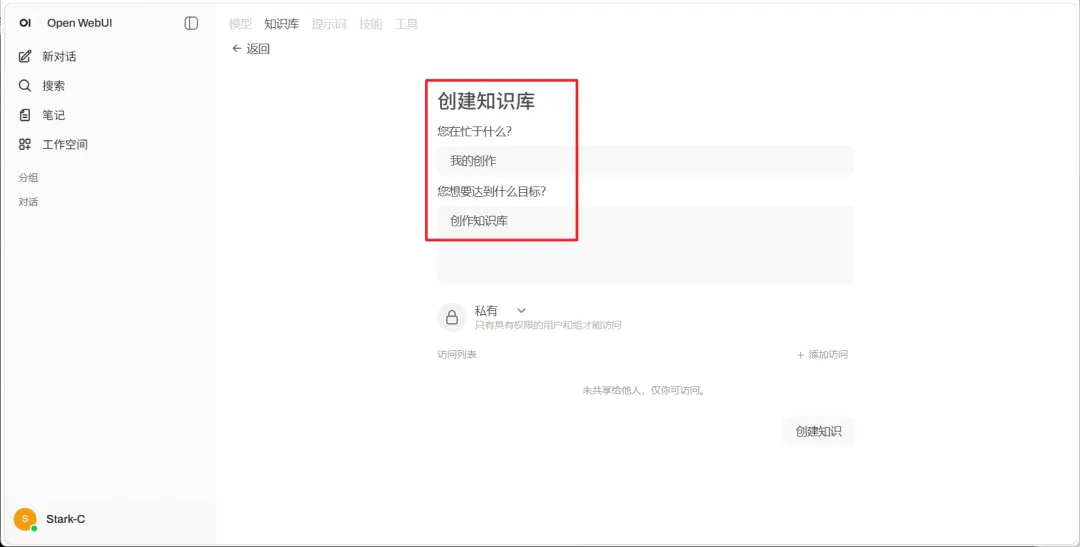

🔺接着在Open WebUI首页依次选择“工作空间--知识库--创建知识库”。

🔺先新建一个知识库的名称。

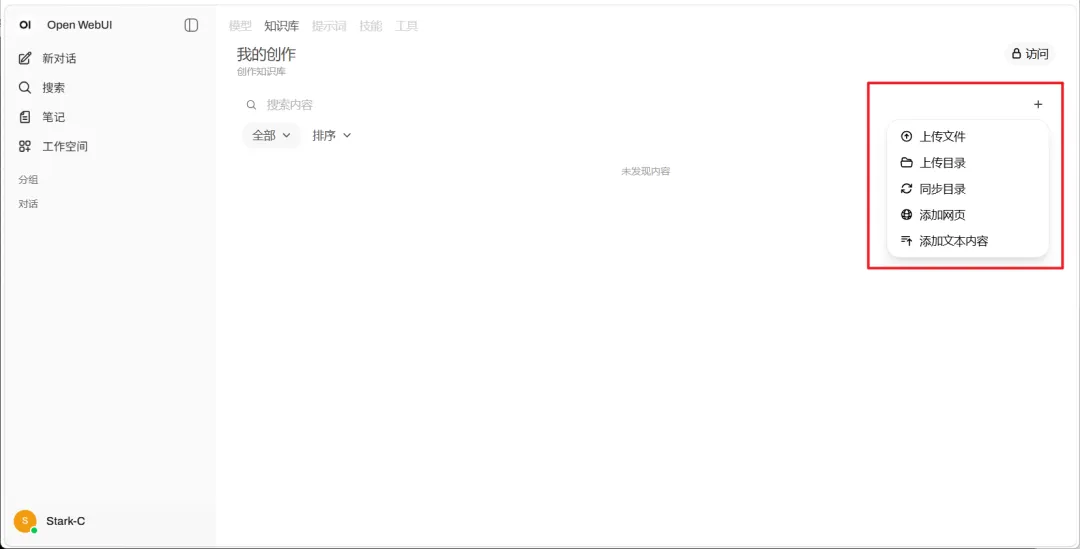

🔺然后就可以直接上传本地文档、文件目录、网页,或者文本内容到知识库这里了。它这里知识库支持的文档还是挺全面的,PDF、Word、Markdown、TXT 等基本上都可以直接扔过来。

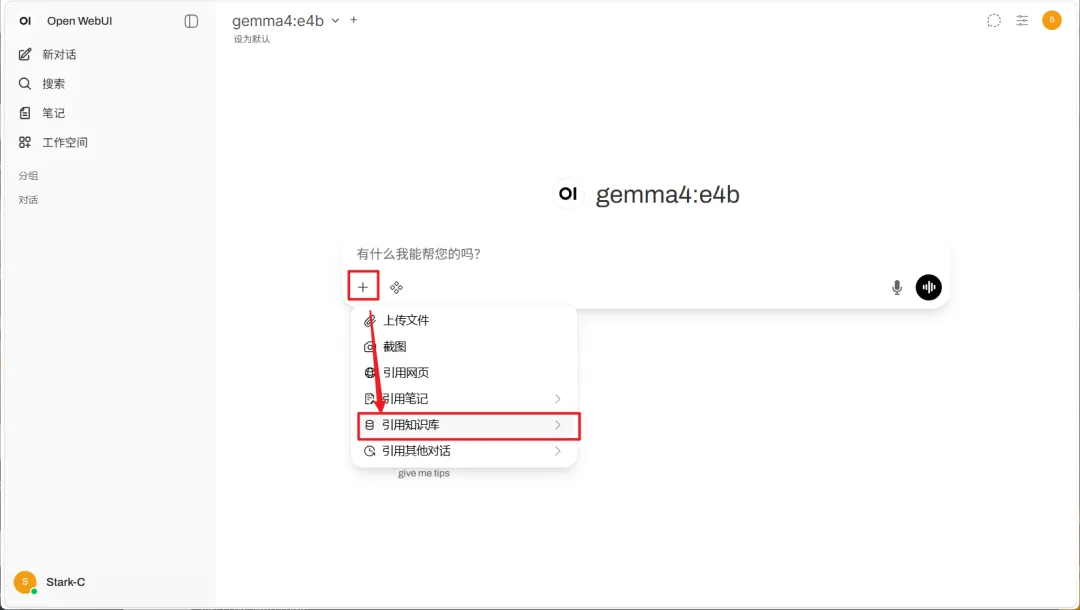

🔺之后任何时候,只要我们在Open WebUI这边的对话框对话的时候,选择“引用知识库”,它就会优先根据知识库的检索并做出回答。

🔺就比如说我就是将我的写作目录同步过来了,然后我问它“极空间NAS养虾对接本地大模型”的问题,它就会优先引用我前几天发布的那篇文章,然后结合AI,给出了我一个非常详细且客观的结果。

最后

总的来说,这套“完全离线的 AI 知识库助手”思路还是很简单的,其实就是:Ollama 负责模型、Open WebUI 负责界面、bge‑m3 负责知识库检索。

可能有些小伙伴会问,部署这么一套 AI 知识库有什么用?事实上只要你原因把自己的工作资料、学习笔记、聊天记录、收藏的网页都“喂”给它,它就成为了一个 真正属于你自己的私人AI 助手。

更关键的是:它不联网、不依赖云端,不用担心隐私泄露,还不用担心AI模型的 API Key 花钱,就能我我们的生活和工作带来极大的便利。比方说:

1,和我一样的创作者,可以把自己的写作目录同步到知识库,不仅可以有针对性的找到之前写过产品的参数和评测方案,甚至还能让它帮我总结文章结构,续写思路; 2,我也可以把我工作中的文档、会议纪要、合同方案等统统丢给它,不仅能让它总结重点,帮我找文件,我甚至还可以放心大胆的让它帮我分析数据,整理列表,毕竟这一切都是离线完成的; 3,甚至我可以把家里电器的说明书、保修单、购物记录都上传过去,某天不知道用法,或者要报修,直接一句话,它就能直接帮我把相关内容自动找出来,并告诉我该怎么做,这是不是比你自己翻说明书更高效?

好了,以上就是今天给大家分享的内容,我是爱分享的Stark-C,如果今天的内容对你有帮助请记得收藏,顺便点点关注,咱们下期再见!谢谢大家~

夜雨聆风

夜雨聆风