在过去二十余年中,Meta完成了一次极具代表性的基础设施跃迁:从一个服务几千名大学生的小型社交网站,发展为支撑全球超过34亿用户的超级平台。这一过程中,其基础设施不仅经历了规模扩展,更发生了底层逻辑的深刻变化。

最初,Meta的系统架构十分简单,运行在少量托管机房的服务器之上,依赖开源的LAMP技术栈(Linux、Apache、MySQL、PHP)。随着用户从哈佛扩展到更多高校,再到整个社会,平台逐渐引入“社交图谱”这一核心概念,将人与人之间的关系进行结构化连接。这一变化,使得数据处理从“单点访问”转向“全局关联”,也为后续的规模化挑战埋下伏笔。

随着用户规模的爆炸式增长,Meta开始在软件层进行大规模扩展。例如,通过部署更大规模的缓存系统(Memcache),以及构建如TAO这样的社交图谱系统,来支撑海量数据访问与实时交互。同时,信息流排序、图片与视频服务等新业务不断涌现,使系统复杂度持续攀升。

然而,仅依赖软件扩展已无法满足全球化发展的需求。Meta很快将重心转向物理基础设施建设,从湾区的小型托管机房,扩展至弗吉尼亚、俄勒冈、北卡罗来纳等地的数据中心,并逐步形成多区域部署架构。在这一阶段,两个关键问题随之出现:一是如何将全球用户高效接入数据中心,二是如何在多个数据中心之间保持一致的用户体验。

为此,Meta一方面大规模建设边缘节点(POP),将计算能力部署在靠近ISP的位置;另一方面构建高带宽骨干网络,实现数据中心之间的互联。这一时期,基础设施开始从“单点系统”演进为“全球分布式系统”。

从规模扩展到复杂性控制(2010–2020)

当基础设施扩展到全球级规模后,挑战不再只是“更大”,而是“更复杂”。

首先出现的是缓存一致性问题。由于用户被分布在不同数据中心,不同区域之间的数据同步存在延迟,导致用户体验不一致,例如能收到通知却无法看到内容。Meta通过构建统一的一致性API和缓存失效机制,逐步解决这一问题。

与此同时,数百万台服务器的运维也成为难题。为此,Meta开发了一系列核心系统,例如Twine(集群管理)、Tectonic(分布式存储)、ZippyDB(强一致性数据库)以及全球分片管理系统等。这些系统共同构成了其“基础设施操作系统”。

在可靠性方面,Meta逐步形成了“软件掩盖硬件故障”的理念。通过Kraken、Taiji、Maelstrom等系统,即使在硬件频繁故障的情况下,仍能对用户提供稳定服务。这种设计思想,成为互联网时代大规模数据中心的典型范式。

AI时代的转折:从CPU到GPU(2020)

真正改变基础设施逻辑的,是人工智能的兴起。

随着短视频和个性化推荐需求的爆发,传统基于社交关系的内容分发模式已无法满足用户期望。系统需要从“分析好友行为”转向“理解全平台内容”,这意味着计算规模呈数量级增长。

在这一背景下,GPU等AI加速器开始成为核心计算单元。与CPU相比,GPU更擅长处理向量与矩阵计算,能够支撑深度学习模型对海量数据进行训练与推理。Meta最早构建的AI集群规模约为4000个GPU,用于训练推荐模型。

这一阶段,数据中心开始发生根本变化:从通用计算平台,转向高性能计算(HPC)系统。基础设施需要围绕高带宽网络、低延迟通信以及大规模并行计算重新设计。

大模型驱动的“算力爆炸”(2022)

2022年,大型语言模型(LLM)的兴起,将这一趋势推向极致。

最初,AI训练任务通常使用数百个GPU,而随着LLM的发展,训练规模迅速扩展至数千个GPU同步运行。这种变化带来了前所未有的挑战:在一个高度同步的系统中,任何单点故障都可能导致整个训练任务中断。

与传统Web服务不同,AI训练无法简单通过“重试”解决问题。为此,Meta通过优化硬件可靠性、网络稳定性以及软件容错机制,将系统中断率大幅降低。

同时,模型架构的演进(如HSTU)也显著提升了训练与推理效率,使AI基础设施进入“系统级优化”阶段。

超大规模AI集群的诞生(2023)

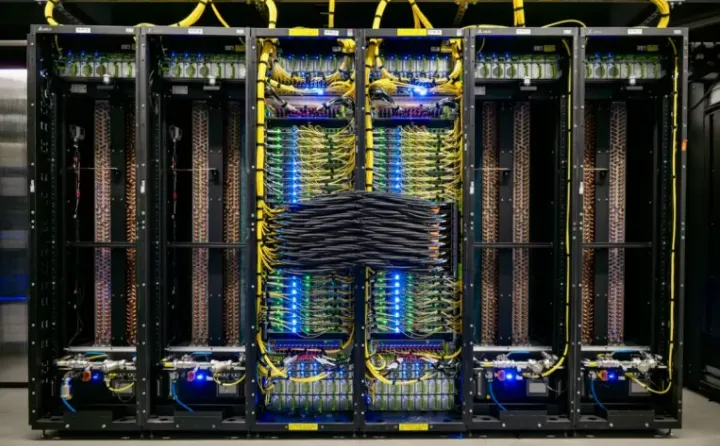

为了满足持续增长的算力需求,Meta在2023年构建了两个规模达24000个GPU的集群,并探索了不同网络架构(InfiniBand与RoCE)。

尽管META的两个 24k 集群( NVIDIA H100 Tensor Core GPUs) 2023 年已跻身全球最大集群之列,但他们的人工智能研究人员发现,投入预训练的计算能力越多,LLM 模型的质量和性能就越高。因此,Meta基础设施工程师肩负起将人工智能集群规模再扩展一个数量级的重任。

为了实现这一目标,他们做了一件在 Meta 历史上从未做过的事情:Meta 的数据中心过去通常以区域形式部署,每个区域包含五个或更多相同的建筑物,位于同一地点。Meta通过清空五个生产数据中心,得以在短短几个月内构建一个拥有 12.9 万个 H100 GPU 的 AI 集群!

与此同时,单机柜功率密度也急剧上升。例如,基于新一代GPU的机架功率已达到140kW以上,迫使数据中心从传统风冷转向液冷甚至空气辅助液冷(AALC)技术。

GB200 机架Catalina,将 AALC 系统连接到单个舱体中

AALC 系统的背面

硬件演进:从通用计算到系统协同设计

在AI时代,基础设施不再只是“部署硬件”,而是“协同设计系统”。

Meta一方面采用NVIDIA和AMD的GPU方案,另一方面也在推进自研芯片(如MTIA),以优化特定工作负载(如推荐系统推理)。

同时,新的技术挑战不断出现:

先进封装(2.5D/3D)成为提升性能的关键

高带宽内存(HBM)带来功耗与散热压力

硅光子技术成为突破网络瓶颈的重要方向

这些变化表明,AI基础设施已经进入“芯片—系统—数据中心”一体化设计阶段。

开放生态:规模化的关键支撑

面对硬件多样性带来的复杂性,Meta持续推动开放标准。

通过参与Open Compute Project(OCP),以及推广如PyTorch、Triton等开源软件,Meta试图在硬件与软件之间建立统一接口,从而降低开发与运维成本。

开放标准不仅提升了系统兼容性,也为行业协同创新提供了基础,这在AI时代尤为关键。

Meta 2025 年投入使用的硬件集合

下一阶段:迈向吉瓦级AI基础设施(2026+)

展望未来,Meta正在构建更大规模的AI基础设施。

其“Prometheus”项目目标是打造一个跨多个数据中心、总功率达1吉瓦的AI集群,而后续的“Hyperion”项目更将扩展至5吉瓦级别。这意味着数据中心将不再是单一园区,而是一个跨区域、跨形态的超级系统。

在这一过程中,基础设施的核心挑战将集中在:

电力与散热

芯片与封装

网络与互联

软件调度与跨域协同

回顾Meta的基础设施演进,可以看到一个清晰的路径:

从软件扩展,到全球分布式系统,再到AI驱动的超大规模计算平台。

如果说过去的数据中心是“支撑业务的基础设施”,那么在AI时代,它正在演变为决定技术边界的核心能力。

夜雨聆风

夜雨聆风