还在为AI对话API限流抓狂? 每月花大几百买Token却不够用? 数据上传第三方平台怕泄露?

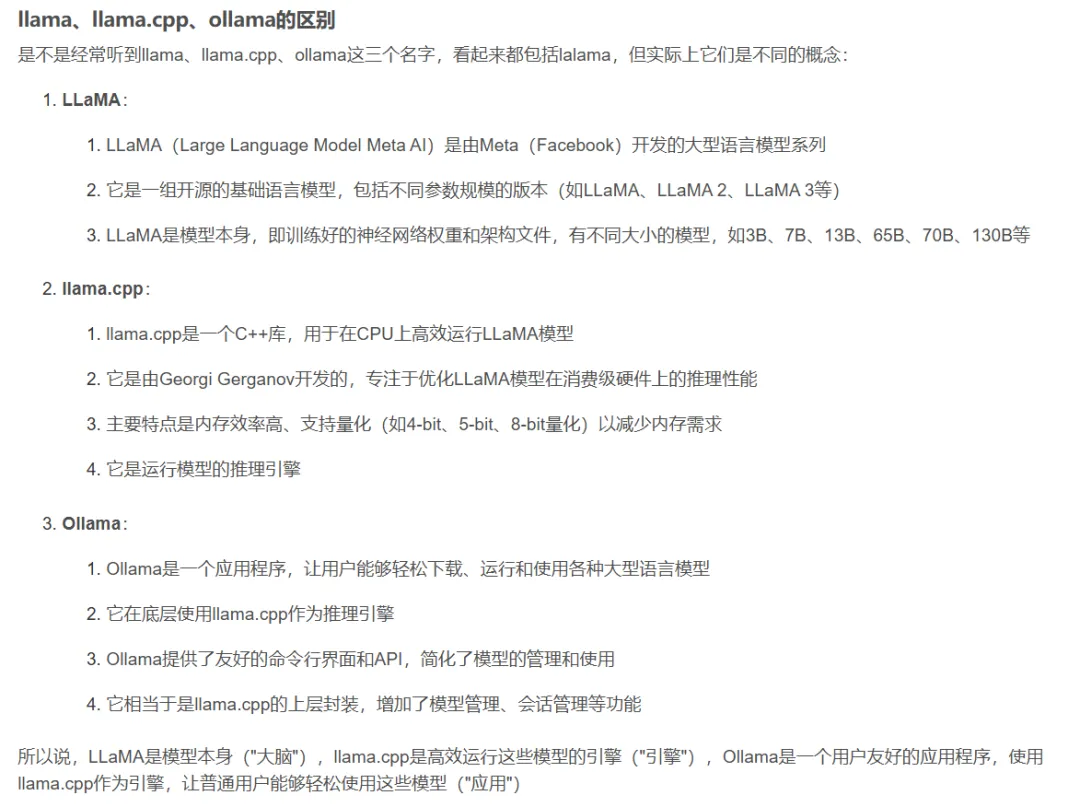

今天给所有AI爱好者、运维党、新手小白安利一款开源神器——OpenClaw(小龙虾)! 搭配llama.cpp搭建本地模型,彻底实现Token自由、本地运行、数据自主,全程免费开源,低配电脑也能轻松上手!

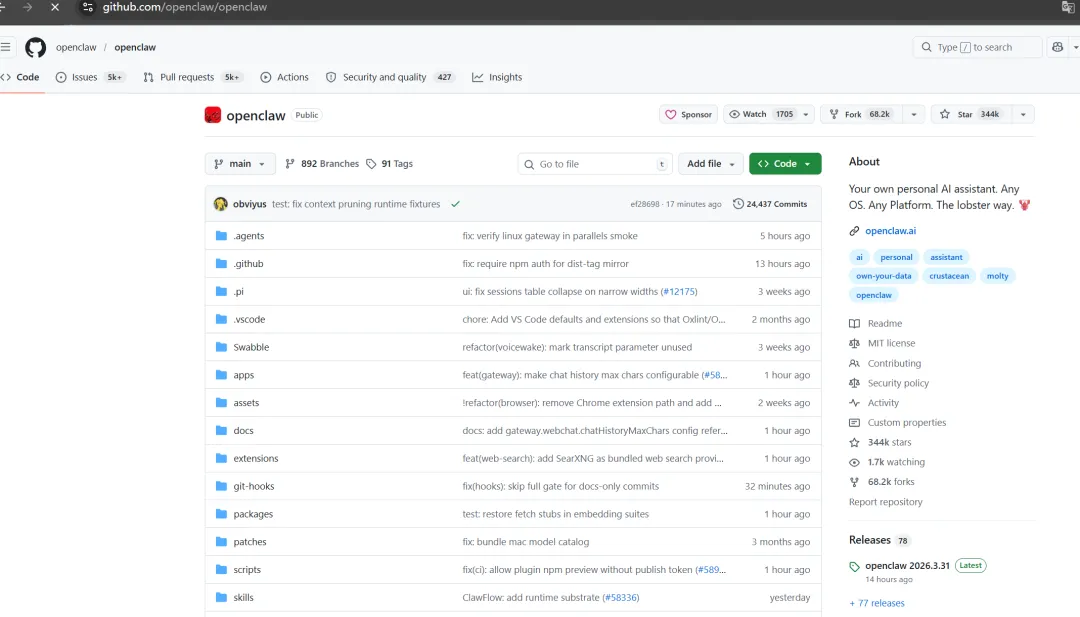

🦞 先搞懂:OpenClaw到底是什么?

OpenClaw是开发者社区维护的开源AI助手框架,外号“小龙虾”,堪称本地AI部署的“万能工具箱”。

它最核心的优势,直接戳中所有AI用户的痛点:

✅ Token自由:本地运行模型,无次数限制、无费用消耗,用多少都够!

✅ 全平台接入:一键对接微信、飞书、钉钉,办公聊天全搞定;

✅ 零成本开源:完全免费无隐藏收费,商用/个人使用都合规;

✅ 轻量易部署:无需顶级硬件,4GB内存就能跑基础模型;

✅ 数据自主掌控:所有对话、数据本地存储,绝不泄露给第三方!

不管是日常对话、办公辅助还是学习练手,用OpenClaw搭建的本地模型,体验丝毫不输付费API,还能省下大笔成本,香到离谱!

🛠️ 准备工作!3分钟搞定部署前提

部署前只需确认两件事,新手也能零门槛:

1. 电脑配置要求(最低门槛,老电脑也能冲)

Python 3.8及以上版本(必须安装); 内存≥4GB(推荐8GB,跑7B模型更丝滑); 磁盘剩余空间≥10GB(存项目+模型足够); 无需顶级显卡,CPU也能运行(想提速可加独显)。

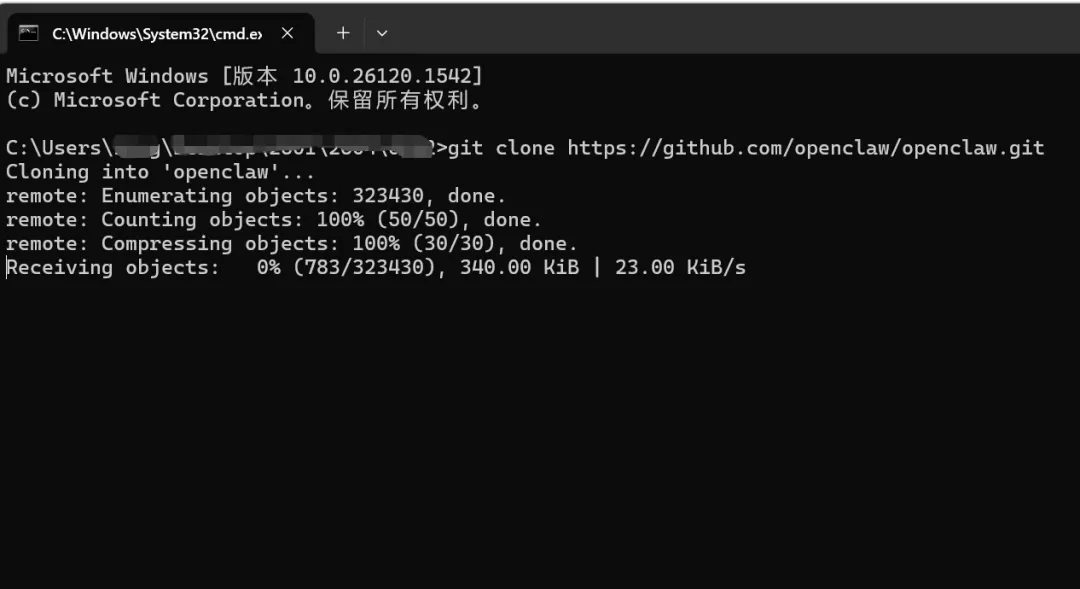

2. 项目获取方式

Git克隆(技术党专属) 打开终端,执行以下命令:

git clone https://github.com/openclaw/openclaw.gitcd openclaw

🚀 7步部署!从0到1跑通OpenClaw

全程跟着步骤来,哪怕是纯新手,10分钟也能搞定,每一步都有明确指引!

步骤1:激活虚拟环境(隔离依赖,避免冲突)

先进入解压/克隆的项目文件夹,再执行对应命令:

# Linux/Mac系统python3 -m venv venvsource venv/bin/activate# Windows系统(cmd终端)python -m venv venvvenv\Scripts\activate

终端出现(venv)前缀,就说明虚拟环境激活成功啦!

步骤2:安装项目依赖

一键安装所需插件,无需手动找包:

pip install -r requirements.txt等待安装完成即可,过程中如果提示升级pip,按提示操作就行~

步骤3:配置Token(基础设置,按需修改)

在项目根目录新建一个配置文件,自定义Token参数(本地模型可随意设置):

# 新建 .env 文件,写入以下内容OPENCLAW_TOKEN=your_custom_token_here直接替换your_custom_token_here为自己想要的字符就行,超简单!

步骤4:启动本地服务

核心一步,执行启动命令:

python3 main.py看到以下日志,就说明服务启动成功啦!🎉

✅ OpenClaw started🔗 Running on http://localhost:8080步骤5:访问可视化界面

打开浏览器,输入地址 http://localhost:8080,进入OpenClaw的管理界面:

左侧:对话测试窗口,直接和本地AI聊天; 中间:配置管理面板,可修改Token、平台接入设置; 右侧:日志查看+模型切换,随时调整运行状态。

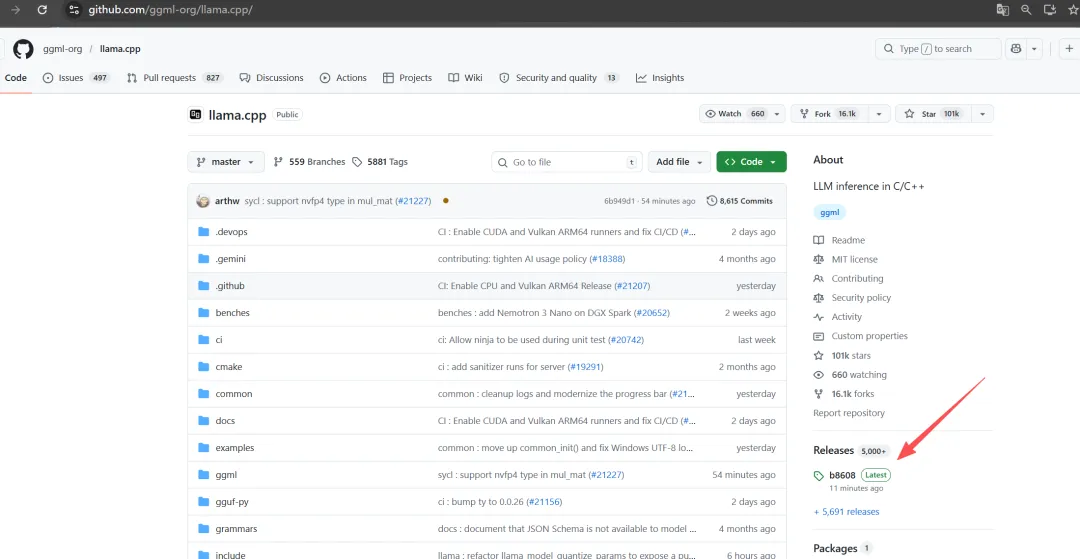

步骤6:集成llama.cpp,配置本地模型

这是实现“Token自由”的关键!

下载llama.cpp:从官方仓库克隆或下载压缩包;

模型存放:将下载好的本地模型放入项目 models文件夹;界面切换:在OpenClaw界面的“模型管理”中,选择对应的本地模型。

步骤7:测试对话!验证效果

在对话窗口输入“你好”,如果AI正常回复“你好!有什么可以帮你的?”,就说明部署完全成功啦! 还可以测试:长文本对话、指令执行、多轮问答,本地模型响应速度完全不输API!

模型推荐!不同配置选对应模型

根据自己的电脑内存,选对模型才能跑起来不卡顿,可以借鉴下面的:

| Gemma 3 270M | 4GB - 8GB | Hugging Face https://huggingface.co/codellama | ||

| CodeQwen 1.5-7B | 8GB - 16GB | Ollamaollama run codeqwen:7b-chatHugging Face: Qwen/CodeQwen1.5-7B-Chat | ||

| CodeLlama-7B | 8GB - 16GB | Ollamaollama run codellama:7b-codeHugging Face: codellama/CodeLlama-7b-hf | ||

| DeepSeek-Coder V2 | 16GB - 32GB+ | Hugging Facedeepseek-ai/DeepSeek-Coder-V2Ollama 支持 | ||

| Devstral-Small-2 | 32GB+ | Ollamaollama run SimonPu/Devstral-Small |

小技巧:内存不够的小伙伴,优先选7B模型,体验流畅不卡顿!

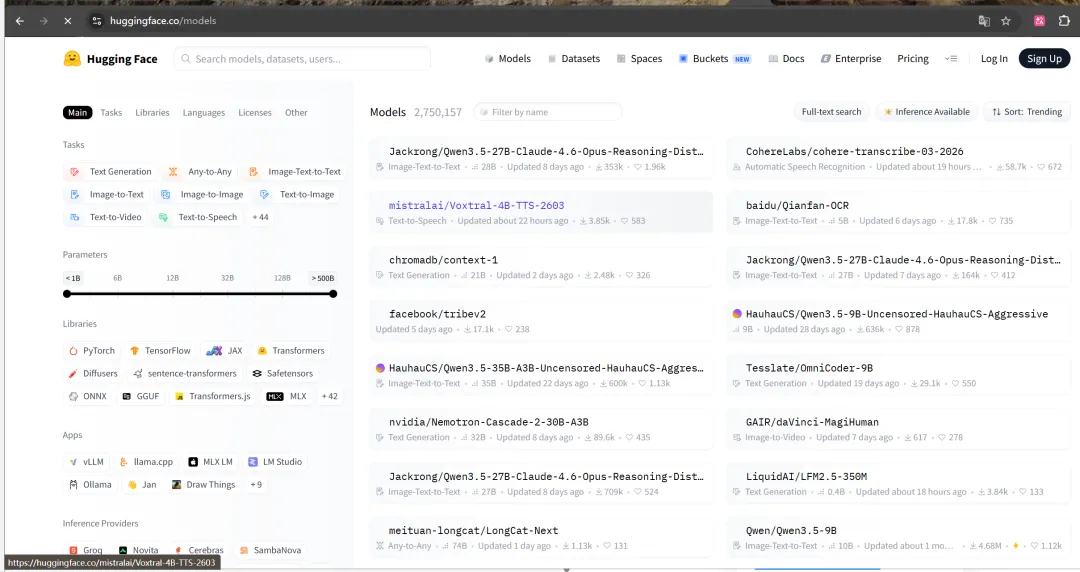

如果想去网页下载,去这里:

https://huggingface.co/models

💡 常见问题!踩坑即解

部署过程中遇到问题?对照以下解决方案,快速解决!

Q1:本地模型运行太慢?

解决:

选用量化模型(降低资源占用,提升速度); 减少上下文长度(比如限制为2048token); 加装NVIDIA显卡,安装CUDA加速包,性能直接翻倍!

Q2:启动服务失败?

解决:

检查Python版本是否≥3.8; 确认依赖安装完整,重新执行 pip install -r requirements.txt;查看日志报错,多数是端口被占用,换用 8081端口即可。

🎉 你能获得什么?

成功跑通OpenClaw后,你将拥有:

彻底的Token自由:再也不用为API付费、不用怕限流;

本地数据安全:对话、文件全存本地,隐私不泄露;

全场景AI助手:对接微信、飞书,办公、聊天、查资料一键搞定;

零成本持续使用:开源免费,永久不收费,随时更新功能。

对于运维人员、AI爱好者、学生党来说,这绝对是2026年最实用的本地AI工具之一!

我建了几个 AI 交流群,欢迎大家进群一起交流各类 AI 工具的使用技巧、实操经验与心得。

在公众号后台私信回复:AI 群,我会邀请你入群。群内严禁发布广告及违规违法言论,违规者将直接移出群聊。

夜雨聆风

夜雨聆风