当前时间: 1970-01-01 08:00:00

分类:办公文件

评论(0)

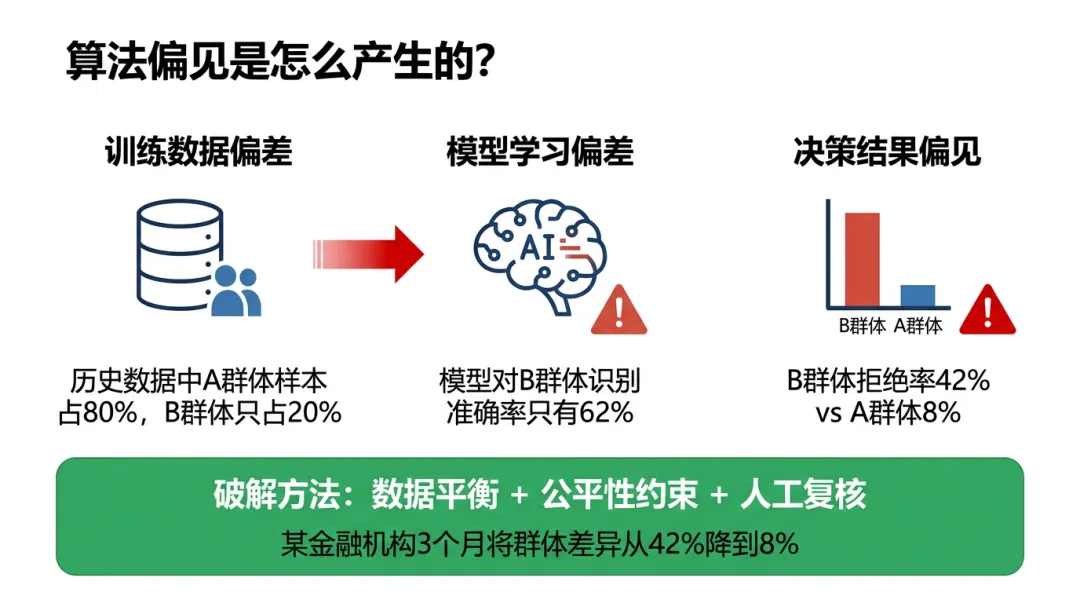

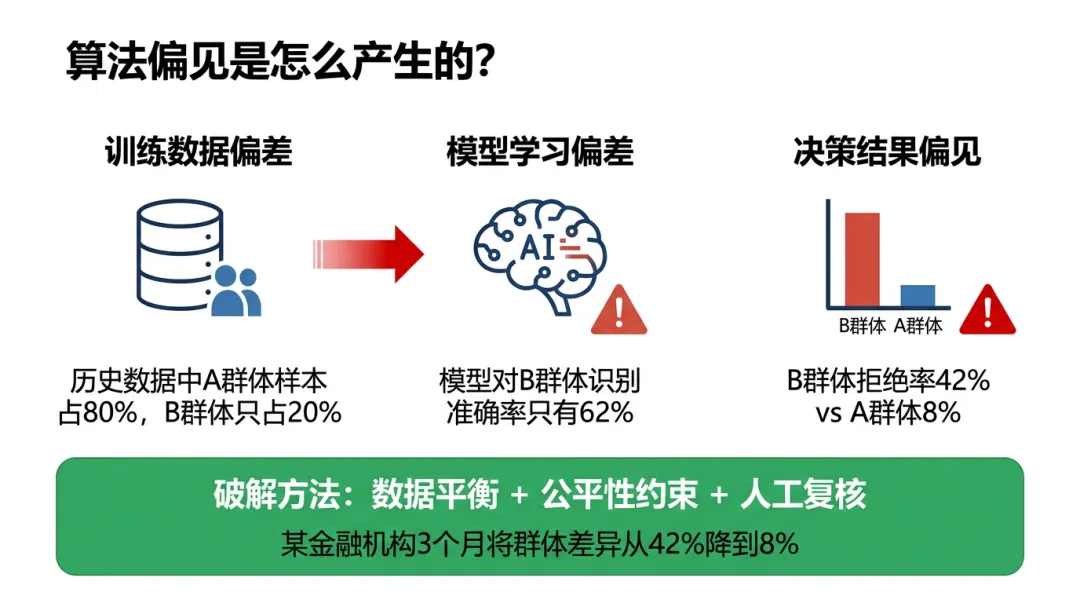

AI转型的5道防线:数据安全与算法风控指南2026年初,某金融企业(资产规模超3000亿元)花20个月完成了智能风控系统建设。技术选型严谨、组织变革到位、一线采纳率达到90%。看起来一切完美。AI审批模型拒绝了某优质客户群体的贷款申请,事后复盘发现:训练数据中这个群体的历史样本太少,算法产生了"统计歧视"。更严重的是,这个偏见模型连续运行了6周,累计拒绝了340笔申请,直接导致公司流失了约2800万利息收入。根据IBM Security 2025年全球AI安全报告,73%的企业在AI上线后12个月内遭遇过至少一次重大风险事件(数据泄露、算法偏见、合规违规、系统被攻击)。而其中,只有31%的企业有完整的AI风险防控体系。AI转型不是上线就结束,是风险管理的开始。 这是我在跟踪42个企业AI项目后,最深刻的第二个结论(第一个是"AI转型是组织变革不是技术项目")。今天我要拆解的是:AI转型必须筑牢的5道风险防线。任何一道失守,都可能让前期投入归零。AI系统的核心燃料是数据,但数据也是最大的风险源。某连锁零售企业(年营收约50亿元)上线智能推荐系统。系统需要接入客户购买记录、浏览行为、会员信息等数据。为了方便算法训练,IT部门把客户数据同步到了云端测试环境。6个月后,一次第三方安全审计发现:测试环境的数据库没有加密,访问日志显示有3个外部IP在过去4个月内多次访问客户数据。万幸没有造成实际泄露。但企业立即启动了应急响应:删除测试环境所有生产数据、重新部署加密数据库、对所有第三方访问做权限回收和审计。直接损失:安全整改费用约120万,项目延期2个月。• 数据分级分类:哪些数据绝对不能出域(客户身份证、银行卡、生物识别)?哪些可以脱敏后使用(购买记录、浏览行为)?哪些可以公开(产品目录、价格)?上线前必须完成数据资产盘点。• 访问权限最小化:谁需要什么数据,只给什么。算法工程师不需要看到真实客户姓名,用ID替代就可以。第三方供应商只需要脱敏后的训练数据,不需要原始数据。• 全程审计留痕:谁在什么时间、访问了什么数据、做了什么操作,必须全程记录。不是等出事才查,是日常就要监控异常访问模式。数据安全不是IT部门的事,是CEO必须亲自盯的底线。 一次数据泄露的代价,可能超过整个AI项目的投入。AI不会"故意"歧视,但算法会"无意中"产生偏见。开篇那家金融企业的事还没完。他们发现问题后,做了3件事来修复算法偏见:第一,重新平衡训练数据——对样本少的客户群体,做过采样(增加权重)或合成数据(基于真实数据特征生成模拟样本),确保算法不会因为"没见过"就"一刀切拒绝"。第二,增加公平性约束——在模型目标函数中加入"群体公平性"惩罚项,如果模型对某个群体的拒绝率显著高于其他群体,自动触发预警。第三,人工复核机制——AI拒绝的申请,如果属于"历史上通过率较高的客户群体",自动转人工复核。不是不信任AI,是给AI加一层"安全网"。3个月后,算法偏见基本消除,各客户群体的通过率差异从42%降到8%。• 群体公平性:不同性别、年龄、地区、行业的通过率/推荐率是否有显著差异?差异是否合理?• 历史偏差校正:训练数据本身是否包含历史偏见?(比如过去某些群体就没有被公平对待过)• 持续监控:算法上线后,每月跑一次公平性检测报告,偏差超过阈值自动预警。有意思的是,很多企业在算法公平性上犯的错误,不是因为"技术不够先进",而是因为"想得太简单"——以为算法天然客观,实际上算法只是放大了训练数据里的偏见。当前AI监管的3个核心要求(基于2025年最新政策趋势):金融、医疗、司法等高风险行业,监管要求AI决策必须"可解释"。不是"算法说拒绝就拒绝",而是必须能说明"为什么拒绝"。某银行智能风控系统上线前,银保监会要求提供算法决策逻辑说明。银行的技术团队花了2个月,把深度学习模型的决策路径转化为"可读规则"(例如:"拒绝原因:近3个月逾期次数>2次+负债收入比>60%+无稳定社保记录")。《个人信息保护法》实施后,收集、使用客户数据必须获得明确授权。AI训练用客户数据,不能"默认同意",必须"单独告知+单独同意"。某互联网企业在更新隐私政策时,把"使用您的数据改进AI服务"藏在1500字的条款里。被用户投诉后,监管部门认定这不属于"明确同意",罚款50万并要求整改。监管要求:AI做出的关键决策(贷款审批、医疗诊断、招聘筛选),必须保存完整的决策记录,包括输入数据、模型版本、决策结果,保存期限不少于3年。合规不是"上线前突击检查",是"从第一天就嵌入流程"。 等监管找上门再改,代价就大了。攻击者在输入数据中加入人眼看不到的微小扰动,就能让AI做出完全错误的判断。某自动驾驶公司的测试车辆,在路牌上贴了几张特制的贴纸,系统就把"限速60"识别成了"限速120"。虽然只是实验室测试,但足以说明风险。在工业场景中,如果竞争对手知道你的AI质检模型用的是什么算法,理论上可以制造"能骗过AI的次品"。攻击者在训练数据中注入"有毒样本",让模型在特定情况下做出错误判断。某电商平台的推荐系统,被恶意用户通过大量刷单行为"训练"——当某个关键词出现时,优先推荐特定商品。3个月后才被发现,期间该关键词的推荐转化率下降了60%。攻击者通过大量查询你的AI系统,反推出你的模型参数和训练数据。某AI创业公司发现,有竞争对手在系统上做了上万次查询,最终复刻了他们的核心推荐算法。虽然不是直接"偷代码",但通过"问"就能"问"出一个模型。• 对抗训练:在训练阶段就加入对抗样本,让模型"见过世面",提高鲁棒性。• 数据质量监控:训练数据上线前做异常检测,发现"离群样本"立即隔离审查。• 访问频率限制:对API调用做频率限制和异常模式检测,防止被"暴力查询"反推模型。AI系统上线不是结束,只是开始。没有持续监控,风险会在不知不觉中积累。某制造企业(年产值约60亿元)上线AI质检系统。上线时准确率99.2%,一切正常。但6个月后,质检主管发现漏检率开始上升。技术团队排查后发现:生产线换了新的原材料供应商,产品表面纹理和之前不一样了。模型没有"见过"这种新材料,所以判断准确率下降。问题不算严重,因为发现及时。但企业做了一件事:建立了"模型性能监控面板",实时跟踪准确率、漏检率、误报率等指标,一旦偏离基准值超过5%,自动触发告警。模型会"老化",因为现实世界在变。 不监控的AI系统,就像不保养的汽车——迟早出问题。• 性能漂移:模型的准确率、召回率、F1分数是否在下降?下降速度有多快?• 数据漂移:输入数据的分布是否发生了变化?(比如客户群体变了、产品结构变了、季节因素)• 业务影响:AI决策对业务指标的影响是否如预期?(比如推荐转化率、审批通过率、客户满意度)• 高风险场景(金融审批、医疗诊断、自动驾驶):实时监控,异常立即告警• 中风险场景(质检、客服、排产):每日检查,每周汇总• 低风险场景(文档摘要、知识问答):每周检查,月度汇总☐ 我的数据已经做了分级分类吗?(绝密/敏感/公开)☐ 访问权限是否做到"最小化"?(谁需要什么就给什么)☐ 所有数据访问是否有审计日志?(能追溯谁在什么时间做了什么)☐ 我的算法是否做过公平性检测?(不同群体的通过率/推荐率差异)☐ 训练数据是否包含历史偏见?是否需要做偏差校正?☐ 是否建立了持续监控机制?(每月跑一次公平性报告)☐ 我的AI决策是否"可解释"?能否向监管说明"为什么做出这个决策"?☐ 客户数据使用是否获得"明确授权"?(不是默认同意)☐ 关键决策记录是否保存完整?(输入数据+模型版本+决策结果,保存≥3年)☐ 训练数据上线前是否做异常检测?(防止数据投毒)☐ API调用是否有频率限制和异常检测?(防止模型窃取)☐ 我是否建立了模型性能监控面板?(准确率、漏检率、误报率)☐ 是否设置了漂移告警阈值?(偏离基准值超过5%自动告警)☐ 监控频率是否与风险等级匹配?(高风险实时、中风险每日、低风险每周)如果他们在系统上线前,就筑牢了5道防线(数据分级分类、算法公平性检测、合规审查、对抗训练、性能监控),算法偏见事件可能根本不会发生——或者至少在第一天就被发现和修复。AI转型不是上线就结束,是风险管理的开始。5道防线,任何一道失守,都可能让18个月的投入归零。CEO们,请把风控预算至少占项目总投入的15-20%。最后留一个思考题给你的CRO和CTO:我们的AI系统中,有多少风险是"已经知道的"?又有多少是"还不知道自己不知道的"?后者才是最危险的。

基本

文件

流程

错误

SQL

调试

- 请求信息 : 2026-04-20 04:15:02 HTTP/1.1 GET : https://www.yeyulingfeng.com/a/544803.html

- 运行时间 : 0.203319s [ 吞吐率:4.92req/s ] 内存消耗:4,726.42kb 文件加载:145

- 缓存信息 : 0 reads,0 writes

- 会话信息 : SESSION_ID=75c9e6cf39a04203ff1de0e8dba6fd8a

- CONNECT:[ UseTime:0.000628s ] mysql:host=127.0.0.1;port=3306;dbname=wenku;charset=utf8mb4

- SHOW FULL COLUMNS FROM `fenlei` [ RunTime:0.000748s ]

- SELECT * FROM `fenlei` WHERE `fid` = 0 [ RunTime:0.000364s ]

- SELECT * FROM `fenlei` WHERE `fid` = 63 [ RunTime:0.000329s ]

- SHOW FULL COLUMNS FROM `set` [ RunTime:0.000637s ]

- SELECT * FROM `set` [ RunTime:0.000254s ]

- SHOW FULL COLUMNS FROM `article` [ RunTime:0.000576s ]

- SELECT * FROM `article` WHERE `id` = 544803 LIMIT 1 [ RunTime:0.001171s ]

- UPDATE `article` SET `lasttime` = 1776629702 WHERE `id` = 544803 [ RunTime:0.008401s ]

- SELECT * FROM `fenlei` WHERE `id` = 64 LIMIT 1 [ RunTime:0.000369s ]

- SELECT * FROM `article` WHERE `id` < 544803 ORDER BY `id` DESC LIMIT 1 [ RunTime:0.000622s ]

- SELECT * FROM `article` WHERE `id` > 544803 ORDER BY `id` ASC LIMIT 1 [ RunTime:0.000425s ]

- SELECT * FROM `article` WHERE `id` < 544803 ORDER BY `id` DESC LIMIT 10 [ RunTime:0.000744s ]

- SELECT * FROM `article` WHERE `id` < 544803 ORDER BY `id` DESC LIMIT 10,10 [ RunTime:0.001178s ]

- SELECT * FROM `article` WHERE `id` < 544803 ORDER BY `id` DESC LIMIT 20,10 [ RunTime:0.000918s ]

0.205070s