一个人干活叫助手,多个Agent协作才叫系统

— · · · · · —

说实话,刚用OpenCLAW那会儿,我就觉得它已经很厉害了。

一个Agent,能聊天、能查资料、能写东西,比我强多了。但后来我发现一件事——不管这个Agent多聪明,它一次只能干一件事。就像你请了个超级全能的助理,但他只有一双手,写报告的时候就不能同时帮你回邮件。

直到有一天,我偶然看到有人在聊"多Agent协作"这个东西,我的天,感觉像是打开了新世界的大门。

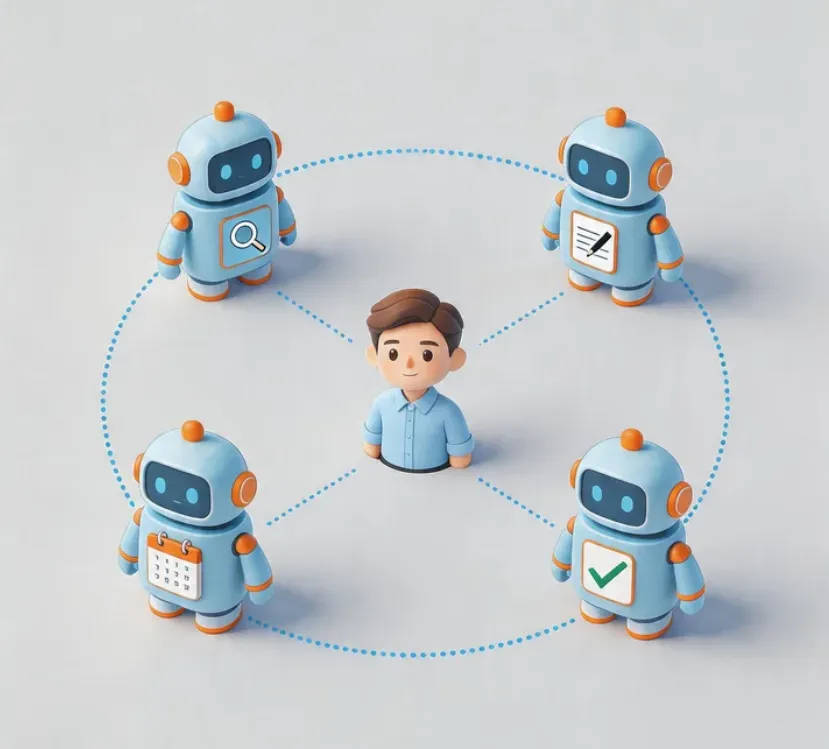

什么意思呢?就是——你不再是只有一个AI助手了,你可以有一整个团队。有的负责查资料,有的负责写文案,有的负责检查质量,还有一个当总指挥协调所有人。这不就是我梦里的样子吗!

— · · · · · —

▎ 第一章:什么是多Agent架构

◆ 类比:你是老板,下面有多个专业员工

我用最简单的方式解释一下。想象一下你开了一家小公司(虽然现在还只是想象哈哈):

单Agent模式 = 你雇了一个超级员工,啥都会,但一次只能做一件事 多Agent模式 = 你雇了一支团队,每个人专精一项,可以同时开工

在OpenCLAW的多Agent架构里,大概是这样分工的:

• **主控Agent(Orchestrator)**——相当于你的项目经理,负责接收你的任务、拆解成小步骤、分派给下面的专员、最后把结果汇总给你

• **子Agent**——各司其职的专家角色。比如Researcher专门搜资料、Writer专门写内容、Reviewer专门挑毛病、Coder专门写代码

• **通信机制**——Agent之间能互相传递信息,不是各干各的,而是像真正的团队合作一样

◆ 适用场景 vs 单Agent场景

场景类型 | 适合单Agent | 适合多Agent |

日常闲聊/问答 | ✅ 完全够用 | ❌ 杀鸡用牛刀 |

写一篇短文 | ✅ 没问题 | ❌ 没必要 |

批量生成多篇内容 | ⚠️ 能做但慢 | ✅ 并行处理快很多 |

复杂调研报告 | ⚠️ 容易遗漏 | ✅ 分工更全面 |

代码开发+审查 | ❌ 自己审查自己? | ✅ 独立审查更靠谱 |

定时自动化任务流 | ❌ 不支持 | ✅ 天然优势 |

💡 小白怎么选:如果你刚开始玩OpenCLAW,先用单Agent熟悉个一两周。等你开始觉得"这个Agent怎么一次只能干一件事"的时候,就是该上多Agent的时候了。别急着一步到位,慢慢来。

— · · · · · —

▎ 第二章:典型协作模式拆解

好了,理论说完了(其实也没说多少),直接看实战吧。下面这三种是我目前见过最常见也最好理解的协作模式,每种我都尽量用人话讲清楚。

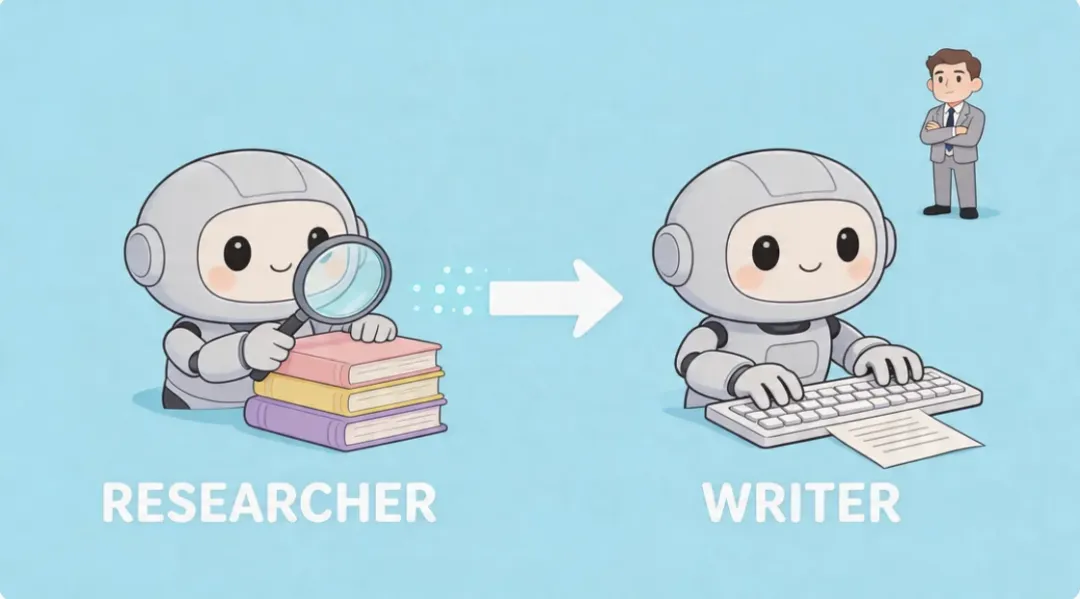

◆ 模式A:Researcher + Writer —— 自动写报告

这是我最早尝试、也是觉得最实用的组合。流程大概是这样的:

1. 你下达指令:"帮我写一篇关于XX行业的研究报告" 2. 主控Agent接收任务,判断这需要两步:先调研,再写作 3. Researcher Agent出发去搜索资料、整理要点 4. Writer Agent拿到Researcher的成果,开始撰写 5. 如果Writer觉得某块信息不够,可以请求Researcher补充 6. 最终报告汇总给你

我第一次跑这个流程的时候,看着终端里一行行日志刷过去,那种感觉怎么说呢……就像看着自己的小团队在干活,你坐在老板椅上喝咖啡(并没有咖啡,是白开水)。

实际效果怎么样?说实话,比我自己让单个Agent从零写到完要好不少。因为搜资料和写东西用的是不同的"脑子",不会出现"写到一半发现自己编不下去了"的尴尬情况。

◆ 模式B:Reviewer + Coder —— 代码审查流水线

这个模式我虽然自己写代码不多,但我一个程序员朋友给我演示过,确实香。

逻辑很简单:Coder Agent写完代码后,不直接给你,而是先交给Reviewer Agent过一遍。Reviewer会检查代码质量、找bug、看有没有安全问题,然后给出修改建议。

你:"帮我写一个Python爬虫" ├─ Coder Agent:写好爬虫代码 └─ Reviewer Agent:检查后发现 • 缺少异常处理 → 建议 try-except 包裹 • 请求间隔太短 → 建议加 random delay • 没有User-Agent → 可能被反爬拦截 最终输出:带审查注释的改进版代码

朋友跟我说,最爽的地方在于——Reviewer不会"给面子"。它真的会挑毛病,而且有些问题你自己 review 一遍未必能发现。相当于免费请了个资深码农帮你 code review,这波不亏。

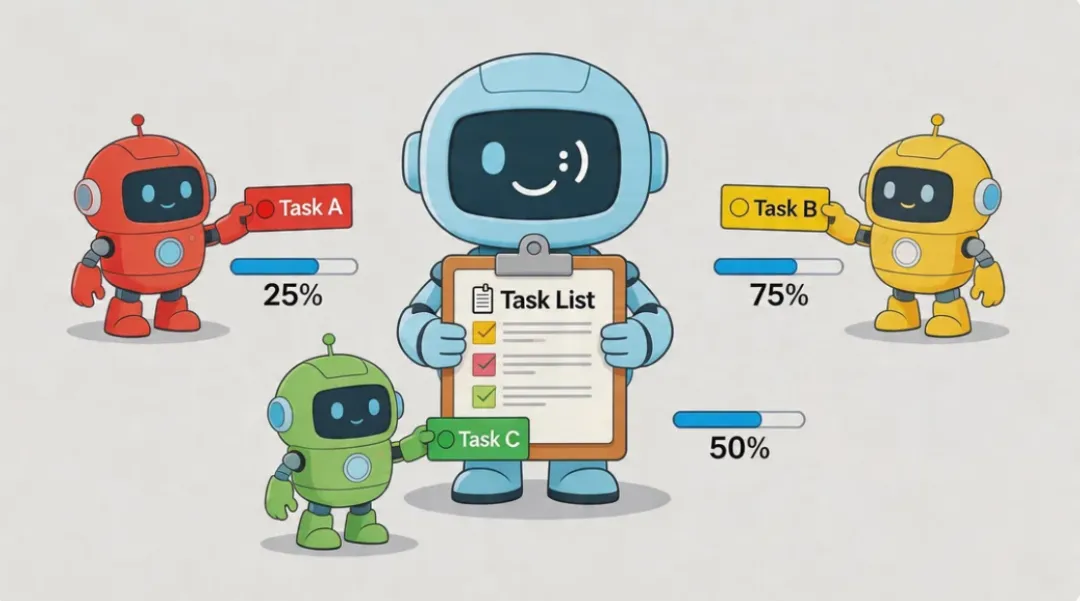

◆ 模式C:Scheduler + Executor —— 任务自动分派

这个模式适合那种"有一堆杂活要干"的场景。Scheduler负责把大任务拆成小任务,然后分派给Executor并行处理。

举个例子,假设你要做一周的内容规划:

你:"帮我规划本周的7篇公众号文章选题和大纲" ├─ Scheduler:拆分成7个独立子任务 └─ Executor x3(三个并行工作者): Executor-1 → 周一、周二选题+大纲 Executor-2 → 周三、周四选题+大纲 Executor-3 → 周五、六、日选题+大纲 结果:串行可能需要20分钟,并行只要6-7分钟

💡 关于并行的小坑:并行不代表无限快。API有速率限制,开太多Agent同时跑反而会被限流。一般3-5个并行是比较稳的选择,具体看你用的API套餐。

— · · · · · —

▎ 第三章:工作流编排工具对比

说到这里你可能会问:这些Agent之间的协作是用什么来管理的?总不能靠人工传纸条吧?哈哈当然不是。

目前主流的编排工具主要有这三个方向,我来帮你捋一捋。

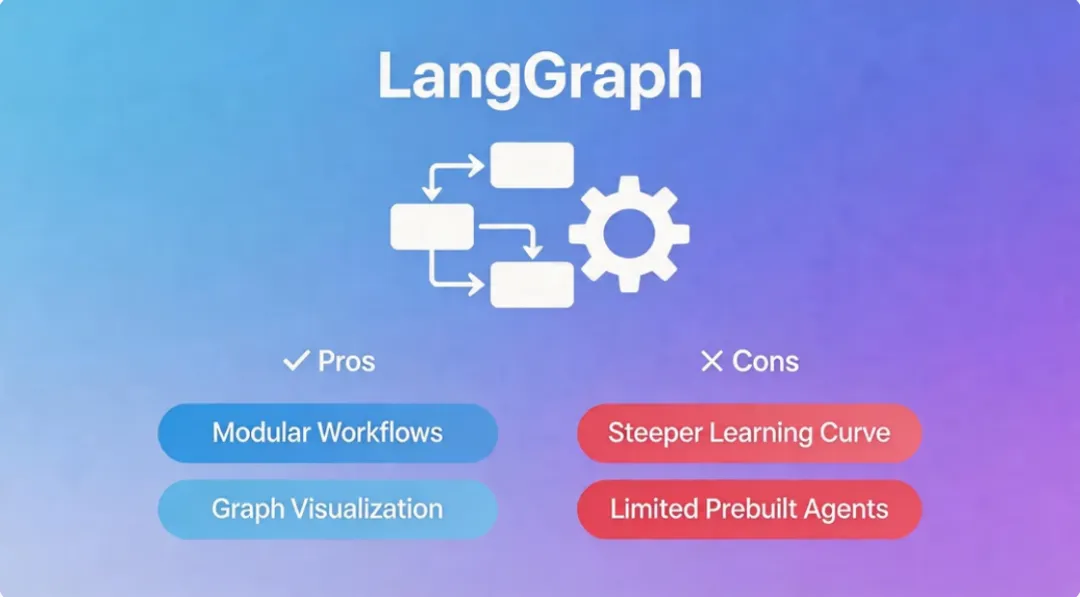

◆ LangGraph —— 适合想要精细控制的人

LangGraph是LangChain团队出的,专门用来构建有状态的多步AI应用。如果你想把Agent之间的流转画成一张"流程图",每个节点是一个Agent或工具,每条边是数据流向,那LangGraph就是这个思路的实现。

• **优点**:可视化强,流程可控,支持循环/条件分支/人工介入

• **缺点**:学习曲线陡峭,文档偏英文,对新手不太友好

• **适合**:你有编程基础,想深度定制工作流的人

◆ CrewAI —— 开箱即用的Agent团队框架

CrewAI是我个人比较推荐新手尝试的。它的理念特别直观——你就当在组建一个"团队(Crew)",每个成员有自己的角色(Role)、目标(Goal)、背景故事(Backstory)。

# CrewAI 的配置大概长这样(概念示例): researcher = Agent( role="资料研究员", goal="搜集和整理相关资料", backstory="你是一个经验丰富的研究员..." ) writer = Agent( role="内容创作者", goal="根据资料撰写高质量文档", ...) crew = Crew(agents=[researcher, writer], tasks=[task1, task2])

• **优点**:上手快,代码直观,社区活跃,中文资料越来越多

• **缺点**:复杂场景下定制性不如LangGraph

• **适合**:想快速搭建多Agent协作的大部分人(包括我)

◆ 自定义脚本 —— 简单场景的最灵活选择

如果你的协作模式很固定(比如永远是 Researcher→Writer 两步走),其实不需要上那些重型框架。用简单的Python脚本就能搞定:主程序调用第一个Agent拿结果,再喂给第二个Agent。几十行代码的事。

• **优点**:完全掌控,无依赖,想怎么改就怎么改

• **缺点**:复杂了之后代码会变乱,没有现成的调度/重试/监控能力

• **适合**:固定简单流程、或者你想从头理解原理的人

维度 | LangGraph | CrewAI | 自定义脚本 |

学习难度 | ⚠️ 中等偏高 | ✅ 较低 | ✅ 看你基础 |

上手速度 | 慢 | 快 | 最快(简单场景) |

灵活性 | ✅ 很高 | ✅ 高 | ✅ 最高 |

可维护性 | ✅ 好 | ✅ 好 | ⚠️ 复杂后差 |

社区生态 | ✅ 成熟 | ✅ 快速增长 | ❌ 靠自己 |

适合阶段 | 进阶玩家 | 新手到中级 | 入门尝鲜 |

— · · · · · —

▎ 第四章:实战 —— 搭建一个"每日资讯摘要"自动化流

说了这么多理论,最后来点真家伙。我把自己搭的一个"每日资讯摘要"自动化流程分享出来,基本上覆盖了前面讲的所有知识点。

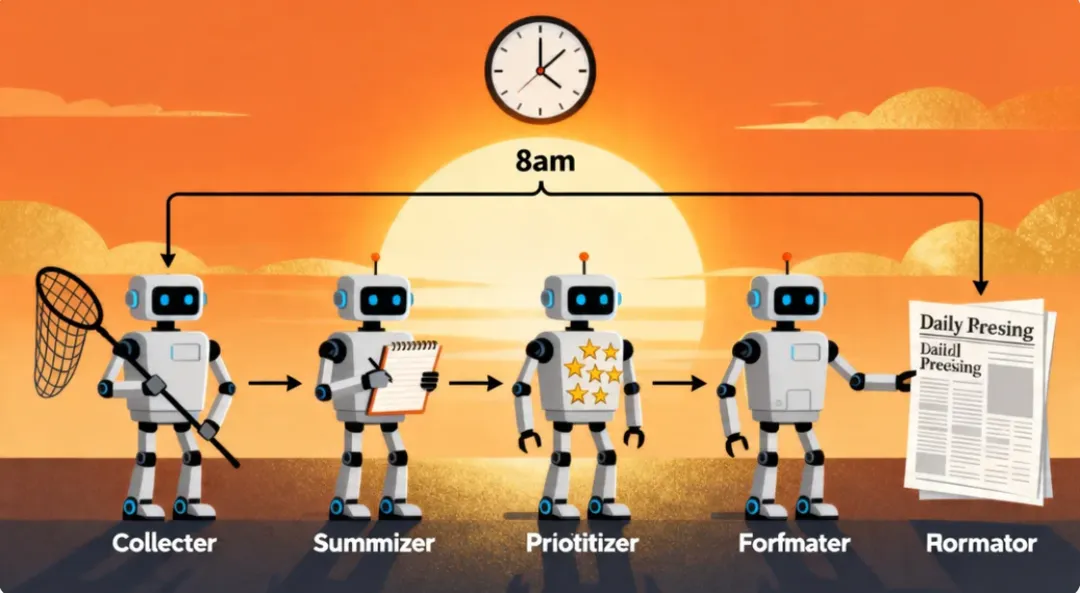

◆ 整体架构长什么样

先说这个自动化流的目标:每天早上8点自动抓取我关注的几个领域的最新资讯,整理成一份简报推送给我。

涉及的Agent角色:

• **Collector** —— 负责从各个信源抓取资讯(RSS、新闻网站、技术博客)

• **Summarizer** —— 对每条资讯生成一句话摘要

• **Prioritizer** —— 根据我的兴趣标签给资讯打分排序

• **Formatter** —— 把排好序的资讯格式化成可阅读的简报

◆ 核心配置代码片段

下面这段是基于CrewAI风格写的核心配置(简化版,方便你看懂逻辑):

# ========== 角色定义 ========== collector = Agent( role="资讯采集员", goal="从指定信源抓取当天最新资讯", backstory="你是一个敏锧的信息采集者,擅长从杂乱信息中筛选出有价值的内容", tools=[rss_tool, web_search_tool]# 工具:RSS阅读+网页搜索 ) summarizer = Agent( role="资讯摘要员", goal="将长文章压缩为1-2句话的精简摘要", backstory="你是一个简洁力行家,只说干货,不说客套话" ) prioritizer = Agent( role="重要性评估员", goal="根据用户兴趣标签对资讯排序", backstory="你深知用户的偏好,能准确判断哪条资讯更值得先看" ) formatter = Agent( role="简报编辑员", goal="将资讯列表格式化为美观的日报格式", backstory="你有设计师的审美,注重排版和可读性" ) # ========== 任务流定义 ========== collect_task = Task( description="抓取以下领域的今日资讯:AI/自动化/剧业生产力", expected_output="JSON格式的资讯列表,包含标题/链接/摘要" ) # ... 其他任务类似省略 ... # ========== 团队组装 ========== daily_briefing_crew = Crew( agents=[collector, summarizer, prioritizer, formatter], tasks=[collect_task, summarize_task, prioritize_task, format_task], process=Process.sequential,# 顺序执行 verbose=True )

💡 代码说明:以上是简化示意代码,实际使用时需要根据你的具体环境调整。重点看每个Agent的role/goal/backstory这三项是怎么定义的——这就是让Agent"知道自己是干什么的"的核心。

◆ 触发方式:定时 vs 事件驱动

自动化流的触发方式主要有两种,各有适用场景:

★ **定时触发(Cron/Schedule)**

就是我上面说的"每天早上8点自动跑"。用Python的`schedule`库或者系统自带的crontab就能实现。适合固定周期性的任务,比如日报、周报、定期备份之类的。

★ **事件驱动(Event-triggered)**

比如"收到邮件后自动处理""GitHub有新的issue提交时通知"这种。需要配合webhook或者消息队列来监听事件。适合响应式场景。

我个人建议:**先从定时触发开始**,跑稳了再加事件驱动。一口吃不成胖子,先把基本流程打通再说高级功能。

— · · · · · —

▎ 写在最后

这篇文章写得我自己都有点上头了哈哈。从刚开始用OpenCLAW时的单Agent小白,到现在折腾多Agent协作,我感觉最大的变化不是技术上的,而是思维方式上的。

以前我觉得AI就是个"聪明的助手",我问它答。现在我把它当成一支"可以组建的团队",我想让它干嘛就设计什么样的团队结构来干这件事。

这种感觉怎么说呢……就像是从小兵升成了指挥官?(好吧中二了一下。)

记住一句话:工具本身不决定上限,你怎么用它才决定。 多Agent协作听起来高大上,本质上就是"合理分工"+"高效沟通"。 这个道理放在人身上也一样,对吧?

如果这篇看完你觉得有点意思但又没完全搞懂,没关系!慢慢来 👋🎯

夜雨聆风

夜雨聆风