AI Agent 到底应该被理解成什么?

前几天,在一个 AI 学习微信群里,有伙伴抛出了一个很真实的问题:

火了一段时间的 OpenClaw(小龙虾),对普通人来说,到底是要自己养,还是等着它以后被直接植入手机?

这个问题我想了好久。

因为它问的,根本不只是 OpenClaw,也不只是某一个具体产品,而是在问一件更本质的事:

普通人面对 AI Agent,到底应该自己下场“养”,还是等它成熟后直接被服务?

我当时在群里的回答,大意是这样的:

对于终端用户来说,最理想的状态,当然不是人人都去学怎么“养虾”,而是让“小龙虾”直接为你服务。

因为“养”这件事,本身就有很高的时间成本。

你要学怎么搭、怎么调、怎么接工具、怎么处理异常、怎么让它跑得稳。这些事情,本来就更像“养虾人”的工作,也就是更接近软件开发者、AI 应用设计者,或者能把系统搭起来的人。

而对绝大多数用户来说,最后真正想要的,其实是另一种体验:

你只要对着手机说出一个需求,然后背后就有一只“虾”,或者说一个 Agent,帮你把事情做掉。

至于这只“虾”到底是你自己养的,还是平台替你养好的,本质上取决于两件事:

- 你的能力够不够自己搭

- 你的资金愿不愿意为成熟服务买单

对我最大的启发是:

今天很多人在讨论 AI Agent 时,关注点还停留在“我要不要学着自己做一个”,但从更长远的产品形态看,终局很可能不是“人人养虾”,而是“人人调用虾”。

也就是说,大多数终端用户最后需要的,不是一套复杂的搭建过程,而是一个随叫随到、能稳定交付结果的 Agent 服务。

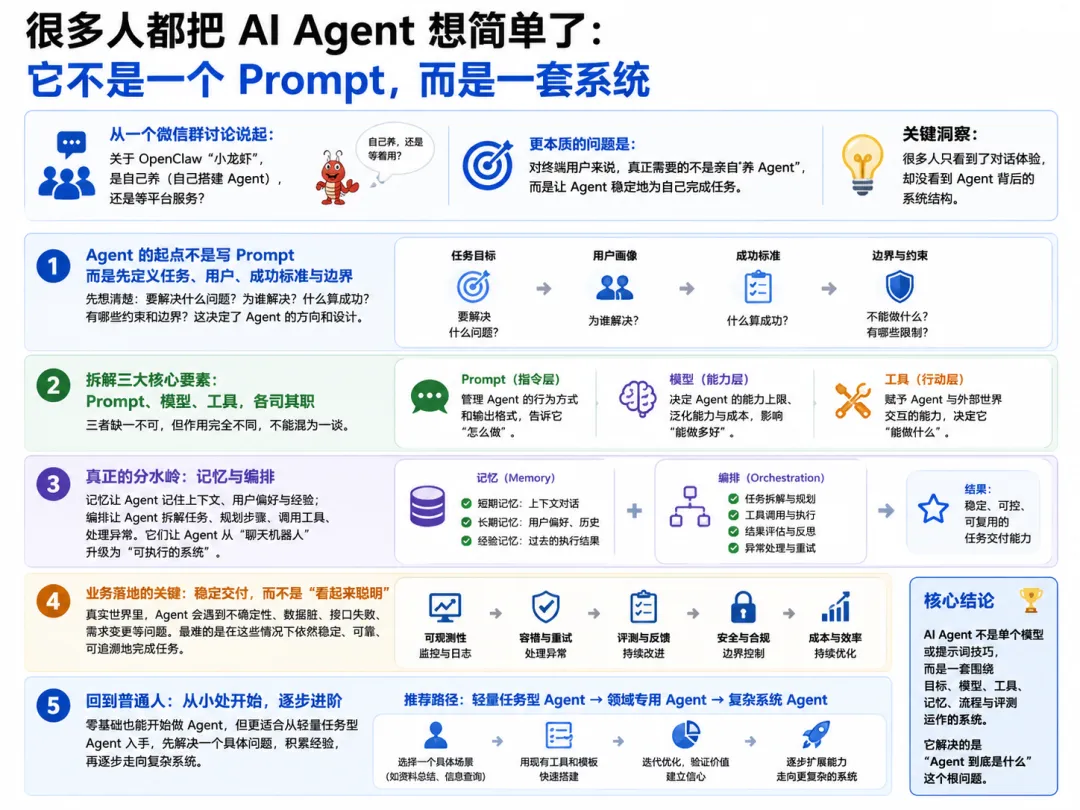

这也刚好解释了,为什么很多人会把 AI Agent 想简单。

因为一旦只从终端体验去看,你会觉得它像是一个更高级的聊天机器人;再进一步,会觉得它无非就是“大模型 + Prompt + 工作流”,只是把对话能力往前再推了一步。

这些理解都不算全错,但都还停留在表层。

因为真正能落地、能交付、能长期运行的 AI Agent,从来不是一句提示词堆出来的,也不是换一个更强模型就自然成立的。它的本质,更像一套围绕任务目标、模型能力、工具连接、记忆机制、流程编排和评测体系搭起来的系统。

换句话说,AI Agent 不是一个提示词技巧,而是一套完整系统。

这也是为什么很多团队会在一开始就走偏。

他们最先讨论的往往是:

- 用哪个模型

- 怎么写 Prompt

- 要不要接知识库

- 能不能加自动化

但真正应该最先回答的问题其实是:

- 它到底要解决什么问题

- 它在替谁工作

- 什么结果才算成功

- 它的边界和约束是什么

如果这些问题没有先想清楚,后面无论你接多少工具、堆多少流程,都很容易做出一个“看起来很聪明,但并不真正有用”的系统。

所以今天这篇文章,我想讲清楚一件事:

为什么 AI Agent 的第一步不是写 Prompt,而是先把它当成一个系统来设计。

第一层:第一步不是 Prompt,而是任务定义

很多人做 Agent,习惯从一句话开始:

“我想做一个 AI 助手。” 问题就在这里!

“AI 助手”不是任务定义,它只是一个模糊愿望。就像你说“我想做一个软件”一样,听起来没错,但几乎没有可执行信息。

一个真正值得搭的 Agent,第一步应该先回答四个问题:

1. 它解决什么问题。

2. 它服务谁。

3. 什么结果叫成功。

4. 它不能做什么。

这四个问题,比很多人想象得更重要。

因为不同目标,会直接决定后面几乎所有设计。

比如,一个企业知识问答 Agent,重点可能是回答准确、引用清晰、边界稳定;一个销售跟进 Agent,重点可能是提醒及时、任务推进、记录更新;一个内容选题 Agent,重点则可能是信息收集、主题聚类、输出结构化建议。

表面上它们都叫 Agent,但本质上根本不是同一种东西。

所以,做 Agent 的第一步不是“怎么让它更聪明”,而是“先把任务定义清楚”。

这也是很多项目最容易被忽略、却最关键的一步。

因为一旦任务没定义清楚,后面的 Prompt 很容易变成空泛指令,模型选择会变成盲选,工具连接会变成乱接,最后整个系统虽然很忙,却没有真正解决问题。

做 AI Agent,第一步不是写 Prompt,而是先定义任务。

第二层:Prompt、模型、工具,分别解决的是三种不同问题

当任务定义清楚之后,很多人会立刻开始写 Prompt。这没有问题,但要先分清楚,Prompt、模型、工具,其实解决的是三类完全不同的问题。

1. Prompt 解决的是“行为规则”

Prompt 的作用,不是给模型一点灵感,而是给它一个相对稳定的工作方式。它决定的是:

- 你是谁

- 你的目标是什么

- 你输出成什么格式

- 你优先考虑什么

- 哪些事情不能做

所以一个好的 Prompt,更像一份岗位说明书,或者一份操作手册。没有这层约束,模型就会漂;有了这层约束,它才可能稳定。

2. 模型解决的是“能力上限与成本边界”

模型选择,也常常被讨论得过于简单。很多人会直接问:最强的是哪个?但这不是最有效的问题。更有效的问题应该是:

- 这个任务需要多强的推理能力

- 需要多长的上下文

- 是否需要很强的代码能力

- 是否对速度很敏感

- 是否对调用成本很敏感

因为不同 Agent,对模型的要求完全不一样。研究型 Agent 可能更需要长上下文和深推理。工作流型 Agent 可能更看重稳定性和速度。编码型Agent 则可能更依赖代码理解与修改能力。

所以模型不是奖杯,不是谁最强就用谁,而是谁更适合这个任务。

3. 工具解决的是“它能不能真正行动”

这一层是很多人低估的。如果没有工具,再聪明的模型,大多数时候也只能生成文本。一旦接上工具,它才能开始真正做事,比如:

- 调用网页或应用接口

- 获取实时数据

- 查询企业知识库

- 更新表格、数据库或任务状态

- 触发下一步流程

这也是为什么很多 Agent 演示看起来很聪明,但一到真实业务里就显得无力。因为它也许很会说,但它未必真的连到了业务系统。

一句最容易记住的话是:

Prompt 决定它怎么想,工具决定它能不能做。

而模型,决定的是它能在多大程度上把这件事做对、做稳、做得划算。

第三层:真正把 Agent 和普通聊天区分开的,是记忆和编排

如果说 Prompt、模型、工具,已经让很多人觉得 Agent 比聊天机器人更进一步,那么真正把两者拉开差距的,往往是后面这两层:记忆和编排。

1. 没有记忆,它只是一次对话

很多人会觉得,聊天记录不就是记忆吗?其实不完全是。真正有用的 Agent,通常至少要处理几类不同的“记住”:

- 当前任务过程中的临时信息

- 与用户有关的关键偏好和历史事实

- 可以被检索调用的文档、资料和知识

- 与业务状态相关的结构化信息

这意味着,所谓“记忆”并不只是把上一轮对话接上去,而是要知道:什么该记、记到哪里、什么时候取出来、取出来之后怎么用。如果没有这套机制,Agent 往往会表现出一种很典型的问题:每次都像第一次见你。你刚觉得它懂你,它下一轮又忘了;你刚让它推进到第二步,它又回到第一步;你刚希望它延续上次工作,它却像从零开始。

所以从系统角度看,没有记忆,Agent 只是一段对话。

2. 没有编排,它只是偶尔成功

更被低估的一层,是编排。所谓编排,说白了就是:

- 什么时候走哪条路径

- 什么情况下调用哪个工具

- 某一步失败之后怎么重试

- 任务复杂时是否要拆成多步

- 是否要交给另一个更适合的 Agent 或模块

这才是真正让系统“跑起来”的部分。

因为真实世界里的任务,很少是一问一答就完成的。它往往是连续动作。

比如:

先识别需求,再查资料,再判断可信度,再生成结果,再更新状态,再把结果发到某个渠道。

只要流程稍微复杂一点,你就会发现,真正难的已经不是“模型会不会回答”,而是“系统能不能稳定推进”。

也正因为如此,很多所谓的 Agent,其实只是“在某些场景下偶尔成功”。

一旦遇到例外、缺数据、权限错误、接口超时、上下文冲突,系统就会断。

所以,没有编排,Agent 只是一次偶然成功。

第四层:普通人最容易高估“会聊天”,低估“能交付”

为什么大家容易把 Agent 想简单?因为现在绝大多数展示,重点都放在“它看起来很智能”。

* 它会理解你。

* 它会分步骤回答。

* 它会调用一些工具。

* 它甚至会生成图表、总结资料、写出方案。

这些都很容易让人产生一种错觉:

好像 Agent 已经非常成熟,接下来只要选个平台、写点 Prompt,就能把大量工作自动化。但真实难点根本不在这里。

真实难点是:

- 它是不是能稳定重复完成

- 它出错后能不能恢复

- 它能不能接进你已有的系统

- 它的结果能不能被团队真正使用

- 它的效果能不能被衡量和持续改进

换句话说,很多人高估的是“会聊天”的价值,低估的是“能交付”的门槛。

这也是为什么很多业务负责人第一次看 Agent 会很兴奋,但真正推进时,很快就会发现复杂度远高于预期。

因为问题从来不只是:“它会不会说。”

而是:“它能不能稳定地把一件事做完。”

最难的不是让 Agent 会说话,而是让 Agent 稳定地做事。

第五层:那普通人到底该怎么开始?

说到这里,很多人最关心的问题就来了。

如果 Agent 真的是一套系统,那没有编程基础的人,是不是就完全不用碰了?也不是。

更准确地说,普通人当然可以开始,但更适合从轻量任务型 Agent 开始,而不是一上来就挑战深度工程型 Agent。

什么叫轻量任务型 Agent?

就是那些任务目标清晰、流程不太长、工具连接相对简单、容错要求没那么极端的场景。

比如:

- 帮你做内容选题整理

- 帮你做会议纪要结构化整理

- 帮你做资料问答

- 帮你做销售跟进提醒

这些场景有一个共同点:

你可以先把它做成一个最小闭环,而不是一开始就做成一个全自动、全连接、全能型系统。

更现实的路径通常是四步:

1. 先定义一个单点任务。

2. 先用现成平台跑通一个最小闭环。

3. 再接一个简单工具或知识源。

4. 最后再考虑多步骤流程、稳定性和评测优化。

这条路径的好处是,你不会一开始就被复杂度压垮。

你先学会把一个任务做清楚,再学会把一个动作接起来,再学会让它连续运行,最后才去追求更大的自动化规模。

所以,不会编程的人,不等于不能做 Agent;但更适合从轻量应用型 Agent 开始,而不是把一开始的目标设成“做一个全自动 AI 员工”。

最后:未来比拼的,不只是模型,而是系统能力

如果要用一句话总结今天这篇文章,我会这样说:

AI Agent 不是一个功能,而是一种架构。

它不是“模型更强一点”的自然结果,也不是“Prompt 写得更漂亮”的直接产物。

它要真正有价值,至少需要你同时思考这些问题:

- 目标定义是否清楚

- 行为规则是否稳定

- 模型选择是否匹配任务

- 工具是否真的能接入业务

- 关键事实是否能被记住

- 流程是否能被稳定推进

- 结果是否可衡量、可迭代

你会发现,到了这里,Agent 已经不像一个聊天产品,更像一个结合产品设计、流程设计和系统设计的复合体。这也是为什么,未来真正拉开差距的,未必只是“谁用了更强的模型”,而是谁能围绕模型,设计出更好的系统。如果你没有编程基础,也完全可以开始理解和使用 Agent;但不要一上来就想搭一个全自动、全能型系统。先做一个能稳定完成单一任务的 Agent,往往比做一个看起来很厉害、但总是断在半路的系统,更有价值。

下一篇,我会接着聊一个更现实的问题:

不会编程的人,到底能把 AI Agent 做到哪一步?

如果你也在思考,AI 到底应该被当成一个工具、一个助手,还是一个真正能进入业务流程的系统,欢迎留言聊聊你的判断。

👋 我是田斌。

长期关注金融、企业经营与 AI 交叉领域,尝试用财务逻辑和系统视角,重新理解 AI 时代的商业重构。

这个系列,我会继续沿着“系统视角”往下写,不只谈模型和工具,更谈 AI 如何真正进入业务、流程与组织。

夜雨聆风

夜雨聆风