当 ChatGPT 开始卖广告,AI 助手还是你的助手吗?

先想一个不难发生的场景。

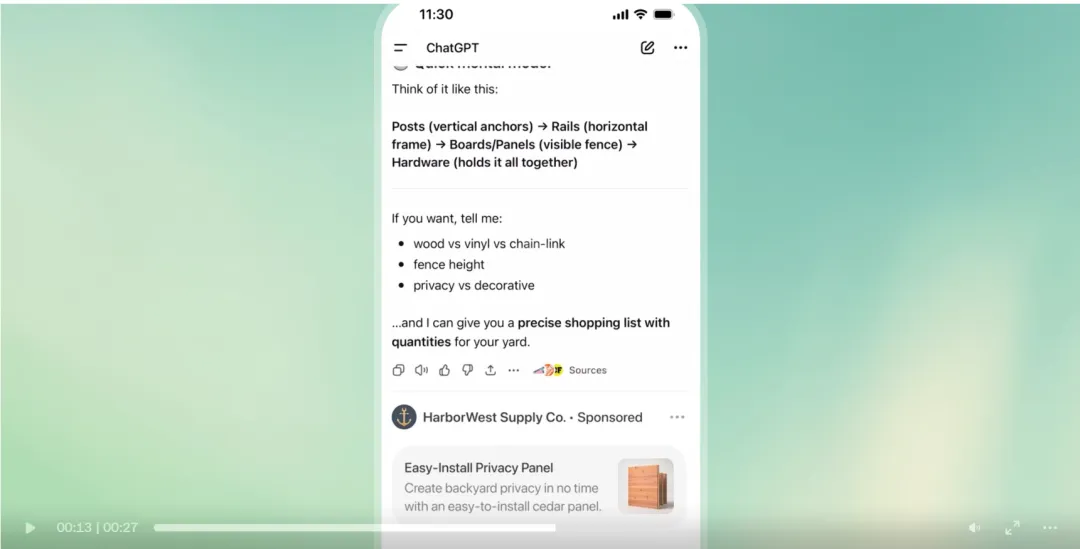

你问 ChatGPT:“我该买哪款降噪耳机?”

它很快给你列了三个选择:一个适合通勤,一个适合长途飞行,一个性价比不错。理由也写得挺像那么回事:续航、降噪、佩戴舒适度、价格区间,全都给你整理好了。

你看完觉得:行,这比我自己刷十篇测评省事多了。

然后你发现,其中一个选项旁边写着:赞助内容。

这时候问题就来了。

你刚才看到的,到底是建议,还是广告?

这不是“页面上多了一块广告位”这么简单。要只是多一块广告位,大家顶多烦一下,划走就完事了。真正别扭的地方在于:我们使用 AI 助手时,心态和使用搜索引擎、信息流、短视频平台完全不一样。

搜索引擎给你一排链接,你心里大概知道前面几条可能是广告。短视频给你推商品,你也知道那里面有带货逻辑。电商平台说“猜你喜欢”,你也不会真以为它只是在纯洁地猜你喜欢。

但 AI 助手不一样。

它不是把一堆结果扔给你,让你自己慢慢挑。它会把信息嚼碎、比较、排序,然后用一种很像“站在你这边”的语气告诉你:我建议你选这个。

这就麻烦了。

因为广告进入的不是页面边栏,不是搜索结果顶部,也不是信息流中间,而是进入了你的判断链路。

搜索广告影响点击,AI 广告影响判断

OpenAI 在 2026 年 1 月发布过关于 ChatGPT 广告原则的说明,提到会在美国对 Free 和 Go 计划里的成年登录用户测试广告。它的说法也很明确:广告会和自然答案分开,会清楚标注,并且不会影响 ChatGPT 给出的回答。

到了 2026 年 5 月,OpenAI 又发布了关于购买 ChatGPT ads 的说明,开始扩展广告主购买和管理广告的方式,包括合作伙伴、自助 Ads Manager、CPC 出价和转化衡量这些能力。

这事儿从商业上看,一点都不奇怪。

模型不是靠仙气跑起来的。训练要钱,推理要钱,带宽要钱,研发、安全、审核、客服都要钱。免费用户越多,账单越厚。OpenAI 找广告收入,没什么道德上不能理解的地方。

企业也愿意投。

因为用户问 AI 的时候,往往不是在无聊刷屏,而是真的有意图:我要买什么、去哪儿、选哪个、怎么做。它有没有告诉你,广告为什么会出现在这里? 对广告主来说,最贵的不是曝光,而是用户已经准备做决定的那一刻。

但也正因为这样,问题才变得尖锐。

搜索广告影响的是:你点哪个链接。AI 广告影响的可能是:你相信哪个答案。

这两件事不是一个量级。

你在搜索引擎里查“降噪耳机推荐”,看到的是一串网页。广告、测评、论坛、商城链接混在一起,你需要自己判断。它当然也会影响你,但那个影响还比较外显:你知道自己在一堆结果里挑。

AI 助手更进一步。

它会替你做第一轮筛选,替你排序,替你总结优缺点。有时候它甚至会直接说:“如果你主要通勤,我建议选 A。”

这句话的重量是不一样的。

因为你不是把 AI 助手当广告栏看,而是把它当一个懂上下文的顾问看。你告诉它预算、偏好、使用场景、之前踩过什么坑,它给你的也不是一堆原材料,而是“判断后的信息”。

所以广告一旦进入这个位置,边界就会变得特别脆。

我不是说 AI 助手一定会偷偷偏向广告主。这个结论太莽,也没证据,没必要硬扣帽子。

真正值得追问的是另一件事:当一个系统既要帮用户做判断,又要向广告主出售“用户正在做判断的场景”,它凭什么证明自己没有把这两件事混在一起?

这才是关键。

OpenAI 广告原则原文 https://openai.com/index/our-approach-to-advertising-and-expanding-access

真问题不是能不能有广告,而是谁在影响答案

很多人第一反应会是:ChatGPT 怎么也开始卖广告了?这是不是变味了?

这个反应挺正常,但说实话,还停在第一层。

AI 产品要不要商业化,不是问题。除非我们准备接受“好模型只给付费用户用,普通人慢慢排队”,否则平台总得找钱。广告、订阅、企业服务、分成、交易佣金,最后无非是这些路。

所以我不太想把这件事写成“OpenAI 也堕落了”。

这话骂起来爽,但没啥含金量。

真正的问题不是能不能有广告,而是广告以什么身份出现,出现在什么位置,又对答案产生什么影响。

我觉得至少要盯住四个问题。

- 广告必须像广告,不能伪装成建议

用户必须一眼知道,哪一部分是自然回答,哪一部分是赞助内容。这里不能玩文字游戏。什么“推荐”“精选”“合作”“你可能喜欢”,这些词单独看都没问题,但放在 AI 助手场景里,就很容易把边界糊住。

AI 助手越像顾问,广告标注就越应该粗暴、清楚、没歧义。

平台不能一边说“答案中立”,一边让广告系统悄悄影响候选项

OpenAI 官方原则里说,广告不会影响 ChatGPT 的回答,答案应该基于对用户最有帮助的内容。这句话非常关键。

如果广告只是答案之后的单独区域,风险还相对可控。可如果广告开始影响候选项、排序、比较维度,甚至影响“什么被认为值得推荐”,那用户就很难判断了。

你看到的“最佳选项”,到底是模型判断出来的,还是商业系统推上来的?

AI 至少要告诉我:你为什么把这个东西推到我眼前

普通广告里,“为什么我看到这个”已经是基本问题。到了 AI 助手这里,这个问题更敏感。

因为广告可能基于当前对话、你的需求、你的地理位置、你的历史偏好出现。用户至少应该知道:这是因为我正在比较产品?因为我提到了某个城市?还是因为某个广告主买了这个场景?

如果这都说不清楚,那所谓“助手”就开始变味了。

我得有退出权。否则这不是助手,是一个越来越懂我的广告入口

能不能关闭个性化?能不能清除用于广告的数据?有没有无广告方案?未成年人和敏感话题怎么处理?医疗、金融、教育这些高风险场景,广告边界怎么划?

这些都不是产品角落里的小设置,而是信任条件。

OpenAI的官方说法里确实提到了类似原则:答案独立、对话隐私、选择和控制、长期价值。也提到广告计划放在答案底部,和自然答案分开,并允许用户了解为什么看到广告或关闭个性化。

这是好事。

但说白了,原则写出来只是第一步。互联网公司最不缺原则,缺的是收入压力上来之后还能不能守住原则。

广告系统一旦跑起来,就会有预算、出价、点击率、转化率、归因、优化目标。它会天然追求更好的效果。这不是谁坏,这是系统惯性。

广告主会不会希望位置更靠前?平台会不会测试更“自然”的展示方式?团队会不会为了转化率,把标注做得更轻一点?收入压力会不会一点点改变产品边界?

这些问题不问,才叫装糊涂。

AI助手最有价值的地方,恰恰也是广告最想接近的地方:用户准备做决定的那一刻。

这才是整件事最要命的地方。

买耳机还是小事。

真正麻烦的是,当你问 AI: 我要不要买这份保险? 孩子该报哪个课程? 这 个症状要不要去医院? 我该不该换工作?

如果这些答案里也混进商业动机,问题就不是广告体验,而是判断权到底还 在不在你手里。

以后我们该怎样信任一个 AI 助手?

我不认为AI助手一卖广告,就自动不可信。

这判断太粗糙了。

现实世界里,我们信任的很多服务都有商业模式。搜索引擎有广告,地图有商家推广,电商有竞价排名,内容平台有品牌合作。问题从来不是“有没有商业利益”,而是商业利益有没有被清楚地放到台面上。

AI 助手商业化之后,我们真正要升级的,是自己的信任标准。

以后看一个 AI 助手的推荐,不能只看它回答得流不流畅,也不能只看它语气像不像一个靠谱的人。

流畅不等于中立。像人不等于站在你这边。能解释,也不代表没有商业动机。

你得多问几个问题。

它有没有清楚区分答案和广告?

它有没有说明推荐理由,而不是只给一个结论?

它有没有告诉你,广告为什么会出现在这里?

它有没有给你关闭、调整、退出的选择?

它在医疗、金融、教育、职业选择这类高风险场景里,有没有足够克制?

这些问题听起来麻烦,但以后会越来越重要。因为 AI 助手不会一直停在“帮你写邮件、改文案、查资料”这个层面。

它会越来越多地参与消费、旅行、学习、求职、理财、健康咨询这些更重的决策。

当它只是帮你润色一句话时,广告可能只是烦人。当它开始帮你决定买什么、去哪儿、学什么、信什么时,广告就会变成信任问题。

所以,“AI 助手还是不是你的助手”这个问题,不能只靠一句“它会明确标注广告”来回答。

一个值得信任的 AI 助手,至少要做到三件事。

第一,它可以商业化,但不能装作自己完全没有商业动机。

第二,它可以展示广告,但不能让广告偷偷进入自然答案的判断逻辑。

第三,它可以帮助用户发现商品和服务,但必须把最终判断权交还给用户,而不是把商业推荐包装成中立建议。

说到底,AI 助手不会因为卖广告就不再是助手。

但如果它不清楚告诉你什么时候在帮你、什么时候在帮广告主,它就不再是一个值得信任的助手。

我们以后要信任的,不是一个永远没有商业利益的 AI。

那不现实,也有点天真。

我们真正需要的,是一个把商业利益说清楚、把选择权交还给用户、并且愿意接受质疑的 AI 助手。

否则,它越聪明,我们反而越需要警惕。

夜雨聆风

夜雨聆风