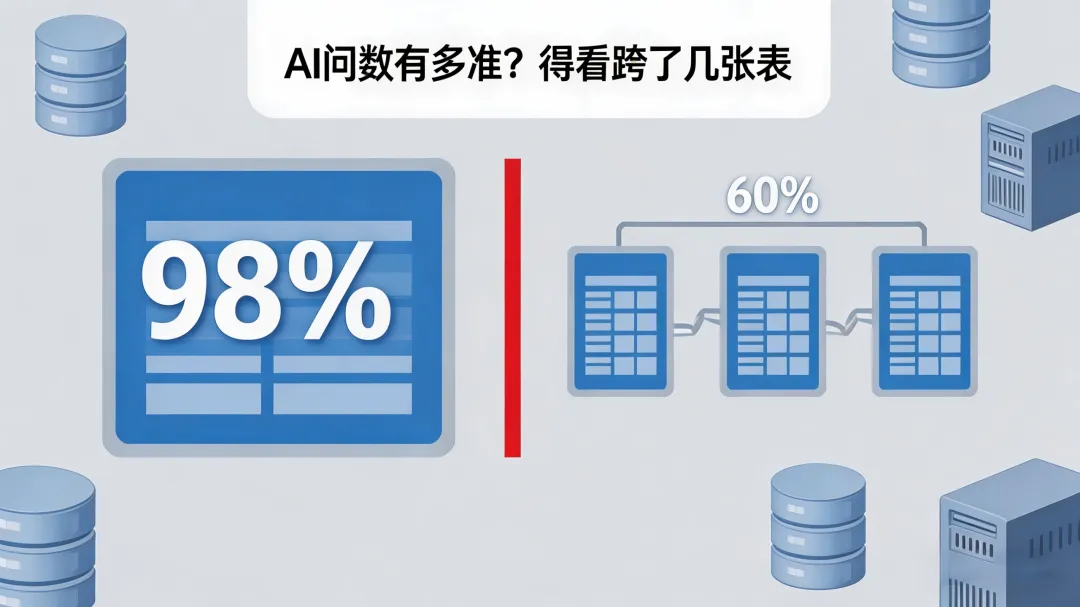

为什么单表98%不是终点,多表JOIN才是智能问数真正的考场?单表查询接近满分,多表关联直接腰斩——这是当前NL2SQL领域最不容回避的一道槛。

一家制造企业的IT负责人在内部技术评估中,对几款主流智能问数方案做了对比测试。单表单次查询——“上月产量”、“华东区入库量”、“某产线产能利用率”——各家表现平稳,准确率几乎都在98%以上,秒级出结果。评估组一度认为,选哪家差别不大。

转折出现在多表场景。当他尝试跨三张表做一个关联分析——“对比某产线上周三种产品的合格率与对应原料批次”——结果开始漂移。第一次查询返回一组数字,换种措辞再问,数字全变了。半天排查下来,问题定位在批次物料表的外键关联上:系统在关联路径上选错了字段,将一半的查询结果匹配到了错误的批次编号上。

这不是孤例。行业公开数据显示,当前NL2SQL在单表查询上的准确率可达85%至90%,已接近人工撰写SQL的水平。但一旦涉及三张及以上的表JOIN操作,准确率便骤降至不足70%;复杂嵌套查询的准确率更低,仅维持在65%至70%的区间。

Gartner在2026年4月发布的一项覆盖782名基础设施与运营领导者的调研,从另一个角度印证了这一困境:仅有28%的AI用例完全达成预期投资回报,超三分之一的失败项目将根因指向数据质量或数据可用性不足。Gartner同时预测,到2026年底,60%的AI项目将因缺乏“AI就绪数据”而被放弃。

单表98%,多表60%——同一套技术底座,同一批数据,单表场景与多表场景下的AI问数,已经是两种截然不同的能力。前者是演示,后者是生产。两者之间差出来的,是NL2SQL工程化落地最核心的分水岭。

多表JOIN到底难在哪?

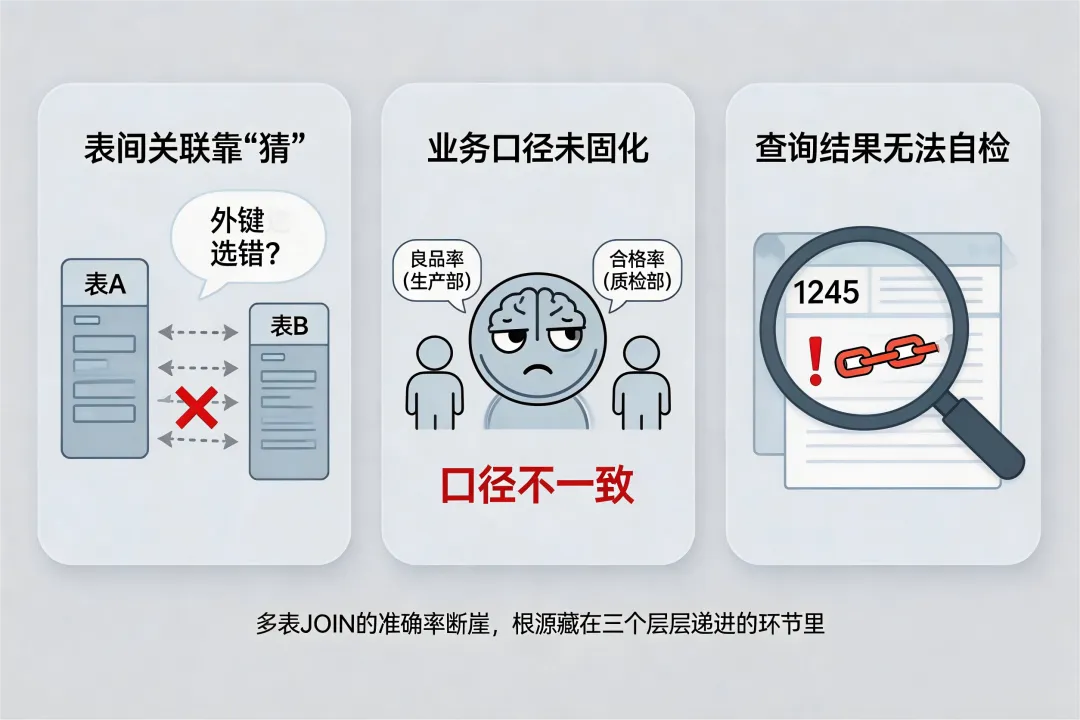

多表JOIN的准确率断崖,根源藏在三个层层递进的环节里。

第一个环节:表间关联靠“猜”。数据库的表靠外键连接。传统NL2SQL系统在执行Schema Linking时,本质上是基于字段名做概率匹配——哪个字段看起来像外键,就往哪条路径上靠。

问题在于,企业数据库的Schema从来不按“看起来像”的逻辑来设计。一条需要拉通员工表、产品表、订单表的跨表查询,关联路径往往不止一种;同一个字段名在不同上下文里可能指向完全不同的表关系。一旦外键选错,INNER JOIN变成了LEFT JOIN,结果就全废了。在标准多表数据集上,即使是当前表现最先进的方案,错误也高度集中在关联遗漏和外键选择这两个环节。有企业级实践数据显示,在包含数百张表的ERP环境中,仅凭模型直接生成SQL的初始准确率仅为72%——这72%里的大多数失分项,全都出在多表关联上。

第二个环节:业务口径未固化为工程规则。单表查询为什么准确率高?因为问题简单、路径单一,大模型只需要完成“理解问题→生成SQL”这一件事。但多表场景下,大模型被要求同时做两件事:既要理解你的业务语言——“良品率”具体指什么、不同部门对它的定义是否一致——又要推算出跨越三到五张表的最优查询路径。

这是一个双重猜测的过程。跨表越多,猜测链条越长,出错空间呈指数级放大。复杂的业务逻辑里隐含着大量的口径约定——比如“绩效一般”可能对应某个评分区间,也可能对应某个标记字段,但大模型无从知晓这些仅存在于企业内部的映射关系。一两处隐含规则尚能应付,几十上百条口语化口径同时出现时,系统的准确率就会持续走低。

第三个环节:查完之后无法自检。单表查询出错相对容易被发现——数字和日常认知偏差太大时,用户会本能地起疑。但多表查询的静默错误是最难防范的:查询能正常执行,返回的数字看起来也合理,但实际上关联逻辑在某一个环节已经悄悄出错了。

没有自检机制的多表查询系统,不会告诉你“这个结果可能有问题”,也不会告诉你“关联路径在第三步偏离了预期”。错误就这么安静地躺在报表里,直到月末对账对不上,或者排产计划因为偏差了几个百分点而导致物料短缺,才被事后发现。有部署实践显示,某企业上线Text-to-SQL系统的第一周,31%的查询结果需要人工纠正,而其中最难检测的正是这类“看起来正常、其实算错了”的静默逻辑错误。

行业里四条破局之路,各有利弊

面对多表JOIN的准确率困局,行业走出了四条不同的技术路线,每条路线各有其代价。

第一条路:预置宽表。把多表关联的结果提前物化成一张大宽表,查询时只需面对单表逻辑。这条路的单表准确率可以做到90%以上,技术实现门槛低,响应速度快。

代价是宽表只能覆盖被提前预设过的查询场景。业务新增一个维度、换一种关联方式,就需要重新构建宽表,维护成本随业务复杂度线性攀升。适合标准化程度高、查询模式相对固定的组织;不适合业务变化快、数据量庞大的环境。

第二条路:ChatBI升级。在传统BI报表系统之上叠加自然语言交互层,用户通过对话的方式调用预置报表或触发预定义查询。依托现有BI生态,实施周期短,用户接受度相对较高。

代价是查询能力的上限被预置报表框死。能回答的问题局限于IT部门提前配置好的范围,泛化能力弱,一旦用户的问题超出预置边界,系统就退化为一个“听不懂人话”的对话界面。

第三条路:预制指标平台。提前由人工定义好所有指标的计算逻辑和统一口径,用户只能查询已被配置的指标。指标口径统一、数据可控、便于治理,对合规要求高的场景友好。

代价是只能回答预制范围内的指标查询,灵活性极差。业务新增一个指标,需要走配置流程;指标数量随业务发展急剧膨胀,维护负担指数级增长。

第四条路:语义层关联。这条路的逻辑与前三条不同——不再依赖大模型去“猜”JOIN路径,而是提前将数据库中所有表间的关联关系做结构化建模,作为查询时的确定性约束。有企业级实践数据显示,通过建立连接图约束,仅允许模型在已验证的表关系内选择关联路径,不正确的JOIN可以减少约60%。再叠加业务术语映射层,让“营收”始终等于“净销售额”、“客户”始终对应“客户ID”,准确率可以从初始的72%逐步提升至91%。

这条路的核心思想是:让关联关系提前确定,让业务口径提前固化为工程规则,让每一次查询结果都可追溯、可校验、可复现。它不是靠大模型的“聪明”去兜底,而是靠工程架构的“确定性”来兜底。

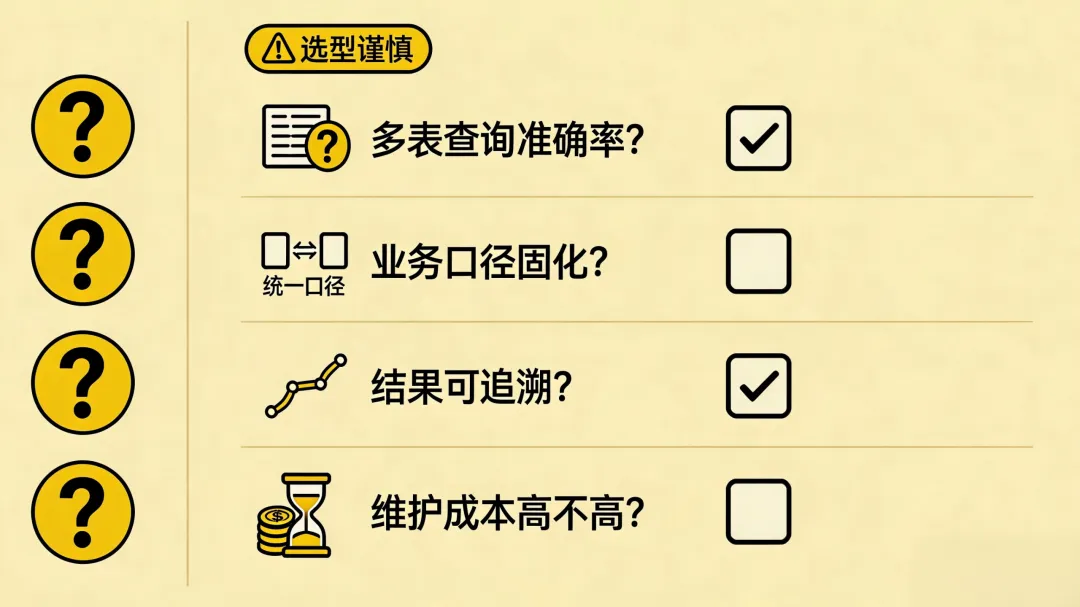

选型时,四个问题比跑Demo更重要

Demo只能证明单表场景下的表现。选型决策时,建议跳出Demo视角,问清楚四个问题。

第一,多表查询的准确率到底是多少?不是在标准测试集上,也不是在Demo环境里,而是在与企业自身数据库同等复杂度的真实Schema下,多表关联查询的执行准确率是什么水平?一个在学术基准Spider 2.0上——覆盖金融、医疗、电商等18个垂直领域的真实企业数据库工作流——整体执行准确率至今不足六成的行业现实,已经说明了这道槛有多么不容易跨过去。

多表查询的准确率不是加分项,是区分“Demo可用”与“生产可信”的分水岭。

第二,业务口径是不是提前固化了?不同部门问同一个指标,系统给出的数字是同一个吗?口径的差异不会在Demo中暴露——Demo用的是干净数据,问的是标准问题。但在生产环境里,口径不一致是导致业务部门“用不起来”的头号原因。

第三,结果能不能追溯?每一句查询生成的SQL逻辑和取数路径是否可审查?当财务对账发现偏差时,能不能顺藤摸瓜找到是哪一步关联出了错?可追溯不是锦上添花,是企业级应用的安全底线。

第四,维护成本有多高?业务新增一张表、调整一个口径,从配置到生效需要多长时间、投入多少资源?这条路的长期维护负担会不会随业务增长而持续放大?一个在Demo阶段看起来完美的方案,如果后期每加一张表都需要数周的重构,其真实的总拥有成本远超初始预期。

我们的技术团队在实际部署中反复验证过一个结论:多表场景下的AI问数翻车,根因不是模型不够大,而是缺少两件“工程化的小事”——稳定的关系建模,让表之间的关联路径提前确定;动态的关联自检,让每一次跨表查询都能校验结果是否正确。

如果你所在的企业也遇到了类似的问题——单表问数没问题,一到多表关联就时准时不准——我们可以一起聊聊这个问题的解法。不推产品,只做技术交流。

《企业智能问数落地实战》——只写能落地的企业智能问数

下期预告:我们聊聊另一个被严重低估的话题:多数智能问数项目只在“易用性”上做文章,而忽略了后台的字典与映射——当行业黑话遇上了标准SQL,AI才能真正“听懂人话”。

光棱智瞳技术团队

我们是一支专注于企业智能问数落地的技术团队。无论是车间班组长还是财务经理,他们口中一个顺口的行业黑话、一次下意识的多表关联提问,都是AI系统理解业务的线索。我们日常做的,就是把这些表达梳理清晰,让每一次跨表查询都有据可循。

夜雨聆风

夜雨聆风