【导读】字节跳动开源 GUI Agent 模型 UI-TARS,能直接看屏幕截图、操控鼠标键盘完成任务。GitHub 仓库 3.2 万星,论文 benchmark 多项超越 Claude 和 GPT-4o,模型权重、桌面应用、论文全部公开——AI 正在从对话框走进操作系统。

「帮我订张机票」——然后它真的打开浏览器订了

有个画面你可能还没习惯:

你对着电脑说,「帮我在 Priceline 上订 9 月 1 日旧金山到纽约的机票」。

然后 AI 打开了浏览器,找到了航班,填好了信息,一步一步点下去。

你没写一行代码,甚至没碰键盘。

▲ 中文 X 用户 axiaisacat 发帖介绍 UI-TARS 的开源能力和使用场景

这个场景来自 X 用户 axiaisacat 5 月 10 日发的一条帖子。他说字节跳动开源了一个 AI,叫UI-TARS——开源免费,本地运行,能直接操控你的电脑。

他举了几个例子:改 VS Code 的自动保存延迟、查杭州天气然后画成图表、订机票。

听起来像科幻?但这次有论文、有代码、有模型权重,全套开源。

这个项目到底是什么?

先别急着兴奋,拆清楚再说。

UI-TARS 其实是一整套技术栈,分成三层:

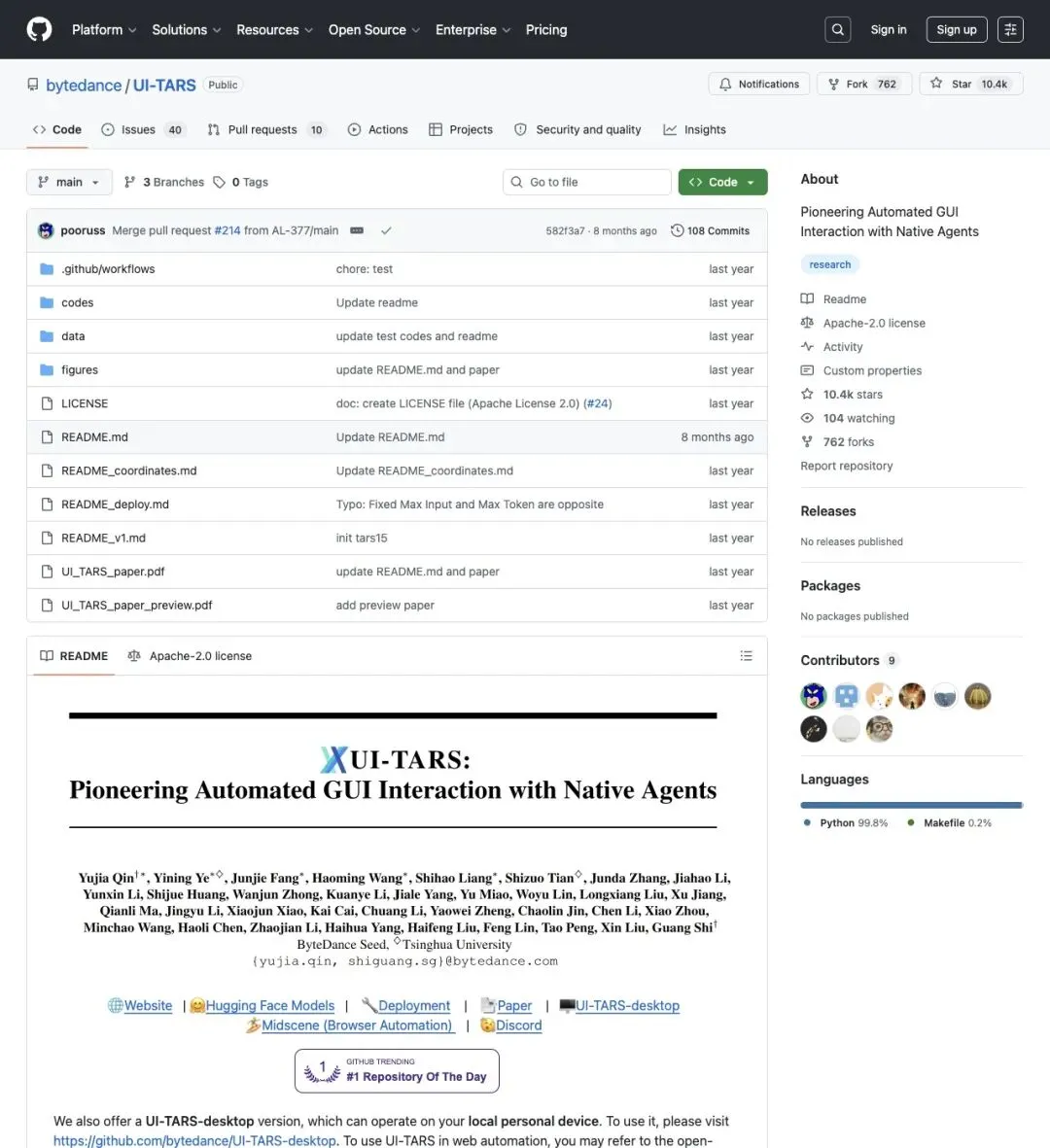

第一层:模型。bytedance/UI-TARS 是核心的视觉语言模型仓库,GitHub 上已经拿到1 万+ 星标。模型的论文发在 arXiv 上,标题是《UI-TARS: Pioneering Automated GUI Interaction with Native Agents》。论文摘要开头就定义了它的能力边界:

"UI-TARS is a native GUI agent model that solely perceives the screenshots as input and performs human-like interactions (e.g., keyboard and mouse operations)."

「UI-TARS 是一个原生 GUI agent 模型,只接收屏幕截图作为输入,执行类似人类的键盘和鼠标操作。」

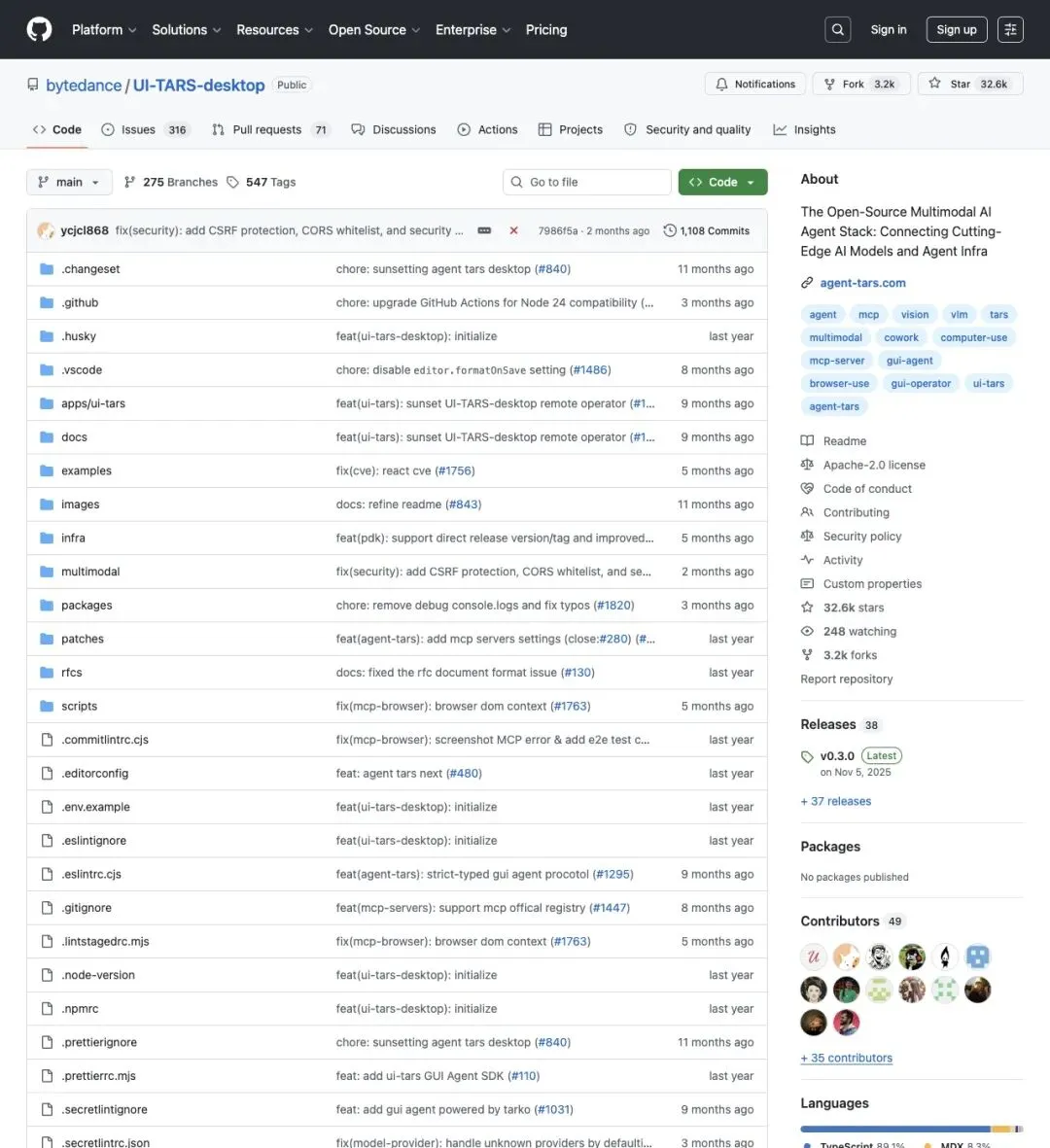

第二层:桌面应用。bytedance/UI-TARS-desktop 是面向用户的桌面端,GitHub 上拿到了3.2 万星标、3200+ fork。官方 README 写得很明确:

"UI-TARS Desktop is a native GUI agent for your local computer."

「UI-TARS Desktop 是针对你本地电脑的原生 GUI agent。」

它提供了本地电脑操作(local computer operator)和浏览器操作(browser operator)两个核心能力,macOS 和 Windows 都支持。

第三层:Agent TARS 工具栈。这是更大的 agent 基础设施,接入了 MCP 工具协议,把 GUI agent 和终端、浏览器、文件系统串起来。不过要注意,The Decoder 的报道特别指出:Agent TARS 偏向浏览器/CLI/文件系统自动化,和 UI-TARS Desktop 的系统级 GUI 操作有区别,别把两个混在一起。

▲ bytedance/UI-TARS-desktop 仓库首页,3.2 万星标,Apache-2.0 开源协议

▲ bytedance/UI-TARS 模型/论文仓库,1 万+ 星标

「看屏幕、动鼠标」背后的技术路线

很多 agent 工具做的事情是:把自然语言翻译成脚本,然后执行。

UI-TARS 走的路线完全不同——它直接看屏幕截图,理解界面上有什么,然后决定下一步点哪里、输入什么。

论文把这个过程拆成了四个关键能力:

增强感知(Enhanced Perception):模型需要从截图里识别出按钮、输入框、菜单、文字这些 GUI 元素的位置和含义。

统一动作建模(Unified Action Modeling):不同平台——手机、电脑、浏览器——的点击、滑动、输入、滚动被归入同一套动作空间。模型学的是通用的「怎么操作界面」,而非为每个平台写一套规则。

System-2 推理:面对多步任务(比如订机票这种需要好几个页面跳转的操作),模型会分解任务、设定里程碑、在执行中反思——这借鉴了认知科学里「慢思考」的框架。

反思式在线训练(Reflective Online Traces):团队在虚拟机里让模型真正执行 GUI 任务,收集交互轨迹,然后筛选、改进,用这些数据迭代训练模型。这解决了 GUI agent 最头疼的问题——高质量训练数据太少。

▲ UI-TARS 论文,2025 年 1 月提交至 arXiv

Benchmark:确实打出了成绩

在论文公布的初版 benchmark 里,UI-TARS 在多个 GUI agent 测试集上拿到了当时的最优成绩:

- OSWorld

(跨应用桌面任务):UI-TARS 得分 24.6(50步)/ 22.7(15步),Claude 对应得分 22.0 / 14.9 - AndroidWorld

(安卓操作任务):UI-TARS 得分 46.6,GPT-4o 得分 34.5

后续的 UI-TARS-1.5 版本成绩进一步提升。模型卡上公布的 OSWorld 数据:

| 42.5 |

7B 小模型就已经超过了初版 72B 的表现——这说明架构和训练方法的优化带来的增益非常可观。

但这里有个重要前提:这些数字都在特定 benchmark 上测出来的,并不意味着 UI-TARS 在所有真实场景中都优于 GPT-4o 或 Claude。Benchmark 和日常使用之间的差距,做过机器学习的人都明白。

开源到什么程度?

这大概是这个项目最让开发者兴奋的部分。

模型权重:Hugging Face 上已经放出了 UI-TARS-1.5-7B,Apache-2.0 协议。采集时有 545 个点赞、超过 2.9 万次下载。

代码仓库:GitHub 上两个核心仓库——UI-TARS(模型)和 UI-TARS-desktop(桌面应用)——都是 Apache-2.0 协议。

论文:arXiv 可直接访问。

▲ UI-TARS-1.5-7B 模型卡,Apache-2.0 协议,基于 qwen2_5_vl 架构

相比之下,Anthropic 的 Computer Use 是商业 API,OpenAI 的 Operator 需要付费会员——字节这次把论文、模型权重、桌面应用一起推出来,在开源力度上确实走得更远。

中文开发者社区也注意到了这一点。X 上有开发者评论说字节在 GUI 理解方向一直有积累,豆包手机也用了类似的底层技术;也有人直接说「开源诚意拉满,但真正考验的是生态和安全性」。

别高兴太早:风险和限制都写在 README 里

官方自己在 UI-TARS 仓库的 Limitations 里列了四个问题,每一条都值得认真对待:

误用风险(Misuse):模型能执行 GUI 任务,理论上也能处理认证挑战——也就是说,它可能被用来做你不希望 AI 做的事情。权限控制、操作审计、沙箱隔离,在部署前必须到位。

算力需求(Computation):「开源免费本地跑」听起来很美,但实际运行需要模型推理服务、足够的显存和算力。7B 模型对消费级硬件来说已经有一定门槛,72B 就更不用说了。所谓「免费」只是指代码和权重不收费,运行成本另算。

幻觉问题(Hallucination):模型可能误描述界面内容、错认 GUI 元素、选择次优操作。想象一下,它把「删除」按钮认成了「确认」——在无人监督的情况下,这类错误的后果可能很严重。

模型规模限制(Model Scale):当前开源的 7B 版本没有专门针对游戏场景优化。不同版本之间的能力差异需要用户自己评估。

▲ VentureBeat 2025 年 1 月报道:ByteDance's UI-TARS can take over your computer

AI 从对话框走到操作系统:这个方向已经不可逆了

把 UI-TARS 放到更大的背景里看:

OpenAI 有 Operator,Anthropic 有 Computer Use,开源社区有 Browser Use、Midscene……所有人都在押同一个方向——让 AI 从「给你答案」变成「替你操作」。

UI-TARS 在这个赛道里的特殊之处在于:ByteDance 同时公开了论文、模型权重、GitHub 仓库和桌面应用,给了开发者一条完整的从模型到产品的路径。这种「全套开源」的做法,在 GUI agent 赛道里目前还比较少见。

但「能操作电脑」和「能安全可靠地操作电脑」之间,隔着的东西太多了——权限管理、操作确认、日志审计、误操作回滚、数据隐私保护……每一项都是工程上的硬仗。

现在模型已经证明了「看屏幕、动鼠标」在技术上可行。接下来的问题是:谁能把这个能力做到真正可信赖?

这场比赛才刚刚开始。

— END —

夜雨聆风

夜雨聆风