护士每天要做2000个决定,AI能接住多少个失误?

医院里最容易出错的地方,不是手术室,而是护士站。每一次发药,都是一次微型决策。累积疲劳、相似药名、嘈杂环境——任何一个因素叠加,都可能让一颗本该救命的药变成威胁。AI正在悄悄改变这个链条,但方式和你想的不一样。

先说一个让人不舒服的数字:美国每年因用药差错导致的死亡人数,超过7000人。这还只是被统计到的。更多的差错被「无害」地化解了——护士在最后一秒发现剂量不对,药剂师拦住了一张模糊的处方,或者纯粹是运气好。整个医疗系统,其实一直在靠人类的临时反应来兜底。

错误从来不是粗心,而是系统性的

大多数人理解用药差错的方式是错的。我们习惯把它归结为「护士不够认真」或者「流程不规范」,但研究医疗差错的学者詹姆斯·瑞森早在1990年代就指出:差错不是人的失败,是系统的漏洞。护士一个班次下来要发药几十次,每次都要核对药名、剂量、患者信息、给药途径。这是在高噪音、高打断率的环境里重复执行精密操作——人类大脑根本没有为这种场景进化过。

更麻烦的是,医院里的药名陷阱多到离谱。「氯化钾」和「氯化钠」,「胰岛素」和「胰岛素类似物」,还有那些只差一个字母的英文药名——LASA(看起来像、听起来像的药物)在美国FDA的数据库里有数百对。一个疲惫的护士,在凌晨三点,面对一张字迹潦草的纸质医嘱,出错的概率不是道德问题,是统计问题。

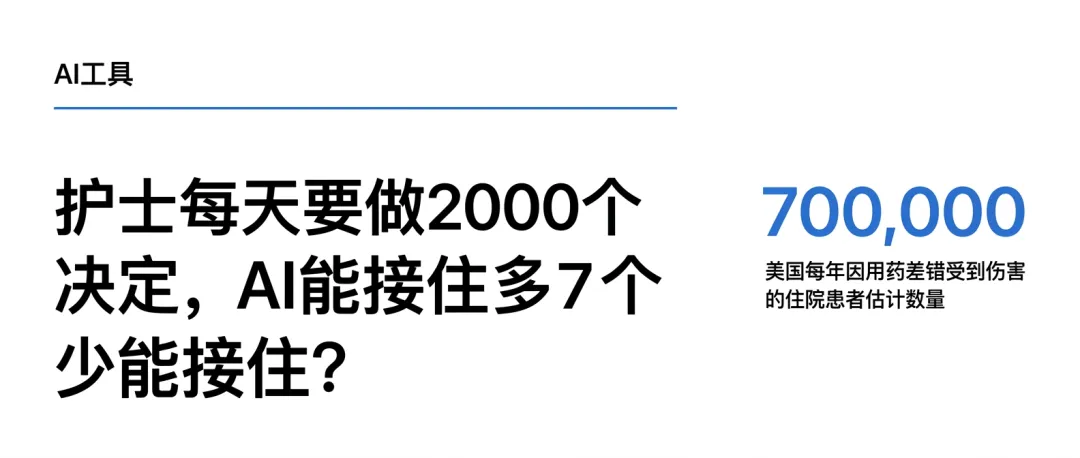

700,000

美国每年因用药差错受到伤害的住院患者估计数量

AI切入的是「最后一道闸」

现在AI进来了,但它进来的位置很有意思。它没有试图重新设计整个医嘱流程,而是插在了「护士准备发药」和「药物进入患者身体」之间这个最后的节点。具体来说,目前落地最广的几类AI工具在做这些事:

1智能条码核验系统:扫描药物和患者腕带,实时比对电子医嘱,不匹配就报警——这不新鲜,但AI让它从「规则匹配」变成了「语义理解」,能识别医嘱里的缩写歧义

2临床决策支持(CDSS):在医嘱录入阶段就介入,自动检测药物相互作用、过敏史冲突、剂量异常,相当于给每张处方配了一个不会疲倦的审核员

3自然语言处理解析手写医嘱:把潦草的手写字或语音医嘱转成结构化数据,减少「看错字」这类低级但致命的失误

4护士工作负荷预测:通过排班数据和历史差错记录,预测高风险时间窗,提前调配人力——这是在用数据对抗疲劳

这里有个关键洞察值得停下来想:AI做的不是替代判断,而是降低判断的认知成本。护士的专业判断没有被取代,但她不再需要用大脑的有限带宽去记住「这两种药不能同时用」或者「这个患者对青霉素过敏」。认知负担卸掉了,专业判断反而能更好地发挥。

「

让人犯错的,往往不是难题,而是在疲惫中处理简单重复的事

」

真实效果:数字背后的逻辑

有研究显示,引入智能药物管理系统(BCMA+CDSS组合)的医院,用药差错率可以下降50%到80%。但这个数字需要一点校准:降低的主要是「可拦截差错」——即在药物到达患者之前还能被发现的那类。对于已经发生、只是没被及时察觉的差错,AI目前帮助有限。

另一个容易被忽略的维度是:AI系统引入初期,往往会带来「警报疲劳」。系统太敏感,频繁误报,护士开始习惯性点「忽略」——这反而制造了新的风险。一个设计糟糕的AI提醒,比没有提醒更危险,因为它训练了人类的忽视反射。所以真正有效的AI工具,不是「提醒最多的」,而是「误报率最低的」。

50%

引入智能核药系统后,多项医院研究报告的用药差错下降幅度下限

护士在这件事里的真实处境

有一个视角在讨论AI医疗时经常被跳过:护士怎么看这件事。技术媒体喜欢讲「AI赋能」,但一线护士的反馈更复杂。有人觉得终于有了一个不会累的搭档;也有人觉得多了一个随时可能误报、还得解释给患者听的麻烦;还有人担心——如果AI说没问题,出了事算谁的?

这个问题不是矫情,是真实的责任边界困境。目前大多数医院的法律框架里,AI是辅助工具,最终责任仍在人。这意味着护士既要信任AI的判断来减轻自己的负担,又不能完全依赖它而放弃独立核查。这种「半信任」状态,本身就是一种新的认知负担。如何设计人机协作的责任边界,是技术之外更难解决的问题。

医疗AI的叙事里,最性感的永远是诊断癌症、预测病情。但真正影响最多人、每天在静默发生的,是护士站那些微小的、重复的、容易出错的决定。AI在这里能做的事,不是让医疗变得更聪明,而是让它变得更不容易出错。这两件事听起来像一回事,其实方向完全不同。前者是进攻,后者是防守。而在医疗这个领域,防守的价值从来都被低估了。

✦ 小结

用药差错的根源是系统漏洞,不是人的粗心。AI切入的是发药前的最后一道闸——通过降低判断的认知成本来减少失误,而非替代专业判断。有效的AI工具不是提醒最多的,而是误报率最低的。技术之外,人机责任边界的设计,才是这场变革里最难啃的骨头。

夜雨聆风

夜雨聆风