点击下方,关注后台回复【666】,免费领取【AI学习礼包】

大家好,我是陈凡。

最近真的是被烦透了,就在我刚刚把4月份出的最新模型在团队中宣讲普及后还没完全推广,没想到5月份还要来一批更炸裂的模型,AI大厂的火拼程度真的是要把人脑袋打成狗脑袋的节奏。

本来我的团队不大,算上我也就十个人,一个产品、一个测试、一个运维,剩下都是全栈,在我们这个三线城市,已经算配置不错了。

但最近三个月,我这个10人小团队被一件事搞得够呛。

废话不多说,我们先捋顺一条大模型发布的时间线,你看完你就知道我在说什么。

所以上一个模型你还没搞懂捂热,下一个就怼到你脸上!你以为这就完了?

马上下周,5月19日到20日,Google I/O 2026召开,Gemini 4将正式亮相。

果不其然,X上已经炸了。

Gemini 3.1 Pro才出了三个月,Gemini 4又要来了,同时DeepSeek V4 在六月也要会跟进,还有传言说GPT-6已经完成预训练。

是不是已经开始焦虑了?上个月刚把工作流切到Claude Code,下周Gemini 新版本出来是不是又得换?六月DeepSeek V4 更新了,再换?

别说我们这10人小团队了,如果没人定的了,还会被大厂牵着鼻子跑!不是不想追新模型,也不是追不起,是中小团队到底该怎么在大厂疯狂的模型迭代浪潮下,站住脚,稳下身,稳步提升,不被甩下车,也不被拖死。

模型迭代快到你的选型决策还没落地就过期了

先帮你算笔时间账。从2月到现在三个半月,上面的表格你已经看到了——14次重要发布,12家大厂轮番登场。

三个半月,14次模型迭代。平均每周一次。

有人算过一笔账:从调研一个新模型、配置环境、写Rules、团队成员上手、到真正能在项目里稳定产出,至少两周。等你跑通了,下一个更强的模型又发布了。你永远在换工具,从来没真正用工具干过活。

这还是技术团队。如果是中小企业,团队里还有前端、有初级开发、有非技术管理者,切换成本再翻倍。

追模型不是进步,是内耗。

团队不是追不起,是无法积累

有人会说,模型更强了不是更好吗,免费升级你焦虑什么?

如果你是一个人开发,确实。每个新模型出来试试,顺手就切过去,不顺手就不动。

但团队不是这么算的。

我给你讲个真实的事。上个月我团队有个后端任务需要长上下文理解,当时Claude Opus 4.7刚出来,有同事说"陈凡咱们是不是切到Claude?SWE-bench最高。"

我说先不切,继续用CodeBuddy。

不是因为CodeBuddy模型更强,是因为我们团队的Rules、Skills、Spec文档已经全在CodeBuddy里磨合了两周了,每个人都知道怎么用。切Claude Code意味着把所有协作流程重新搭一遍,两周白费。

后来那个任务用CodeBuddy做完了。比预期的多花了一点时间,但团队节奏没乱,交付没延期。

中小团队的核心资产不是"最强的模型",是已经跑通的协作流程。你每次追新模型,都是在把自己的流程资产清零重来。

而且还有一个更隐蔽的成本:团队疲劳。一个成员的AI工具被换了三次,他下次就不会认真学新工具了,因为他觉得"反正过两周又换"。

这种心态一旦蔓延,AI编程在团队里就彻底推不动了。

别把模型和流程绑死

那怎么办?总不能永远用落后模型吧?

当然不是。关键是模型和流程解耦。说干就干,我把这个思路叫"模型无关"的AI编程流程。

原理不复杂。模型只是一个执行层,可以随时替换。但上面真正值钱的东西,是你团队积累的三样资产:

Spec(规格文档):不管什么模型,先写清楚功能要做什么、边界在哪、怎么验收。proposal.md + specs/ + design.md + tasks.md,这套文档跟模型型号没关系,换个模型照样用。

我会在后面两篇精讲,这里就不展开了。

Rules(团队规范):编码标准、安全要求、命名约定、测试覆盖率,写进Rules文件。新模型接入,第一件事不是让它写代码,是让它先读Rules。规范是你的,模型只是执行者。

Skills(技能库):架构师Skill、DBA Skill、全栈开发Skill,是你的方法论,不是模型的。发动机可以换,方向盘不能换。

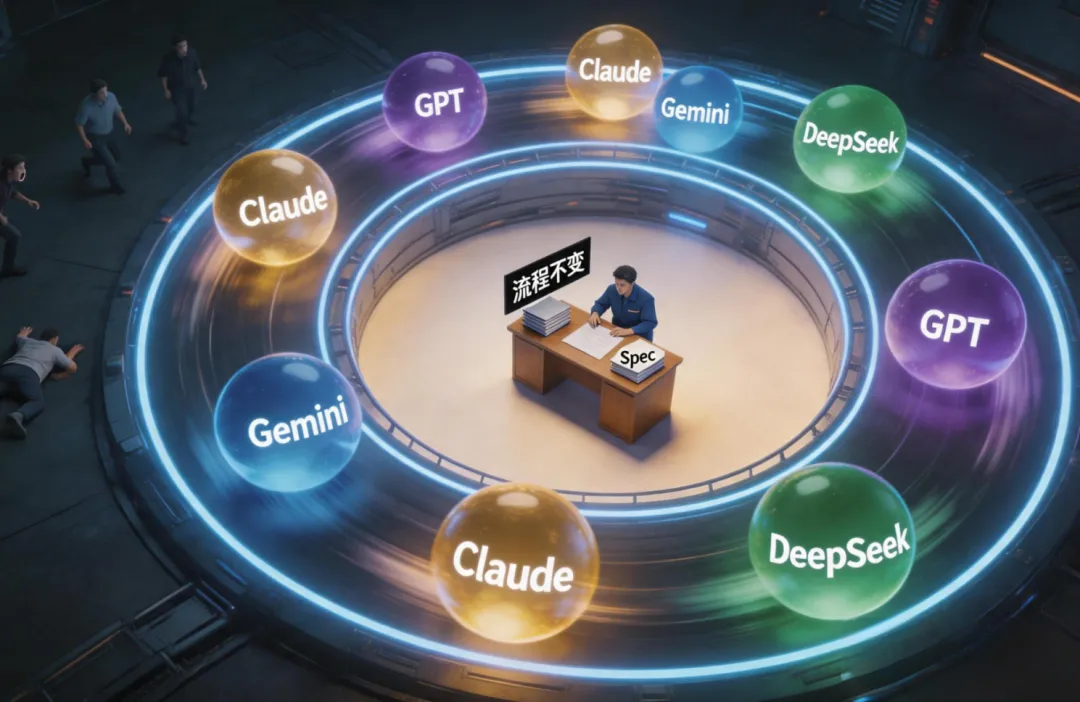

模型是这三样下面垫着的东西。Claude也好,Gemini也好,DeepSeek也好,可以横向对比一下分数,上下差不了几分的就别纠结了他就是一个干活的。今天谁干得好用谁,明天更强的来了换它。但活怎么干、标准是什么、谁来验收,你说了算。

举个真实例子,2月Gemini 3.1 Pro发布后,我在自己机器上测了一下。但我不是把团队流程切过去,而是只在Spec Coding的"实现阶段"换了模型:同一个Spec文档分别喂给Gemini和Claude,对比代码质量。

试完心里有数了,什么场景Gemini更好、什么场景Claude更稳,但我团队日常的工作流一动没动。

模型在变,流程不变。这就是解耦。

别慌,三件事你现在就能干

一、下个需求,先写Spec再写代码。

别上来就让AI写,AI可以辅助,但你得花20分钟检查和补充proposal.md和specs/,写完你会发现一个惊喜:很多需求本身的模糊点在写Spec的时候就暴露了,根本就等不到编码阶段才发现。

这套Spec你存着,过两个月换模型,同样一份Spec喂进去,直接对比两个模型的实现质量。这才叫追模型。

二、把团队规范整理成一份Rules。

AI编程时代到来的就意味着,咱以后和团队说任何事情都别口头约定,一定要把结果写下来,不管是手写还是用AI方式辅助记录。比如SQL参数化、权限验证、错误处理、命名规范,每条一句话都要融入到规约当中。

以CodeBuddy为例,当放进的Rules配置以后,不管底层模型是大厂还是开源,生成代码前都会自动读规则。我团队Rules大概40条,半天写的,写完安全感大增,因为知道不管AI用什么模型,底线不会被突破。

三、建一份你自己的模型评测清单,别看排行榜。

排行榜告诉你谁最强,评测清单告诉你谁最适合你的场景。把你的任务分三类:简单CRUD、复杂业务逻辑、系统重构。同一个Spec找不同模型各跑一遍,自己打分。

我上个月用这方法测了三个模型,结果跟公开榜单差异巨大,有个榜单排名靠后的模型,在我们团队的Java代码场景下反而最好。因为公开榜单测通用能力,你测的是你场景的实战能力,完全两码事。

大厂负责放烟花,你负责盖房子

下周Gemini 4登场。DeepSeek V4.1六月来。GPT-6已经完成预训练。

大厂会继续扎堆发新模型。每一个都宣称比上一个强。每一次都让你觉得"是不是该换了"。但你的10人小团队不是评测实验室,是要交付业务价值的。

说句大实话,我这10人团队的解法就八个字:模型随便换,流程永远不变。

Spec写好了,换什么模型都不怕。Rules定好了,什么模型都得按你的规矩来。Skills攒够了,模型只是你工具箱里的一把扳手。

大厂负责放烟花,你负责盖房子,烟花看完就散,房子得住一辈子。

模型会过时,Spec不会,排行榜会变,流程不会。

我是陈凡,16年全栈开发,现在专注AI编程出海。

哪些AI工具真的值得付费,我会持续实测对比。关注我,不踩坑。

如果你想了解这三个模型的具体使用场景和对比测试,关注公众号【陈凡AI编程】,回复"V4对比",我整理了一份详细的使用场景对照表。

扫码

链接我领礼包

夜雨聆风

夜雨聆风