19000+ Star 的视频增强神器,把模糊老片直接拉回高清时代!

很多人都有这种时刻:翻出一段老视频,内容很珍贵,但画面糊得像打了马赛克。

想拿来做剪辑、做展示、甚至只是自己重温一下,结果一放大就惨不忍睹。

更难受的是,普通拉伸只会把糊放大,根本不是变清晰。

Video2X

今天想聊的这个项目叫 Video2X。你可以把它理解成视频领域的高清修复器:不是简单把 480p 拉成 1080p,而是借助多种 AI 超分辨率引擎,把视频逐帧增强后再重新合成。

它最吸引我的地方,是把原本偏专业、偏折腾的一套流程,尽量做成了普通人也能上手的工具。

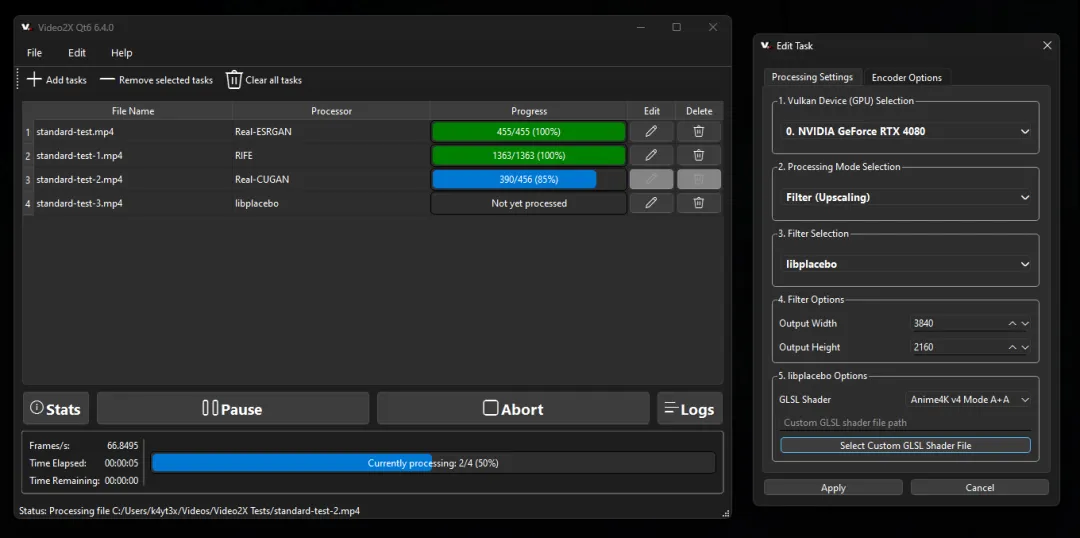

它的界面也很直观,典型桌面工具风格:左边选输入视频,右边设置放大倍数、输出格式、编码参数,底层调用不同增强引擎去跑。

对很多不想碰复杂命令的人来说,这一步就已经很友好了。

先说最核心的一点:它不是单一算法,而是一个统一调度平台。

很多人以为视频增强就是选一个模型点开始,其实真正麻烦的是模型环境、逐帧拆分、处理、编码、音视频合并这一整套链路。我做这个工具时,思路就是把这些脏活累活全包了,用户只需要决定你想放大多少、想用哪种后端。

比如常见的使用方式非常直接:

video2x --input input.mp4 --output output.mp4 --scale 2如果你不想只追求倍数,而是更在意画质、速度、显存占用,就可以切换不同后端。

Video2X 支持接入多种超分辨率方案,像 Waifu2x、RealSR、SRMD、Anime4K、Real-ESRGAN 等都能纳入同一工作流里。

它像一个视频增强的总控台,你不用为每个模型单独研究一遍环境和流程。

第二个很强的点,在于它处理的不是图片 demo,而是真实视频工作流。

很多项目展示一张前后对比图,看起来惊艳,但一到视频就开始掉链子:音轨没了、编码崩了、帧率乱了、字幕出问题了。

Video2X 的思路就很实用,先拆帧,再增强,再编码封装,尽量保留一条完整可落地的生产路径。

举个很典型的场景,你有一段旧动画、游戏录像、监控片段,原始分辨率太低,直接拿去二次创作会很吃亏。

这时候我会先做一遍超分,再按需求导出成 H.264、H.265 这类常见格式。

它能配合 FFmpeg 这类工具链工作,所以并不是那种只能跑个玩具效果的项目。

有些用户尤其喜欢拿它修复老番、老游戏 CG、早年录屏内容,这种素材往往边缘发虚、压缩痕迹重、线条发糊。

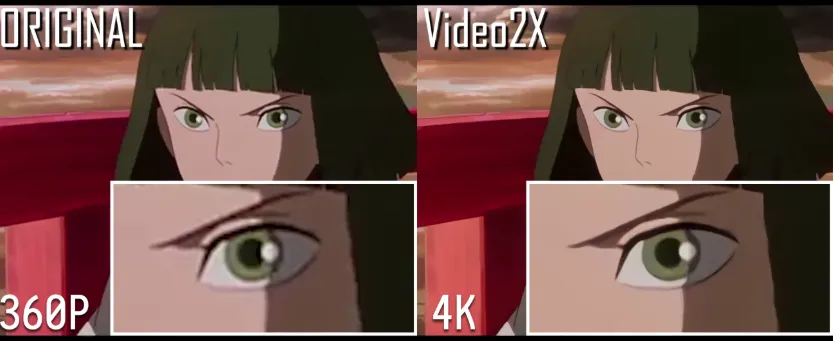

对这类内容,基于 AI 的逐帧增强通常比普通双三次插值要强太多。简单说,普通放大是把糊变大,Video2X 更像是试图把丢掉的细节重新补回来。

第三个让我挺认可的地方,是它尽量降低了高门槛工具的使用成本。

Video2X 本身考虑得比较完整,围绕 Windows 桌面用户做了较成熟的体验,文档里也给了比较清晰的安装和依赖说明。

对新手来说,最重要的不是理解所有模型原理,而是先能跑起来。

如果你偏命令行,也可以走纯 CLI 流程;如果你更习惯图形界面,那直接用桌面端会更省心。像下面这种配置思路就很常见:

video2x \ --input old_video.mp4 \ --output old_video_upscaled.mp4 \ --scale 2 \ --driver realesrgan当然不同后端适合的内容并不一样。动漫线稿、真人视频、游戏画面、低码率录屏,它们对模型的偏好差别很大。

也正因为这样,一个能灵活切换后端的平台,价值就一下子出来了。你不需要因为素材类型变了,就把整套工具链推倒重来。

第四个是它在 GitHub 上持续被关注的原因:需求非常刚,而且效果足够直观。

这不是那种概念很酷但普通人没机会用上的仓库。你拿一段十年前的模糊视频,增强前后往那一摆,谁都能看懂价值在哪。

如果你是视频剪辑爱好者、做自媒体的内容创作者、做怀旧向素材修复的人,或者你手里有一堆低清录像、老课程、旧游戏录屏,Video2X 都值得你试一下。

尤其是那些原素材无法重拍、无法重新获取的内容,这种工具的价值会被无限放大。

如果你是动漫党,它也很有吸引力。很多人会专门用它处理老动画资源,因为线条类内容在合适模型下往往提升非常明显。

要是你是做 AI 影像工作流集成的开发者,也可以把它看成一个现成的能力模块,接到你自己的媒体处理管线里。

开源地址:https://github.com/k4yt3x/video2x如果你也对这类前沿开源项目感兴趣,想第一时间看到真正有潜力的 GitHub 热门项目解析,关注本公众号。

后面我还会继续挖更多值得收藏、值得实操、值得思考的开源好东西。

夜雨聆风

夜雨聆风