Claude 源码泄漏了?一场关于 AI 时代信任危机的深度推演

如果有一天,Anthropic 的核心代码突然出现在 GitHub 上

这不是科幻小说的开头,而是一个值得认真对待的假设性问题。让我们沿着这条线往下想。

首先要厘清一件事:Claude 并不是一段可以打包带走的程序。它的”智能”来自于数以千亿计参数构成的神经网络权重——那是一个动辄数百 GB、甚至 TB 级别的巨型数字矩阵,不是几行 Python 脚本。训练它花掉的算力,换算成普通消费级显卡,大概要跑几百年。所以当我们说”Claude 源码泄漏”,大概率指的是以下几种情形之一:

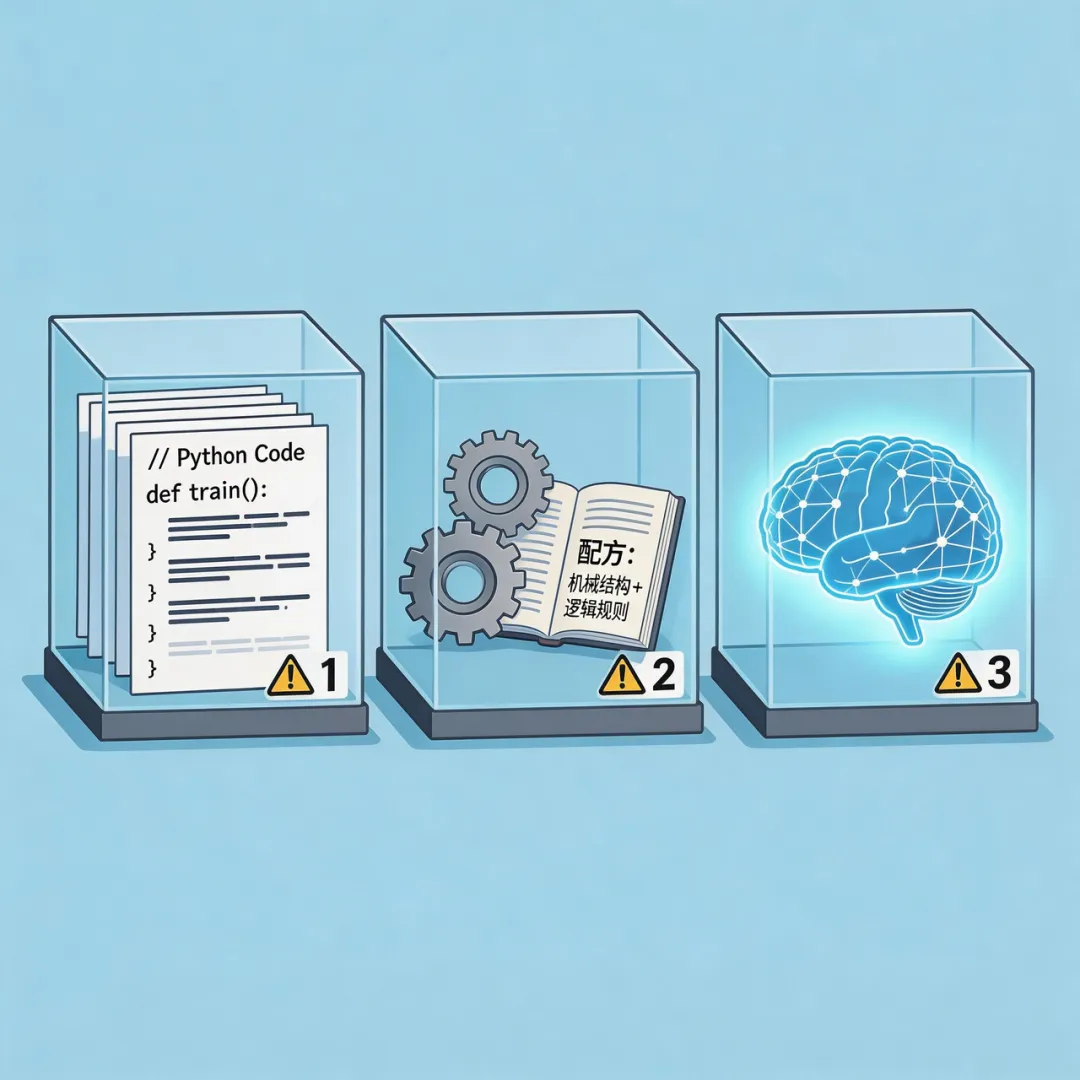

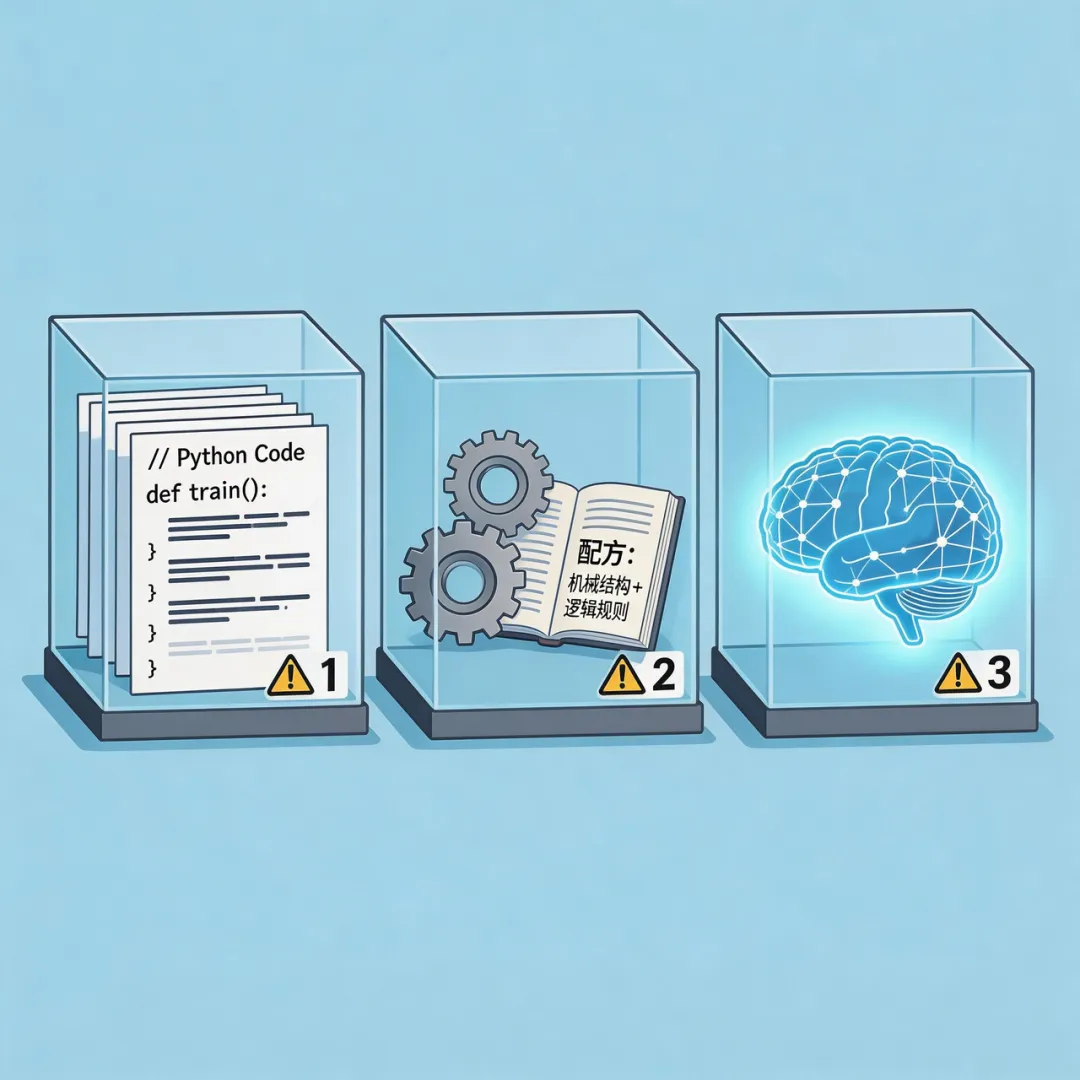

情形 A:推理代码泄漏 即驱动 Claude 对话的工程代码——系统提示词(System Prompt)的结构、安全过滤器的逻辑、上下文窗口管理机制等。这些虽不含”智能本体”,但会完整暴露 Anthropic 如何控制和约束这个模型。情形 B:训练代码泄漏 包括训练框架、RLHF(人类反馈强化学习)流程、数据配方等。竞争对手拿到后,相当于获得了一份”怎么做出同款蛋糕”的食谱,差的只是食材(算力和数据)。情形 C:模型权重泄漏 这是最严重的情形——Claude 本身被打包下载。任何人都可以在本地部署、修改、去除安全限制,然后用于任何目的。这三种情形,危害程度依次递增,但发生概率大致相反。

这不是纯粹的脑洞。2023 年 3 月,Meta 的 LLaMA 模型权重在 4chan 上被公开分享,随后蔓延至 BitTorrent。Meta 原本只向研究机构定向开放,结果几天之内,全球任何人都可以下载一个接近 GPT-3.5 水平的语言模型在自己电脑上运行。2023 年 5 月,一份据称来自谷歌内部的备忘录在网上流传,坦言开源模型正在以谷歌和 OpenAI 都未曾预料的速度赶上商业模型。2024 年,各类”越狱版”、”去审查版”模型在 HuggingFace 和 Reddit 上以惊人的速度涌现,其中不少基于合法开源模型的二次修改,专门用于绕过安全限制。Claude 的权重目前是完全私有的。但”完全私有”从来不等于”绝对安全”。

普通用户:短期内几乎感受不到你日常用的 claude.ai 运行在 Anthropic 的服务器上,那套基础设施不会因为代码泄漏而崩溃。你的聊天记录依然是你的,对话体验短期不会有变化。

Anthropic:商业护城河受损这家公司的估值建立在”我们知道如何训练最安全、最智能的模型”这个核心叙事上。如果训练代码被竞争对手完整复制,知识优势会被大幅压缩。更糟的情况是,投资人信心动摇,融资节奏被打乱——在这个烧钱速度极快的行业,这几乎是致命的。AI 安全社区:可能是最担忧的群体Claude 的安全机制(Constitutional AI,宪法 AI)是 Anthropic 的核心研究成果,用来防止模型产生有害输出。一旦这套机制的细节被完整暴露,”逆向工程”绕过它的难度会急剧降低。那些想用 AI 生成诈骗文案、操控舆论、辅助网络攻击的人,会得到一张详细的”如何绕过安全阀”说明书。竞争对手和开源社区:意外受益者中国、欧洲、以及各类独立研究团队,可能会在一夜之间缩短与美国顶级 AI 实验室数年的技术差距。这在政治上极度敏感,很可能直接触发美国政府对 AI 出口管制的进一步收紧。四、Anthropic 会怎么应对法律层面:立刻启动 DMCA 删除程序,要求 GitHub、HuggingFace 等平台下架。但在去中心化网络(BT、IPFS)面前,法律手段的效率极为有限。一旦文件扩散,基本不可能从互联网上彻底抹除。技术层面:如果是推理代码泄漏,Anthropic 可以快速更换系统架构、修改接口设计,让泄漏的代码失效。但如果是模型权重,则几乎无解——权重本身就是信息,无法被”作废”。公关层面:这是真正的考验。Anthropic 的核心品牌主张是”负责任的 AI 开发”。一次重大安全事故,哪怕是内部人员失误导致的,也会严重削弱这个叙事的可信度。监管层面:美国 AI 法规尚不成熟,但欧盟 AI Act 已经生效。如果泄漏被认定为”重大安全事件”,Anthropic 在欧洲市场的合规处境将极为被动。五、更深的问题:我们应该担心什么表面上,这是一个关于企业机密保护的故事。但往深处看,它触及了一个 AI 时代最根本的张力:越强大的 AI,其安全机制就越需要严格保密;但越保密,公众就越难以验证那些安全保证是否真实可靠。Anthropic 说 Claude 是安全的、有价值观的、会拒绝帮你做坏事。但这套机制的具体实现,从来都不对外公开。我们只能相信这家公司的信誉——以及他们偶尔发布的研究论文。如果源码泄漏,我们也许会发现这套机制比想象中更精密,或者……比想象中更脆弱。两种情形,都值得认真对待。

今天是 2026 年 4 月 1 日。Anthropic 的服务器一切正常,Claude 照常回答你的每一个问题。但”从未发生”不等于”不会发生”。在这个算力就是权力、代码就是资产的时代,如何保护 AI 系统的核心,同时不让安全成为掩盖问题的幌子——这个问题,没有简单的答案。