Claude Code 源码泄露给企业什么启示?再谈 Harness Engineering

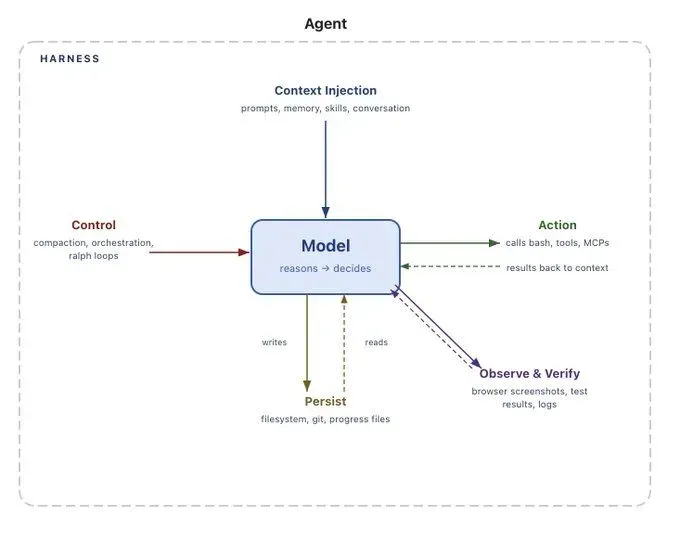

最近 Claude Code 源码泄露在开发者社区引发大量讨论。很多人关注的是权限机制、记忆结构甚至所谓的“彩蛋功能”,但真正值得认真看的,其实是另一件事:Claude Code 展示了一套成熟的 Agent runtime,也就是围绕模型构建的 Harness。

Harness Engineering 关注的不是如何让模型回答得更好,而是如何让模型持续参与真实任务。它涉及记忆结构、权限控制、上下文压缩、多 Agent 协作与后台执行机制等一整套系统能力。随着模型逐渐成为公共基础设施,越来越多企业开始意识到,真正决定智能深度的,不再是模型参数规模,而是系统如何组织模型能力。

Claude Code 的意义,正在于它把这种变化第一次完整暴露在工程层面。

*LangChain, The Anatomy of an Agent Harness https://blog.langchain.com/the-anatomy-of-an-agent-harness/

从 Prompt Engineering

到 Harness Engineering

-

最早是 Prompt Engineering,人们尝试通过语言优化提升输出质量。 -

随后是 Context Engineering,通过引入更多组织信息,让模型理解业务语境。 -

而 Harness Engineering 进一步推进了一步:它关注的是如何构建一个运行环境,让模型成为任务执行网络的一部分,而不是一次性回答机器。

当我们在企业场景中谈

Harness Engineering

真实企业工作很少是一次响应可以完成的。

理解市场趋势、制定产品策略、协调品牌表达、验证用户反馈,这些任务通常涉及多角色协作、多轮判断,以及不断变化的信息输入。

如果模型只是回答问题,它仍然停留在辅助层。

Harness Engineering 的意义在于,把模型转化为参与工作流程的一部分。这通常体现为三个变化。

-

模型开始围绕目标运行,而不是围绕问题运行。

-

推理过程可以被拆解、组合与复用,而不是一次性生成。

-

不同模型能力被组织成协同网络,而不是孤立调用。

当这些能力结合在一起,AI 才真正进入企业经营结构内部。

Harness Engineering

如何改变智能体系统的结构

在智能体系统设计中,Harness Engineering 通常表现为三类关键机制。

第一类是任务拆解机制。复杂目标被分解为多个可执行子路径,并动态选择执行顺序。

第二类是模型编排机制。不同模型根据能力边界承担不同角色,例如推理模型负责判断路径,生成模型负责内容表达,多模态模型负责理解视觉或视频信号。

第三类是上下文驱动机制。系统不再依赖即时输入,而依赖长期积累的组织知识进行决策。

这些机制共同构成了智能体系统的大脑结构。

例如在特赞的 GEA 架构中,Creative Reasoning Model 负责路径发散与任务编排,而 Context System 提供统一的企业知识来源,使模型能够理解品牌策略、历史决策逻辑与用户结构差异。在这样的体系中,模型不再只是执行者,而成为判断网络的一部分。

从模型能力竞争

走向系统能力竞争

一个重要趋势正在形成。

随着 GPT、Claude、Gemini 等模型逐渐成为公共基础设施,单一模型优势正在快速缩小。企业真正的差异来源,开始转向系统如何组织模型能力。

Harness Engineering 的价值正体现在这里。

它让企业可以:把多个模型组合成持续运行的能力体系,把一次性生成结果转化为长期决策能力,把零散工具连接为统一工作结构。

这也是为什么越来越多企业级智能体架构开始强调 orchestration、context、agent skills 等系统层能力,而不是单纯强调模型性能指标。

从技术路径来看,这种变化类似于软件工程历史上的一次重要迁移:能力从函数级调用,转向系统级调度。

Harness Engineering 与企业级智能体的现实落地

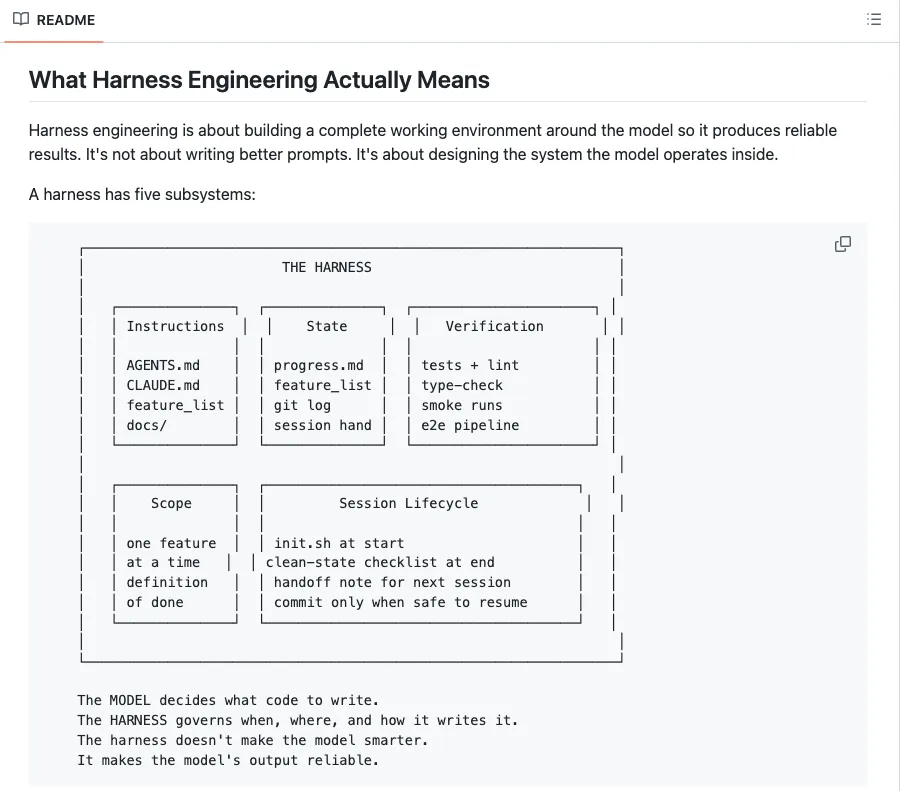

如果把 Harness Engineering 理解为一种工程方法,它最终指向的是一个更具体的问题:AI 如何持续参与业务,而不是偶尔提供建议。

在实践中,这通常意味着三件事同时发生。

-

系统能够理解目标,而不是等待指令

-

系统能够调用上下文,而不是依赖即时输入

-

系统能够持续运行,而不是单次生成结果

GEA 这样的企业级智能体架构,本质上就是这种方法的一种实现路径。通过把推理模型、上下文系统与主动执行智能体连接起来,它尝试让 AI 从“回答问题的工具”,转变为“推动业务进展的系统结构”。

这种变化并不来自模型本身,而来自系统如何组织模型。

Claude Code 源码泄露真正揭示的,是 AI 工程正在进入 Harness Engineering 阶段:当模型逐渐成为公共基础设施之后,决定企业智能能力上限的,不再是模型选择,而是运行时结构、上下文体系与任务编排能力。谁能更早构建可长期运行、理解组织语境并持续推动业务结果的智能体系统,谁就更可能在下一阶段的软件竞争中获得优势。

参考资料:

LangChain,The Anatomy of an Agent Harness https://blog.langchain.com/the-anatomy-of-an-agent-harness/

Learn harness engineering:https://github.com/walkinglabs/learn-harness-engineering

夜雨聆风

夜雨聆风