50万行源码意外流出:深度解构 Anthropic 核心 AI 代理的“黑科技”

在全球 AI 竞赛的白热化阶段,一次技术上的“意外”往往能比官方发布会揭示更多的真相。2026年4月1日,原本应是充满玩笑的日子,Anthropic 公司却遭遇了一个极为尴尬且极具教育意义的时刻:其核心 AI 开发工具 Claude Code 的源代码因 npm 注册表中的配置失误(源码映射文件泄露)而意外“开源”。

这并非一次简单的代码片段流出,而是高达 50万行 TypeScript 代码 的全量曝光。对于一直试图窥探顶级 AI 实验室如何构建生产级 Agent(代理)系统的开发者而言,这无疑是“提前到来的圣诞节”。作为行业观察者,我们看到的不仅是 Anthropic 的失误,更是 AI 代理从“对话框”向“全自动生产力工具”进化的精密路径图。

一、资本之巅:OpenAI 的融资神话与增长隐忧

在深入拆解源码泄露之前,我们不得不关注行业巨头 OpenAI 的最新动态。今日,OpenAI 宣布完成了人类历史上规模最大的单笔融资 [1]。尽管其估值达到了惊人的 8520 亿美元,且年经常性收入(ARR)达到 240 亿美元,增长速度远超当年的 Google 或 Meta,但数据背后的阴影依然存在。

- 用户增长瓶颈: ChatGPT 的周活跃用户(WAU)增长似乎已进入平台期,尚未突破其设定的 2025 年底达到 10 亿的目标。

- 资本化路径: 此次融资伴随着某种形式的“软 IPO”,包括来自 ARK Invest 等机构的 30 亿美元投资,这标志着 AI 巨头正在加速向传统资本市场靠拢。

这种规模的资本投入预示着一个残酷的现实:AI 领域的门槛已不再仅仅是算法,而是工程复杂性与算力消耗的综合较量。而这,恰恰在随后曝光的 Claude Code 源码中得到了完美印证。

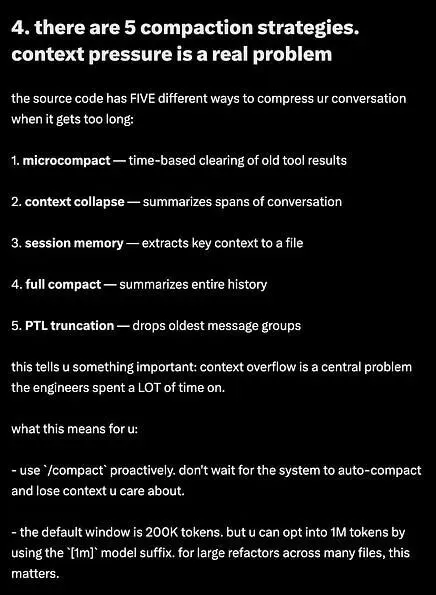

二、解构 Claude Code:Agent 系统的工程护城河

长期以来,业界流传着一种观点:所谓的 AI 代理不过是给模型套了一层“外壳”(Wrapper)。然而,通过对 Claude Code 这 50 万行代码的研究,我们可以断言:顶级的 AI 代理系统本身就是一个极其复杂的软件工程。 它的价值不在于模型本身,而在于如何通过精密的编排逻辑(Harness)来弥补模型的天生缺陷。

1. 三层内存架构:模拟人类的认知深度

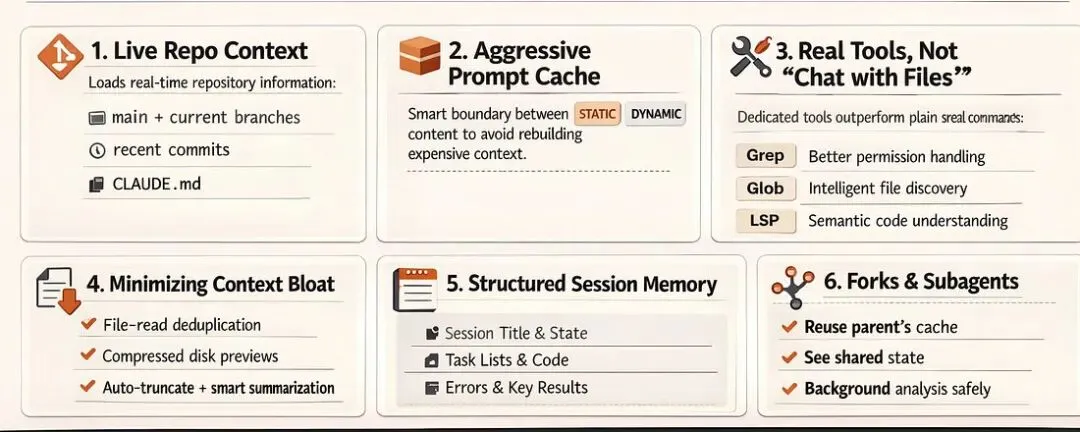

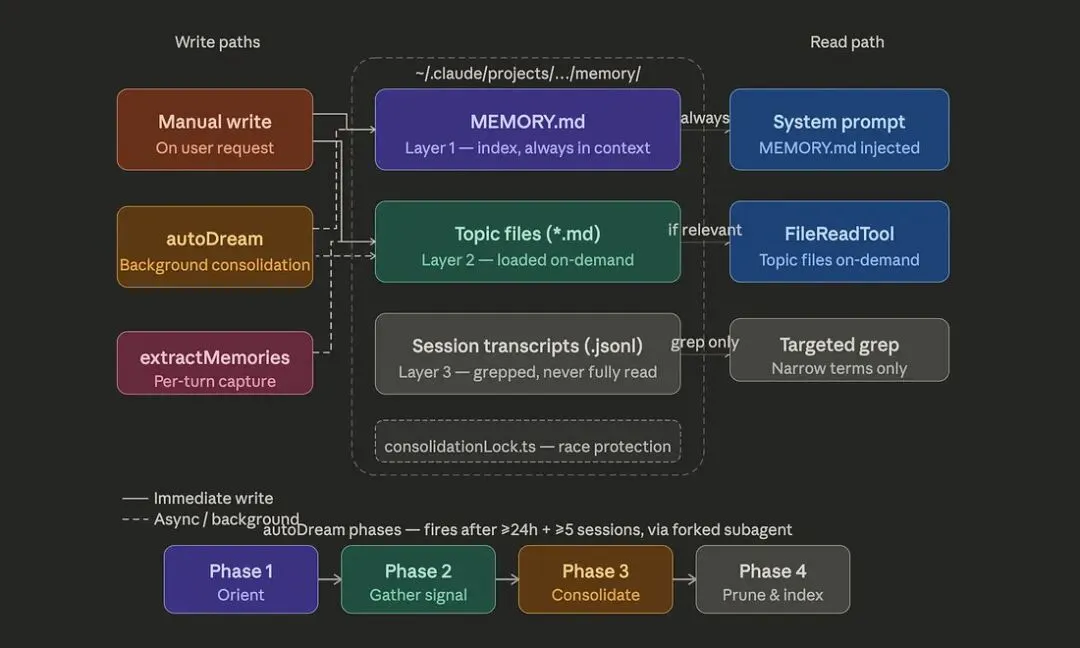

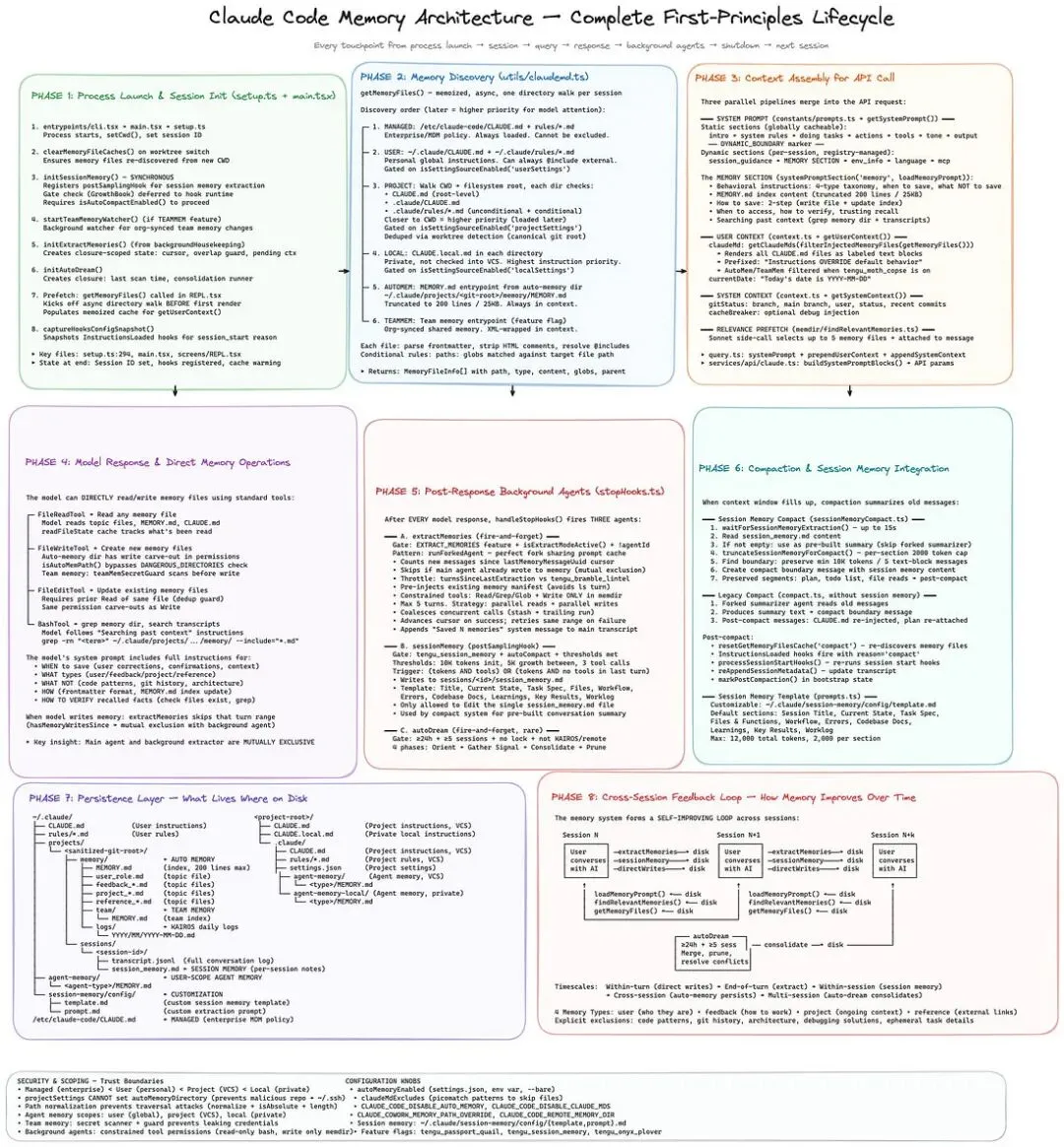

泄露的代码展示了 Anthropic 为 Claude Code 设计的精密内存系统。不同于普通的 RAG(检索增强生成),它采用了类似于操作系统层级的结构:

- 索引层 (MEMORY.md): 作为一个核心索引文件,记录所有其他知识碎片的存放位置。

- 主题层 (Topic Files): 根据任务需求,按需加载特定领域的知识块,减少上下文污染。

- 会话全量转录: 支持对完整会话历史的深度检索,确保代理不会在长任务中“迷失”。

更令人惊叹的是其 “自动梦境”(autoDream)模式。在该模式下,系统会在非活跃时间进行内存清理:合并相似记忆、去除矛盾信息、精简冗余细节。这不仅优化了 Token 使用效率,更在逻辑上模拟了人类大脑在睡眠中巩固记忆的过程。

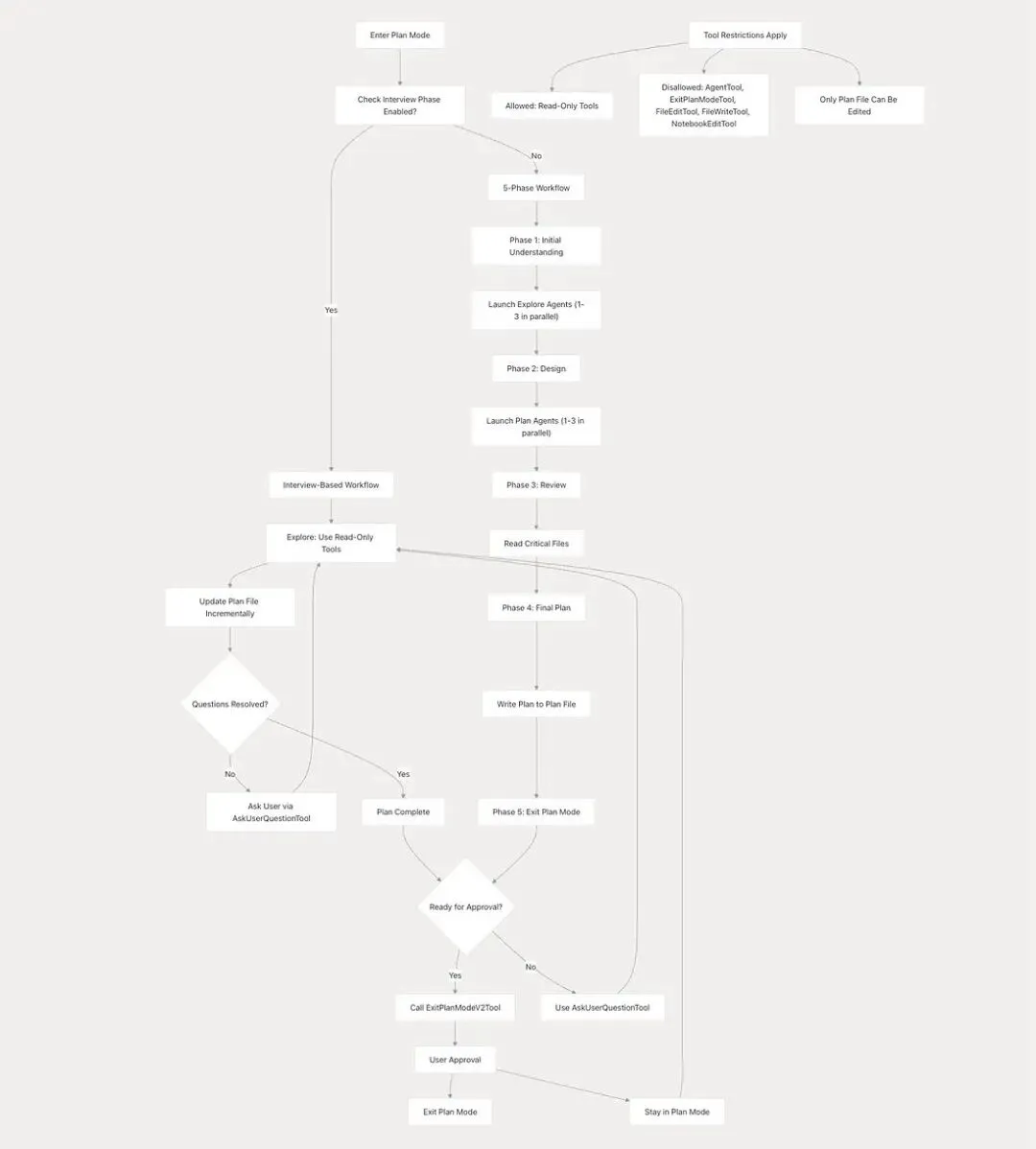

2. 子代理与提示词缓存:将并行效率推向极致

在多代理协作(Multi-agent Orchestration)方面,Claude Code 展现了极高的成熟度。它利用 Prompt Caching(提示词缓存) 技术构建了一个“分叉-合并”(Fork-Join)模型。当主代理派生出多个子代理执行并行任务时,它们共享相同的底层上下文 KV 缓存 [2]。这意味着,在处理复杂工程任务时,大规模并行操作的成本几乎降为零,且不需要重复加载庞大的代码库上下文。

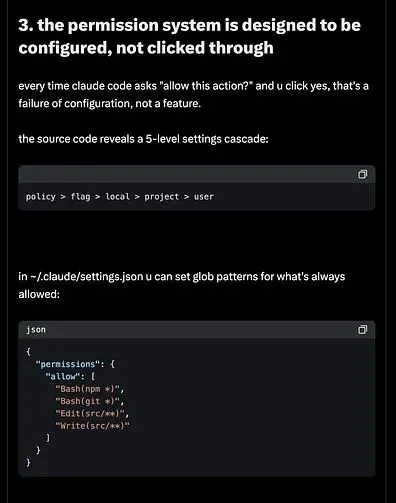

3. 工具箱与权限防御:50 多种预设能力的深度集成

源码中曝光了超过 60 种内置工具,默认启用的近 20 种包括:BashTool、FileEditTool、NotebookEditTool、WebFetchTool 等。为了确保安全性,Anthropic 设计了五层权限验证系统,从只读模式到全自动执行,每一层都设有严格的边界。这证明了在生产环境中,Agent 的安全性不仅靠提示词(Prompting),更靠严密的系统级硬编码过滤。

三、泄露出的“彩蛋”:未发布功能与员工工具

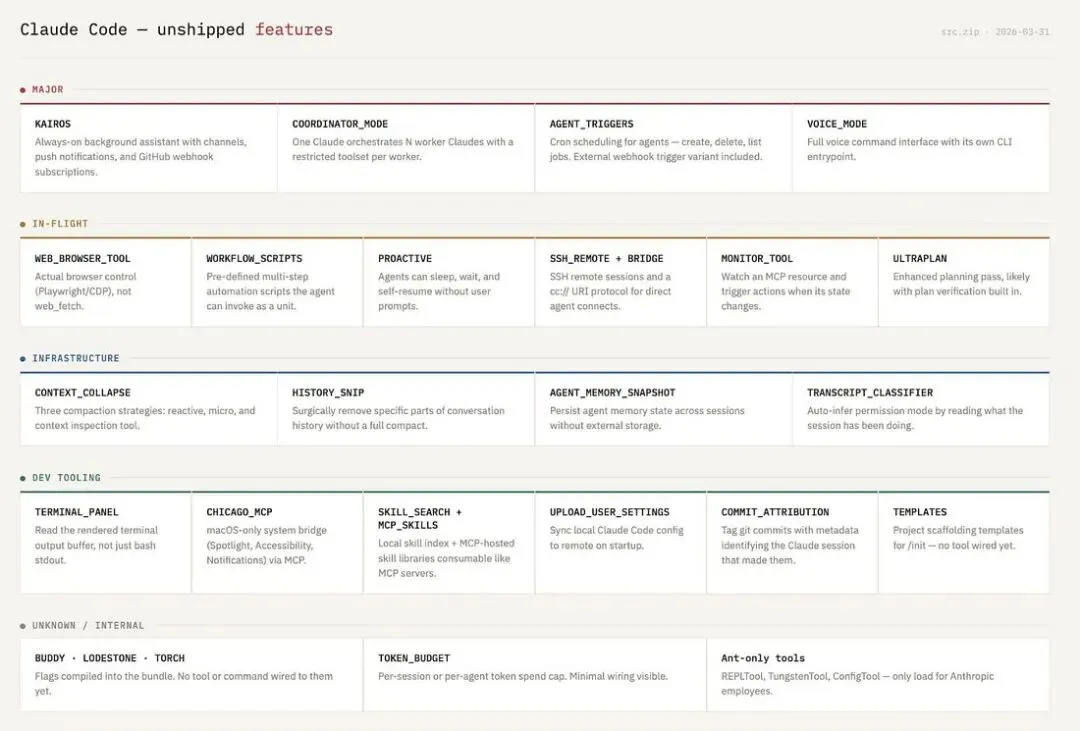

除了严肃的技术架构,源码中还隐藏了许多极具前瞻性的实验功能,预示了 Anthropic 未来的产品方向:

- ULTRAPLAN & KAIROS: 看起来是某种更高级的任务规划引擎,能够处理跨度长达数天的复杂项目。

- AI Pet (/buddy): 一个甚至带有抽卡系统和 ASCII 动画的电子宠物系统。虽然看起来是愚人节彩蛋,但它揭示了 Anthropic 在增强用户交互粘性方面的尝试。

- 员工专用 TUI: 内部名为“Tengu”的项目,包含了更强大的遥测和诊断功能,允许 Anthropic 工程师实时监控代理的思考链路。

-

-

四、连锁反应:供应链安全与竞争格局的重塑

泄露事件发生后,蝴蝶效应迅速蔓延。首先是安全风险:一些黑客迅速在 npm 上注册了诸如 color-diff-napi 等恶意包,专门诱导那些试图在本地编译泄露源码的开发者下载。这再次提醒我们,AI 时代的软件供应链攻击正变得前所未有的精准。

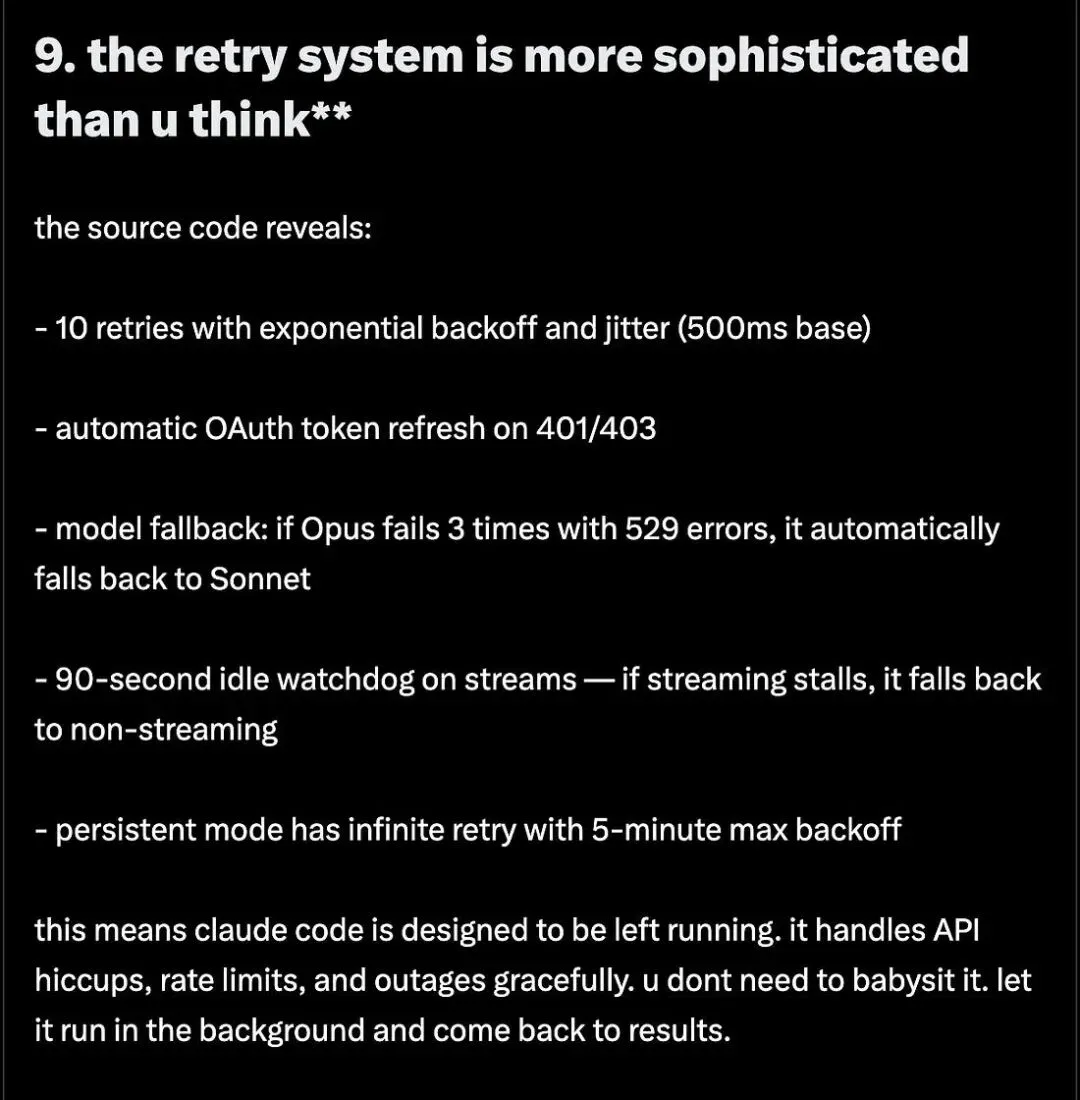

其次是竞争格局。泄露的架构逻辑证明了:AI 工具的护城河不在于算法的神秘感,而在于对海量边缘情况的处理和诊断工具的积累。 正如一位资深工程师所言,Claude Code 充满了针对模型特定行为的条件分支代码。这些“脏活累活”才是确保产品可用的关键。随着这些逻辑的公开,开源社区和竞争对手(如 Qwen 或 Nous)在构建 Agent 框架时将获得极大的启发 [3]。

五、结语:Agent 工程化时代的到来

尽管 Anthropic 正在紧急通过 DMCA 手段清理泄露代码,但覆水难收。这次泄露事件从侧面终结了一个时代——那个认为只要模型足够强,Agent 就能自动生成的幻觉时代。真正的生产力工具,需要的是对内存、缓存、工具链和错误处理的极致雕琢。

从 OpenAI 的巨额融资到 Claude Code 的源码迷思,AI 行业正从“炼金术”转向“精密工业”。对于开发者而言,模仿模型的时代已经过去,学习如何构建像 Claude Code 这样复杂的“外壳”,才是通往 AGI 下半场的入场券。

参考链接

- [1] https://www.latent.space/p/ainews-the-claude-code-source-leak

- [2] https://twitter.com/scaling01/status/17743210987654321

- [3] https://github.com/PrismML/Bonsai-Models

- [4] https://www.reddit.com/r/LocalLlama/comments/claude_code_leak_analysis

AI群: 欢迎加我微信 tsla10timesAI交流,拉你进群!我们刚刚建立这个AI交流社群,正在寻找志同道合的朋友一起成长!

夜雨聆风

夜雨聆风